Este texto se tradujo utilizando el sistema de traducción automatizado de Salesforce. Realice nuestra encuesta para proporcionar comentarios sobre este contenido e indicarnos qué le gustaría ver a continuación.

Note

Descripción general

Las compañías a menudo almacenan datos en Salesforce y otros lagos de datos externos como Snowflake, Google BigQuery, Databricks, Redshift o almacenamiento en la nube como Amazon S3. Este aislamiento de datos en diferentes sistemas de origen supone un reto para las compañías que desean aprovechar toda la potencia de sus datos.

Los arquitectos que trabajan para reunir datos entre múltiples lagos de datos se enfrentan a decisiones arquitectónicas clave sobre cómo integrar mejor esos datos. Data 360 ofrece múltiples opciones para la integración de datos, cada una de las cuales ofrece diferentes pros y contras.

Esta guía proporciona un marco de trabajo para evaluar qué patrón se ajusta mejor a sus requisitos de latencia, costo, capacidad de ampliación, gobernanza y complejidad al integrar datos, ayudándole a elegir cuándo utilizar el ingreso de datos, la federación de datos Cero copia o un enfoque híbrido. La guía también le ayudará a seleccionar entre diferentes métodos de ingreso de datos y federación de datos, cada uno de los cuales satisface una necesidad diferente.

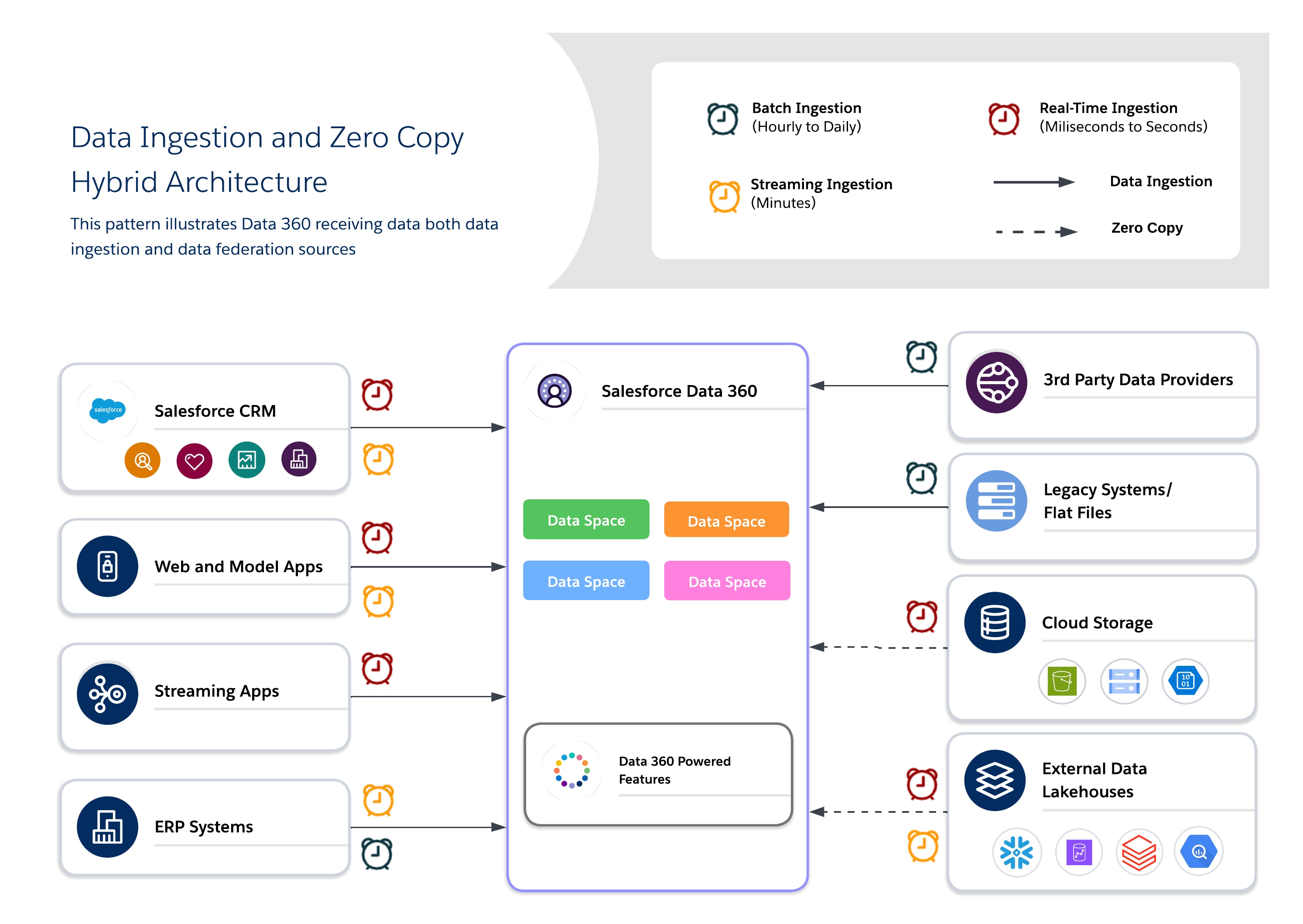

La integración de lagos de datos externos con Data 360 requiere una cuidadosa consideración de las compensaciones entre la actualización de datos, la gobernanza y la eficiencia de las oportunidades en curso. Por ejemplo, el uso de consultas en vivo de federación de datos Cero copia maximiza la actualización de los datos pero puede reducir la eficiencia de las oportunidades en curso a medida que mueve más datos por la red. Por lo tanto, para la mayoría de las implementaciones del mundo real, una combinación de ingreso y federación en un ecosistema de lago de múltiples nubes es la ruta óptima. Este enfoque híbrido garantiza una arquitectura ampliable, gobernada e interoperable que admite sin problemas cargas de trabajo operativas de baja latencia como la personalización en tiempo real y la detección de fraudes, así como cargas de trabajo analíticas como los reportes normativos y el análisis de tendencias históricas. Esta guía de decisiones le ayudará a comprender cómo navegar por estas compensaciones y seleccionar la estrategia correcta.

Comida para llevar

- Ingreso de datos: Copia datos en Salesforce Data 360, creando modelos de datos gobernados y canónicos. Ideal cuando necesita:

- Cree un Customer 360 integral: Unifique y transforme orígenes dispares en un único perfil de confianza.

- Cumplir el estricto cumplimiento normativo: Cree una copia auditable y centralizada donde el acceso a los datos y el linaje puedan controlarse estrictamente.

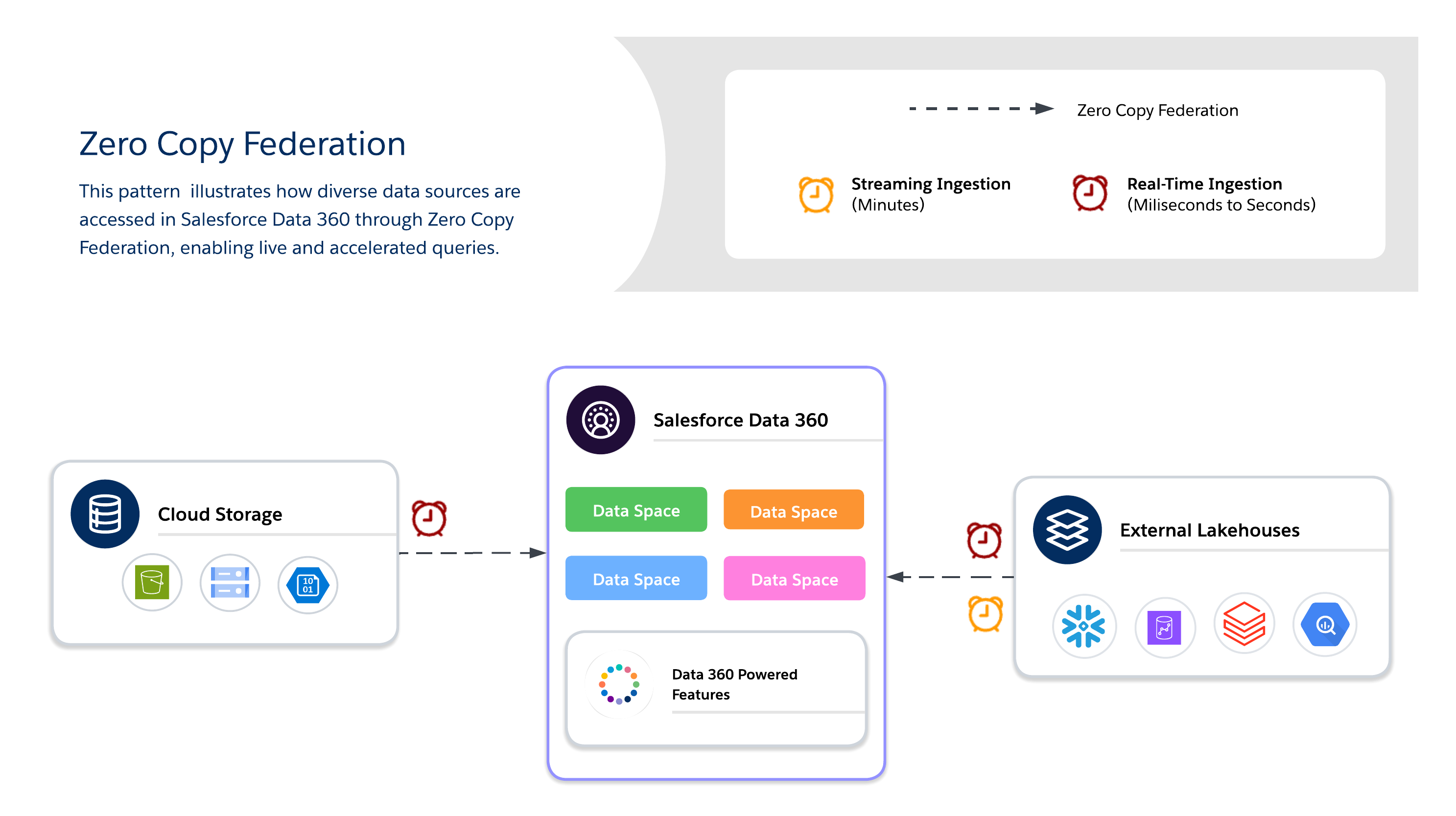

- Federación de copia cero: Consulta fuentes externas en tiempo real sin duplicaciones, lo que permite la personalización en tiempo real, los tableros en vivo y la incorporación rápida de fuentes. Dos opciones principales con compensaciones que debe equilibrar:

- En vivo y en caché (Consulta acelerada): Lo mejor para análisis interactivos y tableros en tiempo real en datos que viven en plataformas de datos externas como Snowflake, Google BigQuery, Redshift o Databricks. Evita la duplicación de datos lenta y costosa enviando el procesamiento al sistema de origen.

- Federación de archivos: Ideal para el procesamiento por lotes a gran escala y el entrenamiento de modelos de IA en datos en su lago de datos de nube (S3, ADLS). Evita el ingreso costoso y lento consultando directamente archivos en formatos de tabla abierta, desbloqueando conjuntos de datos masivos para cargas de trabajo de ciencias de datos y ETL.

- Modelo híbrido: Combine el ingreso para Perfiles unificados con la federación para una mayor frescura, lo que admite la implicación de OmniCanal, acciones dirigidas por Agentforce y capacitación de IA/ML.

Consideraciones importantes

-

Arquitectura híbrida: La mezcla de ingreso de datos y federación de datos a menudo es necesaria.

- Utilice Ingreso de datos en datos críticos para modelos de datos canónicos y gobernanza principal.

- Organice todos los demás datos a través de Cero copia para minimizar la carga operativa de la creación y el mantenimiento de las oportunidades en curso de datos de ingreso.

-

La frecuencia de ingreso de datos importa: Seleccione la frecuencia basándose en el valor de negocio, las necesidades de latencia y la complejidad operativa.

- Utilice el tiempo real para flujos de trabajo urgentes (personalización, tableros en vivo, acciones Agentforce).

- Casi en tiempo real para procesos de urgencia moderada (campañas, reportes operativos).

- Lote para conjuntos de datos históricos o de baja velocidad.

-

Coincidencia del patrón de federación con latencia y desempeño: Seleccione el que mejor se ajuste a sus patrones de acceso y los requisitos de frescura, desempeño y costo.

- Utilice Live Query para tableros operativos y personalización en tiempo real donde la baja latencia es crítica.

- Utilice el almacenamiento en caché (Consulta acelerada) cuando las consultas son frecuentes pero los resultados ligeramente obsoletos son aceptables, lo que equilibra el desempeño y el costo.

- Utilice Federación de archivos para análisis a gran escala y con alto rendimiento o cargas de trabajo por lotes que son ideales para conjuntos de datos históricos o menos urgentes.

-

Alinear la gobernanza con los requisitos de residencia de datos:

- Utilice el ingreso donde la regulación centralizada es crítica.

- Utilice la federación donde la gobernanza descentralizada es aceptable, mientras aplica una gobernanza estricta en el origen externo. Cero copia respeta políticas a nivel de origen como la seguridad a nivel de filas (RLS) y el enmascaramiento de datos.

-

Dar prioridad al ingreso para flujos de trabajo de alto valor: Aplique el ingreso de forma selectiva a procesos críticos como la resolución de identidad, la creación de reportes regulatorios y la activación operativa.

-

Costo y complejidad dirigen la decisión: El ingreso en tiempo real puede ser costoso y complejo. Los arquitectos deben sopesar el costo de incorporar, almacenar y transformar datos con el costo de consultarlos directamente a través de Cero copia.

La selección del patrón de integración correcto (Ingreso de datos, Cero copia o un enfoque híbrido) afecta directamente a la latencia, la gobernanza, la eficiencia operativa y el costo entre plataformas de múltiples nubes. Esta decisión determina cómo se pueden entregar perspectivas en tiempo real, activación dirigida por IA e implicación personalizada de forma fiable y a escala.

Comparación de productos

Esta tabla proporciona una comparación técnica de patrones de ingreso de datos y copia cero en Salesforce Data 360, centrándose en funciones, compensaciones y beneficios, junto con casos de uso y resultados de negocio. Los arquitectos pueden utilizar esto como una referencia para el diseño de plataformas de datos híbridas de múltiples nubes que equilibran el desempeño, el costo y el cumplimiento.

| Tipo de patrón | Modo / Herramienta | Beneficios | Consideraciones | Resultados |

|---|---|---|---|---|

| Ingreso de datos | Tiempo real: Ingreso de latencia por debajo del segundo a través de las API de ingreso con compatibilidad de CDC. Canalizaciones de transmisión continua. | - Perspectivas inmediatas - Ideal para casos de uso operativos y de personalización de baja latencia - Admite flujos de trabajo dirigidos por eventos |

- Alto costo - Arquitectura compleja - Requiere sistemas de origen de baja latencia - Las fuentes de gran volumen pueden causar una transmisión excesiva que conduce a oportunidades en curso saturadas - E/S intensiva - Considerar campos selectivos y filtrado para reducir los gastos generales |

Agentforce: - Alertas de fraude en tiempo real, personalización minorista, alertas operativas Analytics: - Tableros de subsegundos, monitoreo de KPI Cumplimiento: - Actualizaciones continuas de registros de clientes para flujos de trabajo regulados |

| Transmisión:Ingreso de microlotes cada 1 a 3 minutos a través de conectores nativos | Costo equilibrado frente a frescura - Arquitectura más sencilla que en tiempo real - Admite actualizaciones incrementales |

- Latencia ligera - Puede no ser adecuado para decisiones críticas de subsegundos - El tamaño de lote afecta a la memoria/cómputo - E/S es moderada - Lo mejor para patrones de actualización predecibles y repetidos - Considere la agregación con ventanas para reducir la carga de procesamiento |

Agentforce: - Desencadenadores de campaña oportunos, implicación casi en vivo Analytics: - Motores de recomendaciones, tableros casi en vivo Cumplimiento: - Actualizaciones frecuentes con capacidad de auditoría |

|

| Lote: Cargas de gran volumen programadas a través de conectores o API. Admite almacenamiento de objetos y oportunidades en curso de ETL/ELT. | - Costo-eficiente para conjuntos de datos masivos - Fácil de implementar - Fiable para análisis históricos |

- Latencia de datos - Inadecuado para operaciones urgentes - E/S intensiva durante los plazos de carga - El rendimiento de red puede convertirse en un cuello de botella para archivos de gran tamaño - Ideal para flujos de trabajo de agregación histórica o creación de reportes regulados |

Agentforce: - Tickets de asistencia de TI (Jira/ServiceNow), flujos de trabajo agregados Analytics: - Análisis histórico, evaluación de tendencias Queja: - Creación de reportes reguladores, agregación de datos de pacientes/reclamaciones |

|

| Zero Copy | Consulta en vivo: Consultas directas en sistemas externos; esquema en lectura; sin duplicación de datos | - Máxima frescura - Gastos generales de almacenamiento mínimos; admite perspectivas operativas en tiempo real |

-Dependiendo del desempeño de origen - El alto volumen de consultas puede afectar a la latencia - Ideal para consultas con distribución y agregación de predicados para minimizar las E/S - Evitar consultas sin filtrar en conjuntos de datos masivos |

Agentforce: - Flujos de trabajo dinámicos adaptándose a la actividad en vivo Analytics: - Tableros operativos, creación de reportes en vivo Cumplimiento: - Respeta la seguridad a nivel de filas y el enmascaramiento en origen |

| Consulta acelerada (almacenamiento en caché): Copias locales en caché para consultas federadas. Configurable de 15 min a 7 días. Ejecución de consultas optimizada | - Reduce la latencia - Menor costo que las consultas en vivo repetidas - Mejora el desempeño para patrones de acceso frecuente |

- Gestión de caché requerida - El estado depende del intervalo de caché - Ideal para consultas de alta frecuencia - No apto para la decisión de subsegundos |

Agentforce: - Mediciones de implicación preagregadas para una decisión rápida Analytics: - Tableros de BI, segmentación, creación de reportes analíticos Cumplimiento: - Tableros regulados coherentes con registros de auditoría |

|

| Federación de archivos: Acceso directo a grandes conjuntos de datos históricos en establecimientos de objetos o lagos (S3, Iceberg, Google BigQuery, Redshift). | - Gestiona conjuntos de datos a gran escala Almacenamiento mínimo en Data 360 - Admite cargas de trabajo de IA/ML |

-Solo lectura - El desempeño de las consultas depende del rendimiento del sistema externo - Optimizado para trabajos intensivos de rendimiento y por lotes - No apto para tablero en tiempo real |

Agentforce: - (No es típico — pesado por lotes) Analytics: - Entrenamiento de ML/IA, análisis histórico, creación de reportes a escala de petabytes Cumplimiento: Acceso regulado a conjuntos de datos externos sin duplicación |

Patrones de integración de Data 360

Ingreso de datos

Con el ingreso de datos, los datos se copian físicamente en Data 360 y se rigen completamente, a diferencia de Cero copia donde los datos permanecen en el origen. Computar las transformaciones se produce en Data 360, lo que permite la gestión y la auditoría centralizadas.

Casos de uso de ingreso de datos

Utilice el ingreso de datos para almacenar conjuntos de datos gobernados canónicos en Salesforce Data 360 para el cumplimiento y el control operativo. Utilice el ingreso cuando se requiera control completo, auditoría y trazabilidad. Ideal para flujos de trabajo regulados o de alto valor donde la computación centralizada y la gobernanza son fundamentales.

El ingreso es el mejor para crear una base de confianza para la resolución de identidad, la creación de reportes regulatorios, flujos de trabajo dirigidos por IA de misión crítica y la implicación de clientes.

Métodos de ingreso de datos

Los métodos de ingreso de datos varían dependiendo del conector que utilice para ingresar sus datos. Algunos conectores ofrecen una variedad de métodos de ingreso, mientras que otros solo funcionan en modo por lotes o transmisión. Consulte Datos 360: Integraciones y conectores para una lista completa de conectores de Data 360 y sus métodos disponibles.

- En tiempo real

- Ingreso de subsegundos utilizando oportunidades en curso de transmisión o Captura de datos de cambios (CDC).

- Ideal para flujos de trabajo urgentes (detección de fraude, personalización, tableros operativos).

- Distribuya transformaciones y agregaciones en Data 360 para reducir las E/S descendentes y optimizar el uso de computación. Utilice CDC incrementales para minimizar la reorganización de datos.

- Transmisión

- Ingesta cada 1-3 minutos en pequeños incrementos.

- Equilibra la frescura y el costo, adecuados para la orquestación de campañas, la implicación casi en vivo y los reportes operativos.

- Utilice microlotes para controlar picos de E/S. Agregue datos en origen si es posible para reducir los volúmenes de transferencia y optimizar el almacenamiento.

- Lote (Cargas programadas)

- Ingreso periódico de grandes conjuntos de datos (por hora, diariamente, semanalmente).

- Rentable y fiable para conjuntos de datos históricos, creación de reportes regulatorios y casos de uso de cumplimiento.

- Asegúrese de calcular la localidad en la misma región que el almacenamiento de origen para la optimización de desempeño y costos.

Libro de jugadas de arquitecto

- Casos de uso para ingreso de datos

- Generar perfiles unificados Customer 360: Creación de una fuente de verdad única para la identidad y los atributos del cliente.

- Mantener conjuntos de datos de cumplimiento normativo: Aplicación de la gobernanza, el linaje y la capacidad de auditoría para datos confidenciales.

- Centralice la orquestación de campañas: Garantizar que marketing, ventas y servicio funcionan desde conjuntos de datos coherentes y de confianza.

- Prácticas de diseño

- Favorezca el ingreso por lotes para necesidades históricas o tolerantes a baja latencia, como creación de reportes de archivo o instantáneas periódicas.

- Utilice las API de transmisión o CDC para mantener la actualización para flujos de trabajo operativos y de personalización, garantizando actualizaciones casi en tiempo real.

- Controle el almacenamiento y calcule el crecimiento aplicando cargas incrementales, en vez de volver a cargar conjuntos de datos completos, para optimizar el costo y la eficiencia.

- Alinee las oportunidades en curso de ingreso con la localidad de cálculo y el procesamiento incremental para reducir la E/S de red. Aplique transformaciones dentro de Data 360 para evitar mover datos sin procesar innecesariamente.

- Consideraciones de costos

- Ingreso en tiempo real: Costos de computación y oportunidades en curso más altos; justificados para flujos de trabajo de alto valor y urgentes como personalización, tableros operativos o acciones dirigidas por Agentforce.

- Ingreso de transmisión: Modere los costos de computación y almacenamiento; adecuado para actualizaciones frecuentes que pueden tolerar ligeros retrasos, como orquestación de campañas o creación de reportes operativos.

- Ingestión por lotes: Costos de computación más bajos, almacenamiento predecible; lo mejor para conjuntos de datos históricos o actualizaciones de baja frecuencia. El ingreso de datos por lotes desde organizaciones de Salesforce utilizando ciertos conectores es gratuito.

- Modo de actualización: La selección del modo Actualización incremental reduce el ingreso total y calcula los costos. Recomendamos utilizar la actualización incremental siempre que sea posible para optimizar la eficiencia entre todos los tipos de ingreso.

- El costo también se ve afectado por el volumen de E/S desde el origen a Data 360. La optimización de tamaños de lote, particiones y alineación regional reduce los costos de transferencia y mejora el desempeño.

- Escenarios industriales

- Finanzas: Ingrese los conjuntos de datos requeridos para conocer a su cliente (KYC), Antilavado de dinero (AML) y detección de fraude, donde la capacidad de auditoría y el cumplimiento no son negociables.

- Cuidados sanitarios: Utilice el ingreso para la resolución de identidad de pacientes y registros compatibles con HIPAA, permitiendo vistas seguras y unificadas.

- Retail: Consolidar datos de punto de venta (POS), comercio electrónico y programa de fidelidad en perfiles unificados para segmentación y personalización

- Telecom: Apoye la prevención de abandonos y los análisis de uso con datos de suscriptor gobernados canónicos.

Criterios de decisión de método de ingreso de datos

| Función | Ingreso en tiempo real | Ingreso de transmisión | Ingestión por lotes |

|---|---|---|---|

| Latencia y frescura | Ingreso de latencia por debajo del segundo a través de las API de ingreso con compatibilidad con Captura de datos de cambios (CDC). Proporciona oportunidades en curso de transmisión continua. Ideal para casos de uso operativos de baja latencia. | Ingreso de microlotes cada 1 a 3 minutos a través de conectores nativos. Admite actualizaciones incrementales. Se espera una ligera latencia. | Se espera latencia de datos. Cargas de gran volumen programadas. Ingestión periódica (por hora, diariamente, semanalmente). Inadecuado para operaciones urgentes. |

| Casos de uso principales | Ideal para casos de uso operativos y de personalización de baja latencia. Se utiliza para flujos de trabajo urgentes. Admite flujos de trabajo dirigidos por eventos. Se utiliza para alertas de fraude en tiempo real y alertas operativas. | Adecuado para procesos de urgencia moderada. Se utiliza para orquestación de campañas, implicación casi en vivo y creación de reportes operativos. Se utiliza para desencadenadores de campaña oportunos. | Rentable para conjuntos de datos masivos. Fiable para análisis históricos. Se utiliza para flujos de trabajo de agregación histórica o creación de reportes regulados. Ideal para conjuntos de datos históricos o de baja velocidad. |

| Complejidad arquitectónica y E/S | Arquitectura compleja y de alto costo. Requiere sistemas de origen de baja latencia. E/S intensiva. Los orígenes de gran volumen pueden causar oportunidades en curso saturadas. | Arquitectura más sencilla que en tiempo real. E/S es moderada. Lo mejor para patrones de actualización repetidos y predecibles. El tamaño de lote afecta a la memoria/cómputo. | Fácil de implementar. intensivo de E/S durante los plazos de carga. El rendimiento de red puede convertirse en un cuello de botella para lotes grandes. |

| Consideraciones de costos | Costos de computación y oportunidades en curso más altos. Solo se justifica para flujos de trabajo de alto valor y urgentes. | Modere los costos de computación y almacenamiento. Proporciona un enfoque de costo frente a frescura equilibrado. Adecuado para actualizaciones frecuentes que pueden tolerar ligeros retrasos. | Reduzca los costos de computación y el almacenamiento predecible. Recomendado para conjuntos de datos históricos o actualizaciones de baja frecuencia. El ingreso a través de oportunidades en curso internas de Salesforce es gratuito. |

| Prácticas de diseño | Utilice CDC incrementales para minimizar la reorganización de datos. Filtre y utilice campos selectivos para reducir los gastos generales. | Utilice microlotes para controlar picos de E/S. Considere la agregación con ventanas para reducir la carga de procesamiento. | Favorezca esto para reportes de archivo o instantáneas periódicas. Asegúrese de calcular la localidad en la misma región que el almacenamiento de origen para la optimización de costos. |

Federación de datos de copia cero

Cero casos de uso de copia

Utilice Cero copia para la consulta en tiempo real de sistemas externos sin duplicación de datos, permitiendo agilidad, frescura y acceso ampliable a conjuntos de datos grandes o transitorios. Es mejor para tableros en vivo, análisis exploratorios, entrenamiento de modelo de IA/ML e implicación de clientes en tiempo real directamente a través de Salesforce Data 360.

Métodos de copia cero

Al utilizar Cero copia, los arquitectos deben decidir además entre tres métodos de federación de datos disponibles, cada uno de los cuales ofrece sus propias ventajas entre frescura, desempeño y costo.

- Consulta en vivo

- Ejecuta consultas directamente en sistemas externos (Snowflake, Google BigQuery, Redshift, Databricks, etc.) sin duplicación de datos.

- Óptimo cuando los predicados y las agregaciones se pueden empujar hacia abajo, minimizando el movimiento de datos en la red y reduciendo la E/S en el cálculo de Salesforce Data 360.

- Lo mejor para perspectivas en tiempo real y tableros operativos de baja latencia. Dependiendo del desempeño del sistema externo.

- Almacenamiento en caché (Consulta acelerada)

- Almacena temporalmente copias en caché de datos federados en Salesforce Data 360.

- Reduce los costos y la latencia de consultas repetidas para conjuntos de datos a los que se accede con frecuencia, con duración configurable (minutos a días).

- Los datos no se copian de forma permanente ni se rigen completamente; la actualización se gestiona a través de actualizaciones programadas desde el origen.

- Federación de archivos

- Proporciona acceso directo de solo lectura a conjuntos de datos a gran escala en establecimientos de objetos (por ejemplo, S3, GCS con Iceberg).

- Ideal para cargas de trabajo de IA/ML, análisis históricos y creación de reportes a escala de petabytes sin mover datos.

- El desempeño de las consultas depende en gran medida del formato del objeto, la partición y la E/S de red. Las exploraciones de gran tamaño pueden generar E/S sustanciales si no están optimizadas.

Libro de jugadas de arquitecto

- Casos de uso

- Personalización en tiempo real y flujos de trabajo adaptativos: Entregue ofertas dinámicas, recomendaciones y las mejores acciones siguientes a medida que cambia el comportamiento de los clientes.

- Tableros en vivo y análisis operativos: Potencie tableros clave de negocio y KPI directamente desde almacenes externos.

- Entrenamiento de modelo de IA/ML con grandes conjuntos de datos externos: Aproveche datos a escala de petabytes desde lagos de datos y almacenes utilizando Federación de archivos sin moverlos.

- Escenarios industriales

- Retail/Media: Active recomendaciones personalizadas e implicación de clientes en tiempo real federando datos de interacciones de contenido o transmisiones de clics.

- Finanzas: Ejecute la detección de fraudes y el puntuaje de riesgos casi en tiempo real consultando almacenes externos sin duplicar datos confidenciales.

- Tech/Enterprise: Admita la creación de reportes entre nubes, tableros de servicio de TI y análisis operativos donde los conjuntos de datos residen en múltiples sistemas.

- Prácticas de diseño

- Consulta en vivo

- Utilizar para consultas de alta QPS y baja latencia cuando la actualización es crítica.

- Envíe predicados y agregaciones al sistema externo para reducir la reorganización de datos en la red.

- Evite consultas que exploran volúmenes de datos masivos innecesariamente; considere filtros y poda de particiones.

- Federación de archivos

- Acceda a conjuntos de datos a escala de petabytes en establecimientos de objetos sin ingreso.

- Mantenga el almacenamiento de objetos en la misma región de nube que Salesforce computa para minimizar la latencia y los costos de salida.

- Utilice formatos particionados y columnares (Parquet/ORC) y filtros de distribución para reducir la transferencia de E/S y red.

- Aproveche la distribución de consultas y predicados para filtrar y agregar datos en el origen, reduciendo el movimiento de datos.

- Evite el acceso a datos entre regiones a menos que sea necesario, ya que aumenta la E/S, la latencia y los costos.

- Almacenamiento en caché (Consulta acelerada)

- Almacenar en caché conjuntos de datos a los que se accede frecuentemente para equilibrar el costo y el desempeño.

- Configure intervalos de actualización para equilibrar la actualización frente al costo de consulta.

- Cumplimiento: Aplique la regulación en el origen aprovechando la seguridad a nivel de filas (RLS) y enmascarando políticas directamente en sistemas federados. A continuación se muestran mejores prácticas para RLS uniforme y enmascaramiento entre plataformas.

- Utilice un Id. de compañía centralizado: Asigne usuarios y entidades en Salesforce Data 360 a un identificador de compañía único y centralizado que se corresponda con identidades en sistemas externos.

- Alinear políticas de seguridad: Garantice que las políticas de enmascaramiento y seguridad a nivel de filas en sistemas federados se aplican basándose en la identidad asignada. Esto mantiene el cumplimiento al consultar datos externos.

- Estandarizar esquemas de identidad: Mantenga atributos de identidad coherentes (email, Id. de usuario, Id. de cliente, etc.) entre todos los orígenes de datos para evitar desajustes e infracciones de acceso.

- Consulta en vivo

- Consideraciones de costos

- Consulta en vivo: Modelo de pago por consulta: los costos se acumulan en computación externa de Lakehouse y pueden aumentar con un alto QPS. Lo mejor para casos de uso críticos de frescura donde el valor es superior a la variabilidad de costos.

- Consulta acelerada (almacenamiento en caché): Reduce el costo de la consulta en comparación con Consulta en vivo reduciendo las coincidencias en el sistema de origen, pero agrega costos de ingreso de datos por lotes para rellenar y actualizar la caché. Ideal para conjuntos de datos a los que se accede con frecuencia.

- Federación de archivos: Opción de almacenamiento más barata como datos en Almacén de objetos, pero los costos de consulta dependen del tamaño del archivo, la partición y la poda. Ideal para datos históricos o masivos a escala de petabytes.

Criterios de decisión de método de copia cero

| Punto de decisión | Consulta en vivo | Almacenamiento en caché (Consulta acelerada) | Federación de archivos |

|---|---|---|---|

| Ubicación de origen de datos | Lagos de datos externos (Snowflake, Google BigQuery, Redshift, Databricks). | Lagos de datos externos (Snowflake, Google BigQuery, Redshift, Databricks) | Almacenamientos de objetos o lagos de datos en la nube (S3, ADLS, GCS), a menudo utilizando formatos de tabla abiertos como Iceberg. |

| Propósito/Caso de uso | Ideal para análisis interactivos y tableros en tiempo real. Lo mejor para la personalización en tiempo real y flujos de trabajo dinámicos. | Lo mejor para cuando las consultas son frecuentes pero los resultados ligeramente obsoletos son aceptables. Adecuado para tableros de BI y segmentación. | Ideal para el procesamiento por lotes a gran escala y el entrenamiento de modelos de IA/ML. Ideal para análisis históricos y creación de reportes a escala de petabytes. |

| Frescura/Latencia | Máxima actualización; las consultas se ejecutan directamente en tiempo real. Admite decisiones por debajo del segundo. | Los resultados ligeramente obsoletos son aceptables. La actualización depende del intervalo de caché, configurable de 15 minutos a 7 días. | Optimizado para trabajos intensivos de rendimiento y por lotes. No es adecuado para tableros en tiempo real. |

| Patrón de acceso | Ideal para consultas poco frecuentes o ad hoc. Utilizar para consultas de alta QPS (consulta por segundo) y baja latencia donde la actualización es crítica. | Ideal para escenarios de lectura de alta frecuencia. Mejora el desempeño para patrones de acceso frecuentes. | Acceso de solo lectura. Adecuado para conjuntos de datos a escala de petabytes sin ingreso. |

| Controladores de desempeño | Muy dependiente del desempeño del sistema de origen externo. Optimizado cuando los predicados y las agregaciones pueden enviarse hacia abajo al origen. | Reduce la latencia en comparación con consultas en vivo repetidas. El desempeño depende de la gestión y el intervalo de caché. | El desempeño depende en gran medida del formato del objeto, la partición y el rendimiento del sistema externo. Utilice formatos particionados y de columnas (Parquet/ORC). |

| Consecuencias de costos | Modelo de pago por consulta. Los costos se acumulan en computación de Lakehouse externa. Rentable para consultas poco frecuentes, pero los gastos pueden aumentar con un alto volumen de consultas por segundo (QPS). | Costo inferior al de las consultas en vivo repetidas. Reduce la necesidad de consultar repetidamente el origen externo. Agrega almacenamiento en caché y gastos generales de actualización. | Opción de almacenamiento más barata. Los costos de consulta dependen del tamaño del archivo y la partición. |

| Consideración clave | Evite consultas sin filtrar que exploran volúmenes de datos masivos innecesariamente. | Requiere gestión de caché. No es adecuado para la decisión de subsegundos. | El desempeño de las consultas se basa en gran medida en la optimización a través de particiones y distribución de predicados. |

Enfoque híbrido

Las arquitecturas híbridas permiten a los arquitectos anclar conjuntos de datos críticos en Data 360 para una gobernanza centralizada mientras aprovechan las consultas federadas para una actualización, una duplicación reducida y un acceso ampliable a grandes conjuntos de datos externos. Este enfoque equilibra las E/S, calcula la localidad, el costo y los requisitos de cumplimiento.

Casos de uso híbridos

Utilice un enfoque híbrido para una gobernanza equilibrada, frescura y eficiencia operativa combinando el ingreso de datos y la copia cero para entregar perspectivas con capacidad de acción en tiempo real. Utilice el ingreso para conjuntos de datos regulados de alto valor donde se requiere trazabilidad, RLS y enmascaramiento, y la federación para conjuntos de datos efímeros o de gran volumen donde la actualización y el desempeño son clave.

Libro de jugadas de arquitecto

- Casos de uso

- Participación de OmniCanal: Combine datos históricos de clientes con comportamiento en tiempo real para entregar experiencias coherentes y contextuales.

- Oportunidades en curso de IA/ML: Entrene modelos en conjuntos de datos canónicos depurados mientras los enriquece con señales sin procesar o en tiempo real procedentes de fuentes externas.

- Necesita cumplimiento y agilidad mixtos: Aplique una regulación estricta para datos confidenciales pero federe para agilidad operativa.

- Escenarios industriales

- Retail: Utilice el ingreso para la resolución de identidad y la unificación de perfiles; federe para ofertas en tiempo real y personalización.

- Cuidados sanitarios: Mantenga registros de pacientes dorados a través del ingreso mientras federa transmisiones de dispositivos IoT y datos de sensores para contexto inmediato.

- Servicios financieros: Ingrese datos regulados en un lago regulado por el cumplimiento mientras federa consultas externas para la detección de fraude y el monitoreo de riesgos.

- Prácticas de diseño

- Ancle la gobernanza con el ingreso: Ingrese datos de alto valor o regulados en modelos canónicos para garantizar Trust y cumplimiento.

- Utilizar Federation for Freshness: Permita a los lagos externos proporcionar acceso a datos en tiempo real o a gran escala sin duplicación.

- Equilibrar costo frente a Desempeño: Perfil de cargas de trabajo para decidir qué ingresar frente a federar, minimizando los costos de almacenamiento o consulta innecesarios.

- Aplicar gobernanza por capas: Aplique la regulación centralizada para datos ingresados, mientras aprovecha los propios controles de seguridad de sistemas federados (por ejemplo, RLS, enmascaramiento).

- Cuando diseñe oportunidades en curso híbridas, garantice el ingreso incremental para conjuntos de datos históricos y envíe agregaciones o filtros a orígenes federados para optimizar la E/S y calcular el uso.

- Consideraciones de costos

- Optimice el costo total frente al desempeño combinando el ingreso para el cumplimiento o los datos críticos con la federación cuando sea necesaria la actualización.

- Tenga en cuenta las E/S y calcule la distribución al mezclar el ingreso y la federación. Para reducir el costo de computación en sistemas de origen de consultas repetidas, utilice el almacenamiento en caché (Consulta acelerada) para conjuntos de datos federados de alta lectura y acceso frecuente.

Guía de decisiones de casos de uso

A continuación se muestran arquetipos comunes que ilustran cómo aplicar esta lógica.

- El arquetipo "Fuente única de la verdad": Centralizar y gobernar

- Escenario: Necesita crear perfiles Customer 360 unificados que cumplan los requisitos para toda su compañía global. Los datos proceden de una docena de sistemas diferentes, deben cumplir con las estrictas leyes de RGPD y CCPA y servirán como la fuente de confianza para todas las interacciones de marketing y servicio.

- Patrón recomendado: Ingreso de datos. La prioridad es la gobernanza, Trust y Control. El ingreso de los datos en Data 360 es la única forma de crear un perfil canónico completamente auditable que esté aislado de los sistemas de origen.

- El arquetipo "Perspectivas en tiempo real": Analizar sin moverse

- Escenario: Su equipo de ciencia de datos necesita ejecutar consultas exploratorias en una tabla de transacciones masiva y en constante actualización en Snowflake. Al mismo tiempo, su equipo ejecutivo desea un tablero de BI en vivo con esos mismos datos. Mover petabytes de datos diariamente es demasiado lento y costoso.

- Patrón recomendado: Zero Copy Federation. La prioridad es la velocidad, la agilidad y la rentabilidad a escala. Cero copia le permite aprovechar el inmenso poder de su almacén de datos existente para consultas en tiempo real sin la sobrecarga y la latencia de la duplicación de datos.

- El arquetipo "Inteligencia híbrida": Gobernar el núcleo, federar el borde

- Escenario: Desea enriquecer sus perfiles de clientes gobernados e ingresados con señales de comportamiento en tiempo real (como clics de sitios web) desde un lago de datos. Necesita la estabilidad del perfil principal pero la inmediatez de los datos en vivo para potenciar la personalización en el momento.

- Patrón recomendado: Un enfoque híbrido. Utilice el ingreso de datos para crear el núcleo estable y regulado de sus datos de clientes. Luego utilice Cero copia para federar los datos volátiles en tiempo real, uniéndolos en el momento de la consulta para una vista completa al segundo.

El camino a seguir

La estrategia de datos de compañía ya no se trata de elegir un patrón de integración único: se trata de diseñar flexibilidad controlada dentro de un ecosistema de datos interoperable. La selección del método de integración de datos correcto para cada sistema de datos de origen en base a las necesidades de negocio a menudo lleva a un enfoque híbrido que combina los puntos fuertes del ingreso de datos y la federación de datos.

- Ingrese conjuntos de datos gobernados de misión crítica en Salesforce Data 360 para el cumplimiento, la resolución de identidad y los flujos de trabajo operativos.

- Genere datos a través de Cero copia para análisis en vivo, exploratorios y dirigidos por IA sin duplicar el almacenamiento.

Salesforce Data 360 en Hyperforce ofrece resiliencia y capacidad de ampliación de múltiples regiones. ts open lakehouse with Iceberg tables permite calcular la separación y la interoperabilidad con plataformas como Snowflake, Databricks y S3 Iceberg, formando la columna vertebral de un ecosistema de datos multinube verdaderamente interoperable.

A medida que evolucionan los ecosistemas de datos, equilibre continuamente la frescura, el costo, el desempeño y el cumplimiento para mantener la agilidad arquitectónica. Prepare su plataforma para el futuro unificando datos ingresados y gobernados con acceso federado. Esto permite la inteligencia en tiempo real, la activación de IA y la personalización a escala de compañía entre nubes, regiones y dominios de negocio.

Las soluciones únicas no se adaptan a la mayoría de los negocios. La estrategia ��ptima asigna el patrón correcto al controlador de negocio correcto.

Acerca de los autores

Yugandhar Bora es Arquitecto de Ingeniería de Software en Salesforce, especializado en arquitectura de datos dentro de la plataforma Aplicaciones de inteligencia y datos. Lidera iniciativas de la junta de revisión de arquitectura de negocio (EARB) centradas en la gobernanza de datos y modelos de datos unificados, mientras contribuye a soluciones de aprovisionamiento de plataforma automatizadas.

Jan Fernando es Arquitecto principal en la Oficina del Arquitecto jefe de Salesforce. Se unió a Salesforce en 2012, aportando una gran experiencia desde su época en el ecosistema de startups. Antes de incorporarse a la Oficina del Arquitecto Jefe, pasó más de una década en la organización Platform, donde dirigió varias transformaciones tecnológicas clave.

26 minute read