Integrações modernas do Salesforce devem oferecer suporte a muito mais do que uma simples troca de dados. É esperado que eles aprimorem as experiências do cliente em tempo real, coordenem ações em vários sistemas e operem com confiança em escala corporativa, tudo ao mesmo tempo que atendem a requisitos de segurança e conformidade rígidos. Assim, escolher a abordagem de integração certa é uma decisão arquitetônica crítica, não um detalhe da implementação. Considere um cenário corporativo comum. Um cliente conclui uma compra em um aplicativo móvel, acionando uma verificação de elegibilidade em tempo real para uma oferta personalizada. Ao mesmo tempo, os dados da transação devem ser registrados em um sistema ERP, os atributos do cliente atualizados no Salesforce e a análise transmitida para um data lake sem introduzir latência, duplicação de dados ou risco de conformidade. Cenários como esse agora são típicos em ambientes do Salesforce modernos, em que o Salesforce raramente opera isoladamente e deve se integrar perfeitamente a um ecossistema mais amplo de aplicativos e plataformas de dados. Esse guia existe para ajudar arquitetos e desenvolvedores a projetar essas integrações com clareza e confiança. Em vez de se concentrar em implementações ponto a ponto, ele apresenta um conjunto de padrões de integração comprovados que abordam cenários empresariais recorrentes, como orquestração de processos, sincronização de dados e acesso a dados em tempo real. Cada padrão enfatiza a intenção arquitetônica, as compensações e os modelos de execução, permitindo que as equipes tomem decisões de design bem informadas que tenham escala e resistência. Neste documento, você encontrará:

- Padrões de integração que representam "arquétipos" corporativos comuns em cenários de processo, dados e acesso virtual

- Uma estrutura de seleção de padrão para ajudar a identificar a abordagem certa com base na intenção de integração e no momento da execução

- Orientação prática sobre aspectos de escalabilidade, resiliência, governança e segurança

- Práticas recomendadas obtidas de implementações do Salesforce e do Data 360 no mundo real O objetivo deste documento é fornecer uma linguagem arquitetônica compartilhada para integração, ajudando as equipes a projetar soluções que equilibram o desempenho, a flexibilidade e o Trust, alinhando-as às estratégias de governança e dados corporativos.

Este documento é para designers e arquitetos que precisam integrar dados de outros aplicativos em suas empresas com o Salesforce Data 360 (antigo Data Cloud). Esse conteúdo é uma distilação de muitas implementações bem-sucedidas por arquitetos e parceiros do Salesforce. Para se familiarizar com as funcionalidades e opções de integração disponíveis para adoção em grande escala do Data 360, leia as seções Resumo do padrão e Guia de seleção de padrão abaixo. Arquitetos e desenvolvedores devem considerar esses detalhes do padrão e práticas recomendadas durante a fase de design e implementação de projetos de interação de dados no Data 360. Se implementados adequadamente, esses padrões permitem que você entre na produção o mais rápido possível e tenha o conjunto de aplicativos mais estável, escalonável e livre de manutenção possível. Os próprios arquitetos de consultoria do Salesforce usam esses padrões como pontos de referência durante revisões de arquitetura e os mantêm e melhoram ativamente. Como acontece com todos os padrões, esse conteúdo abrange a maioria dos cenários de integração, mas não todos. Embora o Salesforce permita a integração da interface do usuário (UI), mascaramentos, por exemplo, essa integração está fora do escopo desse documento.

Cada padrão de integração segue uma estrutura consistente. Isso proporciona consistência nas informações fornecidas em cada padrão e também facilita a comparação de padrões.

- Nome: O identificador de padrão que também indica o tipo de integração contido no padrão.

- Contexto: O cenário geral de integração que o padrão aborda. O contexto fornece informações sobre o que os usuários estão tentando realizar e como o aplicativo se comporta para dar suporte aos requisitos.

- Problema: Expressado como uma pergunta, esse é o cenário que o padrão foi projetado para resolver. Leia esta seção para entender se o padrão é adequado para seu cenário de integração.

- Forças: As restrições e circunstâncias que tornam o cenário declarado difícil de resolver.

- Solução: A maneira recomendada de resolver o cenário de integração.

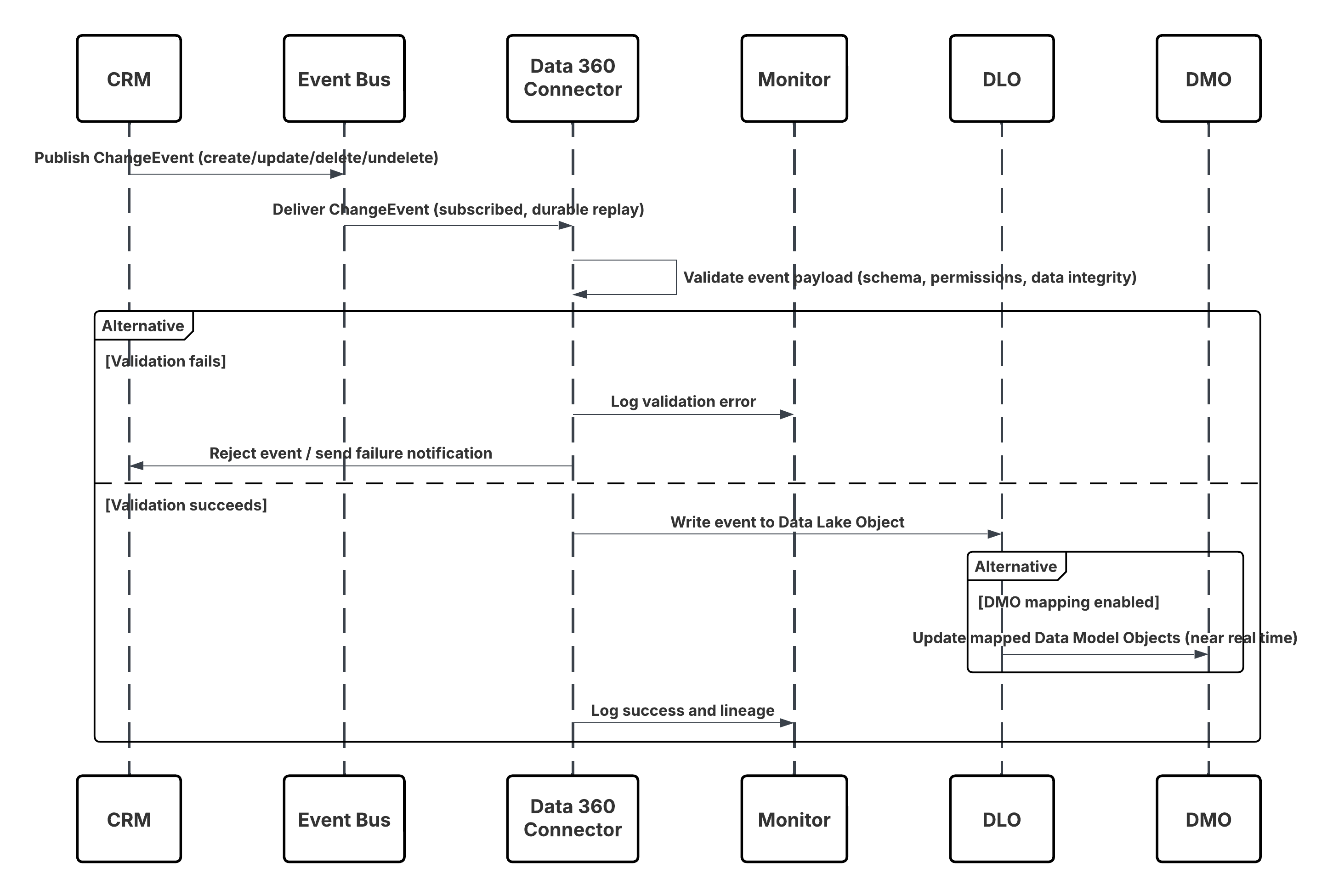

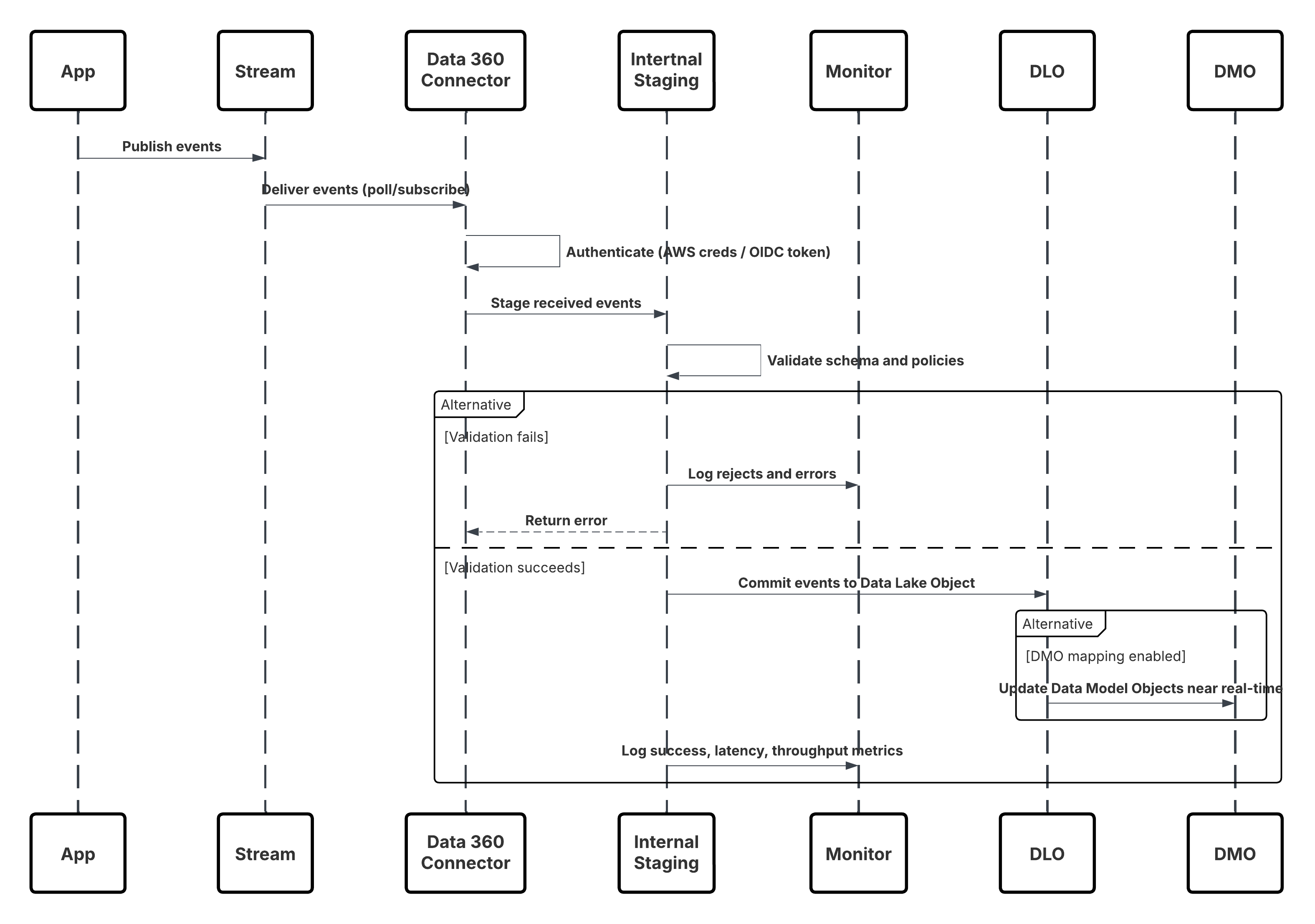

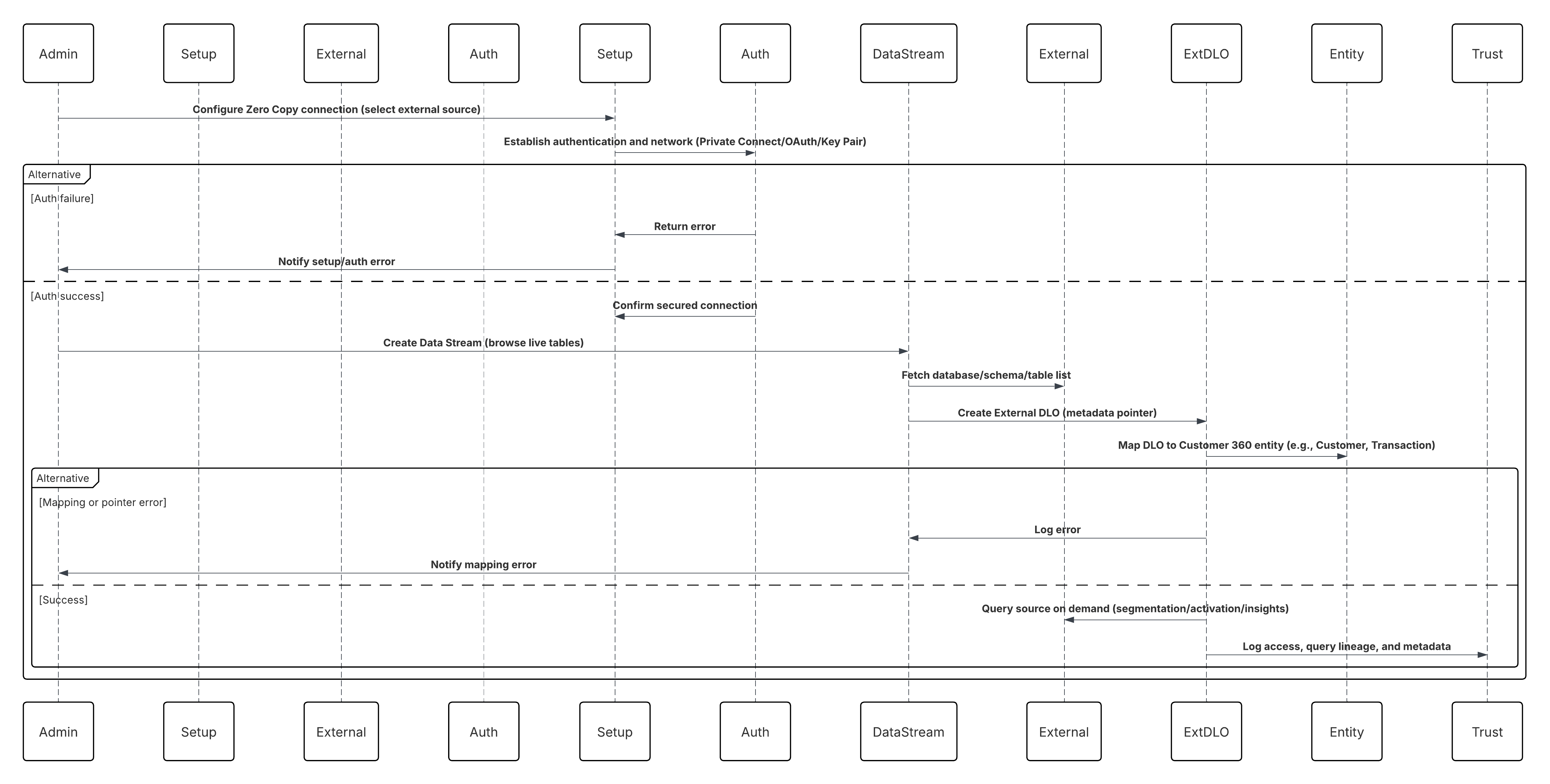

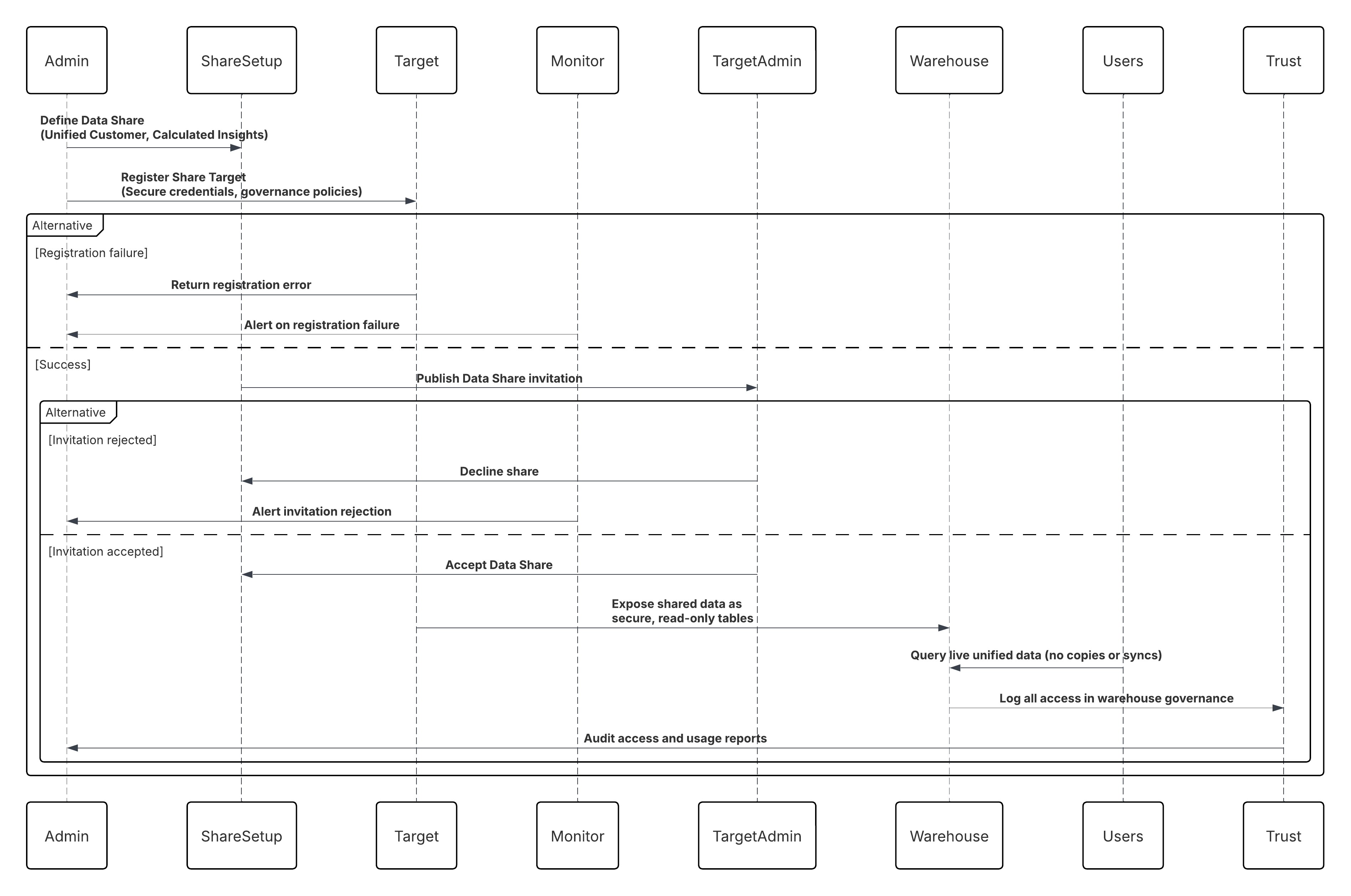

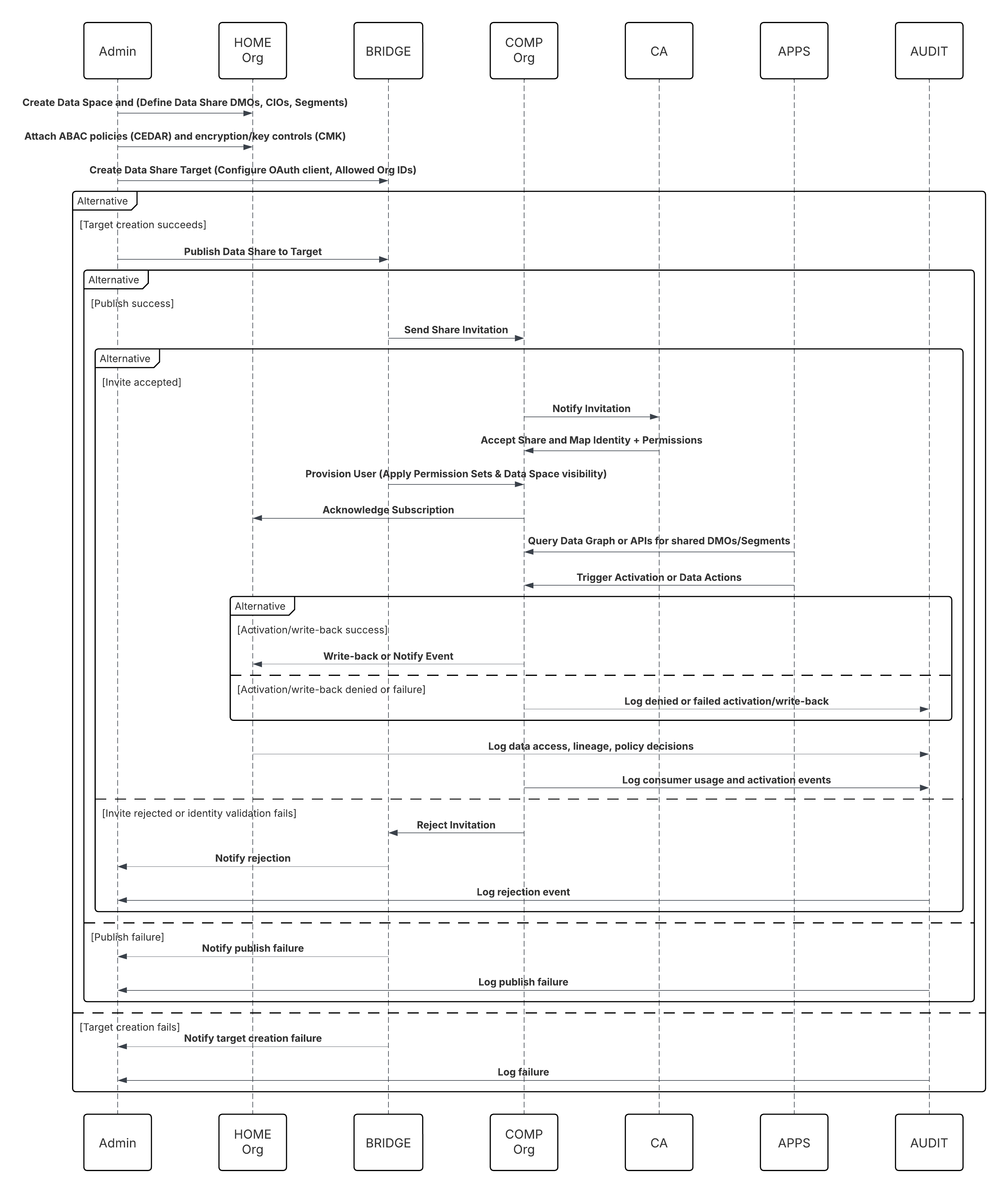

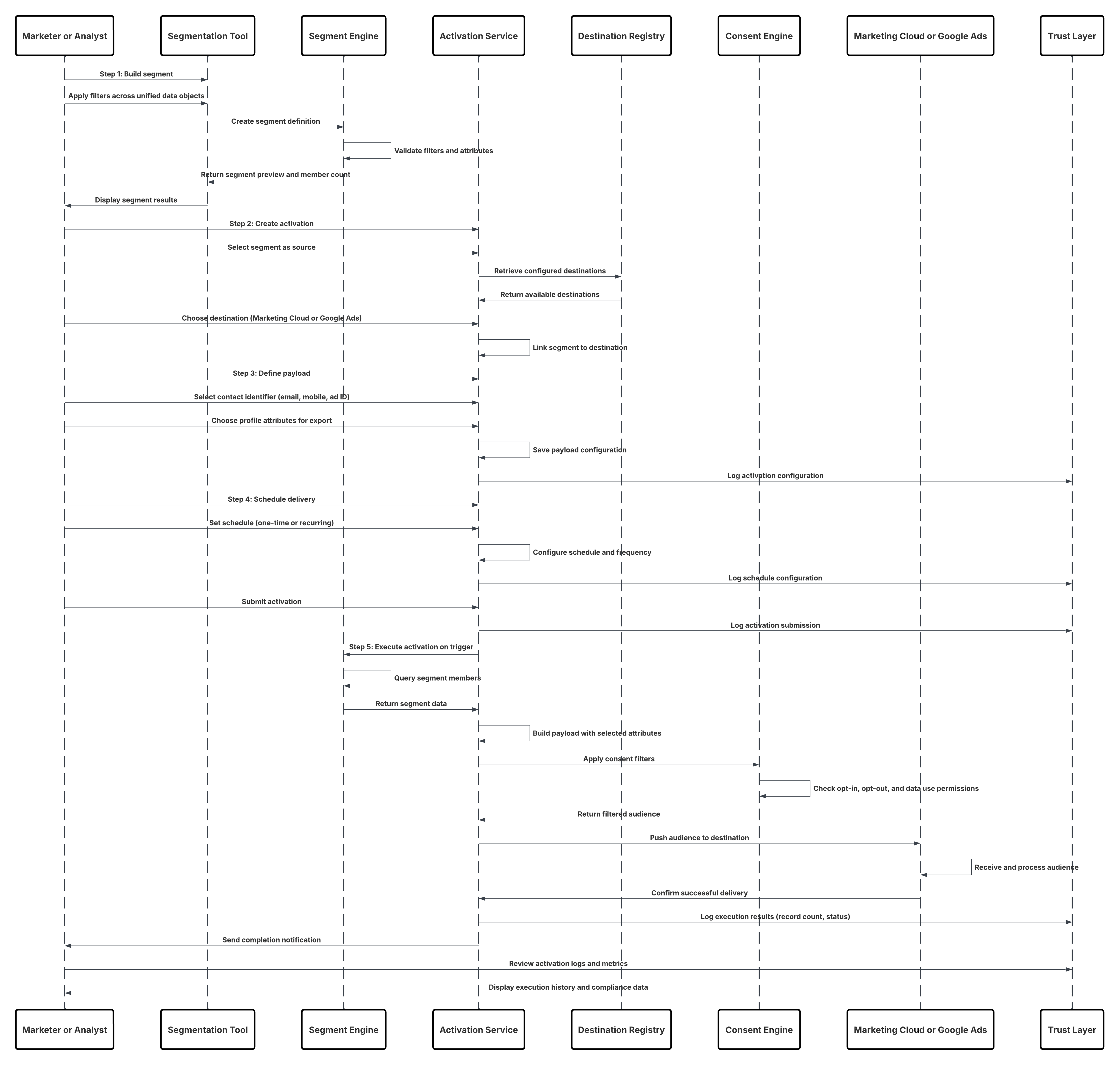

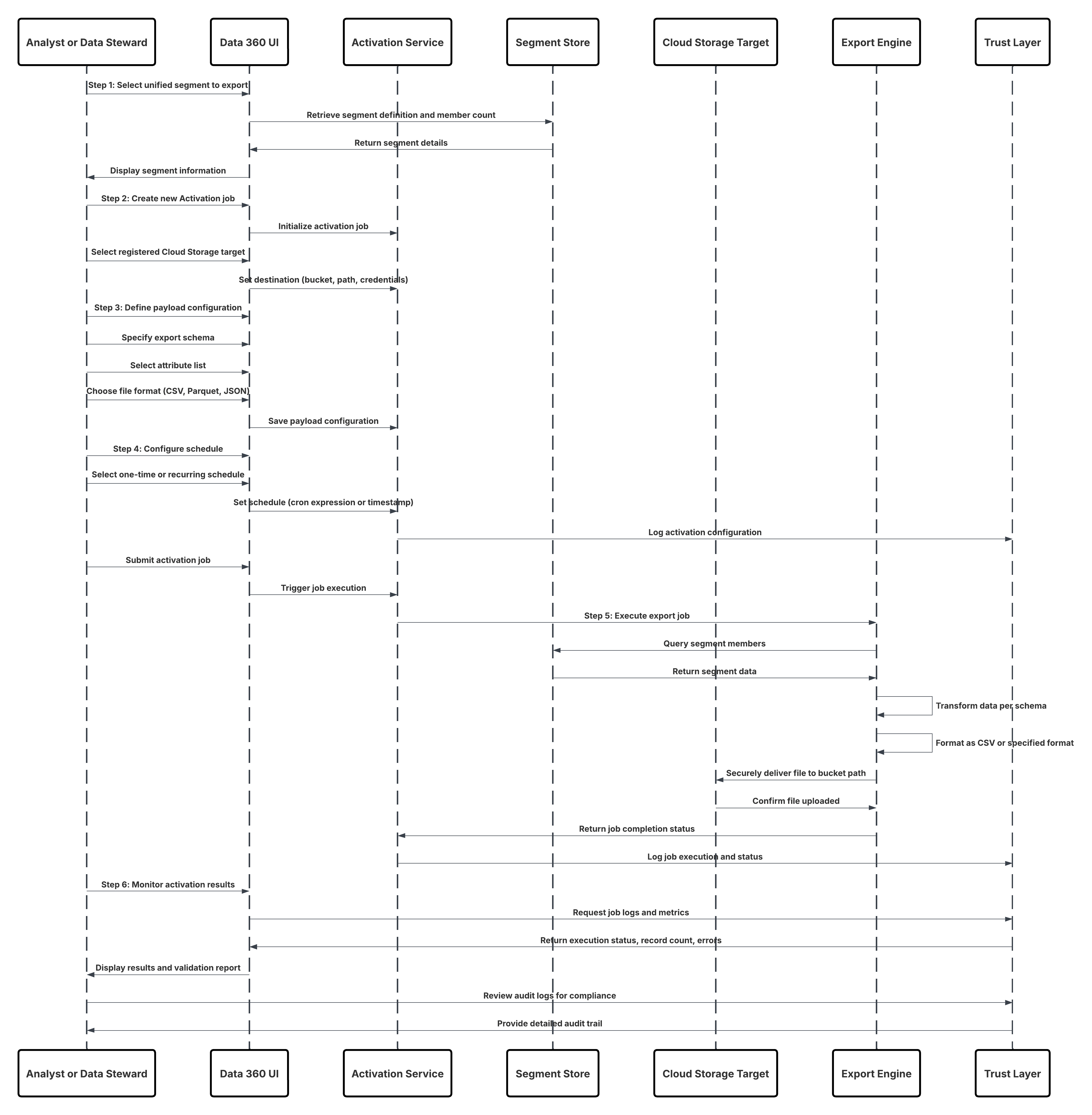

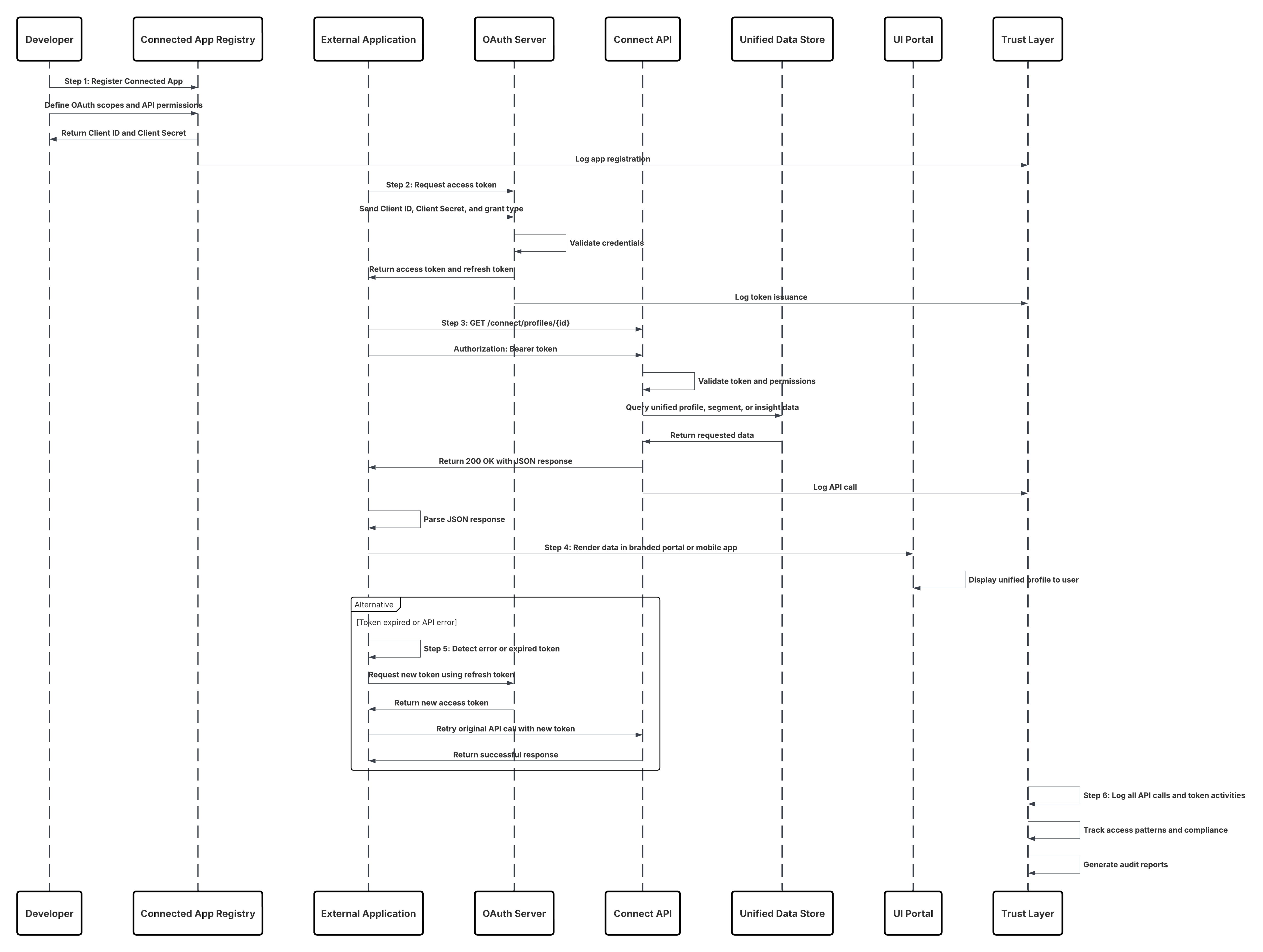

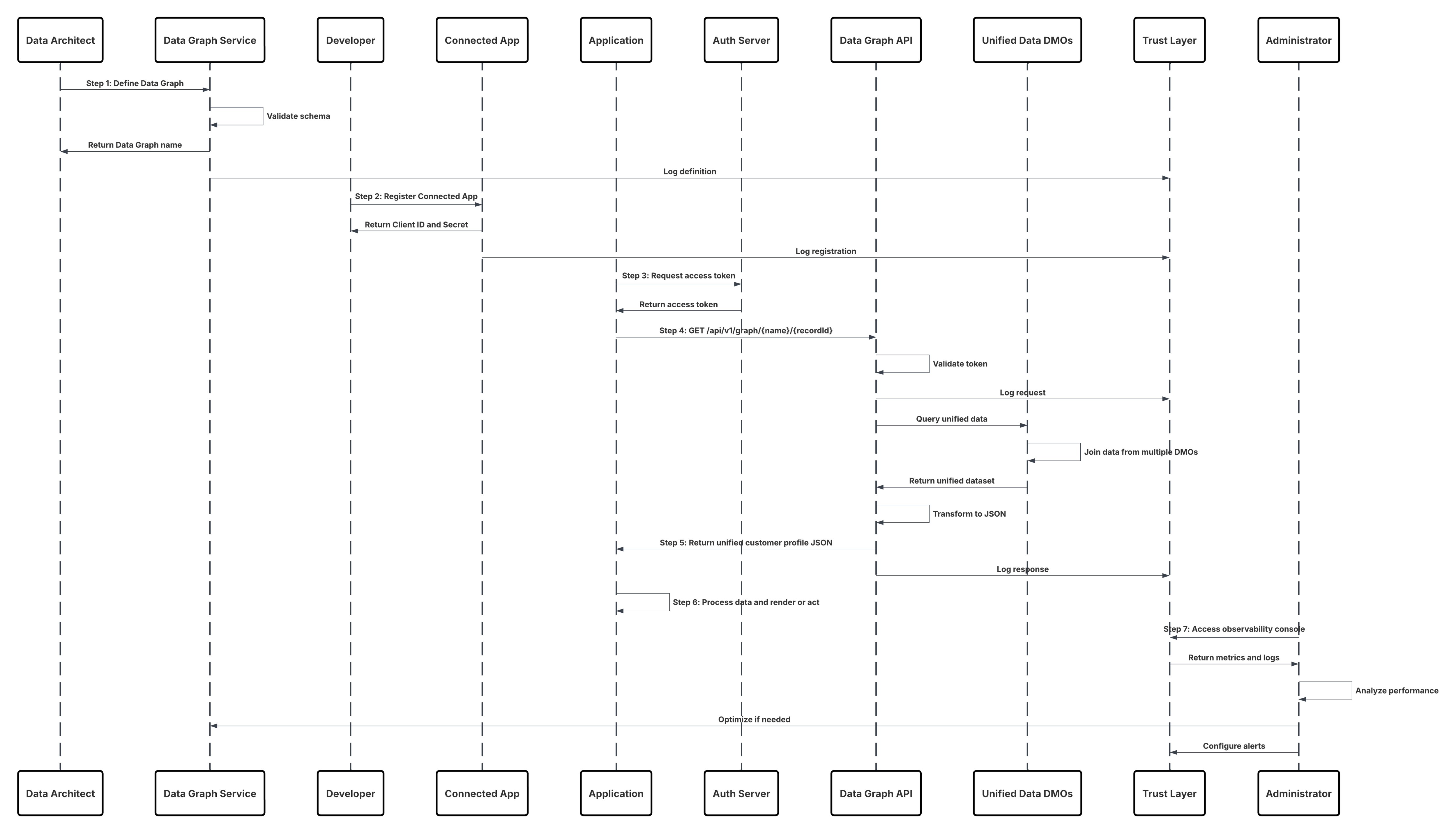

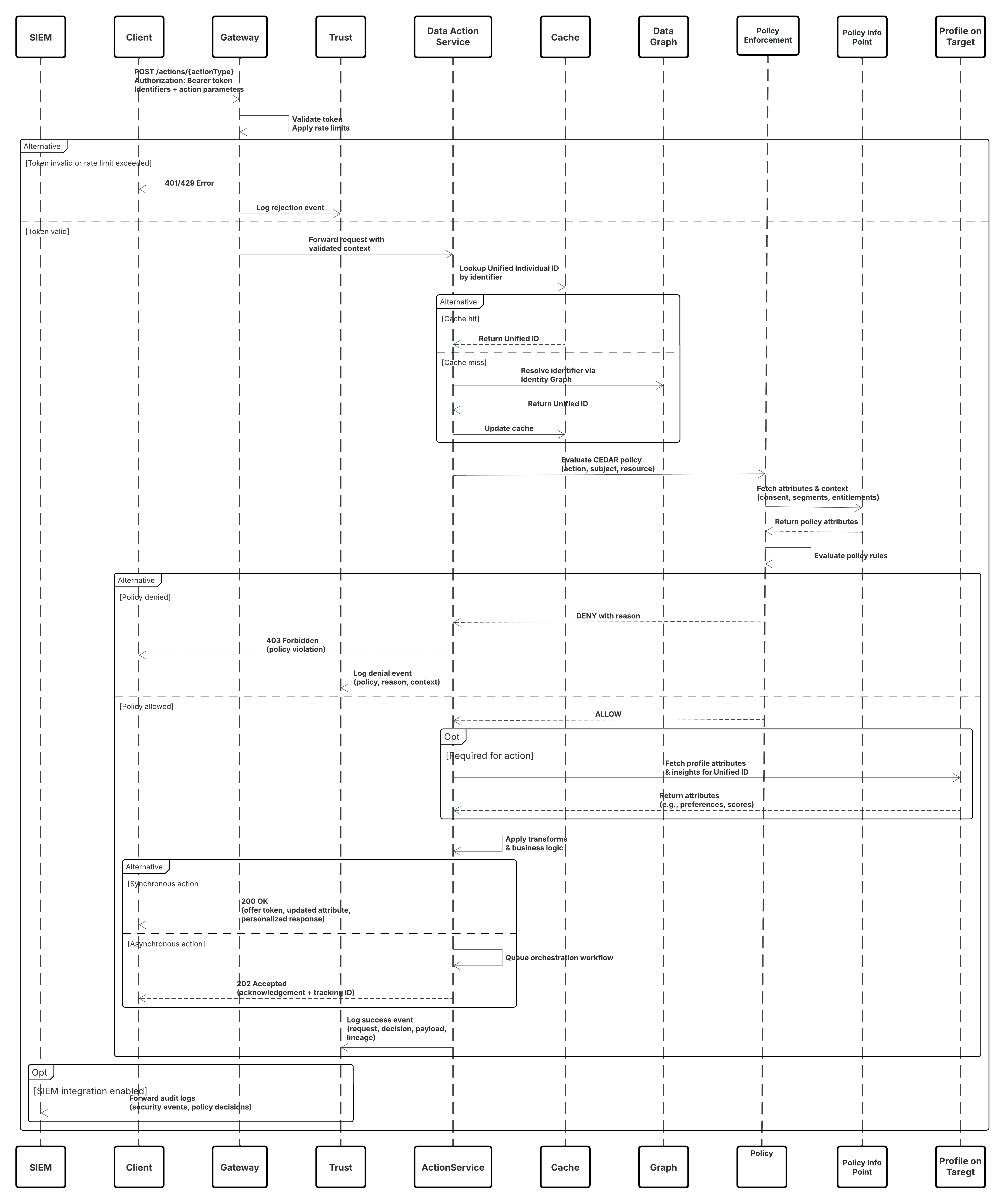

- Esquema: Um diagrama de sequência UML que mostra como a solução lida com o cenário.

- Resultados: Explica os detalhes de como aplicar a solução ao seu cenário de integração e como ela resolve as forças associadas a esse cenário. Esta seção também contém novos desafios que podem surgir como resultado da aplicação do padrão.

- Barras laterais: Seções adicionais relacionadas ao padrão que contêm os principais problemas técnicos, variações do padrão, preocupações específicas do padrão e assim por diante.

- Exemplo: Um cenário do mundo real que descreve como o padrão de design é usado em um cenário do Salesforce do mundo real. O exemplo explica as metas de integração e como implementar o padrão para atingir essas metas.

Use esta tabela como um índice para os padrões de integração contidos neste documento.

| Nível de padrão1 | Nível de padrão2 | Padrão | Secenário |

|---|---|---|---|

| Padrões de ingestão de dados -- Entrada de dados | Padrões de ingestão de lote | Ingestão de dados em massa do armazenamento em nuvem | Os dados são ingeridos de uma fonte de armazenamento de nuvem corporativa, como Amazon S3, Azure Blob ou Google Cloud Storage, no Data 360 na forma de lotes grandes de dados brutos (por exemplo, transações ou logs de produto). |

| Ingestão de dados em massa do Salesforce Clouds | O Data 360 recebe dados de CRM em massa de várias organizações do Salesforce (por exemplo, Sales Cloud, Service Cloud) para criar perfis de cliente unificados. | ||

| Padrões de ingestão de streaming e em tempo real | Ingestão conduzida por evento via API de ingestão--Streaming | O Data 360 assina pontos de extremidade de ingestão de streaming que recebem cargas úteis de evento contínuas (por exemplo, eventos de compra, telemetria de IoT) de sistemas corporativos para atualizações de perfil em tempo real. | |

| Ingestão de comportamento Web e móvel em tempo real | O Data 360 coleta e processa dados comportamentais em tempo real de aplicativo móvel e site por meio de SDKs para aprimorar métricas de engajamento e modelos de personalização. | ||

| Sincronização de CRM quase em tempo real por streaming | O Data 360 recebe atualizações de dados do CRM (por exemplo, contato, caso, alterações de oportunidade) quase em tempo real por meio de fluxos de evento para manter uma visualização Customer 360 continuamente sincronizada. | ||

| Ingestão de fluxo de evento de plataformas de mensagens em nuvem – Kinesis e MSK | O Data 360 consome dados de streaming diretamente de plataformas de evento de nuvem, como AWS Kinesis ou Kafka (MSK), para processar eventos operacionais ou de IoT de alta frequência. | ||

| Padrões de cópia zero – entrada e saída | Inbound Zero Copy – Plataformas externas para o Data 360 | O Data 360 consulta conjuntos de dados externos (por exemplo, Snowflake, BigQuery) sob demanda por meio da Ingestão de cópia zero, sem mover fisicamente os dados para o Salesforce. | |

| Outbound Zero Copy – Data 360 para plataformas externas | Sistemas externos, como o Databricks ou o Tableau, acessam segmentos e percepções aprimorados no Data 360 por meio de conexões de saída do Zero Copy sem replicação de dados. | ||

| Plataforma de dados unificada para diversas organizações com o Data Cloud One | O Data Cloud One unifica várias organizações do Salesforce e origens de dados externas sob um modelo semântico e metadados compartilhados, proporcionando um Customer 360 consistente sem duplicação de dados. | ||

| Padrões de ativação de dados – Saída de dados | Padrões de ativação em lote | Ativação de segmento para plataformas de marketing e publicidade | O Data 360 ativa segmentos de clientes selecionados diretamente no Marketing Cloud, no Meta, no Google Ads ou em outras plataformas de anúncio para entrega de campanha personalizada |

| Exportação de dados para armazenamento na nuvem | O Data 360 exporta conjuntos de dados unificados ou filtrados (por exemplo, registros de cliente consentidos) como arquivos CSV ou Parquet para armazenamento na nuvem corporativa para análise ou arquivamento de conformidade. | ||

| Ativação baseada em API sob demanda | Integração de aplicativos personalizados via API do Connect | Os aplicativos externos chamam a API do Data 360 Connect em tempo real para recuperar ou acionar ações personalizadas (por exemplo, verificação de saldo de fidelidade ou geração de oferta de IA) com base nos dados atuais do cliente.Aplicativos móveis ou da Web personalizados recuperam percepções do Data 360 harmonizadas com segurança por meio da API REST do Connect para serem exibidos em UIs corporativas ou de parceiros. | |

| Recuperação completa do perfil do cliente por meio da API do Data Graph | Um sistema recupera o perfil unificado de um cliente usando a API do Gráfico de dados, retornando uma representação JSON em tempo real pré-juncionada da visualização completa em 360° para decisão ou personalização. | ||

| Ações de dados em tempo real | Ação de dados em tempo real transformando sinais do cliente em ação instantânea | O Data 360 detecta e processa um evento ativo (por exemplo, atualização de consentimento, acionador de compra) e chama imediatamente um sistema conectado ou o Salesforce Flow para ação a jusante.Um sinal de atividade do cliente (por exemplo, risco de rotatividade detectado) no Data 360 aciona uma ação instantânea em tempo real, como atualizar o CRM, invocar a pontuação do Einstein ou iniciar uma jornada de retenção. |

Os padrões de integração neste documento são classificados em três categorias: integrações de dados, processos e visuais.

Os padrões de integração de dados no Data 360 lidam com a movimentação e a sincronização de dados entre sistemas para garantir que o Data 360 e as plataformas externas contenham informações consistentes, oportunas e confiáveis. Esses padrões costumam lidar com fluxos de dados em grande escala e de alto volume e dependem de pipelines governados que aplicam a consistência do esquema, o rastreamento de linha e as regras de domínio.

- Os Padrões de ingestão em lote representam a camada fundamental da integração de dados corporativos. A ingestão de dados em massa de serviços de armazenamento em nuvem, como AWS S3, Azure Blob ou Google Cloud Storage, permite que grandes conjuntos de dados históricos sejam carregados periodicamente no Data 360 para resolução de identidade, segmentação e análise. Da mesma forma, a ingestão em massa de nuvens do Salesforce, como Sales, Service ou Marketing Cloud, usa conectores nativos e fluxos de dados para trazer dados de CRM para a camada de dados unificada, garantindo harmonização e continuidade entre sistemas de engajamento.

- Os Padrões de ingestão de streaming e em tempo real ampliam isso capturando dados de evento de alta velocidade. A ingestão conduzida por evento por meio da API de ingestão permite que os sistemas externos transmitam continuamente a atividade do cliente para o Data 360. A ingestão de comportamento móvel e da Web em tempo real captura dados de interação e clickstream diretamente de pontos de contato digitais para promover a personalização imediata. A sincronização quase em tempo real do CRM por meio de APIs de streaming garante que atributos do cliente e atualizações de consentimento sejam refletidos rapidamente entre sistemas. A ingestão de fluxo de evento de plataformas de mensagens, como Amazon Kinesis ou Confluent MSK, oferece suporte a pipelines contínuos de alta taxa de transferência, alinhando o Data 360 a arquiteturas de evento corporativas.

- A Plataforma de dados multiorganização unificada com o Data Cloud One exemplifica ainda mais a integração de dados, fornecendo um ambiente consolidado para unificar dados de várias organizações do Salesforce e origens externas sob uma camada semântica e de governança comum. Isso permite que as organizações obtenham consistência de dados corporativos, modelos de dados compartilhados e análises dimensionáveis.

- Na fase de ativação, os Padrões de ativação em lote seguem o mesmo princípio de integração de dados. Os segmentos selecionados no Data 360 são exportados em trabalhos agendados para plataformas de marketing e publicidade a jusante, como Marketing Cloud, Meta Ads ou Google Ads, em que acionam a execução da campanha. Da mesma forma, os conjuntos de dados podem ser exportados para destinos de armazenamento na nuvem para alimentar pipelines externos de análise e ciência de dados. Em todos esses casos de uso, o Data 360 atua como a fonte da verdade para dados do cliente sincronizados e selecionados.

Os padrões de integração de processo no Data 360 envolvem acionar ou orquestrar processos de negócios entre sistemas quase em tempo real. Esses padrões permitem que o Data 360 participe ativamente de fluxos de trabalho corporativos, habilitando respostas contextuais e ativação de dados dinâmica.

- Ativação baseada em API sob demanda permite cenários de engajamento em tempo real. Por meio da API do Connect, aplicativos personalizados podem consultar ou ativar perfis do cliente diretamente do Data 360 como parte de processos operacionais, como um console do agente que recupera percepções de perfil unificado durante uma interação com o cliente. A Recuperação completa de perfil do cliente por meio da API de gráfico de dados oferece suporte a aplicativos compostos e microsserviços que dependem de acesso orientado por API ao gráfico completo de entidade de um cliente, permitindo experiências dinâmicas sem segmentos pré-estagiados.

- As Ações de dados em tempo real impulsionam ainda mais essa abordagem de integração habilitando a responsividade imediata. Quando um sinal do cliente, como compra, envio de formulário ou evento de limite, é detectado, o Data 360 pode acionar ações como atualizar um registro do CRM, invocar um webhook externo ou iniciar um fluxo de trabalho de oferta personalizado. Esses padrões incorporam uma verdadeira orquestração de processos, conectando a Inteligência do cliente em tempo real com execução operacional automatizada.

Os padrões de integração virtual no Data 360 permitem o acesso ativo a origens de dados externas ou federadas sem copiar ou duplicar dados fisicamente. Eles são essenciais para empresas que exigem informações gerenciadas e atualizadas no momento da consulta enquanto minimizam a movimentação de dados.

- A Inbound Zero Copy Data Federation (Plataformas externas para Data 360) permite que sistemas externos, como armazéns de dados ou data lakes, compartilhem conjuntos de dados com o Data 360 por meio de conexões seguras e gerenciadas (por exemplo, o Snowflake Secure Data Sharing). Isso garante que o Data 360 possa acessar e operar em dados externos virtualmente, preservando a atualidade e eliminando a replicação desnecessária.

- O Compartilhamento de dados de cópia zero externo (Plataformas Data 360-to-External) permite que o Data 360 exponha conjuntos de dados selecionados para consumo externo, como modelagem de IA, inteligência de negócios ou análise avançada, por meio de federação de dados segura e mecanismos de consulta ativa. Escolher a melhor estratégia de integração para seu sistema não é trivial. Há muitos aspectos a serem considerados e muitas ferramentas que podem ser usadas, sendo que algumas ferramentas são mais adequadas do que outras para determinadas tarefas. Cada padrão aborda áreas críticas específicas, incluindo os recursos de cada um dos sistemas, o volume de dados, o tratamento de falhas e a transacionalidade.

Ao selecionar um padrão de integração, comece respondendo a duas perguntas fundamentais que moldam o design geral e o comportamento da integração. O que você está integrando? — Processamento, Dados ou Acesso virtual Essa dimensão define o propósito principal da integração.

- As integrações de processos focam a orquestração de fluxos de trabalho de negócios e a coordenação de ações entre sistemas.

- As integrações de dados focam a sincronização, enriquecimento ou propagação de dados entre sistemas.

- As integrações virtuais se concentram em acessar dados externos em tempo real sem copiá-los ou persisti-los no Salesforce ou no Data 360. Entender essa intenção ajuda a determinar o nível de orquestração, movimentação de dados e acoplamento necessário entre os sistemas.

- Como ele precisa ser executado? — O método síncrono ou assíncrono define o modelo de execução da integração.

- As integrações síncronas são em tempo real e de bloqueio, em que o chamador espera uma resposta imediata, comumente usada para cenários conduzidos pelo usuário ou de validação.

- As integrações assíncronas são não bloqueadoras e desacopladas, projetadas para lidar com escala, processos de longa duração, novas tentativas e grandes volumes de dados. Juntos, essas duas dimensões – a intenção de integração e o tempo de execução – fornecem uma estrutura clara e consistente para selecionar o padrão de integração certo, equilibrando a experiência do usuário, a escalabilidade e a resiliência operacional. Nota: Uma integração pode exigir um middleware externo ou uma solução de integração (por exemplo, o Enterprise Service Bus), dependendo de quais aspectos se aplicam ao seu cenário de integração.

Esta tabela lista os padrões e seus principais aspectos para ajudá-lo a determinar qual padrão atende melhor aos seus requisitos quando sua integração é do Salesforce para outro sistema

| Tipo | Tempo | Considerações de saída |

|---|---|---|

| Integração de dados | Assíncrono | Ativação de segmento para plataformas de marketing e publicidade |

| Processamento/Integração de dados | Síncrono | Integração de aplicativos personalizados via API do Connect Recuperação completa do perfil do cliente por meio da API do Data Graph |

| Integração de dados | Síncrono | Ação de dados em tempo real transformando sinais do cliente em ação instantânea |

| Integração virtual (usando a cópia zero) | Assíncrono | Outbound Zero Copy – Data 360 para plataformas externas |

| Integração virtual | Assíncrono | Plataforma de dados unificada para diversas organizações com o Data Cloud One |

Esta tabela lista os padrões e seus principais aspectos para ajudá-lo a determinar o padrão mais adequado aos seus requisitos quando sua integração for de outro sistema para o Salesforce.

| Tipo | Tempo | Considerações de entrada |

|---|---|---|

| Integração de dados | Assíncrono | Ingestão de dados em massa do armazenamento em nuvem Ingestão de dados em massa do Salesforce Clouds |

| Integração de dados | Assíncrono | Ingestão de fluxo de evento de plataformas de mensagens em nuvem – Kinesis e MSK Sincronização de CRM quase em tempo real por streaming |

| Integração de processos | Síncrono | Ingestão conduzida por evento via API de ingestão--Streaming Ingestão de comportamento Web e móvel em tempo real |

| Integração virtual | Assíncrono | Inbound Zero Copy – Plataformas externas para o Data 360 |

Esta tabela lista alguns termos-chave relacionados ao middleware e suas definições com relação a esses padrões.

| Termo | Definição |

|---|---|

| Manuseio de evento | A manipulação de eventos se refere a receber, rotear e responder a ocorrências identificáveis de um sistema de origem ou aplicativo. O Middleware lida com eventos identificando o ponto de extremidade de destino, encaminhando o evento e acionando a ação de negócios necessária (por exemplo, registro, novas tentativas ou ativação de serviços downstream). Em arquiteturas do Data 360, a manipulação de eventos é essencial para ingestão de dados em tempo real, acionadores de ativação e padrões de publicação/assinatura. Os eventos podem se originar de sistemas externos (Kafka, AWS Kinesis) ou Eventos da Salesforce Platform e são roteados pelo middleware ou pelo barramento de eventos do Data 360 para processamento imediato. |

| Conversão de protocolo | A conversão de protocolo permite a comunicação entre sistemas usando diferentes padrões de transporte de dados. O Middleware traduz protocolos proprietários ou legados (como AMQP, MQTT, FTP) em protocolos compatíveis do Data 360 (REST, gRPC ou HTTPS). Isso garante a interoperabilidade entre sistemas heterogêneos. Como o Data 360 não lida nativamente com a conversão de protocolo, o middleware fornece a camada de adaptação, encapsulando ou transformando mensagens em APIs do Data 360 em um formato que os conectores podem interpretar. |

| Tradução e Transformação | A tradução e a transformação garantem a interoperabilidade mapeando um formato de dados ou esquema para outro. O Middleware realiza essas transformações para alinhar diversas cargas úteis de dados (CSV, XML, JSON) com objetos de modelo de dados (DMOs) do Data 360 e objetos de camada de dados unificados (UDLOs). Isso inclui limpar, aprimorar e aplicar mapeamento semântico ou baseado em ontologia antes da ingestão. Embora o Salesforce ofereça ferramentas de transformação como Receitas do Preparador de dados, as transformações complexas (especialmente para harmonização semântica) são melhor tratadas em middleware. |

| Enfileiramento e buffering | O enfileiramento e o buffering dependem da passagem de mensagens assíncronas para garantir uma comunicação resiliente e desacoplada. As plataformas de middleware (por exemplo, MuleSoft, Kafka ou Azure Event Hub) fornecem filas persistentes que armazenam dados temporariamente quando o Data 360 ou sistemas downstream estão ocupados ou inacessíveis. Isso evita a perda de dados e dá suporte a novas tentativas de ingestão ou ativação quase em tempo real. O Data 360 oferece suporte à ingestão de streaming e a mensagens de saída baseadas em fluxo, mas o enfileiramento durável e a entrega garantida geralmente são tratados pelo middleware. |

| Protocolos de transporte síncrono | Os protocolos de transporte síncrono envolvem operações de bloqueio de solicitação/resposta em tempo real. O remetente espera uma resposta antes de prosseguir. No Data 360, eles são usados para ativações baseadas em API sob demanda, aprimoramento em tempo real ou pesquisas de perfil, em que as respostas são necessárias imediatamente. O Middleware garante a confiabilidade da conexão e gerencia novas tentativas ou o gerenciamento de fallback para chamadas síncronas à API do Data 360. |

| Protocolos de transporte assíncrono | Os protocolos de transporte assíncronos oferecem suporte à comunicação não bloqueada e desacoplada em que o remetente continua processando sem esperar uma resposta. O Middleware lida com fluxos assíncronos para ativações em lote, ingestão de streaming e ativação conduzida por evento. Isso permite alta taxa de transferência e resiliência, essenciais para padrões de ingestão de dados quase em tempo real e streaming de evento no Data 360. |

| Roteamento de mediação | O roteamento de mediação define o fluxo de mensagens complexo entre sistemas, garantindo que os dados ou o evento certos cheguem ao consumidor correto. O middleware atua como mediador, lidando com a lógica de roteamento com base em regras, cabeçalhos, conteúdo ou tipo de evento. Em integrações do Data 360, a mediação garante que eventos e atualizações de perfil de vários sistemas sejam roteados adequadamente para APIs de ingestão de dados, pontos de extremidade de ativação ou consumidores externos. Isso simplifica a orquestração e dá suporte à sincronização de dados de vários sistemas. |

| Coreografia de processos e orquestração de serviço | A coreografia do processo e a orquestração coordenam processos de vários sistemas. A coreografia oferece suporte a fluxos autônomos assíncronos conduzidos por evento, em que os sistemas atuam com base em regras compartilhadas sem um controlador central. A orquestração é um fluxo gerenciado centralmente que direciona a execução do serviço. Em arquiteturas do Data 360, o middleware gerencia a orquestração para ingestão e ativação entre sistemas, enquanto fluxos de trabalho ou fluxos do Salesforce gerenciam coreografias leves dentro da plataforma. Orquestração complexa, que requer coordenação de transação ou gerenciamento de estado, é recomendada na camada de middleware. |

| Transaccionalidade (criptografia, assinatura, entrega confiável, gerenciamento de transações) | A transacionalidade garante operações atômicas, consistentes, isoladas e duráveis (ACID) entre sistemas. O Salesforce e o Data 360 são transacionais dentro de seus limites, mas não oferecem suporte a transações distribuídas entre sistemas externos. O Middleware lida com o controle de transações globais, incluindo criptografia, assinatura de mensagens, reversão, compensação e entrega confiável. Para fluxos de dados críticos para a missão (por exemplo, atualizações financeiras ou de consentimento), o middleware garante a integridade completa e a recuperação em sistemas externos e do Data 360. |

| Rotagem | O roteamento especifica o fluxo controlado de mensagens ou dados entre componentes. Pode ser baseado em cabeçalhos, tipo de conteúdo, prioridade ou regras. O Middleware lida com a lógica de roteamento para eventos e ativações envolvendo o Data 360, como direcionar segmentos de público avançados para diferentes sistemas downstream (plataformas de anúncios, armazéns, aplicativos CRM). Embora o roteamento possa ser implementado no Salesforce (Apex, Fluxos), o roteamento de middleware é preferido para escalabilidade, flexibilidade e governança. |

| Extrair, transformar e carregar (ETL) | O ETL envolve extrair dados de sistemas de origem, transformá-los em um esquema consistente e carregá-los em um destino (como o Data 360). As ferramentas de middleware ou ETL lidam com essas operações antes da ingestão de dados. O Data 360 pode receber saídas ETL por meio de APIs, conectores ou pipelines de ingestão em massa e também oferece suporte à Captura de dados de alteração (CDC) para sincronização quase em tempo real. Os processos ETL do Middleware são essenciais para integrar sistemas legados e garantir a qualidade dos dados antes da unificação no Data 360. |

| Polling longo | Pesquisa longa (programas de Cometa) é um método para manter a comunicação aberta entre sistemas para atualizações em tempo real. O cliente envia uma solicitação e o servidor a mantém até que um evento ocorra, então responde e reabre uma nova conexão. O Salesforce usa isso na API de streaming e nos protocolos CometD/Bayeux para sincronização de dados conduzida por evento. O Middleware pode assinar esses eventos e encaminhá-los para o Data 360 para acionadores de ingestão ou ativação em tempo real, garantindo a latência mínima entre sistemas corporativos. |

A ingestão de dados é a primeira e mais crítica etapa do ciclo de vida de dados do Salesforce Data 360. É como as informações brutas de vários sistemas externos (CRM, ERP, Web, móvel ou APIs de terceiros) entram na plataforma e se tornam parte de uma visualização unificada do cliente. O padrão de ingestão certo depende do que a empresa precisa:

- Volume de dados — Quantos dados estão se movendo ao mesmo tempo

- Latency – quão recentes os dados devem estar

- Funcionalidades do sistema de origem – como o sistema pode conectar e entregar dados O Data 360 oferece suporte a vários modos de ingestão para atender a essas necessidades: lote para carregamentos de alto volume, streaming para atualizações quase em tempo real, baseado em evento para imediato transacional e ingestão do Zero Copy para acesso instantâneo a dados externos sem movê-los fisicamente. Juntos, esses padrões garantem que cada sinal do cliente, seja um evento de compra, um registro de fluxo de cliques ou uma atualização de fidelidade, flua para o Data 360 de modo eficiente, seguro e no período certo para habilitar análises confiáveis e experiências conduzidas por IA.

Os padrões de ingestão em lote são a base da integração de dados em grande escala no Data 360. Eles são otimizados para cenários em que os dados são processados em massa, geralmente de modo agendado ou periódico, em vez de continuamente. Estes padrões são mais adequados para:

- Carregamentos de dados históricos para inicializar a plataforma com registros empresariais existentes

- Sincronização regular com sistemas de registro, como ERPs, armazéns de dados ou bancos de dados proprietários

- Use casos em que a atualização em tempo real não é essencial, mas consistência, completude e capacidade de auditoria são A ingestão em lote oferece desempenho previsível e simplicidade operacional, tornando-a uma escolha confiável para empresas que gerenciam terabytes de dados estruturados ou semistruturados. O Data 360 fornece um conjunto de conectores disponíveis ao público em geral prontos para produção que suportam a ingestão de lote nativamente. Esses conectores simplificam a configuração da integração, reduzem o desenvolvimento de ETL personalizado e garantem a qualidade e a segurança dos dados em todas as importações. A tabela abaixo destaca os conectores mais comuns usados para ingestão em lote em escala corporativa.

Contexto

Esse padrão é projetado para cenários corporativos que envolvem a ingestão de grandes volumes de dados estruturados, como arquivos CSV ou Parquet, e ativos não estruturados de data lakes centralizados ou gotações de arquivos agendadas. As fontes de dados geralmente incluem plataformas de armazenamento em nuvem, como Amazon S3, Google Cloud Storage (GCS) e Microsoft Azure Blob Storage, em que os arquivos são entregues periodicamente como parte de pipelines de dados upstream ou exportações em lote.

Problema

Como uma organização pode estabelecer um processo confiável, seguro e de alto rendimento para ingerir conjuntos de dados baseados em arquivo de sua plataforma de armazenamento de nuvem primária para o Data 360 em uma agenda recorrente e previsível sem sacrificar a governança, a escalabilidade ou o desempenho?

Forças

Ingerir conjuntos de dados em massa baseados em arquivos no Data 360 não é um exercício simples de transferência de dados, é um desafio arquitetônico moldado por restrições de escala, governança e plataforma.

Volume e escala dos dados: Os conectores de ingestão do Data 360 são otimizados para confiabilidade e governança, não para taxa de transferência em massa arbitrária. Por exemplo, o conector do Amazon S3 oferece suporte a até 100 milhões de linhas ou 50 GB por objeto, o limite que for atingido primeiro. Para empresas com conjuntos de dados históricos executados em bilhões de registros, esse limite se torna uma principal restrição de design. Uma abordagem de aumento e mudança de arquivo único rapidamente se torna inviável, exigindo estratégias inteligentes de particionamento de dados, agrupamento e orquestração para atingir a escala sem atingir os limites do conector.

Definir esquema e manutenção : O Data 360 exige definições de esquema explícitas para cada pipeline de ingestão para garantir a integridade semântica e estrutural. No caso da ingestão do S3, um arquivo csv deve definir cabeçalhos de coluna e uma única linha de dados representativa. Esse arquivo atua como o contrato canônico entre o sistema de origem, ou seja, o armazenamento em nuvem e o Data 360. Qualquer desalinhamento (em nomes de campo, tipos de dados ou codificação) pode causar falhas de ingestão ou corrupção de dados silenciosos. Manter esse arquivo de esquema no controle de versão e impor validação por meio de fluxos de trabalho de CI/CD ou governança de dados se torna uma prática recomendada para ambientes de produção.

Convenções de nomenclatura estrita : O Data 360 aplica regras rígidas de nomenclatura de objetos e campos para manter a consistência em todo o gráfico de metadados.

- Os nomes de objeto devem começar com uma letra e podem incluir somente letras, dígitos ou sublinhados.

- Os nomes de campo devem seguir os mesmos padrões. Arquivos que violam essas convenções, por exemplo, campos contendo espaços, caracteres especiais ou símbolos sem suporte, falharão na validação do esquema durante a ingestão. As empresas devem implementar processos de higiene de dados pré-ingestão para sanitar e normalizar estruturas de arquivos de entrada.

Posição de autenticação e segurança: Cada conexão com armazenamento externo deve estar em conformidade com os padrões de conformidade e segurança corporativos.

- A autenticação geralmente é processada por meio de chaves de acesso/segredo da AWS ou autenticação de provedor de identidade federado (IdP).

- Os papéis do IAM devem ter o escopo para aplicar o privilégio mínimo, permitindo apenas acesso de leitura aos caminhos de armazenamento especificados.

- Para acesso seguro, os endereços IP de saída devem ser adicionados diretamente à lista de permissões do sistema de origem. Esses controles em camadas garantem que cada transferência de arquivo funcione dentro de um perímetro de Trust zero e auditável, equilibrando a conformidade da empresa com a flexibilidade necessária para ingestão em grande escala.

Solução

Esta tabela contém soluções para esse problema de integração.

| Solução | Ajuste | Comentários |

|---|---|---|

| Usar conectores de armazenamento do Native Cloud (Amazon S3, Google Cloud Storage, Armazenamento de Blobs do Azure) | Melhor | Esse é o padrão recomendado e mais confiável para ingestão baseada em arquivo recorrente em grande escala no Data 360\. Conectores nativos fornecem autenticação gerenciada, mapeamento de esquema e movimentação segura de dados diretamente para os objetos do Data Lake (DLOs) do Data 360. Ideal para carregamentos em lote agendados em que a latência não é crítica (por exemplo, agendamento por hora ou diário). |

| Processamento de conjuntos de dados grandes (além dos limites do conector) | Melhor com pré-processamento | Cada conector impõe limites de ingestão (por exemplo, S3: 100M de linhas ou 50 GB por objeto). Para conjuntos de dados maiores, implemente uma etapa de pré-processamento de ETL para particionar dados em arquivos/pastas menores que estejam abaixo desses limites. Em seguida, configure vários fluxos de dados para ingerir cada partição em paralelo e use o nó de adição em uma transformação de dados em lote) no Data 360 para recombinar as partições em um conjunto de dados unificado. |

| Segurança e governança | Melhor | Todos os conectores oferecem suporte à autenticação segura por meio de métodos nativos da nuvem (papéis do IAM, contas de serviço ou chaves de acesso). Para maior controle, restrinja o acesso a intervalos de IP do Data 360 por meio da lista de permissões do provedor de nuvem. A transferência de dados ocorre em canais criptografados, com arquivos armazenados em uma camada de preparação temporária e segura durante a ingestão. |

| Quando não usar | Suboptimal | Esse padrão não é ideal para:

|

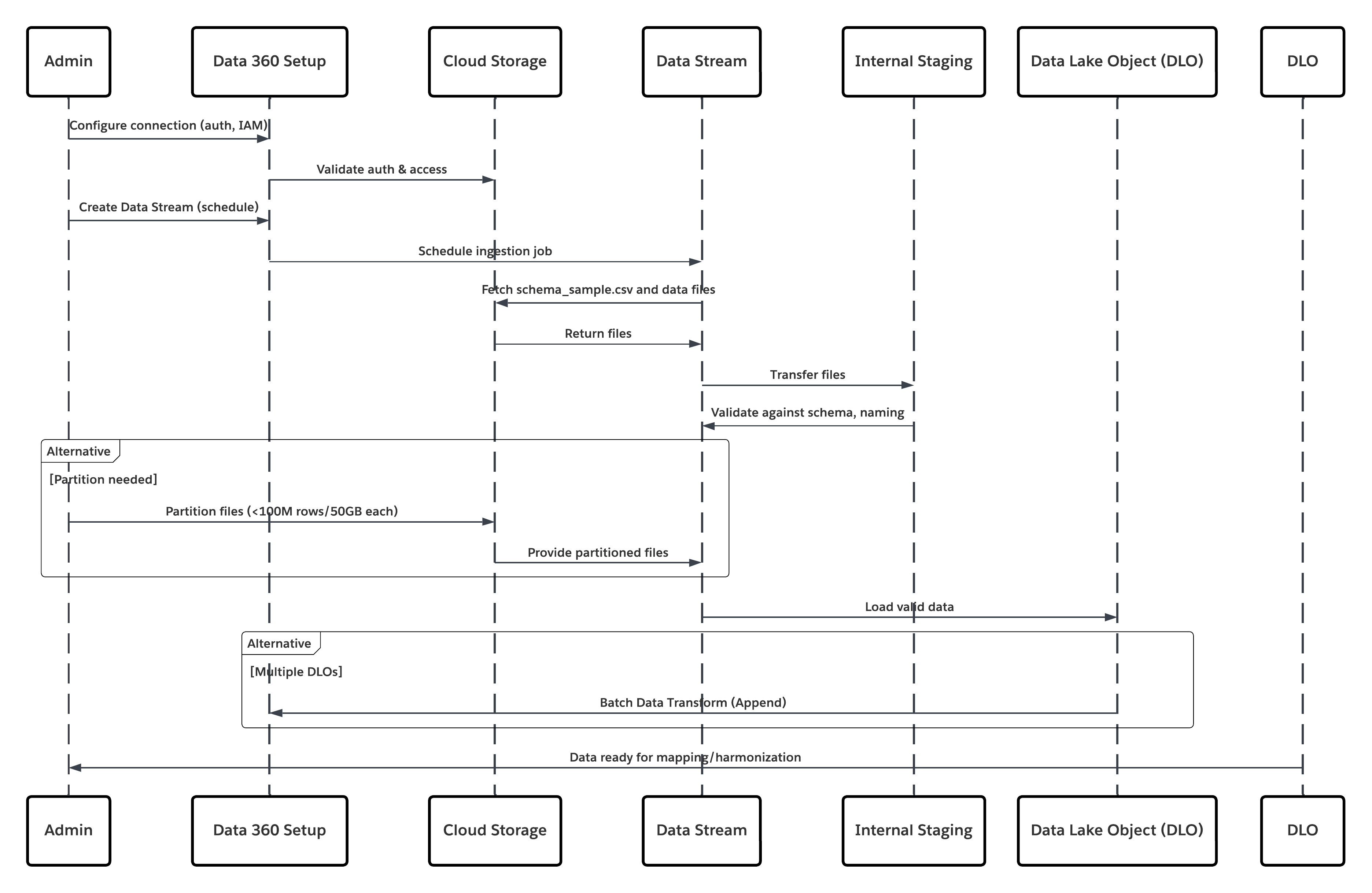

Esboço

Este diagrama ilustra a sequência de etapas para ingerir os dados do armazenamento na nuvem para o Data 360

Neste cenário:

- O administrador configura uma conexão com o armazenamento na nuvem por meio da interface de Configuração do Data 360 (especificando a autenticação, os detalhes do bucket, os papéis do IAM e a lista de permissões).

- A interface de Configuração do Data Cloud autentica com a plataforma de armazenamento em nuvem, verificando as credenciais e o acesso.

- O administrador cria um fluxo de dados no Data 360, vinculando o fluxo de dados ao objeto/pasta no Armazenamento na nuvem e definindo a agenda de ingestão.

- No acionador de agenda, o fluxo de dados solicita arquivos de origem (por exemplo, CSV, Parquet) da plataforma de armazenamento em nuvem.

- A Plataforma de armazenamento em nuvem entrega arquivos, incluindo o schema_sample.csv válido obrigatório e outros arquivos de dados em conformidade com convenções de nomenclatura.

- O fluxo de dados transfere arquivos para o ambiente de preparação interno no Data 360.

- O Pipeline do Data 360 processa os arquivos: Usa a definição de esquema de schema_sample.csv Valida a estrutura, os nomes de campo e divide a carga se estiver acima dos limites de ingestão (100 milhões de linhas/50 GB por arquivo). Se arquivos grandes forem detectados, uma etapa de particionamento de pré-processamento (notificada ao administrador para a próxima execução) será realizada externamente.

- Os registros são importados da preparação para um objeto de data lake (DLO).

- Se necessário e os dados estiverem particionados, use o nó append em uma transformação de dados em lote para combinar vários DLOs.

- O Data 360 registra o sucesso/falha, atualiza o status para monitoramento e indica que os dados estão prontos para mapeamento, harmonização e unificação.

Resultados

A aplicação desse padrão permite a ingestão segura, agendada e em grande escala de arquivos estruturados ou não estruturados de plataformas de armazenamento de nuvem corporativa para o Data 360. O processo é automatizado, escalonável e resiliente, entregando dados brutos em objetos de data lake (DLOs) que servem de base para harmonização e mapeamento para o Modelo de dados Customer 360.

Mecanismos de ingestão

O mecanismo de ingestão depende do conector e da estratégia de agendamento definidos no Data 360.

| Mecanismo de ingestão | Descrição |

|---|---|

| Conector de armazenamento do Native Cloud (Amazon S3, GCS, Azure) | Recomendado para ingestão direta de arquivos no formato CSV ou Parquet do data lake de nuvem da empresa. Esses conectores oferecem suporte a agendas de atualização incrementais e completas. Por exemplo, um banco pode configurar uma sincronização diária de arquivos de transação do cliente de um bucket do S3 para um DLO. |

| Estratégia de arquivo particionado | Para conjuntos de dados muito grandes (mais de 100 milhões de linhas ou 50 GB por objeto), os dados são particionados em conjuntos lógicos menores (por exemplo, por mês ou região). Cada partição é gerenciada como um fluxo de dados separado e posteriormente recombinada usando uma transformação de dados em lote com um nó Acrescentar. |

| Sincronização agendada automatizada | O Data 360 fornece um agendador declarativo (hora, dia ou ritmo personalizado) que aciona trabalhos de ingestão automaticamente, garantindo a atualização dos dados sem intervenção manual. |

Tratamento e recuperação de erros

O tratamento e a recuperação de erros são essenciais para garantir a confiabilidade em operações de ingestão de alto volume.

- Detecção de erro: Cada execução de Fluxo de dados registra erros de ingestão (por exemplo, incompatibilidade de esquema, corrupção de arquivo ou violações de nomenclatura) no Monitoramento do Data 360. Os administradores podem revisar e reprocessar lotes com falha.

- Mecanismo de recuperação: O Data 360 mantém o apontamento de verificação para garantir que lotes com falha não corrompam ingestões anteriores. As novas tentativas podem ser configuradas depois de corrigir problemas de origem (por exemplo, CSVs malformados).

- Validação de esquema: O arquivo schema_sample.csv define tipos de dados e estrutura. Qualquer alteração aciona a validação para evitar o desvio silencioso de esquema entre execuções.

Considerações sobre design idempotente

A ingestão é idempotente por design: reprocessar o mesmo arquivo não resulta em registros duplicados. As principais estratégias incluem:

- Arquivo de impressão digital: O Data 360 calcula as somas de verificação para identificar e ignorar arquivos processados anteriormente.

- Ingestão transacional: Os dados são preparados e confirmados no DLO apenas após o processamento bem-sucedido de todos os registros.

- Adicionar vs. Substituir: Dependendo da lógica de negócios, os fluxos podem anexar ou substituir totalmente o DLO de destino; isso garante resultados determinísticos e evita sobreposições de dados parciais.

Considerações de segurança

A segurança é integral em todo o pipeline de ingestão, da autenticação à criptografia e controle de acesso.

- Autenticação & Autorização: Os conectores usam a Estrutura de integração segura do Salesforce, aproveitando Credenciais nomeadas e Credenciais externas para autenticação sem expor segredos.

- Criptografia: Os dados são criptografados em trânsito (TLS 1.2+) e em repouso (AES-256).

- Controles de rede: Os sistemas de armazenamento de origem (por exemplo, buckets do S3) devem incluir IPs do Data 360 na lista de permissões.

- Alinhamento de conformidade: Suporta estruturas de proteção de dados corporativas, como diretrizes de GDPR, HIPAA e FFIEC, quando combinadas a Chaves gerenciadas pelo cliente (CMK).

- Auditabilidade: Cada trabalho de ingestão e acesso à credencial são registrados para relatórios de rastreabilidade e conformidade.

Barras laterais

Tempo

O tempo depende da agenda de ingestão e do volume de dados.

- Grandes conjuntos de dados corporativos (100M+ linhas) podem exigir particionamento para ingestão paralela.

- A latência de ingestão típica varia de minutos a algumas horas, dependendo do tamanho do arquivo e da complexidade da transformação.

- Para ingestão quase em tempo real, os conectores baseados em API ou de streaming do Data 360 podem complementar o modelo baseado em arquivo.

Volumes de dados

- Mais adequado para ingestão de lote periódica de alto volume.

- Cada objeto processado por meio do conector do S3 oferece suporte a até 100 milhões de linhas ou 50 GB por arquivo.

- Para sistemas em escala de petabytes, use o particionamento de dados e a orquestração de vários fluxos.

Suporte a padrões e funcionalidade do ponto de extremidade

A funcionalidade e o suporte padrão para o ponto de extremidade dependem da solução escolhida.

| Tipo de conector | Requisitos de ponto de extremidade |

|---|---|

| Amazon S3 Connector | Bucket do S3 com a política de IAM adequada e o arquivo schema\_sample.csv definindo o esquema. |

| Conector do Google Cloud Storage | Credenciais da conta de serviço e acesso de bucket com convenções de nomenclatura uniformes. |

| Conector do Armazenamento do Azure | Acessar autenticação baseada em chave ou token SAS; a estrutura de blob ou pasta deve seguir as convenções do Data 360. |

Gerenciamento de estado

O estado é rastreado por meio de Fluxos de dados e seu carimbo de data e hora da última execução bem-sucedida.

- O Data 360 mantém automaticamente os estados de sincronização e os deslocamentos, garantindo que somente arquivos novos ou modificados sejam processados em execuções subsequentes.

- Ao integrar-se a ferramentas ETL externas, são recomendados identificadores de arquivo exclusivos (por exemplo, UUIDs ou carimbos de data e hora) para evitar duplicação.

Cenários de integração complexos

Em arquiteturas empresariais avançadas, esse padrão pode ser integrado a:

- Middleware ETL Pipelines (por exemplo, Informatica, MuleSoft): para orquestrar o pré-processamento, a validação e o particionamento de arquivos antes de transferir para o Data 360.

- Fluxos de trabalho AI/ML: os dados de DLO processados podem ser publicados via DMO para modelos de ambientes de treinamento ou índices RAG por meio de Destinos de ativação do Data 360.

- Sistemas transacionais: DMOs harmonizados podem acionar atualizações a jusante no Salesforce CRM ou sistemas externos por meio de Ações de dados ou Eventos de plataforma.

Exemplo

Uma instituição financeira global armazena dados do cliente e da transação em um data lake do AWS S3, em que arquivos Parquet particionados são gerados diariamente por região (como EUA, UE e APAC). A equipe de arquitetura de dados configura vários Fluxos de dados no Data 360, cada um conectado a uma pasta regional, com um esquema_sample.csv compartilhado garantindo cabeçalhos e tipos de dados consistentes em todas as partições. Agendas de ingestão noturna carregam automaticamente os dados em DLOs, após o que as Transformações de dados em lote acrescentam todas as partições regionais a um Customer_Transactions_DLO unificado. Esse conjunto de dados harmonizado é mapeado para o Customer 360 Data Model, permitindo análise a jusante e ativação de IA. A abordagem fornece uma ingestão automatizada e confiável do data lake existente, impõe uma autenticação e criptografia fortes alinhadas às políticas de TI corporativas e fornece uma base modular dimensionável que dá suporte à expansão futura e à evolução do esquema.

Contexto

Um caso de uso principal e crítico para o Data 360 é unificar dados do cliente em todo o ecossistema do Salesforce. Esse padrão abrange a ingestão nativa de dados de plataformas principais do Salesforce – Sales Cloud e Service Cloud (coletivamente Salesforce CRM) e Marketing Cloud Engagement. As origens incluem objetos de CRM padrão e personalizados (por exemplo, Conta, Contato, Caso, Oportunidade) e extensões de dados do Marketing Cloud Engagement que contêm eventos de engajamento, envios de email e dados de rastreamento.

Problema

Como uma organização pode ingerir de modo eficiente e confiável objetos de CRM padrão e personalizados e extensões de dados do Marketing Cloud Engagement no Data 360 para que os dados possam ser usados para criar perfis de cliente unificados (resolução de identidade, Customer 360), mantendo o desempenho, a governança e as interrupções mínimas dos sistemas de origem?

Forças

Conectores nativos simplificam o trabalho, mas várias forças operacionais e arquitetônicas devem ser gerenciadas:

- Permissões de origem abrangentes: Um usuário de conexão dedicado (conta de integração) deve ter as permissões de leitura adequadas em nível de objeto e de campo. A falha na atribuição dos conjuntos de permissões necessários (por exemplo, um conjunto de permissões do conector do Data 360 predefinido) é uma causa comum de falha de ingestão.

- Modos e custo de atualização de dados: Os conectores oferecem suporte aos modos de atualização completa e delta/incremental. Atualizações completas têm mais impacto no desempenho e nos créditos; as extrações de delta reduzem a carga, mas dependem de um rastreamento de alteração confiável no sistema de origem.

- Esquema personalizado e mapeamento de campo: As instâncias do CRM geralmente incluem objetos/campos personalizados. O mapeamento de esquema preciso e o tratamento de campos personalizados (nomes, tipos) são necessários para evitar erros de mapeamento ou desvio semântico.

- Pacotes de dados starter vs. Mapeamento personalizado: Pacotes de dados iniciantes aceleram a integração pré-selecionando objetos/campos típicos, mas organizações altamente personalizadas precisarão de definições de fluxo personalizadas.

- Limites de taxa de transferência e API: Os limites da API da organização de origem e as taxas de extração do Marketing Cloud restringem a agressividade com que você pode agendar atualizações.

- Convenções de higiene de dados e nomenclatura: Nomes de campo de origem, comportamento nulo e tipos de dados devem ser normalizados antes da ingestão para evitar problemas de mapeamento posterior.

- Segurança e privilégio mínimo: O conector depende de autenticação segura e deve respeitar padrões de IAM de privilégio mínimo, auditoria e controles de rede.

Solução

Esta tabela contém soluções para esse problema de integração.

| Área de solução | Ajuste | Comentários/Detalhes da implementação |

|---|---|---|

| Ajuste da solução | Melhor | Use o Conector nativo do Salesforce CRM e o Conector de engajamento do Marketing Cloud no Data 360\. Comece com Pacotes de dados iniciais para casos de uso padrão e acelere a integração. Use a personalização manual de fluxo para modelos de dados personalizados ou específicos do domínio. |

| Manipulação de instâncias de CRM altamente personalizadas | Melhor com a oficina de mapeamento | Trate Pacotes iniciais como uma linha de base e realize um workshop de mapeamento para identificar: Objetos personalizados e relacionamentos. Campos de fórmula ou calculados. Extensões de pacote gerenciado. Para campos de fórmula pesados, calcule valores em um ETL pré-estágio ou dentro de Transformações do Data 360 para minimizar a carga da API em organizações de origem. |

| Quando não usar | Cenários subóptimos | Evite esse padrão se: Você precisa de ingestão de evento em tempo real ou de alta frequência (em vez disso, use Conectores de streaming, Eventos de plataforma ou Federação de cópia zero). A organização de origem tem capacidade de API limitada e não pode manter extrações agendadas sem atrasos de limite ou de fila. |

| Segurança e governança | Controles obrigatórios | Princípio de privilégio mínimo - Use um usuário de integração dedicado com acesso mínimo de leitura. Nunca use administradores de toda a organização. Autenticação – Use o OAuth 2.0 e aplicativos conectados; faça a rotação regular dos segredos do cliente e monitore o uso do token de atualização. Auditoria e rastreabilidade – Registre todas as execuções de ingestão, alterações de esquema e eventos do conector. Encaminhe registros para SIEM ou sistemas de conformidade para prontidão de auditoria. Classificação de dados – Aplique marcação PII/PHI e Controle de acesso baseado em atributo (ABAC) usando políticas do CEDAR imediatamente após a ingestão para impor mascaramento, consentimento e conformidade a jusante. |

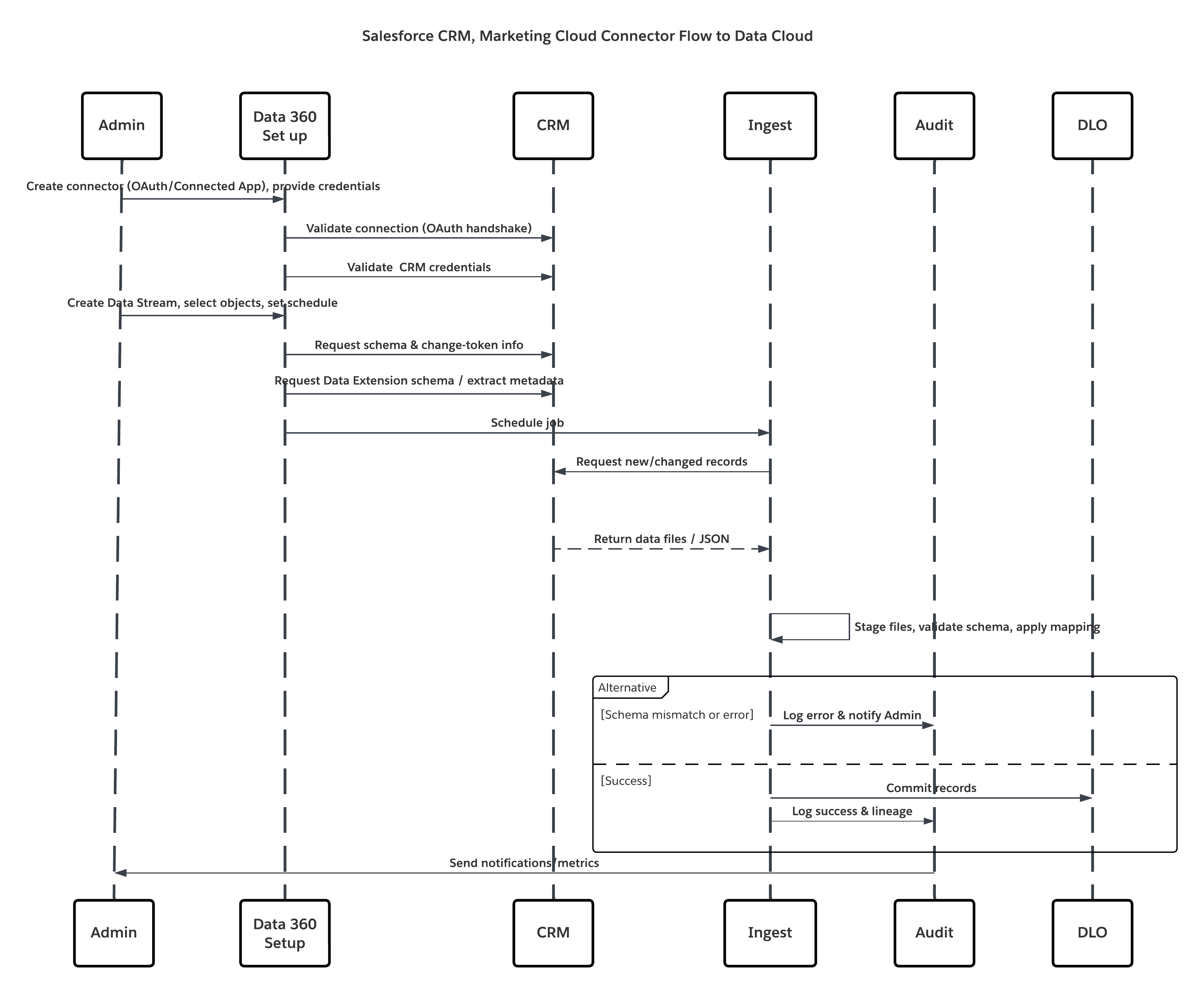

Esboço

Este diagrama ilustra a sequência de etapas para ingerir os dados do armazenamento na nuvem para o Data 360

Neste cenário:

- O administrador provisiona usuários de integração e atribui conjuntos de permissões de conector em organizações de origem.

- O administrador configura os conectores na Configuração do Data 360 (conecta-se ao Salesforce CRM e ao Marketing Cloud por meio de OAuth/aplicativo conectado).

- O administrador cria Fluxos de dados selecionando objetos e Extensões de dados, escolhe atualização completa ou delta e define agendas.

- Em execução agendada, o Data 360 solicita tokens de esquema e delta da(s) origem(s).

- Os sistemas de origem retornam registros (delta ou carga útil total). O Marketing Cloud pode fornecer extrações; o CRM pode retornar resultados de JSON/Query.

- O Data 360 prepara arquivos em sua área de preparação segura interna e valida em relação ao esquema mapeado.

- Se a validação falhar, a ingestão registra o erro, alerta o administrador e interrompe a confirmação. Se a validação for bem-sucedida, o Data 360 confirmará os registros atomicamente para o DLO de destino.

- Os logs de monitoramento e auditoria são atualizados com a linhagem, a duração da execução, as contagens de linhas e o uso de credenciais. Alertas emitidos a administradores se limites ou erros foram acionados.

Resultados

Os principais dados de relacionamento com o cliente e engajamento de marketing são ingeridos no Data 360 como objetos do Data Lake (DLOs). Isso gera:

- Conjunto de dados unificado contendo perfis, casos, oportunidades e métricas de email/engajamento.

- Fundação para resolução de identidade e construção de Perfis de Indivíduo Unificados.

- Preparação operacional para harmonização a jusante, enriquecimento, modelagem de IA e ativação, preservando a governança e a capacidade de auditoria.

Mecanismos de ingestão

O mecanismo de ingestão depende do conector e da estratégia de agendamento definidos no Data 360.

| Mecanismo | Quando usar |

|---|---|

| Conector do Salesforce CRM (nativo) | Melhor para objetos padrão/personalizados do CRM; oferece suporte a atualização completa e delta. |

| Conector de engajamento do Marketing Cloud (nativo) | Melhor para extensões de dados, envios e extrações de rastreamento; oferece suporte a modos full/delta. |

| Iniciar pacotes de dados | Acelere a integração para objetos comuns de Vendas/Serviço/Marketing. |

| Fluxos personalizados + pré-processamento | Use quando transformações complexas ou normalização de esquema pesado forem necessárias. |

Tratamento e recuperação de erros

O tratamento e a recuperação de erros são essenciais para garantir a confiabilidade em operações de ingestão de alto volume.

- Logs por execução: Cada execução de Fluxo de dados fornece detalhes de sucesso/falha e erros no nível da linha.

- Retries & Checkpointing: Execuções com falha podem ser tentadas novamente depois de corrigir problemas de origem ou esquema; o Data 360 usa a semântica de preparação e confirmação atômica.

- Alertas: Configure alertas para desvio de esquema, falhas repetidas ou lacunas de sequência delta.

Considerações sobre design idempotente

A ingestão é idempotente por design: reprocessar a mesma não resulta em registros duplicados. As principais estratégias incluem:

- Detecção de alteração: As extrações de delta dependem de indicadores de alteração do sistema de origem (LastModifiedDate / captura de dados de alteração do sistema). Verifique se a origem fornece carimbos de data/hora confiáveis.

- Deduplicação: Use chaves de negócios exclusivas (por exemplo, Contact.ExternalId) para desduplicar ou inserir e atualizar em DLOs.

- Confirmação transacional: Os registros são preparados e confirmados apenas quando o processamento em lote é concluído com sucesso.

Considerações de segurança

A segurança é integral em todo o pipeline de ingestão, da autenticação à criptografia e controle de acesso.

- Autenticação & Autorização: Os conectores usam a Estrutura de integração segura do Salesforce, aproveitando Credenciais nomeadas e Credenciais externas para autenticação sem expor segredos.

- Criptografia: Os dados são criptografados em trânsito (TLS 1.2+) e em repouso (AES-256).

- Controles de rede: Os sistemas de armazenamento de origem (por exemplo, buckets do S3) devem incluir IPs do Data 360 na lista de permissões.

- Alinhamento de conformidade: Suporta estruturas de proteção de dados corporativas, como diretrizes de GDPR, HIPAA e FFIEC, quando combinadas a Chaves gerenciadas pelo cliente (CMK).

- Auditabilidade: Cada trabalho de ingestão e acesso à credencial são registrados para relatórios de rastreabilidade e conformidade

Barras laterais

Tempo

O tempo depende da agenda de ingestão e do volume de dados.

- O ritmo ideal depende da necessidade do negócio: por hora para acionadores de marketing quase em tempo real, por noite para grandes reconciliações.

- Os modos Delta reduzem a carga e o custo; atualizações completas são mais pesadas e usadas para cargas iniciais ou grandes alterações de esquema.

Volumes de dados

- Os conectores do CRM são otimizados para conjuntos de dados transacionais e de médio volume (milhões de registros).

- Para volumes históricos extremamente grandes, considere o ETL preparado para particionar e carregar em estágios.

Suporte a padrões e funcionalidade do ponto de extremidade

A funcionalidade e o suporte padrão para o ponto de extremidade dependem da solução escolhida.

| Conector | Requisitos de ponto de extremidade |

|---|---|

| Conector do Salesforce CRM | A organização de origem deve permitir um aplicativo conectado, tokens OAuth e um usuário de integração dedicado com permissões de leitura. |

| Conector do Marketing Cloud | Credenciais da API do Marketing Cloud ou pacote instalado; As Extensões de dados devem expor dados por meio de Extrações/API. |

Gerenciamento de estado

- Estado do conector: Os fluxos de dados mantêm os últimos carimbos de data e hora de sincronização bem-sucedidos e deslocamentos de delta.

- Estratégia principal chave: Prefira identificadores de negócios consistentes (IDs externos) para que a reconciliação a jusante e os upserts sejam determinísticos.

Cenários de integração complexos

Em arquiteturas empresariais avançadas, esse padrão pode ser integrado a:

- Topologias híbridas: Combine a ingestão de CRM com streaming (eventos de plataforma) para atualizações quase em tempo real.

- Orquestração de middleware: Use ferramentas MuleSoft ou ETL quando orquestração, aprimoramento ou pré-ingestão de transformação complexos forem necessários.

- Loops de feedback da ativação: DMOs harmonizados podem acionar atualizações a jusante para sistemas de origem por meio de Ações de dados ou APIs de plataforma (cuidado com controles de SOD).

Exemplo

Um varejista multinacional consolida as métricas de engajamento de Contas, Contatos, Casos, Oportunidades e Marketing Cloud no Data 360 para criar uma visualização unificada do cliente. O Pacote de dados Starter inicializa os principais objetos de Vendas e Serviço, enquanto a equipe estende o modelo com campos personalizados, como Loyalty_Membershipc e Customer_Tierc, para capturar o contexto de fidelidade. Os fluxos de dados do CRM são executados a cada hora no modo delta e o Marketing Cloud Engagement é sincronizado diariamente usando extrações de delta para eventos de engajamento. Esses conjuntos de dados são processados por meio de DLOs e resolução de identidade, resultando em um perfil de cliente unificado que combina sinais de engajamento e CRM para aprimorar a personalização e modelos de IA a jusante.

Esses padrões são criados para cenários em que milissegundos são importantes, quando interações, transações ou sinais do cliente devem acionar percepções ou ações imediatas. Eles vão além da ingestão em lote tradicional agendada para habilitar o fluxo de dados conduzido por evento, em que as informações são processadas no momento em que são geradas. No ecossistema do Salesforce Data 360, "tempo real" não é um único modo, é um continuum de modelos de latência. Em uma extremidade está a sincronização quase em tempo real, em que atualizações de sistemas de registro (como CRM ou ERP) são refletidas no Data 360 em segundos ou minutos. No outro lado está a captura de evento em tempo real, em que sinais comportamentais do lado do cliente, como cliques, compras ou interações móveis, são ingeridos e ativados em milissegundos. Para arquitetos, a distinção é mais do que semântica. Ela define como os pipelines são projetados, como as APIs são invocadas e como as decisões posteriores são tomadas. Selecionar o padrão certo, seja sincronização quase em tempo real ou ingestão de streaming de evento, garante que o sistema atenda às metas de latência operacional dos negócios enquanto mantém a integridade, a escalabilidade e a governança dos dados.

Contexto

Esse padrão permite que qualquer sistema externo, como um aplicativo personalizado, uma plataforma Internet das Coisas (IoT), um sistema de ponto de venda (POS) ou um serviço de terceiros, envie programaticamente dados de evento para o Data 360 quase em tempo real conforme ocorrem eventos separados.

Problema

Como um desenvolvedor pode enviar com confiança registros únicos ou pequenos lotes assíncronos de eventos de um aplicativo externo para o Data 360 com baixa latência para que os dados estejam disponíveis rapidamente para processamento, segmentação e ativação?

Forças

Esse padrão oferece baixa latência e melhor controle do desenvolvedor, mas introduz várias restrições técnicas e dependências operacionais:

- Dependência de desenvolvedor: Requer esforço do desenvolvedor para implementar clientes da API REST autenticados e lógica de erro/tentativa – não é um conector de apontar e clicar.

- Esquema rígido na gravação: A API de ingestão aplica o esquema-em-gravação. Um esquema preciso deve ser definido e carregado para a configuração do conector; todas as cargas úteis devem atender exatamente ou ser rejeitadas.

- Modos de interação dupla: O mesmo conector oferece suporte ao streaming (JSON) para atualizações de baixa latência, registro por registro e em massa (CSV) para sincronizações periódicas maiores – os arquitetos devem escolher por caso de uso.

- Autenticação & Segurança: As chamadas devem ser autenticadas por meio de um aplicativo conectado do Salesforce usando OAuth 2.0 (por exemplo, Fluxo do portador JWT para servidor a servidor). Escopos de gerenciamento de token, rotação e privilégio mínimo são obrigatórios.

- Visibilidade operacional: Os desenvolvedores e as equipes da plataforma devem implementar o monitoramento para códigos de resposta, novas tentativas, filas de letras inativas e alertas de desvio de esquema.

- Requisito de gráfico em tempo real: Para ativação instantânea verdadeira (segmentação instantânea, mapeamento de DMO em tempo real), o Objeto de modelo de dados (DMO) de destino deve fazer parte do gráfico de dados em tempo real; caso contrário, os eventos atravessarão um pipeline de latência ligeiramente maior.

Solução

Esta tabela contém soluções para esse problema de integração.

| Área de solução | Ajuste | Comentários/Detalhes da implementação |

|---|---|---|

| Ajuste da solução | Melhor para captura de evento de baixa latência | Use a API de ingestão do Data 360 (JSON de streaming) para enviar eventos únicos ou microlote. Configure o conector da API de ingestão com um esquema OAS 3.0 estrito (.yaml). Use a ingestão CSV em massa para sincronizações maiores e menos frequentes. |

| Lidar com alterações de esquema | Rígido / Gerenciado | As alterações de esquema estão em andamento: atualize o .yaml do OAS, faça a versão do conector e realize testes de contrato. Implemente a migração de esquema progressivo se os produtores não puderem alterar simultaneamente. |

| Quando não usar | Subóptimo | Não é ideal se o pré-processamento for necessário (por exemplo, desduplicação, pedido garantido etc.) ou para cargas em massa extremamente grandes (use conectores em massa nativos ou ETL em lote). Se a origem não puder produzir cargas úteis válidas para esquema ou não puder se autenticar com segurança, use métodos de ingestão alternativos. |

| Segurança e governança | Obrigatório | Use OAuth 2.0 com escopos de privilégio mínimo, chaves de rotação, uso de token de log. Imponha o TLS 1.2+, valide os IPs do cliente, se necessário, e garanta a marcação de PII da carga útil. Todos os eventos devem conter metadados de provenência (origem, carimbo de data e hora, versão do esquema, chave de idempotency). |

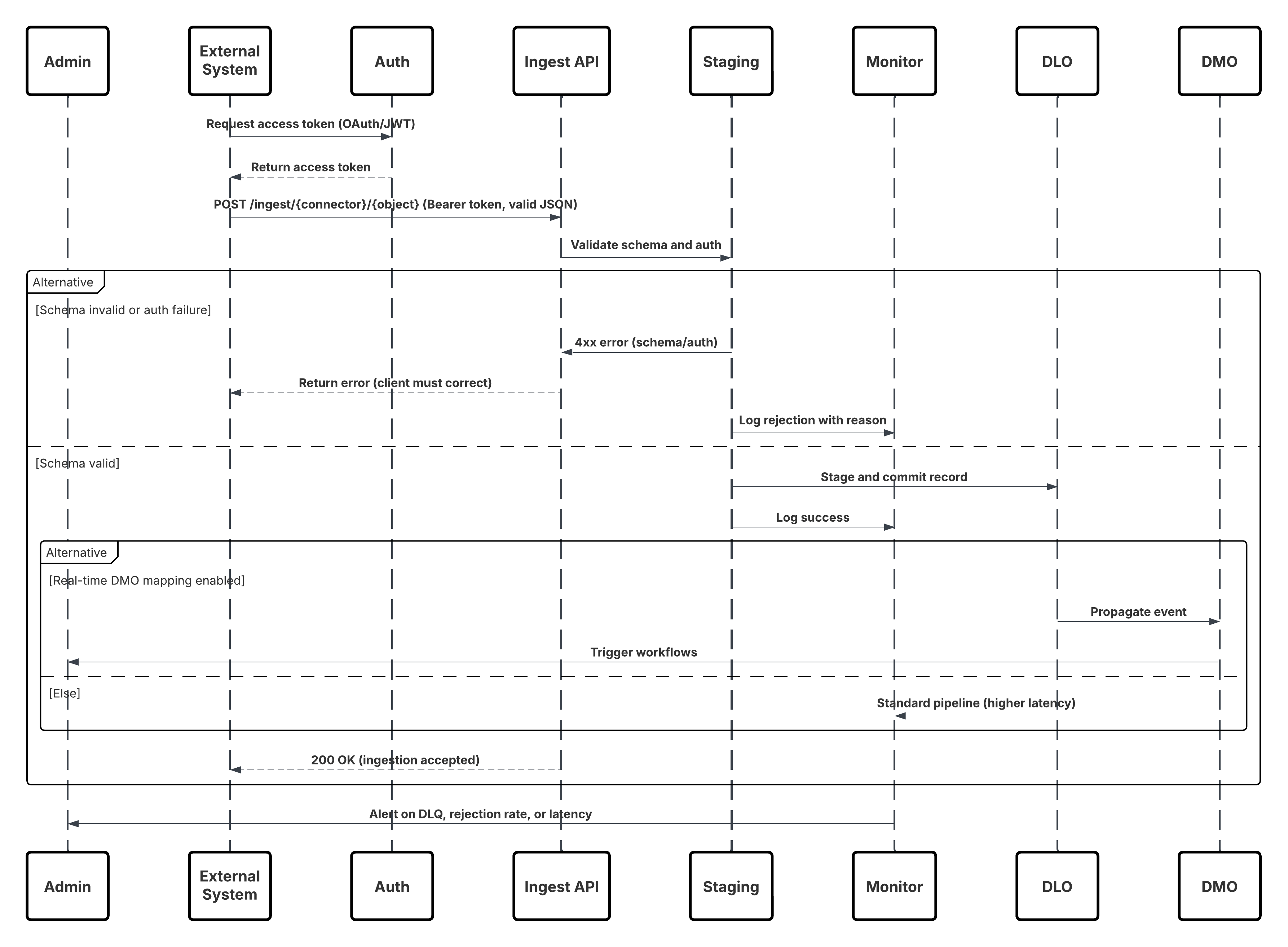

Esboço

Este diagrama ilustra a sequência de etapas para ingerir os dados da API de ingestão no Data 360

Neste cenário:

- O Sistema externo solicita autenticação por meio do OAuth/JWT do Servidor de autenticação.

- O Servidor de autenticação retorna o token de acesso ao Sistema externo.

- O Sistema externo envia uma solicitação POST de ingestão de dados para a API de ingestão do Data 360 com autorização e carga útil JSON.

- A API de ingestão valida o esquema de solicitação e a autenticação por meio do módulo Preparação e validação.

- Em falha de esquema/autenticação:

- Erro retornado para o Sistema externo.

- Rejeição registrada para monitoramento e alerta.

- Na validação bem-sucedida:

- Registros preparados e confirmados no Objeto do Data Lake (DLO).

- Sucesso registrado para monitoramento.

- Se habilitado, os dados são propagados para o Gráfico de dados em tempo real (DMO) acionando fluxos de trabalho downstream.

- Caso contrário, os dados são processados por meio de um pipeline de maior latência ou lote padrão.

- A API de ingestão confirma o sucesso para o Sistema externo.

- Os componentes de monitoramento alertam o administrador sobre filas de letras mortas, taxas de rejeição ou problemas de latência.

Resultados

Dados de evento externo são ingeridos em DLOs do Data 360 com baixa latência. Quando o DMO de destino faz parte do gráfico em tempo real, os dados estão disponíveis para segmentação instantânea, fluxos de trabalho do agente, modelos de IA e ativação operacional. Isso habilita respostas comerciais rápidas a eventos originados de qualquer sistema conectado.

Mecanismos de ingestão

O mecanismo de ingestão depende do conector e da estratégia de agendamento definidos no Data 360.

| Mecanismo | Quando usar |

|---|---|

| Streaming JSON (API de ingestão) | Eventos únicos, microlote, eventos comportamentais, fluxos de cliques, telemetria de IoT – quando baixa latência é necessária. |

| CSV em massa (modo em massa da API de ingestão) | Uploads periódicos maiores em que os requisitos de latência são relaxados. |

| Edge / Middleware | Use quando precisar de validação, transformação, aprimoramento ou limitação de taxa antes de enviar por push para a API de ingestão. |

Tratamento e recuperação de erros

- Erros imediatos (sincronização): Respostas 4xx para erros de esquema/autenticação – o cliente deve corrigir a carga útil ou o token e tentar novamente.

- Falhas temporárias (assíncronas): 5xx responses – novas tentativas de cliente com desvio exponencial e agitação.

- Fila de letras mortas (DLQ): Falhas persistentes chegam ao DLQ para inspeção manual e reprodução.

- Monitoração: Acompanhe a taxa de rejeição de esquema, falhas de autenticação, percentis de latência e pendências de DLQ. Alerta sobre limites.

Considerações sobre design idempotente

- Chave de idempotency: Cada evento deve incluir uma chave de idempotency/ID de mensagem exclusiva.

- Estratégia de inserção e atualização: Use chaves de negócios (ExternalId) para evitar duplicatas em repetições.

- Janela de desativação: O arquiteto deve definir janelas de desduplicação e retenção para rastreamento de idempotência.

Considerações de segurança

A segurança é integral em todo o pipeline de ingestão, da autenticação à criptografia e controle de acesso.

- Autenticação: OAuth 2.0 (portador JWT) recomendado para servidor a servidor. Limite escopos apenas à ingestão.

- Criptografia: TLS 1.2+ para transporte; o Data 360 impõe a criptografia em repouso.

- Privilégio mínimo: As credenciais do aplicativo conectado têm direitos mínimos; segredos de rotação e registros de acesso de instrumento.

- Governação da carga de pagamento: Inclua sinalizadores de consentimento/consumo em metadados de evento; aplique políticas ABAC/CEDAR imediatamente após a ingestão.

- Controles de IP / Conexão privada: Quando necessário, restrinja o acesso por meio de listas de permissões ou use a Conexão privada para rede privada.

Barras laterais

Tempo

O tempo depende da agenda de ingestão e do volume de dados. O JSON de streaming gera uma latência de subsegundo a segundo, dependendo do processamento e da configuração do gráfico. CSV em massa é de minutos a horas. Escolha com base em SLAs de negócios.

Volumes de dados

Os tamanhos de eventos individuais devem ser pequenos (menos de alguns KB). Para produtores de alta taxa de transferência, considere fazer o lote no produtor ou usar uma margem de streaming (Kafka/Kinesis) antes de chamar a API.

Gerenciamento de estado

- Versão do esquema: Mantenha a versão do esquema nos metadados de evento e use o controle de versão do conector ao atualizar o contrato do OAS.

- Deslocamentos do conector: O Data 360 lida com a semântica de compromisso; os produtores devem rastrear chaves de idempotency e a última sequência bem-sucedida para reprodução segura.

Cenários de integração complexos

Em arquiteturas empresariais avançadas, esse padrão pode ser integrado a:

- Caixa de validação de borda: Use o middleware para traduzir formatos de produtores heterogêneos para o contrato OAS necessário, realizar a limitação de taxa e pré-aprimoramento.

- Arquiteturas híbridas: Combine a API de ingestão para eventos e Conectores para reconciliação em massa.

- Ativação do agente: Os eventos mapeados para DMOs em tempo real podem acionar fluxos de trabalho do Agentforce e modelos do Einstein para tomada de decisão automatizada.

Exemplo

Uma rede de varejo transmite eventos de compra de ponto de venda (POS) para o Data 360 em tempo real para impulsionar o engajamento imediato do cliente. Cada loja executa um componente de servidor leve que coleta transações, aprimora-as com metadados de local e dispositivo e publica eventos JSON com segurança usando OAuth portador JWT com chaves de idempotency para evitar duplicações. Um administrador define a estrutura do evento carregando um esquema OAS para o ponto de venda e configurando o conector da API de ingestão. Os eventos recebidos são ingeridos no DLO pos_sale, mapeados para o DMO de vendas e adicionados ao gráfico em tempo real. Como resultado, as compras de alto valor são detectadas instantaneamente, acionando fluxos de trabalho VIP no Agentforce e atualizando a segmentação de clientes para promover a personalização em tempo real.

Contexto

Esse padrão permite a captura de dados de interação do usuário granulares de alto volume, como visualizações de página, cliques em botões, impressões de produto e reproduções de vídeo, de sites e aplicativos móveis em tempo real. É fundamental para oferecer personalização no momento, em que cada interação digital pode influenciar dinamicamente a experiência do usuário e promover o engajamento.

Problema

Como uma empresa pode capturar e processar um fluxo contínuo de eventos comportamentais de propriedades digitais, abrangendo milhões de interações do usuário por minuto, e disponibilizar esses dados imediatamente no Data 360 para habilitar a segmentação, a personalização e a ativação em tempo real?

Forças

Esse caso de uso apresenta vários desafios de design que exigem uma arquitetura de ingestão de baixa latência criada para fins específicos:

- Período extremo : Sites de alto tráfego ou aplicativos móveis podem emitir milhões de eventos por minuto. A camada de ingestão deve ser dimensionada horizontalmente para lidar com esse volume sem perda de evento ou contrapressão, garantindo uma latência consistente sob cargas de pico.

- Instrumentação no lado do cliente: Diferentemente das integrações conduzidas pelo servidor, esse padrão depende dos SDKs do lado do cliente. Um emblema JavaScript (SDK de Interações do Salesforce) deve ser integrado a cada página ou um SDK nativo integrado a aplicativos móveis. Isso requer implementação de cliente robusta, controle de versões e governança de esquema de evento.

- Processamento de evento de baixa latência : As ações do usuário, como "adicionar ao carrinho" ou "jogar vídeo", devem alcançar o Data 360 dentro de segundos, habilitando ativação em tempo real e respostas contextuais (por exemplo, ofertas direcionadas, recomendações personalizadas).

- Armonização de dados e resolução de identidade: Os eventos capturados geralmente incluem identificadores anônimos (cookies, IDs de dispositivo, tokens de sessão). Para habilitar os casos de uso do Customer 360, eles devem ser mapeados para perfis conhecidos por meio da resolução de identidade do Data 360 e harmonizados com o Modelo de dados do Customer 360.

Solução

A abordagem recomendada é usar o Conector de personalização do Salesforce Marketing Cloud, um pipeline de streaming nativo e totalmente gerenciado projetado para ingestão comportamental de alto rendimento.

| Área de solução | Ajuste | Comentários/Detalhes da implementação |

|---|---|---|

| Captura de evento baseada em SDK | Melhor | Implemente o SDK de Interações do Salesforce (web) ou o SDK nativo (móvel). Essas bibliotecas leves capturam e serializam interações do usuário em tempo real, anexando metadados (ID da sessão, carimbo de data e hora, contexto). |

| Pipeline de streaming de evento | Melhor | Os eventos são enviados ao serviço de streaming de eventos da Personalização do Marketing Cloud por HTTPS seguro. Essa camada é escalonável horizontalmente e otimizada para transmissão de baixa latência (<2s). |

| Integração do Data 360 | Melhor | O Conector de personalização do Data 360 assina o feed de streaming, ingerindo cada evento em um Objeto do Data Lake (DLO) quase em tempo real. |

| Mapeamento de modelo de dados | Práticas recomendadas | O DLO ingerido é mapeado para objetos de modelo de dados (DMOs) do Customer 360. Isso habilita a vinculação de usuários anônimos e conhecidos por meio da Resolução de identidade. |

| Habilitação de gráfico em tempo real | Opcional / Recomendado | Inclua DMOs mapeados no gráfico em tempo real para segmentação instantânea, acionando ações personalizadas por meio de fluxos de trabalho do Einstein ou Agentforce. |

| Quando Não usar | Subóptimo | Esse padrão não é ideal quando: Os dados de origem são cliente da Web e eventos (use a API de ingestão em vez disso). A organização não tem controle sobre clientes da Web/móveis. Não é necessário rastreamento de comportamento em tempo real (use ingestão em lote). |

| Lidar com as alterações do esquema | Evolução gerenciada | Os esquemas de evento evoluem conforme novas interações são adicionadas. Os SDKs devem ter definições de evento de versão. Alterações compatíveis com versões anteriores (adicionando campos opcionais) são seguras; alterar as alterações exige reconfiguração do conector e teste de contrato. |

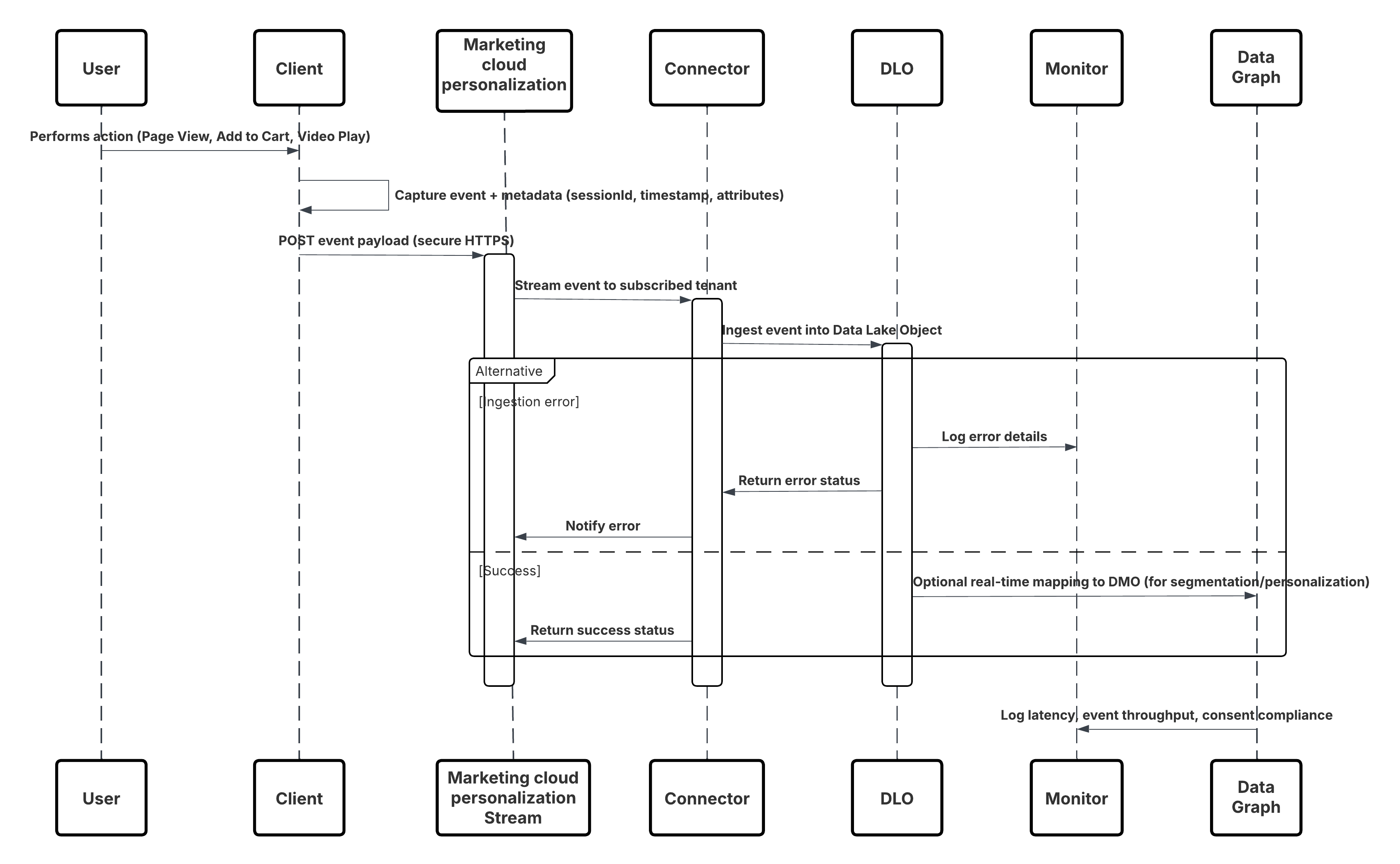

Esboço

Este diagrama ilustra a sequência de etapas para ingerir os dados de canais móveis e da Web no Data 360

Neste cenário:

- Implemente o SDK em canais da Web ou móveis (captura de interação do usuário).

- Configure o SDK com ID do locatário, ambiente e controles de consentimento.

- Transmita eventos JSON capturados (metadados + atributos) para o ponto de extremidade de streaming do Marketing Cloud.

- Na Configuração do Data 360, crie e configure o Conector de personalização para o locatário.

- Ingira eventos em um DLO e mapeie o DLO → DMO dentro do Data 360.

- Habilite o DMO no gráfico em tempo real para ativação imediata.

- Monitore a latência, a conformidade do esquema, os sinalizadores de consentimento, a taxa de transferência e as taxas de erro.

- Implante em produção e monitore continuamente.

Resultados

Um fluxo contínuo de eventos comportamentais de baixa latência flui de canais digitais para o Data 360. Dentro de segundos, cada ação do usuário fica disponível para segmentação em tempo real, modelagem preditiva ou personalização acionada, habilitando experiências do cliente verdadeiramente adaptáveis.

Mecanismos de ingestão

O mecanismo de ingestão depende do conector e da estratégia de agendamento definidos no Data 360.

| Mecanismo | Quando usar |

|---|---|

| SDK de interações (Web) | Captura em tempo real de navegadores da Web e SPAs. |

| Mobile SDK | Captura em tempo real de aplicativos móveis nativos. |

| Conector de personalização | Assinatura gerenciada entre o Marketing Cloud e o Data 360\. |

| Mapeamento de gráfico em tempo real | Habilita a ativação imediata em Segmentação, Einstein e Jornadas. |

Tratamento e recuperação de erros

- Tolerância de falha em camadas: Implemente mecanismos de validação e repetição de vários níveis – os SDKs do cliente lidam com falhas temporárias com fallos exponenciais, enquanto a camada de ingestão usa filas duráveis e pipelines reproduzíveis para evitar a perda de dados.

- Esquema e governança de dados: Versione e valide esquemas de evento continuamente; eventos inválidos ou em evolução são roteados para uma Rejeição de esquema ou Fila de letras mortas para triagem e reprodução seguras.

- Idempotency & Deduplicação: Use identificadores de evento estáveis e semântica de inserção e atualização para garantir o processamento exato mesmo durante novas tentativas ou repetições.

- Automação de monitoramento e recuperação: O monitoramento contínuo de taxa de transferência, latência e erro aciona fluxos de trabalho de recuperação automatizados, garantindo baixa latência, entrega confiável e resultados de personalização consistentes em tempo real.

Considerações sobre design idempotente

- Cada evento deve conter uma chave de idempotency ou ID de mensagem exclusiva para que envios duplicados possam ser desduplicados a jusante.

- Use chaves de negócios (por exemplo, sessionID + eventTimestamp + userID) quando apropriado para identificar duplicados.

- Defina uma janela de desduplicação (por exemplo, 24 horas) durante a qual eventos duplicados são ignorados ou filtrados.

- Use estratégias de inserção e atualização quando apropriado (por exemplo, atualizar contadores ou sinalizadores em vez de inserir itens duplicados).

Considerações de segurança

A segurança é integral em todo o pipeline de ingestão, da autenticação à criptografia e controle de acesso.

- Criptografia de transporte: TLS 1.2+ para todas as conexões de serviço de streaming → SDK.

- Criptografia de dados em repouso no Data 360 e no fluxo de marketing.

- O SDK respeita os indicadores de consentimento do usuário (GDPR/CCPA) e suprime o rastreamento se o consentimento for negado.

- Autenticação do tráfego SDK: garanta que apenas locatários/clientes aprovados possam transmitir eventos.

- Metadados: cada evento deve incluir ID de origem, carimbo de data e hora, versão do esquema, ID da sessão, chave de idempotency.

- Acesso de privilégio mínimo: Pontos de extremidade e conectores de SDK limitados ao escopo de ingestão de evento; faça a rotação das credenciais regularmente.

- Classificação de dados: Anote PII em cargas úteis de evento, aplique políticas imediatamente após a ingestão

Barras laterais

Tempo

- O tempo depende da atividade do usuário final e da configuração de streaming de evento.

- Os eventos capturados por meio do SDK de Interações do Salesforce e entregues por meio do Fluxo de personalização do Marketing Cloud geralmente alcançam uma latência de ~2 segundos a ~2 segundos antes de ficarem disponíveis no Gráfico em tempo real do Data 360.

- Isso habilita a segmentação, a personalização e a ativação quase instantâneas em sessões de usuário ativas.

Volumes de dados

Eventos comportamentais individuais (por exemplo, clique, exibição, adição ao carrinho) são leves, geralmente de 1 a 5 KB por carga útil. Para propriedades digitais em grande escala, espere milhares a milhões de eventos por minuto. Para garantir taxa de transferência e resiliência:

- Use os mecanismos de repetição e lote integrados do SDK para páginas de alto tráfego.

- Descarregue a manipulação de explosões para a camada de buffer de streaming do Marketing Cloud.

- Monitore a taxa de ingestão e as proporções de erro usando o painel de métricas do conector.

Gerenciamento de estado

Cada evento inclui metadados para controle de estado e versão: