Moderne Salesforce-integraties moeten veel meer ondersteunen dan alleen gegevensuitwisseling. Van hen wordt verwacht dat ze realtime klantervaringen aansturen, acties binnen meerdere systemen coördineren en betrouwbaar werken op ondernemingsniveau—alles terwijl ze voldoen aan strenge beveiligings- en nalevingsvereisten. Het kiezen van de juiste integratiebenadering is daarom een kritische architectonische beslissing, geen implementatiedetail. Overweeg een veelvoorkomend ondernemingsscenario. Een klant voltooit een aankoop in een mobiele app en activeert via een trigger een realtime aanspraakcontrole voor een gepersonaliseerde aanbieding. Tegelijkertijd moeten transactiegegevens worden vastgelegd in een ERP-systeem, moeten klantkenmerken worden bijgewerkt in Salesforce en moeten analyses worden gestreamd naar een gegevens-lake—zonder latentie, gegevensduplicatie of nalevingsrisico te introduceren. Scenario's zoals deze zijn nu typisch in moderne Salesforce-omgevingen, waar Salesforce zelden geïsoleerd werkt en naadloos moet worden geïntegreerd met een breder ecosysteem van toepassingen en gegevensplatforms. Deze handleiding is bedoeld om architecten en ontwikkelaars te helpen deze integraties met duidelijkheid en vertrouwen te ontwerpen. In plaats van zich te richten op punt-naar-punt implementaties, biedt het een set bewezen integratiepatronen die betrekking hebben op terugkerende ondernemingsscenario's, zoals procescombinatie, gegevenssynchronisatie en realtime gegevenstoegang. Elk patroon legt de nadruk op architectonische intent, trade-offs en uitvoeringsmodellen, waardoor teams weloverwogen ontwerpbeslissingen kunnen nemen die schaalbaar en duurzaam zijn. In dit document vindt u:

- Integratiepatronen die veelvoorkomende ondernemings“archetypen” vertegenwoordigen voor proces-, gegevens- en virtuele-toegangsscenario's

- Een framework voor patroonselectie om de juiste aanpak te identificeren op basis van integratie-intent en uitvoeringstiming

- Praktische richtlijnen voor schaalbaarheid, veerkracht, governance en beveiligingsoverwegingen

- Best practices uit Salesforce- en Data 360-implementaties uit de praktijk Het doel van dit document is om een gedeelde architectuurtaal voor integratie te bieden, die teams helpt oplossingen te ontwerpen die prestaties, flexibiliteit en Trust in balans brengen en tegelijkertijd overeenkomen met ondernemingsgegevens en governance-strategieën.

Dit document is bedoeld voor ontwerpers en architecten die gegevens uit andere toepassingen in hun onderneming moeten integreren met Salesforce Data 360 (voorheen Data Cloud). Deze inhoud is een distillatie van vele succesvolle implementaties door Salesforce-architecten en -partners. Als u vertrouwd wilt raken met integratiemogelijkheden en opties die beschikbaar zijn voor grootschalige toepassing van Data 360, leest u de secties Patroonsamenvatting en Patroonselectiehandleiding hieronder. Architecten en ontwikkelaars moeten rekening houden met deze patroondetails en best practices tijdens de ontwerp- en implementatiefase van gegevensinteractieprojecten in Data 360. Als deze patronen op de juiste manier worden geïmplementeerd, kunt u zo snel mogelijk naar productie gaan en beschikt u over de meest stabiele, schaalbare en onderhoudsvrije set toepassingen. De eigen consultingarchitecten van Salesforce gebruiken deze patronen als referentiepunten tijdens architectuurbeoordelingen en onderhouden en verbeteren ze actief. Zoals bij alle patronen omvat deze inhoud de meeste integratiescenario's, maar niet alle. Hoewel Salesforce integratie van de gebruikersinterface (UI) toestaat, vallen mashups bijvoorbeeld buiten het bereik van dit document.

Elk integratiepatroon volgt een consistente structuur. Dit biedt consistentie in de informatie die in elk patroon wordt gegeven en maakt het ook gemakkelijker om patronen te vergelijken.

- Naam: De patroonidentifier die ook het type integratie aangeeft dat in het patroon is opgenomen.

- Context: Het algemene integratiescenario waarop het patroon betrekking heeft. Context geeft informatie over wat gebruikers proberen te bereiken en hoe de toepassing werkt om aan de vereisten te voldoen.

- Probleem: Uitgedrukt als een vraag is dit het scenario dat het patroon moet oplossen. Lees deze sectie om te begrijpen of het patroon geschikt is voor uw integratiescenario.

- Krachten: De beperkingen en omstandigheden die het opgegeven scenario moeilijk op te lossen maken.

- Oplossing: De aanbevolen manier om het integratiescenario op te lossen.

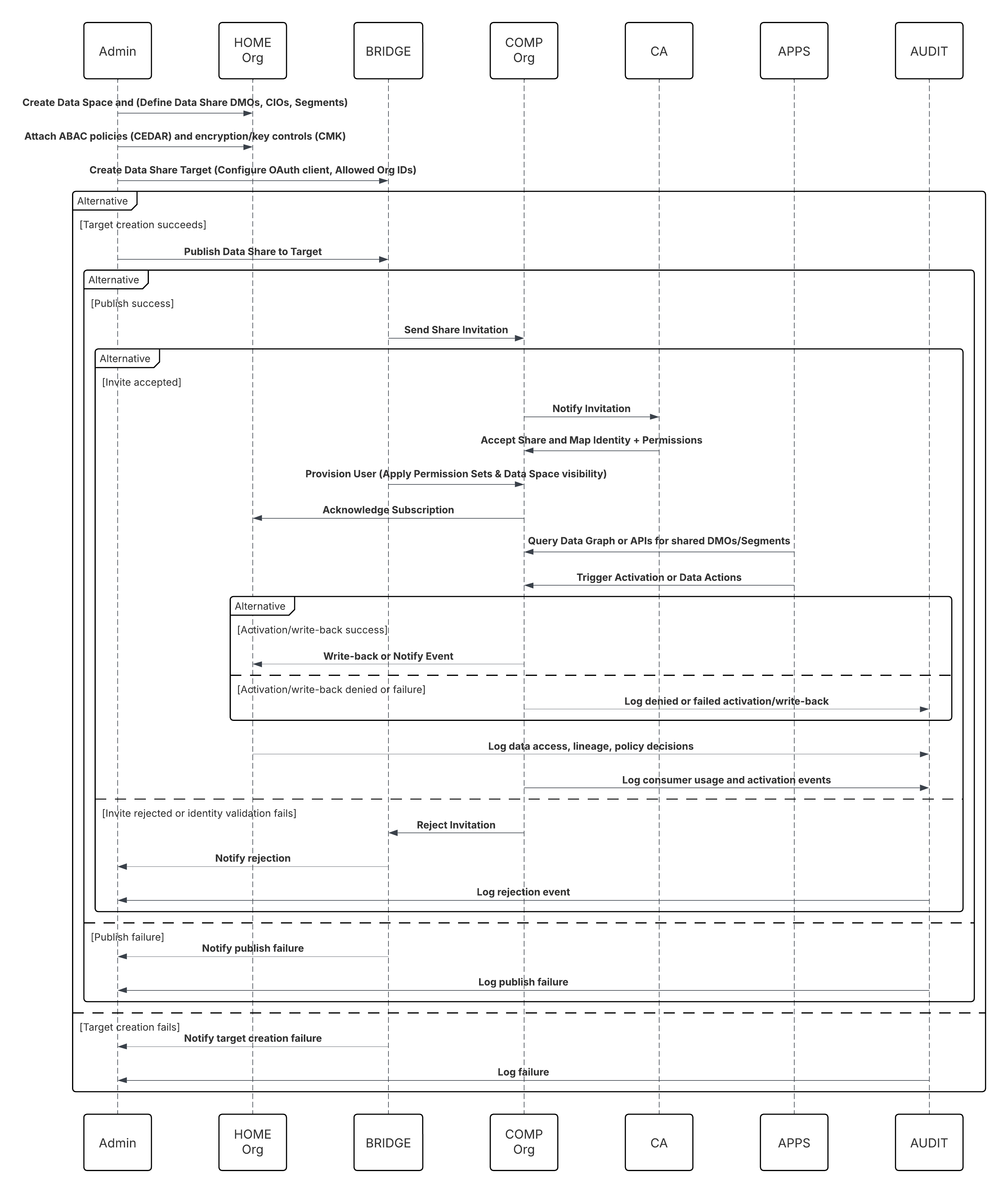

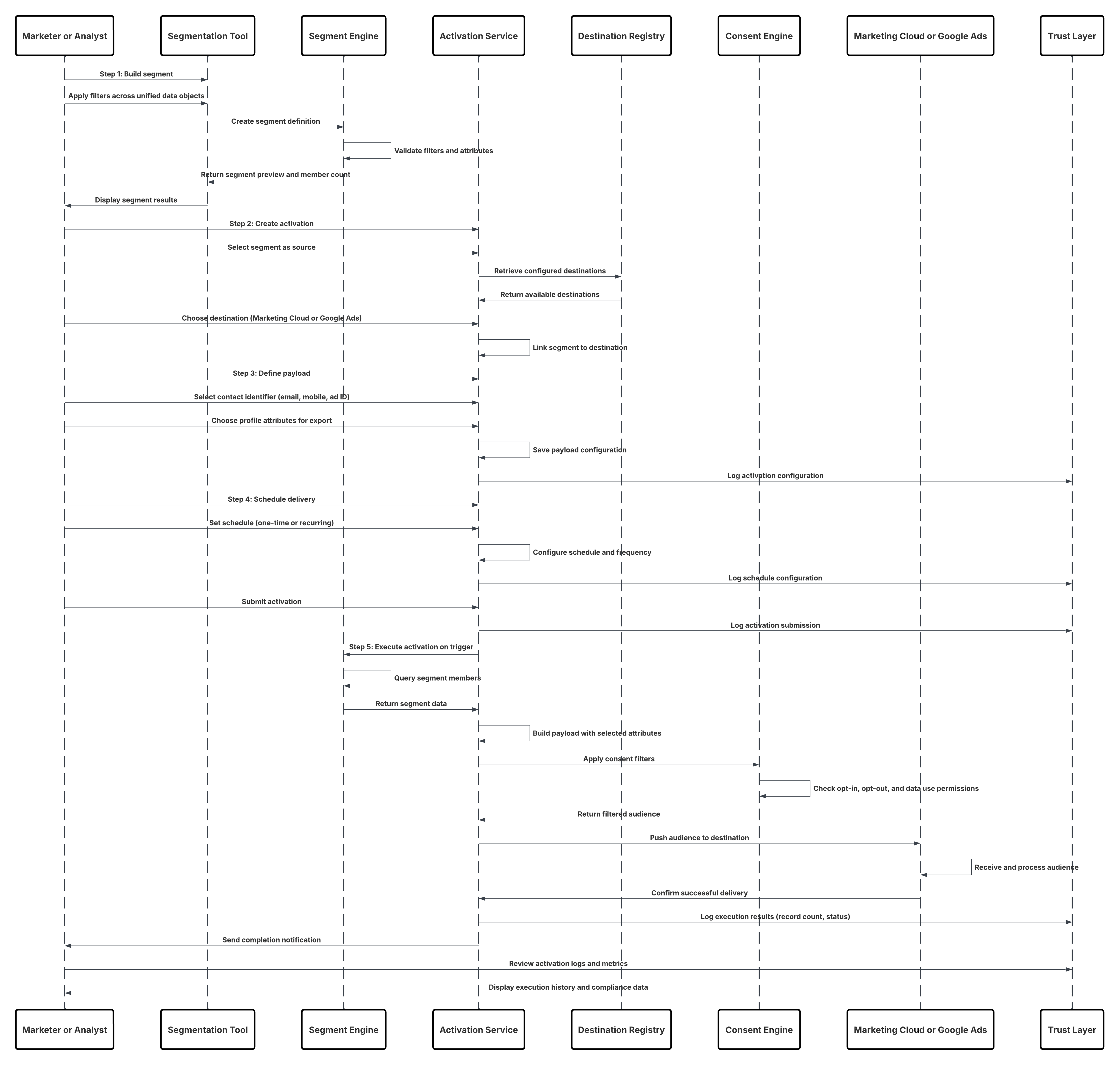

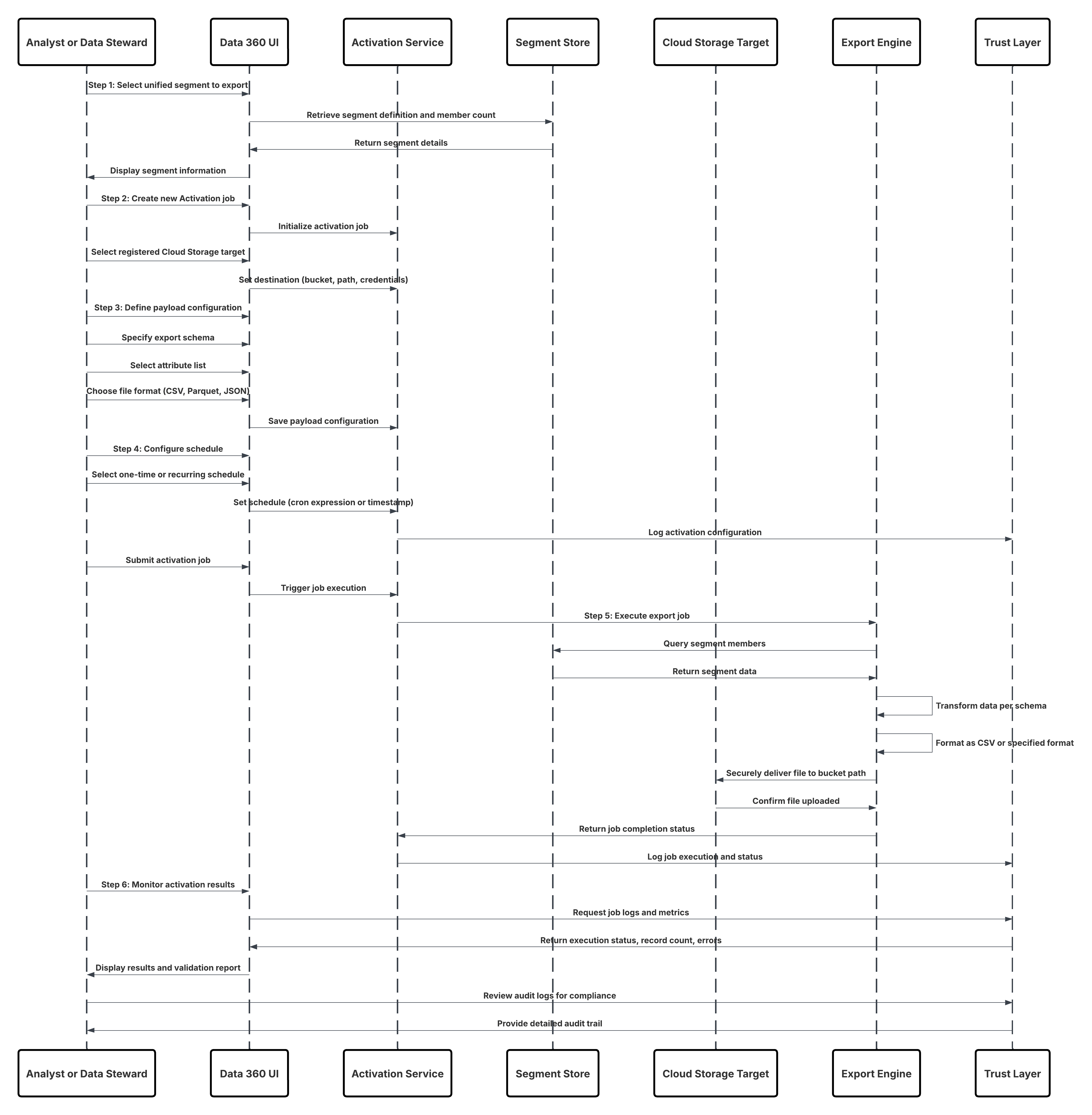

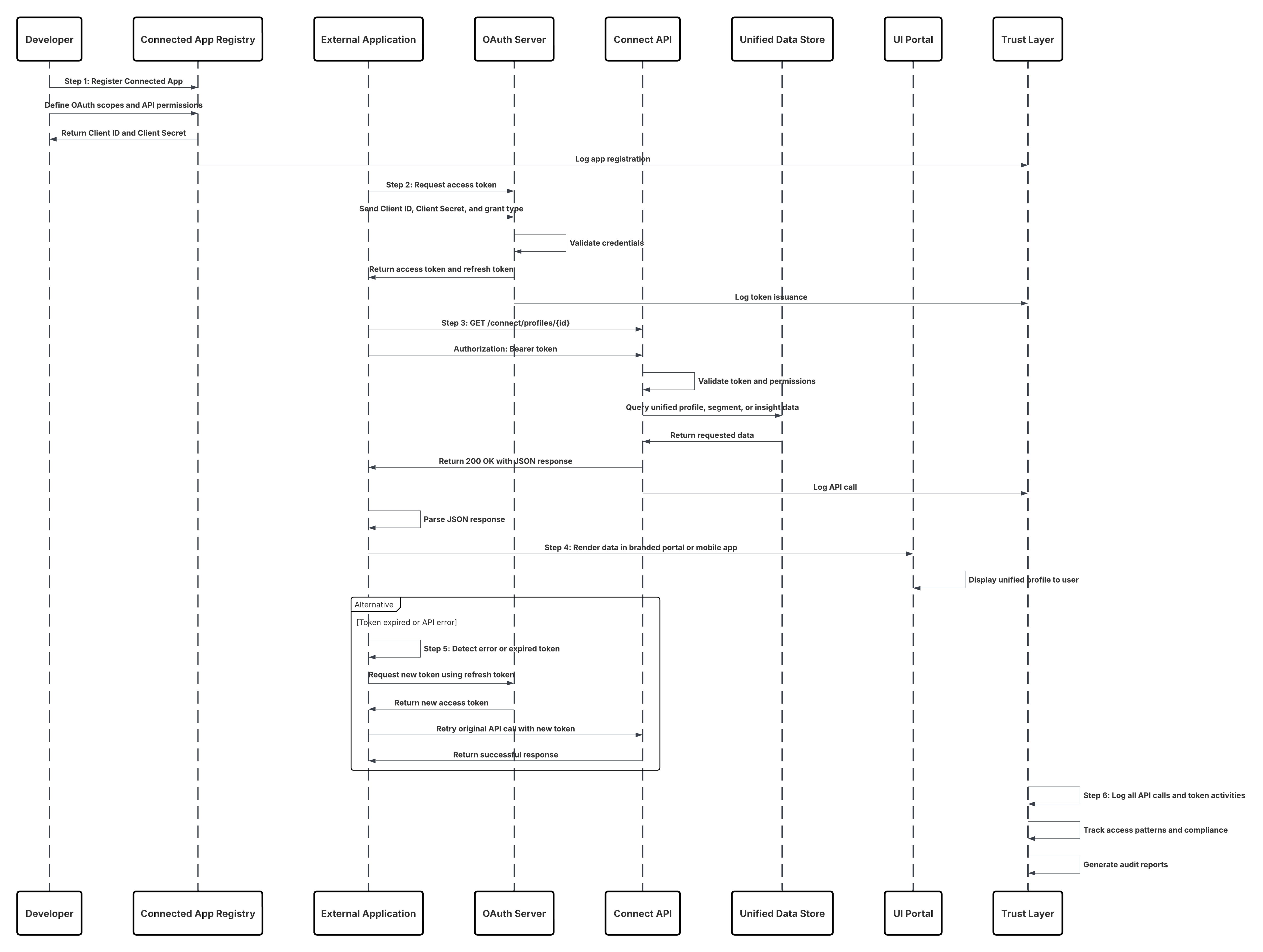

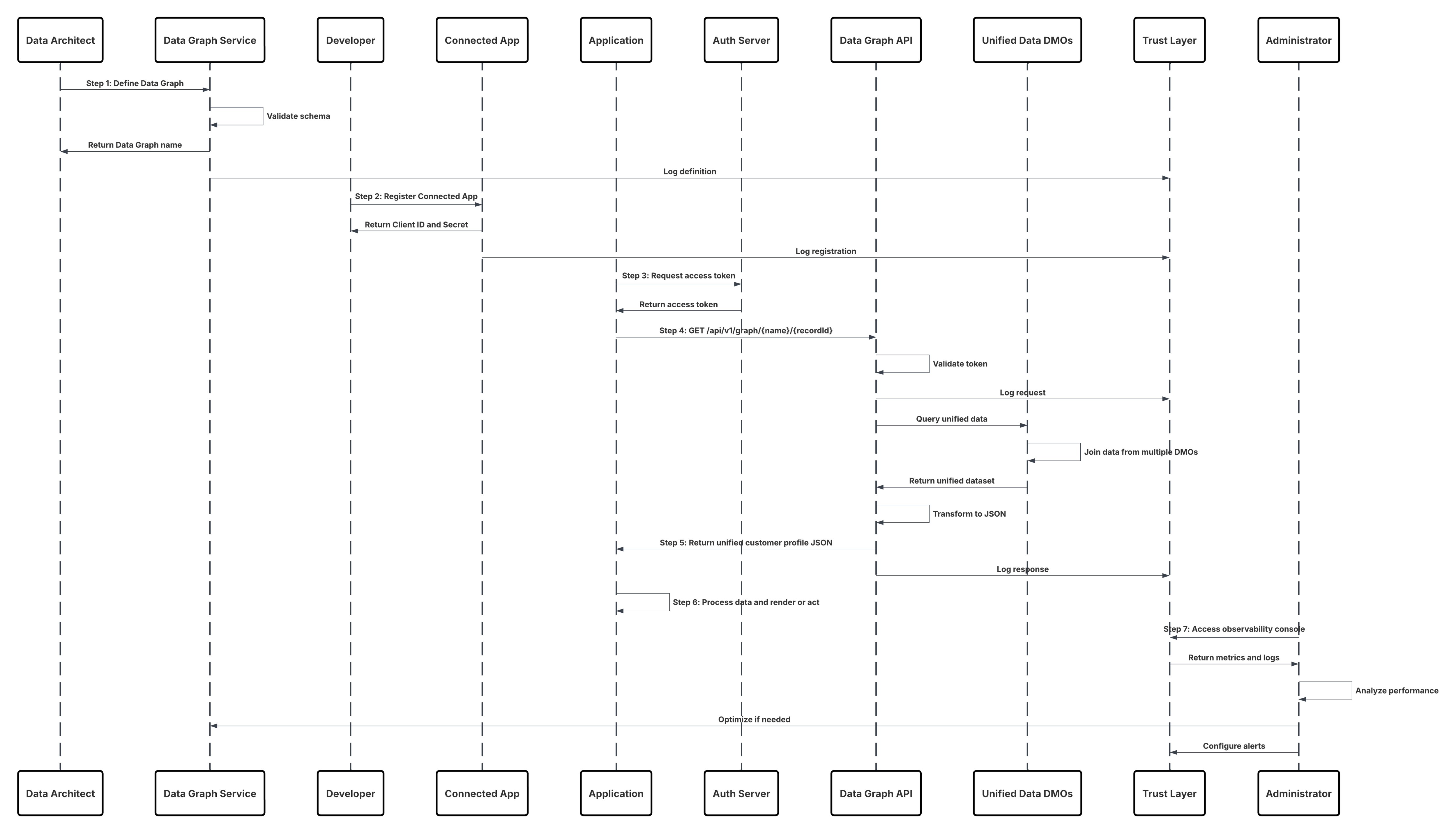

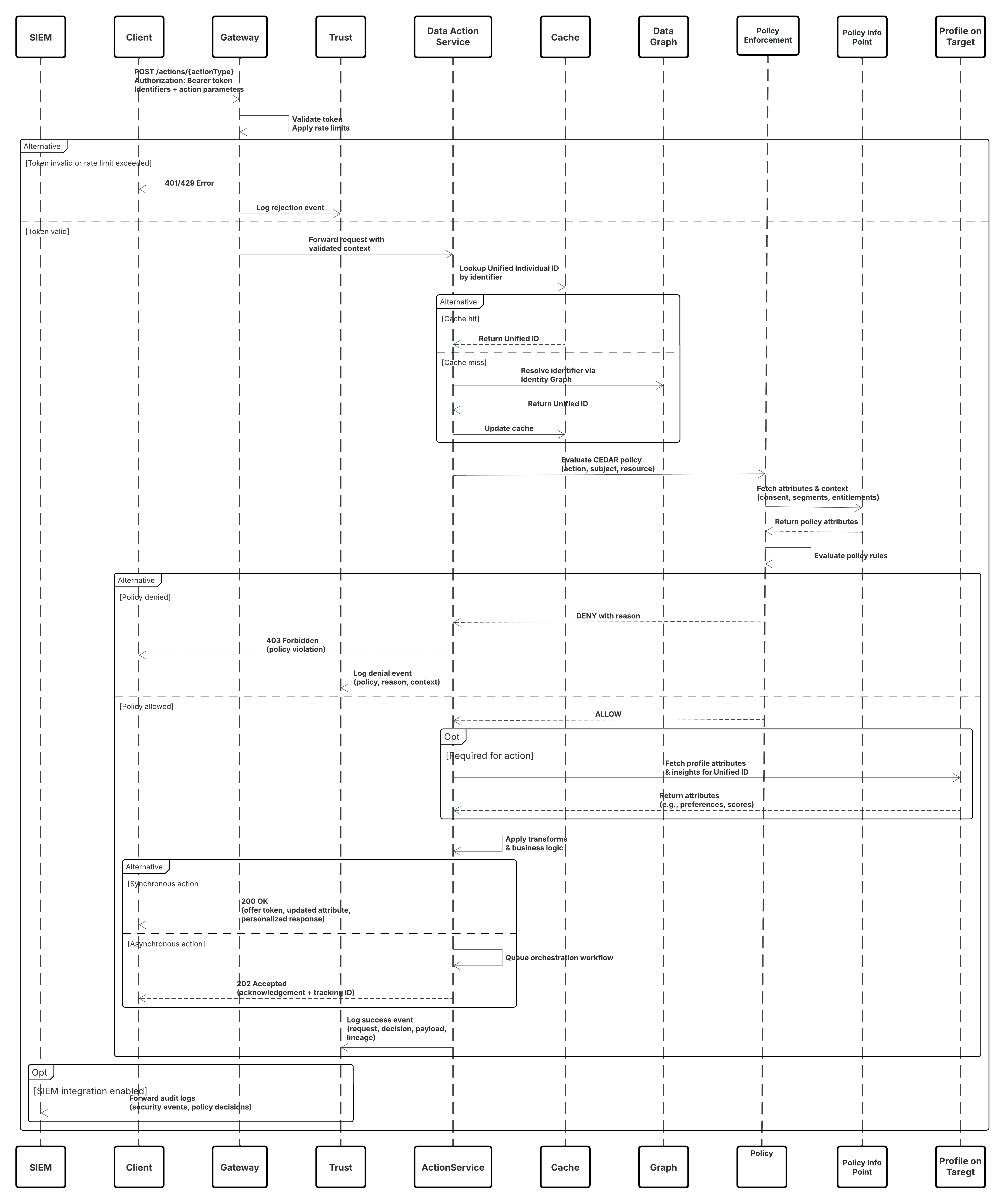

- Schets: Een UML-volgordediagram dat toont hoe de oplossing het scenario aanpakt.

- Resultaten: Legt de details uit van de manier waarop u de oplossing toepast op uw integratiescenario en hoe deze de krachten oplost die aan dat scenario zijn gekoppeld. Deze sectie bevat ook nieuwe uitdagingen die kunnen ontstaan als gevolg van het toepassen van het patroon.

- Sidebars: Aanvullende secties gerelateerd aan het patroon die belangrijke technische problemen, variaties van het patroon, patroonspecifieke problemen, enzovoort bevatten.

- Voorbeeld: Een scenario uit de echte wereld waarin wordt beschreven hoe het ontwerppatroon wordt gebruikt in een Salesforce-scenario uit de echte wereld. In het voorbeeld worden de integratiedoelen uitgelegd en wordt uitgelegd hoe u het patroon implementeert om die doelen te bereiken.

Gebruik deze tabel als inhoudsopgave voor de integratiepatronen in dit document.

| Patroonniveau1 | Patroonniveau2 | Patroon | Secenario |

|---|---|---|---|

| Gegevensopnamepatronen--Inkomende gegevens | Batchgewijze opnamepatronen | Bulkgegevensopname vanuit Cloud Storage | Gegevens worden opgenomen vanuit een Enterprise Cloud-opslagbron zoals Amazon S3, Azure Blob of Google Cloud Storage in Data 360 in de vorm van grote batches ruwe gegevens (bijv. transacties of productlogboeken). |

| Bulkgegevensopname vanuit Salesforce Clouds | Data 360 ontvangt CRM-gegevens in bulk uit meerdere Salesforce-organisaties (bijvoorbeeld Sales Cloud, Service Cloud) om gecombineerde klantprofielen samen te stellen. | ||

| Streaming en realtime opnamepatronen | Eventgestuurde opname via opname-API--Streaming | Data 360 abonneert zich op streaming opname-eindpunten die continue eventpayloads (bijv. aankoopevents, IoT-telemetrie) van ondernemingssystemen ontvangen voor realtime profielupdates. | |

| Realtime opname van web en mobiel gedrag | Data 360 verzamelt en verwerkt realtime gedragsgegevens van websites en mobiele apps via SDK's om betrokkenheidsmeetgegevens en personalisatiemodellen te verrijken. | ||

| Vrijwel realtime CRM-synchronisatie via streaming | Data 360 ontvangt CRM-gegevensupdates (bijv. contactpersoon, case, opportunitywijzigingen) in nearReal-Time via eventstromen om een continu gesynchroniseerde Customer 360 weergave te behouden. | ||

| Opname van eventstromen vanuit Cloud Berichtenplatforms--Kinesis en MSK | Data 360 verbruikt streaminggegevens rechtstreeks van cloudeventplatforms zoals AWS Kinesis of Kafka (MSK) om hoogfrequente operationele of IoT-events te verwerken. | ||

| Nul kopieerpatronen--Inkomend en uitgaand | Inkomende nulkopie--Externe platforms naar Data 360 | Data 360 voert op verzoek een query uit op externe gegevenssets (bijv. Snowflake, BigQuery) via Zero Copy-opname, zonder gegevens fysiek naar Salesforce te verplaatsen. | |

| Uitgaande nulkopie--Data 360 naar externe platforms | Externe systemen zoals Databricks of Tableau hebben toegang tot verrijkte segmenten en insights in Data 360 via uitgaande nulkopieverbindingen zonder gegevensreplicatie. | ||

| Gecombineerd gegevensplatform voor meerdere organisaties met Data Cloud One | Data Cloud One verenigt meerdere Salesforce-organisaties en externe gegevensbronnen onder een gedeeld metagegevens- en semantisch model, waardoor een consistente Customer 360 zonder gegevensduplicatie ontstaat. | ||

| Gegevensactiveringspatronen--Gegevens uitgaand | Batchactiveringspatronen | Segmentactivering naar marketing- en advertentieplatforms | Data 360 activeert beheerde klantsegmenten rechtstreeks in Marketing Cloud, Meta, Google Ads of andere advertentieplatforms voor gepersonaliseerde campagnelevering |

| Gegevens exporteren naar cloudopslag | Data 360 exporteert gecombineerde of gefilterde gegevenssets (bijv. goedgekeurde klantrecords) als CSV- of parketbestanden naar Enterprise Cloud-opslag voor analyse of archivering van naleving. | ||

| Op aanvraag API-gebaseerde activering | Integratie van aangepaste toepassingen via Connect-API | Externe toepassingen roepen de Data 360 Connect-API in realtime aan om gepersonaliseerde acties op te halen of te activeren (bijvoorbeeld controle van loyaliteitssaldo of genereren van AI-aanbod) op basis van huidige klantgegevens.Op maat gemaakte web- of mobiele toepassingen halen geharmoniseerde Data 360-insights veilig op via de Connect REST-API om weer te geven binnen UI's van ondernemingen of partners. | |

| Ophalen van klantprofiel voltooien via Data Graph API | Een systeem haalt het gecombineerde profiel van een klant op met behulp van de Data Graph API, waarbij een vooraf samengevoegde, real-time JSON-weergave van de volledige 360°-weergave wordt geretourneerd voor besluitvorming of personalisering. | ||

| Realtime gegevensacties | Realtime gegevensactie Klantsignalen omzetten in onmiddellijke actie | Data 360 detecteert en verwerkt een live event (bijv. instemmingsupdate, aankooptrigger) en roept onmiddellijk een verbonden systeem of Salesforce-stroom aan voor actie verderop in de stroom.Een signaal van een klantactiviteit (bijv. verlooprisico gedetecteerd) in Data 360 activeert een onmiddellijke real-time actie, zoals het bijwerken van CRM, Einstein Scores aanroepen of een retentietraject starten. |

De integratiepatronen in dit document zijn ingedeeld in drie categorieën: gegevens, proces en visuele integraties.

Gegevensintegratiepatronen in Data 360 hebben betrekking op de verplaatsing en synchronisatie van gegevens tussen systemen om ervoor te zorgen dat zowel Data 360 als externe platforms consistente, tijdige en betrouwbare informatie bevatten. Deze patronen verwerken doorgaans grootschalige gegevensstromen met groot volume en vertrouwen op beheerde pijplijnen die schemaconsistentie, tracering van afstamming en hoofdregels afdwingen.

- Batchopnamepatronen vertegenwoordigen de basislaag van onboarding van ondernemingsgegevens. Met bulkgegevensopname vanuit cloudopslagservices zoals AWS S3, Azure Blob of Google Cloud Storage kunnen grote historische gegevenssets periodiek in Data 360 worden geladen voor identiteitsoplossing, segmentering en analyses. Op soortgelijke wijze gebruikt bulkopname vanuit Salesforce Clouds, zoals Sales, Service of Marketing Cloud, native connectoren en gegevensstromen om CRM-gegevens in de gecombineerde gegevenslaag te brengen, wat harmonisering en continuïteit tussen systemen van betrokkenheid garandeert.

- Streaming en realtime opnamepatronen breiden dit uit door eventgegevens met hoge snelheid vast te leggen. Eventgestuurde opname via de opname-API maakt het voor externe systemen mogelijk om continu klantactiviteit te streamen naar Data 360. Realtime opname van web- en mobiel gedrag legt klikstroom- en interactiegegevens rechtstreeks vanaf digitale aanspreekpunten vast om directe personalisatie te stimuleren. Bijna-realtime CRM-synchronisatie via Streaming-API's zorgt ervoor dat klantkenmerken en instemmingsupdates snel worden weergegeven in alle systemen. Opname van eventstromen vanuit berichtenverkeersplatforms zoals Amazon Kinesis of Confluent MSK ondersteunt continue pijplijnen met hoge doorvoer, waardoor Data 360 wordt afgestemd op eventarchitecturen voor de onderneming.

- Unified Multi-Org Data Platform with Data Cloud One is een voorbeeld van gegevensintegratie en biedt een geconsolideerde omgeving om gegevens uit meerdere Salesforce-organisaties en externe bronnen te combineren onder een gemeenschappelijke governance- en semantische laag. Hierdoor kunnen organisaties consistentie van gegevens voor de hele onderneming, gedeelde gegevensmodellen en schaalbare analyses realiseren.

- In de activeringsfase volgen batchactiveringspatronen hetzelfde gegevensintegratieprincipe. Segmenten die zijn gemodereerd in Data 360, worden in geplande taken geëxporteerd naar marketing- en advertentieplatforms verderop in de stroom—zoals Marketing Cloud, Meta Ads of Google Ads—waar ze campagne-uitvoering activeren. Op soortgelijke wijze kunnen gegevenssets worden geëxporteerd naar cloudopslagdoelen om externe analyses en pijplijnen voor gegevenswetenschappen aan te wakkeren. In al deze gebruikscases fungeert Data 360 als de bron van waarheid voor gesynchroniseerde en beheerde klantgegevens.

Procesintegratiepatronen in Data 360 omvatten het activeren of orkestreren van bedrijfsprocessen binnen systemen in nearReal-Time. Met deze patronen kan Data 360 actief deelnemen aan ondernemingswerkstromen, waardoor contextuele reacties en dynamische gegevensactivering mogelijk worden.

- Op on-demand API gebaseerde activering maakt real-time betrokkenheidsscenario's mogelijk. Via de Connect-API kunnen aangepaste toepassingen rechtstreeks vanuit Data 360 query's uitvoeren op of klantprofielen activeren als onderdeel van operationele processen, zoals een agentconsole die gecombineerde profielinsights ophaalt tijdens een interactie met de klant. De API Klantprofiel ophalen via gegevensgrafiek ondersteunt samengestelde toepassingen en microservices die afhankelijk zijn van API-gestuurde toegang tot de volledige entiteitsgrafiek van een klant, waardoor dynamische omgevingen mogelijk zijn zonder vooraf gefaseerde segmenten.

- Realtime gegevensacties stimuleren deze integratiebenadering door onmiddellijke responsiviteit in te schakelen. Wanneer een klantsignaal—zoals een aankoop, formulierindiening of drempelwaarde-event—wordt gedetecteerd, kan Data 360 acties activeren zoals het bijwerken van een CRM-record, het aanroepen van een externe webhook of het starten van een werkstroom voor een gepersonaliseerde aanbieding. Deze patronen belichamen echte procescombinatie, waarbij real-time Klantenintelligence wordt verbonden met geautomatiseerde operationele uitvoering.

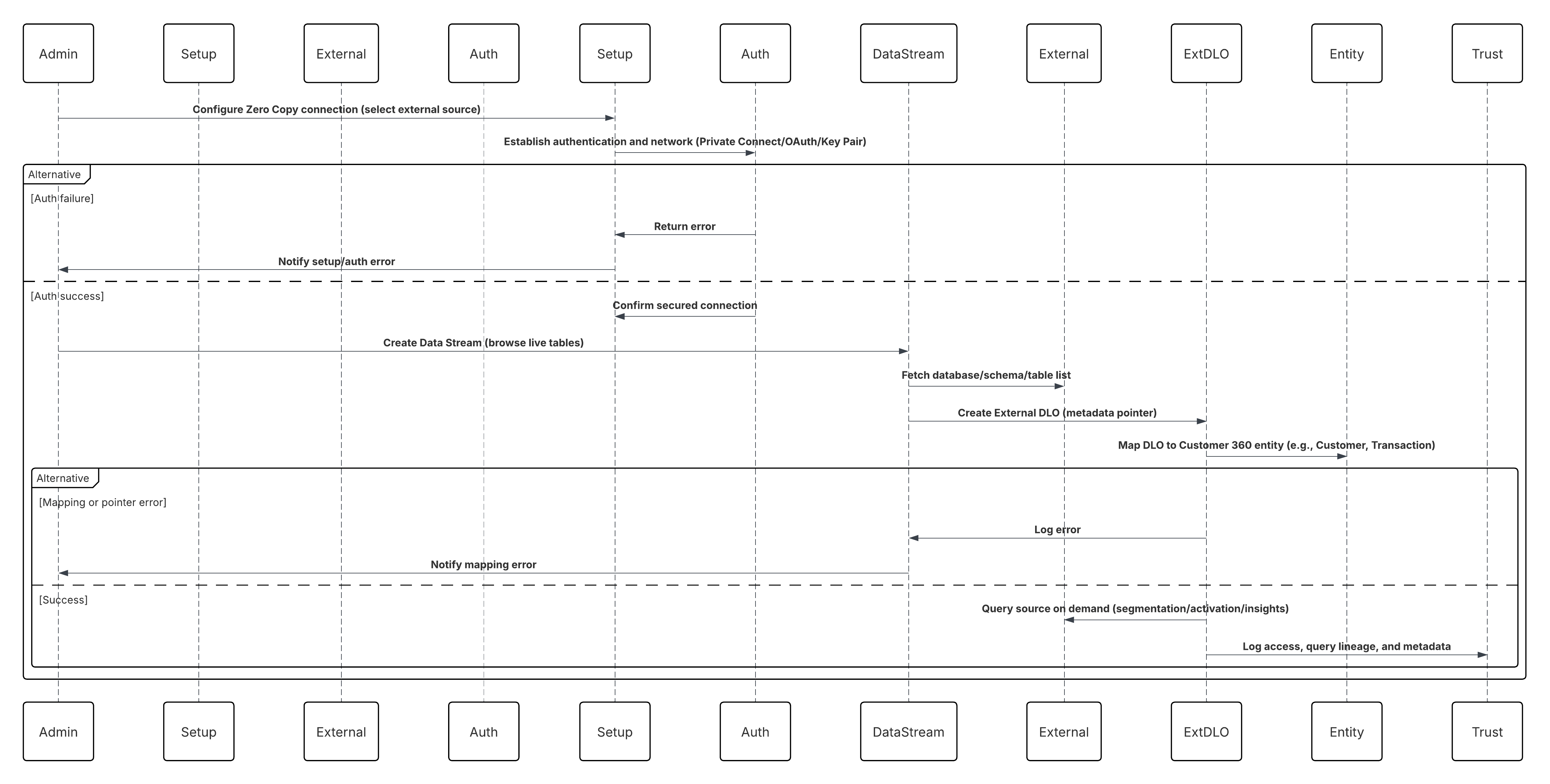

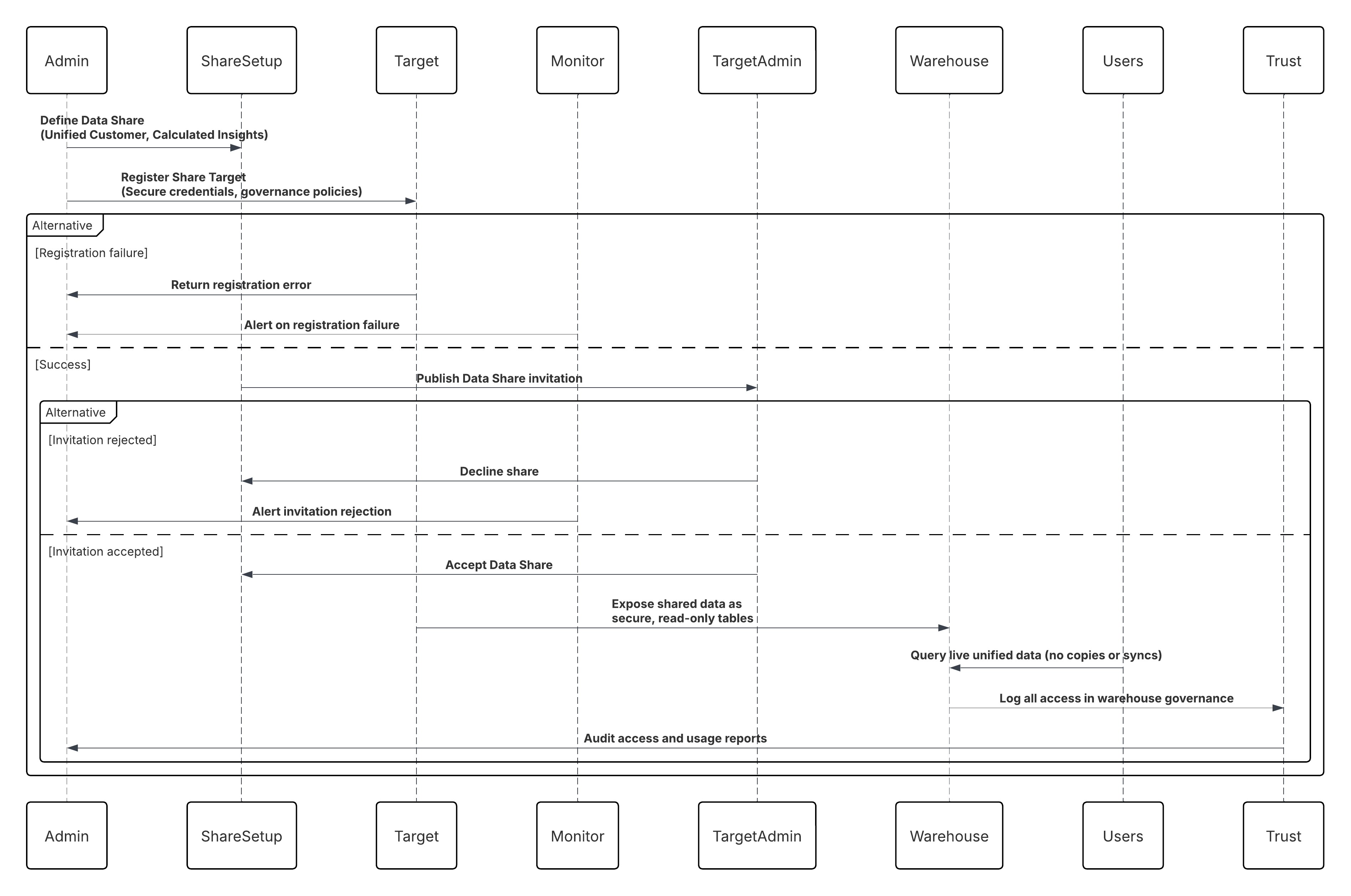

Virtuele integratiepatronen in Data 360 maken live toegang tot externe of gebundelde gegevensbronnen mogelijk zonder gegevens fysiek te kopiëren of dupliceren. Deze zijn van cruciaal belang voor ondernemingen die gecontroleerde, actuele informatie nodig hebben op het moment van de query en tegelijkertijd de gegevensverplaatsing minimaliseren.

- Met Inbound Zero Copy Data Federation (Externe platforms-naar-Data 360) kunnen externe systemen—zoals gegevensmagazijnen of gegevens-lakes—gegevenssets delen met Data 360 via beveiligde, beheerde verbindingen (bijvoorbeeld Snowflake Secure Data Sharing). Dit zorgt ervoor dat Data 360 virtuele toegang heeft tot en kan werken met externe gegevens, waardoor versheid wordt behouden en onnodige replicatie wordt voorkomen.

- Met Outbound Zero Copy Data Sharing (Data 360-naar-externe platforms) kan Data 360 beheerde gegevenssets beschikbaar stellen voor extern gebruik, zoals AI-modellering, bedrijfsintelligence of geavanceerde analyses, via beveiligde mechanismen voor gegevensbundeling en live query's. Het kiezen van de beste integratiestrategie voor uw systeem is niet triviaal. Er zijn vele aspecten om rekening mee te houden en vele tools die kunnen worden gebruikt, waarbij sommige tools geschikter zijn dan andere voor bepaalde taken. Elk patroon behandelt specifieke kritieke gebieden, waaronder de mogelijkheden van elk van de systemen, het volume van gegevens, de afhandeling van storingen en transactionaliteit.

Wanneer u een integratiepatroon selecteert, begint u met het beantwoorden van twee fundamentele vragen die het algemene ontwerp en de werking van de integratie bepalen. Wat integreert u? — Proces, Gegevens of Virtuele toegang Deze dimensie definieert het primaire doel van de integratie.

- Procesintegraties richten zich op het orkestreren van bedrijfswerkstromen en het coördineren van acties binnen systemen.

- Gegevensintegraties richten zich op het synchroniseren, verrijken of verspreiden van gegevens tussen systemen.

- Virtuele integraties richten zich op toegang tot externe gegevens in Realtime zonder deze te kopiëren of te bewaren in Salesforce of Data 360. Inzicht in deze intent helpt bij het bepalen van het niveau van doeltreffende combinatie, gegevensverplaatsing en koppeling tussen systemen.

- Hoe moet deze worden uitgevoerd? — Synchrone of asynchrone methode definieert het uitvoeringsmodel van de integratie.

- Synchrone integraties zijn real-time en blokkerend, waarbij de beller een onmiddellijke reactie verwacht—veelal gebruikt voor door de gebruiker gestuurde of validatiescenario's.

- Asynchrone integraties zijn niet-blokkerend en ontkoppeld, ontworpen voor het afhandelen van schaal, langlopende processen, opnieuw proberen en grote gegevensvolumes. Samen vormen deze twee dimensies – integratie-intent en uitvoeringstijdstip – een duidelijk, consistent raamwerk voor het selecteren van het juiste integratiepatroon, waarbij een evenwicht wordt gevonden tussen gebruikerservaring, schaalbaarheid en operationele veerkracht. Opmerking: Een integratie kan een externe middleware- of integratieoplossing (bijvoorbeeld Enterprise Service Bus) vereisen, afhankelijk van welke aspecten van toepassing zijn op uw integratiescenario.

Deze tabel vermeldt de patronen en hun belangrijkste aspecten om u te helpen bepalen welk patroon het beste aansluit op uw vereisten wanneer uw integratie plaatsvindt van Salesforce naar een ander systeem

| Type | Timing | Uitgaande overwegingen |

|---|---|---|

| Gegevensintegratie | Asynchronous | Segmentactivering naar marketing- en advertentieplatforms |

| Proces-/gegevensintegratie | Synchroon | Integratie van aangepaste toepassingen via Connect-API Ophalen van klantprofiel voltooien via Data Graph API |

| Gegevensintegratie | Synchroon | Realtime gegevensactie Klantsignalen omzetten in onmiddellijke actie |

| Virtuele integratie (met behulp van Zero Copy) | Asynchronous | Uitgaande nulkopie--Data 360 naar externe platforms |

| Virtuele integratie | Asynchronous | Gecombineerd gegevensplatform voor meerdere organisaties met Data Cloud One |

Deze tabel vermeldt de patronen en hun belangrijkste aspecten om u te helpen het patroon te bepalen dat het beste aansluit op uw vereisten wanneer uw integratie plaatsvindt vanuit een ander systeem naar Salesforce.

| Type | Timing | Inkomende overwegingen |

|---|---|---|

| Gegevensintegratie | Asynchronous | Bulkgegevensopname vanuit Cloud Storage Bulkgegevensopname vanuit Salesforce Clouds |

| Gegevensintegratie | Asynchronous | Opname van eventstromen vanuit Cloud Berichtenplatforms--Kinesis en MSK Vrijwel realtime CRM-synchronisatie via streaming |

| Procesintegratie | Synchroon | Eventgestuurde opname via opname-API--Streaming Realtime opname van web en mobiel gedrag |

| Virtuele integratie | Asynchronous | Inkomende nulkopie--Externe platforms naar Data 360 |

Deze tabel vermeldt enkele belangrijke termen die zijn gerelateerd aan middleware en hun definities met betrekking tot deze patronen.

| Term | Definitie |

|---|---|

| Afhandeling van events | Eventafhandeling verwijst naar het ontvangen, routeren en reageren op identificeerbare voorvallen vanuit een bronsysteem of toepassing. Middleware verwerkt events door het doeleindpunt te identificeren, de event door te sturen en de vereiste bedrijfsactie te activeren (bijvoorbeeld vastleggen, opnieuw proberen of downstream services activeren). In Data 360-architecturen is eventverwerking van cruciaal belang voor het opnemen van realtime gegevens, activeringstriggers en publicatie-/abonneerpatronen. Events kunnen afkomstig zijn van externe systemen (Kafka, AWS Kinesis) of Salesforce Platform-events en worden gerouteerd door middleware of de Data 360-eventbus voor onmiddellijke verwerking. |

| Protocolconversie | Protocolconversie maakt communicatie mogelijk tussen systemen die verschillende standaarden voor gegevenstransport gebruiken. Middleware vertaalt gepatenteerde of verouderde protocollen (zoals AMQP, MQTT, FTP) naar ondersteunde Data 360-protocollen (REST, gRPC of HTTPS). Dit garandeert interoperabiliteit tussen heterogene systemen. Aangezien Data 360 geen eigen protocolconversie afhandelt, biedt middleware de aanpassingslaag, die berichten inkapselt of transformeert in een indeling die Data 360-API's en -connectoren kunnen interpreteren. |

| Vertaling en transformatie | Vertaling en transformatie zorgen voor interoperabiliteit door de ene gegevensindeling of het ene schema toe te wijzen aan de andere. Middleware voert deze transformaties uit om diverse gegevenspayloads (CSV, XML, JSON) uit te lijnen met Data 360-gegevensmodelobjecten (DMO's) en gecombineerde gegevenslaagobjecten (UDLO's). Dit omvat het reinigen, verrijken en toepassen van semantische of op ontologie gebaseerde toewijzing vóór opname. Salesforce biedt transformatietools zoals Gegevensvoorbereiding-recepten, maar complexe transformaties (met name voor semantische harmonisering) kunnen het best worden afgehandeld in middleware. |

| Wachtrij en bufferen | Wachtrijen en bufferen vertrouwen op het doorgeven van asynchrone berichten om veerkrachtige, ontkoppelde communicatie te garanderen. Middlewareplatforms (bijvoorbeeld MuleSoft, Kafka of Azure Event Hub) bieden aanhoudende wachtrijen waarin gegevens tijdelijk worden opgeslagen wanneer Data 360 of downstreamsystemen bezet of onbereikbaar zijn. Dit voorkomt gegevensverlies en ondersteunt opname- of activeringspogingen in vrijwel realtime. Data 360 ondersteunt streamingopname en op stroom gebaseerd uitgaand berichtenverkeer, maar duurzame wachtrijen en gegarandeerde levering worden doorgaans afgehandeld door middleware. |

| Synchrone transportprotocollen | Synchrone transportprotocollen omvatten blokkering en realtime verzoek-/reactiebewerkingen. De afzender wacht op een antwoord voordat deze doorgaat. In Data 360 worden deze gebruikt voor op on-demand API gebaseerde activeringen, real-time verrijking of profielzoekopdrachten, waarbij onmiddellijk moet worden gereageerd. Middleware zorgt voor betrouwbaarheid van de verbinding en beheert nieuwe pogingen of reserveverwerking voor synchrone Data 360 API-aanroepen. |

| Asynchrone transportprotocollen | Asynchrone transportprotocollen ondersteunen niet-blokkerende, ontkoppelde communicatie waarbij de afzender doorgaat met de verwerking zonder te hoeven wachten op een reactie. Middleware verwerkt asynchrone stromen voor batchactiveringen, streamingopname en eventgestuurde activering. Dit maakt een hoge doorvoer en veerkracht mogelijk — essentieel voor eventstreaming en vrijwel realtime gegevensopnamepatronen in Data 360. |

| Routering voor bemiddeling | Bemiddelingsroutering definieert een complexe berichtenstroom tussen systemen en zorgt ervoor dat de juiste gegevens of events de juiste consument bereiken. Middleware treedt op als bemiddelaar en handelt routeringslogica af op basis van regels, kopteksten, inhoud of eventtype. In Data 360-integraties zorgt bemiddeling ervoor dat events en profielupdates van meerdere systemen op de juiste manier worden gerouteerd naar gegevensopname-API's, activeringseindpunten of externe consumenten. Dit vereenvoudigt doeltreffende combinatie en ondersteunt gegevenssynchronisatie voor meerdere systemen. |

| Proceschoreografie en servicecombinatie | Proceschoreografie en doeltreffende combinatie coördineren processen van meerdere systemen. Choreografie ondersteunt autonome, asynchrone eventgestuurde stromen, waarbij systemen werken op basis van gedeelde regels zonder een centrale controller. Orchestration is een centraal beheerde stroom die de uitvoering van de service stuurt. In Data 360-architecturen beheert middleware doeltreffende combinaties voor opname en activering binnen systemen, terwijl Salesforce-werkstromen of stromen lichtgewicht choreografieën afhandelen binnen het platform. Complexe doeltreffende combinatie, die transactiecoördinatie of statusbeheer vereist, wordt aanbevolen in de middlewarelaag. |

| Transactionaliteit (encryptie, ondertekening, betrouwbare levering, transactiebeheer) | Transactionaliteit garandeert atomaire, consistente, geïsoleerde en duurzame (ACID) bewerkingen binnen systemen. Salesforce en Data 360 zijn transactioneel binnen hun grenzen, maar ondersteunen geen gedistribueerde transacties binnen externe systemen. Middleware verwerkt globale transactiecontrole, inclusief encryptie, ondertekening van berichten, terugdraaien, compensatie en betrouwbare levering. Voor bedrijfskritieke gegevensstromen (bijvoorbeeld financiële updates of updates van instemming) zorgt middleware voor end-to-end integriteit en herstel binnen Data 360 en externe systemen. |

| Routering | Routering geeft de gecontroleerde stroom van berichten of gegevens tussen componenten aan. Dit kan zijn gebaseerd op kopteksten, inhoudstype, prioriteit of regels. Middleware verwerkt routeringslogica voor events en activeringen waarbij Data 360 betrokken is, zoals het omleiden van verrijkte doelgroepsegmenten naar verschillende downstream systemen (advertentieplatforms, magazijnen, CRM-apps). Hoewel routering kan worden geïmplementeerd binnen Salesforce (Apex, Stromen), heeft middlewareroutering de voorkeur vanwege schaalbaarheid, flexibiliteit en governance. |

| Extraheren, transformeren en laden (ETL) | ETL omvat het extraheren van gegevens uit bronsystemen, het transformeren ervan in een consistent schema en het laden ervan in een doel (zoals Data 360). Middleware- of ETL-tools verwerken deze bewerkingen vóór gegevensopname. Data 360 kan ETL-uitvoer ontvangen via API's, connectoren of bulkopnamepijplijnen, en ondersteunt ook Change Gegevensvastlegging (CDC) voor vrijwel realtime synchronisatie. Middleware-ETL-processen zijn essentieel voor het integreren van verouderde systemen en het waarborgen van de gegevenskwaliteit vóór het combineren in Data 360. |

| Lange polling | Long polling (Comet-programmering) is een methode voor het onderhouden van open communicatie tussen systemen voor real-time updates. De client verzendt een verzoek en de server houdt dit vast totdat er een event optreedt, reageert vervolgens en opent opnieuw een nieuwe verbinding. Salesforce gebruikt dit in de Streaming API- en CometD/Bayeux-protocollen voor eventgestuurde gegevenssynchronisatie. Middleware kan zich abonneren op deze events en deze doorsturen naar Data 360 voor realtime opname- of activeringstriggers, wat zorgt voor een minimale latentie in alle bedrijfssystemen. |

Gegevensopname is de eerste en meest kritieke stap in de gegevenslevenscyclus van Salesforce Data 360. Ruwe informatie uit meerdere externe systemen (CRM, ERP, web, mobiel of externe API's) komt zo het platform binnen en wordt onderdeel van een uniforme klantenweergave. Het juiste opnamepatroon is afhankelijk van wat het bedrijf nodig heeft:

- Gegevensvolume: hoeveel gegevens er tegelijk worden verplaatst

- Latency: hoe vers de gegevens moeten zijn

- Bronsysteemmogelijkheden: hoe het systeem gegevens kan verbinden en leveren Data 360 ondersteunt meerdere opnamemodi om aan deze behoeften te voldoen: batchgewijs laden van grote volumes, streaming voor vrijwel realtime updates, op event gebaseerd voor onmiddellijke transactie en opname met nul kopiëren voor onmiddellijke toegang tot externe gegevens zonder deze fysiek te verplaatsen. Samen zorgen deze patronen ervoor dat elk klantsignaal—of het nu een aankoopevent, een klikstroomlogboek of een loyaliteitsupdate is—efficiënt, veilig en binnen het juiste tijdsbestek Data 360 binnenstroomt om vertrouwde analyses en AI-gestuurde omgevingen te stimuleren.

Batchgewijze opnamepatronen vormen de ruggengraat van grootschalige gegevensonboarding in Data 360. Ze zijn geoptimaliseerd voor scenario's waarin gegevens in bulk worden verwerkt—doorgaans op geplande of periodieke basis—in plaats van continu. Deze patronen zijn het meest geschikt voor:

- Historische gegevens laden om het platform te initialiseren met bestaande ondernemingsrecords

- Regelmatige synchronisatie met recordsystemen zoals ERP's, gegevensmagazijnen of eigen databases

- Gebruikscases waarin realtime versheid niet kritiek is, maar consistentie, volledigheid en controleerbaarheid wel belangrijk zijn Batchopname biedt voorspelbare prestaties en operationele eenvoud, waardoor het een vertrouwde keuze is voor ondernemingen die terabytes aan gestructureerde of semigestructureerde gegevens beheren. Data 360 biedt een set productieklare, algemeen beschikbare connectoren die batchgewijs opnemen ondersteunen. Deze connectoren stroomlijnen de set-up van integratie, reduceren de ontwikkeling van aangepaste ETL en zorgen voor gegevenskwaliteit en beveiliging bij elke import. De onderstaande tabel markeert de meest gebruikte connectoren voor batchopname op ondernemingsniveau.

Context

Dit patroon is ontworpen voor ondernemingsscenario's die betrekking hebben op het opnemen van grote volumes gestructureerde gegevens—zoals CSV- of parketbestanden—en ongestructureerde activa uit gecentraliseerde gegevens-lakes of geplande bestandsdrops. Gegevensbronnen omvatten doorgaans cloudopslagplatforms zoals Amazon S3, Google Cloud Storage (GCS) en Microsoft Azure Blob Storage, waarbij bestanden periodiek worden geleverd als onderdeel van upstream gegevenspijplijnen of batchexports.

Probleem

Hoe kan een organisatie een betrouwbaar, veilig en high-throughput proces opzetten voor het opnemen van enorme, op bestanden gebaseerde gegevenssets vanuit haar primaire cloudopslagplatform in Data 360 volgens een voorspelbare, terugkerende planning—zonder in te boeten op governance, schaalbaarheid of prestaties?

Krachten

Het opnemen van enorme, op bestanden gebaseerde gegevenssets in Data 360 is geen eenvoudige oefening voor gegevensoverdracht — het is een architectonische uitdaging die wordt bepaald door schaal, governance en platformbeperkingen.

Gegevensvolume en schaal: Data 360-opnameconnectoren zijn geoptimaliseerd voor betrouwbaarheid en governance, niet voor willekeurige bulkdoorvoer. Zo ondersteunt de Amazon S3-connector maximaal 100 miljoen rijen of 50 GB per object, afhankelijk van welke limiet het eerst wordt bereikt. Voor ondernemingen met historische gegevenssets die miljarden records bevatten, wordt deze grens een belangrijke ontwerpbeperking. Een benadering met één bestand, lift-and-shift, wordt al snel onhaalbaar en vereist intelligente gegevenspartitionering, blokken en doeltreffende combinatiestrategieën om schaalbaarheid te bereiken zonder connectorlimieten te bereiken.

Definitie en onderhoud van schema's: Data 360 vereist expliciete schemadefinities voor elke opnamepijplijn om semantische en structurele integriteit te waarborgen. In het geval van S3-opname moet een csv-bestand kolomkoppen en één representatieve gegevensrij definiëren. Dit bestand fungeert als het canonieke contract tussen het bronsysteem, d.w.z. cloudopslag en Data 360. Elke verkeerde uitlijning – in veldnamen, gegevenstypen of codering – kan leiden tot opnamefouten of stille gegevensbeschadiging. Het onderhouden van dit schemabestand in versiebeheer en het afdwingen van validatie via CI/CD- of gegevens-governancewerkstromen wordt een best practice voor productieomgevingen.

Strikte naamgevingsconventies: Data 360 dwingt strikte object- en veldnaamregels af om consistentie in de metagegevensgrafiek te behouden.

- Objectnamen moeten beginnen met een letter en mogen alleen letters, cijfers of onderstrepingstekens bevatten.

- Veldnamen moeten dezelfde patronen volgen. Bestanden die deze conventies schenden — bijvoorbeeld velden met spaties, speciale lettertekens of niet-ondersteunde symbolen — mislukken schemavalidatie tijdens opname. Ondernemingen moeten pre-opnameprocessen voor gegevenshygiëne implementeren om inkomende bestandsstructuren te zuiveren en normaliseren.

Authenticatie- en beveiligingshouding: Elke verbinding met externe opslag moet voldoen aan beveiligings- en nalevingsnormen van ondernemingsniveau.

- Authenticatie wordt doorgaans afgehandeld via AWS Access/Secret Keys of IdP-authenticatie (Federated Identity Provider).

- IAM-rollen moeten zo worden ingesteld dat ze de minste rechten hebben en alleen leestoegang tot de opgegeven opslagpaden toestaan.

- Voor veilige toegang moeten uitgaande IP-adressen rechtstreeks worden toegevoegd aan de goedgekeurde lijst van het bronsysteem. Deze gelaagde besturingselementen zorgen ervoor dat elke bestandsoverdracht binnen een Trustloze, controleerbare perimeter werkt, waarbij naleving van de onderneming in evenwicht is met de flexibiliteit die vereist is voor grootschalige opname.

Oplossing

Deze tabel bevat oplossingen voor dit integratieprobleem.

| Oplossing | Passen | Opmerkingen |

|---|---|---|

| Native Cloud Storage-connectoren gebruiken (Amazon S3, Google Cloud Storage, Azure Blob Storage) | Beste | Dit is het aanbevolen en meest betrouwbare patroon voor grootschalige, terugkerende op bestanden gebaseerde opname in Data 360\. Oorspronkelijke connectoren bieden beheerde authenticatie, schematoewijzing en beveiligde gegevensverplaatsing rechtstreeks naar Data Lake Objects (DLO's) van Data 360. Ideaal voor geplande batchladingen waarbij latentie niet kritiek is (bijvoorbeeld per uur of dagelijks plannen). |

| Omgaan met grote gegevenssets (voorbij connectorlimieten) | Beste met Voorverwerking | Elke connector dwingt opnamelimieten af (bijvoorbeeld S3: 100M rijen of 50 GB per object). Implementeer voor grotere gegevenssets een ETL-voorverwerkingsstap om gegevens te partitioneren in kleinere bestanden/mappen die onder deze drempelwaarden vallen. Configureer vervolgens meerdere gegevensstromen om elke partitie parallel op te nemen en gebruik het append-knooppunt in een batchgegevenstransformatie) binnen Data 360 om de partities opnieuw te combineren tot een gecombineerde gegevensset. |

| Beveiliging en governance | Beste | Alle connectoren ondersteunen veilige authenticatie via cloud-native methoden (IAM-rollen, serviceaccounts of toegangssleutels). Voor extra controle beperkt u toegang tot Data 360 IP-bereiken via de goedgekeurde lijst van de cloudprovider. Gegevensoverdracht vindt plaats via versleutelde kanalen, waarbij bestanden tijdens opname worden opgeslagen in een tijdelijke, veilige faseringslaag. |

| Wanneer niet te gebruiken | Suboptimal | Dit patroon is niet optimaal voor:

|

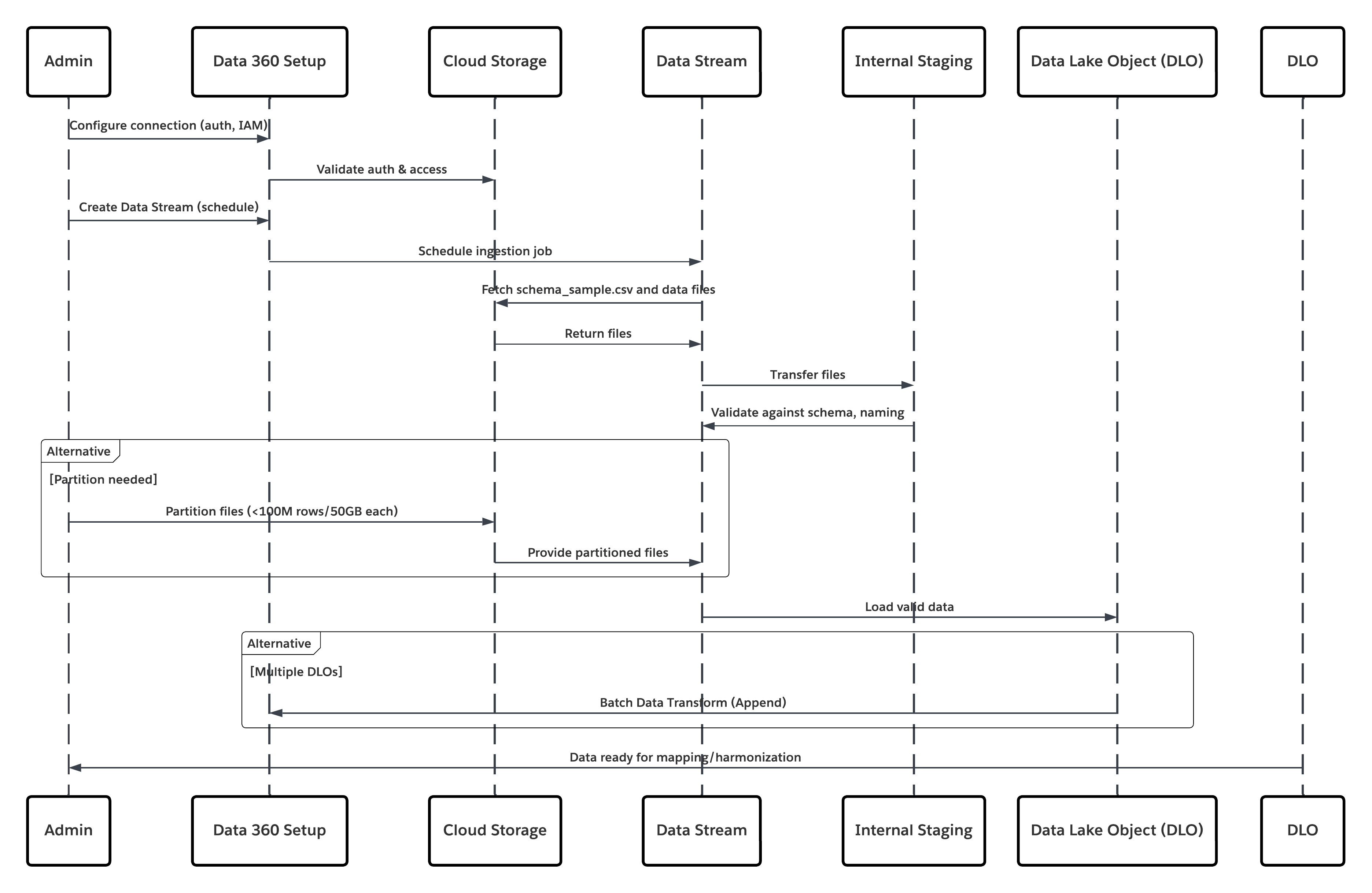

Schets

Dit diagram illustreert de volgorde van stappen voor het opnemen van de gegevens vanuit cloudopslag in Data 360

In dit scenario:

- Beheerder configureert een verbinding met cloudopslag via de Set-upinterface van Data 360 (authenticatie, bucketdetails, IAM-rollen en whitelisting opgeven).

- De Set-upinterface van Data Cloud wordt geverifieerd met het Cloud Storage Platform, waarbij inloggegevens en toegang worden geverifieerd.

- De beheerder maakt een gegevensstroom in Data 360, koppelt de gegevensstroom aan het object/de map in Cloud Storage en definieert het opnameschema.

- Bij planningstrigger vraagt de gegevensstroom bronbestanden (bijv. CSV, Parket) aan vanuit het Cloud Storage Platform.

- Cloud Storage Platform levert bestanden, inclusief de vereiste geldige schema_sample.csv en andere gegevensbestanden die voldoen aan naamgevingsconventies.

- Gegevensstroom draagt bestanden over naar de interne faseringsomgeving binnen Data 360.

- Data 360 Pipeline verwerkt de bestanden: Gebruikt de schemadefinitie uit schema_sample.csv Valideert structuur, veldnamen en verdeelt de belasting indien boven de opnamedrempelwaarden (100 miljoen rijen/50 GB per bestand). Als er grote bestanden worden gedetecteerd, wordt er extern een partitioneringsstap voor de verwerking uitgevoerd (kennisgeving aan de beheerder voor de volgende uitvoering).

- Records worden geïmporteerd vanuit fasering in een gegevens-lakeobject (Data Lake Object, DLO).

- Indien vereist en gegevens zijn gepartitioneerd, gebruikt u het append-knooppunt in een batch gegevenstransformatie om meerdere DLO's te combineren.

- Data 360 registreert succes/mislukt, werkt de status bij voor bewaking en signaleert dat gegevens gereed zijn voor toewijzing, harmonisering en samenvoeging.

Resultaten

De toepassing van dit patroon maakt veilige, geplande en grootschalige opname van gestructureerde of ongestructureerde bestanden vanuit Enterprise Cloud Storage Platforms in Data 360 mogelijk. Het proces is geautomatiseerd, schaalbaar en veerkrachtig en levert ruwe gegevens in gegevens-lakeobjecten (Data Lake Objects, DLO's) die de basis vormen voor harmonisering en toewijzing aan het Customer 360 Data Model.

Opnamemechanismen

Het opnamemechanisme is afhankelijk van de connector en planningsstrategie die zijn gedefinieerd binnen Data 360.

| Opnamemechanisme | Beschrijving |

|---|---|

| Native Cloud Storage-connector (Amazon S3, GCS, Azure) | Aanbevolen voor directe opname van bestanden in CSV- of parketindeling vanuit het cloud-gegevens-lake van de onderneming. Deze connectoren ondersteunen incrementele en volledige vernieuwingsschema's. Zo kan een bank een dagelijkse synchronisatie configureren van transactiebestanden van klanten vanuit een S3-bucket naar een DLO. |

| Strategie voor gepartitioneerde bestanden | Voor zeer grote gegevenssets (meer dan 100 miljoen rijen of 50 GB per object) worden de gegevens gepartitioneerd in kleinere logische sets (bijvoorbeeld op maand of regio). Elke partitie wordt beheerd als een afzonderlijke gegevensstroom en later opnieuw gecombineerd met behulp van een batch gegevenstransformatie met een knooppunt Toevoegen. |

| Geautomatiseerde geplande synchronisatie | Data 360 biedt een declaratieve planner (per uur, dagelijks of aangepaste cadans) die opnametaken automatisch activeert, waardoor gegevens vers blijven zonder handmatige tussenkomst. |

Afhandeling en herstel van fouten

Afhandeling en herstel van fouten zijn van cruciaal belang om betrouwbaarheid te garanderen bij opnamebewerkingen met groot volume.

- Foutopsporing: Elke uitvoering van Gegevensstroom registreert opnamefouten (bijv. schemafouten, bestandsbeschadiging of naamsschendingen) in Data 360 Monitoring. Beheerders kunnen mislukte batches beoordelen en opnieuw verwerken.

- Herstelmechanisme: Data 360 handhaaft controlepunten om ervoor te zorgen dat mislukte batches eerdere opnames niet beschadigen. Opnieuw proberen kan worden geconfigureerd na het corrigeren van bronproblemen (bijv. CSV's met onjuiste notatie).

- Schemavalidatie: Het bestand schema_sample.csv definieert gegevenstypen en -structuur. Elke wijziging activeert validatie om stille schemadrift tussen uitvoeringen te voorkomen.

Overwegingen bij impotent ontwerp

Opname is idempotent van opzet — het opnieuw verwerken van hetzelfde bestand resulteert niet in duplicaatrecords. Belangrijke strategieën omvatten:

- Bestandsvingerafdrukken: Data 360 berekent controlesommen om eerder verwerkte bestanden te identificeren en over te slaan.

- Transactionele opname: Gegevens worden gefaseerd en alleen naar het DLO gecommit bij een succesvolle verwerking van alle records.

- Toevoegen vs. Vervangen: Afhankelijk van de bedrijfslogica kunnen stromen worden toegevoegd aan het doel-DLO of dit volledig vervangen; dit garandeert deterministische uitkomsten en voorkomt gedeeltelijke overlapping van gegevens.

Beveiligingsoverwegingen

Beveiliging is een integraal onderdeel van de opnamepijplijn, van authenticatie tot encryptie en toegangscontrole.

- Authenticatie en autorisatie: Connectoren gebruiken het Secure Integration Framework van Salesforce, waarbij Benoemde inloggegevens en Externe inloggegevens worden gebruikt voor authenticatie zonder geheimen openbaar te maken.

- Encryptie: Gegevens worden versleuteld onderweg (TLS 1.2+) en in ruste (AES-256).

- Netwerkbesturingselementen: Bronopslagsystemen (bijvoorbeeld S3-buckets) moeten Data 360-IP's op een goedgekeurde lijst zetten.

- Uitlijning van naleving: Ondersteunt frameworks voor gegevensbescherming voor ondernemingen zoals AVG, HIPAA en FFIEC-richtlijnen indien gekoppeld aan Customer-Managed Keys (CMK).

- Controleerbaarheid: Elke opnametaak en toegang tot inloggegevens wordt vastgelegd voor traceerbaarheid en nalevingsrapportage.

Sidebars

Tijdigheid

Tijdigheid is afhankelijk van het opnameschema en het gegevensvolume.

- Grote ondernemingsgegevenssets (100M+ rijen) vereisen mogelijk partitionering voor parallelle opname.

- Typische opnamelatentie varieert van minuten tot enkele uren, afhankelijk van de bestandsgrootte en de complexiteit van de transformatie.

- Voor opname in vrijwel realtime kunnen op Data 360 Streaming of API gebaseerde connectoren het op bestanden gebaseerde model aanvullen.

Gegevensvolumes

- Het meest geschikt voor periodieke batches met groot volume.

- Elk object dat wordt verwerkt via de S3-connector ondersteunt maximaal 100 miljoen rijen of 50 GB per bestand.

- Gebruik voor systemen op petabyteschaal gegevenspartitionering en doeltreffende combinatie van meerdere stromen.

Ondersteuning voor eindpuntmogelijkheden en standaarden

De mogelijkheden en standaardondersteuning voor het eindpunt zijn afhankelijk van de oplossing die u kiest.

| Type connector | Eindpuntvereisten |

|---|---|

| Amazon S3-connector | S3-bucket met het juiste IAM-beleid en schema\_sample.csv-bestand dat het schema definieert. |

| Google Cloud Storage-connector | Serviceaccountgegevens en toegang tot buckets met uniforme naamgevingsconventies. |

| Azure-opslagconnector | Toegangssleutel of op SAS-tokens gebaseerde authenticatie; blob of mapstructuur moet voldoen aan Data 360-conventies. |

Statusbeheer

Status wordt bijgehouden via Gegevensstromen en het tijdstempel van de laatste geslaagde uitvoering.

- Data 360 handhaaft automatisch synchronisatiestatussen en verschuivingen, waardoor alleen nieuwe of gewijzigde bestanden worden verwerkt bij daaropvolgende uitvoeringen.

- Bij integratie met externe ETL-tools worden unieke bestands-ID's (bijv. UUID's of tijdstempels) aanbevolen om duplicatie te voorkomen.

Complexe integratiescenario's

In geavanceerde ondernemingsarchitecturen kan dit patroon worden geïntegreerd met:

- Middleware-ETL-pijplijnen (bijv. Informatica, MuleSoft): voor het organiseren van pre-verwerking, validatie en bestandspartitionering vóór overdracht aan Data 360.

- AI/ML-werkstromen: verwerkte DLO-gegevens kunnen via DMO worden gepubliceerd om trainingsomgevingen of RAG-indexen te modelleren via Data 360-activeringsdoelen.

- Transactionele systemen: geharmoniseerde DMO's kunnen updates verderop in de stroom activeren in Salesforce CRM of externe systemen via gegevensacties of platformevents.

Voorbeeld

Een wereldwijde financiële instelling slaat klant- en transactiegegevens op in een AWS S3-gegevens-lake, waar 's nachts gepartitioneerde parketbestanden worden gegenereerd per regio (zoals de VS, de EU en APAC). Het team van de gegevensarchitectuur configureert meerdere gegevensstromen in Data 360, elk verbonden met een regionale map, waarbij een gedeeld schema_sample.csv zorgt voor consistente headers en gegevenstypen voor alle partities. Met nachtelijke opnameschema's worden de gegevens automatisch geladen in DLO's, waarna batchgegevenstransformaties alle regionale partities toevoegen aan een gecombineerd Customer_Transactions_DLO. Deze geharmoniseerde gegevensset wordt vervolgens toegewezen aan het Customer 360 gegevensmodel, waardoor analyses verderop in de stroom en AI-activering mogelijk worden. De benadering biedt geautomatiseerde en betrouwbare opname vanuit het bestaande gegevens-lake, dwingt sterke authenticatie en encryptie af die zijn afgestemd op IT-beleid voor de onderneming, en biedt een schaalbare, modulaire basis die toekomstige uitbreiding en schema-evolutie ondersteunt.

Context

Een primaire en kritieke gebruikscase voor Data 360 is het combineren van klantgegevens binnen het Salesforce-ecosysteem. Dit patroon bestrijkt het native opnemen van gegevens van kernplatforms van Salesforce: Sales Cloud en Service Cloud (gezamenlijk Salesforce CRM) en Marketing Cloud Engagement. Bronnen omvatten standaard en aangepaste CRM-objecten (bijv. Account, Contactpersoon, Case, Opportunity) en Marketing Cloud Engagement-gegevensextensies die betrokkenheidsevents, e-mailverzendingen en trackinggegevens bevatten.

Probleem

Hoe kan een organisatie efficiënt en betrouwbaar standaard- en aangepaste CRM-objecten en Marketing Cloud Engagement-gegevensextensies opnemen in Data 360, zodat de gegevens kunnen worden gebruikt voor het samenstellen van gecombineerde klantprofielen (identiteitsoplossing, Customer 360), met behoud van prestaties, governance en minimale onderbreking van bronsystemen?

Krachten

Oorspronkelijke connectoren vereenvoudigen de taak, maar er moeten verschillende operationele en architectonische krachten worden beheerd:

- Uitgebreide bronmachtigingen: Een speciale verbindende gebruiker (integratieaccount) moet de juiste machtigingen voor lezen op object- en veldniveau hebben. Het niet toewijzen van vereiste machtigingensets (bijvoorbeeld een vooraf samengestelde Data 360-connectormachtigingenset) is een veel voorkomende oorzaak van opnamefouten.

- Gegevensvernieuwingsmodi en -kosten: Connectoren ondersteunen volledige en delta/incrementele vernieuwingsmodi. Volledige vernieuwingen zijn zwaarder voor prestaties en kredieten; delta-extracties verminderen de belasting, maar zijn afhankelijk van betrouwbaar bijhouden van wijzigingen in het bronsysteem.

- Aangepast schema en veldtoewijzing: CRM-exemplaren bevatten vaak aangepaste objecten/velden. Nauwkeurige schematoewijzing en afhandeling van aangepaste velden (namen, typen) is vereist om toewijzingsfouten of semantische afwijking te voorkomen.

- Startgegevensbundels vs. Aangepaste toewijzing: Startergegevensbundels versnellen onboarding door het vooraf selecteren van typische objecten/velden, maar sterk aangepaste organisaties hebben specifieke stroomdefinities nodig.

- Doorvoer- en API-limieten: API-limieten voor de bronorganisatie en Marketing Cloud-extractiescores beperken hoe agressief u vernieuwingen kunt plannen.

- Gegevenshygiëne en naamgevingsconventies: Bronveldnamen, null-werking en gegevenstypen moeten vóór opname worden genormaliseerd om problemen met toewijzing verderop in de stroom te voorkomen.

- Beveiliging en minste rechten: De connector vertrouwt op veilige authenticatie en moet rekening houden met IAM-patronen met de minste rechten, controlemogelijkheden en netwerkbesturingselementen.

Oplossing

Deze tabel bevat oplossingen voor dit integratieprobleem.

| Oplossingsgebied | Passen | Opmerkingen / Implementatiedetails |

|---|---|---|

| Oplossing passend | Beste | Gebruik de eigen Salesforce CRM-connector en Marketing Cloud Engagement-connector in Data 360\. Begin met startgegevensbundels voor standaardgebruikscases en versnel onboarding. Gebruik handmatige stroomaanpassing voor op maat gemaakte of domeinspecifieke gegevensmodellen. |

| Omgaan met sterk aangepaste CRM-exemplaren | Beste met Mapping Workshop | Behandel startbundels als baseline en geef een mappingworkshop om het volgende te identificeren: Aangepaste objecten en relaties. Formule- of berekende velden. Beheerde pakketextensies. Voor zware formulevelden berekent u waarden in een pre-fase-ETL of binnen Data 360-transformaties om API-belasting voor bronorganisaties te minimaliseren. |

| Wanneer niet te gebruiken | Suboptimale scenario's | Vermijd dit patroon als: U hebt opname van hoogfrequente of real-time events nodig (gebruik in plaats daarvan Streaming-connectoren, Platform-events of Zero-Copy Federation). De bronorganisatie heeft beperkte API-capaciteit en kan geplande extracties niet aanhouden zonder throttling of wachtrijvertragingen. |

| Beveiliging en governance | Verplichte controles | Principe van minste rechten - Gebruik een speciale integratiegebruiker met minimale leestoegang. Gebruik nooit beheerders voor de hele organisatie. Authenticatie: gebruik OAuth 2.0 en verbonden apps; roteer clientgeheimen regelmatig en bewaak het gebruik van vernieuwingstokens. Audit en traceerbaarheid — Leg alle opnameuitvoeringen, schemawijzigingen en connectorevents vast. Stuur logboeken door naar SIEM of nalevingssystemen voor auditgereedheid. Gegevensclassificatie — Pas persoonsgegevens/PHI-tagging en op kenmerken gebaseerde toegangscontrole (ABAC) toe met behulp van CEDAR-beleidsvormen onmiddellijk na opname om maskering, instemming en naleving verderop in de stroom af te dwingen. |

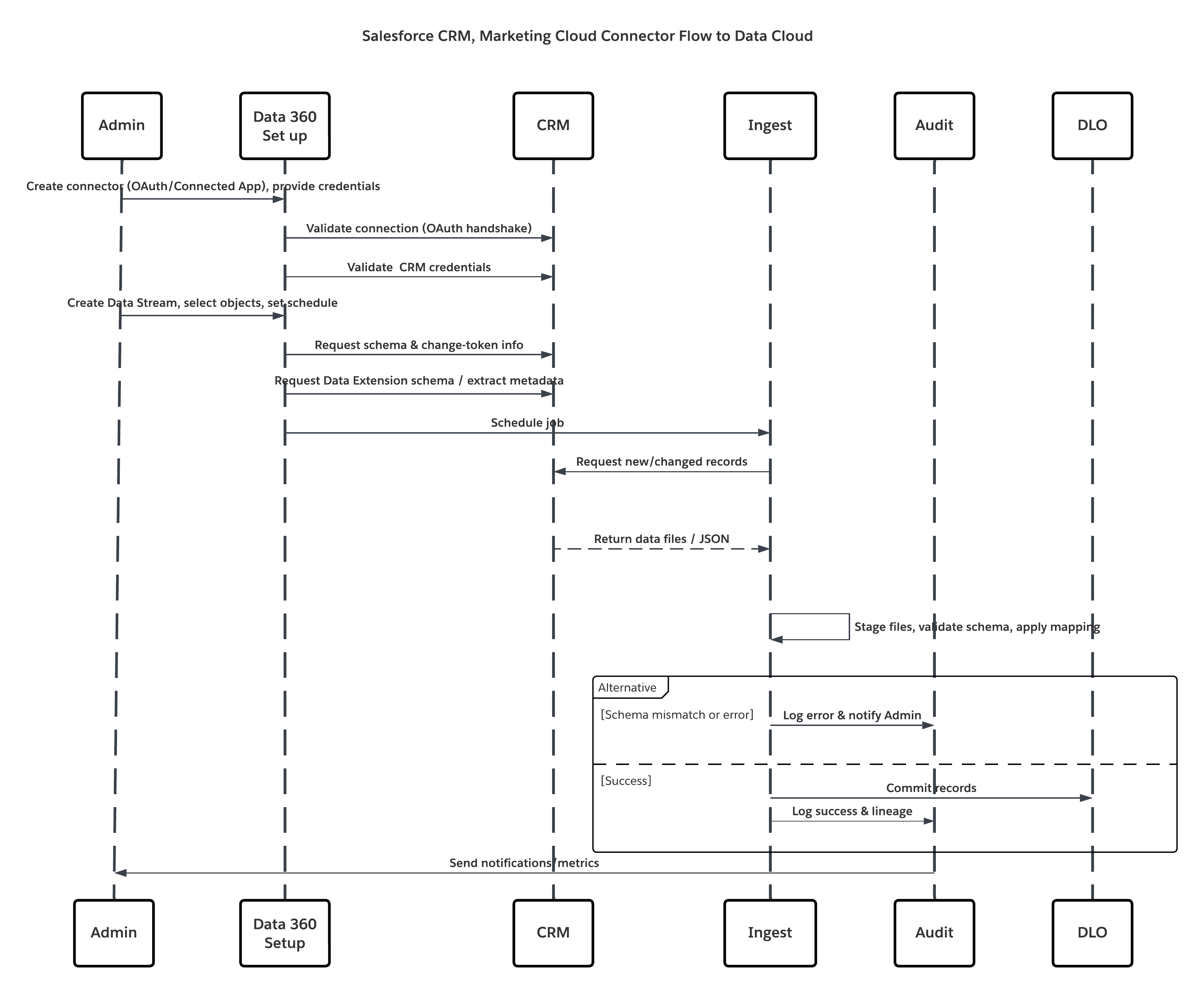

Schets

Dit diagram illustreert de volgorde van stappen voor het opnemen van de gegevens vanuit cloudopslag in Data 360

In dit scenario:

- De beheerder levert integratiegebruikers en wijst connectormachtigingensets toe in bronorganisatie(s).

- Beheerder configureert connectoren in Set-up van Data 360 (maakt verbinding met Salesforce CRM en Marketing Cloud via OAuth/verbonden app).

- De beheerder maakt gegevensstromen door objecten en gegevensextensies te selecteren, kiest voor volledige of deltavernieuwing en stelt planningen in.

- Bij geplande uitvoering vraagt Data 360 schema- en deltatokens aan bij de bron(nen).

- Bronsystemen retourneren records (delta of volledige payload). Marketing Cloud levert mogelijk extracties; CRM retourneert mogelijk JSON-/queryresultaten.

- Data 360 faseert bestanden in het interne beveiligde faseringsgebied en valideert op basis van toegewezen schema's.

- Als validatie mislukt, wordt een fout in het opnamelogboek vastgelegd, wordt de beheerder gewaarschuwd en wordt het vastleggen gestopt. Als de validatie slaagt, verbindt Data 360 records atomisch aan het doel-DLO.

- Bewakings- en auditlogboeken worden bijgewerkt met herkomst, uitvoeringsduur, rijtellingen en inloggegevensgebruik. Waarschuwingen die worden uitgegeven aan beheerders als drempelwaarden of fouten worden geactiveerd.

Resultaten

Kerngegevens over klantrelaties en marketingbetrokkenheid worden opgenomen in Data 360 als gegevens-lakeobjecten (Data Lake Objects, DLO's). Dit levert op:

- Gecombineerde gegevensset met profielen, cases, opportunities en meetgegevens over e-mail/betrokkenheid.

- Stichting voor identiteitsoplossing en constructie van gecombineerde individuele profielen.

- Operationele gereedheid voor harmonisering, verrijking, AI-modellering en activering verderop in de stroom, met behoud van governance en controleerbaarheid.

Opnamemechanismen

Het opnamemechanisme is afhankelijk van de connector en planningsstrategie die zijn gedefinieerd binnen Data 360.

| Mechanisme | Wanneer gebruiken |

|---|---|

| Salesforce CRM-connector (native) | Beste voor standaard/aangepaste CRM-objecten; ondersteunt volledige en deltavernieuwing. |

| Marketing Cloud-betrokkenheidsconnector (native) | Beste voor gegevensextensies, verzenden en bijhouden van extracties; ondersteunt volledige / delta-modi. |

| Startgegevensbundels | Versnel onboarding voor veelvoorkomende objecten voor Verkoop/Service/Marketing. |

| Aangepaste stromen + voorverwerking | Gebruik dit wanneer complexe transformaties of zware schemanormalisatie vereist is. |

Afhandeling en herstel van fouten

Afhandeling en herstel van fouten zijn van cruciaal belang om betrouwbaarheid te garanderen bij opnamebewerkingen met groot volume.

- Per uitvoering logboeken: Elke uitvoering van Gegevensstroom biedt details over slagen/mislukken en fouten op rijniveau.

- Opnieuw proberen en controlepunten: Mislukte uitvoeringen kunnen opnieuw worden geprobeerd na het oplossen van bron- of schemaproblemen; Data 360 gebruikt fasering en atomaire semantiek voor vastleggen.

- Waarschuwingen: Configureer waarschuwingen voor schemaafwijking, herhaalde mislukkingen of hiaten in de deltareeks.

Overwegingen bij impotent ontwerp

Opname is idempotent van opzet — opwerking hetzelfde resulteert niet in duplicaatrecords. Belangrijke strategieën omvatten:

- Wijzigingsdetectie: Delta-extracties vertrouwen op bronsysteemwijzigingsindicatoren (LastModifiedDate / gegevensvastlegging systeemwijziging). Controleer of de bron betrouwbare tijdstempels/vlaggen levert.

- Deduplicatie: Gebruik unieke bedrijfssleutels (bijv. Contact.ExternalId) om DLO's te ontdubbelen of in te voegen.

- Transactionele verbintenis: Records worden gefaseerd en alleen vastgelegd wanneer de batchverwerking met succes is voltooid.

Beveiligingsoverwegingen

Beveiliging is een integraal onderdeel van de opnamepijplijn, van authenticatie tot encryptie en toegangscontrole.

- Authenticatie en autorisatie: Connectoren gebruiken het Secure Integration Framework van Salesforce, waarbij Benoemde inloggegevens en Externe inloggegevens worden gebruikt voor authenticatie zonder geheimen openbaar te maken.

- Encryptie: Gegevens worden versleuteld onderweg (TLS 1.2+) en in ruste (AES-256).

- Netwerkbesturingselementen: Bronopslagsystemen (bijvoorbeeld S3-buckets) moeten Data 360-IP's op een goedgekeurde lijst zetten.

- Uitlijning van naleving: Ondersteunt frameworks voor gegevensbescherming voor ondernemingen zoals AVG, HIPAA en FFIEC-richtlijnen indien gekoppeld aan Customer-Managed Keys (CMK).

- Controleerbaarheid: Elke opnametaak en toegang tot inloggegevens wordt vastgelegd voor traceerbaarheids- en nalevingsrapportage

Sidebars

Tijdigheid

Tijdigheid is afhankelijk van het opnameschema en het gegevensvolume.

- De ideale cadans is afhankelijk van de bedrijfsbehoeften: elk uur voor marketingtriggers in bijna realtime en elke nacht voor grote afstemmingen.

- Delta-modi verlagen de belasting en kosten; volledige vernieuwingen zijn zwaarder en worden gebruikt voor initiële ladingen of grote schemawijzigingen.

Gegevensvolumes

- CRM-connectoren zijn geoptimaliseerd voor transactionele gegevenssets en gegevenssets met gemiddeld volume (miljoenen records).

- Overweeg voor extreem grote historische volumes gefaseerde ETL voor partitioneren en laden in fasen.

Ondersteuning voor eindpuntmogelijkheden en standaarden

De mogelijkheden en standaardondersteuning voor het eindpunt zijn afhankelijk van de oplossing die u kiest.

| Connector | Eindpuntvereisten |

|---|---|

| Salesforce CRM-connector | Bronorganisatie moet een verbonden app, OAuth-tokens en een speciale integratiegebruiker met leesmachtigingen toestaan. |

| Marketing Cloud-connector | Marketing Cloud API-inloggegevens of geïnstalleerd pakket; gegevensextensies moeten gegevens zichtbaar maken via extracties/API. |

Statusbeheer

- Connectorstatus: Gegevensstromen onderhouden laatste geslaagde synchronisatietijdstempels en deltaverschuivingen.

- Hoofdsleutelstrategie: Geef de voorkeur aan consistente bedrijfs-ID's (externe ID's), zodat afstemming verderop in de stroom en upserts deterministisch zijn.

Complexe integratiescenario's

In geavanceerde ondernemingsarchitecturen kan dit patroon worden geïntegreerd met:

- Hybride topologieën: Combineer CRM-opname met streaming (Platform-events) voor vrijwel realtime updates.

- Middleware doeltreffende combinatie: Gebruik MuleSoft- of ETL-tools wanneer complexe doeltreffende combinatie, verrijking of transformatie vooraf vereist is.

- Activeringsfeedbacklussen: Geharmoniseerde DMO's kunnen updates van bronsystemen verderop in de stroom activeren via gegevensacties of platform-API's (voorzichtig met SoD-besturingselementen).

Voorbeeld

Een multinationale detailhandelaar consolideert Accounts, Contactpersonen, Cases, Opportunities en Marketing Cloud-betrokkenheidsmeetgegevens in Data 360 om een uniforme klantweergave te maken. De startgegevensbundel initialiseert de kernobjecten Verkoop en Service, terwijl het team het model uitbreidt met aangepaste velden zoals Loyaliteitslidmaatschapc en Klantniveauc om de loyaliteitscontext vast te leggen. CRM-gegevensstromen worden elk uur uitgevoerd in de deltamodus en Marketing Cloud Engagement synchroniseert dagelijks met behulp van delta-extracties voor betrokkenheidsevents. Deze gegevenssets worden verwerkt via DLO's en identiteitsoplossing, wat resulteert in een gecombineerd klantprofiel dat CRM- en betrokkenheidssignalen combineert om personalisatie en AI-modellen verderop in de stroom aan te sturen.

Deze patronen zijn ontwikkeld voor scenario's waarin milliseconden ertoe doen, wanneer interacties, transacties of signalen van klanten onmiddellijk inzicht of actie moeten activeren. Ze gaan verder dan traditionele, geplande batchopname en schakelen eventgestuurde gegevensstromen in, waarbij informatie wordt verwerkt op het moment dat deze wordt gegenereerd. In het Salesforce Data 360-ecosysteem is "realtime" niet één modus, maar een continuüm van latentiemodellen. Aan de ene kant ligt vrijwel realtime synchronisatie, waarbij updates vanuit recordsystemen (zoals CRM of ERP) binnen enkele seconden of minuten worden weerspiegeld in de Data 360. Aan de andere kant is er het vastleggen van echte realtime events, waarbij gedragssignalen aan de clientzijde, zoals klikken, aankopen of mobiele interacties, worden opgenomen en geactiveerd in milliseconden. Voor architecten is het onderscheid meer dan semantisch. Het definieert hoe pijplijnen worden ontworpen, hoe API's worden aangeroepen en hoe beslissingen verderop in de stroom worden genomen. Het selecteren van het juiste patroon – of het nu gaat om opname via vrijwel realtime synchronisatie of eventstreaming – zorgt ervoor dat het systeem voldoet aan de operationele latentiedoelen van het bedrijf, terwijl de gegevensintegriteit, schaalbaarheid en governance behouden blijven.

Context

Met dit patroon kan elk extern systeem — zoals een aangepaste toepassing, een IoT-platform (Internet-of-Things), een point-of-sale-systeem (POS) of een externe service — eventgegevens programmatisch in Data 360 pushen in vrijwel realtime wanneer afzonderlijke events plaatsvinden.

Probleem

Hoe kan een ontwikkelaar op betrouwbare wijze enkelvoudige records of kleine asynchrone batches events van een externe toepassing naar Data 360 verzenden met een lage latentie, zodat de gegevens snel beschikbaar zijn voor verwerking, segmentering en activering?

Krachten

Dit patroon levert een lage latentie en betere ontwikkelaarscontrole, maar introduceert diverse technische beperkingen en operationele afhankelijkheden:

- Ontwikkelaarsafhankelijkheid: Vereist inspanning van ontwikkelaars voor het implementeren van geauthenticeerde REST API-clients en fout-/opnieuw-proberen-logica. Het is geen "point-and-click"-connector.

- Strikt schema-op-schrijven: De opname-API dwingt schema-op-schrijven af. Er moet een nauwkeurig schema worden gedefinieerd en geüpload naar de connectorconfiguratie; alle payloads moeten exact conform zijn of worden afgewezen.

- Dubbele interactiemodi: Dezelfde connector ondersteunt zowel streaming (JSON) voor record-voor-record updates met lage latentie als bulk (CSV) voor grotere periodieke synchronisaties — architecten moeten per gebruikscase kiezen.

- Authenticatie en beveiliging: Aanroepen moeten worden geauthenticeerd via een verbonden app voor Salesforce met behulp van OAuth 2.0 (bijvoorbeeld JWT-bearerstroom voor server-naar-server). Tokenbeheer, rotatie en bereiken met de minste rechten zijn verplicht.

- Operationele zichtbaarheid: Ontwikkelaars en platformteams moeten bewaking implementeren voor responscodes, nieuwe pogingen, wachtrijen met dode letters en waarschuwingen over schemaafwijkingen.

- Vereiste realtime grafiek: Voor echte onmiddellijke activering (onmiddellijke segmentering, realtime DMO-toewijzing) moet het doelgegevensmodelobject (Data Model Object, DMO) deel uitmaken van de realtime gegevensgrafiek; anders doorlopen events een pijplijn met een iets hogere latentie.

Oplossing

Deze tabel bevat oplossingen voor dit integratieprobleem.

| Oplossingsgebied | Passen | Opmerkingen / Implementatiedetails |

|---|---|---|

| Oplossing passend | Beste voor het vastleggen van events met lage latentie | Gebruik de Data 360-opname-API (streaming JSON) voor het pushen van enkelvoudige events of microbatches. Configureer de Ingestion API-connector met een strikt OAS 3.0-schema (.yaml). Gebruik bulk CSV-opname voor grotere, minder frequente synchronisaties. |

| Omgaan met schemawijzigingen | Strikt / beheerd | Schemawijzigingen worden verbroken: werk OAS .yaml bij, versie de connector en voer contracttests uit. Implementeer doorlopende schemamigratie als producenten niet tegelijkertijd kunnen wijzigen. |

| Wanneer niet gebruiken | Suboptimal | Niet ideaal als voorbewerking nodig is (bijv. deduplicatie, gegarandeerde order etc.) of voor extreem grote bulkladingen (gebruik native bulkconnectoren of batch-ETL). Als de bron geen schema-geldige payloads kan produceren of niet veilig kan worden geauthenticeerd, gebruikt u alternatieve opnamemethoden. |

| Beveiliging en governance | Verplicht | Gebruik OAuth 2.0 met bereiken met de minste rechten, roteer sleutels en leg tokengebruik vast. Dwing TLS 1.2+ af, valideer client-IP's indien nodig en zorg voor payload-PII-tagging. Alle events moeten herkomstmetagegevens hebben (bron, tijdstempel, schemaversie, idempotentiesleutel). |

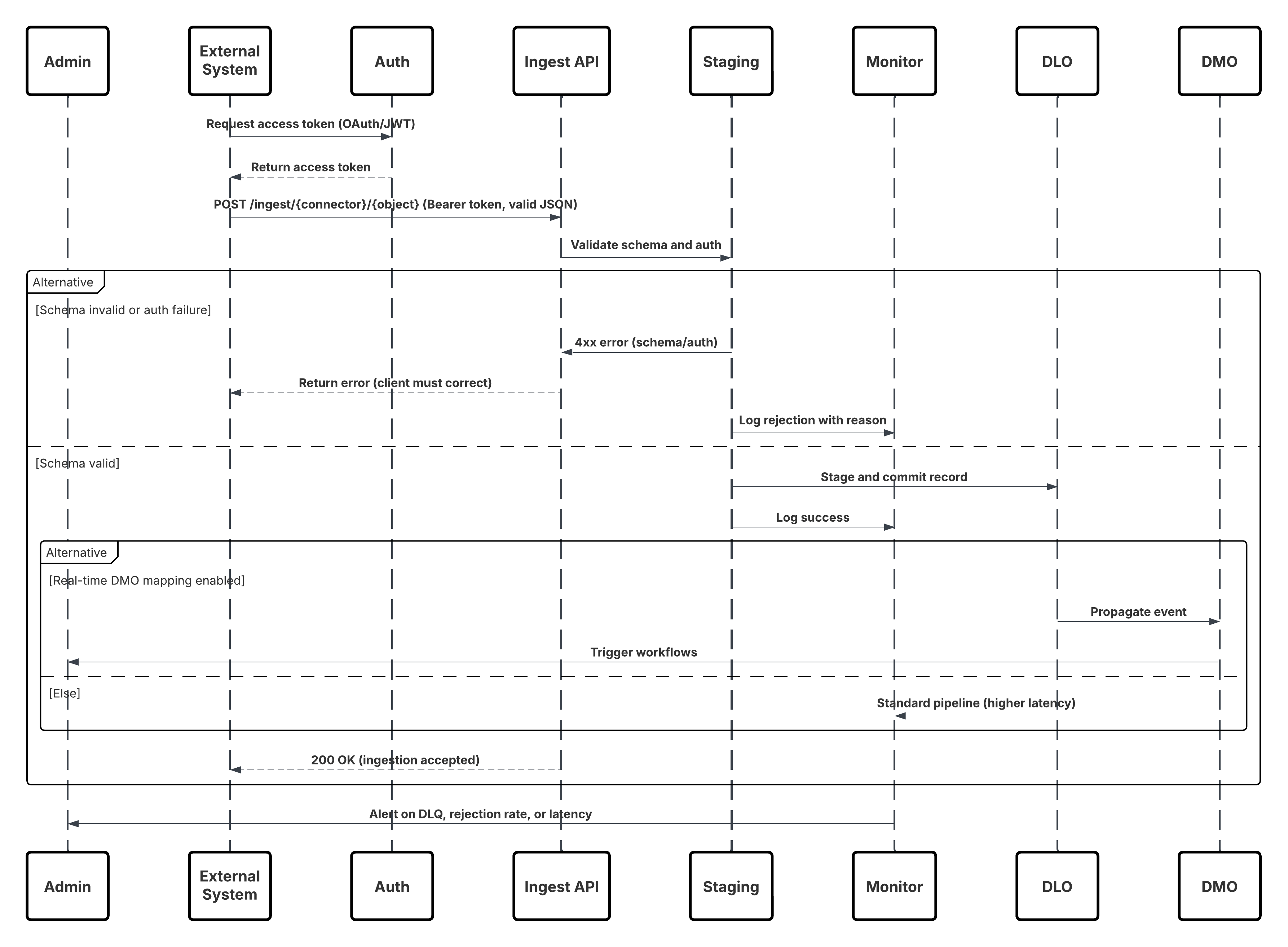

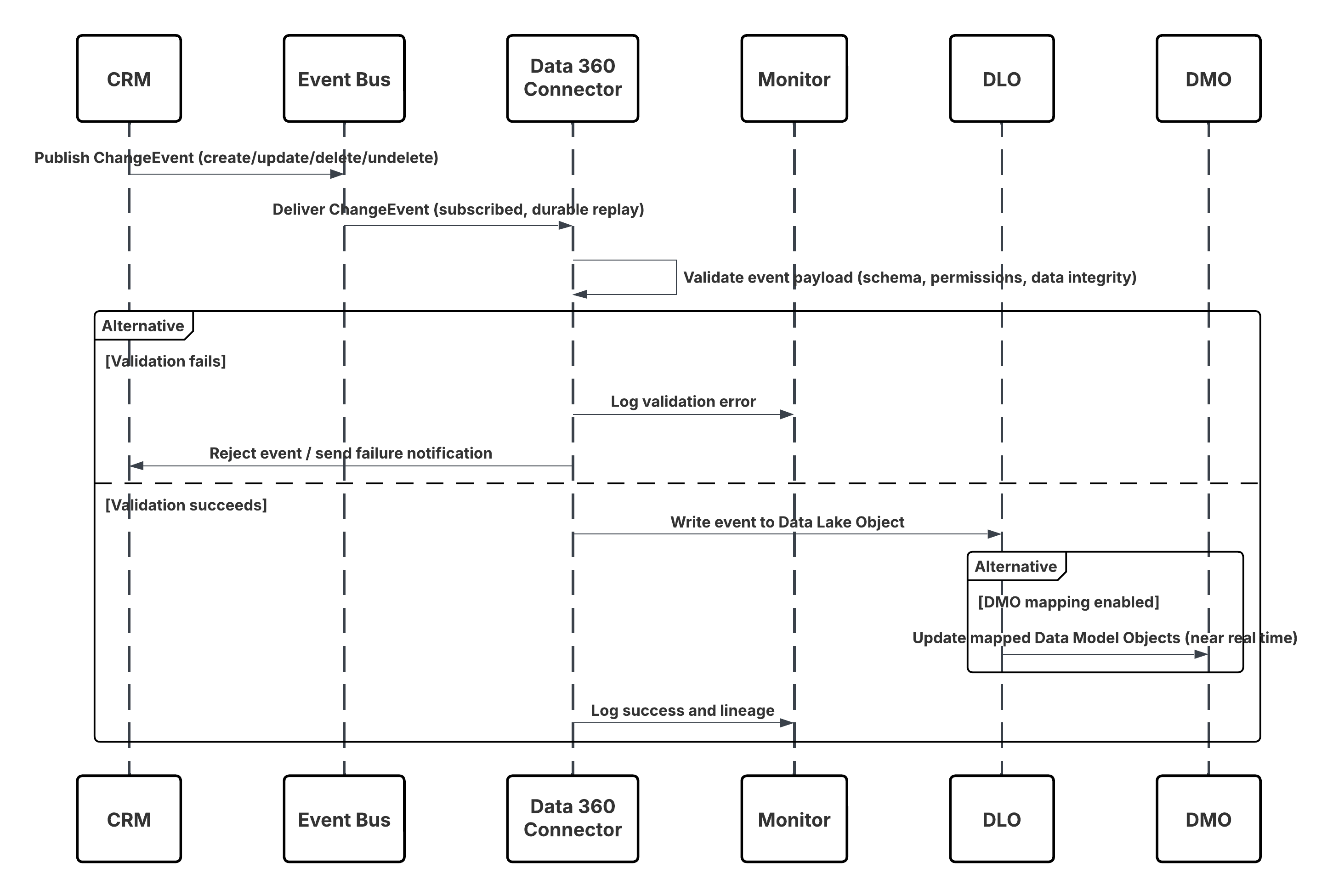

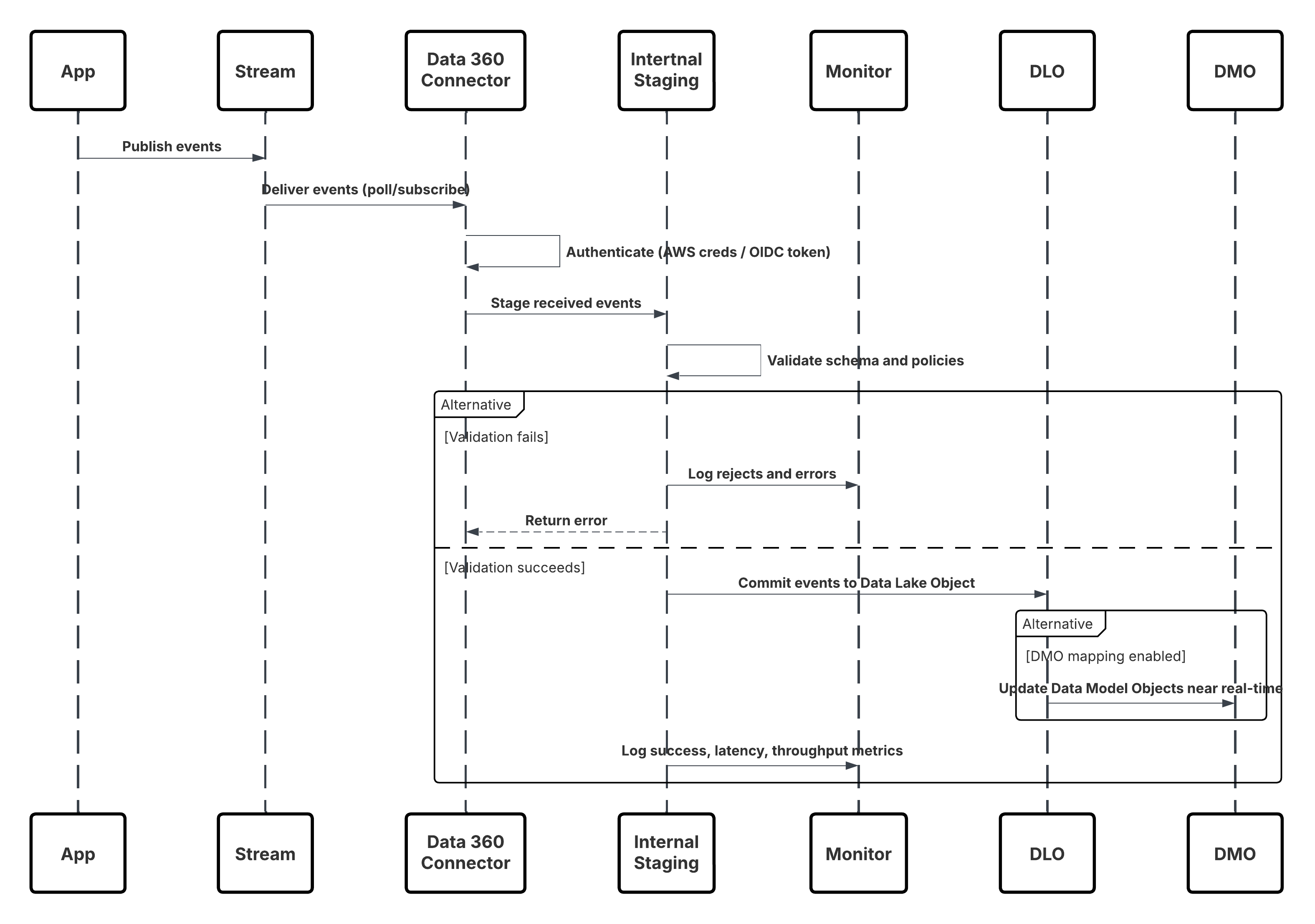

Schets

Dit diagram illustreert de volgorde van stappen voor het opnemen van de gegevens vanuit de opname-API in Data 360

In dit scenario:

- Extern systeem vraagt authenticatie via OAuth/JWT aan bij Auth Server.

- Auth.-server retourneert toegangstoken naar Extern systeem.

- Extern systeem verzendt POST-aanvraag voor gegevensopname naar Data 360-opname-API met autorisatie en JSON-payload.

- De opname-API valideert het aanvraagschema en de authenticatie via de module Staging & Validation.

- Bij schema-/authenticatiefout:

- Fout geretourneerd naar Extern systeem.

- Afwijzing vastgelegd voor bewaking en waarschuwing.

- Bij succesvolle validatie:

- Records die zijn gefaseerd en vastgelegd in het gegevens-lakeobject (Data Lake Object, DLO).

- Succes vastgelegd voor bewaking.

- Indien ingeschakeld, worden gegevens gepropageerd naar Real-time Data Graph (DMO) die downstream werkstromen activeren.

- Anders worden gegevens verwerkt via een standaardbatch of een pijplijn met een hogere latentie.

- Opname-API bevestigt succes voor Extern systeem.

- Bewakingscomponenten waarschuwen de beheerder voor wachtrijen met dode letters, afwijzingsscores of latentieproblemen.

Resultaten

Externe eventgegevens worden met een lage latentie opgenomen in Data 360-DLO's. Wanneer het doel-DMO deel uitmaakt van de realtime grafiek, zijn de gegevens beschikbaar voor onmiddellijke segmentering, agentwerkstromen, AI-modellen en operationele activering. Dit maakt snelle bedrijfsreacties mogelijk op events die afkomstig zijn van elk verbonden systeem.

Opnamemechanismen

Het opnamemechanisme is afhankelijk van de connector en planningsstrategie die zijn gedefinieerd binnen Data 360.

| Mechanisme | Wanneer gebruiken |

|---|---|

| Streaming JSON (Ingestion API) | Enkelvoudige events, microbatches, gedragsevents, klikstromen, IoT-telemetrie — wanneer een lage latentie vereist is. |

| Bulk CSV (bulkmodus opname-API) | Grotere, periodieke uploads waarbij de latentievereisten worden versoepeld. |

| Edge / Middleware | Gebruik dit wanneer u validatie, transformatie, verrijking of scorebeperking nodig hebt voordat u naar de opname-API pusht. |

Afhandeling en herstel van fouten

- Onmiddellijke (synchronisatie)fouten: 4xx-responsen voor schema-/authenticatiefouten: client moet payload of token corrigeren en het opnieuw proberen.

- Voorbijgaande (asynchrone) storingen: 5xx-responsen: opnieuw proberen van cliënten met exponentiële backoff en jitter.

- Dead-Letter Queue (DLQ): Aanhoudende storingen landen in DLQ voor handmatige inspectie en opnieuw afspelen.

- Bewaking: Houd het percentage afgewezen schema's, authenticatiefouten, latentiepercentielen en DLQ-achterstand bij. Waarschuwing over drempelwaarden.

Overwegingen bij impotent ontwerp

- Idempotentiesleutel: Elke event moet een unieke idempotentiesleutel/bericht-ID bevatten.

- Strategie voor upsert: Gebruik bedrijfssleutels (ExternalId) om duplicaten bij opnieuw afspelen te voorkomen.

- Ded-upvenster: Architect moet deduplicatievensters en retentie definiëren voor het bijhouden van idempotentie.

Beveiligingsoverwegingen

Beveiliging is een integraal onderdeel van de opnamepijplijn, van authenticatie tot encryptie en toegangscontrole.

- Authenticatie: OAuth 2.0 (JWT Bearer) aanbevolen voor server-naar-server. Beperk bereiken tot alleen opname.

- Encryptie: TLS 1.2+ voor transport; Data 360 dwingt encryptie at rest af.

- Minste rechten: Inloggegevens voor verbonden apps hebben minimale rechten; roteer geheimen en toegangslogboeken voor instrumenten.

- Bestuur van payload: Neem instemmings-/verbruiksvlaggen op in eventmetagegevens; pas ABAC-/CEDAR-beleid onmiddellijk na opname toe.

- IP-besturingselementen / Privé verbinden: Beperk indien nodig toegang via goedgekeurde lijsten of gebruik Privé verbinden voor privénetwerken.

Sidebars

Tijdigheid

Tijdigheid is afhankelijk van het opnameschema en het gegevensvolume. Streaming JSON levert een latentie van subseconde tot seconde, afhankelijk van de verwerking en de configuratie van de grafiek. Bulk CSV is minuten tot uren. Kies op basis van bedrijfs-SLA's.

Gegevensvolumes

Afzonderlijke eventgrootten moeten klein zijn (< paar kB). Overweeg voor producenten met hoge doorvoer batching bij de producent of gebruik een streamingbuffer (Kafka/Kinesis) voordat u de API aanroept.

Statusbeheer

- Schemaversiebeheer: Onderhoud schemaversie in eventmetagegevens en gebruik connectorversiebeheer bij het bijwerken van het OAS-contract.

- Connectorverschuivingen: Data 360 verwerkt commitsemantiek; producenten moeten idempotentiesleutels en laatste succesvolle volgorde bijhouden voor veilig opnieuw afspelen.

Complexe integratiescenario's

In geavanceerde ondernemingsarchitecturen kan dit patroon worden geïntegreerd met:

- Randvalidatielaag: Gebruik middleware voor het vertalen van heterogene producentennotaties naar het vereiste OAS-contract, het uitvoeren van scorebeperkingen en pre-verrijking.

- Hybride architecturen: Combineer opname-API voor events en connectoren voor bulkafstemming.

- Agentactivering: Events die zijn toegewezen aan realtime DMO's kunnen Agentforce werkstromen en Einstein modellen activeren voor geautomatiseerde besluitvorming.

Voorbeeld

Een detailhandelsketen streamt verkooppuntaankoopevents in real-time naar Data 360 om directe klantbetrokkenheid te stimuleren. Elke store voert een lichtgewicht servercomponent uit die transacties verzamelt, deze verrijkt met locatie- en apparaatmetagegevens en JSON-events veilig post met behulp van JWT Bearer OAuth met idempotentiesleutels om duplicaten te voorkomen. Een beheerder definieert de eventstructuur door een OAS-schema voor het verkooppunt te uploaden en de connector van de opname-API te configureren. Inkomende events worden opgenomen in het DLO pos_sale, toegewezen aan het DMO Verkoop en toegevoegd aan de realtime grafiek. Als gevolg hiervan worden aankopen met een hoge waarde onmiddellijk gedetecteerd, waardoor VIP-werkstromen in Agentforce worden geactiveerd en klantsegmentering wordt bijgewerkt om real-time personalisatie te stimuleren.

Context

Dit patroon maakt het mogelijk om gedetailleerde gebruikersinteractiegegevens met groot volume—zoals paginaweergaven, knopklikken, productimpressies en videoweergaven—vast te leggen vanaf websites en mobiele toepassingen in trueReal-Time. Het is essentieel voor het leveren van personalisatie op het moment, waarbij elke digitale interactie dynamisch de gebruikerservaring kan beïnvloeden en betrokkenheid kan stimuleren.

Probleem

Hoe kan een onderneming een continue stroom van gedragsevents vastleggen en verwerken vanuit digitale eigenschappen, die miljoenen gebruikersinteracties per minuut bestrijken, en die gegevens onmiddellijk beschikbaar maken in Data 360 om realtime segmentering, personalisering en activering aan te sturen?

Krachten

Deze gebruikscase introduceert diverse ontwerpuitdagingen die een doelgerichte opnamearchitectuur met lage latentie vereisen:

- Extreme doorvoer: Websites of mobiele apps met veel verkeer kunnen miljoenen events per minuut uitzenden. De opnamelaag moet horizontaal worden geschaald om dit volume te verwerken zonder eventverlies of tegendruk, wat zorgt voor een consistente latentie bij piekbelastingen.

- Instrument aan cliëntzijde: In tegenstelling tot servergestuurde integraties is dit patroon afhankelijk van SDK's aan clientzijde. Op elke pagina moet een JavaScript-baken (Salesforce Interactions SDK) zijn ingebed of een native SDK die is geïntegreerd in mobiele apps. Dit vereist robuuste clientimplementatie, versiebeheer en governance van eventschema's.

- Verwerking van event met lage vertraging: Gebruikersacties—zoals “toevoegen aan winkelwagentje” of “video afspelen”—moeten Data 360 binnen enkele seconden bereiken, waardoor real-time activering en contextuele reacties (bijv. gerichte aanbiedingen, gepersonaliseerde aanbevelingen) mogelijk worden.

- Gegevens harmonisering en Identiteitsoplossing: Vastgelegde events bevatten vaak anonieme identifiers (cookies, apparaat-ID's, sessietokens). Voor Customer 360 gebruikscases moeten deze worden toegewezen aan bekende profielen via de identiteitsoplossing van Data 360 en worden gecombineerd met het Customer 360 gegevensmodel.

Oplossing

De aanbevolen benadering is het gebruik van de Salesforce Marketing Cloud Personalization-connector, een eigen, volledig beheerde streamingpijplijn die is ontworpen voor opname met hoge doorvoer.

| Oplossingsgebied | Passen | Opmerkingen / Implementatiedetails |

|---|---|---|

| Op SDK gebaseerde event vastleggen | Best | Implementeer de Salesforce Interactions SDK (web) of native SDK (mobiel). Deze lichtgewicht bibliotheken leggen interacties van gebruikers in realtime vast en serialiseren deze, waarbij metagegevens (sessie-ID, tijdstempel, context) worden bijgevoegd. |

| Eventstreamingpijplijn | Best | Events worden verzonden naar de eventstreamingservice van Marketing Cloud Personalization via beveiligde HTTPS. Deze laag is horizontaal schaalbaar en geoptimaliseerd voor transmissie met lage latentie (<2s). |

| Data 360-integratie | Best | De Personaliseringsconnector van Data 360 abonneert zich op de streamingfeed en neemt elke event in nearReal-Time op in een Data Lake-object (DLO). |

| Gegevensmodeltoewijzing | Best practice | Het opgenomen DLO wordt toegewezen aan Customer 360 Data Model Objects (DMO's). Hierdoor kunnen anonieme en bekende gebruikers worden gekoppeld via Identiteitsoplossing. |

| Inschakelen van realtime grafieken | Optioneel / aanbevolen | Neem toegewezen DMO's op in de realtime grafiek voor onmiddellijke segmentering, waardoor gepersonaliseerde acties worden geactiveerd via Einstein of Agentforce werkstromen. |

| Wanneer niet gebruiken | Suboptimal | Dit patroon is niet ideaal wanneer: De brongegevens zijn webclient en events (gebruik in plaats daarvan de opname-API). De organisatie heeft geen controle over web-/mobiele clients. Realtime gedrag bijhouden is niet vereist (gebruik batchgewijs opnemen). |

| Omgaan met het schema Wijzigingen | Beheerde evolutie | Eventschema's evolueren naarmate nieuwe interacties worden toegevoegd. SDK's moeten eventdefinities versieren. Achterwaarts compatibele wijzigingen (het toevoegen van optionele velden) zijn veilig; het breken van wijzigingen vereist opnieuw configureren van de connector en testen van contracten. |

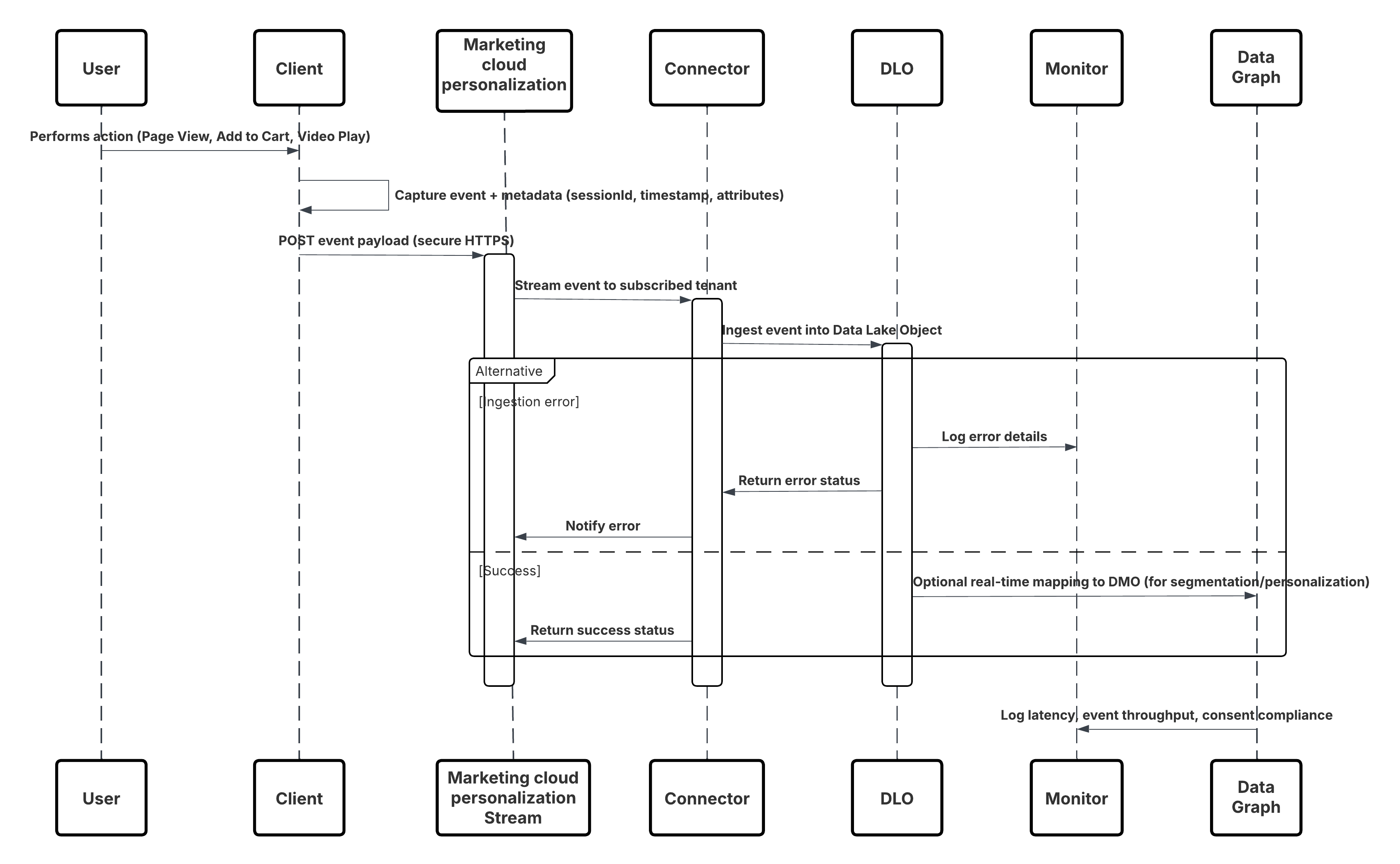

Schets

Dit diagram illustreert de volgorde van stappen voor het opnemen van de gegevens uit mobiele en webkanalen in Data 360

In dit scenario:

- Implementeer de SDK in web- of mobiele kanalen (vastleggen van gebruikersinteractie).

- Configureer SDK met belanghebbenden-ID, omgevings- en instemmingsbesturingselementen.

- Stream vastgelegde JSON-events (metagegevens + kenmerken) naar Marketing Cloud-streamingeindpunt.

- Maak en configureer in Set-up van Data 360 de Personalisatieconnector voor de belanghebbende.

- Neem events op in een DLO en wijs het DLO → DMO toe binnen Data 360.

- Schakel het DMO in de realtime grafiek in voor onmiddellijke activering.

- Bewaak latentie, schemaconformiteit, instemmingsvlaggen, doorvoer en foutpercentages.

- Implementeren naar productie en continu bewaken.

Resultaten

Een continue stroom van gedragsevents met een lage latentie stroomt van digitale kanalen naar Data 360. Binnen enkele seconden is elke gebruikersactie beschikbaar voor real-time segmentering, voorspellend modelleren of geactiveerde personalisering, waardoor echt adaptieve klantervaringen mogelijk worden.

Opnamemechanismen

Het opnamemechanisme is afhankelijk van de connector en planningsstrategie die zijn gedefinieerd binnen Data 360.

| Mechanisme | Wanneer gebruiken |

|---|---|

| Interactions SDK (Web) | Realtime vastleggen vanuit webbrowsers en SPA's. |

| Mobile SDK | Realtime vastleggen vanuit native mobiele toepassingen. |

| Personalisatieconnector | Beheerd abonnement tussen Marketing Cloud en Data 360\. |

| Realtime grafiektoewijzing | Schakelt onmiddellijke activering in Segmentering, Einstein en Journeys in. |

Afhandeling en herstel van fouten

- Gelaagde fouttolerantie: Implementeer validatie- en hernieuwde pogingen op meerdere lagen: client-SDK's verwerken tijdelijke storingen met exponentiële backoff, terwijl de opnamelaag duurzame wachtrijen en afspeelbare pijplijnen gebruikt om gegevensverlies te voorkomen.

- Schema en gegevensbeheer: Versieer en valideer eventschema's continu; ongeldige of zich ontwikkelende events worden naar een wachtrij Schemaafwijzing of Dode letter gerouteerd voor veilig testen en opnieuw afspelen.

- Idempotentie en deduplicatie: Gebruik stabiele event-ID's en upsert-semantiek om exacte eenmalige verwerking te garanderen, zelfs tijdens opnieuw proberen of opnieuw afspelen.

- Bewaking en herstelautomatisering: Continue bewaking van doorvoer, latentie en foutpercentages activeert geautomatiseerde herstelwerkstromen, wat zorgt voor een lage latentie, betrouwbare levering en consistente real-time personalisatie-uitkomsten.

Overwegingen bij impotent ontwerp

- Elke event moet een unieke idempotentiesleutel of bericht-ID hebben, zodat dubbele indieningen verderop in de stroom kunnen worden ontdubbeld.

- Gebruik waar nodig bedrijfssleutels (bijv. sessionID + eventTimestamp + userID) om duplicaten te identificeren.

- Definieer een deduplicatieperiode (bijvoorbeeld 24 uur) waarin duplicaatevents worden genegeerd of gefilterd.

- Gebruik upsert-strategieën waar van toepassing (bijvoorbeeld tellers of vlaggen bijwerken in plaats van duplicaten invoegen).

Beveiligingsoverwegingen

Beveiliging is een integraal onderdeel van de opnamepijplijn, van authenticatie tot encryptie en toegangscontrole.

- Transport-encryptie: TLS 1.2+ voor alle SDK → streaming service verbindingen.

- Gegevensencryptie in ruste in Data 360 en marketingstroom.

- SDK respecteert gebruikersinstemmingsvlaggen (GDPR/CCPA) en onderdrukt tracking als instemming wordt geweigerd.

- Authenticatie van SDK-verkeer: zorg ervoor dat alleen goedgekeurde belanghebbenden/klanten events kunnen streamen.

- Metagegevens: elke event moet bron-ID, tijdstempel, schemaversie, sessie-ID en idempotentiesleutel bevatten.

- Toegang met minste rechten: SDK-eindpunten en -connectoren die zijn beperkt tot het opnamebereik van events; roteer inloggegevens regelmatig.

- Gegevensclassificatie: Persoonsgegevens annoteren in eventpayloads, beleid onmiddellijk na opname afdwingen

Sidebars

Tijdigheid

- Tijdigheid is afhankelijk van de activiteit van eindgebruikers en de configuratie van eventstreaming.

- Events die zijn vastgelegd via de Salesforce Interactions SDK en worden geleverd via de Marketing Cloud Personalization Stream, bereiken doorgaans een latentie van minder dan een seconde tot ongeveer een seconde voordat ze beschikbaar komen in de realtime grafiek van Data 360.

- Dit maakt vrijwel onmiddellijke segmentering, personalisering en activering binnen actieve gebruikerssessies mogelijk.

Gegevensvolumes

Afzonderlijke gedragsevents (bijvoorbeeld klikken, weergeven, toevoegen aan winkelwagentje) zijn licht van gewicht — over het algemeen 1–5 kB per payload. Verwacht voor grootschalige digitale eigenschappen duizenden tot miljoenen events per minuut. Doorvoer en veerkracht garanderen:

- Gebruik de ingebouwde batching- en hernieuwde pogingsmechanismen van de SDK voor pagina's met veel verkeer.

- Offload burstverwerking naar de Marketing Cloud-bufferlaag voor streaming.

- Bewaak opnamedoorvoer en foutverhoudingen met behulp van het dashboard voor connectormeetgegevens.

Statusbeheer

Elke event omvat metagegevens voor status- en versiebeheer:

- Schemaversiebeheer: Schemaversie inbedden in elke event; versie van de personalisatieconnector bij het bijwerken van het schema.

- Afhandeling van opnieuw afspelen: Events die mislukken vanwege tijdelijke netwerkproblemen, worden automatisch opnieuw geprobeerd door de SDK met exponentiële backoff.

- Idempotentiesleutels: Unieke identifiers (sessionId + eventType + tijdstempel) zorgen ervoor dat opnieuw afgespeelde events geen duplicaten maken in Data 360.

- Offsetbeheer: Data 360 houdt succesvolle commits bij; niet-verwerkte events worden opnieuw in de wachtrij geplaatst door de connector totdat ze met succes worden opgenomen.

Complexe integratiescenario's

Dit patroon kan naadloos worden geïntegreerd in geavanceerde ondernemingsarchitecturen:

- Randverrijkingslaag: Voeg middleware (bijvoorbeeld reverse proxy of serverloze functie) toe om extra context te injecteren, zoals geo, apparaattype of campagnemetagegevens, voordat events Marketing Cloud bereiken.

- Hybride (streaming + batch): Gebruik de Marketing Cloud-connector voor realtime stromen en combineer deze met batch-ETL-taken (bijv. ordergegevens) voor afstemming verderop in de stroom.