Le integrazioni Salesforce moderne devono supportare molto più del semplice scambio di dati. Si prevede che rafforzino le esperienze dei clienti in tempo reale, coordinino le azioni in più sistemi e operino in modo affidabile su scala aziendale, il tutto rispettando rigorosi requisiti di sicurezza e conformità. Scegliere il giusto approccio di integrazione è quindi una decisione architettonica fondamentale, non un dettaglio di implementazione. Considerare uno scenario aziendale comune. Un cliente completa un acquisto in un'app mobile, attivando un controllo dell'idoneità in tempo reale per un'offerta personalizzata. Allo stesso tempo, i dati delle transazioni devono essere registrati in un sistema ERP, gli attributi dei clienti aggiornati in Salesforce e gli elementi di Analytics trasmessi in streaming a un data lake, senza introdurre latenza, duplicazione dei dati o rischi di conformità. Scenari di questo tipo sono ormai tipici degli ambienti Salesforce moderni, dove Salesforce raramente opera in modo isolato e deve integrarsi perfettamente con un ecosistema più ampio di applicazioni e piattaforme dati. Questa guida esiste per aiutare architetti e sviluppatori a progettare queste integrazioni con chiarezza e sicurezza. Anziché concentrarsi sulle implementazioni da punto a punto, presenta una serie di modelli di integrazione collaudati che riguardano scenari aziendali ricorrenti, ad esempio l'orchestrazione dei processi, la sincronizzazione dei dati e l'accesso ai dati in tempo reale. Ogni schema enfatizza l'intento architettonico, i compromessi e i modelli di esecuzione, consentendo ai team di prendere decisioni di progettazione informate e durature. All'interno di questo documento troverai:

- Schemi di integrazione che rappresentano "archetipi" aziendali comuni in scenari di accesso a processi, dati e virtuali

- Framework di selezione degli schemi per identificare l'approccio corretto in base all'intento di integrazione e ai tempi di esecuzione

- Indicazioni pratiche su scalabilità, affidabilità, governance e considerazioni sulla sicurezza

- Procedure consigliate tratte dalle implementazioni reali di Salesforce e Data 360 L'obiettivo di questo documento è quello di fornire un linguaggio architettonico condiviso per l'integrazione, aiutando i team a progettare soluzioni che bilanciano prestazioni, flessibilità e Trust allineandosi con i dati aziendali e le strategie di governance.

Questo documento è destinato a progettisti e architetti che necessitano di integrare i dati di altre applicazioni aziendali con Salesforce Data 360 (in precedenza Data Cloud). Questo contenuto è un distillato di molte implementazioni di successo degli architetti e dei partner Salesforce. Per acquisire familiarità con le funzionalità e le opzioni di integrazione disponibili per l'adozione su larga scala di Data 360, vedere le sezioni Riepilogo schemi e Guida alla selezione degli schemi riportate di seguito. Gli architetti e gli sviluppatori dovrebbero considerare questi dettagli dello schema e le procedure consigliate durante la fase di progettazione e implementazione dei progetti di interazione dei dati in Data 360. Se implementati correttamente, questi schemi consentono di arrivare in produzione il più velocemente possibile e di avere la serie di applicazioni più stabile, scalabile ed esente da manutenzione possibile. Gli architetti consulenti Salesforce utilizzano questi schemi come punti di riferimento durante le revisioni architettoniche e li gestiscono e migliorano attivamente. Come per tutti gli schemi, questo contenuto copre la maggior parte degli scenari di integrazione, ma non tutti. Benché Salesforce consenta l'integrazione dell'interfaccia utente (interfaccia utente), ad esempio i mashup, tale integrazione esula dall'ambito di questo documento.

Ogni schema di integrazione segue una struttura coerente. Ciò offre coerenza nelle informazioni fornite in ogni schema e semplifica anche il confronto degli schemi.

- Nome: Identificatore dello schema che indica anche il tipo di integrazione contenuto nello schema.

- Context: Scenario di integrazione generale affrontato dallo schema. Il contesto fornisce informazioni su ciò che gli utenti stanno cercando di ottenere e su come l'applicazione si comporta per supportare i requisiti.

- Problema: Espresso come domanda, questo è lo scenario che lo schema è progettato per risolvere. Leggere questa sezione per capire se lo schema è appropriato per il proprio scenario di integrazione.

- Forze: I vincoli e le circostanze che rendono lo scenario dichiarato difficile da risolvere.

- Soluzione: Il modo consigliato per risolvere lo scenario di integrazione.

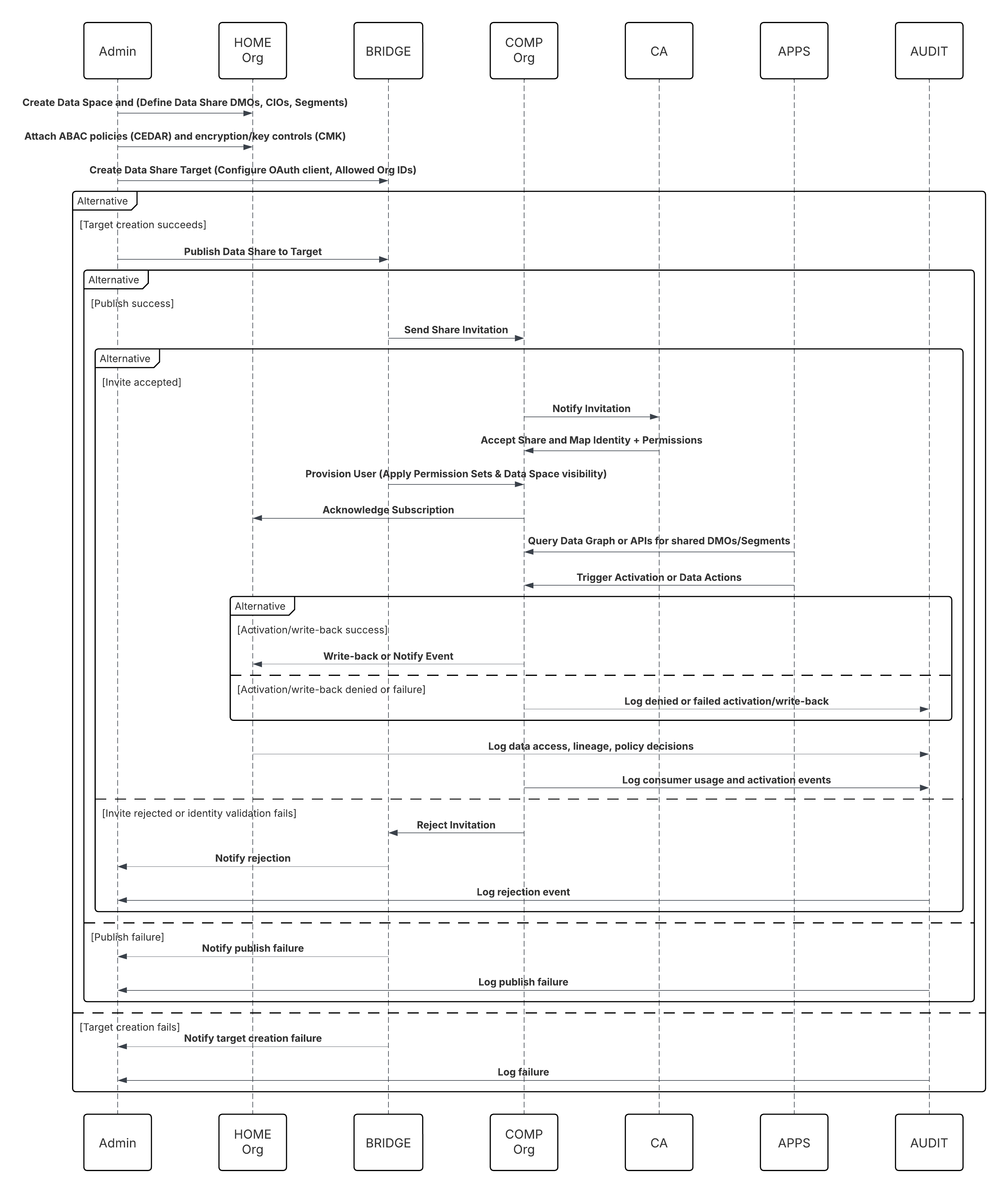

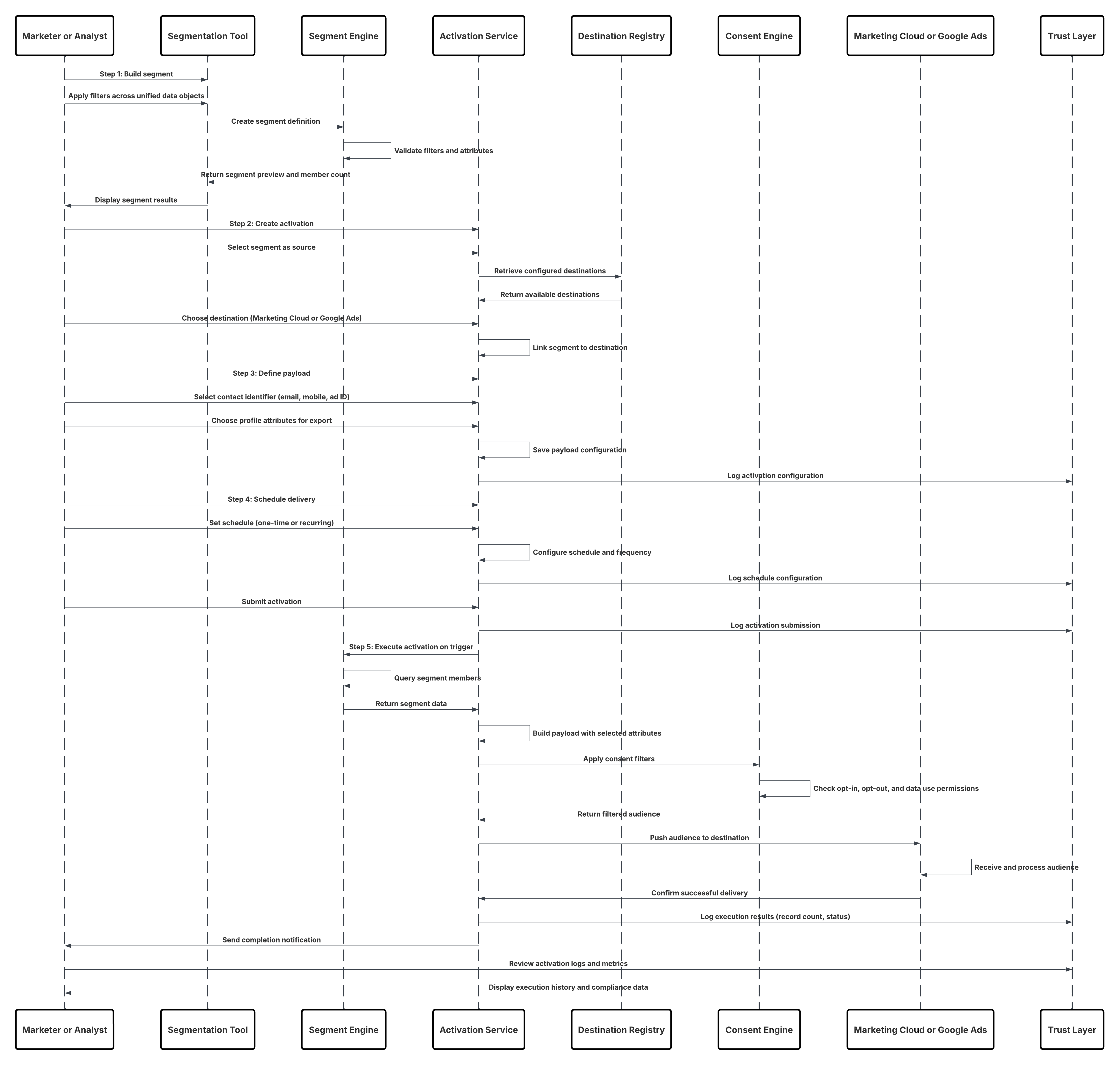

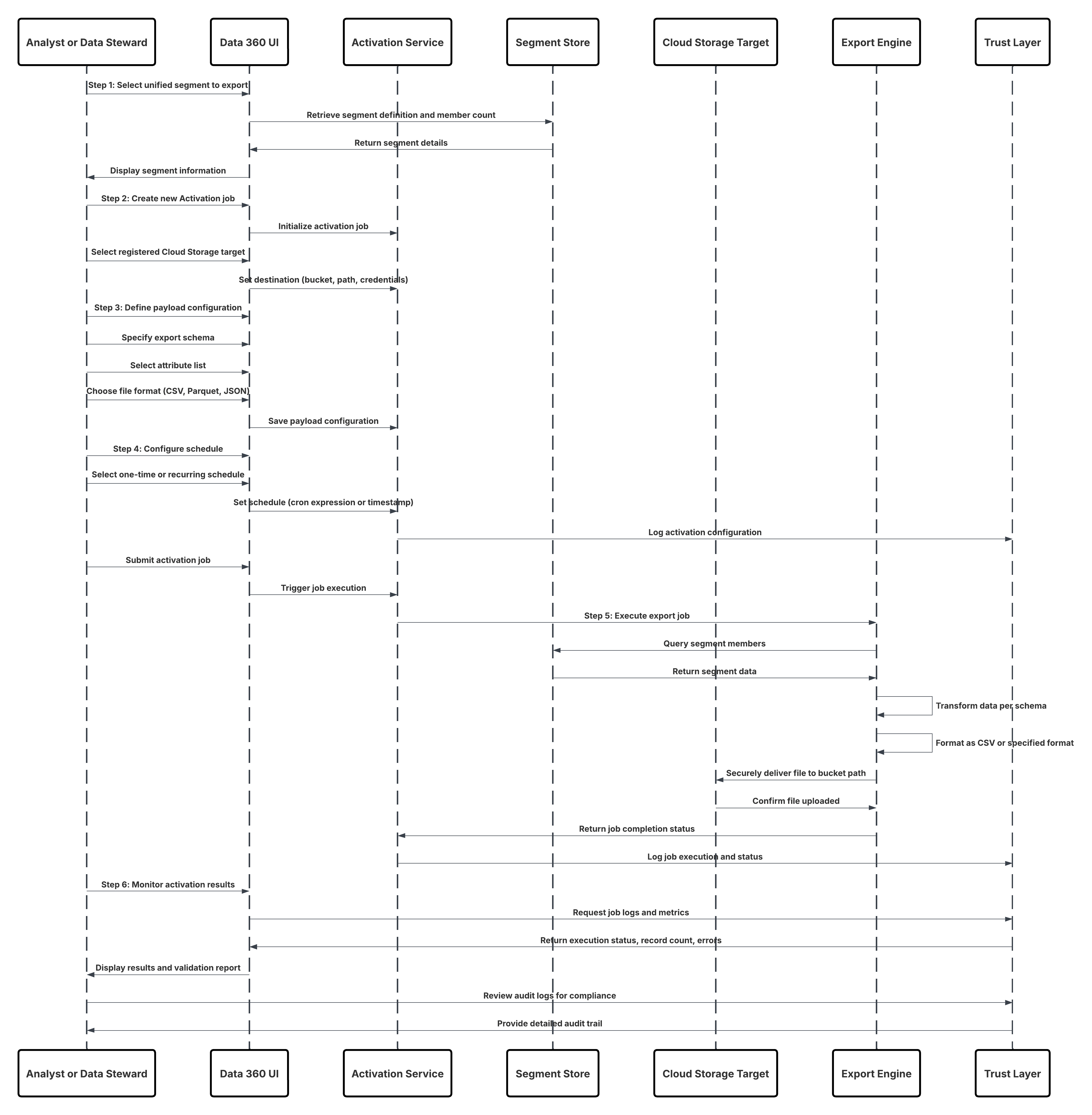

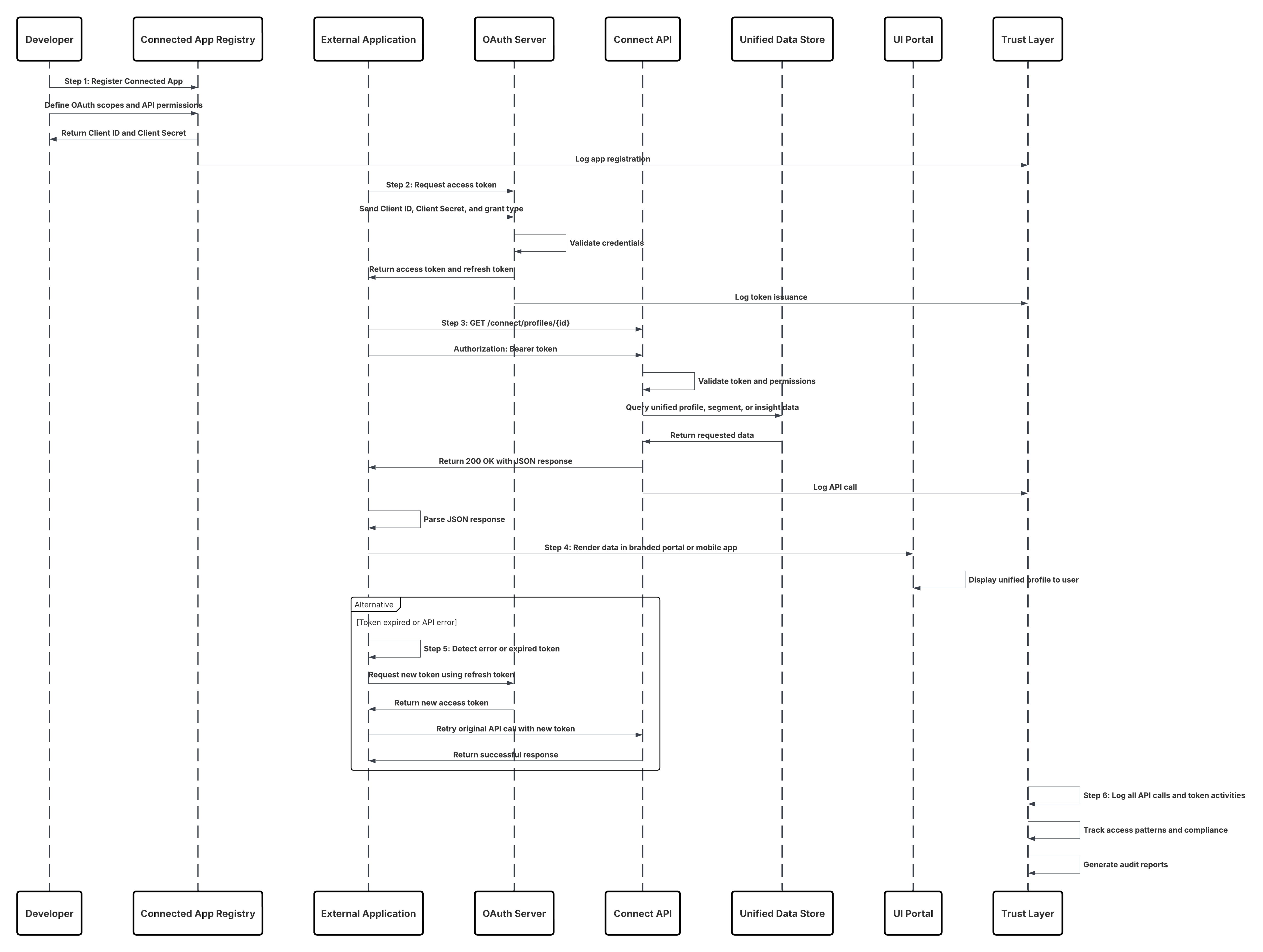

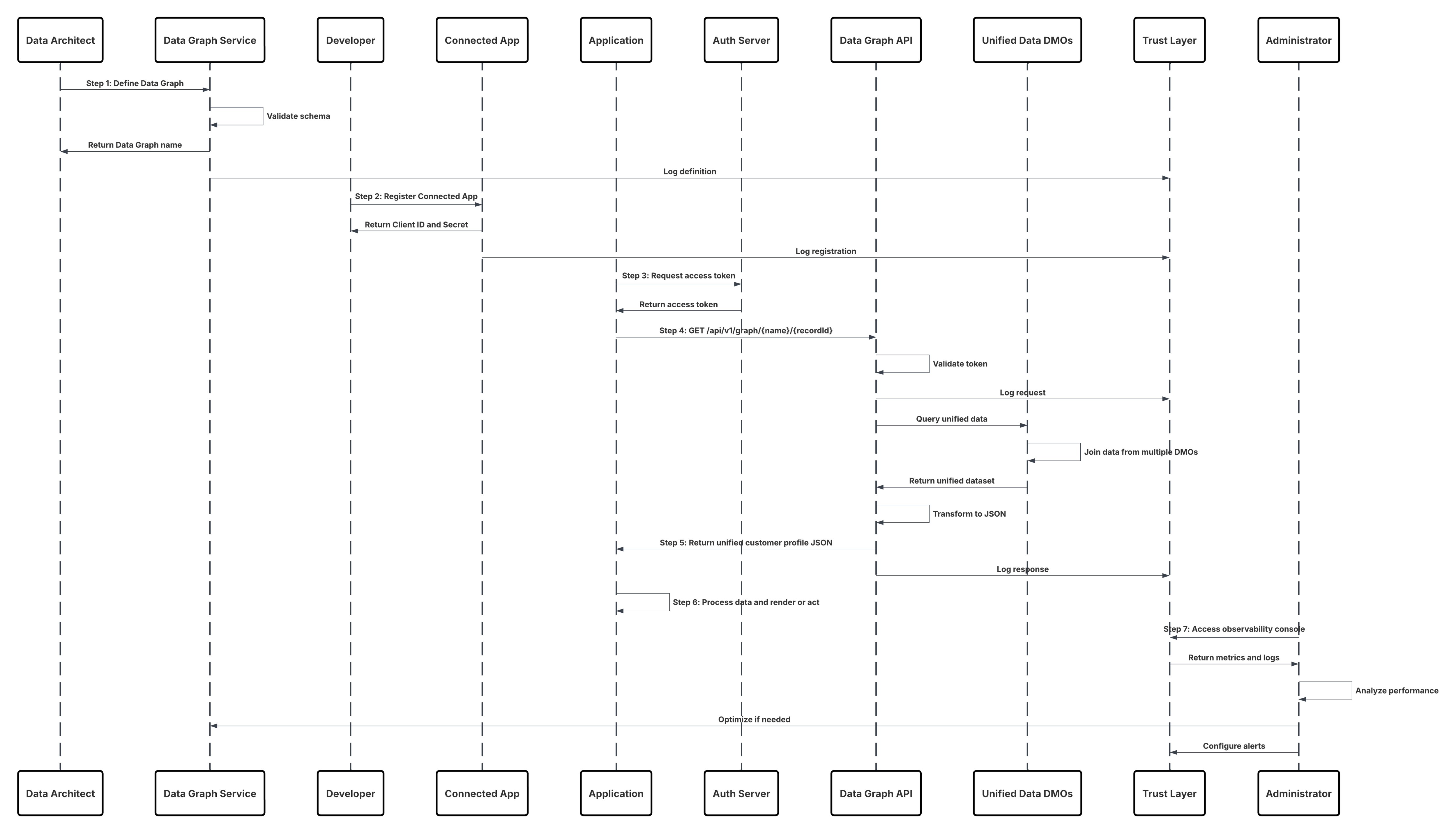

- Sketch: Diagramma di sequenza UML che mostra come la soluzione affronta lo scenario.

- Risultati: Spiega i dettagli di come applicare la soluzione allo scenario di integrazione e come risolvere le forze associate a quello scenario. Questa sezione contiene anche nuove sfide che possono sorgere in seguito all'applicazione dello schema.

- Intestazioni laterali: Sezioni aggiuntive correlate allo schema che contengono problemi tecnici chiave, variazioni dello schema, problemi specifici dello schema e così via.

- Esempio: Uno scenario del mondo reale che descrive come viene utilizzato lo schema di progettazione in uno scenario Salesforce del mondo reale. L'esempio spiega gli obiettivi di integrazione e come implementare lo schema per raggiungere tali obiettivi.

Utilizzare questa tabella come indice degli schemi di integrazione contenuti in questo documento.

| Schema livello1 | Schema livello2 | Schema | Secenario |

|---|---|---|---|

| Schemi di inserimento dati - Dati in entrata | Schemi di inserimento batch | Inserimento di dati in blocco da Cloud Storage | I dati vengono inseriti da una fonte di archiviazione cloud aziendale come Amazon S3, Azure Blob o Google Cloud Storage in Data 360 sotto forma di grandi batch di dati non elaborati (ad esempio transazioni o registri di prodotti). |

| Inserimento di dati in blocco da Salesforce Clouds | Data 360 riceve i dati CRM in blocco da più organizzazioni Salesforce (ad esempio Sales Cloud, Service Cloud) per creare profili cliente unificati. | ||

| Streaming e schemi di inserimento in tempo reale | Inserimento basato sugli eventi tramite l'API di inserimento--Streaming | Data 360 si abbona agli endpoint di inserimento streaming che ricevono payload di eventi continui (ad esempio, eventi di acquisto, telemetria IoT) dai sistemi aziendali per gli aggiornamenti dei profili in tempo reale. | |

| Inserimento di comportamenti Web e mobili in tempo reale | Data 360 raccoglie ed elabora i dati comportamentali in tempo reale dei siti Web e delle app mobili tramite SDK per arricchire le metriche di coinvolgimento e i modelli di personalizzazione. | ||

| Sincronizzazione CRM quasi in tempo reale tramite streaming | Data 360 riceve gli aggiornamenti dei dati CRM (ad esempio, le modifiche di referenti, casi e opportunità) quasi in tempo reale tramite stream di eventi per mantenere una visualizzazione Customer 360 sincronizzata in modo continuo. | ||

| Inserimento di stream di eventi dalle piattaforme di messaggistica cloud - Kinesis e MSK | Data 360 utilizza i dati in streaming direttamente da piattaforme di eventi cloud come AWS Kinesis o Kafka (MSK) per elaborare eventi operativi o IoT ad alta frequenza. | ||

| Schemi copia zero - In entrata e in uscita | Copia zero in entrata - Piattaforme esterne in Data 360 | Data 360 esegue query su serie di dati esterne (ad esempio Snowflake, BigQuery) su richiesta tramite l'inserimento copia zero, senza spostare fisicamente i dati in Salesforce. | |

| Copia zero in uscita - Dati 360 su piattaforme esterne | I sistemi esterni come Databricks o Tableau accedono a segmenti e approfondimenti arricchiti in Data 360 tramite connessioni Copia zero in uscita senza replica dei dati. | ||

| Piattaforma dati unificata multi-organizzazione con Data Cloud One | Data Cloud One unifica più organizzazioni Salesforce e fonti di dati esterne in un modello semantico e di metadati condiviso, offrendo Customer 360 coerente senza duplicazione dei dati. | ||

| Schemi di attivazione dei dati - Dati in uscita | Schemi di attivazione batch | Attivazione del segmento nelle piattaforme di marketing e pubblicità | Data 360 attiva i segmenti di clienti curati direttamente in Marketing Cloud, Meta, Google Ads o altre piattaforme pubblicitarie per la consegna personalizzata delle campagne |

| Esportazione di dati in Cloud Storage | Data 360 esporta le serie di dati unificate o filtrate (ad esempio, i record cliente consenzienti) come file CSV o Parquet nell'archiviazione cloud aziendale per l'analisi o l'archiviazione della conformità. | ||

| Attivazione basata su API on-demand | Integrazione di applicazioni personalizzate tramite API Connect | Le applicazioni esterne richiamano l'API Data 360 Connect in tempo reale per recuperare o attivare azioni personalizzate (ad esempio, il controllo del saldo fedeltà o la generazione di offerte AI) in base ai dati correnti dei clienti.Le applicazioni Web o mobili personalizzate recuperano gli approfondimenti armonizzati di Data 360 in modo sicuro tramite l'API REST Connect per visualizzarli nelle interfacce utente aziendali o dei partner. | |

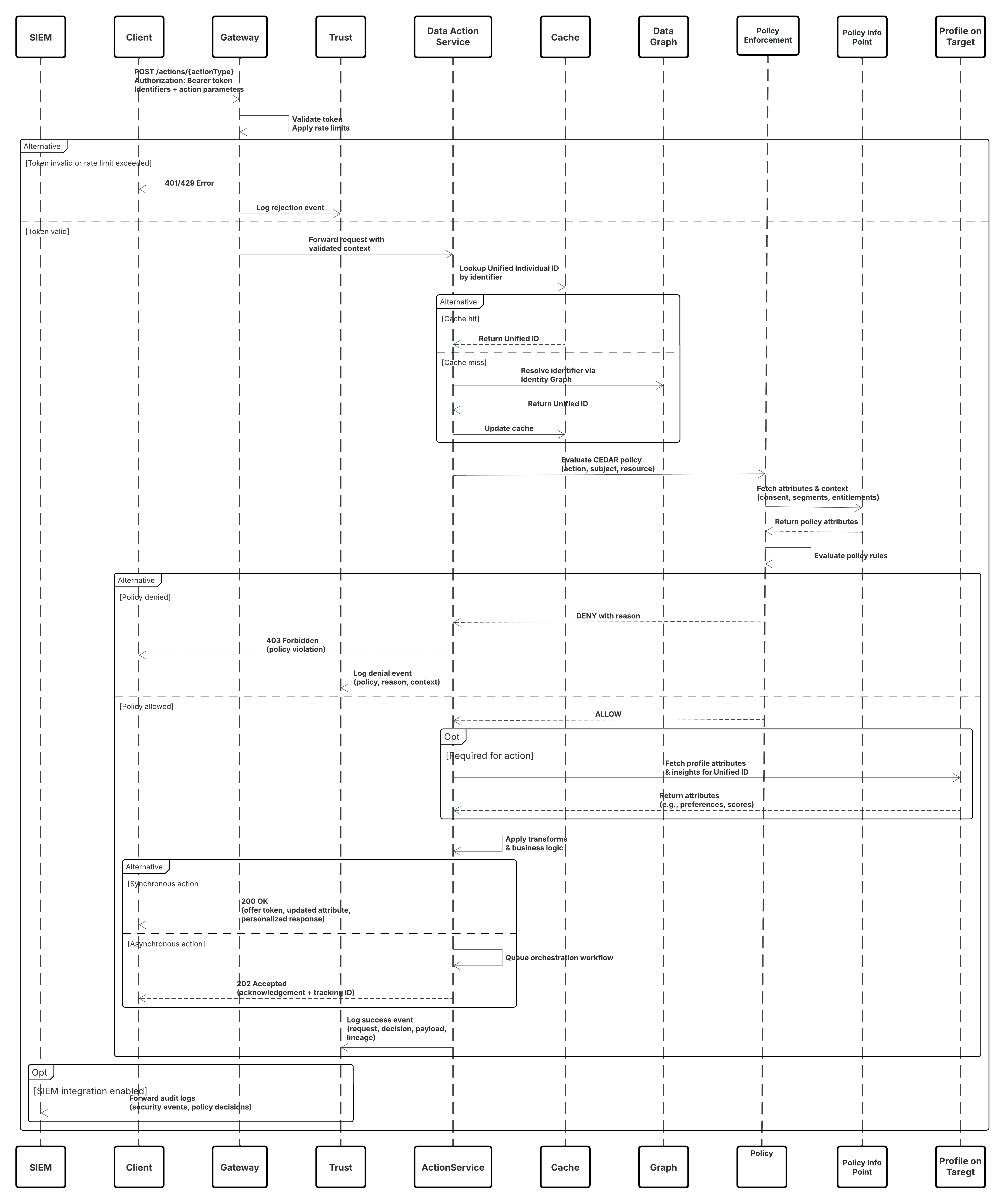

| Completamento del recupero del profilo cliente tramite l'API Data Graph | Un sistema recupera il profilo unificato di un cliente utilizzando l'API Data Graph, restituendo una rappresentazione JSON pre-unita in tempo reale della visualizzazione completa a 360° per le decisioni o la personalizzazione. | ||

| Azioni dati in tempo reale | Azione dati in tempo reale Trasformazione dei segnali dei clienti in azione immediata | Data 360 rileva ed elabora un evento live (ad esempio, aggiornamento del consenso, trigger di acquisto) e richiama immediatamente un sistema connesso o un flusso Salesforce per un'azione a valle.Un segnale di attività del cliente (ad esempio, il rischio di abbandono rilevato) in Data 360 attiva un'azione istantanea in tempo reale, ad esempio aggiornare CRM, invocare il calcolo del punteggio Einstein o avviare un journey di fidelizzazione. |

Gli schemi di integrazione in questo documento sono classificati in tre categorie: integrazioni di dati, processi e visuali.

Gli schemi di integrazione dei dati in Data 360 riguardano lo spostamento e la sincronizzazione dei dati tra i sistemi per garantire che sia Data 360 che le piattaforme esterne dispongano di informazioni coerenti, tempestive e affidabili. Questi schemi in genere gestiscono flussi di dati su larga scala e a volume elevato e si basano su pipeline governate che impongono la coerenza dello schema, il tracciamento dei lignaggi e le regole di masterizzazione.

- Gli schemi di inserimento batch rappresentano il livello di base dell'orientamento dei dati aziendali. L'inserimento in blocco di dati da servizi di cloud storage come AWS S3, Azure Blob o Google Cloud Storage consente di caricare periodicamente serie di dati storici di grandi dimensioni in Data 360 per la risoluzione dell'identità, la segmentazione e l'analisi. Analogamente, l'inserimento in blocco da Salesforce Cloud, ad esempio Sales Cloud, Service Cloud o Marketing Cloud, utilizza connettori e stream di dati nativi per inserire i dati CRM nel livello di dati unificato, garantendo armonizzazione e continuità tra i sistemi di coinvolgimento.

- Streaming e schemi di inserimento in tempo reale estendono questo processo acquisendo dati di eventi a velocità elevata. L'inserimento basato sugli eventi tramite l'API di inserimento consente ai sistemi esterni di trasmettere continuamente l'attività dei clienti in Data 360. L'inserimento del comportamento Web e mobile in tempo reale acquisisce i dati di clickstream e di interazione direttamente dai punti di contatto digitali per favorire la personalizzazione immediata. La sincronizzazione CRM quasi in tempo reale tramite le Streaming API garantisce che gli attributi dei clienti e gli aggiornamenti del consenso si riflettano rapidamente nei vari sistemi. L'inserimento di stream di eventi da piattaforme di messaggistica come Amazon Kinesis o Confluent MSK supporta opportunità in corso di realizzazione continue ad alta produttività, allineando Data 360 alle architetture degli eventi aziendali.

- Unified Multi-Org Data Platform with Data Cloud One rappresenta un ulteriore esempio di integrazione dei dati, offrendo un ambiente consolidato per unificare i dati di più organizzazioni Salesforce e fonti esterne sotto un livello di governance e semantica comune. Ciò consente alle organizzazioni di ottenere coerenza dei dati a livello aziendale, modelli di dati condivisi e analisi scalabili.

- Nella fase di attivazione, gli schemi di attivazione batch seguono lo stesso principio di integrazione dei dati. I segmenti curati in Data 360 vengono esportati nei processi pianificati nelle piattaforme di marketing e pubblicità a valle, ad esempio Marketing Cloud, Meta Ads o Google Ads, dove attivano l'esecuzione delle campagne. Analogamente, le serie di dati possono essere esportate in destinazioni di archiviazione cloud per alimentare le opportunità di analytics e data science esterne. In tutti questi casi d'uso, Data 360 funge da fonte di dati veritieri per i dati dei clienti sincronizzati e curati.

Gli schemi di integrazione dei processi in Data 360 includono l'attivazione o l'orchestrazione di processi aziendali tra i sistemi in quasi tempo reale. Questi schemi consentono a Data 360 di partecipare attivamente ai flussi di lavoro aziendali, abilitando risposte contestuali e attivazione dinamica dei dati.

- L'attivazione basata su API abilita scenari di coinvolgimento in tempo reale. Tramite l'API Connect, le applicazioni personalizzate possono eseguire query o attivare i profili cliente direttamente da Data 360 come parte dei processi operativi, ad esempio una console agente che recupera approfondimenti unificati sui profili durante un'interazione con il cliente. Il Complete Customer Profile Retrieval via Data Graph API supporta applicazioni composite e microservizi che si basano sull'accesso basato su API al grafico entità completo di un cliente, consentendo esperienze dinamiche senza segmenti pre-stadiati.

- Le azioni dati in tempo reale spingono ulteriormente questo approccio di integrazione abilitando la reattività immediata. Quando viene rilevato un segnale cliente, ad esempio un acquisto, l'invio di un modulo o un evento di soglia, Data 360 può attivare azioni come l'aggiornamento di un record CRM, l'invocazione di un webhook esterno o l'avvio di un flusso di lavoro dell'offerta personalizzato. Questi schemi incarnano una vera e propria orchestrazione dei processi, collegando Intelligence clienti in tempo reale ed esecuzione operativa automatica.

Gli schemi di integrazione virtuali in Data 360 consentono l'accesso live a fonti di dati esterne o federate senza copiare o duplicare fisicamente i dati. Questi sono fondamentali per le aziende che necessitano di informazioni aggiornate e gestite in fase di query riducendo al minimo lo spostamento dei dati.

- Inbound Zero Copy Data Federation (External Platforms-to-Data 360) consente ai sistemi esterni, ad esempio data warehouse o data lake, di condividere le serie di dati con Data 360 tramite connessioni protette e regolamentate (ad esempio, Snowflake Secure Data Sharing). Ciò garantisce che Data 360 possa accedere e operare virtualmente sui dati esterni, preservando la freschezza ed eliminando le repliche inutili.

- Outbound Zero Copy Data Sharing (Data 360-to-External Platforms) consente a Data 360 di esporre le serie di dati curate per il consumo esterno, ad esempio modellazione AI, business intelligence o analisi avanzate, tramite meccanismi di federazione dei dati e query live sicuri. Scegliere la strategia di integrazione migliore per il proprio sistema non è banale. Ci sono molti aspetti da considerare e molti strumenti che possono essere utilizzati, con alcuni strumenti più appropriati di altri per determinate operazioni. Ogni schema affronta specifiche aree critiche, tra cui le funzionalità di ogni sistema, il volume dei dati, la gestione dei guasti e la transazionalità.

Quando si seleziona uno schema di integrazione, iniziare rispondendo a due domande fondamentali che definiscono la progettazione e il comportamento complessivi dell'integrazione. Cosa si sta integrando? — Accesso a processi, dati o virtuale Questa dimensione definisce lo scopo principale dell'integrazione.

- Le integrazioni dei processi si concentrano sull'orchestrazione dei flussi di lavoro aziendali e sul coordinamento delle azioni tra i sistemi.

- Le integrazioni dei dati si concentrano sulla sincronizzazione, l'arricchimento o la propagazione dei dati tra i sistemi.

- Le integrazioni virtuali si concentrano sull'accesso ai dati esterni in tempo reale senza copiarli o mantenerli in Salesforce o Data 360. La comprensione di questo intento consente di determinare il livello di orchestrazione, spostamento dei dati e accoppiamento richiesto tra i sistemi.

- Come deve essere eseguito? — Il metodo Sincrono o Asincrono definisce il modello di esecuzione dell'integrazione.

- Le integrazioni sincronizzate sono in tempo reale e bloccanti, in cui il chiamante si aspetta una risposta immediata, comunemente utilizzate per scenari guidati dagli utenti o di convalida.

- Le integrazioni asincrone sono non bloccanti e disaccoppiate, progettate per gestire processi su larga scala, di lunga durata, tentativi e volumi di dati elevati. Insieme, queste due dimensioni (intento di integrazione e tempistica di esecuzione) offrono un framework chiaro e coerente per selezionare lo schema di integrazione corretto bilanciando esperienza utente, scalabilità e resilienza operativa. Nota: Un'integrazione può richiedere un middleware esterno o una soluzione di integrazione (ad esempio, Enterprise Service Bus) a seconda degli aspetti validi per lo scenario di integrazione.

In questa tabella sono elencati gli schemi e i relativi aspetti chiave per consentire di determinare quale schema si adatta meglio alle proprie esigenze quando l'integrazione passa da Salesforce a un altro sistema

| Tipo | Tempistica | Considerazioni in uscita |

|---|---|---|

| Integrazione dei dati | Asynchronous | Attivazione del segmento nelle piattaforme di marketing e pubblicità |

| Integrazione processi/dati | Synchronous | Integrazione di applicazioni personalizzate tramite API Connect Completamento del recupero del profilo cliente tramite l'API Data Graph |

| Integrazione dei dati | Synchronous | Azione dati in tempo reale Trasformazione dei segnali dei clienti in azione immediata |

| Integrazione virtuale (utilizzo di copia zero) | Asynchronous | Copia zero in uscita - Dati 360 su piattaforme esterne |

| Integrazione virtuale | Asynchronous | Piattaforma dati unificata multi-organizzazione con Data Cloud One |

In questa tabella sono elencati gli schemi e i relativi aspetti chiave per consentire di determinare lo schema più adatto alle proprie esigenze quando l'integrazione avviene da un altro sistema a Salesforce.

| Tipo | Tempistica | Considerazioni in entrata |

|---|---|---|

| Integrazione dei dati | Asynchronous | Inserimento di dati in blocco da Cloud Storage Inserimento di dati in blocco da Salesforce Clouds |

| Integrazione dei dati | Asynchronous | Inserimento di stream di eventi dalle piattaforme di messaggistica cloud - Kinesis e MSK Sincronizzazione CRM quasi in tempo reale tramite streaming |

| Integrazione dei processi | Synchronous | Inserimento basato sugli eventi tramite l'API di inserimento--Streaming Inserimento di comportamenti Web e mobili in tempo reale |

| Integrazione virtuale | Asynchronous | Copia zero in entrata - Piattaforme esterne in Data 360 |

In questa tabella sono elencati alcuni termini chiave relativi al middleware e le relative definizioni in relazione a questi schemi.

| Termine | Definizione |

|---|---|

| Gestione eventi | La gestione degli eventi si riferisce alla ricezione, all'instradamento e alla risposta a occorrenze identificabili da un sistema o da un'applicazione di origine. Middleware gestisce gli eventi identificando l'endpoint di destinazione, inoltrando l'evento e attivando l'azione aziendale richiesta (ad esempio, registrazione, tentativi o attivazione di servizi a valle). Nelle architetture Data 360, la gestione degli eventi è fondamentale per l'inserimento dati in tempo reale, i trigger di attivazione e gli schemi di pubblicazione/abbonamento. Gli eventi possono provenire da sistemi esterni (Kafka, AWS Kinesis) o da eventi Salesforce Platform e vengono instradati dal middleware o dal bus degli eventi di Data 360 per l'elaborazione immediata. |

| Conversione protocollo | La conversione del protocollo consente la comunicazione tra sistemi che utilizzano standard di trasporto dati diversi. Middleware traduce protocolli proprietari o legacy (come AMQP, MQTT, FTP) in protocolli Data 360 supportati (REST, gRPC o HTTPS). Ciò garantisce l'interoperabilità tra sistemi eterogenei. Poiché Data 360 non gestisce in modo nativo la conversione del protocollo, il middleware fornisce il livello di adattamento, incapsulando o trasformando i messaggi in un formato che le API e i connettori di Data 360 possono interpretare. |

| Traduzione e trasformazione | La traduzione e la trasformazione garantiscono l'interoperabilità mappando un formato di dati o uno schema a un altro. Middleware esegue queste trasformazioni per allineare diversi payload di dati (CSV, XML, JSON) agli oggetti modello di dati (DMO) e agli oggetti livello di dati (UDLO) di Data 360. Ciò include la pulitura, l'arricchimento e l'applicazione di mappature semantiche o basate sull'ontologia prima dell'inserimento. Mentre Salesforce offre strumenti di trasformazione come i procedimenti di Preparazione dati, le trasformazioni complesse (soprattutto per l'armonizzazione semantica) sono gestite meglio nel middleware. |

| Area di attesa e buffering | L'area di attesa e il buffering si basano sul passaggio di messaggi asincroni per garantire una comunicazione resiliente e disaccoppiata. Le piattaforme middleware (ad esempio MuleSoft, Kafka o Azure Event Hub) forniscono aree di attesa persistenti che memorizzano temporaneamente i dati quando Data 360 o i sistemi a valle sono occupati o non raggiungibili. Ciò evita la perdita di dati e supporta l'inserimento o i tentativi di attivazione quasi in tempo reale. Data 360 supporta l'inserimento in streaming e la messaggistica in uscita basata sul flusso, ma le aree di attesa durevoli e la consegna garantita sono in genere gestite dal middleware. |

| Protocolli di trasporto sincroni | I protocolli di trasporto sincrono prevedono il blocco delle operazioni di richiesta/risposta in tempo reale. Il mittente attende una risposta prima di procedere. In Data 360, vengono utilizzati per attivazioni basate su API on-demand, arricchimento in tempo reale o ricerche di profili, in cui le risposte sono richieste immediatamente. Middleware garantisce l'affidabilità della connessione e gestisce i tentativi o la gestione di fallback per le chiamate API Data 360 sincrone. |

| Protocolli di trasporto asincrono | I protocolli di trasporto asincroni supportano la comunicazione non bloccante e disaccoppiata in cui il mittente continua l'elaborazione senza attendere una risposta. Middleware gestisce i flussi asincroni per le attivazioni batch, l'inserimento in streaming e l'attivazione basata sugli eventi. Ciò consente un'elevata produttività e resilienza, fondamentali per lo streaming degli eventi e gli schemi di inserimento dati quasi in tempo reale in Data 360. |

| Instradamento della mediazione | L'instradamento della mediazione definisce un flusso di messaggi complesso tra i sistemi, assicurando che i dati o gli eventi corretti raggiungano il consumatore corretto. Middleware funge da mediatore, gestendo la logica di instradamento in base a regole, intestazioni, contenuti o tipi di evento. Nelle integrazioni Data 360, la mediazione garantisce che gli eventi e gli aggiornamenti dei profili di più sistemi vengano instradati correttamente alle API di inserimento dati, agli endpoint di attivazione o ai consumatori esterni. Ciò semplifica l'orchestrazione e supporta la sincronizzazione dei dati multi-sistema. |

| Coreografia del processo e orchestrazione del servizio | La coreografia e l'orchestrazione del processo coordinano i processi multi-sistema. La coreografia supporta flussi autonomi e asincroni basati sugli eventi, in cui i sistemi agiscono in base a regole condivise senza un controller centrale. L'orchestrazione è un flusso gestito centralmente che dirige l'esecuzione del servizio. Nelle architetture Data 360, il middleware gestisce l'orchestrazione per l'inserimento e l'attivazione tra i sistemi, mentre i flussi di lavoro o i flussi di Salesforce gestiscono coreografie leggere all'interno della piattaforma. Un'orchestrazione complessa, che richiede il coordinamento delle transazioni o la gestione dello stato, è consigliata a livello middleware. |

| Transazionalità (crittografia, firma, consegna affidabile, gestione delle transazioni) | La transazionalità garantisce operazioni atomiche, coerenti, isolate e durature (ACID) in tutti i sistemi. Salesforce e Data 360 sono transazioni all'interno dei loro confini ma non supportano le transazioni distribuite tra i sistemi esterni. Middleware gestisce il controllo delle transazioni globali, incluse crittografia, firma dei messaggi, ritiro, compensazione e consegna affidabile. Per i flussi di dati mission-critical (ad esempio, aggiornamenti finanziari o consenso), il middleware garantisce l'integrità e il ripristino end-to-end in Data 360 e nei sistemi esterni. |

| Instradamento | L'instradamento specifica il flusso controllato di messaggi o dati tra i componenti. Può essere basato su intestazioni, tipo di contenuto, priorità o regole. Middleware gestisce la logica di instradamento per gli eventi e le attivazioni che coinvolgono Data 360, ad esempio l'indirizzamento di segmenti di pubblico arricchiti a diversi sistemi a valle (piattaforme pubblicitarie, magazzini, app CRM). Sebbene l'instradamento possa essere implementato in Salesforce (Apex, flussi), l'instradamento middleware è preferito per la scalabilità, la flessibilità e la governance. |

| Estrazione, trasformazione e caricamento (ETL) | ETL consiste nell'estrarre i dati dai sistemi di origine, trasformarli in uno schema coerente e caricarli in una destinazione (ad esempio Data 360). Gli strumenti middleware o ETL gestiscono queste operazioni prima dell'inserimento dei dati. Data 360 può ricevere output ETL tramite API, connettori o pipeline di inserimento in blocco e supporta anche la sincronizzazione quasi in tempo reale per l'acquisizione dati di modifica. I processi ETL middleware sono essenziali per integrare i sistemi legacy e garantire la qualità dei dati prima dell'unificazione in Data 360. |

| Sondaggio lungo | Il long polling (programmazione Comet) è un metodo per mantenere aperta la comunicazione tra i sistemi per gli aggiornamenti in tempo reale. Il client invia una richiesta e il server la mantiene finché non si verifica un evento, quindi risponde e riapre una nuova connessione. Salesforce lo utilizza nei protocolli Streaming API e CometD/Bayeux per la sincronizzazione dei dati basata sugli eventi. Middleware può abbonarsi a questi eventi e inoltrarli a Data 360 per l'inserimento in tempo reale o i trigger di attivazione, garantendo una latenza minima tra i sistemi aziendali. |

L'inserimento dati è il primo e più importante passaggio del ciclo di vita dei dati di Salesforce Data 360. È il modo in cui le informazioni non elaborate provenienti da più sistemi esterni (API CRM, ERP, Web, mobili o di terze parti) entrano nella piattaforma e diventano parte di una visualizzazione cliente unificata. Lo schema di inserimento corretto dipende dalle esigenze dell'azienda:

- Volume di dati: quanti dati vengono spostati contemporaneamente

- Latenza: quanto devono essere aggiornati i dati

- Funzionalità del sistema di origine: come il sistema può connettersi e fornire dati Data 360 supporta diverse modalità di inserimento per soddisfare queste esigenze: batch per carichi a volume elevato, streaming per aggiornamenti quasi in tempo reale, basato sugli eventi per l'immediatezza delle transazioni e inserimento Copia zero per l'accesso immediato ai dati esterni senza spostarli fisicamente. Insieme, questi schemi assicurano che ogni segnale del cliente, sia che si tratti di un evento di acquisto, di un registro clickstream o di un aggiornamento fedeltà, fluisca in Data 360 in modo efficiente, sicuro e nell'intervallo di tempo giusto per fornire dati analitici affidabili ed esperienze basate sull'intelligenza artificiale.

Gli schemi di inserimento batch sono la spina dorsale dell'orientamento dei dati su larga scala in Data 360. Sono ottimizzati per gli scenari in cui i dati vengono elaborati in blocco, in genere su base pianificata o periodica, anziché in modo continuo. Questi modelli sono più adatti per:

- Dati storici caricati per inizializzare la piattaforma con record aziendali esistenti

- Sincronizzazione regolare con sistemi di record come ERP, data warehouse o database proprietari

- Utilizzare casi in cui la freschezza in tempo reale non è fondamentale, ma la coerenza, la completezza e la possibilità di controllo sono L'inserimento batch offre prestazioni prevedibili e semplicità operativa, il che lo rende una scelta affidabile per le aziende che gestiscono terabyte di dati strutturati o semi-strutturati. Data 360 offre una serie di connettori pronti per l'uso in produzione, generalmente disponibili, che supportano l'inserimento batch in modo nativo. Questi connettori semplificano l'impostazione dell'integrazione, riducono lo sviluppo ETL personalizzato e garantiscono la qualità e la sicurezza dei dati in ogni importazione. La tabella seguente evidenzia i connettori più comuni utilizzati per l'inserimento batch su scala aziendale.

Contesto

Questo schema è progettato per gli scenari aziendali che prevedono l'inserimento di grandi volumi di dati strutturati, ad esempio file CSV o Parquet, e asset non strutturati da data lake centralizzati o drop di file pianificati. Le fonti di dati includono in genere piattaforme di archiviazione cloud come Amazon S3, Google Cloud Storage (GCS) e Archiviazione BLOB di Microsoft Azure, in cui i file vengono consegnati periodicamente nell'ambito di opportunità di data pipeline a monte o esportazioni batch.

Problema

Come può un'organizzazione stabilire un processo affidabile, sicuro e ad alta produttività per inserire serie di dati massicce basate su file dalla piattaforma di archiviazione cloud principale in Data 360 in modo prevedibile e ricorrente, senza sacrificare la governance, la scalabilità o le prestazioni?

Forze

L'inserimento di serie di dati massicce basate su file in Data 360 non è un semplice esercizio di trasferimento dati: è una sfida architetturale caratterizzata da vincoli di scala, governance e piattaforma.

Volume e scala dei dati : I connettori di inserimento Data 360 sono ottimizzati per l'affidabilità e la governance, non per la produzione in blocco arbitraria. Ad esempio, il connettore Amazon S3 supporta fino a 100 milioni di righe o 50 GB per oggetto, a seconda di quale limite viene raggiunto per primo. Per le aziende con serie di dati storiche che contengono miliardi di record, questo confine diventa un vincolo fondamentale per la progettazione. Un approccio lift-and-shift a file singolo diventa rapidamente impossibile, richiedendo strategie intelligenti di partizionamento dei dati, suddivisione in blocchi e orchestrazione per raggiungere la scalabilità senza superare i limiti dei connettori.

Definizione e manutenzione dello schema: Data 360 richiede definizioni esplicite dello schema per ogni pipeline di inserimento per garantire l'integrità semantica e strutturale. In caso di inserimento S3, un file CSV deve definire le intestazioni di colonna e una singola riga di dati rappresentativa. Questo file funge da contratto canonico tra il sistema di origine, ovvero l'archiviazione cloud, e Data 360. Qualsiasi disallineamento, nei nomi dei campi, nei tipi di dati o nella codifica, può causare errori di inserimento o danni silenziosi ai dati. Mantenere questo file schema nel controllo di versione e imporre la convalida tramite flussi di lavoro CI/CD o di governance dei dati diventa una procedura ottimale per gli ambienti di produzione.

Convenzioni di denominazione rigorose: Data 360 applica rigorose regole di denominazione per mantenere la coerenza nel grafico dei metadati.

- I nomi degli oggetti devono iniziare con una lettera e possono contenere solo lettere, numeri o caratteri di sottolineatura.

- I nomi dei campi devono seguire gli stessi schemi. I file che violano queste convenzioni, ad esempio campi contenenti spazi, caratteri speciali o simboli non supportati, non riusciranno a convalidare lo schema durante l'inserimento. Le aziende devono implementare processi di igiene per disinfettare e normalizzare le strutture di file in entrata.

Autenticazione e comportamento di sicurezza: Ogni connessione allo storage esterno deve essere conforme agli standard di sicurezza e conformità di livello aziendale.

- L'autenticazione viene in genere gestita tramite l'autenticazione AWS Access/Secret Keys o IdP (Federated Identity Provider).

- I ruoli IAM devono avere un ambito per imporre privilegi minimi, consentendo l'accesso in sola lettura ai percorsi di archiviazione specificati.

- Per un accesso sicuro, gli indirizzi IP in uscita devono essere aggiunti direttamente all'elenco consentiti del sistema di origine. Questi controlli a livelli assicurano che ogni trasferimento di file operi in un perimetro controllabile e a zero Trust, bilanciando la conformità dell'azienda con la flessibilità necessaria per l'inserimento su larga scala.

Soluzione

Questa tabella contiene le soluzioni a questo problema di integrazione.

| Soluzione | Adatta | Commenti |

|---|---|---|

| Utilizzo di connettori di archiviazione cloud nativi (Amazon S3, Google Cloud Storage, Archiviazione BLOB di Azure) | Best | Questo è lo schema consigliato e più affidabile per l'inserimento su larga scala e ricorrente basato su file in Data 360\. I connettori nativi forniscono l'autenticazione gestita, la mappatura dello schema e lo spostamento sicuro dei dati direttamente negli oggetti data lake (DLO) di Data 360. Ideale per i carichi batch pianificati in cui la latenza non è critica (ad esempio, la pianificazione ogni ora o ogni giorno). |

| Gestione di serie di dati di grandi dimensioni (oltre i limiti del connettore) | Migliore con la preelaborazione | Ogni connettore impone dei limiti di inserimento (ad esempio, S3: 100 milioni di righe o 50 GB per oggetto). Per le serie di dati più grandi, implementare una fase di preelaborazione ETL per suddividere i dati in file/cartelle più piccoli che rientrano in queste soglie. Quindi, configurare più stream di dati per inserire ogni partizione in parallelo e utilizzare il nodo append in una trasformazione dati batch) in Data 360 per ricombinare le partizioni in una serie di dati unificata. |

| Sicurezza e governance | Best | Tutti i connettori supportano l'autenticazione protetta tramite metodi nativi cloud (ruoli IAM, account di servizio o chiavi di accesso). Per un maggiore controllo, limitare l'accesso agli intervalli IP di Data 360 tramite l'elenco consentiti del provider cloud. Il trasferimento dei dati avviene su canali crittografati, con file memorizzati in un livello di gestione temporanea e sicuro durante l'inserimento. |

| Quando non utilizzare | Non ottimale | Questo schema non è ottimale per:

|

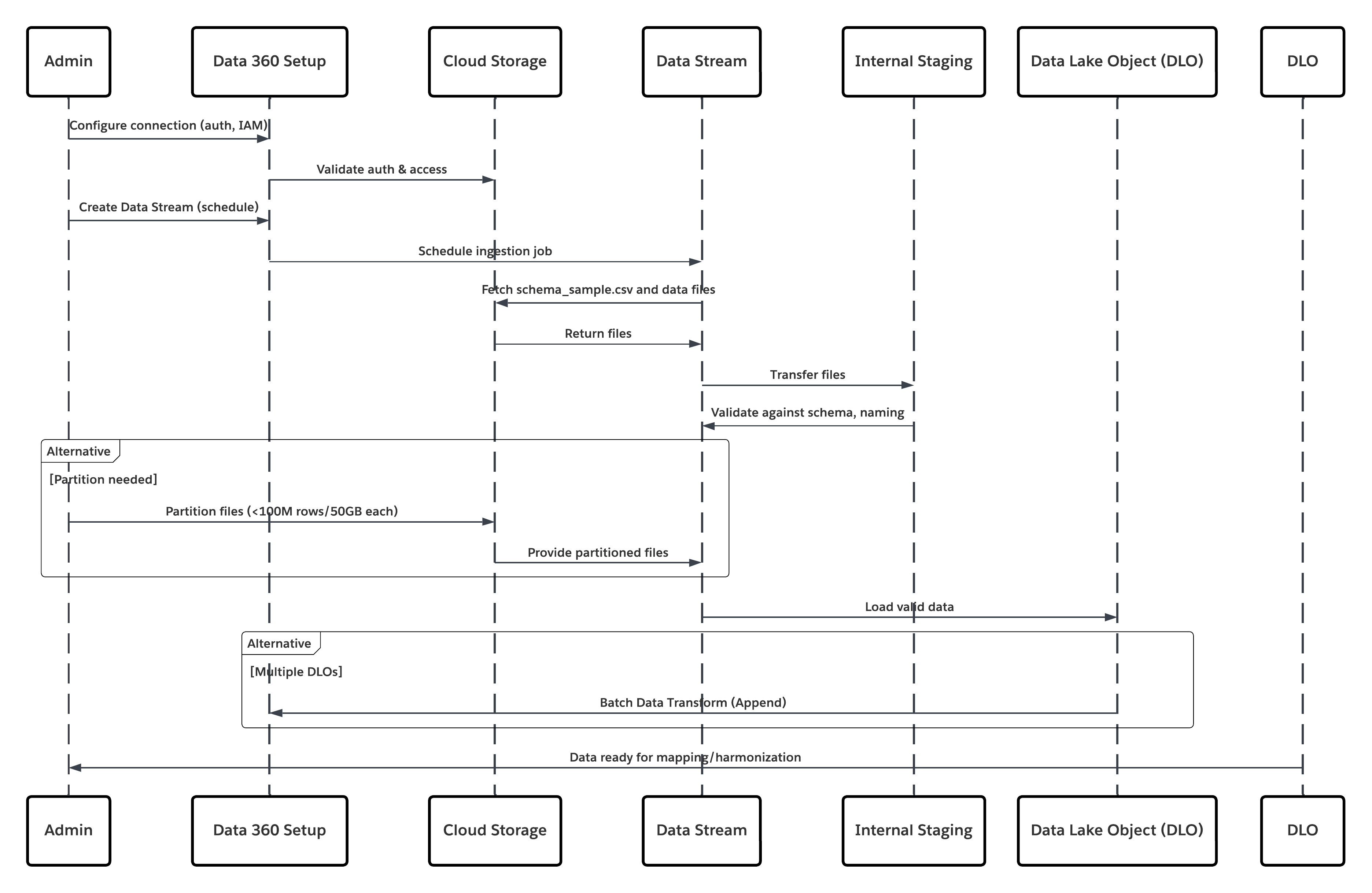

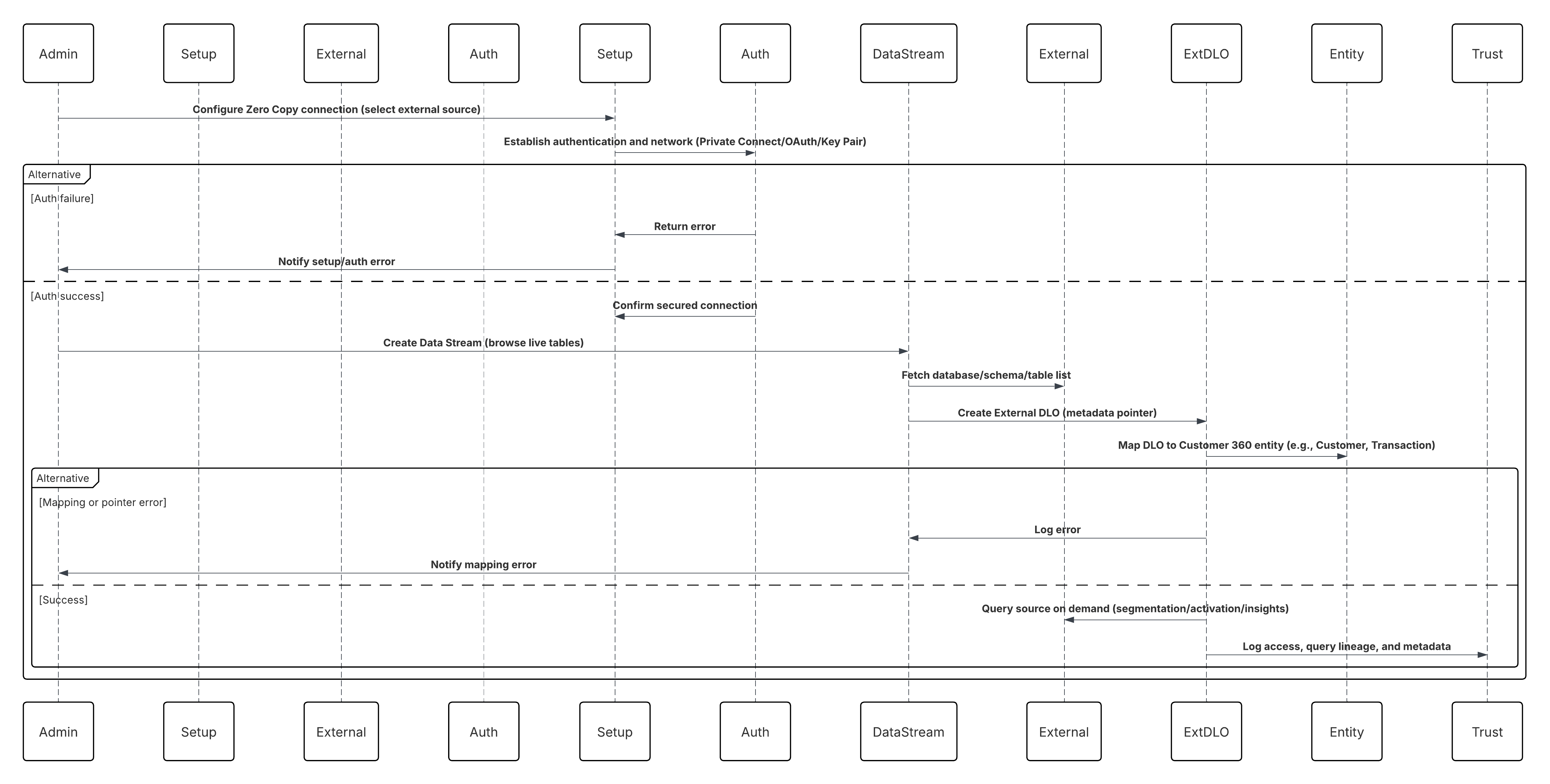

Sketch

Questo diagramma illustra la sequenza delle fasi per inserire i dati dall'archiviazione cloud in Data 360

In questo scenario:

- L'amministratore configura una connessione all'archiviazione cloud tramite l'interfaccia di impostazione di Data 360 (specificando l'autenticazione, i dettagli del bucket, i ruoli IAM e la whitelist).

- L'interfaccia di impostazione di Data Cloud esegue l'autenticazione con Cloud Storage Platform, verificando le credenziali e l'accesso.

- L'amministratore crea uno stream di dati in Data 360, collegandolo all'oggetto/cartella in Cloud Storage e definendo la pianificazione dell'inserimento.

- Al trigger di pianificazione, lo stream di dati richiede i file di origine (ad esempio, CSV, Parquet) da Cloud Storage Platform.

- Cloud Storage Platform fornisce file, inclusi schema_sample.csv validi e altri file di dati conformi alle convenzioni di denominazione.

- Stream di dati trasferisce i file all'ambiente di gestione temporanea interno in Data 360.

- Pipeline di Data 360 elabora i file: Utilizza la definizione schema di schema_sample.csv Convalida la struttura, i nomi dei campi e divide il carico se supera le soglie di inserimento (100 milioni di righe/50 GB per file). Se vengono rilevati file di grandi dimensioni, viene eseguita esternamente una fase di partizionamento di preelaborazione (notificata all'amministratore per l'esecuzione successiva).

- I record vengono importati dalla gestione temporanea in un oggetto data lake (DLO).

- Se necessario e i dati sono partizionati, utilizzare il nodo append in una trasformazione dati batch per combinare più DLO.

- Data 360 registra gli esiti positivi/negativi, aggiorna lo stato per il monitoraggio e segnala che i dati sono pronti per mappatura, armonizzazione e unificazione.

Risultati

L'applicazione di questo schema consente l'inserimento sicuro, pianificato e su larga scala di file strutturati o non strutturati dalle piattaforme di archiviazione cloud aziendali in Data 360. Il processo è automatizzato, scalabile e resiliente: fornisce dati non elaborati in oggetti data lake (DLO) che fungono da base per l'armonizzazione e la mappatura al modello di dati Customer 360.

Meccanismi di inserimento

Il meccanismo di inserimento dipende dal connettore e dalla strategia di pianificazione definiti in Data 360.

| Meccanismo di inserimento | Descrizione |

|---|---|

| Connettore Cloud Storage nativo (Amazon S3, GCS, Azure) | Consigliato per l'inserimento diretto di file in formato CSV o Parquet dal data lake cloud dell'azienda. Questi connettori supportano pianificazioni di aggiornamento incrementali e complete. Ad esempio, una banca può configurare una sincronizzazione giornaliera dei file delle transazioni dei clienti da un bucket S3 a un DLO. |

| Strategia file partizionati | Per le serie di dati molto grandi (oltre 100 milioni di righe o 50 GB per oggetto), i dati vengono partizionati in serie logiche più piccole (ad esempio, per mese o regione). Ogni partizione viene gestita come stream di dati separato e in seguito ricombinata utilizzando una trasformazione dati batch con un nodo Aggiungi in coda. |

| Sincronizzazione pianificata automatica | Data 360 offre uno strumento di pianificazione dichiarativo (ogni ora, ogni giorno o cadenza personalizzata) che attiva automaticamente i processi di inserimento, garantendo la freschezza dei dati senza intervento manuale. |

Gestione e ripristino degli errori

La gestione e il ripristino degli errori sono fondamentali per garantire l'affidabilità nelle operazioni di inserimento a volume elevato.

- Rilevamento errori: Ogni esecuzione dello stream di dati registra gli errori di inserimento (ad esempio, mancata corrispondenza dello schema, danneggiamento dei file o violazioni dei nomi) in Monitoraggio di Data 360. Gli amministratori possono rivedere e rielaborare i batch non riusciti.

- Meccanismo di recupero: Data 360 mantiene il checkpointing per garantire che i batch non riusciti non danneggino gli inserimenti precedenti. I tentativi possono essere configurati dopo la correzione dei problemi di origine (ad esempio, file CSV in formato non corretto).

- Convalida dello schema: Il file schema_sample.csv definisce i tipi di dati e la struttura. Qualsiasi modifica attiva la convalida per evitare una fluttuazione silenziosa dello schema tra le esecuzioni.

Considerazioni sulla progettazione idempotente

L'inserimento è idempotente per progettazione: la rielaborazione dello stesso file non genera record duplicati. Le strategie chiave includono:

- Impronte digitali file: Data 360 calcola le checksum per identificare e ignorare i file elaborati in precedenza.

- Inserimento transazionale: I dati vengono inseriti in più passaggi e confermati nel DLO solo dopo che sono stati elaborati correttamente tutti i record.

- Append vs. Sostituisci: A seconda della logica aziendale, gli stream possono aggiungere o sostituire completamente il DLO di destinazione; ciò garantisce risultati deterministici ed evita la sovrapposizione parziale dei dati.

Considerazioni sulla sicurezza

La sicurezza è fondamentale in tutta la pipeline di inserimento, dall'autenticazione alla crittografia e al controllo degli accessi.

- Autenticazione e autorizzazione: I connettori utilizzano il framework di integrazione sicura di Salesforce, che sfrutta le credenziali denominate e le credenziali esterne per l'autenticazione senza esporre segreti.

- Crittografia: I dati vengono crittografati in transito (TLS 1.2+) e a riposo (AES-256).

- Controlli di rete: I sistemi di archiviazione di origine (ad esempio, i bucket S3) devono inserire nell'elenco consentiti gli IP di Data 360.

- Allineamento conformità: Supporta i framework di protezione dei dati aziendali come GDPR, HIPAA e le linee guida FFIEC se abbinati alle chiavi gestite dal cliente (CMK).

- Controllabilità: Ogni processo di inserimento e accesso alle credenziali vengono registrati per la tracciabilità e la creazione di rapporti sulla conformità.

Intestazioni laterali

Tempestività

La tempestività dipende dalla pianificazione dell'inserimento e dal volume dei dati.

- Serie di dati aziendali di grandi dimensioni (oltre 100 milioni di righe) possono richiedere il partizionamento per l'inserimento parallelo.

- La latenza tipica dell'inserimento varia da minuti ad alcune ore, a seconda delle dimensioni del file e della complessità della trasformazione.

- Per l'inserimento quasi in tempo reale, Streaming Data 360 o connettori basati su API possono integrare il modello basato su file.

Volumi di dati

- Più adatto per l'inserimento periodico batch a volume elevato.

- Ogni oggetto elaborato tramite il connettore S3 supporta fino a 100 milioni di righe o 50 GB per file.

- Per i sistemi su scala petabyte, utilizzare il partizionamento dei dati e l'orchestrazione multi-stream.

Supporto della capacità e degli standard degli endpoint

La funzionalità e il supporto standard per l'endpoint dipendono dalla soluzione scelta.

| Tipo di connettore | Requisiti degli endpoint |

|---|---|

| Connettore Amazon S3 | bucket S3 con policy IAM e file schema\_sample.csv appropriati che definiscono lo schema. |

| Connettore Google Cloud Storage | Credenziali account di servizio e accesso bucket con convenzioni di denominazione uniformi. |

| Connettore Azure Storage | Chiave di accesso o autenticazione basata su token SAS; la struttura dei BLOB o delle cartelle deve seguire le convenzioni di Data 360. |

Gestione statale

Lo stato viene tracciato attraverso gli stream di dati e l'indicazione oraria dell'ultima esecuzione riuscita.

- Data 360 mantiene automaticamente gli stati di sincronizzazione e gli offset, assicurando che solo i file nuovi o modificati vengano elaborati nelle esecuzioni successive.

- Quando si esegue l'integrazione con strumenti ETL esterni, si consiglia di utilizzare identificatori di file univoci (ad esempio, UUID o indicazioni orarie) per evitare la duplicazione.

Scenari di integrazione complessi

Nelle architetture aziendali avanzate, questo schema può integrarsi con:

- Pipeline ETL middleware (ad esempio Informatica, MuleSoft): per orchestrare la preelaborazione, la convalida e il partizionamento dei file prima della consegna a Data 360.

- Flussi AI/ML: i dati DLO elaborati possono essere pubblicati tramite DMO per modellare gli ambienti di addestramento o gli indici RAG tramite Destinazioni attivazione Data 360.

- Sistemi transazionali: i DMO armonizzati possono attivare aggiornamenti a valle in Salesforce CRM o in sistemi esterni tramite azioni dati o eventi piattaforma.

Esempio

Un istituto finanziario globale archivia i dati dei clienti e delle transazioni in un data lake AWS S3, dove i file Parquet partizionati vengono generati nottetempo per regione (ad esempio Stati Uniti, UE e APAC). Il team dell'architettura dei dati configura più stream di dati in Data 360, ciascuno collegato a una cartella regionale, con schema_sample.csv condiviso che garantisce intestazioni e tipi di dati coerenti in tutte le partizioni. Le pianificazioni dell'inserimento notturno caricano automaticamente i dati nei DLO, dopo di che le trasformazioni dati batch aggiungono tutte le partizioni regionali in un Customer_Transactions_DLO unificato. Questa serie di dati armonizzata viene quindi mappata al modello di dati Customer 360, abilitando l'analisi a valle e l'attivazione dell'intelligenza artificiale. L'approccio offre l'inserimento automatico e affidabile dal data lake esistente, impone l'autenticazione e la crittografia avanzate in linea con le policy IT aziendali e fornisce una base modulare scalabile che supporta l'espansione futura e l'evoluzione dello schema.

Contesto

Un caso d'uso principale e critico per Data 360 è l'unificazione dei dati dei clienti in tutto l'ecosistema Salesforce. Questo schema copre l'inserimento nativo dei dati dalle piattaforme Salesforce principali, Sales Cloud e Service Cloud (collettivamente Salesforce CRM) e Marketing Cloud Engagement. Le fonti includono oggetti CRM standard e personalizzati (ad esempio Account, Referente, Caso, Opportunità) ed estensioni dati di Marketing Cloud Engagement che contengono eventi di coinvolgimento, invii di email e dati di tracciamento.

Problema

Come può un'organizzazione inserire in modo efficiente e affidabile oggetti CRM standard e personalizzati ed estensioni dati Marketing Cloud Engagement in Data 360 in modo che i dati possano essere utilizzati per creare profili cliente unificati (risoluzione dell'identità, Customer 360), mantenendo prestazioni, governance e interruzioni minime dei sistemi di origine?

Forze

I connettori nativi semplificano il lavoro, ma è necessario gestire diverse forze operative e architettoniche:

- Autorizzazioni di origine complete: Un utente di connessione dedicato (account integrazione) deve disporre delle autorizzazioni di lettura appropriate a livello di oggetto e di campo. La mancata assegnazione degli insiemi di autorizzazioni necessari (ad esempio, un insieme di autorizzazioni predefinito del connettore Data 360) è una causa comune di errore di inserimento.

- Modalità e costo di aggiornamento dei dati: I connettori supportano le modalità di aggiornamento completo e delta/incrementale. Gli aggiornamenti completi sono più pesanti per le prestazioni e i crediti; le estrazioni delta riducono il carico ma dipendono dal tracciamento affidabile delle modifiche nel sistema di origine.

- Schema personalizzato e mappatura dei campi: Le istanze CRM spesso includono oggetti/campi personalizzati. Per evitare errori di mappatura o fluttuazioni semantiche sono necessarie una mappatura e una gestione accurate dei campi personalizzati (nomi, tipi).

- Avvia pacchetti di dati rispetto a Mappatura personalizzata: I pacchetti di dati Starter accelerano l'orientamento preselezionando oggetti/campi tipici, ma le organizzazioni molto personalizzate avranno bisogno di definizioni di stream personalizzate.

- Limite di throughput e API: I limiti dell'API dell'organizzazione di origine e le percentuali di estrazione di Marketing Cloud limitano la modalità di pianificazione degli aggiornamenti.

- Igiene dei dati e convenzioni di denominazione: I nomi dei campi di origine, il comportamento nullo e i tipi di dati devono essere normalizzati prima dell'inserimento per evitare problemi di mappatura a valle.

- Sicurezza e privilegi minimi: Il connettore si basa sull'autenticazione protetta e deve rispettare gli schemi IAM con i privilegi minimi, la possibilità di controllo e i controlli di rete.

Soluzione

Questa tabella contiene le soluzioni a questo problema di integrazione.

| Area soluzioni | Adatta | Commenti / Dettagli implementazione |

|---|---|---|

| Soluzione adatta | Best | Utilizzare il connettore Salesforce CRM nativo e il connettore Marketing Cloud Engagement in Data 360\. Iniziare con i pacchetti di dati Starter per i casi d'uso standard e accelerare l'orientamento. Utilizzare la personalizzazione manuale degli stream per modelli di dati personalizzati o specifici del dominio. |

| Gestione delle istanze CRM altamente personalizzate | Migliori con il workshop di mappatura | Considerare i pacchetti Starter come base di riferimento e condurre un workshop di mappatura per identificare: Oggetti e relazioni personalizzati. Formula o campi calcolati. Estensioni di pacchetti gestiti. Per i campi formula pesanti, calcolare i valori in un ETL pre-fase o all'interno delle trasformazioni Data 360 per ridurre al minimo il carico API nelle organizzazioni di origine. |

| Quando non utilizzare | Scenari non ottimali | Evitare questo schema se: È necessario l'inserimento di eventi ad alta frequenza o in tempo reale (utilizzare invece Streaming Connectors, Platform Events o Zero-Copy Federation). L'organizzazione di origine ha una capacità API limitata e non può supportare le estrazioni pianificate senza limitazioni o ritardi nell'area di attesa. |

| Sicurezza e governance | Controlli obbligatori | Principio dei privilegi minimi: utilizzare un utente integrazione dedicato con accesso in lettura minimo. Non utilizzare mai gli amministratori dell'organizzazione. Autenticazione: utilizzare OAuth 2.0 e le applicazioni connesse; ruotare regolarmente i segreti client e monitorare l'utilizzo dei token di aggiornamento. Controllo e tracciabilità: registrare tutte le esecuzioni dell'inserimento, le modifiche dello schema e gli eventi del connettore. Inoltrare i registri a SIEM o ai sistemi di conformità per la preparazione al controllo. Classificazione dei dati: applicare il tag PII/PHI e il controllo dell'accesso basato sugli attributi (ABAC) utilizzando policy CEDAR immediatamente dopo l'inserimento per applicare mascheramento, consenso e conformità a valle. |

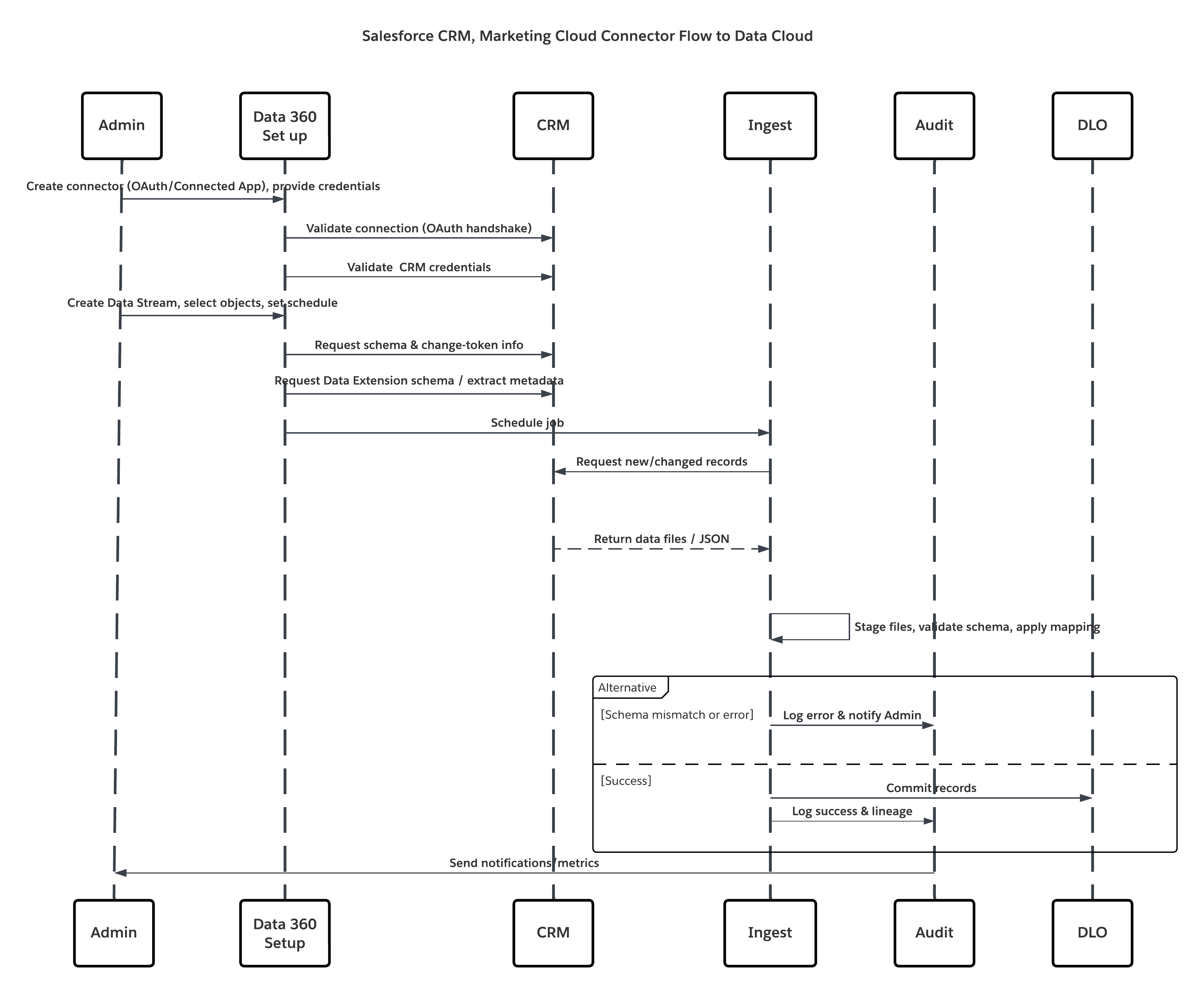

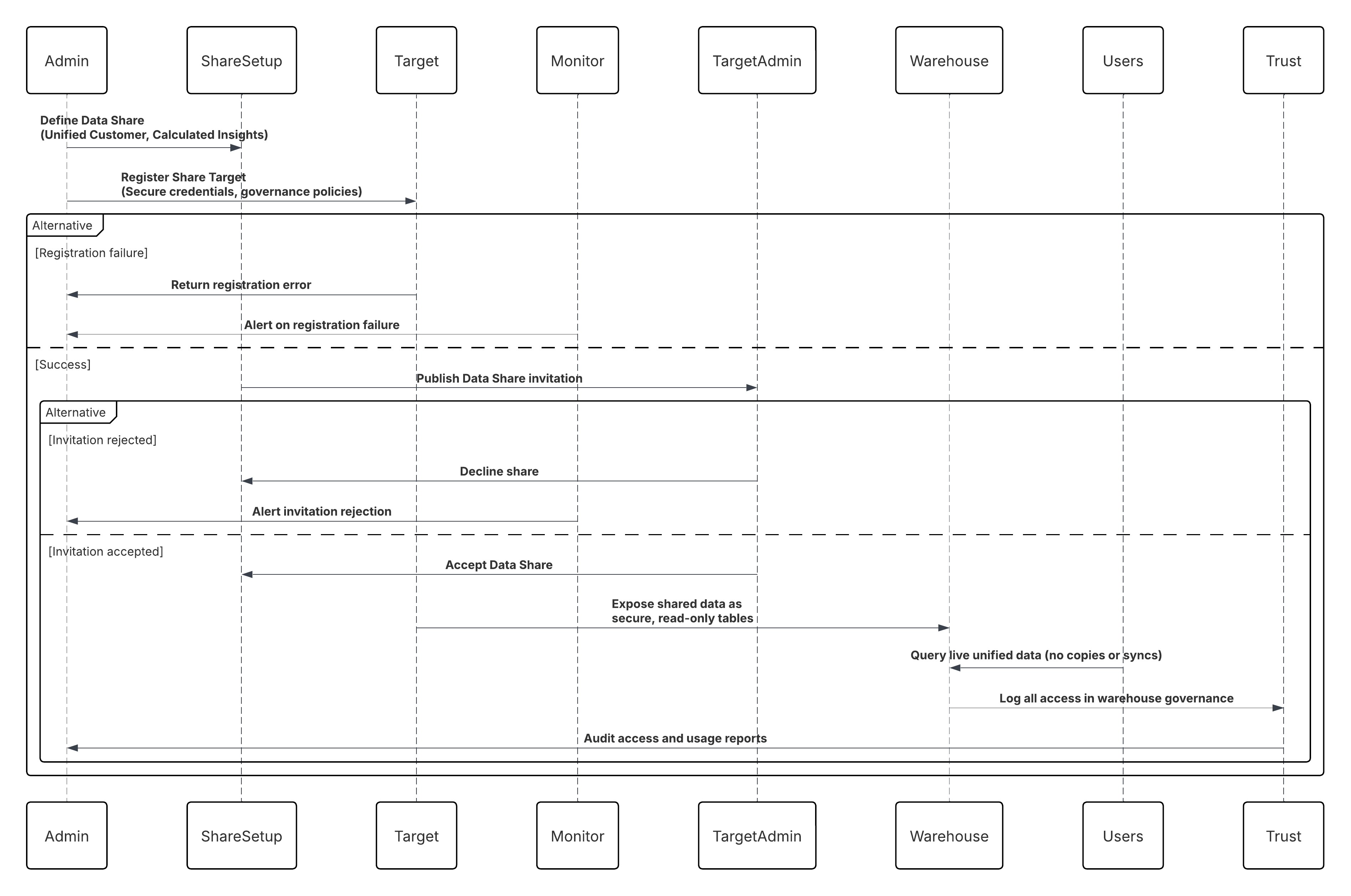

Sketch

Questo diagramma illustra la sequenza delle fasi per inserire i dati dall'archiviazione cloud in Data 360

In questo scenario:

- L'amministratore esegue provisioning e assegna gli insiemi di autorizzazioni connettore nelle organizzazioni di origine.

- L'amministratore configura i connettori in Imposta in Data 360 (si connette a Salesforce CRM e Marketing Cloud tramite OAuth/applicazione connessa).

- L'amministratore crea stream di dati selezionando oggetti ed estensioni dati, sceglie l'aggiornamento completo o delta e imposta le pianificazioni.

- All'esecuzione pianificata, Data 360 richiede lo schema e i token delta alle fonti.

- I sistemi di origine restituiscono record (delta o payload completo). Marketing Cloud può fornire estratti; CRM può restituire risultati JSON/Query.

- Data 360 inserisce file nella propria area di gestione temporanea protetta interna e li convalida in base allo schema mappato.

- Se la convalida non riesce, l'inserimento registra l'errore, avvisa l'amministratore e interrompe la conferma. Se la convalida riesce, Data 360 conferma i record in modo atomico nel DLO di destinazione.

- I registri monitoraggio e controllo vengono aggiornati con discendenza, durata dell'esecuzione, conteggi delle righe e utilizzo delle credenziali. Avvisi inviati agli amministratori se vengono attivate soglie o errori.

Risultati

I dati principali sulle relazioni con i clienti e sul coinvolgimento nel marketing vengono inseriti in Data 360 come oggetti data lake (DLO). In questo modo si ottiene:

- Serie di dati contenente profili, casi, opportunità e metriche di email/coinvolgimento.

- Fondazione per la risoluzione dell'identità e la costruzione di profili Persona unificata.

- Prontezza operativa per armonizzazione, arricchimento, modellazione AI e attivazione a valle, preservando governance e controllabilità.

Meccanismi di inserimento

Il meccanismo di inserimento dipende dal connettore e dalla strategia di pianificazione definiti in Data 360.

| Meccanismo | Quando utilizzare |

|---|---|

| Connettore Salesforce CRM (nativo) | Ideale per oggetti CRM standard/personalizzati; supporta l'aggiornamento completo e delta. |

| Connettore Marketing Cloud Engagement (nativo) | Ideale per estensioni dati, invii e tracciamento delle estrazioni; supporta le modalità full/delta. |

| Pacchetti di dati Starter | Accelerare l'orientamento per gli oggetti Sales/Service/Marketing più comuni. |

| Stream personalizzati + preelaborazione | Utilizzare quando sono necessarie trasformazioni complesse o una pesante normalizzazione dello schema. |

Gestione e ripristino degli errori

La gestione e il ripristino degli errori sono fondamentali per garantire l'affidabilità nelle operazioni di inserimento a volume elevato.

- Registri per esecuzione: Ogni esecuzione dello stream di dati fornisce dettagli su esito positivo/fallimento ed errori a livello di riga.

- Tentativi e checkpoint: Le esecuzioni non riuscite possono essere riprovate dopo aver risolto i problemi di origine o schema; Data 360 utilizza la gestione temporanea e la semantica di conferma atomica.

- Avvisi: Configurare gli avvisi per fluttuazione dello schema, errori ripetuti o interruzioni della sequenza delta.

Considerazioni sulla progettazione idempotente

L'inserimento è idempotente per progettazione: la rielaborazione degli stessi non genera record duplicati. Le strategie chiave includono:

- Rilevamento modifiche: Le estrazioni delta si basano sugli indicatori di modifica del sistema di origine (LastModifiedDate / acquisizione dati di modifica del sistema). Verificare che l'origine fornisca indicazioni orarie/flag affidabili.

- Deduplicazione: Utilizzare chiavi aziendali univoche (ad esempio Contact.ExternalId) per deduplicare o inserire con aggiornamento nei DLO.

- Impegno transazionale: I record vengono impostati e confermati solo quando l'elaborazione batch viene completata correttamente.

Considerazioni sulla sicurezza

La sicurezza è fondamentale in tutta la pipeline di inserimento, dall'autenticazione alla crittografia e al controllo degli accessi.

- Autenticazione e autorizzazione: I connettori utilizzano il framework di integrazione sicura di Salesforce, che sfrutta le credenziali denominate e le credenziali esterne per l'autenticazione senza esporre segreti.

- Crittografia: I dati vengono crittografati in transito (TLS 1.2+) e a riposo (AES-256).

- Controlli di rete: I sistemi di archiviazione di origine (ad esempio, i bucket S3) devono inserire nell'elenco consentiti gli IP di Data 360.

- Allineamento conformità: Supporta i framework di protezione dei dati aziendali come GDPR, HIPAA e le linee guida FFIEC se abbinati alle chiavi gestite dal cliente (CMK).

- Controllabilità: Ogni processo di inserimento e accesso alle credenziali viene registrato per la tracciabilità e la creazione di rapporti sulla conformità

Intestazioni laterali

Tempestività

La tempestività dipende dalla pianificazione dell'inserimento e dal volume dei dati.

- La cadenza ideale dipende dalle esigenze aziendali: oraria per i trigger di marketing quasi in tempo reale, notturna per le riconciliazioni di grandi dimensioni.

- Le modalità delta riducono il carico e i costi; gli aggiornamenti completi sono più pesanti e vengono utilizzati per i caricamenti iniziali o per le modifiche principali dello schema.

Volumi di dati

- I connettori CRM sono ottimizzati per le serie di dati transazionali e a volume medio (milioni di record).

- Per volumi storici estremamente grandi, considerare l'opzione ETL in più passaggi per partizionare e caricare in più passaggi.

Supporto della capacità e degli standard degli endpoint

La funzionalità e il supporto standard per l'endpoint dipendono dalla soluzione scelta.

| Connettore | Requisiti degli endpoint |

|---|---|

| Connettore Salesforce CRM | L'organizzazione di origine deve consentire un'applicazione connessa, token OAuth e un utente integrazione dedicato con autorizzazioni di lettura. |

| Connettore Marketing Cloud | Credenziali API Marketing Cloud o pacchetto installato; le estensioni dati devono esporre i dati tramite Estrazioni/API. |

Gestione statale

- Stato connettore: Gli stream di dati mantengono le indicazioni orarie e gli offset delta dell'ultima sincronizzazione riuscita.

- Strategia chiave principale: Preferire identificatori aziendali coerenti (ID esterni) in modo che la riconciliazione a valle e gli inserimenti con aggiornamento siano deterministici.

Scenari di integrazione complessi

Nelle architetture aziendali avanzate, questo schema può integrarsi con:

- Topologie ibride: Combinare l'inserimento CRM con lo streaming (Eventi piattaforma) per aggiornamenti quasi in tempo reale.

- Orchestrazione middleware: Utilizzare gli strumenti MuleSoft o ETL quando è necessaria un'orchestrazione, un arricchimento o una pre-inserimento di trasformazioni complessi.

- Loop di feedback di attivazione: I DMO armonizzati possono attivare aggiornamenti a valle dei sistemi di origine tramite azioni dati o API piattaforma (attenzione ai controlli SoD).

Esempio

Un rivenditore multinazionale consolida le metriche di coinvolgimento di Account, Referenti, Casi, Opportunità e Marketing Cloud in Data 360 per creare una visualizzazione cliente unificata. Lo Starter Data Bundle inizializza gli oggetti Sales and Service principali, mentre il team estende il modello con campi personalizzati come Loyalty_Membershipc e Customer_Tierc per acquisire il contesto fedeltà. Gli stream di dati CRM vengono eseguiti ogni ora in modalità delta e Marketing Cloud Engagement viene sincronizzato ogni giorno utilizzando le estrazioni delta per gli eventi di coinvolgimento. Queste serie di dati vengono elaborate tramite DLO e risoluzione dell'identità, creando un profilo cliente unificato che combina i segnali CRM e di coinvolgimento per potenziare la personalizzazione e i modelli di intelligenza artificiale a valle.

Questi schemi vengono creati per gli scenari in cui i millisecondi contano, ovvero quando le interazioni, le transazioni o i segnali dei clienti devono attivare approfondimenti o azioni immediate. Vanno oltre l'inserimento batch pianificato tradizionale per abilitare il flusso di dati basato sugli eventi, in cui le informazioni vengono elaborate nel momento in cui vengono generate. Nell'ecosistema Salesforce Data 360, "real-time" non è una modalità singola, ma un continuum di modelli di latenza. Da un lato si trova la sincronizzazione quasi in tempo reale, in cui gli aggiornamenti dei sistemi di registrazione (come CRM o ERP) si riflettono in Data 360 in pochi secondi o minuti. Dall'altro lato è l'acquisizione evento in tempo reale, in cui i segnali comportamentali lato client, ad esempio clic, acquisti o interazioni mobili, vengono inseriti e attivati in millisecondi. Per gli architetti, la distinzione è più che semantica. Definisce come vengono progettate le opportunità in corso di realizzazione, come vengono richiamate le API e come vengono prese le decisioni a valle. La selezione dello schema corretto, che si tratti di sincronizzazione quasi in tempo reale o inserimento di stream di eventi, garantisce che il sistema soddisfi gli obiettivi di latenza operativa dell'azienda mantenendo l'integrità, la scalabilità e la governance dei dati.

Contesto

Questo schema consente a qualsiasi sistema esterno, ad esempio un'applicazione personalizzata, una piattaforma Internet delle cose (IoT), un sistema POS o un servizio di terze parti, di inviare a livello di programmazione i dati degli eventi in Data 360 quasi in tempo reale quando si verificano eventi discreti.

Problema

Come può uno sviluppatore inviare in modo affidabile singoli record o piccoli batch asincroni di eventi da un'applicazione esterna a Data 360 con bassa latenza in modo che i dati siano disponibili rapidamente per l'elaborazione, la segmentazione e l'attivazione?

Forze

Questo schema offre una latenza bassa e un migliore controllo da parte dello sviluppatore, ma introduce diversi vincoli tecnici e dipendenze operative:

- Dipendenza sviluppatore: Richiede lo sforzo dello sviluppatore per implementare client API REST autenticati e logica di errore/riprovare: non è un connettore "point-and-click".

- Schema rigoroso in scrittura: L'API di inserimento impone lo schema in scrittura. È necessario definire uno schema preciso e caricarlo nella configurazione del connettore; tutti i payload devono essere esattamente conformi o essere rifiutati.

- Modalità di doppia interazione: Lo stesso connettore supporta sia lo streaming (JSON) per gli aggiornamenti record per record a bassa latenza, sia l'aggiornamento in blocco (CSV) per le sincronizzazioni periodiche più grandi.

- Autenticazione e sicurezza: Le chiamate devono essere autenticate tramite un'applicazione connessa Salesforce utilizzando OAuth 2.0 (ad esempio, flusso bearer JWT per server a server). La gestione dei token, la rotazione e gli ambiti con privilegi minimi sono obbligatori.

- Visibilità operativa: Gli sviluppatori e i team piattaforma devono implementare il monitoraggio per i codici di risposta, i tentativi, le aree di attesa a lettere non valide e gli avvisi di fluttuazione dello schema.

- Requisito del grafico in tempo reale: Per un'attivazione istantanea vera (segmentazione istantanea, mappatura DMO in tempo reale), l'oggetto modello di dati (DMO) di destinazione deve far parte del grafico dei dati in tempo reale; in caso contrario, gli eventi attraversano una pipeline con latenza leggermente superiore.

Soluzione

Questa tabella contiene le soluzioni a questo problema di integrazione.

| Area soluzioni | Adatta | Commenti / Dettagli implementazione |

|---|---|---|

| Soluzione adatta | Ideale per l'acquisizione di eventi a bassa latenza | Utilizzare l'API inserimento Data 360 (JSON streaming) per inviare tramite push singoli eventi o micro batch. Configurare il connettore API di inserimento con uno schema OAS 3.0 rigoroso (.yaml). Utilizzare l'inserimento CSV in blocco per sincronizzazioni più grandi e meno frequenti. |

| Gestione delle modifiche dello schema | Rigoroso / Gestito | Le modifiche dello schema si stanno interrompendo: aggiornare il file .yaml OAS, modificare il connettore ed eseguire i test dei contratti. Implementare la migrazione dello schema continuativo se i produttori non possono modificare contemporaneamente. |

| Quando non utilizzare | Non ottimale | Non è ideale se è necessaria una preelaborazione (es:deduplicazione, ordine garantito, ecc.) o per carichi in blocco molto grandi (utilizzare connettori in blocco nativi o batch ETL). Se l'origine non è in grado di generare payload validi per lo schema o non è in grado di eseguire l'autenticazione in modo sicuro, utilizzare metodi di inserimento alternativi. |

| Sicurezza e governance | Obbligatorio | Utilizzare OAuth 2.0 con ambiti con privilegi minimi, ruotare le chiavi, registrare l'utilizzo dei token. Applicare TLS 1.2+, convalidare gli IP client se necessario e garantire la creazione di tag delle informazioni personali del payload. Tutti gli eventi devono contenere metadati di provenienza (origine, indicazione oraria, versione dello schema, chiave idempotency). |

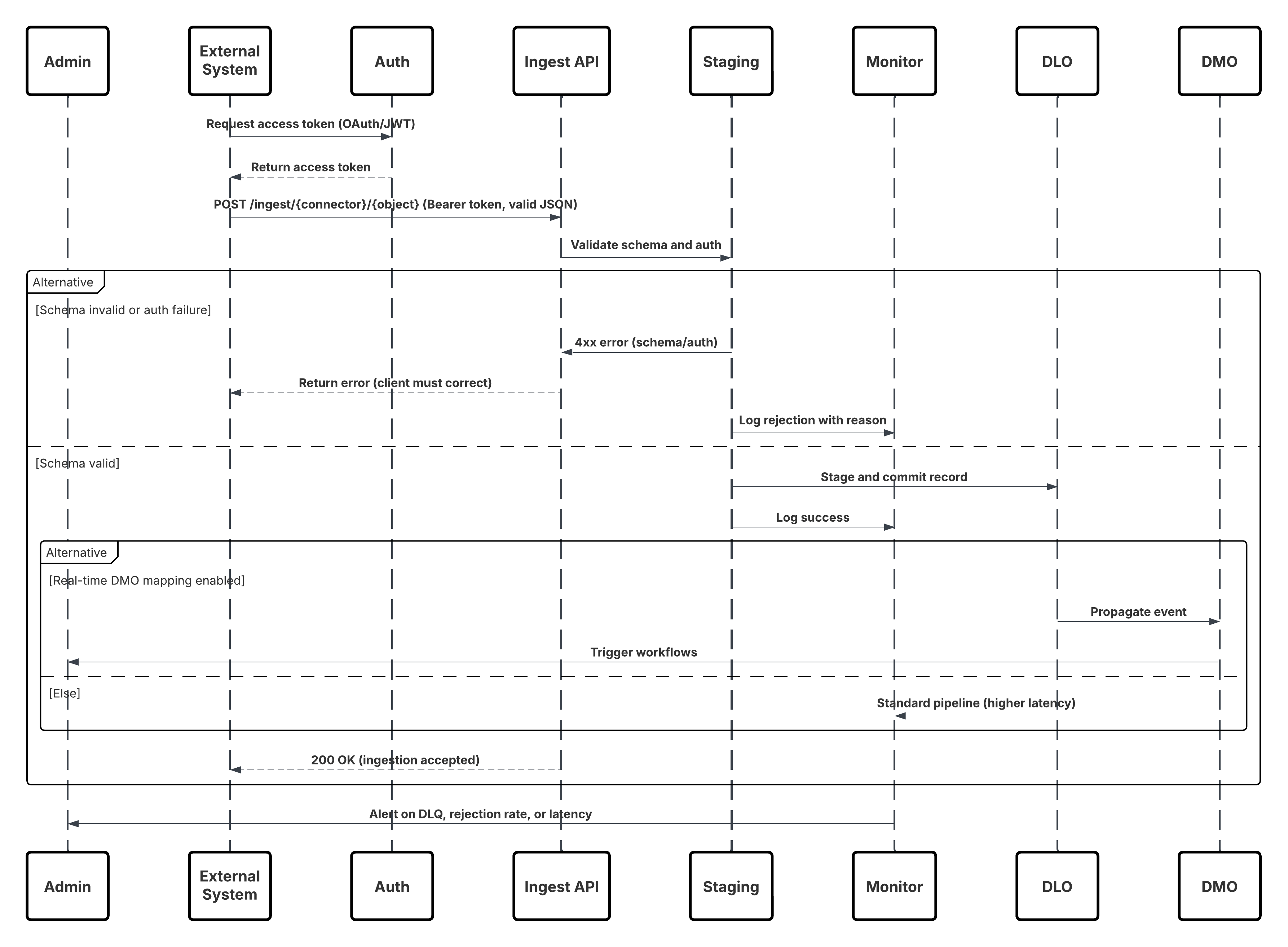

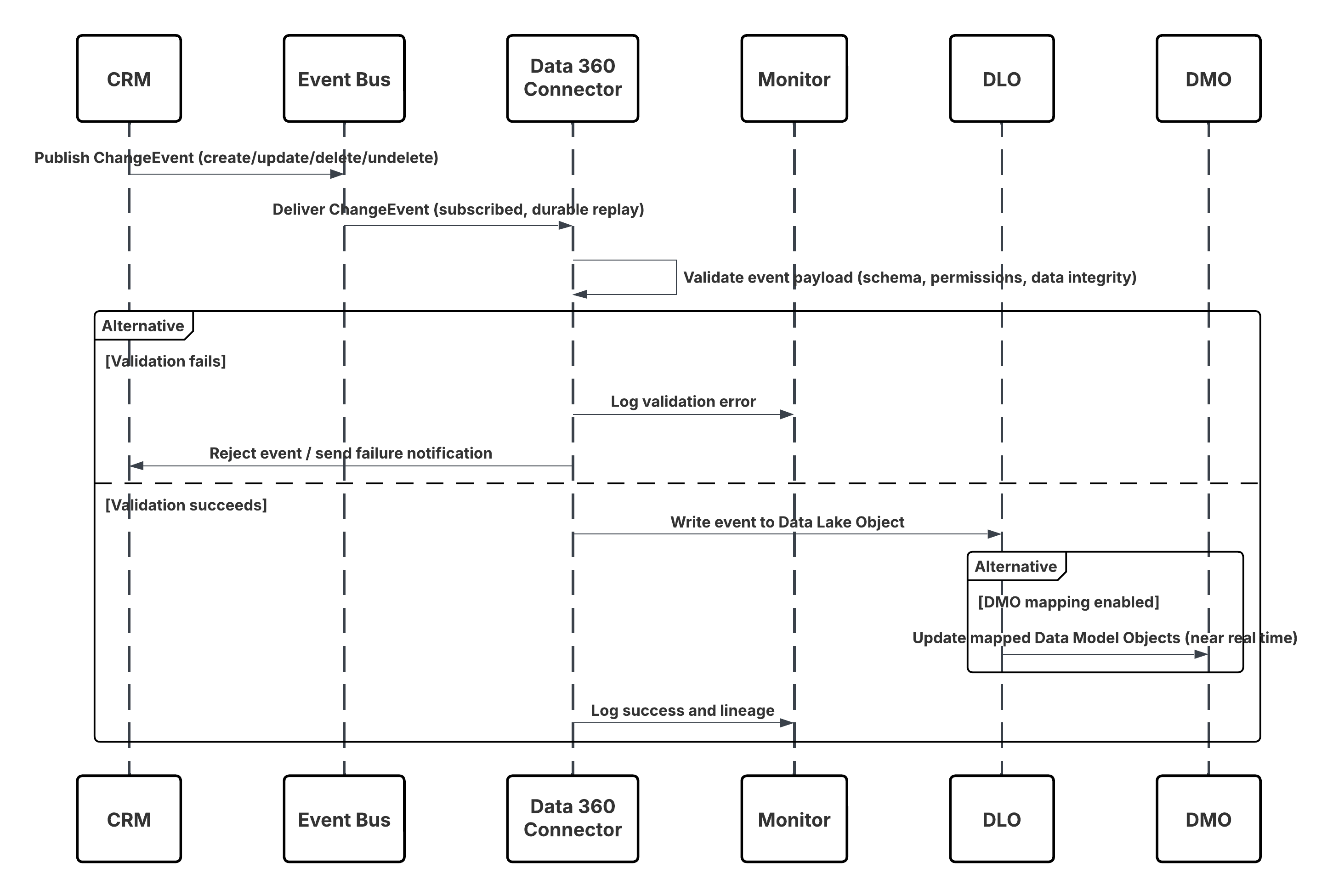

Sketch

Questo diagramma illustra la sequenza delle fasi per inserire i dati dall'API di inserimento in Data 360

In questo scenario:

- Sistema esterno richiede l'autenticazione tramite OAuth/JWT dal server di autenticazione.

- Il server di autenticazione restituisce il token di accesso al sistema esterno.

- Sistema esterno invia la richiesta POST di inserimento dati all'API di inserimento Data 360 con autorizzazione e payload JSON.

- L'API di inserimento convalida lo schema della richiesta e l'autenticazione tramite il modulo Staging & Validation (Stage e convalida).

- In caso di errore di schema/autenticazione:

- Errore restituito al sistema esterno.

- Rifiuto registrato per il monitoraggio e l'avviso.

- In caso di convalida riuscita:

- Record inseriti e confermati nell'oggetto data lake (DLO).

- Riuscito registrato per il monitoraggio.

- Se abilitata, la propagazione dei dati al grafico dati in tempo reale (DMO) attiva flussi di lavoro a valle.

- In caso contrario, i dati elaborati tramite batch standard o pipeline a latenza più alta.

- L'API di inserimento conferma l'esito positivo di Sistema esterno.

- Avviso sui componenti di monitoraggio Amministratore in caso di aree di attesa senza risposta, percentuali di rifiuto o problemi di latenza.

Risultati

I dati degli eventi esterni vengono inseriti nei DLO di Data 360 con bassa latenza. Quando il DMO di destinazione fa parte del grafico in tempo reale, i dati sono disponibili per la segmentazione istantanea, i flussi di lavoro degli agenti, i modelli AI e l'attivazione operativa. Ciò consente risposte aziendali rapide agli eventi provenienti da qualsiasi sistema connesso.

Meccanismi di inserimento

Il meccanismo di inserimento dipende dal connettore e dalla strategia di pianificazione definiti in Data 360.

| Meccanismo | Quando utilizzare |

|---|---|

| Streaming JSON (API di inserimento) | Eventi singoli, micro batch, eventi comportamentali, stream di clic, telemetria IoT, quando è richiesta una latenza bassa. |

| CSV in blocco (modalità in blocco dell'API di inserimento) | Caricamenti periodici più ampi in cui i requisiti di latenza vengono ridotti. |

| Bordio / middleware | Utilizzare quando è necessaria la convalida, la trasformazione, l'arricchimento o la limitazione della percentuale prima di passare all'API di inserimento. |

Gestione e ripristino degli errori

- Errori immediati di (sincronizzazione): 4xx risposte per errori di schema/autenticazione: il client deve correggere il payload o il token e riprovare.

- Errori temporanei (asincroni): 5xx risposte: il client tenta di ripetere con backoff e jitter esponenziali.

- Area di attesa a lettere morte (DLQ): Gli errori persistenti vengono visualizzati in DLQ per l'ispezione manuale e il replay.

- Monitoraggio: Tenere traccia della percentuale di rifiuto dello schema, degli errori di autenticazione, dei percentili di latenza e dell'arretrato DLQ. Avviso sulle soglie.

Considerazioni sulla progettazione idempotente

- Chiave impotenza: Ogni evento deve includere una chiave idempotency/ID messaggio univoci.

- Aggiorna strategia di inserimento: Utilizzare le chiavi aziendali (ExternalId) per evitare duplicati sui replay.

- Finestra di Dundeup: L'architetto deve definire le finestre di deduplica e la conservazione per il tracciamento dell'impotenza.

Considerazioni sulla sicurezza

La sicurezza è fondamentale in tutta la pipeline di inserimento, dall'autenticazione alla crittografia e al controllo degli accessi.

- Autenticazione: OAuth 2.0 (JWT Bearer) consigliato da server a server. Limitare gli ambiti solo all'inserimento.

- Crittografia: TLS 1.2+ per il trasporto; Data 360 applica la crittografia a riposo.

- Privilegio minimo: Le credenziali dell'applicazione connessa hanno diritti minimi; ruotano i segreti e i registri di accesso agli strumenti.

- Payload Governance: Includere flag consenso/consumo nei metadati degli eventi; applicare le policy ABAC/CEDAR immediatamente dopo l'inserimento.

- Controlli IP / Private Connect: Ove necessario, limitare l'accesso tramite elenchi consentiti o utilizzare Private Connect per la rete privata.

Intestazioni laterali

Tempestività

La tempestività dipende dalla pianificazione dell'inserimento e dal volume dei dati. Il JSON in streaming restituisce una latenza da subsecondi a secondi a seconda dell'elaborazione e della configurazione del grafico. CSV in blocco è da minuti a ore. Scegliere in base agli SLA aziendali.

Volumi di dati

Le dimensioni dei singoli eventi devono essere piccole (< pochi KB). Per i produttori a elevata produttività, valutare la possibilità di creare batch presso il produttore o di utilizzare un buffer streaming (Kafka/Kinesis) prima di chiamare l'API.

Gestione statale

- Versione schema: Mantenere la versione dello schema nei metadati degli eventi e utilizzare il controllo delle versioni del connettore quando si aggiorna il contratto OAS.

- Offset connettore: Data 360 gestisce la semantica di conferma; i produttori devono tenere traccia delle chiavi di impotenza e dell'ultima sequenza riuscita per una riproduzione sicura.

Scenari di integrazione complessi

Nelle architetture aziendali avanzate, questo schema può integrarsi con:

- Livello convalida bordo: Utilizzare il middleware per tradurre formati di produttori eterogenei nel contratto OAS richiesto, eseguire la limitazione delle percentuali e il pre-arricchimento.

- Architetture ibride: Combinare l'API di inserimento per gli eventi e i connettori per la riconciliazione in blocco.

- Attivazione agente: Gli eventi mappati in DMO in tempo reale possono attivare flussi di lavoro Agentforce e modelli Einstein per le decisioni automatiche.

Esempio

Una catena di vendita al dettaglio trasmette in streaming gli eventi di acquisto POS in Data 360 in tempo reale per favorire il coinvolgimento immediato dei clienti. Ogni punto vendita esegue un componente server leggero che raccoglie le transazioni, le arricchisce con i metadati della posizione e del dispositivo e pubblica in modo sicuro eventi JSON utilizzando JWT Bearer OAuth con chiavi idempotency per evitare duplicati. Un amministratore definisce la struttura degli eventi caricando uno schema OAS per il punto vendita e configurando il connettore API di inserimento. Gli eventi in entrata vengono inseriti nel DLO pos_sale, mappati al DMO Vendita e aggiunti al grafico in tempo reale. Di conseguenza, gli acquisti di valore elevato vengono rilevati immediatamente, attivando flussi di lavoro VIP in Agentforce e aggiornando la segmentazione dei clienti per favorire la personalizzazione in tempo reale.

Contesto

Questo schema consente di acquisire dati granulari a volume elevato sulle interazioni degli utenti, ad esempio visualizzazioni di pagina, clic su pulsanti, impressioni sui prodotti e riproduzioni video, da siti Web e applicazioni mobili in trueReal-Time. È fondamentale per offrire una personalizzazione immediata, in cui ogni interazione digitale può influenzare dinamicamente l'esperienza utente e favorire il coinvolgimento.

Problema

Come può un'azienda acquisire ed elaborare un flusso continuo di eventi comportamentali dalle proprietà digitali, che coprono milioni di interazioni utente al minuto, e rendere immediatamente disponibili tali dati in Data 360 per favorire la segmentazione, la personalizzazione e l'attivazione in tempo reale?

Forze

Questo caso d'uso presenta diverse sfide di progettazione che richiedono un'architettura di inserimento appositamente creata a bassa latenza:

- Extreme Throughput : I siti Web o le app mobili a traffico elevato possono generare milioni di eventi al minuto. Lo strato di inserimento deve scalare orizzontalmente per gestire questo volume senza perdita di evento o contropressione, garantendo una latenza costante sotto i picchi di carico.

- Strumentazione lato cliente: A differenza delle integrazioni basate sul server, questo schema dipende dagli SDK lato client. In ogni pagina deve essere incorporato un beacon JavaScript (Salesforce Interactions SDK) o un SDK nativo integrato nelle app mobili. Ciò richiede una solida distribuzione client, il controllo delle versioni e la governance dello schema degli eventi.

- Elaborazione degli eventi a bassa latenza: Le azioni degli utenti, ad esempio "aggiungi al carrello" o "riproduci video", devono raggiungere Data 360 in pochi secondi, abilitando l'attivazione in tempo reale e le risposte contestuali (ad esempio offerte mirate, consigli personalizzati).

- Armonizzazione dei dati e risoluzione dell'identità: Gli eventi acquisiti spesso includono identificatori anonimi (cookie, ID dispositivo, token di sessione). Per ottimizzare i casi d'uso Customer 360, questi devono essere mappati ai profili noti tramite la risoluzione dell'identità di Data 360 e armonizzati con il modello di dati Customer 360.

Soluzione

L'approccio consigliato è utilizzare il connettore Salesforce Marketing Cloud Personalizzazione, una pipeline di streaming completamente gestita progettata per l'inserimento comportamentale ad alta produttività.

| Area soluzioni | Adatta | Commenti / Dettagli implementazione |

|---|---|---|

| Acquisizione evento basata su SDK | Best | Distribuire Salesforce Interactions SDK (web) o SDK nativo (mobile). Queste librerie leggere acquisiscono e serializzano le interazioni degli utenti in tempo reale, allegando metadati (ID sessione, indicazione oraria, contesto). |

| Streaming di eventi in corso di realizzazione | Best | Gli eventi vengono inviati al servizio di streaming eventi di Personalizzazione Marketing Cloud su HTTPS protetto. Questo livello è scalabile orizzontalmente e ottimizzato per la trasmissione a bassa latenza (<2s). |

| Integrazione con Data 360 | Best | Il connettore Personalizzazione di Data 360 si abbona al feed in streaming, inserendo ogni evento in un oggetto data lake (DLO) in nearReal-Time. |

| Mappatura del modello di dati | Best Practice | Il DLO inserito viene mappato agli oggetti modello di dati (DMO) Customer 360. Ciò consente di collegare utenti anonimi e noti tramite la risoluzione dell'identità. |

| Abilitazione del grafico in tempo reale | Facoltativo / Consigliato | Includere i DMO mappati nel grafico in tempo reale per una segmentazione istantanea, attivando azioni personalizzate tramite flussi di lavoro Einstein o Agentforce. |

| Quando non utilizzare | Non ottimale | Questo schema non è ideale quando: I dati di origine sono client Web ed eventi (utilizzare invece l'API di inserimento). L'organizzazione non ha il controllo sui client Web/mobili. Il tracciamento del comportamento in tempo reale non è necessario (utilizzare l'inserimento batch). |

| Gestione delle modifiche dello schema | Evoluzione gestita | Gli schemi degli eventi evolvono man mano che vengono aggiunte nuove interazioni. Gli SDK devono eseguire la versione delle definizioni degli eventi. Le modifiche compatibili con le versioni precedenti (aggiunta di campi facoltativi) sono sicure; l'interruzione delle modifiche richiede la riconfigurazione del connettore e il test del contratto. |

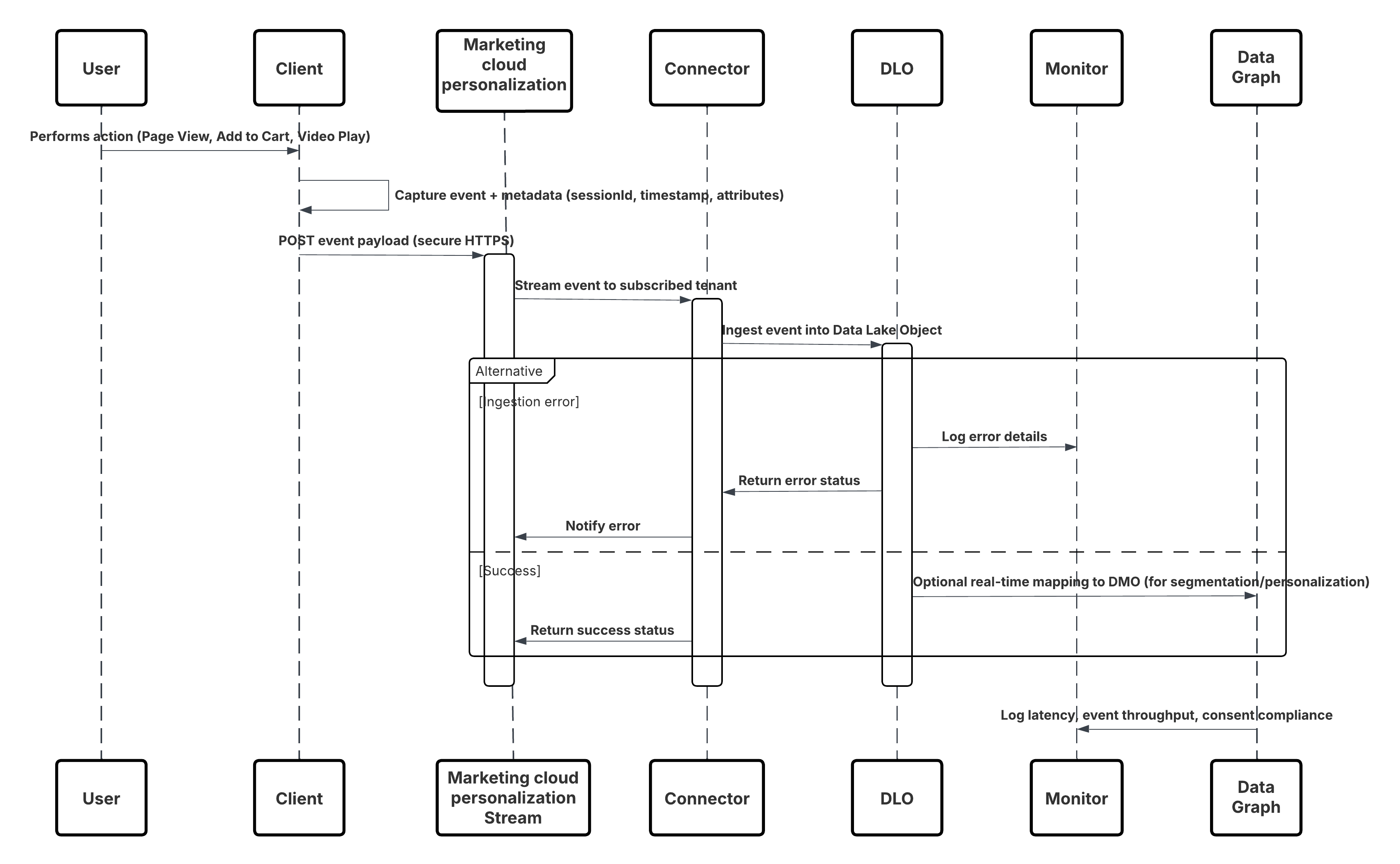

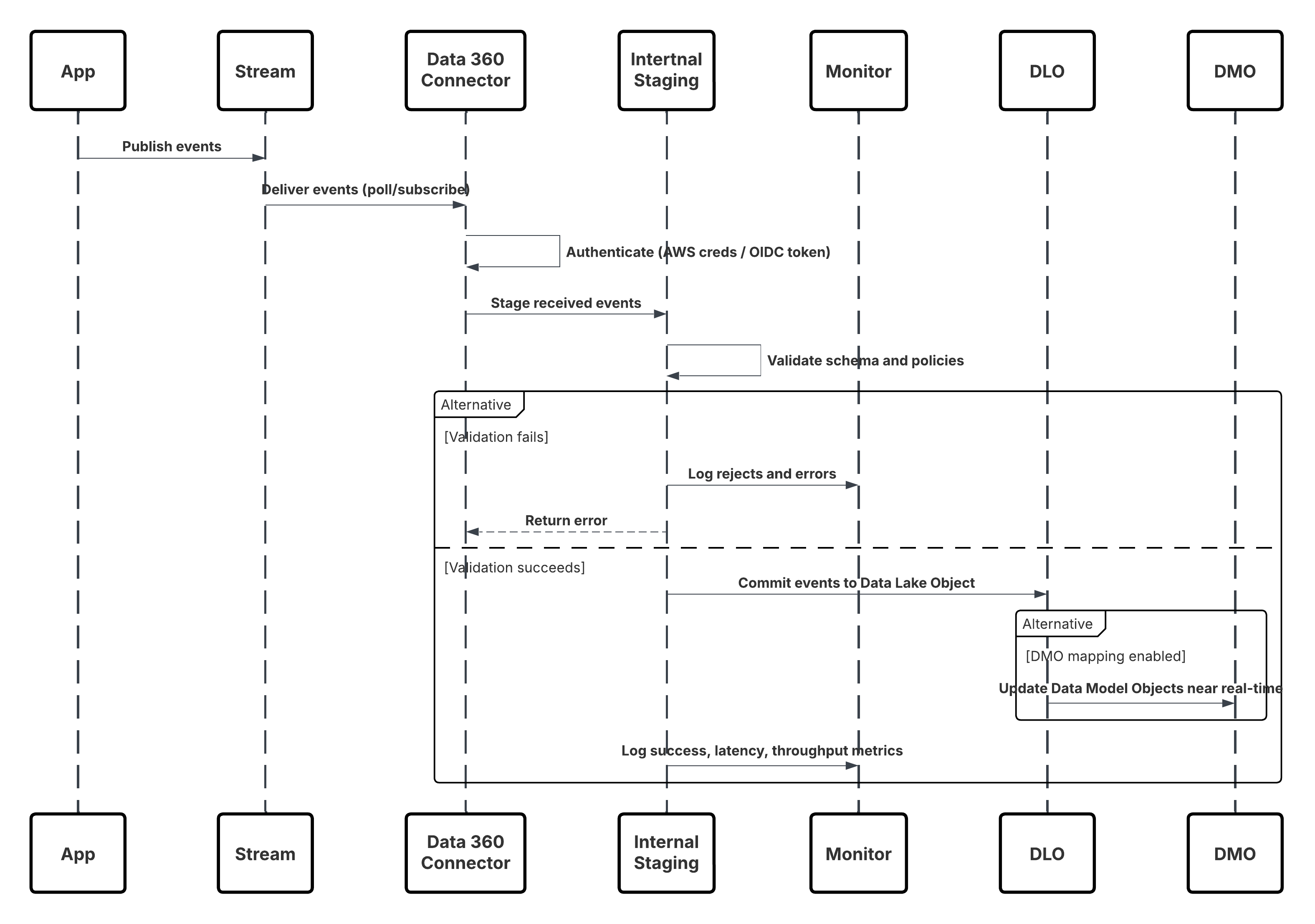

Sketch

Questo diagramma illustra la sequenza delle fasi per inserire i dati dai canali Web e mobili in Data 360

In questo scenario:

- Distribuire l'SDK nei canali Web o mobili (acquisizione dell'interazione utente).

- Configurare SDK con ID tenant, ambiente e controlli consenso.

- Inviare in streaming gli eventi JSON acquisiti (metadati + attributi) all'endpoint di streaming di Marketing Cloud.

- In Imposta in Data 360, creare e configurare il connettore Personalizzazione per il tenant.

- Inserire gli eventi in un DLO e mappare il DLO → DMO in Data 360.

- Abilitare il DMO nel grafico in tempo reale per l'attivazione immediata.

- Monitorare la latenza, la conformità dello schema, i flag di consenso, la produttività, le percentuali di errore.

- Distribuire in produzione e monitorare continuamente.

Risultati

Un flusso continuo a bassa latenza di eventi comportamentali fluisce dai canali digitali a Data 360. In pochi secondi, ogni azione utente diventa disponibile per la segmentazione in tempo reale, la modellazione predittiva o la personalizzazione attivata, abilitando esperienze cliente davvero adattive.

Meccanismi di inserimento

Il meccanismo di inserimento dipende dal connettore e dalla strategia di pianificazione definiti in Data 360.

| Meccanismo | Quando utilizzare |

|---|---|

| Interactions SDK (Web) | Acquisizione in tempo reale da browser Web e SPA. |

| SDK mobile | Acquisizione in tempo reale da applicazioni mobili native. |

| Connettore Personalizzazione | Abbonamento gestito tra Marketing Cloud e Data 360\. |

| Mappatura del grafico in tempo reale | Abilita l'attivazione immediata in Segmentazione, Einstein e Journey. |

Gestione e ripristino degli errori

- Tolleranza dei guasti a livelli: Implementare meccanismi di convalida e riprovazione a più livelli: gli SDK client gestiscono gli errori temporanei con backoff esponenziale, mentre il livello di inserimento utilizza aree di attesa durevoli e opportunità in corso di realizzazione riproducibili per evitare la perdita di dati.

- Schema e governance dei dati: Versionare e convalidare gli schemi degli eventi in modo continuo; gli eventi non validi o in evoluzione vengono instradati a un rifiuto schema o a un'area di attesa a lettere morte per un triage e un replay sicuri.

- Impotenza e deduplicazione: Utilizzare identificatori di evento stabili e semantica di inserimento con aggiornamento per garantire l'elaborazione esatta anche durante i tentativi o i replay.

- Monitoraggio e ripristino Automazione: Il monitoraggio continuo di produttività, latenza e percentuali di errore attiva flussi di lavoro di ripristino automatici, garantendo bassa latenza, consegna affidabile e risultati di personalizzazione coerenti in tempo reale.

Considerazioni sulla progettazione idempotente

- Ogni evento deve contenere una chiave di impotenza univoca o un ID messaggio in modo che gli invii duplicati possano essere deduplicati a valle.

- Utilizzare le chiavi aziendali (ad esempio sessionID + eventTimestamp + userID) ove appropriato per identificare i duplicati.