Les intégrations Salesforce modernes doivent prendre en charge bien plus que le simple échange de données. Ils sont censés piloter l'expérience client en temps réel, coordonner les actions entre plusieurs systèmes et fonctionner de façon fiable à l'échelle de l'entreprise, le tout en respectant des exigences strictes de sécurité et de conformité. Le choix de la bonne approche d'intégration est donc une décision architecturale critique, pas un détail d'implémentation. Prenons un scénario d'entreprise courant. Un client effectue un achat dans une application mobile, déclenchant un contrôle d'éligibilité en temps réel pour une offre personnalisée. Parallèlement, les données des transactions doivent être enregistrées dans un système ERP, les attributs des clients mis à jour dans Salesforce et les analytiques transmises à un lac de données, sans introduire de latence, de duplication des données ou de risque de conformité. De tels scénarios sont désormais typiques dans les environnements Salesforce modernes, où Salesforce fonctionne rarement de façon isolée et doit s'intégrer de façon transparente à un écosystème élargi d'applications et de plates-formes de données. Ce guide existe pour aider les architectes et les développeurs à concevoir ces intégrations avec clarté et confiance. Au lieu de se concentrer sur les implémentations de point à point, il présente une série de modèles d'intégration éprouvés qui répondent à des scénarios d'entreprise récurrents, tels que l'orchestration de processus, la synchronisation des données et l'accès aux données en temps réel. Chaque modèle met l'accent sur l'intention architecturale, les compromis et les modèles d'exécution, ce qui permet aux équipes de prendre des décisions de conception informées, adaptées et durables. Dans ce document, vous trouverez :

- Modèles d'intégration qui représentent des « archétypes » d'entreprise communs dans les scénarios de processus, de données et d'accès virtuel

- Un cadre de sélection de schéma pour aider à identifier l'approche appropriée basée sur l'intention d'intégration et le calendrier d'exécution

- Considérations pratiques sur l'évolutivité, la résilience, la gouvernance et la sécurité

- Meilleures pratiques tirées des implémentations Salesforce et Data 360 réelles L'objectif de ce document est de fournir un langage architectural partagé pour l'intégration, en aidant les équipes à concevoir des solutions qui concilient performance, flexibilité et Trust tout en s'alignant avec les données de l'entreprise et les stratégies de gouvernance.

Ce document s'adresse aux concepteurs et aux architectes qui doivent intégrer les données d'autres applications de leur entreprise à Salesforce Data 360 (anciennement Data Cloud). Ce contenu est une distillation de nombreuses implémentations réussies par des architectes et partenaires Salesforce. Pour vous familiariser avec les capacités d'intégration et les options disponibles pour l'adoption à grande échelle de Data 360, lisez les sections Résumé du schéma et Guide de sélection de schéma ci-dessous . Les architectes et les développeurs doivent prendre en compte ces détails de schéma et les meilleures pratiques pendant la phase de conception et d'implémentation des projets d'interaction de données dans Data 360. S'ils sont correctement implémentés, ces modèles permettent d'accéder à la production le plus rapidement possible et d'utiliser l'ensemble d'applications le plus stable, évolutif et sans maintenance possible. Les architectes-conseils Salesforce utilisent ces modèles comme points de référence lors des examens architecturaux, et les entretiennent et les améliorent activement. Comme avec tous les schémas, ce contenu couvre la plupart des scénarios d'intégration, mais pas tous. Salesforce autorise par exemple l'intégration d'interface utilisateur (interface utilisateur), mais cette intégration n'entre pas dans le champ d'application de ce document.

Chaque modèle d'intégration suit une structure cohérente. Cela permet de fournir des informations cohérentes dans chaque modèle et facilite également la comparaison.

- Nom: L'identificateur du modèle qui indique également le type d'intégration contenu dans le modèle.

- Contexte : Le scénario d'intégration global que le schéma traite. Contexte fournit des informations sur ce que les utilisateurs tentent d'accomplir et sur le comportement de l'application pour satisfaire aux exigences.

- Problème : Exprimé sous forme de question, c'est le scénario que le schéma est conçu pour résoudre. Lisez cette section pour comprendre si le schéma convient à votre scénario d'intégration.

- Forces : Les contraintes et les circonstances qui rendent le scénario énoncé difficile à résoudre.

- Solution : La méthode recommandée pour résoudre le scénario d'intégration.

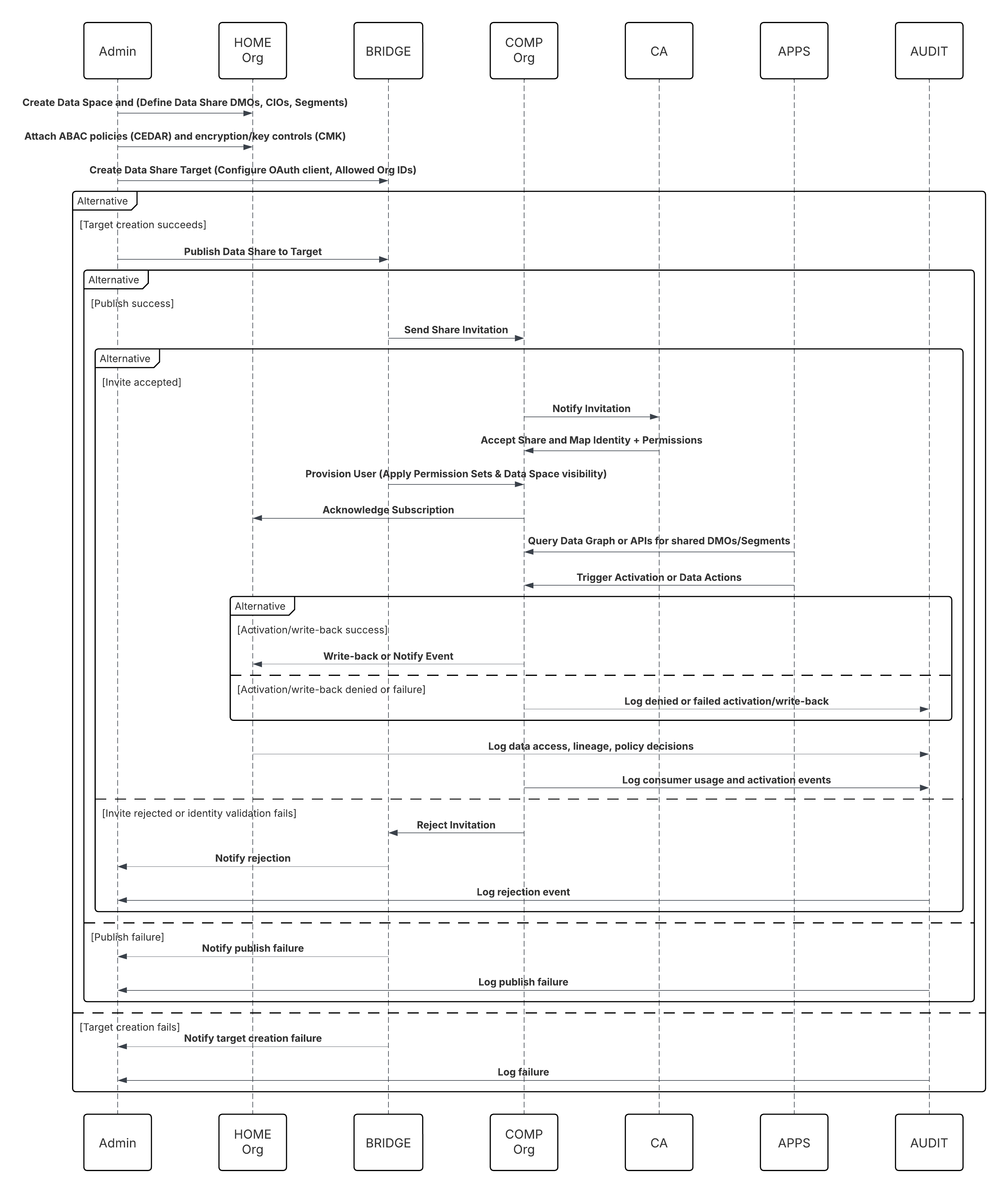

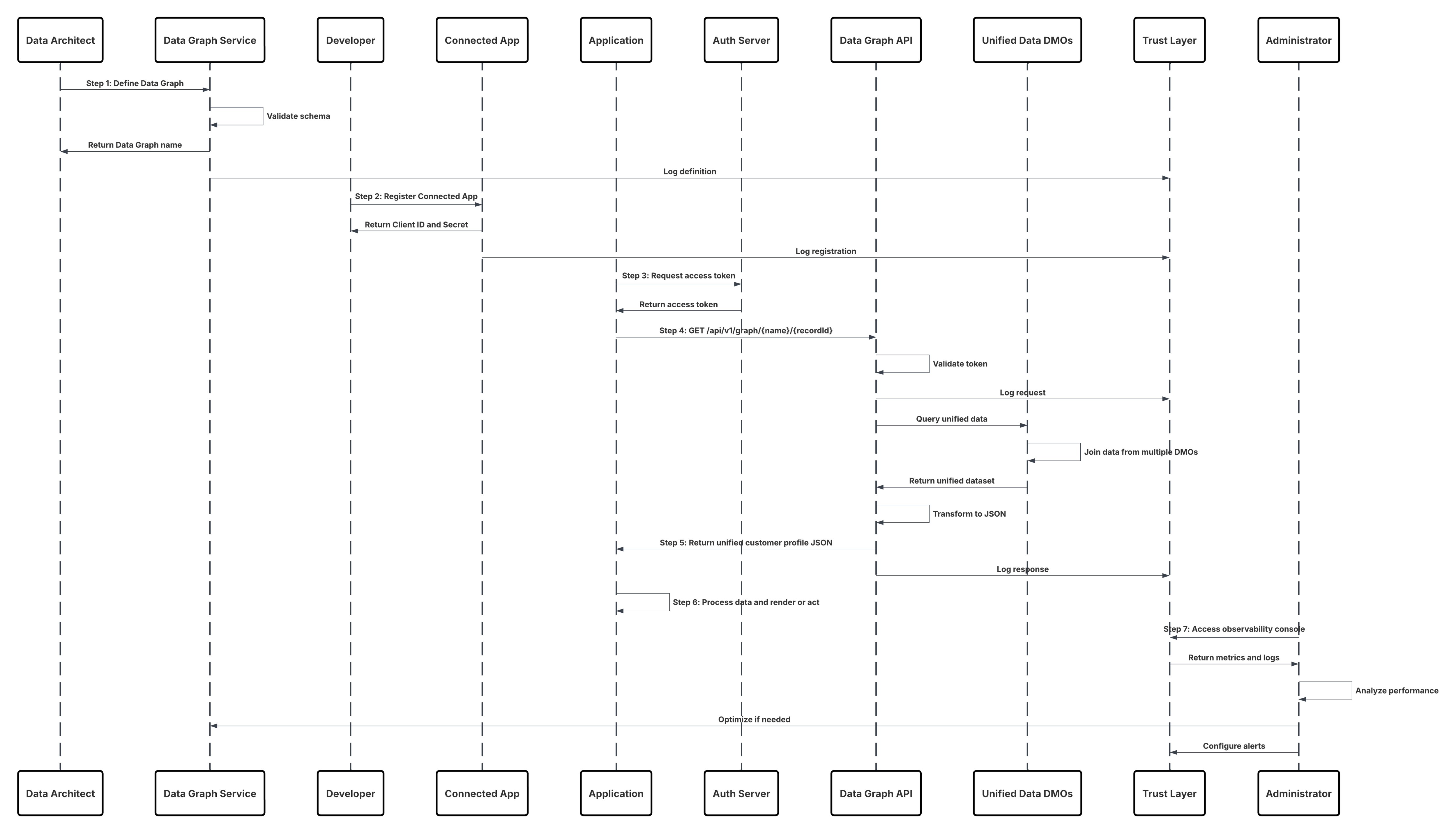

- Croquis : Un diagramme de séquence UML qui montre comment la solution répond au scénario.

- Résultats : Explique comment appliquer la solution à votre scénario d'intégration et comment elle résout les forces associées à ce scénario. Cette section présente également les nouveaux défis qui peuvent survenir suite à l'application du schéma.

- Barres latérales : Sections supplémentaires liées au modèle qui contiennent des problèmes techniques clés, des variantes du modèle, des préoccupations spécifiques au modèle, etc.

- Exemple : Un scénario du monde réel qui décrit l'utilisation du modèle de conception dans un scénario Salesforce réel. L'exemple explique les objectifs d'intégration et comment implémenter le schéma pour atteindre ces objectifs.

Utilisez ce tableau comme table des matières pour les modèles d'intégration contenus dans ce document.

| Niveau de schéma1 | Niveau de schéma2 | Modèle | Scénario |

|---|---|---|---|

| Modèles d'ingestion de données - Données entrantes | Modèles d'ingestion par lot | Ingestion de données en masse depuis Cloud Storage | Les données sont ingérées dans Data 360 à partir d'une source de stockage cloud d'entreprise telle que Amazon S3, Azure Blob ou Google Cloud Storage, sous forme de lots volumineux de données brutes (par exemple, des journaux de transactions ou de produits). |

| Ingestion de données en masse depuis Salesforce Clouds | Data 360 reçoit en masse les données CRM de plusieurs organisations Salesforce (par exemple Sales Cloud, Service Cloud) pour élaborer des profils clients unifiés. | ||

| Modèles d'ingestion en continu et en temps réel | Ingestion pilotée par l'événement via l'API Ingestion--Streaming | Data 360 s'abonne aux points de terminaison d'ingestion en continu qui reçoivent des charges de travail d'événements continus (par exemple, événements d'achat, télémétrie IoT) des systèmes d'entreprise pour des mises à jour de profil en temps réel. | |

| Ingestion du comportement Web et mobile en temps réel | Data 360 collecte et traite les données comportementales en temps réel des sites Web et des applications mobiles via des kits de développement pour enrichir les métriques d'engagement et les modèles de personnalisation. | ||

| Synchronisation CRM en temps quasi réel via Streaming | Data 360 reçoit les mises à jour des données CRM (p. ex., contact, requête, changements d'opportunité) en temps quasi réel via des flux d'événements pour maintenir une vue Customer 360 synchronisée en permanence. | ||

| Ingestion de flux d'événements à partir de plates-formes de messagerie Cloud - Kinesis et MSK | Data 360 consomme des données en continu directement à partir de plates-formes d'événements cloud telles que AWS Kinesis ou Kafka (MSK) pour traiter les événements opérationnels ou Internet des objets à haute fréquence. | ||

| Zéro modèle de copie - entrant et sortant | Inbound Zero Copy - Plates-formes externes dans Data 360 | Data 360 interroge des jeux de données externes (par exemple Snowflake, BigQuery) à la demande via Zero Copy Ingestion, sans déplacer physiquement les données dans Salesforce. | |

| Copie zéro sortante - Data 360 vers des plates-formes externes | Des systèmes externes tels que Databricks ou Tableau accèdent à des segments et à des connaissances enrichis dans Data 360 via des connexions Zero Copy Outbound sans réplication des données. | ||

| Plate-forme de données multi-organisations unifiée avec Data Cloud One | Data Cloud One unifie plusieurs organisations Salesforce et sources de données externes sous un modèle sémantique et de métadonnées partagées, offrant ainsi un Customer 360 cohérent sans duplication des données. | ||

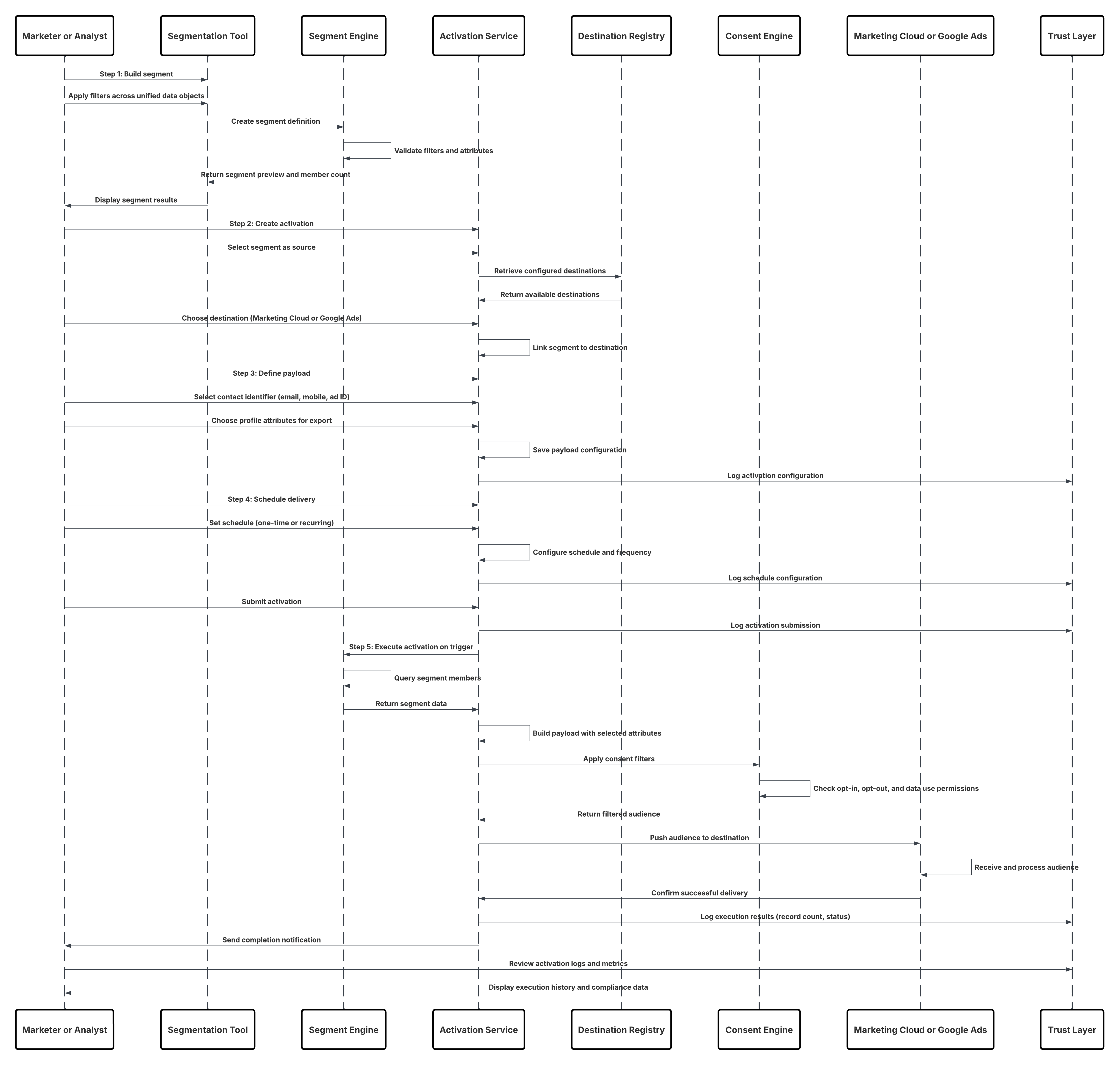

| Modèles d'activation des données - Données sortantes | Modèles d'activation par lot | Activation de segments pour des plates-formes marketing et publicitaires | Data 360 active des segments de clients organisés directement dans Marketing Cloud, Meta, Google Ads ou d'autres plates-formes publicitaires pour une diffusion de campagnes personnalisées |

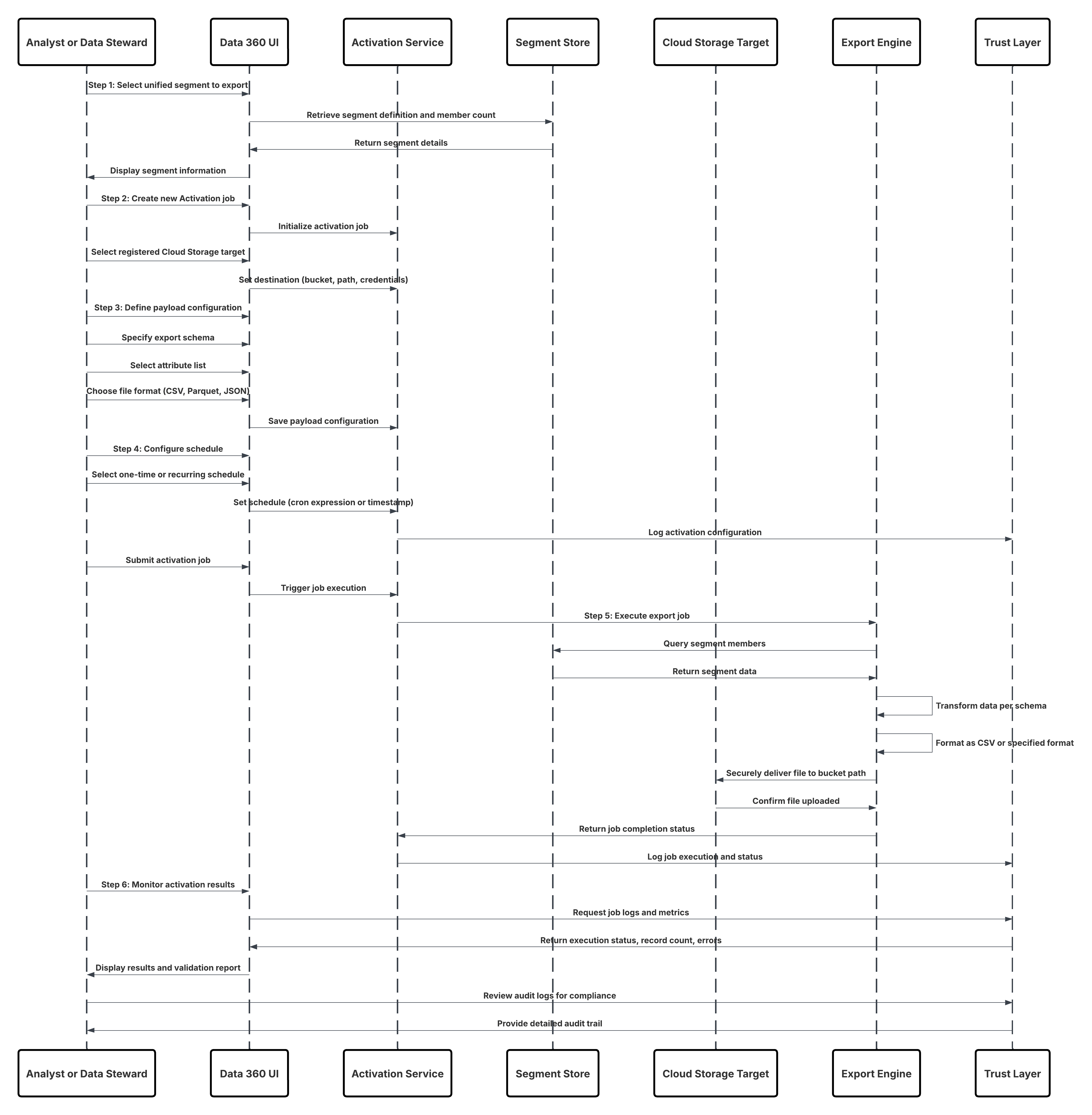

| Exportation de données vers Cloud Storage | Data 360 exporte des jeux de données unifiés ou filtrés (par exemple, des enregistrements clients consentis) sous forme de fichiers CSV ou Parquet vers le stockage cloud d'entreprise pour l'archivage d'analyses ou de conformité. | ||

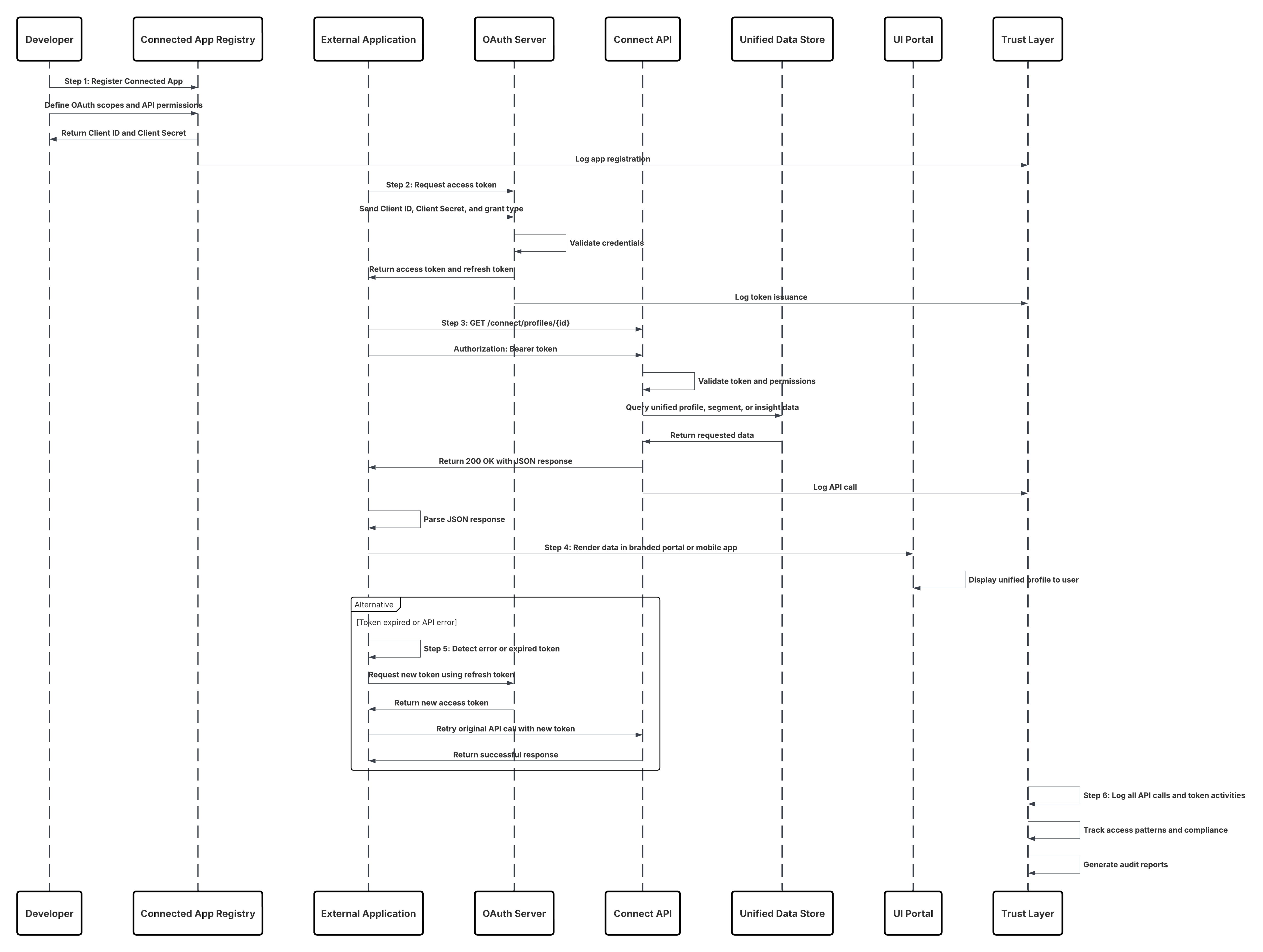

| Activation basée sur l'API à la demande | Intégration d'application personnalisée via l'API Connect | Les applications externes invoquent l'API Data 360 Connect en temps réel pour récupérer ou déclencher des actions personnalisées (par exemple, contrôle du solde de fidélité ou génération d'offres IA) basées sur les données clients actuelles.Des applications Web ou mobiles personnalisées récupèrent des connaissances Data 360 harmonisées en toute sécurité via l'API REST Connect pour les afficher dans des interfaces utilisateur d'entreprise ou de partenaire. | |

| Récupération complète du profil client via l'API Data Graph | Un système récupère le profil unifié d'un client en utilisant l'API Data Graph, en renvoyant une représentation JSON en temps réel pré-jointe de la vue complète à 360° pour la prise de décision ou la personnalisation. | ||

| Actions de données en temps réel | Action de données en temps réel Transformation des signaux clients en action instantanée | Data 360 détecte et traite un événement en direct (par exemple, mise à jour du consentement, déclencheur d'achat) et invoque immédiatement un système connecté ou un flux Salesforce pour une action en aval.Un signal d'activité client (par exemple, risque d'attrition détecté) dans Data 360 déclenche une action instantanée en temps réel, par exemple mettre à jour CRM, invoquer le score Einstein ou lancer un parcours de rétention. |

Les modèles d'intégration de ce document sont classés en trois catégories : données, processus et intégrations visuelles.

Les modèles d'intégration de données dans Data 360 traitent du mouvement et de la synchronisation des données entre les systèmes afin de garantir que Data 360 et les plates-formes externes contiennent des informations cohérentes, opportunes et fiables. Ces modèles gèrent généralement des flux de données à grande échelle et à haut volume, et s'appuient sur des pipelines gouvernés qui appliquent des règles de cohérence de schéma, de suivi de lignage et de mastering.

- Les modèles d'ingestion par lot représentent la couche fondamentale de l'intégration des données d'entreprise. L'ingestion de données en masse à partir de services de stockage cloud tels que AWS S3, Azure Blob ou Google Cloud Storage permet de charger périodiquement des jeux de données historiques volumineux dans Data 360 pour la résolution de l'identité, la segmentation et les analytiques. De la même façon, l'ingestion en masse à partir de Salesforce Clouds, tels que Sales, Service ou Marketing Cloud, utilise des connecteurs natifs et des flux de données pour intégrer les données CRM dans la couche de données unifiée, garantissant harmonisation et continuité entre les systèmes d'engagement.

- Les modèles d'ingestion en continu et en temps réel étendent cette fonctionnalité en capturant des données d'événements à grande vitesse. L'ingestion pilotée par l'événement via l'API Ingestion permet aux systèmes externes de diffuser en continu l'activité des clients dans Data 360. L'ingestion en temps réel du comportement Web et mobile capture les données de flux de clics et d'interaction directement depuis les points de contact numériques pour favoriser une personnalisation immédiate. La synchronisation CRM en temps quasi réel via les API Streaming permet de refléter rapidement les attributs des clients et les mises à jour du consentement dans tous les systèmes. L'ingestion de flux d'événements à partir de plates-formes de messagerie telles que Amazon Kinesis ou Confluent MSK prend en charge les pipelines à haut débit continus, alignant Data 360 avec les architectures d'événements d'entreprise.

- Unified Multi-Org Data Platform with Data Cloud One illustre davantage l'intégration de données, en fournissant un environnement consolidé pour unifier les données de plusieurs organisations Salesforce et sources externes sous une gouvernance et une couche sémantique communes. Cela permet aux organisations d'obtenir une cohérence des données à l'échelle de l'entreprise, des modèles de données partagés et des analytiques évolutives.

- Dans la phase d'activation, les modèles d'activation par lot suivent le même principe d'intégration de données. Les segments organisés dans Data 360 sont exportés dans des tâches planifiées vers des plates-formes marketing et publicitaires en aval, telles que Marketing Cloud, Meta Ads ou Google Ads, où ils déclenchent l'exécution de campagnes. De la même façon, les jeux de données peuvent être exportés vers des cibles de stockage Cloud pour alimenter les pipelines d'analyses externes et de science des données. Dans tous ces cas d'utilisation, Data 360 agit en tant que source de vérité pour les données clients synchronisées et organisées.

Les modèles d'intégration de processus dans Data 360 impliquent le déclenchement ou l'orchestration de processus métiers à travers les systèmes en temps quasi réel. Ces modèles permettent à Data 360 de participer activement aux workflows d'entreprise, en activant des réponses contextuelles et l'activation dynamique des données.

- L'activation basée sur l'API à la demande active des scénarios d'engagement en temps réel. Grâce à l'API Connect, les applications personnalisées peuvent interroger ou activer des profils clients directement depuis Data 360 dans le cadre de processus opérationnels, par exemple une console d'agent récupérant des connaissances de profil unifiées pendant une interaction avec un client. La Récupération complète du profil client via l'API Data Graph prend en charge les applications composites et les microservices qui dépendent de l'accès piloté par l'API au graphique complet des entités d'un client, ce qui permet des expériences dynamiques sans segments pré-étape.

- Les actions de données en temps réel poussent plus loin cette approche d'intégration en activant une réactivité immédiate. Lorsqu'un signal client, par exemple un achat, une soumission de formulaire ou un événement de seuil, est détecté, Data 360 peut déclencher des actions telles que la mise à jour d'un enregistrement CRM, l'invocation d'un webhook externe ou le lancement d'un workflow d'offre personnalisée. Ces schémas incarnent une véritable orchestration des processus, reliant l'Intelligence client en temps réel à l'exécution opérationnelle automatisée.

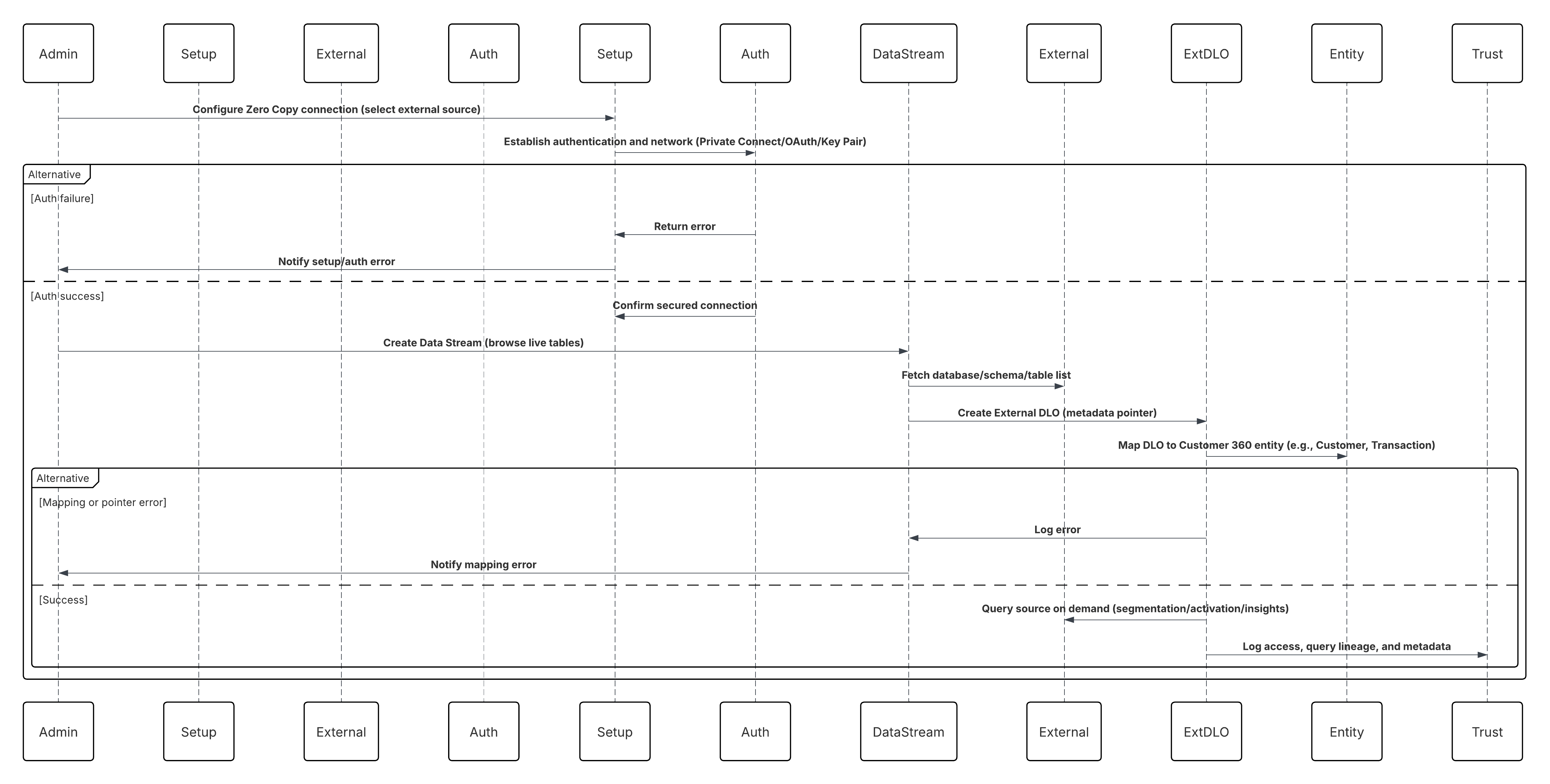

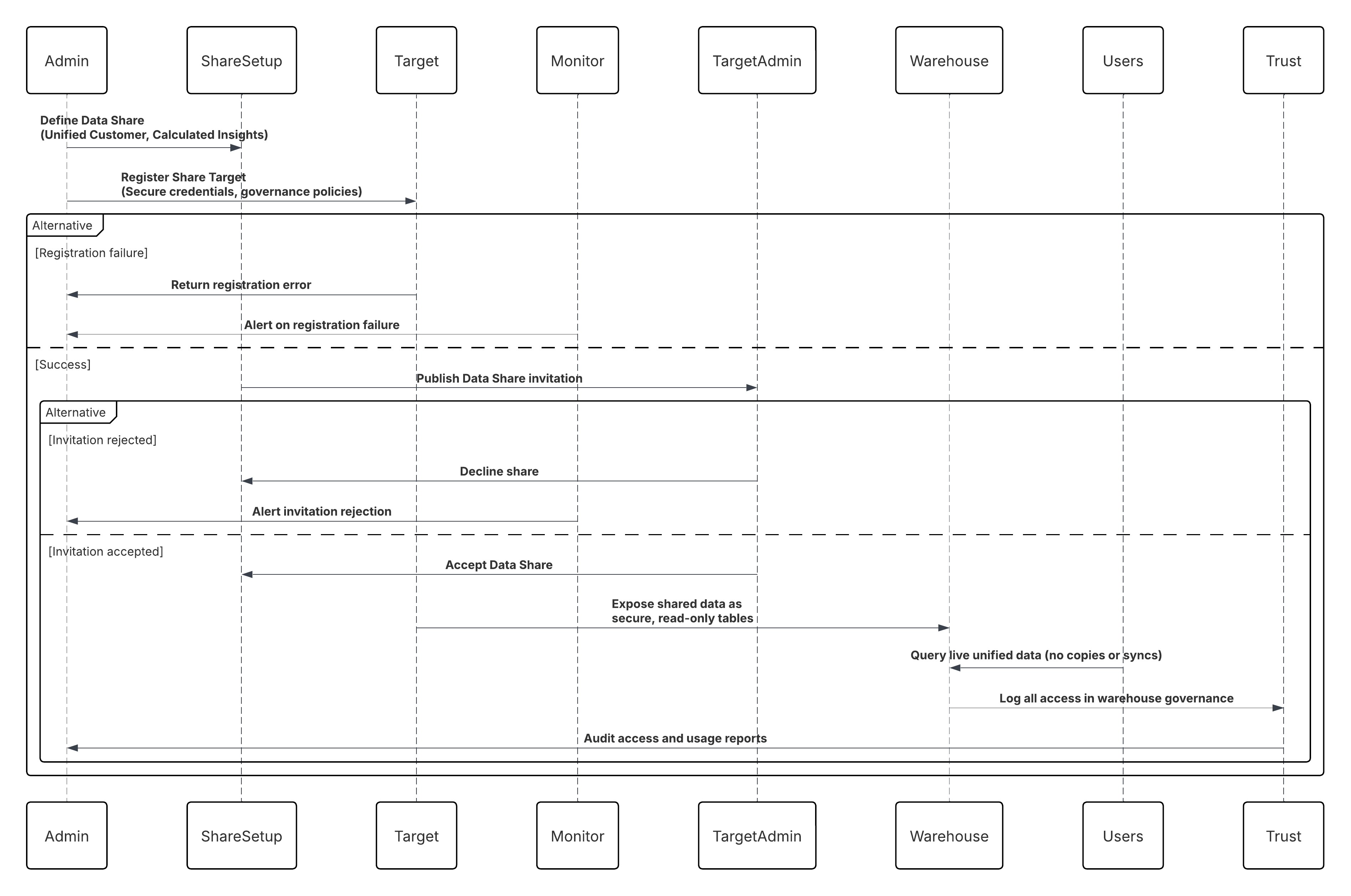

Les modèles d'intégration virtuelle dans Data 360 permettent d'accéder en direct à des sources de données externes ou fédérées sans copier ni dupliquer physiquement les données. Elles sont essentielles pour les entreprises qui ont besoin d'informations gouvernées et à jour au moment de la requête tout en limitant les mouvements de données.

- Inbound Zero Copy Data Federation (External Platforms-to-Data 360) permet à des systèmes externes, tels que des entrepôts de données ou des lacs de données, de partager des jeux de données avec Data 360 via des connexions sécurisées et régies (par exemple, Snowflake Secure Data Sharing). Cela permet à Data 360 d'accéder virtuellement à des données externes et de les exploiter, préservant ainsi leur fraîcheur et éliminant les réplications inutiles.

- Outbound Zero Copy Data Sharing (Data 360-to-External Platforms) permet à Data 360 d'exposer des jeux de données organisés pour la consommation externe, tels que la modélisation IA, l'intelligence économique ou les analytiques avancées, via des mécanismes sécurisés de fédération de données et de requête live. Choisir la meilleure stratégie d'intégration pour votre système n'est pas anodin. Il y a de nombreux aspects à prendre en compte et de nombreux outils qui peuvent être utilisés, certains outils étant plus appropriés que d'autres pour certaines tâches. Chaque modèle traite de domaines critiques spécifiques, notamment les capacités de chaque système, le volume de données, le traitement des échecs et la transactionnalité.

Lors de la sélection d'un modèle d'intégration, commencez par répondre à deux questions fondamentales qui déterminent la conception et le comportement globaux de l'intégration. Qu'est-ce que vous intégrez ? — Processus, Données ou Accès virtuel Cette dimension définit l'objectif principal de l'intégration.

- Les intégrations de processus se concentrent sur l'orchestration des workflows métiers et la coordination des actions entre les systèmes.

- Les intégrations de données se concentrent sur la synchronisation, l'enrichissement ou la propagation de données entre les systèmes.

- Les intégrations virtuelles se concentrent sur l'accès aux données externes en temps réel sans les copier ni les conserver dans Salesforce ou Data 360. Comprendre cette intention permet de déterminer le niveau d'orchestration, de mouvement des données et de couplage requis entre les systèmes.

- Comment doit-elle être exécutée ? — La méthode Synchrone ou Asynchrone définit le modèle d'exécution de l'intégration.

- Les intégrations synchrones sont en temps réel et bloquantes, où l'appelant attend une réponse immédiate, couramment utilisées pour des scénarios pilotés par l'utilisateur ou de validation.

- Les intégrations asynchrones ne sont pas bloquantes et découplées, conçues pour gérer les processus d'échelle, longs, les tentatives et les volumes de données élevés. Ensemble, ces deux dimensions (intention d'intégration et calendrier d'exécution) fournissent un cadre clair et cohérent pour sélectionner le modèle d'intégration approprié tout en équilibrant l'expérience utilisateur, l'évolutivité et la résilience opérationnelle. Note : Une intégration peut nécessiter un middleware externe ou une solution d'intégration (par exemple, Bus de service d'entreprise) selon les aspects qui s'appliquent à votre scénario d'intégration.

Le tableau ci-dessous répertorie les modèles et leurs aspects clés pour vous aider à déterminer le modèle le plus adapté à vos besoins lorsque votre intégration se fait depuis Salesforce vers un autre système.

| Type | Calendrier | Considérations sortantes |

|---|---|---|

| Intégration de données | Asynchrone | Activation de segments pour des plates-formes marketing et publicitaires |

| Intégration de processus/données | Synchrone | Intégration d'application personnalisée via l'API Connect Récupération complète du profil client via l'API Data Graph |

| Intégration de données | Synchrone | Action de données en temps réel Transformation des signaux clients en action instantanée |

| Intégration virtuelle (utilisation de Zero Copy) | Asynchrone | Copie zéro sortante - Data 360 vers des plates-formes externes |

| Intégration virtuelle | Asynchrone | Plate-forme de données multi-organisations unifiée avec Data Cloud One |

Le tableau ci-dessous répertorie les schémas et leurs principaux aspects pour vous aider à déterminer le schéma le plus adapté à vos besoins lorsque votre intégration s'effectue depuis un autre système vers Salesforce.

| Type | Calendrier | Considérations relatives aux entrées |

|---|---|---|

| Intégration de données | Asynchrone | Ingestion de données en masse depuis Cloud Storage Ingestion de données en masse depuis Salesforce Clouds |

| Intégration de données | Asynchrone | Ingestion de flux d'événements à partir de plates-formes de messagerie Cloud - Kinesis et MSK Synchronisation CRM en temps quasi réel via Streaming |

| Intégration de processus | Synchrone | Ingestion pilotée par l'événement via l'API Ingestion--Streaming Ingestion du comportement Web et mobile en temps réel |

| Intégration virtuelle | Asynchrone | Inbound Zero Copy - Plates-formes externes dans Data 360 |

Le tableau ci-dessous répertorie quelques termes clés liés au middleware et leurs définitions par rapport à ces modèles.

| Durée | Définition |

|---|---|

| Gestion des événements | Le traitement des événements désigne la réception, l'acheminement et la réponse à des occurrences identifiables à partir d'un système source ou d'une application. Middleware gère les événements en identifiant le point de terminaison cible, en transmettant l'événement et en déclenchant l'action métier requise (par exemple, consignation, tentatives ou activation de services en aval). Dans les architectures Data 360, le traitement des événements est essentiel pour l'ingestion de données en temps réel, les déclencheurs d'activation et les modèles de publication/abonnement. Les événements peuvent provenir de systèmes externes (Kafka, AWS Kinesis) ou d'événements de plate-forme Salesforce, et sont acheminés par middleware ou bus d'événement Data 360 pour un traitement immédiat. |

| Conversion du protocole | La conversion de protocole permet de communiquer entre les systèmes en utilisant différentes normes de transport de données. Middleware traduit les protocoles propriétaires ou hérités (tels que AMQP, MQTT, FTP) en protocoles Data 360 pris en charge (REST, gRPC ou HTTPS). Cela garantit l'interopérabilité entre des systèmes hétérogènes. Comme Data 360 ne gère pas nativement la conversion de protocole, middleware fournit la couche d'adaptation, encapsulant ou transformant les messages dans un format que les API et les connecteurs Data 360 peuvent interpréter. |

| Traduction et transformation | La traduction et la transformation garantissent l'interopérabilité en mappant un format de données ou un schéma avec un autre. Middleware effectue ces transformations pour aligner diverses charges de travail de données (CSV, XML, JSON) avec des objets modèle de données (DMO) Data 360 et des objets couche de données unifiée (UDLO). Cela inclut le nettoyage, l'enrichissement et l'application d'un mappage sémantique ou basé sur l'ontologie avant l'ingestion. Si Salesforce propose des outils de transformation comme les Recettes de Préparation des données, il est préférable de gérer les transformations complexes (notamment pour l'harmonisation sémantique) dans les middlewares. |

| File d'attente et tampon | La mise en file d'attente et la mise en tampon s'appuient sur la transmission de messages asynchrones pour garantir une communication résiliente et découplée. Les plates-formes middleware (par exemple, MuleSoft, Kafka ou Azure Event Hub) fournissent des files d'attente permanentes qui stockent temporairement des données lorsque Data 360 ou des systèmes en aval sont occupés ou inaccessibles. Cela évite la perte de données et prend en charge les tentatives d'ingestion ou d'activation en temps quasi réel. Data 360 prend en charge l'ingestion en continu et la messagerie sortante basée sur le flux, mais la mise en file d'attente durable et la livraison garantie sont généralement gérées par un middleware. |

| Protocoles de transport synchrones | Les protocoles de transport synchrones impliquent des opérations de blocage/réponse en temps réel. L'expéditeur attend une réponse avant de continuer. Dans Data 360, ils sont utilisés pour les activations basées sur l'API à la demande, l'enrichissement en temps réel ou les références de profil, où des réponses sont requises immédiatement. Middleware garantit la fiabilité de la connexion et gère les tentatives ou le traitement de secours pour les appels d'API Data 360 synchrones. |

| Protocoles de transport asynchrone | Les protocoles de transport asynchrones prennent en charge la communication non bloquante et découplée dans laquelle l'expéditeur poursuit le traitement sans attendre une réponse. Middleware gère les flux asynchrones pour les activations par lot, l'ingestion en continu et l'activation pilotée par l'événement. Cela permet un débit et une résilience élevés, essentiels pour la diffusion en continu d'événements et les modèles d'ingestion de données en temps quasi réel dans Data 360. |

| Acheminement de médiation | L'acheminement de la médiation définit un flux de messages complexe entre les systèmes, garantissant que les données ou les événements appropriés parviennent au consommateur approprié. Middleware agit en tant que médiateur, gérant une logique d'acheminement basée sur des règles, des en-têtes, un contenu ou un type d'événement. Dans les intégrations Data 360, la médiation garantit que les événements et les mises à jour de profil de plusieurs systèmes sont correctement acheminés vers des API Ingestion de données, des points de terminaison d'activation ou des consommateurs externes. Cela simplifie l'orchestration et prend en charge la synchronisation des données multisystème. |

| Chorégraphie de processus et orchestration de service | La chorégraphie de processus et l'orchestration coordonnent les processus multi-systèmes. La chorégraphie prend en charge des flux autonomes pilotés par un événement, où les systèmes agissent sur la base de règles partagées sans contrôleur central. Orchestration est un flux géré de façon centralisée qui dirige l'exécution du service. Dans les architectures Data 360, le middleware gère l'orchestration pour l'ingestion et l'activation à travers les systèmes, tandis que les workflows Salesforce ou les flux gèrent les chorégraphies légères sur la plate-forme. Une orchestration complexe, nécessitant une coordination des transactions ou une gestion d'état, est recommandée au niveau de la couche middleware. |

| Transactionnalité (cryptage, signature, livraison fiable, gestion des transactions) | La transactionnalité garantit des opérations atomiques, cohérentes, isolées et durables (ACID) entre les systèmes. Salesforce et Data 360 sont transactionnelles dans leurs limites, mais ne prennent pas en charge les transactions distribuées à travers des systèmes externes. Middleware gère le contrôle global des transactions, notamment le cryptage, la signature de messages, l'annulation, la compensation et la livraison fiable. Pour les flux de données critiques (par exemple, les mises à jour financières ou de consentement), le middleware garantit l'intégrité et la récupération de bout en bout dans Data 360 et les systèmes externes. |

| Acheminement | L'acheminement spécifie le flux contrôlé de messages ou de données entre les composants. Il peut être basé sur des en-têtes, un type de contenu, une priorité ou des règles. Middleware gère la logique d'acheminement des événements et des activations impliquant Data 360, par exemple l'acheminement de segments d'audience enrichis vers différents systèmes en aval (plates-formes publicitaires, entrepôts, applications CRM). Bien que l'acheminement puisse être implémenté dans Salesforce (Apex, Flux), l'acheminement middleware est préféré pour l'évolutivité, la flexibilité et la gouvernance. |

| Extraction, transformation et chargement (ETL) | ETL consiste à extraire des données de systèmes sources, à les transformer en schéma cohérent et à les charger dans une cible (telle que Data 360). Les outils middleware ou ETL gèrent ces opérations avant l'ingestion de données. Data 360 peut recevoir des sorties ETL via des API, des connecteurs, ou des pipelines d'ingestion en masse, et prend également en charge la Capture des données de modification (CDC) pour la synchronisation en temps quasi réel. Les processus ETL Middleware sont essentiels pour intégrer des systèmes hérités et garantir la qualité des données avant l'unification dans Data 360. |

| Sondage long | L'interrogation longue (programmation Comet) est une méthode qui permet de maintenir une communication ouverte entre les systèmes pour des mises à jour en temps réel. Le client envoie une requête et le serveur la conserve jusqu'à ce qu'un événement se produise, puis répond et rouvre une nouvelle connexion. Salesforce l'utilise dans l'API Streaming et les protocoles CometD/Bayeux pour la synchronisation des données pilotée par l'événement. Middleware peut s'abonner à ces événements et les transmettre à Data 360 pour des déclencheurs d'ingestion ou d'activation en temps réel, ce qui garantit une latence minimale entre les systèmes d'entreprise. |

L'ingestion de données est la première étape et la plus critique du cycle de vie des données de Salesforce Data 360. C'est ainsi que les informations brutes de plusieurs systèmes externes (CRM, ERP, Web, mobiles ou API tierces) entrent sur la plate-forme et font partie d'une vue client unifiée. Le mode d'ingestion approprié dépend des besoins de l'entreprise :

- Volume de données : quantité de données qui se déplacent à la fois

- Latence — Quelle doit être l'actualisation des données

- Capacités système source - comment le système peut connecter et livrer des données Data 360 prend en charge plusieurs modes d'ingestion pour répondre à ces besoins : par lot pour les chargements à haut volume, streaming pour les mises à jour en temps quasi réel, basé sur l'événement pour l'immédiateté transactionnelle et ingestion Zero Copy pour un accès instantané aux données externes sans les déplacer physiquement. Ensemble, ces modèles garantissent que chaque signal client, qu'il s'agisse d'un événement d'achat, d'un journal de flux de clics ou d'une mise à jour de fidélité, est transmis dans Data 360 de façon efficace, sécurisée et dans les délais appropriés afin d'optimiser les analytiques de confiance et les expériences pilotées par l'IA.

Les modèles d'ingestion par lot sont l'épine dorsale de l'intégration de données à grande échelle dans Data 360. Ils sont optimisés pour les scénarios dans lesquels les données sont traitées en masse, généralement de façon planifiée ou périodique, plutôt que de façon continue. Ces modèles sont les plus adaptés pour :

- Chargement de données historiques pour initialiser la plate-forme avec des enregistrements d'entreprise existants

- Synchronisation régulière avec des systèmes d'enregistrement tels que des ERP, des entrepôts de données ou des bases de données propriétaires

- Utilisez des cas où l'actualisation en temps réel n'est pas critique, mais la cohérence, l'exhaustivité et l'auditabilité sont L'ingestion par lot offre des performances prévisibles et une simplicité opérationnelle, ce qui en fait un choix de confiance pour les entreprises qui gèrent des téraoctets de données structurées ou semi-structurées. Data 360 fournit une série de connecteurs prêts pour la production et globalement disponibles qui prennent en charge l'ingestion par lot en natif. Ces connecteurs rationalisent la configuration de l'intégration, réduisent le développement ETL personnalisé, et garantissent la qualité et la sécurité des données à chaque importation. Le tableau ci-dessous présente les connecteurs les plus souvent utilisés pour l'ingestion par lot à l'échelle de l'entreprise.

Context

Ce schéma est conçu pour les scénarios d'entreprise qui impliquent l'ingestion de volumes importants de données structurées, telles que des fichiers CSV ou Parquet, et d'actifs non structurés à partir de lacs de données centralisés ou de dépôts de fichiers planifiés. Les sources de données comprennent généralement des plates-formes de stockage cloud telles que Amazon S3, Google Cloud Storage (GCS) et Microsoft Azure Blob Storage, où les fichiers sont périodiquement livrés dans le cadre de pipelines de données en amont ou d'exportations par lot.

Problème

Comment une organisation peut-elle établir un processus fiable, sécurisé et à haut débit pour ingérer des jeux de données volumineux, basés sur des fichiers, depuis sa plate-forme de stockage cloud principale vers Data 360 à un rythme prévisible et récurrent, sans sacrifier la gouvernance, l'évolutivité ou les performances ?

Forces

L'ingestion massive de jeux de données basés sur des fichiers dans Data 360 n'est pas un simple exercice de transfert de données, mais un défi architectural façonné par les contraintes d'échelle, de gouvernance et de plate-forme.

Volume et échelle des données : Les connecteurs d'ingestion Data 360 sont optimisés pour la fiabilité et la gouvernance, pas pour un débit en masse arbitraire. Par exemple, le connecteur Amazon S3 prend en charge jusqu'à 100 millions de lignes ou 50 Go par objet, selon la première limite atteinte. Pour les entreprises qui ont des jeux de données historiques contenant des milliards d'enregistrements, cette frontière devient une contrainte de conception clé. Une approche à fichier unique, par lift-and-shift devient rapidement impossible, nécessitant des stratégies intelligentes de partitionnement, de segmentation et d'orchestration des données pour atteindre l'échelle sans atteindre les limites du connecteur.

Définition et maintenance du schéma : Data 360 nécessite des définitions de schéma explicites pour chaque pipeline d'ingestion afin de garantir l'intégrité sémantique et structurelle. Dans le cas d'une ingestion S3, un fichier csv doit définir des en-têtes de colonne et une seule ligne de données représentative. Ce fichier agit en tant que contrat canonique entre le système source, c'est-à-dire le stockage cloud, et Data 360. Tout désalignement (dans les noms de champ, les types de données ou l'encodage) peut entraîner des échecs d'ingestion ou une corruption silencieuse des données. La gestion de ce fichier de schéma dans le contrôle de version et l'application automatique de la validation via des workflows CI/CD ou de gouvernance des données devient une meilleure pratique pour les environnements de production.

Conventions de nommage strictes : Data 360 applique des règles strictes de nommage d'objets et de champs pour maintenir la cohérence dans le graphique des métadonnées.

- Les noms d'objet doivent commencer par une lettre et ne peuvent inclure que des lettres, des chiffres ou des traits de soulignement.

- Les noms de champ doivent suivre les mêmes modèles. Les fichiers qui enfreignent ces conventions, par exemple les champs contenant des espaces, des caractères spéciaux ou des symboles non pris en charge, échouent à la validation du schéma pendant l'ingestion. Les entreprises doivent mettre en œuvre des processus d'hygiène des données préalables à l'ingestion afin d'assainir et de normaliser les structures de fichiers entrants.

Schéma d'authentification et de sécurité : Chaque connexion à un stockage externe doit respecter les normes de sécurité et de conformité de niveau entreprise.

- L'authentification est généralement gérée via l'accès AWS/clés secrètes ou l'authentification par fournisseur d'identité (IdP) fédéré.

- Les rôles IAM doivent être délimités pour appliquer le moindre privilège, en autorisant uniquement l'accès en lecture aux chemins de stockage spécifiés.

- Pour un accès sécurisé, les adresses IP sortantes doivent être directement ajoutées à la liste d'autorisations du système source. Ces contrôles en couches garantissent que chaque transfert de fichier fonctionne dans un périmètre zéro Trust et auditable, en équilibrant la conformité de l'entreprise avec la flexibilité requise pour l'ingestion à grande échelle.

Solution

Le tableau ci-dessous présente des solutions à ce problème d'intégration.

| Solution | Ajustement | Commentaires |

|---|---|---|

| Utilisation de connecteurs Native Cloud Storage (Amazon S3, Google Cloud Storage, Azure Blob Storage) | Meilleur | C'est le modèle recommandé et le plus fiable pour l'ingestion récurrente à grande échelle de fichiers dans Data 360\. Les connecteurs natifs fournissent une authentification gérée, un mappage de schémas et un mouvement sécurisé des données directement dans les objets lac de données (DLO) de Data 360. Idéal pour les chargements par lot planifiés où la latence n'est pas critique (par exemple, planification horaire ou quotidienne). |

| Traitement des jeux de données volumineux (au-delà des limites du connecteur) | Mieux avec le prétraitement | Chaque connecteur applique des limites en ingestion (par exemple, S3 : 100 M de lignes ou 50 Go par objet). Pour des jeux de données plus volumineux, implémentez une étape de prétraitement ETL afin de partitionner les données dans des fichiers/dossiers plus petits qui correspondent à ces seuils. Configurez ensuite plusieurs flux de données pour ingérer chaque partition en parallèle, puis utilisez le nœud append dans une transformation de données par lot) dans Data 360 pour recombiner les partitions dans un jeu de données unifié. |

| Sécurité et gouvernance | Meilleur | Tous les connecteurs prennent en charge l'authentification sécurisée via des méthodes natives du cloud (rôles IAM, comptes de service ou clés d'accès). Pour plus de contrôle, limitez l'accès aux plages IP Data 360 via la liste d'autorisations du fournisseur de cloud. Le transfert de données se fait sur des canaux cryptés, avec des fichiers stockés dans une couche intermédiaire temporaire et sécurisée pendant l'ingestion. |

| Quand ne pas utiliser | Suboptimal | Ce schéma n'est pas optimal pour :

|

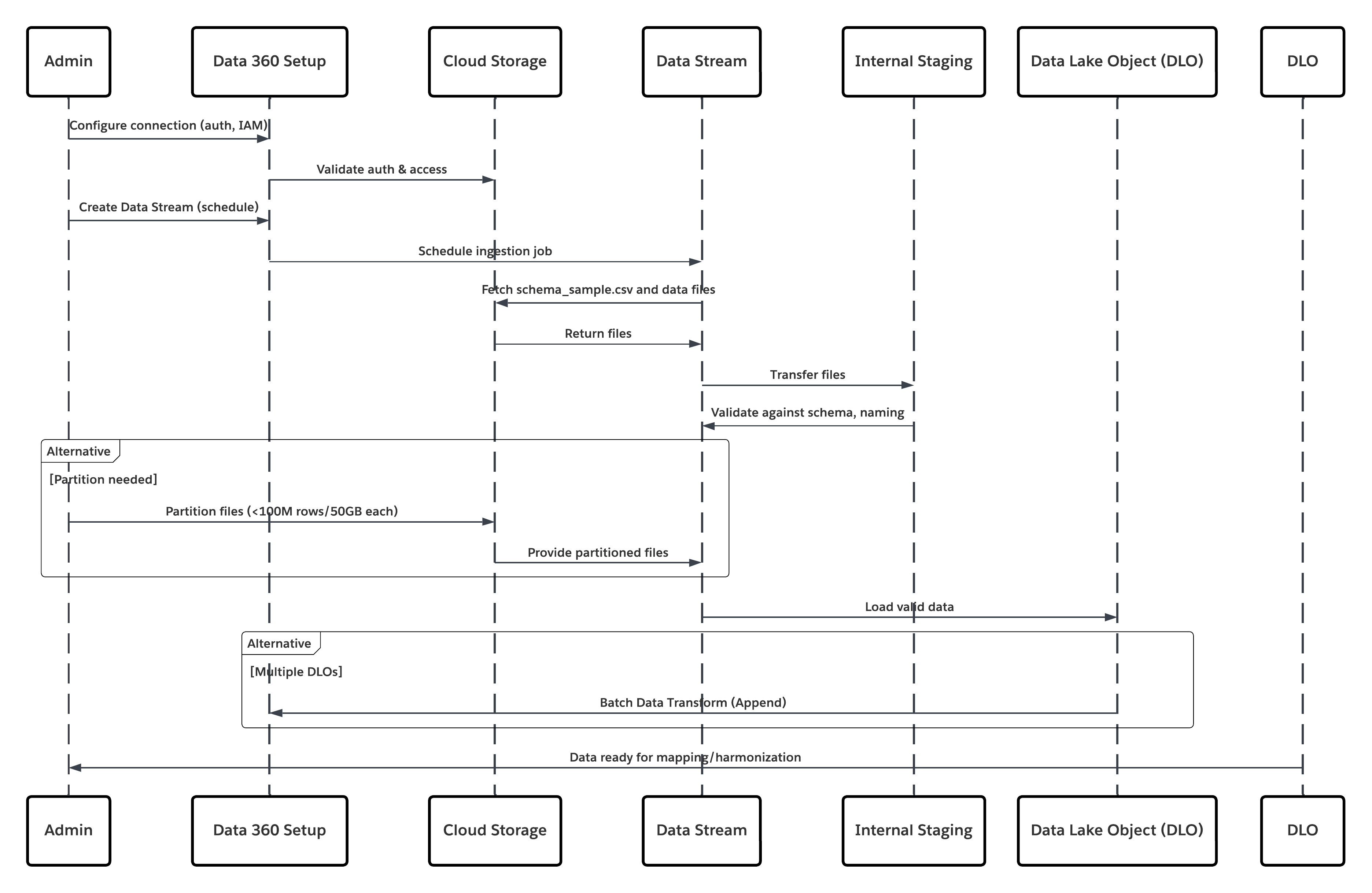

Croquis

Ce diagramme illustre la séquence des étapes d'ingestion des données depuis le stockage Cloud vers Data 360

Dans ce scénario :

- L'administrateur configure une connexion au stockage cloud via l'interface de configuration de Data 360 (en spécifiant l'authentification, les détails du compartiment, les rôles IAM et la liste blanche).

- L'interface de configuration de Data Cloud s'authentifie à Cloud Storage Platform, en vérifiant les identifiants et l'accès.

- L'administrateur crée un flux de données dans Data 360, liant le flux de données à l'objet/dossier dans Cloud Storage et définissant la planification de l'ingestion.

- À la planification du déclencheur, le flux de données demande des fichiers sources (par exemple, CSV, Parquet) depuis Cloud Storage Platform.

- Cloud Storage Platform livre des fichiers, y compris les fichiers valides requis schema_sample.csv et d'autres fichiers de données conformes aux conventions de nommage.

- Le flux de données transfère des fichiers vers l'environnement intermédiaire interne dans Data 360.

- Data 360 Pipeline traite les fichiers : Utilise la définition de schéma de schema_sample.csv Valide la structure, les noms de champ et divise la charge si elle dépasse les seuils d'ingestion (100 millions de lignes/50 Go par fichier). Si des fichiers volumineux sont détectés, une étape de partitionnement préalable au traitement (notifiée à l'administrateur pour la prochaine exécution) est effectuée en externe.

- Les enregistrements sont importés depuis Staging dans un objet lac de données (DLO).

- Si nécessaire et que les données sont partitionnées, utilisez le nœud append dans une transformation de données batch pour combiner plusieurs objets lac de données.

- Data 360 consigne les réussites/échecs, met à jour le statut de surveillance et indique que les données sont prêtes pour le mappage, l'harmonisation et l'unification.

Résultats

L'application de ce schéma permet d'ingestion sécurisée, planifiée et à grande échelle de fichiers structurés ou non structurés à partir de plates-formes de stockage cloud d'entreprise dans Data 360. Le processus est automatisé, évolutif et résilient. Il livre des données brutes dans des objets lac de données (DLO) qui servent de base d'harmonisation et de mappage avec le Customer 360 Data Model.

Mécanismes d'ingestion

Le mécanisme d'ingestion dépend du connecteur et de la stratégie de planification définis dans Data 360.

| Mécanisme d'ingestion | Description |

|---|---|

| Connecteur Native Cloud Storage (Amazon S3, GCS, Azure) | Recommandé pour l'ingestion directe de fichiers au format CSV ou Parquet depuis le lac de données cloud de l'entreprise. Ces connecteurs prennent en charge les planifications d'actualisation incrémentielles et complètes. Par exemple, une banque peut configurer une synchronisation quotidienne des fichiers de transaction client depuis un compartiment S3 vers un objet lac de données. |

| Stratégie de fichiers partitionnés | Pour des jeux de données très volumineux (au-delà de 100 millions de lignes ou 50 Go par objet), les données sont partitionnées en jeux logiques plus petits (par exemple, par mois ou par région). Chaque partition est gérée comme un flux de données séparé, puis recombinée en utilisant une Transformation de données par lot avec un nœud Ajouter. |

| Synchronisation planifiée automatisée | Data 360 fournit un planificateur déclaratif (cadence horaire, quotidienne ou personnalisée) qui déclenche automatiquement des tâches d'ingestion, assurant l'actualisation des données sans intervention manuelle. |

Gestion et récupération des erreurs

Le traitement des erreurs et la récupération sont essentiels pour garantir la fiabilité des opérations d'ingestion à haut volume.

- Détection des erreurs : Chaque exécution de flux de données consigne les erreurs d'ingestion (par exemple, inadéquation du schéma, corruption de fichiers ou infractions au nommage) dans Data 360 Monitoring. Les administrateurs peuvent réviser et retraiter les lots échoués.

- Mécanisme de recouvrement: Data 360 maintient le pointage pour s'assurer que les lots échoués ne corrompent pas les ingestions précédentes. Les récupérations peuvent être configurées après avoir corrigé des problèmes sources (par exemple des fichiers CSV malformés).

- Validation du schéma: Le fichier schema_sample.csv définit les types de données et la structure. Toute modification déclenche une validation afin d'éviter une dérive silencieuse du schéma entre les exécutions.

Considérations relatives à la conception impotente

L'ingestion est idempotente par conception - le retraitement du même fichier n'entraîne pas de duplication des enregistrements. Les stratégies clés comprennent :

- Empreinte digitale du fichier : Data 360 calcule des sommes de contrôle pour identifier et ignorer les fichiers précédemment traités.

- Ingestion transactionnelle : Les données sont intermédiaires et engagées dans l'objet lac de données uniquement lorsque le traitement de tous les enregistrements réussit.

- Ajouter vs. Remplacer : Selon la logique métier, les flux peuvent ajouter ou remplacer entièrement l'objet lac de données cible, ce qui garantit des résultats déterministes et empêche le chevauchement partiel des données.

Considérations relatives à la sécurité

La sécurité fait partie intégrante du pipeline d'ingestion, de l'authentification au cryptage et au contrôle d'accès.

- Authentification et autorisation : Les connecteurs utilisent l'infrastructure d'intégration sécurisée de Salesforce, exploitant les identifiants nommés et les identifiants externes pour l'authentification sans révéler de secrets.

- Cryptage : Les données sont cryptées en transit (TLS 1.2+) et au repos (AES-256).

- Contrôles réseau : Les systèmes de stockage sources (p. ex. les compartiments S3) doivent ajouter des adresses IP Data 360 à la liste d'autorisations.

- Alignement de conformité : Prend en charge les infrastructures de protection des données d'entreprise telles que GDPR, HIPAA et les directives FFIEC lorsqu'elles sont associées à des clés gérées par le client (CMK).

- Auditabilité : Chaque tâche d'ingestion et accès aux identifiants est consigné pour la traçabilité et les rapports de conformité.

Menus latéraux

Opportunité

La rapidité dépend de la planification de l'ingestion et du volume de données.

- Les jeux de données d'entreprise volumineux (100M+ lignes) peuvent nécessiter un partitionnement pour l'ingestion parallèle.

- La latence d'ingestion typique varie de minutes à quelques heures, selon la taille du fichier et la complexité de la transformation.

- Pour l'ingestion en temps quasi réel, des connecteurs Data 360 Streaming ou basés sur l'API peuvent compléter le modèle basé sur le fichier.

Volumes de données

- Convient parfaitement à l'ingestion par lots périodique à haut volume.

- Chaque objet traité via le connecteur S3 prend en charge jusqu'à 100 millions de lignes ou 50 Go par fichier.

- Pour des systèmes à l'échelle du pétaoctet, utilisez le partitionnement des données et l'orchestration multiflux.

Prise en charge des capacités et des normes des points de terminaison

La capacité et la prise en charge standard du point de terminaison dépendent de la solution que vous choisissez.

| Type de connecteur | Exigences du point de terminaison |

|---|---|

| Connecteur Amazon S3 | Compartiment S3 avec la stratégie IAM appropriée et le fichier schema\_sample.csv définissant le schéma. |

| Connecteur Google Cloud Storage | Identifiants de compte de service et accès au compartiment avec des conventions de nommage uniformes. |

| Connecteur Azure Storage | Accéder à l'authentification basée sur la clé ou le jeton SAS ; la structure du blob ou du dossier doit respecter les conventions Data 360. |

Gestion des états

L'état est suivi à travers les flux de données et leur horodatage de dernière exécution réussie.

- Data 360 conserve automatiquement les états de synchronisation et les décalages, garantissant que seuls les fichiers nouveaux ou modifiés sont traités lors des exécutions suivantes.

- Lors de l'intégration à des outils ETL externes, des identificateurs de fichier uniques (par exemple, des UUID ou des horodatages) sont recommandés pour éviter les doublons.

Scénarios d'intégration complexes

Dans les architectures d'entreprise avancées, ce schéma peut s'intégrer à :

- Middleware ETL Pipelines (p. ex. Informatica, MuleSoft) : pour orchestrer le prétraitement, la validation et le partitionnement de fichiers avant la transmission à Data 360.

- Workflows IA/ML : les données d'objet lac de données traitées peuvent être publiées via un objet modèle de données pour modéliser des environnements d'entraînement ou des index RAG via des cibles d'activation Data 360.

- Systèmes transactionnels : les objets modèle de données harmonisés peuvent déclencher des mises à jour en aval dans Salesforce CRM ou des systèmes externes via des Actions de données ou des Événements de plate-forme.

Exemple

Une institution financière internationale stocke les données des clients et des transactions dans un lac de données AWS S3, où les fichiers Parquet partitionnés sont générés la nuit par région (États-Unis, UE et APAC). L'équipe d'architecture de données configure plusieurs flux de données dans Data 360, chacun connecté à un dossier régional, avec un schema_sample.csv partagé garantissant des en-têtes et des types de données cohérents dans toutes les partitions. Les planifications d'ingestion nocturne chargent automatiquement les données dans des objets lac de données, après quoi les Transformations de données par lot ajoutent toutes les partitions régionales dans un objet lac de données Customer_Transactions_DLO unifié. Ce jeu de données harmonisé est ensuite mappé avec le Customer 360 Data Model, ce qui permet d'activer les analytiques en aval et l'IA. L'approche fournit une ingestion automatisée et fiable à partir du lac de données existant, applique une authentification forte et un cryptage alignés sur les politiques informatiques de l'entreprise, et fournit une fondation modulaire évolutive qui prend en charge l'expansion future et l'évolution du schéma.

Context

Un cas d'utilisation principal et critique pour Data 360 est l'unification des données clients dans l'écosystème Salesforce. Ce schéma couvre l'ingestion native de données à partir des plates-formes Salesforce principales : Sales Cloud et Service Cloud (collectivement Salesforce CRM) et Marketing Cloud Engagement. Les sources comprennent des objets CRM standard et personnalisés (par exemple, Compte, Contact, Requête, Opportunité) et des extensions de données Marketing Cloud Engagement qui contiennent des événements d'engagement, des envois d'e-mails et des données de suivi.

Problème

Comment une organisation peut-elle ingérer efficacement et de façon fiable des objets CRM standard et personnalisés et des extensions de données Marketing Cloud Engagement dans Data 360 afin d'utiliser les données pour élaborer des profils clients unifiés (résolution de l'identité, Customer 360), tout en maintenant les performances, la gouvernance et une interruption minimale des systèmes sources ?

Forces

Les connecteurs natifs simplifient la tâche, mais plusieurs forces opérationnelles et architecturales doivent être gérées :

- Autorisations sources complètes : Un utilisateur connecté dédié (compte d'intégration) doit disposer des autorisations de lecture appropriées au niveau de l'objet et au niveau du champ. L'incapacité d'attribuer les ensembles d'autorisations requis (par exemple, un ensemble d'autorisations de connecteur Data 360 prédéfini) est une cause fréquente d'échec de l'ingestion.

- Modes d'actualisation des données et coût : Les connecteurs prennent en charge les modes d'actualisation complet et delta/incrémentiel. Les actualisations complètes sont plus lourdes en performances et crédits ; les extractions delta réduisent la charge, mais dépendent d'un suivi fiable des modifications dans le système source.

- Schéma personnalisé et mappage de champs : Les instances CRM contiennent souvent des objets/champs personnalisés. Un mappage précis des schémas et la gestion des champs personnalisés (noms, types) sont requis pour éviter les erreurs de mappage ou les dérives sémantiques.

- Paquets de données de démarrage vs. Mappage personnalisé : Les paquets de données de démarrage accélèrent l'intégration en présélectionnant des objets/champs typiques, mais les organisations fortement personnalisées auront besoin de définitions de flux sur mesure.

- Limites en débit et en API : Les limites en API d'organisation source et les taux d'extraction Marketing Cloud limitent l'agressivité avec laquelle vous pouvez planifier des actualisations.

- Conventions relatives à l'hygiène des données et au nommage : Les noms de champ source, le comportement nul et les types de données doivent être normalisés avant l'ingestion afin d'éviter les problèmes de mappage en aval.

- Sécurité et moindre privilège : Le connecteur s'appuie sur l'authentification sécurisée et doit respecter les modèles IAM à moindre privilège, l'auditabilité et les contrôles réseau.

Solution

Le tableau ci-dessous présente des solutions à ce problème d'intégration.

| Zone de solution | Ajustement | Commentaires / Détails d'implémentation |

|---|---|---|

| Solution adaptée | Meilleur | Utilisez le connecteur Salesforce CRM natif et le connecteur Marketing Cloud Engagement dans Data 360\. Commencez par les paquets de données de démarrage pour des cas d'utilisation standard et accélérez l'intégration. Utilisez la personnalisation manuelle des flux pour des modèles de données sur mesure ou spécifiques au domaine. |

| Gestion des instances CRM hautement personnalisées | Mieux avec l'atelier de mappage | Traitez les offres groupées de démarrage comme une référence et organisez un atelier de cartographie pour identifier : Objets et relations personnalisés. Champs de formule ou calculés. Extensions de package géré. Pour des champs de formule lourds, calculez des valeurs dans un ETL préalable à l'étape ou dans des Transformations Data 360 afin de limiter la charge d'API pour les organisations sources. |

| Quand ne pas utiliser | Scénarios sous-optimaux | Évitez ce schéma si : Vous avez besoin d'une ingestion d'événements à haute fréquence ou en temps réel (utilisez à la place Connecteurs en continu, Événements de plate-forme ou Fédération zéro copie). L'organisation source a une capacité d'API limitée et ne peut pas prendre en charge les extractions planifiées sans limitation ou délais de mise en file d'attente. |

| Sécurité et gouvernance | Contrôles obligatoires | Principe du moindre privilège : utilisez un utilisateur d'intégration dédié avec un accès en lecture minimal. N'utilisez jamais des administrateurs d'organisation. Authentification : utilisez OAuth 2.0 et des applications connectées, permutez régulièrement les secrets clients et surveillez l'utilisation de jetons d'actualisation. Audit et traçabilité : consignez toutes les exécutions d'ingestion, les changements de schéma et les événements de connecteur. Transmettez les journaux au SIEM ou aux systèmes de conformité pour la préparation à l'audit. Classification des données : appliquez le balisage PII/PHI et le Contrôle d'accès basé sur l'attribut (ABAC) en utilisant des stratégies CEDAR immédiatement après l'ingestion pour imposer le masquage, le consentement et la conformité en aval. |

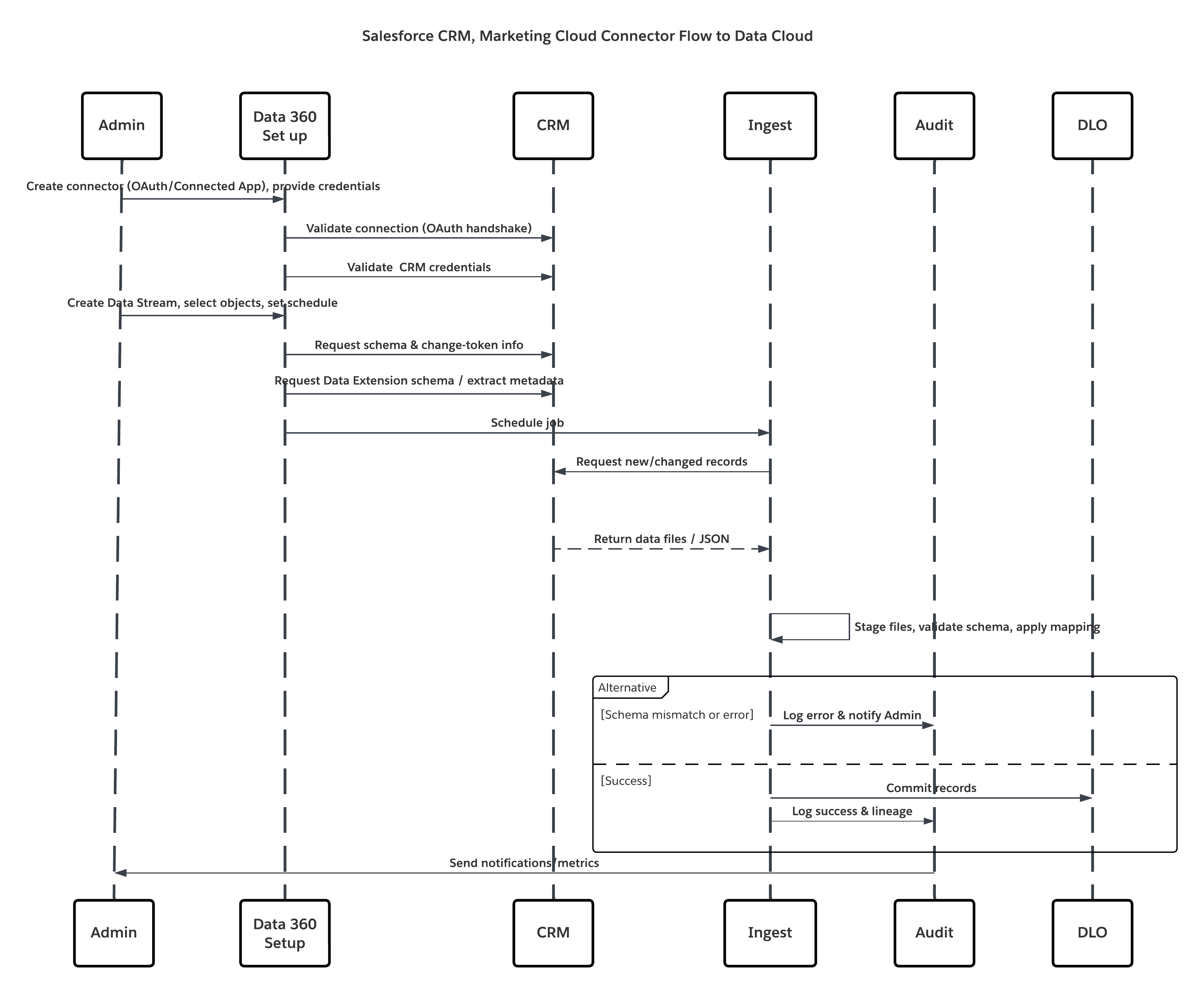

Croquis

Ce diagramme illustre la séquence des étapes d'ingestion des données depuis le stockage Cloud vers Data 360

Dans ce scénario :

- L'administrateur provisionne les utilisateurs de l'intégration et attribue des ensembles d'autorisations de connecteur dans les organisations sources.

- L'administrateur configure les connecteurs dans la Configuration de Data 360 (se connecte à Salesforce CRM et Marketing Cloud via OAuth/application connectée).

- L'administrateur crée des flux de données en sélectionnant des objets et des extensions de données, choisit l'actualisation complète ou delta, et définit des planifications.

- À l'exécution planifiée, Data 360 demande des jetons de schéma et delta à la ou aux sources.

- Les systèmes sources renvoient des enregistrements (delta ou charge utile complète). Marketing Cloud peut fournir des extractions, CRM peut renvoyer des résultats JSON/Query.

- Data 360 met en scène les fichiers dans sa zone intermédiaire sécurisée interne et les valide par rapport au schéma mappé.

- Si la validation échoue, l'erreur est consignée dans les journaux d'ingestion, l'administrateur est alerté et l'engagement est interrompu. Si la validation réussit, Data 360 engage atomiquement les enregistrements dans l'objet lac de données cible.

- Les journaux de surveillance et d'audit sont mis à jour avec le lignage, la durée d'exécution, le nombre de lignes et l'utilisation des identifiants. Alertes envoyées aux administrateurs en cas de déclenchement de seuils ou d'erreurs.

Résultats

Les principales données de relation client et d'engagement marketing sont ingérées dans Data 360 en tant qu'objets lac de données (DLO). Cela renvoie :

- Jeu de données unifié contenant des profils, des requêtes, des opportunités et des métriques d'e-mail/engagement.

- Fondation pour la résolution de l'identité et la construction de profils Individu unifié.

- Préparation opérationnelle à l'harmonisation, à l'enrichissement, à la modélisation et à l'activation de l'IA en aval tout en préservant la gouvernance et l'auditabilité.

Mécanismes d'ingestion

Le mécanisme d'ingestion dépend du connecteur et de la stratégie de planification définis dans Data 360.

| Mécanisme | Quand utiliser |

|---|---|

| Connecteur Salesforce CRM (natif) | Idéal pour les objets CRM standard/personnalisés ; prend en charge l'actualisation complète et delta. |

| Connecteur Marketing Cloud Engagement (natif) | Idéal pour les extensions de données, les envois et les extractions de suivi ; prend en charge les modes full/delta. |

| Paquets de données de démarrage | Accélérez l'intégration pour les objets Sales/Service/Marketing courants. |

| Flux personnalisés + prétraitement | Utilisé lorsque des transformations complexes ou une normalisation de schéma lourde sont requises. |

Gestion et récupération des erreurs

Le traitement des erreurs et la récupération sont essentiels pour garantir la fiabilité des opérations d'ingestion à haut volume.

- Journaux par exécution : Chaque exécution de flux de données fournit des détails de réussite/échec et des erreurs au niveau de la ligne.

- Retries & Checkpointing : Les exécutions échouées peuvent être ré-essayées après avoir corrigé des problèmes sources ou de schéma ; Data 360 utilise la sémantique d'étape et d'engagement atomique.

- Alertes : Configurez des alertes en cas de dérive du schéma, d'échecs répétés ou d'écarts de séquence delta.

Considérations relatives à la conception impotente

L'ingestion est idempotente par conception - le retraitement n'entraîne pas de doublons dans les enregistrements. Les stratégies clés comprennent :

- Détection des modifications : Les extractions Delta s'appuient sur des indicateurs de changement du système source (LastModifiedDate / capture des données de changement du système). Vérifiez que la source fournit des horodatages/indicateurs fiables.

- Déduplication : Utilisez des clés métiers uniques (par exemple Contact.ExternalId) pour dédupliquer ou mettre à jour/insérer dans des objets lac de données.

- Engagement transactionnel : Les enregistrements sont intermédiaires et engagés uniquement lorsque le traitement par lot est terminé avec succès.

Considérations relatives à la sécurité

La sécurité fait partie intégrante du pipeline d'ingestion, de l'authentification au cryptage et au contrôle d'accès.

- Authentification et autorisation : Les connecteurs utilisent l'infrastructure d'intégration sécurisée de Salesforce, exploitant les identifiants nommés et les identifiants externes pour l'authentification sans révéler de secrets.

- Cryptage : Les données sont cryptées en transit (TLS 1.2+) et au repos (AES-256).

- Contrôles réseau : Les systèmes de stockage sources (p. ex. les compartiments S3) doivent ajouter des adresses IP Data 360 à la liste d'autorisations.

- Alignement de conformité : Prend en charge les infrastructures de protection des données d'entreprise telles que GDPR, HIPAA et les directives FFIEC lorsqu'elles sont associées à des clés gérées par le client (CMK).

- Auditabilité : Chaque tâche d'ingestion et accès aux identifiants est consigné pour la traçabilité et les rapports de conformité

Menus latéraux

Opportunité

La rapidité dépend de la planification de l'ingestion et du volume de données.

- La cadence idéale dépend des besoins de l'entreprise : toutes les heures pour les déclencheurs marketing en temps quasi réel, toutes les nuits pour les rapprochements importants.

- Les modes delta réduisent la charge et le coût ; les actualisations complètes sont plus lourdes et utilisées pour les chargements initiaux ou les changements de schéma majeurs.

Volumes de données

- Les connecteurs CRM sont optimisés pour les jeux de données transactionnels et à volume moyen (millions d'enregistrements).

- Pour des volumes historiques extrêmement importants, tenez compte de l'ETL intermédiaire pour partitionner et charger par étapes.

Prise en charge des capacités et des normes des points de terminaison

La capacité et la prise en charge standard du point de terminaison dépendent de la solution que vous choisissez.

| Connecteur | Exigences du point de terminaison |

|---|---|

| Connecteur Salesforce CRM | L'organisation source doit autoriser une application connectée, des jetons OAuth et un utilisateur d'intégration dédié avec des autorisations de lecture. |

| Connecteur Marketing Cloud | Identifiants d'API Marketing Cloud ou package installé ; les extensions de données doivent exposer les données via Extraits/API. |

Gestion des états

- État du connecteur : Les flux de données conservent les derniers horodatages de synchronisation réussis et les décalages delta.

- Principale stratégie clé : Préférez des identifiants métiers cohérents (ID externes) afin que le rapprochement en aval et les mises à jour/insertions soient déterministes.

Scénarios d'intégration complexes

Dans les architectures d'entreprise avancées, ce schéma peut s'intégrer à :

- Topologies hybrides : Combinez l'ingestion CRM à la diffusion en continu (événements de plate-forme) pour des mises à jour en temps quasi réel.

- Orchestration middleware : Utilisez les outils MuleSoft ou ETL lorsque l'orchestration, l'enrichissement ou la préingestion de transformation complexe est requis.

- Boucles de commentaires d'activation : Les objets modèle de données harmonisés peuvent déclencher des mises à jour en aval des systèmes sources via des Actions de données ou des API de plate-forme (attention avec les contrôles SoD).

Exemple

Un distributeur multinational regroupe les métriques d’engagement Comptes, Contacts, Requêtes, Opportunités et Marketing Cloud dans Data 360 pour créer une vue client unifiée. Le paquet de données Starter initialise les principaux objets Ventes et Service, tandis que l'équipe étend le modèle avec des champs personnalisés tels que Loyalty_Membershipc et Customer_Tierc pour capturer le contexte de fidélité. Les flux de données CRM sont exécutés toutes les heures en mode delta, et Marketing Cloud Engagement est synchronisé quotidiennement en utilisant des extractions delta pour les événements d'engagement. Ces jeux de données sont traités via des objets lac de données et la résolution de l'identité, ce qui génère un profil client unifié qui combine CRM et signaux d'engagement pour piloter la personnalisation et les modèles IA en aval.

Ces modèles sont conçus pour les scénarios où les millisecondes sont importantes, c'est-à-dire lorsque les interactions, les transactions ou les signaux des clients doivent déclencher une connaissance ou une action immédiate. Ils vont au-delà de l'ingestion par lot planifiée traditionnelle pour activer le flux de données piloté par l'événement, où les informations sont traitées dès leur génération. Dans l'écosystème Salesforce Data 360, le « temps réel » n'est pas un mode unique, mais un continuum de modèles de latence. D'un côté, la synchronisation en temps quasi réel, où les mises à jour des systèmes d'enregistrement (tels que CRM ou ERP) sont reflétées dans Data 360 en quelques secondes ou minutes. De l'autre côté, la véritable capture d'événements en temps réel, où les signaux comportementaux côté client, tels que les clics, les achats ou les interactions mobiles, sont ingérés et activés en millisecondes. Pour les architectes, la distinction est plus que sémantique. Il définit la conception des pipelines, l'invocation des API et la prise de décisions en aval. La sélection du modèle approprié (synchronisation en temps quasi réel ou ingestion d'événements en continu) garantit que le système atteint les objectifs de latence opérationnelle de l'entreprise tout en préservant l'intégrité des données, l'évolutivité et la gouvernance.

Context

Ce schéma permet à n'importe quel système externe, par exemple une application personnalisée, une plate-forme Internet des objets (IoT), un système de point de vente (POS) ou un service tiers, d'envoyer automatiquement par programmation des données d'événements dans Data 360 en temps quasi réel lorsque des événements discrets se produisent.

Problème

Comment un développeur peut-il envoyer de façon fiable des enregistrements uniques ou de petits lots asynchrones d'événements depuis une application externe vers Data 360 avec une faible latence afin que les données soient rapidement disponibles pour le traitement, la segmentation et l'activation ?

Forces

Ce schéma offre une faible latence et un meilleur contrôle du développeur, mais introduit plusieurs contraintes techniques et dépendances opérationnelles :

- Dépendance du développeur : Nécessite un effort de développeur pour implémenter des clients d'API REST authentifiés et une logique d'erreur/réessai. Ce n'est pas un connecteur par pointer-cliquer.

- Schéma strict en écriture : L'API Ingestion applique automatiquement le schéma en écriture. Un schéma précis doit être défini et chargé dans la configuration du connecteur. Toutes les charges utiles doivent être conformes ou rejetées.

- Modes d'interaction double : Le même connecteur prend en charge le streaming (JSON) pour les mises à jour à faible latence, enregistrement par enregistrement, et le transfert en masse (CSV) pour les synchronisations périodiques plus importantes. Les architectes doivent choisir par cas d'utilisation.

- Authentification et sécurité : Les appels doivent être authentifiés via une application connectée Salesforce en utilisant OAuth 2.0 (p. ex. flux de porteur JWT pour serveur à serveur). La gestion des jetons, la rotation et les étendues de moindre privilège sont obligatoires.

- Visibilité opérationnelle : Les développeurs et les équipes de plate-forme doivent mettre en œuvre une surveillance des codes de réponse, des tentatives, des files d'attente en lettres mortes et des alertes de dérive de schéma.

- Graphique en temps réel requis : Pour une véritable activation instantanée (segmentation instantanée, mappage d'objets modèle de données en temps réel), l'objet modèle de données (DMO) cible doit faire partie du graphique de données en temps réel, sinon les événements traversent un pipeline à latence légèrement plus élevée.

Solution

Le tableau ci-dessous présente des solutions à ce problème d'intégration.

| Zone de solution | Ajustement | Commentaires / Détails d'implémentation |

|---|---|---|

| Solution adaptée | Meilleur pour la capture d'événements à faible latence | Utilisez l'API Data 360 Ingestion (JSON en continu) pour envoyer automatiquement des événements uniques ou des micro-batches. Configurez le connecteur d'API Ingestion avec un schéma OAS 3.0 strict (.yaml). Utilisez l'ingestion CSV en masse pour des synchronisations plus grandes et moins fréquentes. |

| Modifications du schéma de traitement | Strict / Géré | Les changements de schéma sont rompus : mettez à jour OAS .yaml, mettez le connecteur en version et effectuez des tests contractuels. Implémentez la migration du schéma glissant si les producteurs ne peuvent pas changer simultanément. |

| Quand ne pas utiliser | Suboptimal | Pas idéal si un prétraitement est nécessaire ( ex: déduplication, commande garantie etc. ) , ou pour des charges en masse extrêmement importantes (utilisez des connecteurs en masse natifs ou ETL par lot). Si la source ne peut pas produire de charges utiles valides pour le schéma ou ne peut pas s'authentifier en toute sécurité, utilisez des méthodes d'ingestion alternatives. |

| Sécurité et gouvernance | Obligatoire | Utilisez OAuth 2.0 avec des étendues à moindre privilège, permutez les clés, consignez l'utilisation de jetons. Appliquez le protocole TLS 1.2+, validez les adresses IP des clients si nécessaire et assurez-vous que les informations d'identification personnelle de la charge de travail sont balisées. Tous les événements doivent porter des métadonnées de provenance (source, horodatage, version du schéma, clé d'idempotence). |

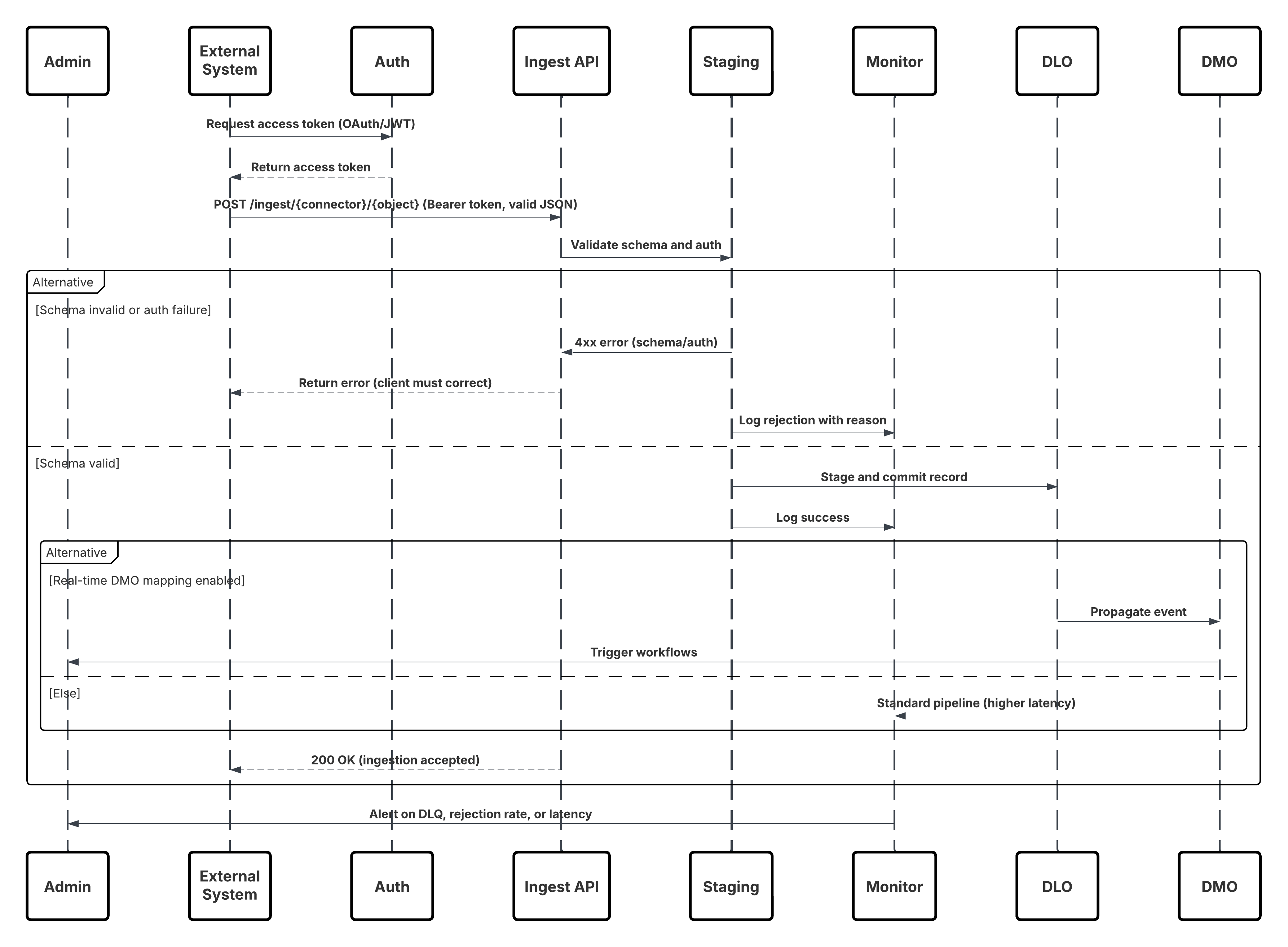

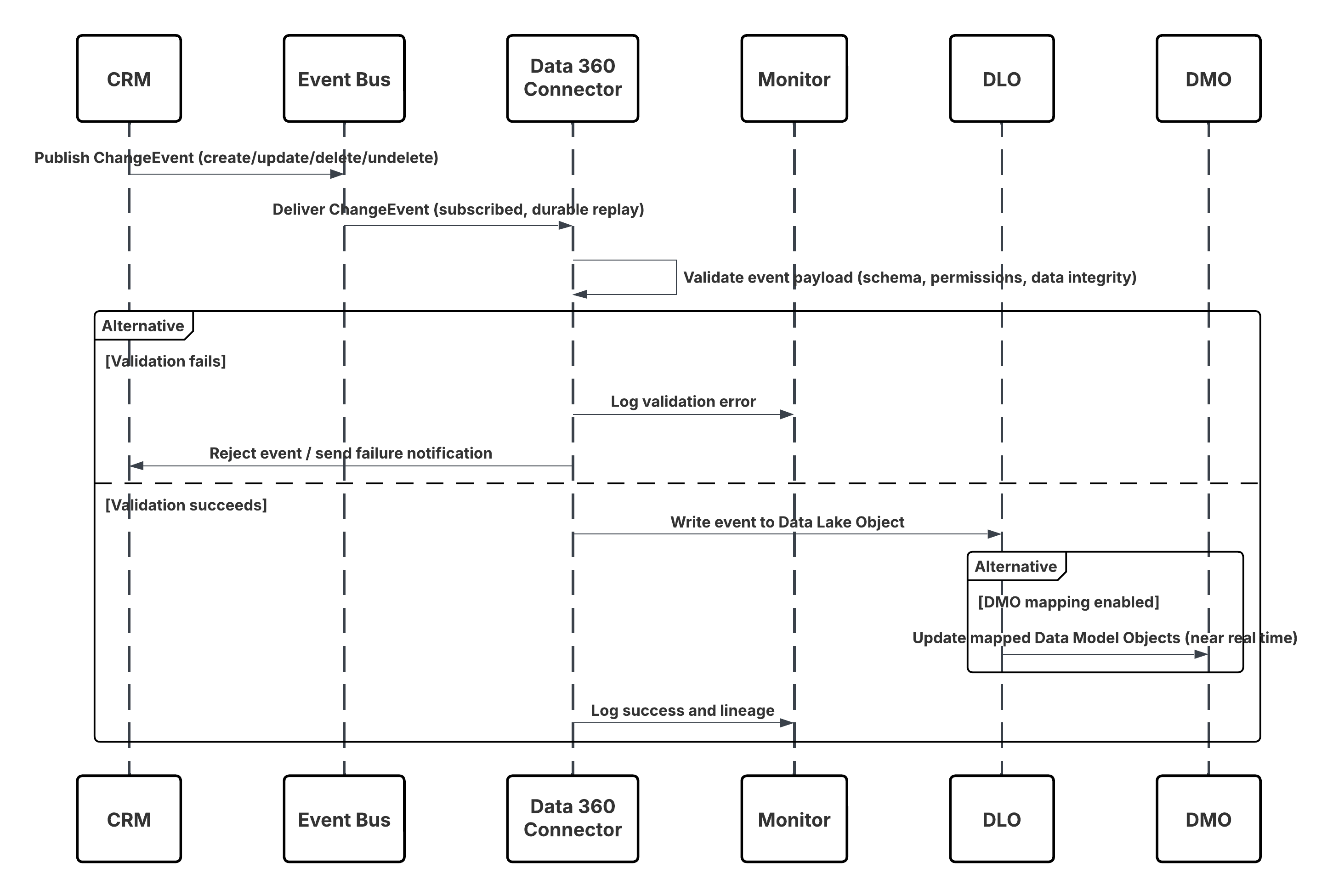

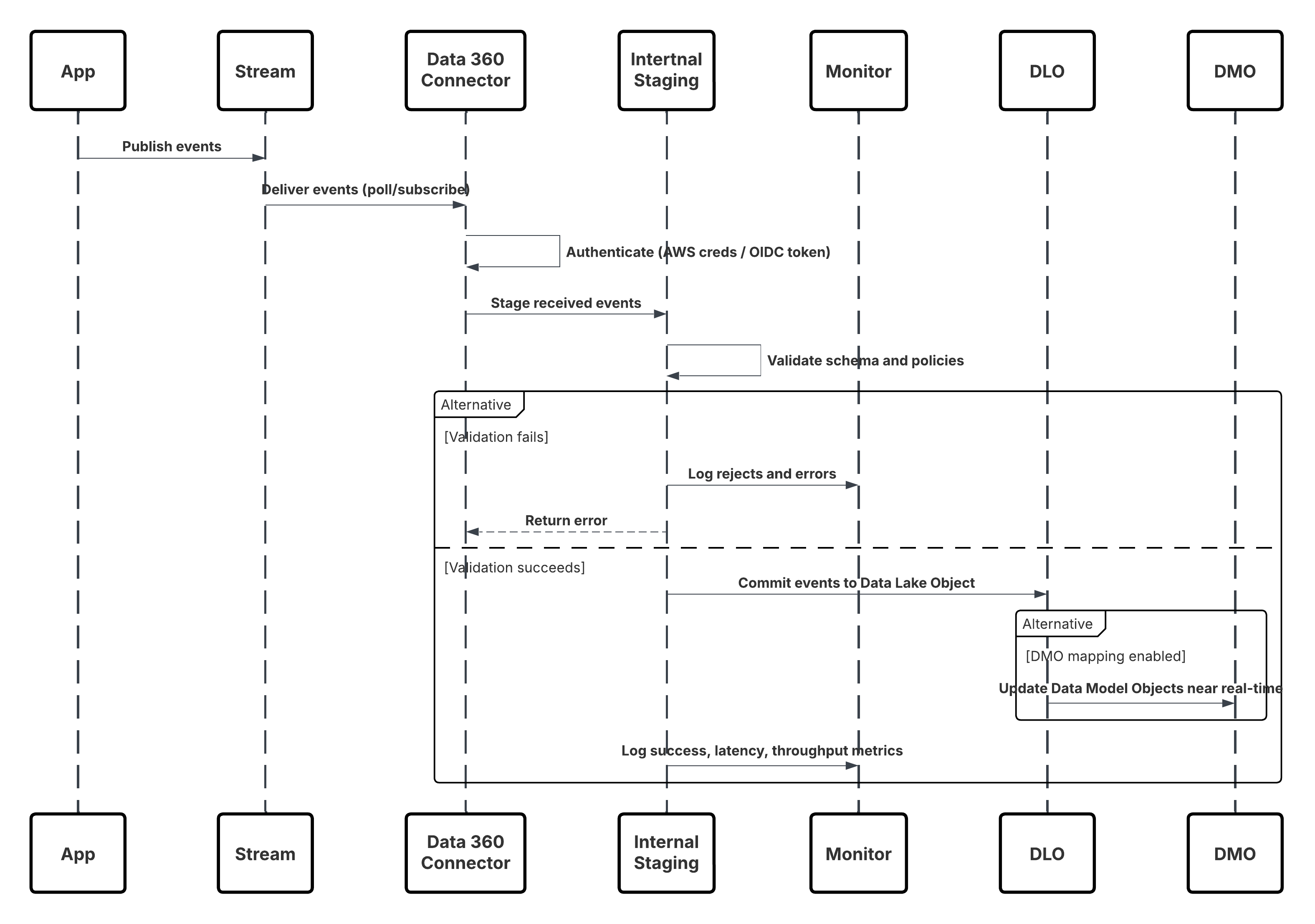

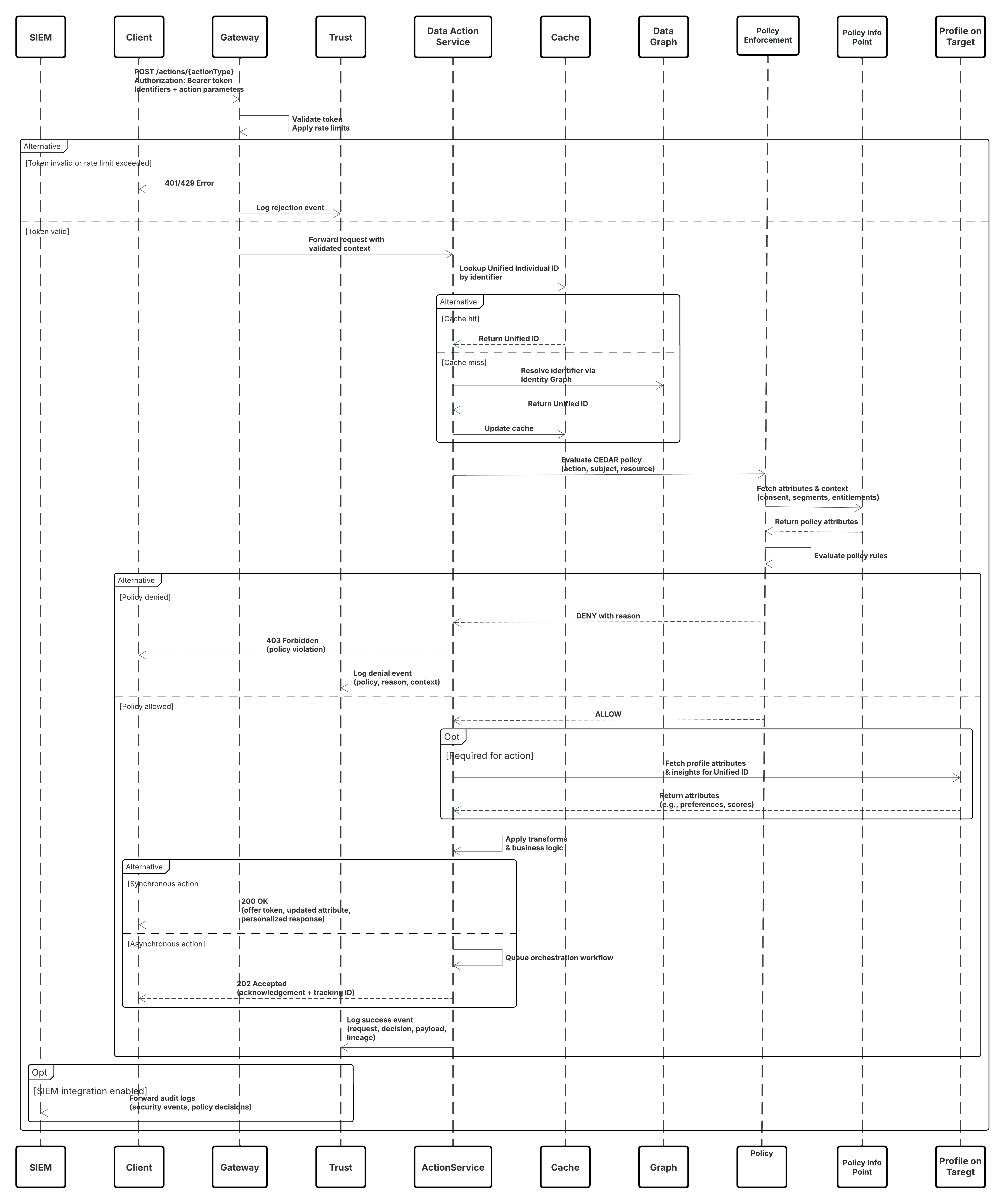

Croquis

Ce diagramme illustre la séquence des étapes d'ingestion des données depuis l'API Ingestion vers Data 360

Dans ce scénario :

- Le système externe demande l'authentification via OAuth/JWT au serveur d'authentification.

- Le serveur d'authentification renvoie le jeton d'accès au système externe.

- Le système externe envoie la requête POST d'ingestion de données à l'API Ingestion Data 360 avec autorisation et charge de travail JSON.

- L'API Ingestion valide le schéma de requête et l'authentification via le module Staging & Validation.

- En cas d'échec du schéma/de l'authentification :

- Erreur renvoyée dans Système externe.

- Refus consigné pour surveillance et alerte.

- Une fois la validation réussie :

- Enregistrements mis en scène et engagés dans Objet lac de données (DLO).

- Succès consigné pour la surveillance.

- Si cette option est activée, les données sont propagées vers le Graphique de données en temps réel (DMO) qui déclenche des workflows en aval.

- Sinon, les données sont traitées par lot standard ou pipeline à latence plus élevée.

- L'API Ingestion confirme le succès du système externe.

- Les composants de surveillance alertent l'administrateur sur les files d'attente en lettres mortes, les taux de rejet ou les problèmes de latence.

Résultats

Les données d'événements externes sont ingérées dans des objets lac de données Data 360 à faible latence. Lorsque l'objet modèle de données cible fait partie du graphique en temps réel, les données sont disponibles pour la segmentation instantanée, les workflows des agents, les modèles IA et l'activation opérationnelle. Cela permet de répondre rapidement aux événements provenant de n'importe quel système connecté.

Mécanismes d'ingestion

Le mécanisme d'ingestion dépend du connecteur et de la stratégie de planification définis dans Data 360.

| Mécanisme | Quand utiliser |

|---|---|

| JSON en continu (API Ingestion) | Événements uniques, microbatches, événements comportementaux, flux de clics, télémétrie Internet des objets — lorsqu'une faible latence est requise. |

| CSV en masse (mode en masse de l'API Ingestion) | Chargements périodiques plus importants où les exigences de latence sont assouplies. |

| Edge / Middleware | Utilisez-le lorsque vous avez besoin de validation, de transformation, d'enrichissement ou de limitation de taux avant d'appliquer automatiquement l'API Ingestion. |

Gestion et récupération des erreurs

- Erreurs (de synchronisation) immédiates : Réponses 4xx pour des erreurs de schéma/authentification — le client doit corriger la charge utile ou le jeton et réessayer.

- Échecs transitoires (asynchrones) : Réponses 5xx : le client essaie avec un recul exponentiel et de la gigue.

- File d'attente lettre morte (DLQ) : Les échecs persistants sont renvoyés dans DLQ pour inspection manuelle et relecture.

- Surveillance : Suivez le taux de rejet du schéma, les échecs d'authentification, les percentiles de latence et le backlog DLQ. Alerte sur les seuils.

Considérations relatives à la conception impotente

- Clé d'immunité : Chaque événement doit inclure une clé d'identité/ID de message unique.

- Mettre à jour/insérer une stratégie : Utilisez des clés métiers (ExternalId) pour éviter les doublons lors des relectures.

- Fenêtre Dedup : L'architecte doit définir des fenêtres de déduplication et de rétention pour le suivi de l'idempotence.

Considérations relatives à la sécurité

La sécurité fait partie intégrante du pipeline d'ingestion, de l'authentification au cryptage et au contrôle d'accès.

- Authentification : OAuth 2.0 (porteur JWT) recommandé pour serveur à serveur. Limitez les étendues uniquement à l'ingestion.

- Cryptage : TLS 1.2+ pour le transport; Data 360 applique automatiquement le cryptage au repos.

- Moins de privilège : Les identifiants de l'application connectée ont des droits minimums. Permutez les secrets et les journaux d'accès aux instruments.

- Gouvernance de la charge de travail : Insérez des indicateurs de consentement/consommation dans les métadonnées des événements; appliquez les stratégies ABAC/CEDAR immédiatement après l'ingestion.

- Contrôles IP / Private Connect : Si nécessaire, limitez l'accès via des listes d'autorisations ou utilisez Private Connect pour la mise en réseau privée.

Menus latéraux

Opportunité

La rapidité dépend de la planification de l'ingestion et du volume de données. Le JSON en continu renvoie une latence de la seconde à la seconde selon le traitement et la configuration du graphique. Le fichier CSV en masse est de minutes à heures. Choisissez en fonction des accords commerciaux.

Volumes de données

La taille des événements individuels doit être petite (< quelques Ko). Pour les producteurs à haut débit, vous pouvez utiliser un traitement par lot chez le producteur ou une mémoire tampon en continu (Kafka/Kinesis) avant d'appeler l'API.

Gestion des états

- Schéma de version : Maintenir la version du schéma dans les métadonnées d'événements et utiliser la gestion des versions du connecteur lors de la mise à jour du contrat OAS.

- Décalages de connecteur : Data 360 gère la sémantique d'engagement. Les producteurs doivent suivre les clés d'idempotence et la dernière séquence réussie pour une relecture sécurisée.

Scénarios d'intégration complexes

Dans les architectures d'entreprise avancées, ce schéma peut s'intégrer à :

- Couche de validation Edge : Utilisez un middleware pour traduire des formats de producteur hétérogènes vers le contrat OAS requis, effectuer une limitation de taux et un pré-enrichissement.

- Architectures hybrides : Combinez l'API d'ingestion pour les événements et les connecteurs pour le rapprochement en masse.

- Activation de l'agent : Les événements mappés avec des objets modèle de données en temps réel peuvent déclencher des workflows Agentforce et des modèles Einstein pour la prise de décision automatisée.

Exemple

Une chaîne de magasins de détail diffuse des événements d'achat de point de vente (POS) dans Data 360 inReal-Time pour favoriser l'engagement immédiat des clients. Chaque magasin exécute un composant serveur léger qui collecte les transactions, les enrichit avec des métadonnées d'emplacement et d'appareil, et publie en toute sécurité des événements JSON en utilisant OAuth du porteur JWT avec des clés d'idempotency pour éviter les doublons. Un administrateur définit la structure de l'événement en chargeant un schéma OAS pour le point de vente et en configurant le connecteur d'API Ingestion. Les événements entrants sont ingérés dans l'objet lac de données pos_sale, mappés avec l'objet modèle de données Vente et ajoutés au graphique en temps réel. Ainsi, les achats de grande valeur sont détectés instantanément, ce qui déclenche des workflows VIP dans Agentforce et met à jour la segmentation des clients pour piloter la personnalisation en temps réel.

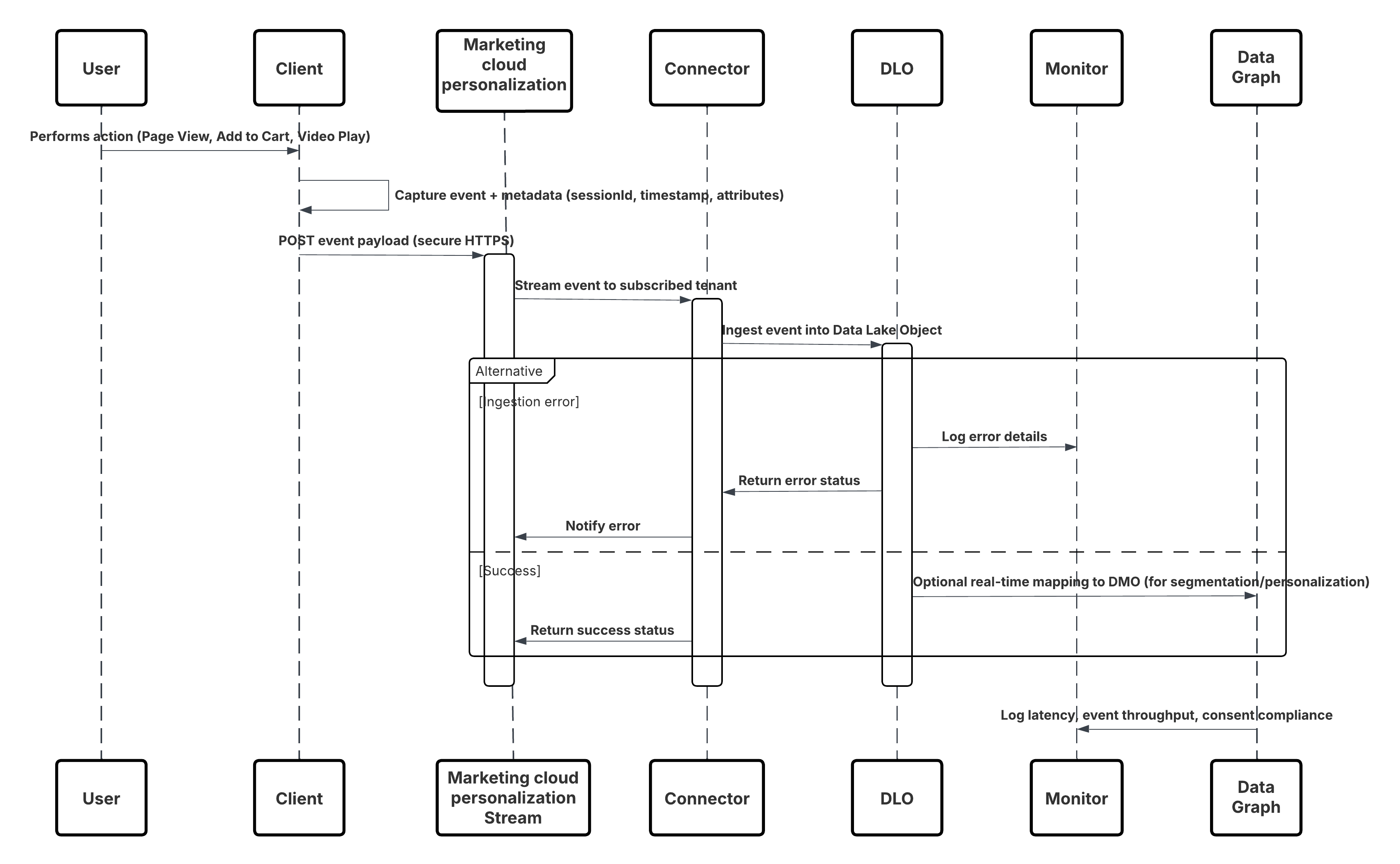

Context

Ce schéma permet de capturer des données d'interaction utilisateur précises et volumineuses, telles que des vues de page, des clics sur des boutons, des impressions de produits et des lectures vidéo, à partir de sites Web et d'applications mobiles en temps réel. Elle est fondamentale pour offrir une personnalisation instantanée, où chaque interaction numérique peut influencer dynamiquement l'expérience utilisateur et favoriser l'engagement.

Problème

Comment une entreprise peut-elle capturer et traiter un flux continu d'événements comportementaux à partir de propriétés numériques, couvrant des millions d'interactions utilisateur par minute, et rendre ces données immédiatement disponibles dans Data 360 pour piloter la segmentation, la personnalisation et l'activation en temps réel ?

Forces

Ce cas d'utilisation introduit plusieurs défis de conception qui nécessitent une architecture d'ingestion à faible latence spécialement conçue :

- Débit extrême : Les sites Web ou les applications mobiles à fort trafic peuvent émettre des millions d'événements par minute. La couche d'ingestion doit évoluer horizontalement pour gérer ce volume sans perte d'événement ni contre-pression, ce qui garantit une latence constante sous des charges de pointe.

- Instrumentation côté client : Contrairement aux intégrations pilotées par le serveur, ce modèle dépend des kits de développement côté client. Une balise JavaScript (Salesforce Interactions SDK) doit être incorporée à chaque page, ou un kit de développement natif intégré à des applications mobiles. Cela nécessite un déploiement client robuste, la gestion des versions et la gouvernance du schéma d'événements.

- Traitement des événements à faible latence : Les actions de l'utilisateur, telles que « ajouter au panier d'achat » ou « lecture vidéo », doivent atteindre Data 360 en quelques secondes, ce qui permet l'activation en temps réel et des réponses contextuelles (par exemple, des offres ciblées, des recommandations personnalisées).

- Harmonisation et résolution de l'identité des données : Les événements capturés contiennent souvent des identifiants anonymes (cookies, ID d'appareil, jetons de session). Pour piloter les cas d'utilisation Customer 360, ils doivent être mappés avec des profils connus via la résolution de l'identité de Data 360 et harmonisés avec le Customer 360 Data Model.

Solution

L'approche recommandée consiste à utiliser le connecteur Salesforce Marketing Cloud Personalization, un encours en continu entièrement géré et natif conçu pour l'ingestion comportementale à haut débit.

| Zone de solution | Ajustement | Commentaires / Détails d'implémentation |

|---|---|---|

| Capture d'événement basée sur le kit de développement | Meilleur | Déployez le kit de développement Salesforce Interactions (web) ou le kit de développement natif (mobile). Ces bibliothèques légères capturent et sérialisent les interactions des utilisateurs en temps réel, en joignant des métadonnées (ID de session, horodatage, contexte). |

| Event Streaming Pipeline | Meilleur | Les événements sont envoyés au service de streaming d'événements Marketing Cloud Personalization sur HTTPS sécurisé. Cette couche est évolutive horizontalement et optimisée pour la transmission à faible latence (<2s). |

| Intégration Data 360 | Meilleur | Le connecteur de personnalisation de Data 360 s'abonne au fil en continu, ingérant chaque événement dans un objet lac de données (DLO) en temps quasi réel. |

| Mappage de modèle de données | Meilleures pratiques | L'objet lac de données ingéré est mappé avec des objets modèle de données Customer 360. Cela permet de lier des utilisateurs anonymes et connus via la Résolution de l'identité. |

| Activation du graphique en temps réel | Facultatif / Recommandé | Insérez des objets modèle de données mappés dans le graphique en temps réel pour une segmentation instantanée, déclenchant des actions personnalisées via des workflows Einstein ou Agentforce. |

| Quand ne pas utiliser | Suboptimal | Ce schéma n'est pas idéal lorsque : Les données sources sont client Web et événements (utilisez à la place l'API Ingestion). L'organisation ne contrôle pas les clients Web/mobile. Le suivi du comportement en temps réel n'est pas requis (utilisez l'ingestion par lot). |