Las integraciones modernas de Salesforce deben admitir mucho más que un simple intercambio de datos. Se espera que potencien experiencias de clientes en tiempo real, coordinen acciones entre múltiples sistemas y operen de forma fiable a escala de la compañía, todo ello cumpliendo al mismo tiempo estrictos requisitos de seguridad y cumplimiento. Por lo tanto, la selección del enfoque de integración correcto es una decisión arquitectónica crítica, no un detalle de implementación. Considere un escenario de compañía común. Un cliente completa una compra en una aplicación móvil, desencadenando una comprobación de aptitud en tiempo real para una oferta personalizada. Al mismo tiempo, los datos de transacciones deben registrarse en un sistema ERP, los atributos de clientes actualizarse en Salesforce y los análisis transmitirse a un lago de datos, sin introducir latencia, duplicación de datos o riesgo de cumplimiento. Escenarios como este son ahora típicos en entornos modernos de Salesforce, donde Salesforce rara vez opera de forma aislada y debe integrarse a la perfección con un ecosistema más amplio de aplicaciones y plataformas de datos. Esta guía existe para ayudar a los arquitectos y desarrolladores a diseñar esas integraciones con claridad y confianza. En vez de centrarse en implementaciones de punto a punto, presenta un conjunto de patrones de integración que abordan escenarios de compañía recurrentes, como orquestación de procesos, sincronización de datos y acceso a datos en tiempo real. Cada patrón enfatiza la intención arquitectónica, las compensaciones y los modelos de ejecución, permitiendo a los equipos tomar decisiones de diseño fundamentadas que se amplían y perduran. Dentro de este documento, encontrará:

- Patrones de integración que representan “arquetipos” de compañía comunes entre procesos, datos y escenarios de acceso virtual

- Un marco de trabajo de selección de patrones para ayudar a identificar el enfoque correcto basándose en la intención de integración y el tiempo de ejecución

- Directrices prácticas sobre consideraciones de escalabilidad, resiliencia, gobernanza y seguridad

- Mejores prácticas extraídas de implementaciones reales de Salesforce y Data 360 El objetivo de este documento es proporcionar un lenguaje arquitectónico compartido para la integración, ayudando los equipos a diseñar soluciones que equilibren desempeño, flexibilidad y Trust mientras se alinean con datos de compañía y estrategias de gobernanza.

Este documento es para diseñadores y arquitectos que necesitan integrar datos de otras aplicaciones en su compañía con Salesforce Data 360 (anteriormente Data Cloud). Este contenido es una destilación de muchas implementaciones correctas por arquitectos y socios de Salesforce. Para familiarizarse con las funciones y opciones de integración disponibles para la adopción a gran escala de Data 360, lea las secciones Resumen de patrón y Guía de selección de patrón a continuación. Los arquitectos y desarrolladores deben tener en cuenta estos detalles de patrón y mejores prácticas durante la fase de diseño e implementación de proyectos de interacción de datos en Data 360. Si se implementan correctamente, estos patrones le permiten llegar a producción lo más rápido posible y tener el conjunto de aplicaciones más estable, ampliable y sin mantenimiento posible. Los propios arquitectos consultores de Salesforce utilizan estos patrones como puntos de referencia durante revisiones arquitectónicas y los mantienen y mejoran activamente. Como con todos los patrones, este contenido cubre la mayoría de los escenarios de integración, pero no todos. Aunque Salesforce permite la integración de la interfaz de usuario (UI), mashups, por ejemplo, dicha integración está fuera del ámbito de este documento.

Cada patrón de integración sigue una estructura coherente. Esto proporciona coherencia en la información proporcionada en cada patrón y también facilita la comparación de patrones.

- Nombre: El identificador de patrón que también indica el tipo de integración contenida en el patrón.

- Contexto: Escenario de integración general que soluciona el patrón. El contexto proporciona información acerca de lo que los usuarios están intentando lograr y cómo se comporta la aplicación para dar cobertura a los requisitos.

- Problema: Expresado como una pregunta, este es el escenario que el patrón está diseñado para resolver. Lea esta sección para comprender si el patrón es apropiado para su escenario de integración.

- Fuerzas: Las restricciones y circunstancias que hacen que el escenario establecido sea difícil de resolver.

- Solución: La forma recomendada de resolver el escenario de integración.

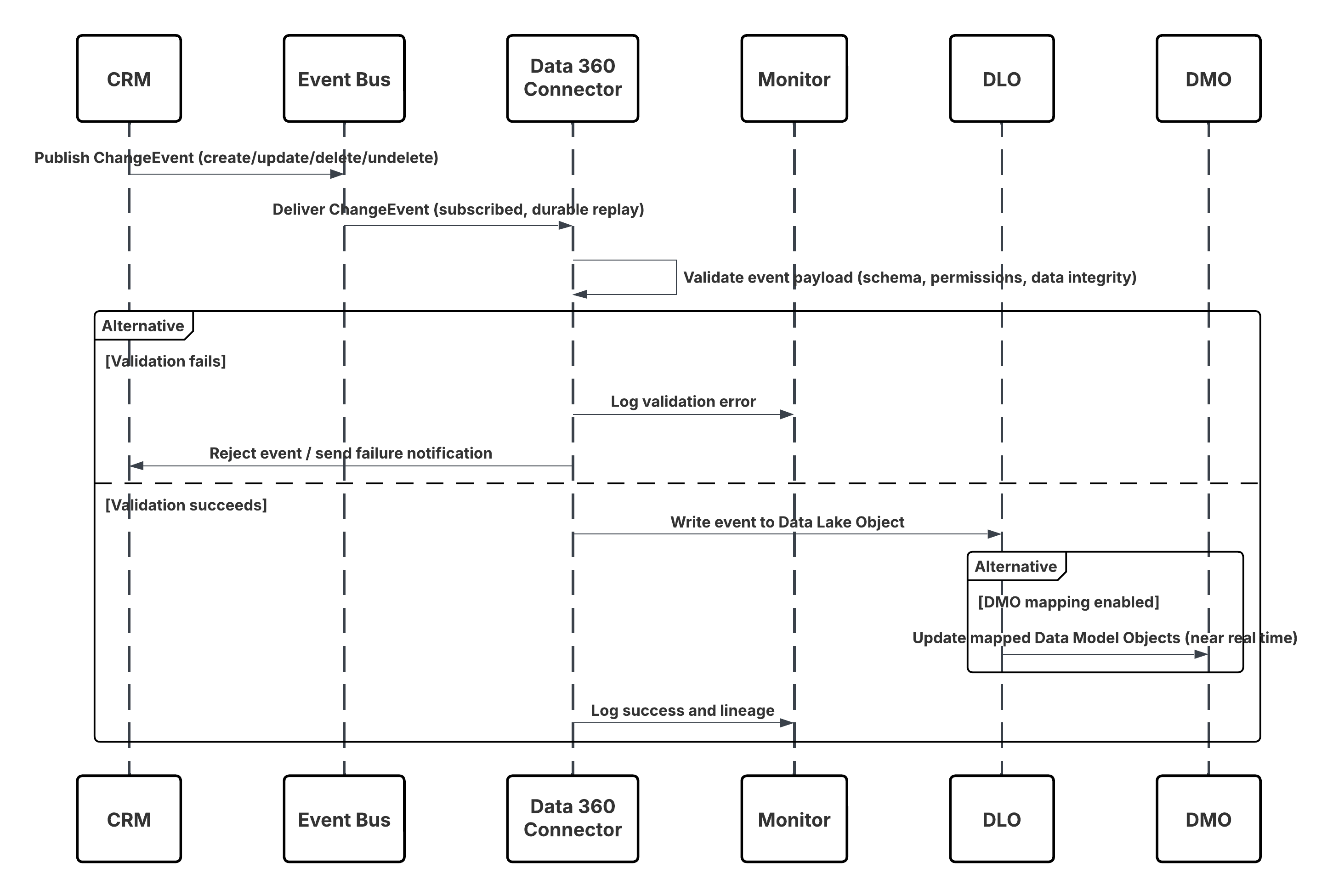

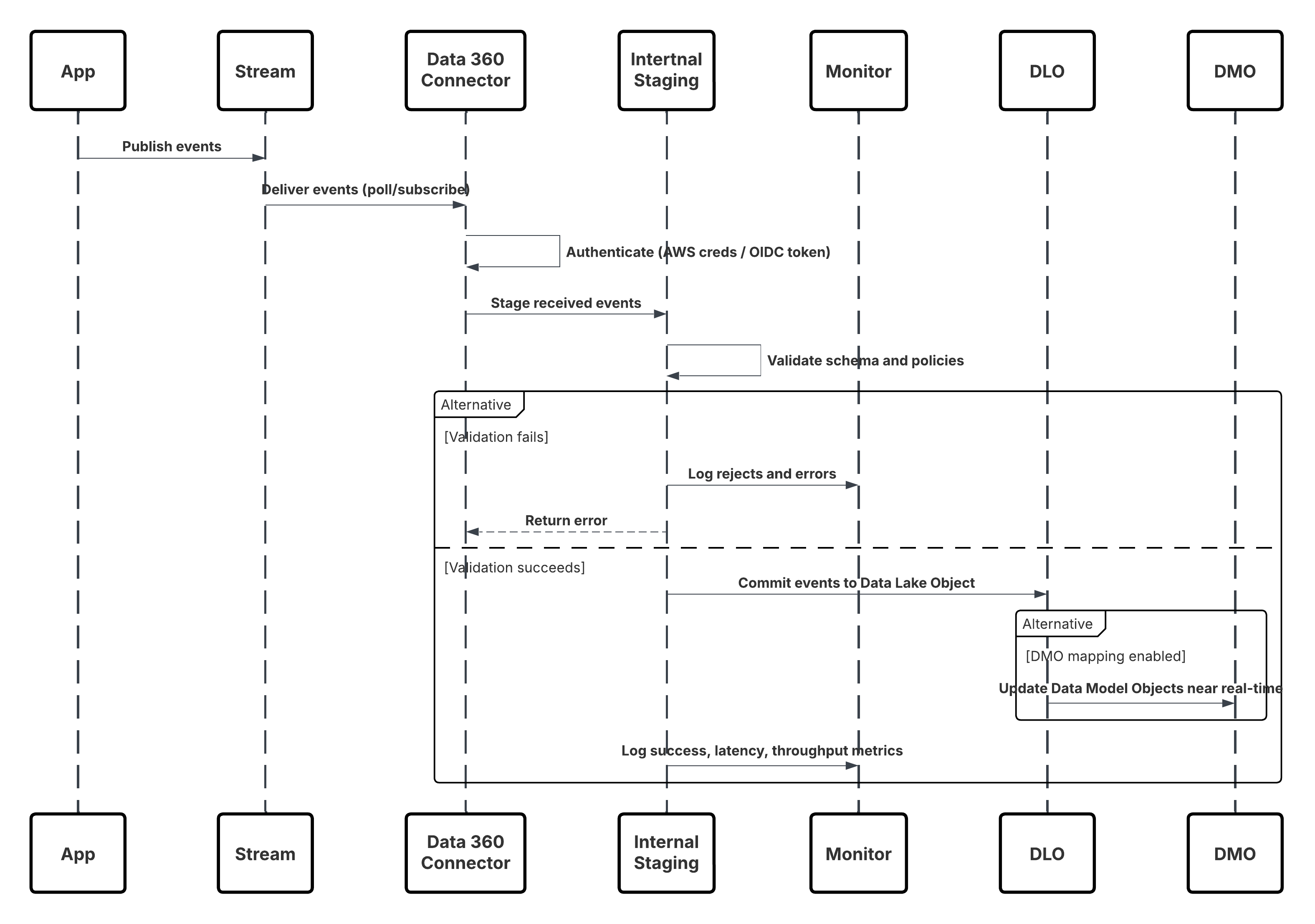

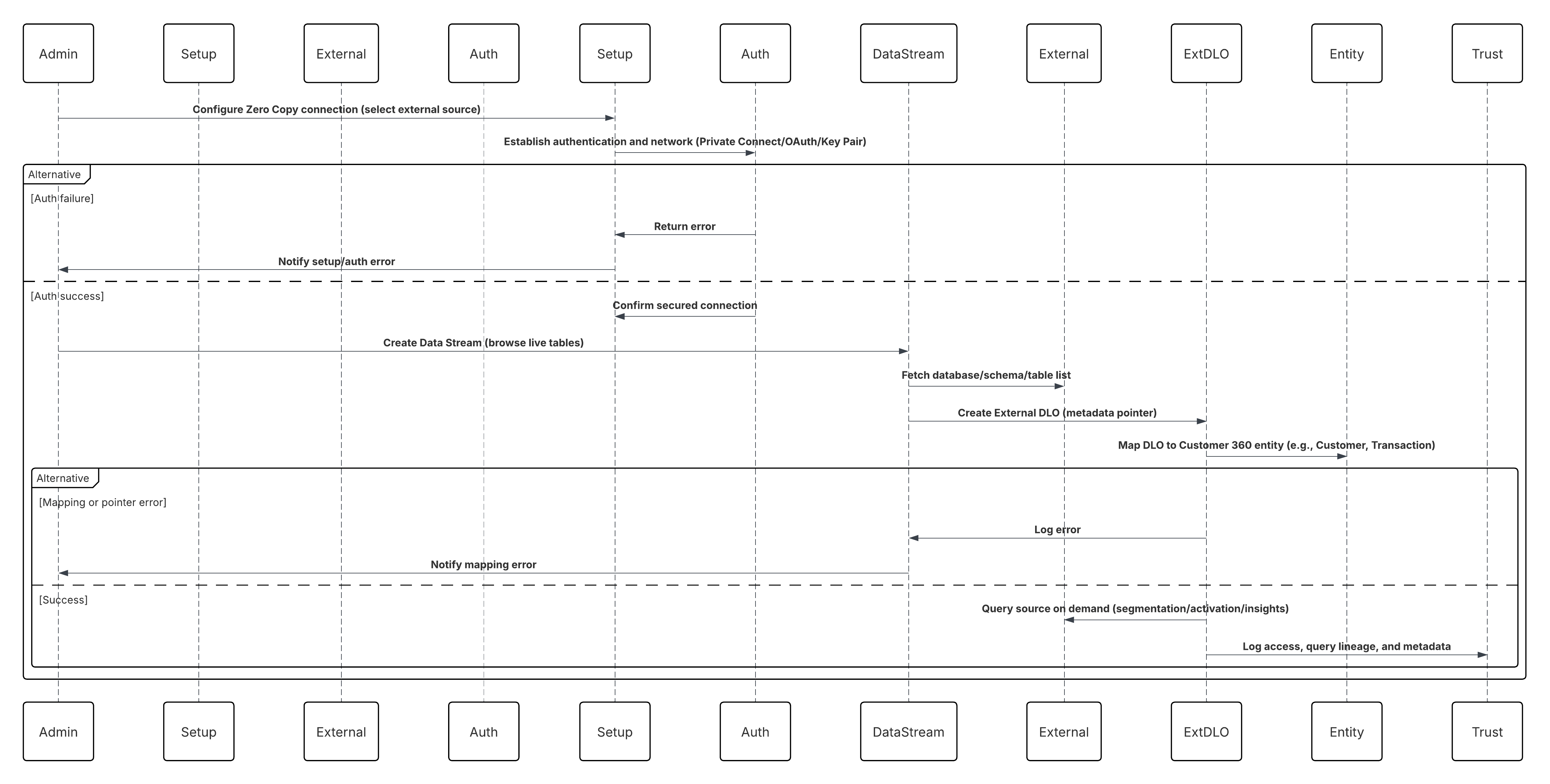

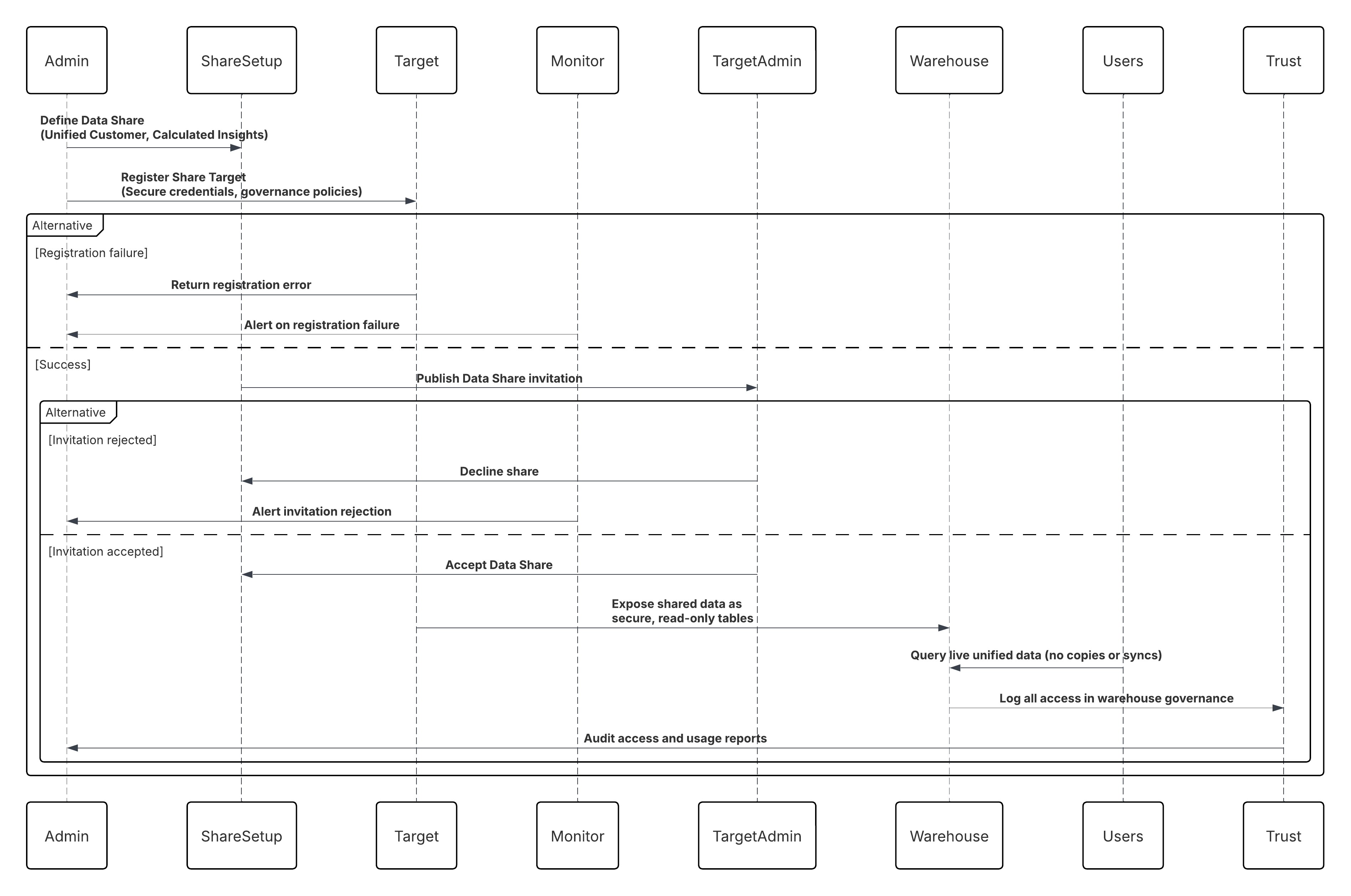

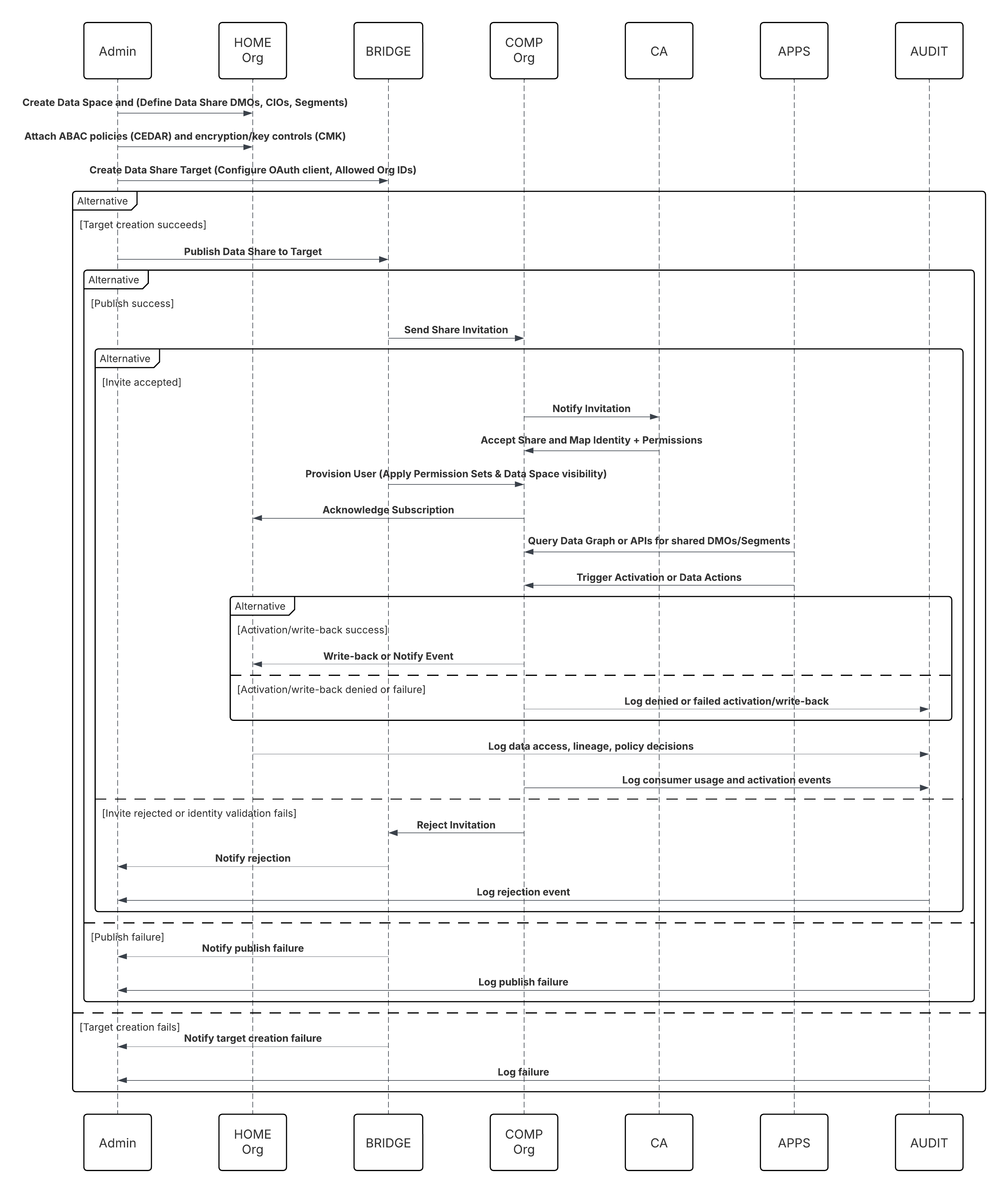

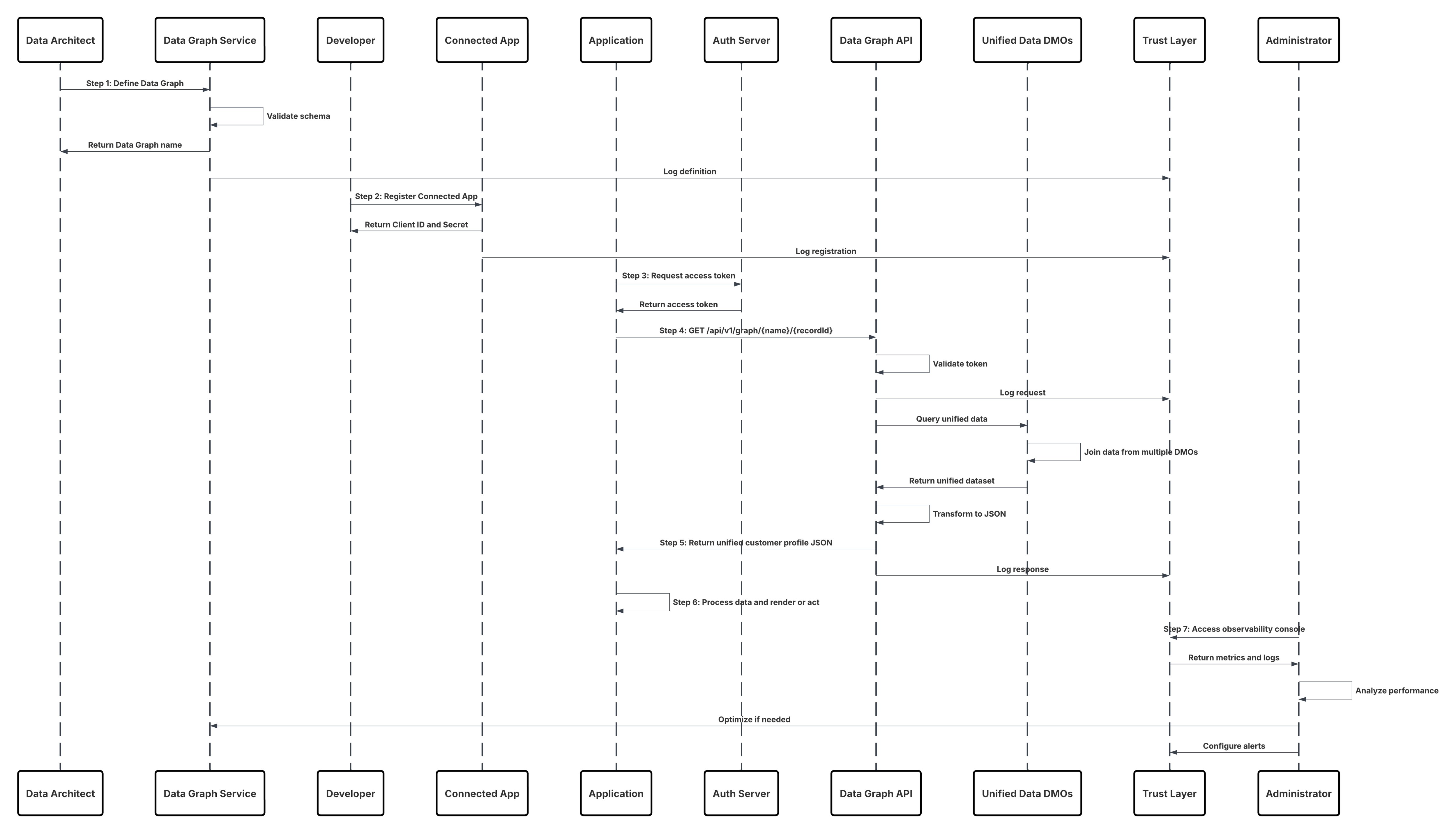

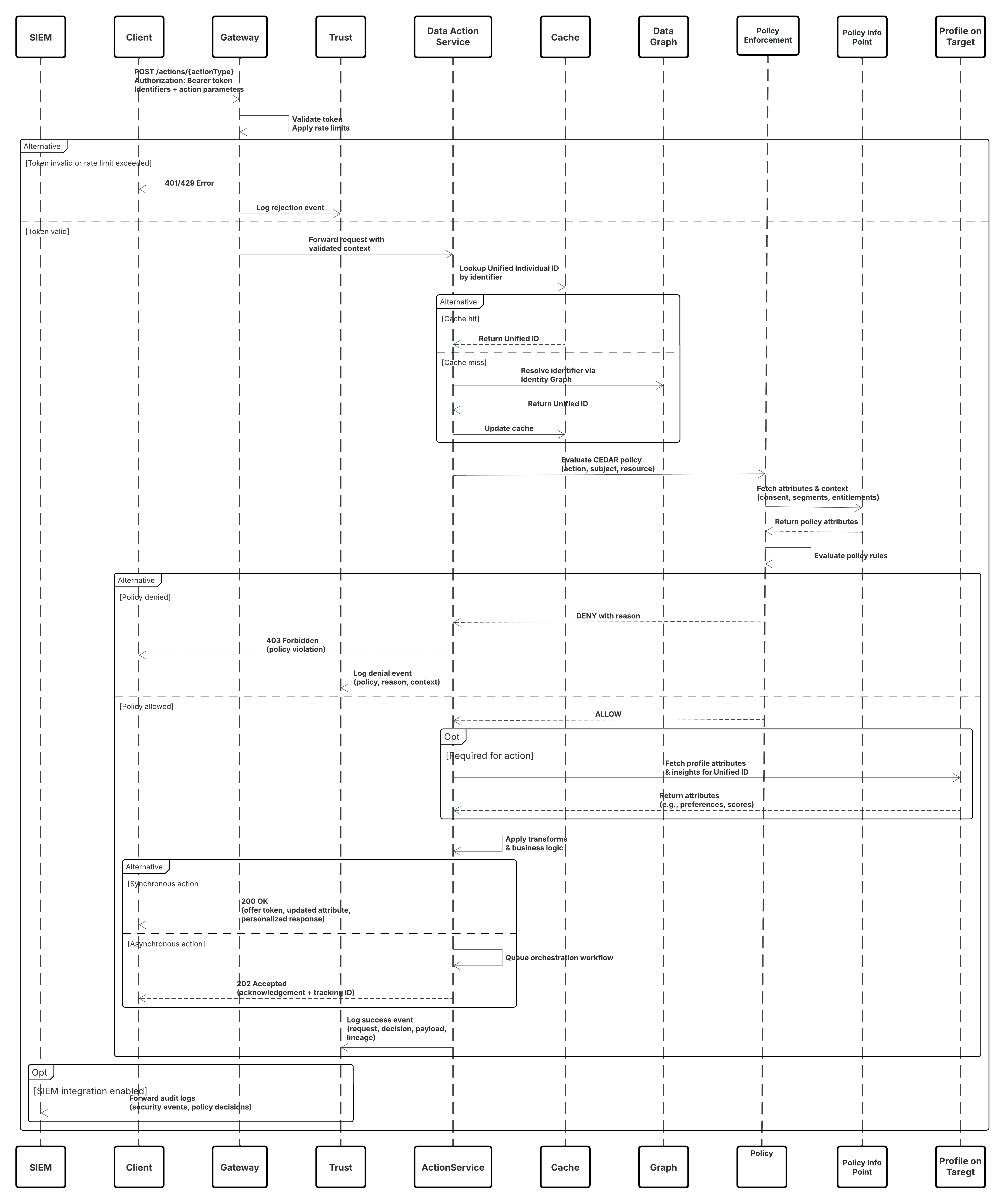

- Boceto: Un diagrama de secuencia UML que le muestra cómo la solución aborda el escenario.

- Resultados: Explica los detalles de cómo aplicar la solución a su escenario de integración y cómo resuelve las fuerzas asociadas con ese escenario. Esta sección también contiene nuevos retos que pueden surgir como resultado de la aplicación del patrón.

- Barras laterales: Secciones adicionales relacionadas con el patrón que contienen problemas técnicos clave, variaciones del patrón, problemas específicos del patrón, etc.

- Ejemplo: Un escenario del mundo real que describe cómo se utiliza el patrón de diseño en un escenario de Salesforce del mundo real. El ejemplo explica los objetivos de integración y cómo implementar el patrón para alcanzar esos objetivos.

Utilice esta tabla como una tabla de contenidos para los patrones de integración contenidos en este documento.

| Nivel de patrón1 | Nivel de patrón2 | Patrón | Escenario |

|---|---|---|---|

| Patrones de ingreso de datos: Datos entrantes | Patrones de ingreso por lotes | Ingreso masivo de datos desde Cloud Storage | Los datos se ingresan desde un origen de almacenamiento de Enterprise Cloud como Amazon S3, Azure Blob o Google Cloud Storage en Data 360 en forma de grandes lotes de datos sin procesar (por ejemplo, transacciones o registros de productos). |

| Ingreso masivo de datos desde Salesforce Cloud | Data 360 recibe datos de CRM de forma masiva desde múltiples organizaciones de Salesforce (por ejemplo, Sales Cloud, Service Cloud) para crear perfiles de clientes unificados. | ||

| Patrones de transmisión e ingreso en tiempo real | Ingreso dirigido por eventos a través de API de ingreso: Transmisión | Data 360 se suscribe a extremos de ingreso de transmisión que reciben cargas de eventos continuas (por ejemplo, eventos de compra, telemetría de IoT) desde sistemas de compañía para actualizaciones de perfil en tiempo real. | |

| Ingreso de comportamiento web y móvil en tiempo real | Data 360 recopila y procesa datos de comportamiento de sitios web y aplicaciones móviles en tiempo real a través de SDK para enriquecer mediciones de implicación y modelos de personalización. | ||

| Sincronización de CRM casi en tiempo real a través de transmisión | Data 360 recibe actualizaciones de datos de CRM (por ejemplo, cambios de contacto, caso u oportunidad) casi en tiempo real a través de transmisiones de eventos para mantener una vista Customer 360 sincronizada continuamente. | ||

| Ingreso de transmisiones de eventos desde plataformas de mensajería de nube: Kinesis y MSK | Data 360 consume datos de transmisión directamente desde plataformas de eventos en la nube como AWS Kinesis o Kafka (MSK) para procesar eventos operativos o de IoT de alta frecuencia. | ||

| Cero patrones de copia: entrante y saliente | Copia de cero entrante: Plataformas externas en Data 360 | Data 360 consulta conjuntos de datos externos (por ejemplo, Snowflake, BigQuery) on demand a través de Cero ingreso de copia, sin mover físicamente datos en Salesforce. | |

| Copia cero saliente: Data 360 en plataformas externas | Los sistemas externos como Databricks o Tableau acceden a segmentos enriquecidos y perspectivas en Data 360 a través de conexiones salientes de copia cero sin replicación de datos. | ||

| Plataforma de datos de múltiples organizaciones unificada con Data Cloud One | Data Cloud One unifica múltiples organizaciones de Salesforce y orígenes de datos externos bajo un modelo semántico y de metadatos compartidos, proporcionando un Customer 360 coherente sin duplicación de datos. | ||

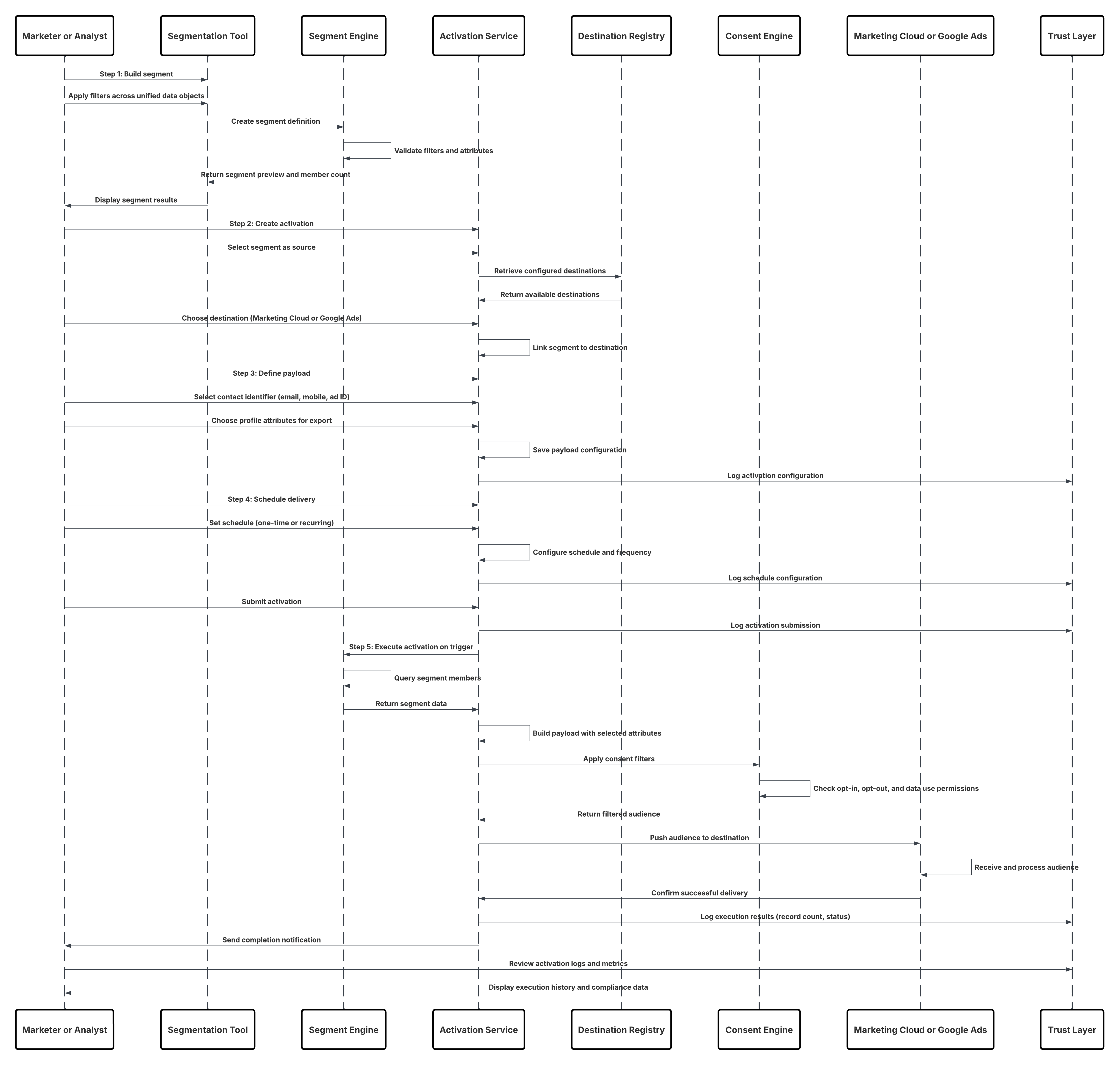

| Patrones de activación de datos: Datos salientes | Patrones de activación por lotes | Activación de segmentos en plataformas de marketing y publicidad | Data 360 activa segmentos de clientes depurados directamente en Marketing Cloud, Meta, Google Ads u otras plataformas de anuncios para la entrega de campañas personalizadas |

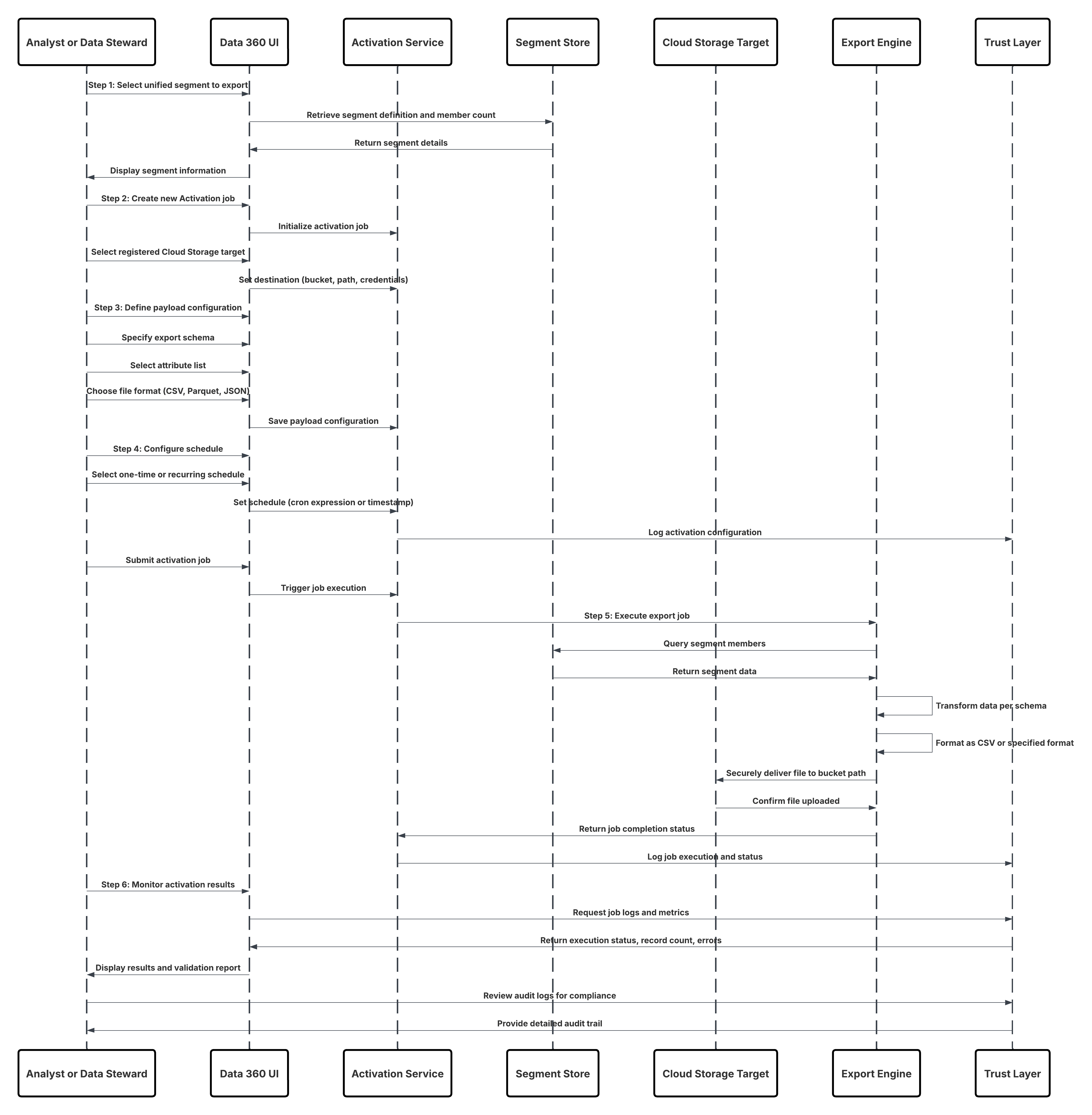

| Exportación de datos a Cloud Storage | Data 360 exporta conjuntos de datos unificados o filtrados (por ejemplo, registros de clientes consentidos) como archivos CSV o Parquet a almacenamiento de Enterprise Cloud para análisis o archivado de cumplimiento. | ||

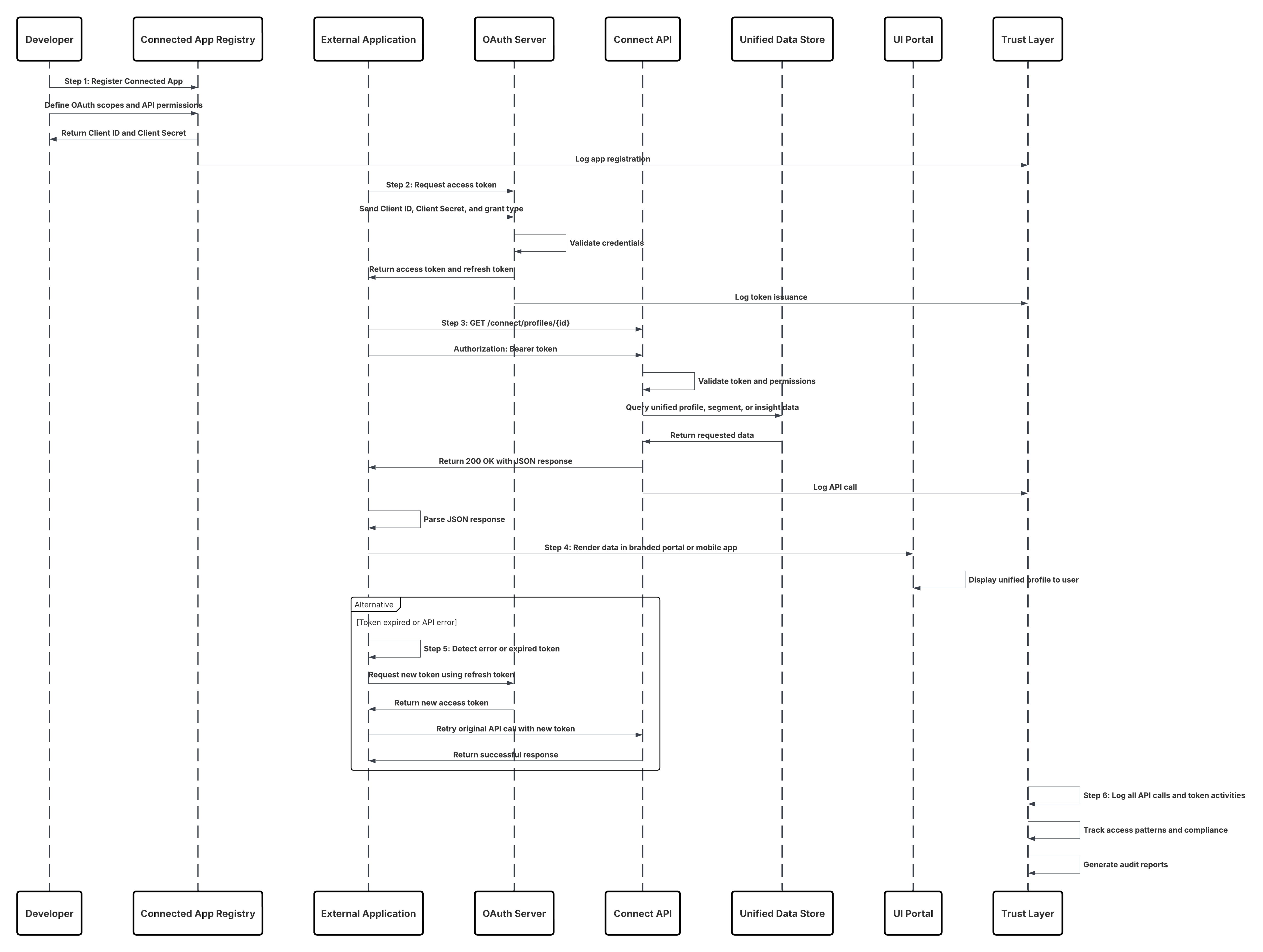

| Activación basada en API On Demand | Integración de aplicaciones personalizadas a través de la API de Connect | Las aplicaciones externas invocan la API de Data 360 Connect en tiempo real para recuperar o desencadenar acciones personalizadas (por ejemplo, comprobación de balance de fidelidad o generación de ofertas de IA) basándose en datos de clientes actuales.Las aplicaciones web o móviles creadas a medida recuperan perspectivas de Data 360 armonizadas de forma segura a través de la API de REST de Connect para mostrar en las interfaces de usuario de compañías o socios. | |

| Recuperación de perfil de cliente completa a través de API de gráficos de datos | Un sistema recupera el perfil unificado de un cliente utilizando la API de gráfico de datos, devolviendo una representación JSON en tiempo real unida previamente de la vista completa de 360° para la decisión o la personalización. | ||

| Acciones de datos en tiempo real | Acción de datos en tiempo real Conversión de señales de clientes en acciones instantáneas | Data 360 detecta y procesa un evento en vivo (por ejemplo, actualización de consentimiento, desencadenador de compra) e invoca inmediatamente un sistema conectado o Salesforce Flow para una acción descendente.Una señal de actividad de cliente (por ejemplo, riesgo de abandono detectado) en Data 360 desencadena una acción instantánea en tiempo real, como la actualización de CRM, la invocación de puntuaje Einstein o el inicio de una trayectoria de retención. |

Los patrones de integración de este documento se clasifican en tres categorías: datos, procesos e integraciones visuales.

Los patrones de integración de datos en Data 360 abordan el movimiento y la sincronización de datos entre sistemas para garantizar que tanto Data 360 como las plataformas externas albergan información coherente, oportuna y fiable. Estos patrones normalmente gestionan flujos de datos de gran volumen y gran escala y se basan en oportunidades en curso gobernadas que aplican reglas de coherencia, seguimiento de linaje y masterización de esquemas.

- Los patrones de ingreso por lotes representan la capa fundamental de incorporación de datos de compañía. El ingreso masivo de datos desde servicios de almacenamiento en la nube como AWS S3, Azure Blob o Google Cloud Storage permite cargar conjuntos de datos históricos de gran tamaño periódicamente en Data 360 para la resolución de identidad, segmentación y análisis. Del mismo modo, el ingreso masivo desde Salesforce Cloud (como Sales, Service o Marketing Cloud) utiliza conectores nativos y Transmisiones de datos para aportar datos de CRM a la capa de datos unificada, garantizando Armonización y continuidad entre sistemas de implicación.

- Los patrones de transmisión e ingreso en tiempo real amplían esto capturando datos de eventos de alta velocidad. El ingreso dirigido por eventos a través de la API de ingreso permite a los sistemas externos transmitir continuamente la actividad de los clientes en Data 360. El ingreso de comportamiento web y móvil en tiempo real captura datos de interacciones y transmisiones de clics directamente desde puntos de contacto digitales para dirigir la personalización inmediata. La sincronización de CRM casi en tiempo real a través de las API de transmisión garantiza que los atributos del cliente y las actualizaciones de consentimiento se reflejen rápidamente entre sistemas. El ingreso de transmisiones de eventos desde plataformas de mensajería como Amazon Kinesis o Confluent MSK admite oportunidades en curso de alto rendimiento continuas, alineando Data 360 con arquitecturas de eventos de compañía.

- Unified Multi-Org Data Platform with Data Cloud One ejemplifica aún más la integración de datos, proporcionando un entorno consolidado para unificar datos desde múltiples organizaciones de Salesforce y orígenes externos bajo una gobernanza común y una capa semántica. Esto permite a las organizaciones alcanzar la coherencia de datos de toda la compañía, modelos de datos compartidos y análisis ampliables.

- En la fase de activación, los patrones de activación por lotes siguen el mismo principio de integración de datos. Los segmentos depurados en Data 360 se exportan en trabajos programados a plataformas de marketing y publicidad descendentes, como Marketing Cloud, Meta Ads o Google Ads, donde desencadenan la ejecución de campañas. Del mismo modo, los conjuntos de datos se pueden exportar a destinos de almacenamiento en la nube para impulsar oportunidades en curso de análisis externo y ciencia de datos. En todos estos casos de uso, Data 360 actúa como la fuente de la verdad para datos de clientes sincronizados y depurados.

Los patrones de integración de procesos en Data 360 implican desencadenar u orquestar procesos de negocio entre sistemas casi en tiempo real. Estos patrones permiten que Data 360 participe activamente en flujos de trabajo de compañía, permitiendo respuestas contextuales y activación de datos dinámica.

- La activación basada en API On-Demand activa escenarios de implicación en tiempo real. A través de la API de Connect, las aplicaciones personalizadas pueden consultar o activar perfiles de clientes directamente desde Data 360 como parte de procesos operativos, como una consola de agente recuperando perspectivas de perfil unificadas durante una interacción de cliente. La Recuperación completa de perfiles de clientes a través de la API de gráficos de datos admite aplicaciones compuestas y microservicios que se basan en acceso dirigido por API al gráfico de entidad completo de un cliente, permitiendo experiencias dinámicas sin segmentos preestablecidos.

- Las acciones de datos en tiempo real amplían aún más este enfoque de integración al permitir la capacidad de respuesta inmediata. Cuando se detecta una señal de cliente, como una compra, un envío de formulario o un evento de umbral, Data 360 puede desencadenar acciones como la actualización de un registro de CRM, la invocación de un gancho web externo o el inicio de un flujo de trabajo de oferta personalizado. Estos patrones encarnan una verdadera orquestación de procesos, uniendo Inteligencia de clientes en tiempo real con la ejecución operativa automatizada.

Los patrones de integración virtual en Data 360 permiten el acceso en vivo a orígenes de datos externos o federados sin copiar físicamente o duplicar datos. Estas son críticas para las compañías que requieren información actualizada gobernada en el momento de la consulta minimizando al mismo tiempo el movimiento de datos.

- Federación de datos de copia cero entrante (Plataformas externas a Data 360) permite a los sistemas externos, como almacenes de datos o lagos de datos, compartir conjuntos de datos con Data 360 a través de conexiones seguras y gobernadas (por ejemplo, Colaboración de datos segura de Snowflake). Esto garantiza que Data 360 pueda acceder y operar en datos externos virtualmente, preservando la actualización y eliminando replicaciones innecesarias.

- La colaboración de datos de copia cero saliente (Data 360 to External Platforms) permite a Data 360 exponer conjuntos de datos depurados para consumo externo, como modelado de IA, inteligencia de negocio o análisis avanzado, a través de mecanismos de federación de datos y consulta en vivo seguros. La selección de la mejor estrategia de integración para su sistema no es trivial. Existen muchos aspectos a tener en cuenta y muchas herramientas que se pueden utilizar, siendo algunas herramientas más apropiadas que otras para ciertas tareas. Cada patrón aborda áreas críticas específicas incluyendo las funciones de cada uno de los sistemas, el volumen de datos, la gestión de fallos y la transaccionalidad.

Al seleccionar un patrón de integración, comience respondiendo a dos preguntas fundamentales que dan forma al diseño y el comportamiento generales de la integración. ¿Qué está integrando? — Proceso, Datos o Acceso virtual Esta dimensión define el propósito principal de la integración.

- Las integraciones de procesos se centran en orquestar flujos de trabajo de negocio y coordinar acciones entre sistemas.

- Las integraciones de datos se centran en la sincronización, el enriquecimiento o la propagación de datos entre sistemas.

- Las integraciones virtuales se centran en acceder a datos externos en tiempo real sin copiarlos o persistir en Salesforce o Data 360. Comprender esta intención ayuda a determinar el nivel de orquestación, el movimiento de datos y el acoplamiento requeridos entre sistemas.

- ¿Cómo se necesita ejecutar?: El método Síncrono o Asíncrono define el modelo de ejecución de la integración.

- Las integraciones síncronas son en tiempo real y de bloqueo, donde el llamante espera una respuesta inmediata, utilizada habitualmente para escenarios dirigidos por el usuario o de validación.

- Las integraciones asíncronas no son de bloqueo y están desacopladas, diseñadas para gestionar procesos de escala, larga ejecución, reintentos y altos volúmenes de datos. Juntos, estas dos dimensiones (intención de integración y tiempo de ejecución) proporcionan un marco claro y coherente para seleccionar el patrón de integración correcto mientras equilibran la experiencia del usuario, la capacidad de ampliación y la resiliencia operativa. Nota: Una integración puede requerir un middleware externo o una solución de integración (por ejemplo, Enterprise Service Bus) dependiendo de qué aspectos se aplican a su escenario de integración.

Esta tabla enumera los patrones y sus aspectos clave para ayudarle a determinar qué patrón se ajusta mejor a sus requisitos cuando su integración es desde Salesforce a otro sistema

| Tipo | Cronología | Consideraciones de salida |

|---|---|---|

| Integración de datos | Asíncrono | Activación de segmentos en plataformas de marketing y publicidad |

| Integración de procesos/datos | Síncrono | Integración de aplicaciones personalizadas a través de la API de Connect Recuperación de perfil de cliente completa a través de API de gráficos de datos |

| Integración de datos | Síncrono | Acción de datos en tiempo real Conversión de señales de clientes en acciones instantáneas |

| Integración virtual (utilizando copia cero) | Asíncrono | Copia cero saliente: Data 360 en plataformas externas |

| Integración virtual | Asíncrono | Plataforma de datos de múltiples organizaciones unificada con Data Cloud One |

Esta tabla enumera los patrones y sus aspectos clave para ayudarle a determinar el patrón que mejor se ajusta a sus requisitos cuando su integración es desde otro sistema en Salesforce.

| Tipo | Cronología | Consideraciones sobre el ingreso |

|---|---|---|

| Integración de datos | Asíncrono | Ingreso masivo de datos desde Cloud Storage Ingreso masivo de datos desde Salesforce Cloud |

| Integración de datos | Asíncrono | Ingreso de transmisiones de eventos desde plataformas de mensajería de nube: Kinesis y MSK Sincronización de CRM casi en tiempo real a través de transmisión |

| Integración de procesos | Síncrono | Ingreso dirigido por eventos a través de API de ingreso: Transmisión Ingreso de comportamiento web y móvil en tiempo real |

| Integración virtual | Asíncrono | Copia de cero entrante: Plataformas externas en Data 360 |

Esta tabla enumera algunos términos clave relacionados con middleware y sus definiciones con respecto a estos patrones.

| Plazo | Definición |

|---|---|

| Gestión de eventos | La gestión de eventos hace referencia a la recepción, el enrutamiento y la respuesta a incidencias identificables desde un sistema o una aplicación de origen. El middleware gestiona eventos identificando el extremo de destino, reenviando el evento y desencadenando la acción de negocio requerida (por ejemplo, registro, reintentos o activación de servicios descendentes). En arquitecturas de Data 360, la gestión de eventos es clave para el ingreso de datos en tiempo real, desencadenadores de activación y patrones de publicación/suscripción. Los eventos pueden originarse desde sistemas externos (Kafka, AWS Kinesis) o Eventos de Salesforce Platform y se enrutan por middleware o el bus de eventos de Data 360 para su procesamiento inmediato. |

| Conversión de protocolo | La conversión de protocolos permite la comunicación entre sistemas utilizando diferentes estándares de transporte de datos. El middleware traduce protocolos propios o heredados (como AMQP, MQTT, FTP) en protocolos de Data 360 compatibles (REST, gRPC o HTTPS). Esto garantiza la interoperabilidad entre sistemas heterogéneos. Como Data 360 no gestiona de forma nativa la conversión de protocolos, el middleware proporciona la capa de adaptación, encapsulando o transformando mensajes en un formato que las API y conectores de Data 360 pueden interpretar. |

| Traducción y transformación | La traducción y la transformación garantizan la interoperabilidad asignando un formato de datos o esquema a otro. Middleware realiza estas transformaciones para alinear diversas cargas de datos (CSV, XML, JSON) con objetos de modelo de datos (DMO) y objetos de capa de datos unificados (UDLO) de Data 360. Esto incluye la limpieza, el enriquecimiento y la aplicación de asignaciones semánticas u ontológicas antes de la ingesta. Aunque Salesforce ofrece herramientas de transformación como Recetas de Preparación de datos, las transformaciones complejas (especialmente para Armonización semántica) se gestionan mejor en middleware. |

| Cola y almacenamiento en memoria intermedia | Las colas y el almacenamiento en memoria intermedia dependen del paso de mensajes asíncronos para garantizar una comunicación resiliente y desvinculada. Las plataformas de middleware (por ejemplo, MuleSoft, Kafka o Azure Event Hub) proporcionan colas persistentes que almacenan temporalmente datos cuando Data 360 o sistemas descendentes están ocupados o no se puede acceder a ellos. Esto evita la pérdida de datos y admite reintentos de ingreso o activación casi en tiempo real. Data 360 admite el ingreso de transmisiones y la mensajería saliente basada en flujos, pero el middleware suele gestionar las colas duraderas y la entrega garantizada. |

| Protocolos de transporte síncronos | Los protocolos de transporte síncronos implican operaciones de bloqueo de solicitudes/respuestas en tiempo real. El remitente espera una respuesta antes de continuar. En Data 360, estos se utilizan para activaciones basadas en API on-demand, enriquecimiento en tiempo real o búsquedas de perfil, donde se requieren respuestas de inmediato. El middleware garantiza la fiabilidad de la conexión y gestiona reintentos o gestión de reserva para llamadas de API de Data 360 síncronas. |

| Protocolos de transporte asíncronos | Los protocolos de transporte asíncronos admiten la comunicación desvinculada no bloqueada donde el remitente continúa procesando sin esperar una respuesta. El middleware gestiona flujos asíncronos para activaciones por lotes, ingreso de transmisiones y activación dirigida por eventos. Esto permite un alto rendimiento y capacidad de recuperación, clave para la transmisión de eventos y patrones de ingreso de datos casi en tiempo real en Data 360. |

| Enrutamiento de mediación | El enrutamiento de mediación define un flujo de mensajes complejo entre sistemas, garantizando que los datos o eventos correctos llegan al consumidor correcto. El middleware actúa como mediador, gestionando la lógica de enrutamiento basándose en reglas, encabezados, contenido o tipo de evento. En integraciones de Data 360, la mediación garantiza que los eventos y las actualizaciones de perfil desde múltiples sistemas se enruten correctamente a las API de ingreso de datos, los extremos de activación o los consumidores externos. Esto simplifica la orquestación y admite la sincronización de datos de múltiples sistemas. |

| Coreografía de proceso y Orquestación de servicio | La coreografía de procesos y la orquestación coordinan procesos de múltiples sistemas. Coreografía admite flujos autónomos dirigidos por eventos asíncronos, donde los sistemas actúan basándose en reglas compartidas sin un controlador central. Orquestación es un flujo gestionado de forma centralizada que dirige la ejecución del servicio. En arquitecturas de Data 360, el middleware gestiona la orquestación para el ingreso y la activación entre sistemas, mientras que los flujos de trabajo o flujos de Salesforce gestionan coreografías ligeras dentro de la plataforma. La orquestación compleja, que requiere coordinación de transacciones o gestión de estados, se recomienda en la capa de middleware. |

| Transacción (Cifrado, Firma, Entrega fiable, Gestión de transacciones) | La transaccionalidad garantiza operaciones atómicas, coherentes, aisladas y duraderas (ACID) entre sistemas. Salesforce y Data 360 son transaccionales dentro de sus límites pero no admiten transacciones distribuidas entre sistemas externos. El middleware gestiona el control de transacciones globales, incluyendo cifrado, firma de mensajes, reversión, compensación y entrega fiable. Para flujos de datos de misión crítica (por ejemplo, actualizaciones financieras o de consentimiento), el middleware garantiza la integridad y la recuperación de extremo a extremo entre Data 360 y sistemas externos. |

| Enrutamiento | El enrutamiento especifica el flujo controlado de mensajes o datos entre componentes. Puede basarse en encabezados, tipo de contenido, prioridad o reglas. El middleware gestiona la lógica de enrutamiento para eventos y activaciones que implican Data 360, como dirigir segmentos de audiencia enriquecidos a diferentes sistemas descendentes (plataformas de anuncios, almacenes, aplicaciones CRM). Aunque el enrutamiento se puede implementar dentro de Salesforce (Apex, Flows), el enrutamiento middleware se prefiere por su capacidad de ampliación, flexibilidad y gobernanza. |

| Extracción, transformación y carga (ETL) | ETL implica extraer datos de sistemas de origen, transformarlos en un esquema coherente y cargarlos en un destino (como Data 360). Las herramientas de middleware o ETL gestionan estas operaciones antes del ingreso de datos. Data 360 puede recibir salidas de ETL a través de API, conectores o oportunidades en curso de ingreso masivo, y también admite Captura de datos de cambios (CDC) para la sincronización casi en tiempo real. Los procesos ETL de middleware son esenciales para integrar sistemas heredados y garantizar la calidad de los datos antes de la unificación en Data 360. |

| Votación larga | Sondeo largo (Programación de cometas) es un método para mantener la comunicación abierta entre sistemas para actualizaciones en tiempo real. El cliente envía una solicitud y el servidor la mantiene hasta que se produzca un evento, luego responde y reabre una nueva conexión. Salesforce utiliza esto en la API de transmisión y los protocolos CometD/Bayeux para la sincronización de datos dirigida por eventos. El middleware puede suscribirse a estos eventos y reenviarlos a Data 360 para desencadenadores de ingreso o activación en tiempo real, garantizando una latencia mínima entre sistemas de compañía. |

El ingreso de datos es el primer paso y el más crítico en el ciclo de vida de datos de Salesforce Data 360. Es cómo la información sin procesar de múltiples sistemas externos (CRM, ERP, API web, móviles o externas) entra en la plataforma y se convierte en parte de una vista de cliente unificada. El patrón de ingreso correcto depende de lo que necesita el negocio:

- Volumen de datos: cuántos datos se están moviendo a la vez

- Latencia: cuán actualizados deben ser los datos

- Funciones del sistema de origen: cómo el sistema puede conectar y entregar datos Data 360 admite múltiples modos de ingreso para satisfacer estas necesidades: lote para cargas de gran volumen, transmisión para actualizaciones casi en tiempo real, basado en eventos para inmediatez de transacciones e ingreso Cero copia para acceso instantáneo a datos externos sin moverlos físicamente. Juntos, estos patrones garantizan que cada señal de cliente (ya sea un evento de compra, un registro de transmisión de clics o una actualización de fidelidad) fluya en Data 360 de forma eficiente, segura y en el plazo de tiempo correcto para potenciar análisis de confianza y experiencias dirigidas por IA.

Los patrones de ingreso por lotes son la columna vertebral de la incorporación de datos a gran escala en Data 360. Están optimizados para escenarios donde los datos se procesan de forma masiva (normalmente de forma programada o periódica) en vez de de forma continua. Estos patrones son los más adecuados para:

- Cargas de datos históricos para inicializar la plataforma con registros de compañía existentes

- Sincronización regular con sistemas de registro como sistemas ERP, almacenes de datos o bases de datos propias

- Utilice casos donde la actualización en tiempo real no es crítica, pero la coherencia, la integridad y la capacidad de auditoría son El ingreso por lotes ofrece desempeño predecible y sencillez operativa, lo que lo convierte en una opción de confianza para las empresas que gestionan terabytes de datos estructurados o semiestructurados. Data 360 proporciona un conjunto de conectores listos para la producción y disponibles de forma general que admiten el ingreso por lotes de forma nativa. Estos conectores simplifican la configuración de la integración, reducen el desarrollo de ETL personalizado y garantizan la calidad y la seguridad de los datos en cada importación. La tabla siguiente resalta los conectores más comunes utilizados para el ingreso por lotes a escala de compañía.

Contexto

Este patrón está diseñado para escenarios de compañía que implican el ingreso de grandes volúmenes de datos estructurados, como archivos CSV o Parquet, y activos no estructurados desde lagos de datos centralizados o caídas de archivos programadas. Los orígenes de datos incluyen comúnmente plataformas de almacenamiento en la nube como Amazon S3, Google Cloud Storage (GCS) y Microsoft Azure Blob Storage, donde los archivos se entregan periódicamente como parte de oportunidades en curso de datos ascendentes o exportaciones por lotes.

Problema

¿Cómo puede una organización establecer un proceso fiable, seguro y de alto rendimiento para ingresar conjuntos de datos masivos basados en archivos desde su plataforma de almacenamiento de nube principal en Data 360 de forma predecible y recurrente, sin sacrificar la gobernanza, la capacidad de ampliación o el desempeño?

Fuerzas

Ingresar conjuntos de datos masivos basados en archivos en Data 360 no es un ejercicio de transferencia de datos sencillo: es un reto arquitectónico modelado por restricciones de escala, gobernanza y plataforma.

Volumen y escala de datos: Los conectores de ingreso de Data 360 están optimizados para la fiabilidad y la regulación, no el rendimiento masivo arbitrario. Por ejemplo, el conector de Amazon S3 admite hasta 100 millones de filas o 50 GB por objeto, cualquiera que sea el límite que se alcance primero. Para empresas con conjuntos de datos históricos que se ejecutan en miles de millones de registros, este límite se convierte en una restricción de diseño clave. Un enfoque de una sola fila, elevación y cambio se vuelve rápidamente inviable, requiriendo estrategias inteligentes de partición, fragmentación y orquestación de datos para alcanzar la escala sin alcanzar los límites del conector.

Definición y mantenimiento del esquema: Data 360 requiere definiciones de esquema explícitas para cada canalización de ingreso para garantizar la integridad semántica y estructural. En el caso del ingreso de S3, un archivo csv debe definir encabezados de columna y una única fila de datos representativa. Este archivo actúa como el contrato canónico entre el sistema de origen, es decir, almacenamiento en la nube y Data 360. Cualquier desalineación (en nombres de campo, tipos de datos o codificación) puede causar fallos de ingreso o daños de datos silenciosos. Mantener este archivo de esquema en el control de versiones y aplicar la validación a través de flujos de trabajo de CI/CD o gobernanza de datos se convierte en una mejor práctica para entornos de producción.

Convenios de nomenclatura estricta: Data 360 aplica reglas estrictas de nomenclatura de objetos y campos para mantener la coherencia en el gráfico de metadatos.

- Los nombres de objetos deben comenzar por una letra y solo pueden incluir letras, dígitos o guiones bajos.

- Los nombres de campo deben seguir los mismos patrones. Los archivos que infringen estas convenciones (por ejemplo, campos que contienen espacios, caracteres especiales o símbolos no admitidos) fallarán en la validación de esquemas durante el ingreso. Las compañías deben implementar procesos de higiene de datos previos al ingreso para limpiar y normalizar las estructuras de archivos entrantes.

Posición de autenticación y seguridad: Cada conexión al almacenamiento externo debe cumplir con estándares de seguridad y cumplimiento de nivel de compañía.

- La autenticación se gestiona habitualmente a través de claves secretas/acceso de AWS o autenticación de proveedor de identidad federado (IdP).

- Las funciones de IAM deben tener un ámbito para aplicar el menor privilegio, permitiendo solo el acceso de lectura a las rutas de almacenamiento especificadas.

- Para un acceso seguro, las direcciones IP salientes deben agregarse directamente a la lista de admisión del sistema de origen. Estos controles por capas garantizan que cada transferencia de archivos funcione dentro de un perímetro auditable de confianza cero, equilibrando el cumplimiento de la compañía con la flexibilidad requerida para el ingreso a gran escala.

Solución

Esta tabla contiene soluciones a este problema de integración.

| Solución | Ajuste | Comentarios |

|---|---|---|

| Utilizar conectores de almacenamiento de nube nativos (Amazon S3, Google Cloud Storage, Azure Blob Storage) | Mejor | Este es el patrón recomendado y más fiable para el ingreso recurrente a gran escala basado en archivos en Data 360\. Los conectores nativos proporcionan autenticación gestionada, asignación de esquemas y movimiento de datos seguro directamente en los objetos de lago de datos (DLO) de Data 360. Ideal para cargas por lotes programadas donde la latencia no es crítica (por ejemplo, programación cada hora o diariamente). |

| Gestión de grandes conjuntos de datos (más allá de los límites del conector) | Mejor con preprocesamiento | Cada conector aplica límites de admisión (por ejemplo, S3: 100M filas o 50 GB por objeto). Para conjuntos de datos más grandes, implemente un paso de preprocesamiento de ETL para particionar datos en archivos/carpetas más pequeños que se encuentren por debajo de estos umbrales. A continuación, configure múltiples transmisiones de datos para ingresar cada partición en paralelo, y utilice el nodo adjunto en transformaciones de datos por lotes) dentro de Data 360 para recombinar las particiones en un conjunto de datos unificado. |

| Seguridad y gobernanza | Mejor | Todos los conectores admiten la autenticación segura a través de métodos nativos de la nube (funciones IAM, cuentas de servicio o claves de acceso). Para mayor control, restrinja el acceso a intervalos de IP de Data 360 a través de la lista de admisión del proveedor de nube. La transferencia de datos se produce en canales cifrados, con archivos almacenados en una capa de organización temporal y segura durante el ingreso. |

| Cuándo no utilizar | Suboptimal | Este patrón no es óptimo para:

|

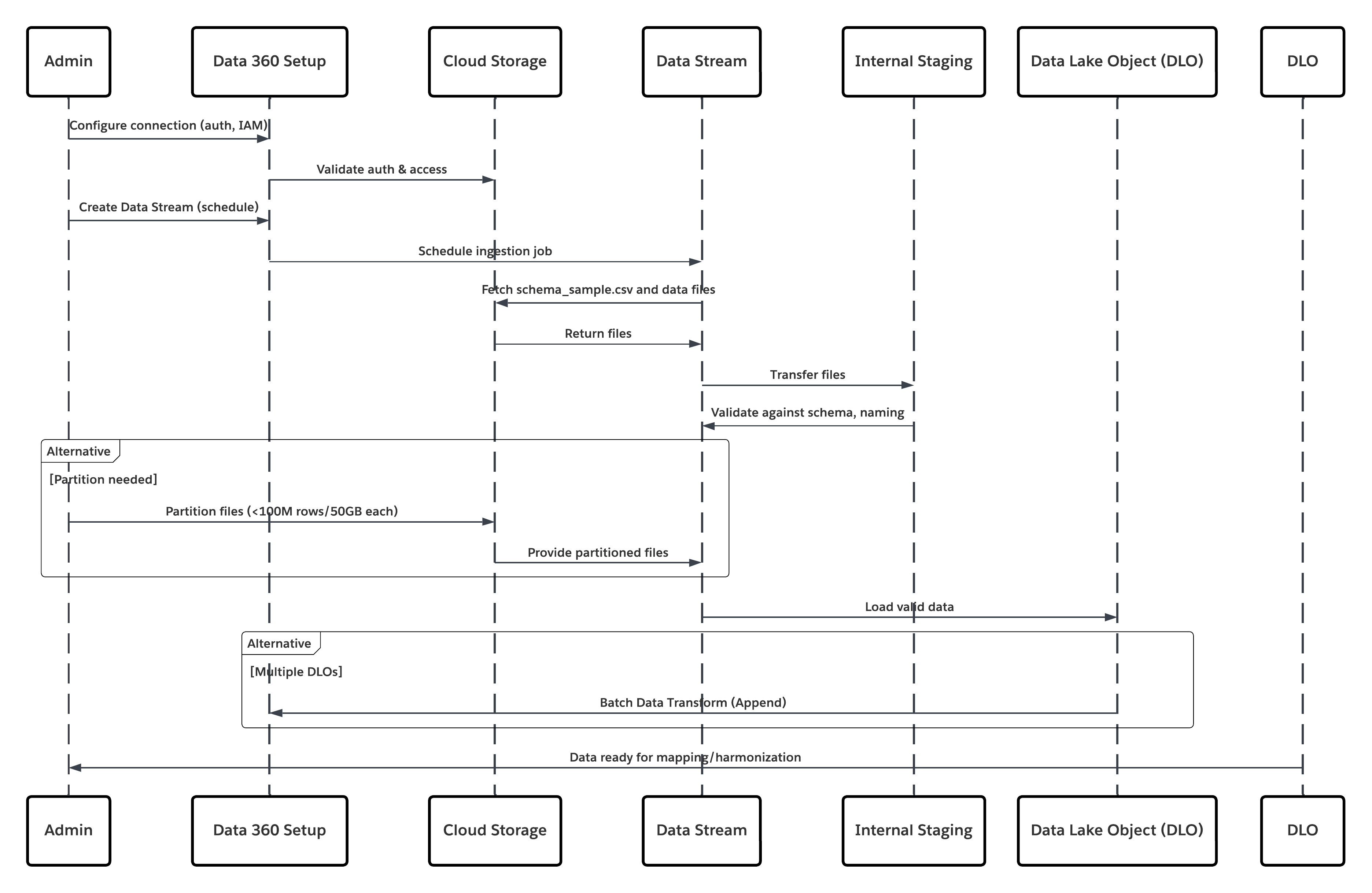

Boceto

Este diagrama ilustra la secuencia de pasos para ingresar los datos desde el almacenamiento en la nube en Data 360

En este escenario:

- El administrador configura una conexión al almacenamiento en la nube a través de la interfaz Configuración de Data 360 (especificando autenticación, detalles de depósito, funciones de IAM y listas blancas).

- La interfaz de configuración de Data Cloud se autentica con Cloud Storage Platform, verificando credenciales y acceso.

- El administrador crea una transmisión de datos en Data 360, vinculando la transmisión de datos al objeto/carpeta en Cloud Storage y definiendo la programación de ingreso.

- En el desencadenador de programación, la transmisión de datos solicita archivos de origen (por ejemplo, CSV, Parquet) desde Cloud Storage Platform.

- Cloud Storage Platform entrega archivos, incluyendo el schema_sample.csv válido requerido y otros archivos de datos que cumplen con convenciones de nomenclatura.

- Transmisión de datos transfiere archivos al entorno de organización interno en Data 360.

- Canalizaciones de Data 360 procesa los archivos: Utiliza la definición de esquema de schema_sample.csv Valida la estructura, los nombres de campo y divide la carga si está por encima de los umbrales de ingreso (100 millones de filas/50 GB por archivo). Si se detectan archivos de gran tamaño, se realiza un paso de partición de preprocesamiento (notificado al administrador para la siguiente ejecución) de forma externa.

- Los registros se importan desde la organización en un objeto de lago de datos (DLO).

- Si es necesario y los datos están particionados, utilice el nodo de anexado en una Trasformación de datos por lotes para combinar múltiples DLO.

- Data 360 registra el éxito/fallo, actualiza el estado para el monitoreo y señala que los datos están listos para la asignación, Armonización y Unificación.

Resultados

La aplicación de este patrón permite el ingreso seguro, programado y a gran escala de archivos estructurados o no estructurados desde plataformas de almacenamiento de Enterprise Cloud en Data 360. El proceso es automatizado, ampliable y resistente, entregando datos sin procesar en objetos de lago de datos (DLO) que sirven como la base para Armonización y asignación al modelo de datos Customer 360.

Mecanismos de admisión

El mecanismo de ingreso depende del conector y la estrategia de programación definidos en Data 360.

| Mecanismo de admisión | Descripción |

|---|---|

| Conector de almacenamiento de nube nativo (Amazon S3, GCS, Azure) | Recomendado para el ingreso directo de archivos en formato CSV o Parquet desde el lago de datos de nube de la compañía. Estos conectores admiten programaciones de actualización incrementales y completas. Por ejemplo, un banco puede configurar una sincronización diaria de archivos de transacciones de clientes desde un depósito de S3 a un DLO. |

| Estrategia de archivo particionado | Para conjuntos de datos muy grandes (más de 100 millones de filas o 50 GB por objeto), los datos se dividen en conjuntos lógicos más pequeños (por ejemplo, por mes o región). Cada partición se gestiona como una Transmisión de datos separada y se recombina más adelante utilizando una Trasformación de datos por lotes con un nodo Anexado. |

| Sincronización programada automatizada | Data 360 proporciona un programador declarativo (cadencia horaria, diaria o personalizada) que desencadena trabajos de ingreso automáticamente, garantizando la actualización de los datos sin intervención manual. |

Gestión y recuperación de errores

La gestión y recuperación de errores son fundamentales para garantizar la fiabilidad en operaciones de ingreso de gran volumen.

- Detección de errores: Cada ejecución de Transmisión de datos registra errores de ingreso (por ejemplo, errores de coincidencia de esquemas, daños en archivos o infracciones de nombres) en Monitoreo de Data 360. Los administradores pueden revisar y reprocesar lotes con fallos.

- Mecanismo de recuperación: Data 360 mantiene puntos de control para garantizar que los lotes con fallos no corrompen las ingestas anteriores. Los reintentos se pueden configurar después de corregir problemas de origen (por ejemplo, CSV defectuosos).

- Validación de esquema: El archivo schema_sample.csv define los tipos de datos y la estructura. Cualquier cambio desencadena la validación para evitar la desviación silenciosa de esquemas entre ejecuciones.

Consideraciones de diseño idempotentes

El ingreso es idempotente por diseño: el reprocesamiento del mismo archivo no da como resultado registros duplicados. Las estrategias clave incluyen:

- Huella de archivo: Data 360 calcula sumas de comprobación para identificar y omitir archivos procesados anteriormente.

- Ingreso transaccional: Los datos se organizan y solo se confirman con el DLO cuando se procesan correctamente todos los registros.

- Anexar vs. Sustituya: Dependiendo de la lógica de negocio, las transmisiones pueden anexar o sustituir completamente el DLO de destino; esto garantiza resultados deterministas y evita la superposición parcial de datos.

Consideraciones de seguridad

La seguridad es integral en todas las oportunidades en curso de ingreso, desde la autenticación hasta el cifrado y el control de acceso.

- Autenticación y autorización: Los conectores utilizan el Marco de trabajo de integración seguro de Salesforce, aprovechando credenciales nombradas y credenciales externas para la autenticación sin exponer secretos.

- Cifrado: Los datos se cifran en tránsito (TLS 1,2+) y en reposo (AES-256).

- Controles de red: Los sistemas de almacenamiento de origen (por ejemplo, depósitos de S3) deben incluir en la lista de admisión direcciones IP de Data 360.

- Alineación de cumplimiento: Admite marcos de trabajo de protección de datos de compañía como RGPD, HIPAA y directrices FFIEC cuando se emparejan con Claves gestionadas por el cliente (CMK).

- Auditabilidad: Cada trabajo de ingreso y acceso a credenciales se registra para la trazabilidad y la creación de reportes de cumplimiento.

Barras laterales

Oportunidad

La puntualidad depende de la programación de ingreso y el volumen de datos.

- Los conjuntos de datos de grandes compañías (más de 100 filas) pueden requerir particiones para el ingreso paralelo.

- La latencia de ingreso habitual oscila entre minutos y algunas horas, dependiendo del tamaño del archivo y la complejidad de la transformación.

- Para el ingreso casi en tiempo real, los conectores basados en API o Transmisión de Data 360 pueden complementar el modelo basado en archivos.

Volúmenes de datos

- Mejor adaptado para el ingreso por lotes periódico de gran volumen.

- Cada objeto procesado a través del conector S3 admite hasta 100 millones de filas o 50 GB por archivo.

- Para sistemas de escala de petabytes, utilice particiones de datos y orquestación de múltiples transmisiones.

Capacidad de extremo y compatibilidad de estándares

La capacidad y la compatibilidad estándar para el extremo depende de la solución que seleccione.

| Tipo de conector | Requisitos de extremo |

|---|---|

| Conector de Amazon S3 | Depósito de S3 con política de IAM apropiada y archivo schema\_sample.csv que define el esquema. |

| Conector de Google Cloud Storage | Credenciales de cuentas de servicio y acceso a depósitos con convenciones de nomenclatura uniforme. |

| Conector de almacenamiento de Azure | Clave de acceso o autenticación basada en tokens de SAS; la estructura de carpetas o blob debe seguir las convenciones de Data 360. |

Gestión de estado

Se realiza un seguimiento del estado a través de Transmisiones de datos y su última marca de tiempo de ejecución correcta.

- Data 360 mantiene automáticamente los estados de sincronización y las compensaciones, garantizando que solo se procesen archivos nuevos o modificados en ejecuciones posteriores.

- Al integrar con herramientas ETL externas, se recomiendan identificadores de archivo exclusivos (por ejemplo, UUID o marcas de tiempo) para evitar la duplicación.

Escenarios de integración complejos

En arquitecturas de negocio avanzadas, este patrón puede integrarse con:

- Oportunidades en curso de ETL de middleware (por ejemplo, Informatica, MuleSoft): para orquestar el procesamiento previo, la validación y la partición de archivos antes de la transferencia a Data 360.

- Flujos de trabajo IA/ML: los datos de DLO procesados se pueden publicar a través de DMO para modelar entornos de entrenamiento o índices RAG a través de Destinos de activación de Data 360.

- Sistemas transaccionales: los DMO armonizados pueden desencadenar actualizaciones descendentes en Salesforce CRM o sistemas externos a través de Acciones de datos o Eventos de plataforma.

Ejemplo

Una institución financiera global almacena datos de clientes y transacciones en un lago de datos de AWS S3, donde los archivos Parquet particionados se generan cada noche por región (como EE.UU., UE y APAC). El equipo de arquitectura de datos configura múltiples Transmisiones de datos en Data 360, cada una conectada a una carpeta regional, con un schema_sample.csv compartido garantizando encabezados y tipos de datos coherentes entre todas las particiones. Las programaciones de ingreso nocturno cargan automáticamente los datos en DLO, tras lo cual Transformaciones de datos por lotes anexan todas las particiones regionales en Customer_Transactions_DLO unificado. Este conjunto de datos armonizado se asigna a continuación al modelo de datos Customer 360, lo que permite la activación de análisis descendente y IA. El enfoque entrega un ingreso automatizado y confiable desde el lago de datos existente, aplica una autenticación y cifrado sólidos alineados con políticas de TI de negocio y proporciona una base modular ampliable que admite la expansión futura y la evolución de esquemas.

Contexto

Un caso de uso principal y crítico para Data 360 es la unificación de datos de clientes en el ecosistema de Salesforce. Este patrón cubre el ingreso nativo de datos desde plataformas principales de Salesforce: Sales Cloud y Service Cloud (colectivamente Salesforce CRM) y Marketing Cloud Engagement. Los orígenes incluyen objetos estándar y personalizados de CRM (por ejemplo, Cuenta, Contacto, Caso, Oportunidad) y extensiones de datos de Marketing Cloud Engagement que albergan eventos de implicación, envíos de email y datos de seguimiento.

Problema

¿Cómo puede una organización ingresar de forma eficiente y fiable objetos CRM estándar y personalizados y extensiones de datos de Marketing Cloud Engagement en Data 360 de modo que los datos puedan utilizarse para crear perfiles de clientes unificados (resolución de identidad, Customer 360), manteniendo al mismo tiempo el desempeño, la gobernanza y la interrupción mínima en los sistemas de origen?

Fuerzas

Los conectores nativos simplifican el trabajo, pero se deben gestionar varias fuerzas operativas y arquitectónicas:

- Permisos de origen integrales: Un usuario de conexión exclusivo (cuenta de integración) debe tener permisos de lectura a nivel de campo y objeto apropiados. El fallo en la asignación de conjuntos de permisos requeridos (por ejemplo, un conjunto de permisos de conector de Data 360 preconstruido) es una causa común de fallo de ingreso.

- Modos y costo de actualización de datos: Los conectores admiten modos de actualización completos y delta/incrementales. Las actualizaciones completas son más pesadas en desempeño y créditos; los extractos delta reducen la carga pero dependen de un seguimiento de cambios fiable en el sistema de origen.

- Esquema personalizado y asignación de campos: Las instancias de CRM a menudo incluyen objetos/campos personalizados. Se requiere una asignación de esquemas precisa y la gestión de campos personalizados (nombres, tipos) para evitar errores de asignación o desviación semántica.

- Iniciar paquetes de datos frente a Asignación personalizada: Los paquetes de datos de inicio aceleran la incorporación seleccionando previamente objetos/campos típicos, pero las organizaciones altamente personalizadas necesitarán definiciones de transmisión a medida.

- Límites de API y rendimiento: Los límites de API de la organización de origen y los índices de extracción de Marketing Cloud limitan la agresividad con la que puede programar actualizaciones.

- Convenciones de higiene y nomenclatura de datos: Los nombres de campo de origen, el comportamiento nulo y los tipos de datos deben normalizarse antes de la introducción para evitar problemas de asignación descendente.

- Seguridad y privilegios mínimos: El conector se basa en autenticación segura y debe respetar los patrones de IAM de menor privilegio, la capacidad de auditoría y los controles de red.

Solución

Esta tabla contiene soluciones a este problema de integración.

| Área de solución | Ajuste | Comentarios / Detalles de implementación |

|---|---|---|

| Ajuste de solución | Mejor | Utilice el conector nativo de Salesforce CRM y el conector de Marketing Cloud Engagement en Data 360\. Comience con Paquetes de datos de inicio para casos de uso estándar y acelere la incorporación. Utilice la personalización de transmisiones manual para modelos de datos a medida o específicos de dominio. |

| Gestión de instancias de CRM altamente personalizadas | Mejor con taller de asignación | Trate los paquetes de inicio como una línea base y realice un taller de asignación para identificar: Relaciones y objetos personalizados. Fórmula o campos calculados. Extensiones de paquetes gestionados. Para campos de fórmula pesados, calcule valores en un ETL previo a la etapa o dentro de Transformaciones de Data 360 para minimizar la carga de API en organizaciones de origen. |

| Cuándo no utilizar | Escenarios subóptimos | Evite este patrón si: Necesita ingreso de eventos de alta frecuencia o en tiempo real (en su lugar, utilice Conectores de transmisión, Eventos de plataforma o Federación de copia cero). La organización de origen tiene una capacidad de API limitada y no puede mantener las extracciones programadas sin demoras de estrangulación o cola. |

| Seguridad y gobernanza | Controles obligatorios | Principio de menor privilegio: utilice un usuario de integración exclusivo con acceso de lectura mínimo. Nunca utilice administradores de toda la organización. Autenticación: Utilice OAuth 2.0 y aplicaciones conectadas; rote secretos de cliente regularmente y monitoree el uso de tokens de actualización. Auditoría y trazabilidad: registre todas las ejecuciones de ingreso, cambios de esquema y eventos de conector. Reenvíe registros a SIEM o sistemas de cumplimiento para la preparación de auditorías. Clasificación de datos: Aplique el etiquetado PII/PHI y el Control de acceso basado en atributos (ABAC) utilizando políticas de CEDAR inmediatamente después del ingreso para aplicar el enmascaramiento, el consentimiento y el cumplimiento descendente. |

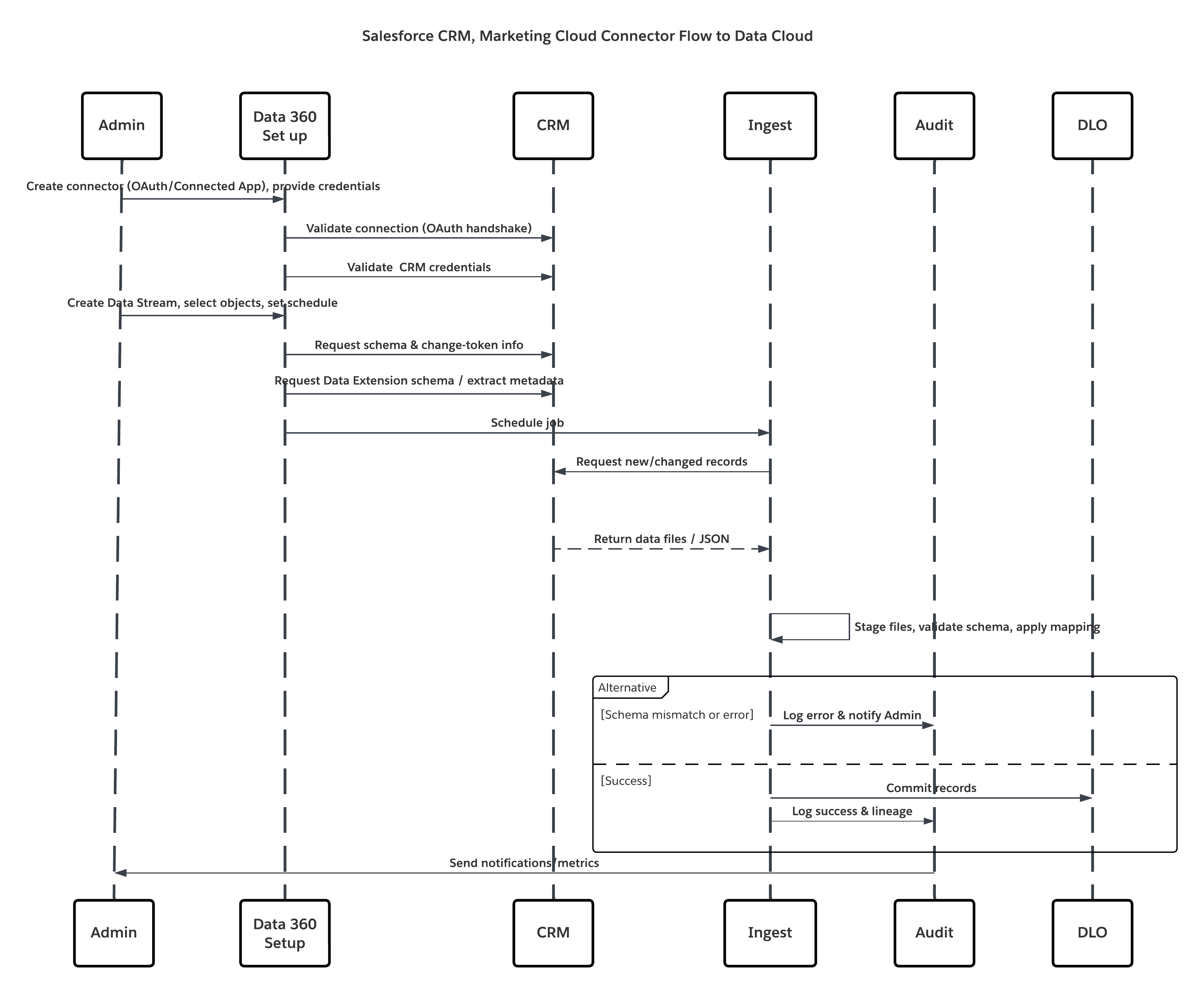

Boceto

Este diagrama ilustra la secuencia de pasos para ingresar los datos desde el almacenamiento en la nube en Data 360

En este escenario:

- El administrador proporciona usuarios de integración y asigna conjuntos de permisos de conector en organizaciones de origen.

- El administrador configura conectores en Configuración de Data 360 (se conecta a Salesforce CRM y Marketing Cloud a través de OAuth/aplicación conectada).

- El administrador crea Transmisiones de datos seleccionando objetos y Extensiones de datos, selecciona la actualización completa o delta y establece programaciones.

- En la ejecución programada, Data 360 solicita tokens de esquema y delta desde la(s) fuente(s).

- Los sistemas de origen devuelven registros (delta o carga completa). Marketing Cloud puede entregar extractos; CRM puede devolver resultados de JSON/Consulta.

- Data 360 organiza archivos en su área de organización segura interna y valida con el esquema asignado.

- Si falla la validación, el error de registro de ingreso, el administrador de alertas y la confirmación se detiene. Si la validación se realiza correctamente, Data 360 confirma registros atómicamente en el DLO de destino.

- Los registros de monitoreo y auditoría se actualizan con el linaje, la duración de la ejecución, los conteos de filas y el uso de credenciales. Alertas emitidas a administradores si se desencadenan umbrales o errores.

Resultados

Los datos principales de relaciones con los clientes e implicación de marketing se ingresan en Data 360 como Objetos de lago de datos (DLO). Esto proporciona:

- Conjunto de datos unificado que contiene perfiles, casos, oportunidades y mediciones de email/implicación.

- Fundamento para resolución de identidad y construcción de perfiles de particulares unificados.

- Preparación operativa para Armonización descendente, enriquecimiento, modelado de IA y activación preservando al mismo tiempo la gobernanza y la capacidad de auditoría.

Mecanismos de admisión

El mecanismo de ingreso depende del conector y la estrategia de programación definidos en Data 360.

| Mecanismo | Cuándo utilizar |

|---|---|

| Conector de Salesforce CRM (nativo) | Lo mejor para objetos CRM estándar/personalizados; admite la actualización completa y delta. |

| Conector de implicación de Marketing Cloud (nativo) | Lo mejor para extensiones de datos, envíos y seguimiento de extractos; admite modos completo/delta. |

| Paquetes de datos de inicio | Acelere la incorporación para objetos comunes de Ventas/Servicio/Marketing. |

| Transmisiones personalizadas + preprocesamiento | Se utiliza cuando se requieren transformaciones complejas o normalización de esquemas intensa. |

Gestión y recuperación de errores

La gestión y recuperación de errores son fundamentales para garantizar la fiabilidad en operaciones de ingreso de gran volumen.

- Registros por ejecución: Cada ejecución de Transmisión de datos proporciona detalles de operación correcta/fallo y errores a nivel de fila.

- Reintentos y puntos de control: Las ejecuciones fallidas se pueden reintentar después de solucionar problemas de origen o esquema; Data 360 utiliza la semántica de preparación y confirmación atómica.

- Alertas: Configure alertas para desviación de esquemas, fallos repetidos o brechas de secuencia delta.

Consideraciones de diseño idempotentes

El ingreso es idempotente por diseño: el reprocesamiento del mismo no da como resultado registros duplicados. Las estrategias clave incluyen:

- Detección de cambios: Los extractos Delta se basan en indicadores de cambio del sistema de origen (LastModifiedDate / Captura de datos de cambio del sistema). Verifique que el origen proporciona marcas de tiempo/marcas fiables.

- Deduplicación: Utilice claves de negocio exclusivas (por ejemplo, Contact.ExternalId) para deduplicar o alterar en DLO.

- Compromiso transaccional: Los registros se organizan y solo se confirman cuando el procesamiento por lotes se completa correctamente.

Consideraciones de seguridad

La seguridad es integral en todas las oportunidades en curso de ingreso, desde la autenticación hasta el cifrado y el control de acceso.

- Autenticación y autorización: Los conectores utilizan el Marco de trabajo de integración seguro de Salesforce, aprovechando credenciales nombradas y credenciales externas para la autenticación sin exponer secretos.

- Cifrado: Los datos se cifran en tránsito (TLS 1,2+) y en reposo (AES-256).

- Controles de red: Los sistemas de almacenamiento de origen (por ejemplo, depósitos de S3) deben incluir en la lista de admisión direcciones IP de Data 360.

- Alineación de cumplimiento: Admite marcos de trabajo de protección de datos de compañía como RGPD, HIPAA y directrices FFIEC cuando se emparejan con Claves gestionadas por el cliente (CMK).

- Auditabilidad: Cada trabajo de ingreso y acceso a credenciales se registra para la trazabilidad y creación de reportes de cumplimiento

Barras laterales

Oportunidad

La puntualidad depende de la programación de ingreso y el volumen de datos.

- La cadencia ideal depende de las necesidades de negocio: cada hora para desencadenadores de marketing casi en tiempo real, cada noche para conciliaciones de gran tamaño.

- Los modos Delta reducen la carga y el costo; las actualizaciones completas son más pesadas y se utilizan para cargas iniciales o cambios de esquema importantes.

Volúmenes de datos

- Los conectores de CRM están optimizados para conjuntos de datos transaccionales y de volumen medio (millones de registros).

- Para volúmenes históricos extremadamente grandes, considere ETL por etapas para particionar y cargar por etapas.

Capacidad de extremo y compatibilidad de estándares

La capacidad y la compatibilidad estándar para el extremo depende de la solución que seleccione.

| Conector | Requisitos de extremo |

|---|---|

| Conector de Salesforce CRM | La organización de origen debe permitir una aplicación conectada, tokens de OAuth y un usuario de integración exclusivo con permisos de lectura. |

| Conector de Marketing Cloud | Credenciales de API de Marketing Cloud o paquete instalado; las extensiones de datos deben exponer datos a través de Extractos/API. |

Gestión de estado

- Estado conector: Las transmisiones de datos mantienen las últimas marcas de tiempo de sincronización correctas y las compensaciones delta.

- Estrategia clave principal: Prefiera identificadores de negocio coherentes (Id. externos) de modo que la reconciliación descendente y las alteraciones sean deterministas.

Escenarios de integración complejos

En arquitecturas de negocio avanzadas, este patrón puede integrarse con:

- Topologías híbridas: Combine el ingreso de CRM con la transmisión (Eventos de plataforma) para actualizaciones casi en tiempo real.

- Orquestación de middleware: Utilice herramientas MuleSoft o ETL cuando se requiera orquestación compleja, enriquecimiento o ingreso previo de transformación.

- Bucles de comentarios de activación: Los DMO armonizados pueden desencadenar actualizaciones descendentes en sistemas de origen a través de Acciones de datos o API de plataforma (cuidado con los controles de SoD).

Ejemplo

Un minorista multinacional consolida mediciones de implicación de Cuentas, Contactos, Casos, Oportunidades y Marketing Cloud en Data 360 para crear una vista de cliente unificada. El Paquete de datos de inicio inicializa objetos principales de Ventas y Servicio, mientras que el equipo amplía el modelo con campos personalizados como Loyalty_Membershipc y Customer_Tierc para capturar contexto de fidelidad. Las transmisiones de datos de CRM se ejecutan cada hora en modo delta, y Marketing Cloud Engagement se sincroniza diariamente utilizando extractos delta para eventos de implicación. Estos conjuntos de datos se procesan a través de DLO y resolución de identidad, dando como resultado un perfil de cliente unificado que combina CRM y señales de implicación para potenciar la personalización y los modelos de IA descendentes.

Estos patrones se crean para escenarios donde los milisegundos importan, cuando las interacciones, transacciones o señales de los clientes deben desencadenar perspectivas o acciones inmediatas. Van más allá del ingreso por lotes programado tradicional para activar el flujo de datos dirigido por eventos, donde la información se procesa en el momento en que se genera. En el ecosistema de Salesforce Data 360, el “tiempo real” no es un modo único, es un continuo de modelos de latencia. En un extremo se encuentra la sincronización casi en tiempo real, donde las actualizaciones desde sistemas de registro (como CRM o ERP) se reflejan en Data 360 en cuestión de segundos o minutos. En el otro extremo se encuentra la captura de eventos en tiempo real verdadera, donde las señales de comportamiento del lado del cliente, como clics, compras o interacciones móviles, se ingresan y activan en milisegundos. Para los arquitectos, la distinción es más que semántica. Define cómo se diseñan las oportunidades en curso, cómo se invocan las API y cómo se toman las decisiones posteriores. La selección del patrón correcto (ya sea sincronización casi en tiempo real o ingreso de transmisiones de eventos) garantiza que el sistema cumpla los objetivos de latencia operativa del negocio mientras mantiene la integridad, la capacidad de ampliación y la gobernanza de los datos.

Contexto

Este patrón permite a cualquier sistema externo, como una aplicación personalizada, una plataforma de Internet de las cosas (IoT), un sistema de punto de venta (POS) o un servicio externo, enviar programáticamente datos de eventos en Data 360 casi en tiempo real a medida que se producen eventos discretos.

Problema

¿Cómo puede un desarrollador enviar de forma fiable registros únicos o pequeños lotes asíncronos de eventos desde una aplicación externa a Data 360 con baja latencia de modo que los datos estén disponibles rápidamente para su procesamiento, segmentación y activación?

Fuerzas

Este patrón entrega baja latencia y un mejor control del desarrollador, pero presenta varias restricciones técnicas y dependencias operativas:

- Dependencia de desarrollador: Requiere esfuerzo del desarrollador para implementar clientes de API de REST autenticados y lógica de error/reintento: no es un conector de apuntar y hacer clic.

- Esquema estricto en escritura: La API de ingreso aplica el esquema sobre escritura. Debe definirse un esquema preciso y cargarse en la configuración del conector; todas las cargas deben ajustarse exactamente o rechazarse.

- Modos de interacción dual: El mismo conector admite tanto la transmisión (JSON) para actualizaciones registro por registro de baja latencia como la masiva (CSV) para sincronizaciones periódicas de mayor tamaño: los arquitectos deben elegir por caso de uso.

- Autenticación y seguridad: Las llamadas deben autenticarse a través de una aplicación conectada de Salesforce utilizando OAuth 2.0 (por ejemplo, Flujo de soporte JWT para servidor a servidor). Los ámbitos de gestión de tokens, rotación y menor privilegio son obligatorios.

- Visibilidad operativa: Los desarrolladores y equipos de plataforma deben implementar el monitoreo para códigos de respuesta, reintentos, colas de letra muerta y alertas de desviación de esquemas.

- Requisito de gráfico en tiempo real: Para una activación instantánea verdadera (segmentación instantánea, asignación de DMO en tiempo real), el Objeto de modelo de datos (DMO) de destino debe formar parte del gráfico de datos en tiempo real; de lo contrario, los eventos atraviesan una canalización de latencia ligeramente superior.

Solución

Esta tabla contiene soluciones a este problema de integración.

| Área de solución | Ajuste | Comentarios / Detalles de implementación |

|---|---|---|

| Ajuste de solución | Mejor para captura de eventos de baja latencia | Utilice la API de ingreso de Data 360 (JSON de transmisión) para enviar eventos únicos o microlotes. Configure el conector de API de ingreso con un esquema estricto de OAS 3.0 (.yaml). Utilice el ingreso masivo de CSV para sincronizaciones más grandes y menos frecuentes. |

| Gestión de cambios de esquema | Estricto / Gestionado | Los cambios de esquemas se están interrumpiendo: actualice .yaml de OAS, versione el conector y realice pruebas de contratos. Implemente la migración de esquemas progresiva si los productores no pueden cambiar simultáneamente. |

| Cuándo no utilizar | Suboptimal | No es ideal si se necesita preprocesamiento (ej: deduplicación, pedido garantizado, etc.) o para cargas masivas extremadamente grandes (utilice conectores masivos nativos o ETL por lotes). Si el origen no puede producir cargas válidas para esquemas o no puede autenticarse de forma segura, utilice métodos de ingreso alternativos. |

| Seguridad y gobernanza | Obligatorio | Utilice OAuth 2.0 con ámbitos de menor privilegio, rotar claves, registrar uso de tokens. Aplique TLS 1.2+, valide direcciones IP de clientes si es necesario y garantice el etiquetado de PII de carga. Todos los eventos deben incluir metadatos de procedencia (origen, marca de tiempo, versión de esquema, clave de idempotencia). |

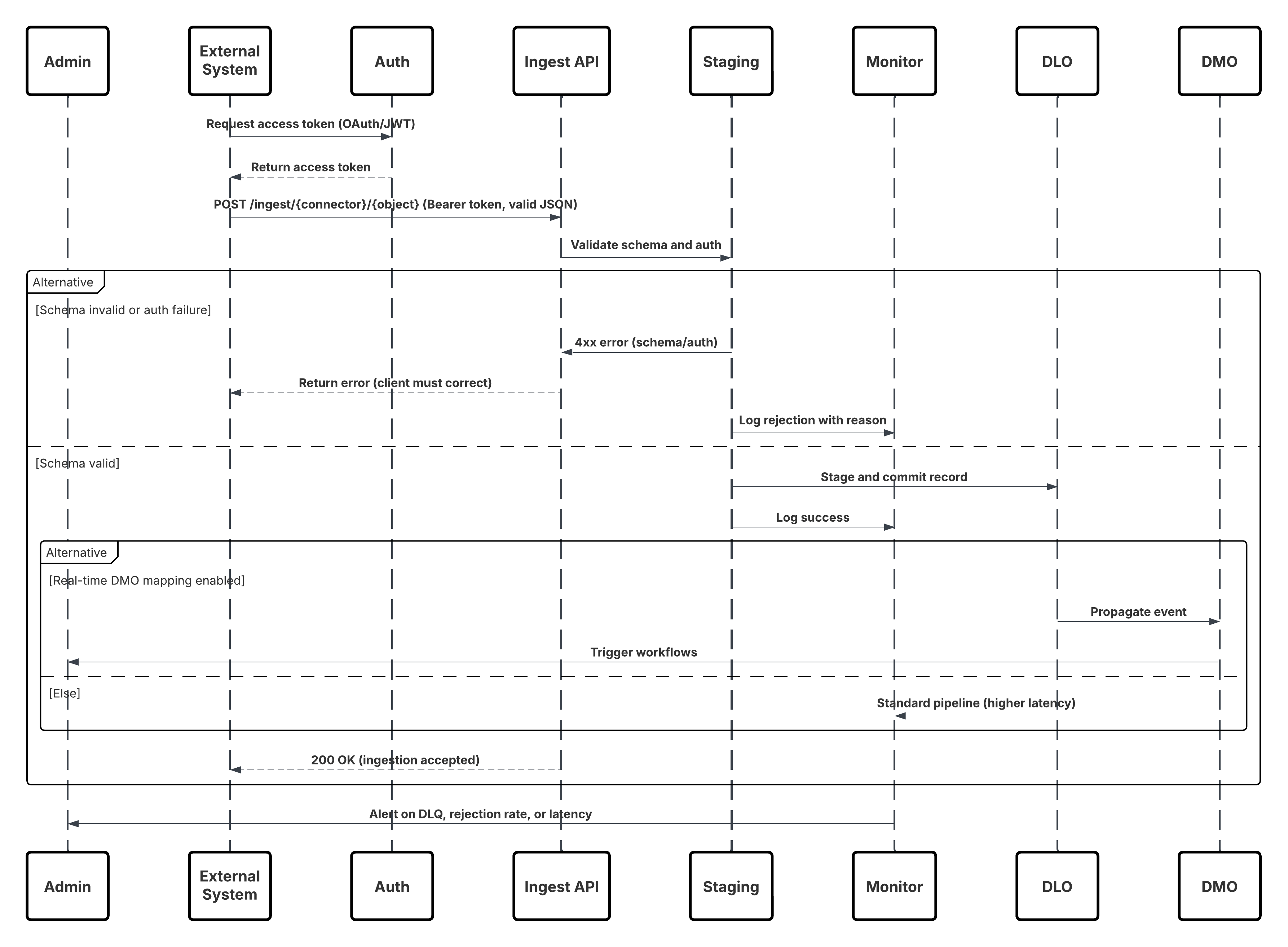

Boceto

Este diagrama ilustra la secuencia de pasos para ingresar los datos desde la API de ingreso en Data 360

En este escenario:

- El sistema externo solicita autenticación a través de OAuth/JWT desde el servidor de autenticación.

- Servidor de autenticación devuelve el token de acceso a Sistema externo.

- El sistema externo envía la solicitud POST de ingreso de datos a la API de ingreso de Data 360 con autorización y carga JSON.

- La API de ingreso valida el esquema de solicitud y la autenticación a través del módulo Etapa y validación.

- En caso de fallo de esquema/autenticación:

- Error devuelto a Sistema externo.

- Rechazo registrado para monitoreo y alerta.

- En validación correcta:

- Registros organizados y confirmados en Objeto de lago de datos (DLO).

- Éxito registrado para el monitoreo.

- Si se activa, los datos se propagan a Gráfico de datos en tiempo real (DMO) desencadenando flujos de trabajo descendentes.

- De lo contrario, los datos procesados a través de lotes estándar o oportunidades en curso de latencia superior.

- API de ingreso confirma el éxito en Sistema externo.

- Los componentes de monitoreo alertan al administrador sobre colas de letra muerta, índices de rechazo o problemas de latencia.

Resultados

Los datos de eventos externos se ingresan en los DLO de Data 360 con baja latencia. Cuando el DMO de destino forma parte del gráfico en tiempo real, los datos están disponibles para segmentación instantánea, flujos de trabajo de agentes, modelos de IA y activación operativa. Esto permite respuestas de negocio rápidas a eventos originados desde cualquier sistema conectado.

Mecanismos de admisión

El mecanismo de ingreso depende del conector y la estrategia de programación definidos en Data 360.

| Mecanismo | Cuándo utilizar |

|---|---|

| JSON de transmisión (API de ingreso) | Eventos únicos, microlotes, eventos de comportamiento, transmisiones de clics, telemetría de IoT: cuando se requiere baja latencia. |

| CSV masivo (modo masivo de API de ingreso) | Cargas periódicas más grandes donde los requisitos de latencia se relajan. |

| Perfil / Middleware | Utilice cuando necesite validación, transformación, enriquecimiento o limitación de velocidad antes de enviar a la API de ingreso. |

Gestión y recuperación de errores

- Errores inmediatos (sincronización): Respuestas 4xx para errores de esquema/autenticación: el cliente debe solucionar la carga o el token y reintentarlo.

- Fallos transitorios (asíncronos): Respuestas 5xx: el cliente reintenta con retroceso exponencial y fluctuación.

- Cola de letras muertas (DLQ): Los fallos persistentes llegan a DLQ para la inspección manual y la reproducción.

- Monitoreo: Realice un seguimiento del índice de rechazo de esquemas, los fallos de autenticación, los percentiles de latencia y el retraso de DLQ. Alerta sobre umbrales.

Consideraciones de diseño idempotentes

- Clave de impotencia: Cada evento debe incluir una clave de idempotencia/Id. de mensaje exclusivos.

- Estrategia de inserción: Utilice claves de negocio (ExternalId) para evitar duplicados en reproducciones.

- Ventana de duplicado: El arquitecto debe definir plazos de deduplicación y retención para el seguimiento de la idempotencia.

Consideraciones de seguridad

La seguridad es integral en todas las oportunidades en curso de ingreso, desde la autenticación hasta el cifrado y el control de acceso.

- Autenticación: OAuth 2.0 (portador JWT) recomendado para servidor a servidor. Limite los ámbitos a solo la admisión.

- Cifrado: TLS 1.2+ para el transporte; Data 360 aplica el cifrado en periodos de inactividad.

- Privilegio mínimo: Las credenciales de Aplicación conectada tienen derechos mínimos; gire secretos y registros de acceso a instrumentos.

- Gobernanza de carga: Incluya indicadores de consentimiento/consumo en metadatos de eventos; aplique políticas ABAC/CEDAR inmediatamente después del ingreso.

- Controles de IP / Conexión privada: Donde sea necesario, restrinja el acceso a través de listas de admisión o utilice Conexión privada para redes privadas.

Barras laterales

Oportunidad

La puntualidad depende de la programación de ingreso y el volumen de datos. El JSON de transmisión ofrece una latencia de subsegunda a segunda dependiendo del procesamiento y la configuración del gráfico. El CSV masivo es de minutos a horas. Seleccione basándose en SLA de negocio.

Volúmenes de datos

Los tamaños de eventos individuales deben ser pequeños (< pocos KB). Para productores de alto rendimiento, considere realizar lotes en el productor o utilizar un buffer de transmisión (Kafka/Kinesis) antes de llamar a la API.

Gestión de estado

- Versión de esquema: Mantenga la versión de esquema en metadatos de eventos y utilice la versión de conector al actualizar el contrato de OEA.

- Compensaciones de conector: Data 360 controla la semántica de confirmación; los productores deben realizar un seguimiento de las claves de idempotencia y la última secuencia correcta para una reproducción segura.

Escenarios de integración complejos

En arquitecturas de negocio avanzadas, este patrón puede integrarse con:

- Capa de validación de borde: Utilice middleware para traducir formatos de productor heterogéneos al contrato de OEA requerido, realizar limitaciones de velocidad y enriquecimiento previo.

- Arquitecturas híbridas: Combine la API de ingreso para eventos y conectores para una reconciliación masiva.

- Activación de agente: Los eventos asignados en DMO en tiempo real pueden desencadenar flujos de trabajo Agentforce y modelos Einstein para la toma de decisiones automatizada.

Ejemplo

Una cadena minorista transmite eventos de compra de punto de venta (POS) en Data 360 en tiempo real para potenciar la implicación inmediata del cliente. Cada establecimiento ejecuta un componente de servidor ligero que recopila transacciones, las enriquece con metadatos de ubicación y dispositivo y publica de forma segura eventos JSON utilizando JWT Bearer OAuth con claves de idempotencia para evitar duplicados. Un administrador define la estructura del evento cargando un esquema de OAS para el punto de venta y configurando el conector de API de ingreso. Los eventos entrantes se ingresan en el DLO pos_sale, se asignan al DMO de ventas y se agregan al gráfico en tiempo real. Como resultado, las compras de alto valor se detectan al instante, desencadenando flujos de trabajo VIP en Agentforce y actualizando la segmentación de clientes para dirigir la personalización en tiempo real.

Contexto

Este patrón permite la captura de datos de interacción de usuario granulares de gran volumen (como vistas de página, clics de botón, impresiones de productos y reproducciones de video) desde sitios web y aplicaciones móviles en tiempo real. Es fundamental para entregar personalización en el momento, donde cada interacción digital puede influir dinámicamente en la experiencia del usuario e impulsar la implicación.

Problema

¿Cómo puede una compañía capturar y procesar una transmisión continua de eventos de comportamiento desde propiedades digitales (que abarcan millones de interacciones de usuario por minuto) y hacer que esos datos estén disponibles de inmediato en Data 360 para potenciar la segmentación, personalización y activación en tiempo real?

Fuerzas

Este caso de uso presenta varios retos de diseño que requieren una arquitectura de ingreso de baja latencia creada específicamente:

- Rendimiento extremo: Los sitios web de alto tráfico o las aplicaciones móviles pueden emitir millones de eventos por minuto. La capa de admisión debe ampliarse horizontalmente para gestionar este volumen sin pérdida de eventos o contrapresión, garantizando una latencia coherente bajo cargas máximas.

- Instrumentación del lado del cliente: A diferencia de las integraciones dirigidas por servidor, este patrón depende de los SDK del lado del cliente. Una baliza de JavaScript (SDK de interacciones de Salesforce) debe estar integrada en cada página, o un SDK nativo integrado en aplicaciones móviles. Esto requiere una implementación de cliente sólida, versiones y regulación de esquemas de eventos.

- Procesamiento de eventos de baja latencia: Las acciones de usuario, como “agregar al carrito” o “reproducción de video”, deben alcanzar Data 360 en cuestión de segundos, lo que permite la activación en tiempo real y las respuestas contextuales (por ejemplo, ofertas dirigidas, recomendaciones personalizadas).

- Armonización y resolución de identidad: Los eventos capturados a menudo incluyen identificadores anónimos (cookies, Id. de dispositivo, tokens de sesión). Para potenciar casos de uso Customer 360, estos deben asignarse a perfiles conocidos a través de la resolución de identidad de Data 360 y armonizarse con el modelo de datos Customer 360.

Solución

El enfoque recomendado es utilizar el Conector de personalización de Salesforce Marketing Cloud: una canalización de transmisión completamente gestionada nativa diseñada para el ingreso de comportamiento de alto rendimiento.

| Área de solución | Ajuste | Comentarios / Detalles de implementación |

|---|---|---|

| Captura de eventos basada en SDK | Mejor | Implemente el SDK de interacciones de Salesforce (web) o el SDK nativo (móvil). Estas bibliotecas ligeras capturan y serializan interacciones de usuarios en tiempo real, adjuntando metadatos (Id. de sesión, marca de tiempo, contexto). |

| Oportunidades en curso de transmisión de eventos | Mejor | Los eventos se envían al servicio de transmisión de eventos de Marketing Cloud Personalization a través de HTTPS seguro. Esta capa es ampliable horizontalmente y está optimizada para la transmisión de baja latencia (<2s). |

| Integración de Data 360 | Mejor | El Conector de personalización de Data 360 se suscribe a las noticias en tiempo real de transmisión, ingresando cada evento en un Objeto de lago de datos (DLO) casi en tiempo real. |

| Asignación de modelo de datos | Mejor práctica | El DLO ingresado se asigna a Objetos de modelo de datos (DMO) Customer 360. Esto permite vincular usuarios anónimos y conocidos a través de Resolución de identidad. |

| Activación de gráficos en tiempo real | Opcional / Recomendado | Incluya DMO asignados en el gráfico en tiempo real para segmentación instantánea, desencadenando acciones personalizadas a través de flujos de trabajo Einstein o Agentforce. |

| Cuándo no utilizar | Suboptimal | Este patrón no es ideal cuando: Los datos de origen son cliente web y eventos (utilice la API de ingreso en su lugar). La organización carece de control sobre clientes web/móviles. No se requiere el seguimiento del comportamiento en tiempo real (utilice el ingreso por lotes). |

| Gestionar los cambios de esquema | Evolución gestionada | Los esquemas de eventos evolucionan a medida que se agregan nuevas interacciones. Los SDK deben versionar definiciones de eventos. Los cambios compatibles con versiones anteriores (agregar campos opcionales) son seguros; la interrupción de los cambios requiere la reconfiguración del conector y pruebas de contratos. |

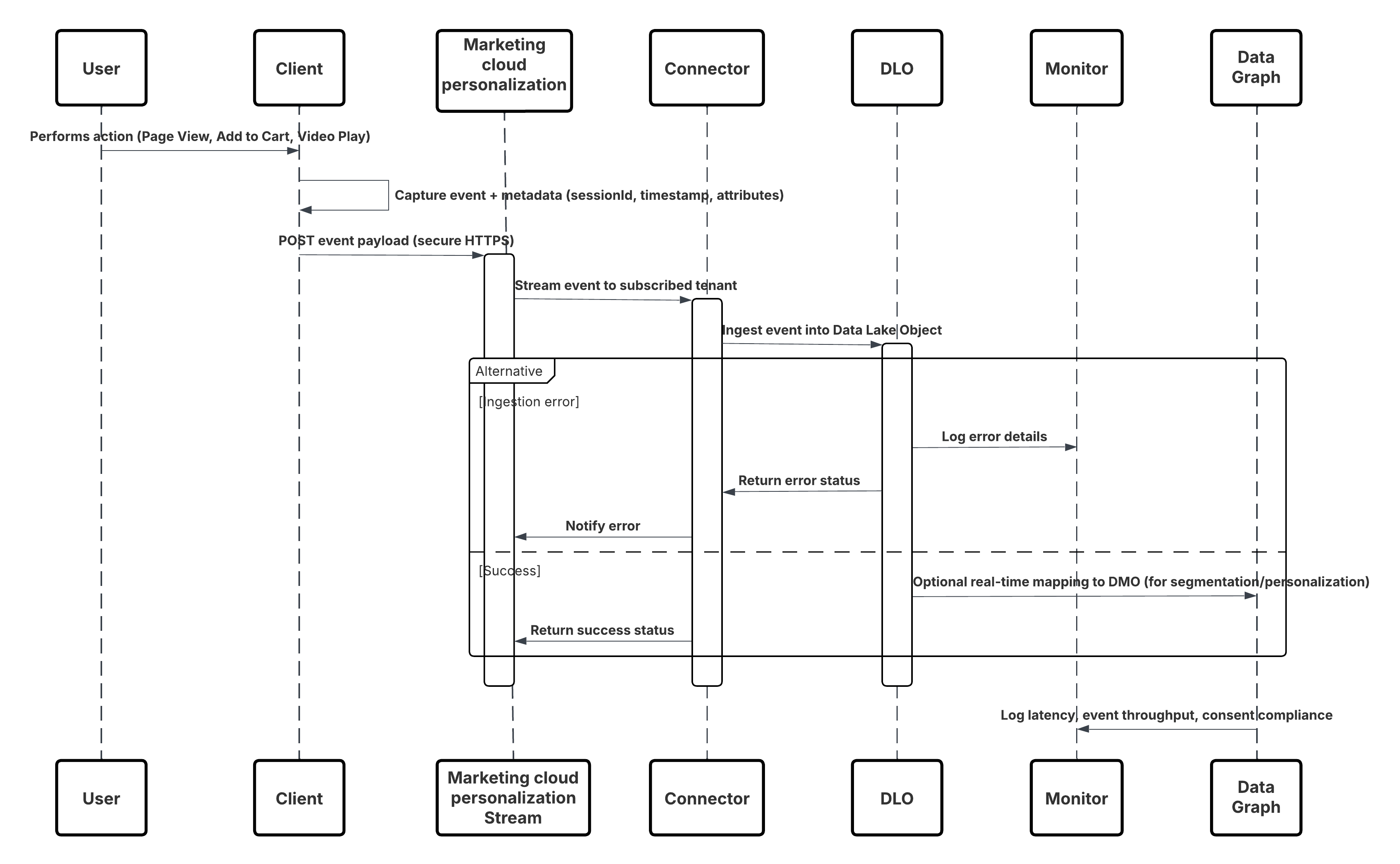

Boceto

Este diagrama ilustra la secuencia de pasos para ingresar los datos desde canales móviles y web en Data 360

En este escenario:

- Implemente el SDK en canales web o móviles (captura de interacción de usuario).

- Configure SDK con controles de Id. de arrendatario, entorno y consentimiento.

- Transmita eventos JSON capturados (metadatos + atributos) al extremo de transmisión de Marketing Cloud.

- En Configuración de Data 360, cree y configure el Conector de personalización para el arrendatario.

- Ingrese eventos en un DLO y asigne el DLO → DMO dentro de Data 360.

- Active el DMO en el gráfico en tiempo real para una activación inmediata.

- Monitoree la latencia, la conformidad de esquemas, los indicadores de consentimiento, el rendimiento y los índices de error.

- Implemente en producción y monitoree continuamente.

Resultados

Una transmisión continua y de baja latencia de eventos de comportamiento fluye desde canales digitales a Data 360. En cuestión de segundos, cada acción de usuario queda disponible para segmentación en tiempo real, modelado predictivo o personalización desencadenada, permitiendo experiencias de cliente verdaderamente adaptativas.

Mecanismos de admisión

El mecanismo de ingreso depende del conector y la estrategia de programación definidos en Data 360.

| Mecanismo | Cuándo utilizar |

|---|---|

| SDK de interacciones (Web) | Captura en tiempo real desde navegadores web y SPA. |

| SDK móvil | Captura en tiempo real desde aplicaciones móviles nativas. |

| Conector de personalización | Suscripción gestionada entre Marketing Cloud y Data 360\. |

| Asignación de gráficos en tiempo real | Activa la activación inmediata en Segmentación, Einstein y Trayectorias. |

Gestión y recuperación de errores

- Tolerancia a fallos por capas: Implemente mecanismos de validación y reintento de múltiples niveles: los SDK de cliente gestionan fallos transitorios con retroceso exponencial, mientras que la capa de ingreso utiliza colas duraderas y oportunidades en curso reproducibles para evitar la pérdida de datos.

- Esquema y gobernanza de datos: Verifique y valide esquemas de eventos de forma continua; los eventos no válidos o en evolución se enrutan a una cola de rechazo de esquema o letra muerta para un triaje y reproducción seguros.

- Impotencia y deduplicación: Utilice identificadores de eventos estables y altere la semántica para garantizar el procesamiento una vez exacto incluso durante reintentos o repeticiones.