Moderne Salesforce-Integrationen müssen weit mehr unterstützen als den einfachen Datenaustausch. Es wird erwartet, dass sie Kundenerfahrungen in Echtzeit unterstützen, Aktionen über mehrere Systeme hinweg koordinieren und zuverlässig im Unternehmensmaßstab arbeiten – und dies alles unter Einhaltung strenger Sicherheits- und Compliance-Anforderungen. Die Wahl des richtigen Integrationsansatzes ist daher eine wichtige architektonische Entscheidung und kein Implementierungsdetail. Stellen Sie sich ein allgemeines Unternehmensszenario vor. Ein Kunde schließt einen Kauf in einer mobilen Anwendung ab und löst eine Echtzeit-Anspruchsprüfung für ein personalisiertes Angebot aus. Gleichzeitig müssen Transaktionsdaten in einem ERP-System aufgezeichnet, Kundenattribute in Salesforce aktualisiert und Analysen an einen Data Lake übertragen werden, ohne Latenz, Datenduplizierung oder Compliance-Risiko einzuführen. Szenarien wie diese sind nun typisch in modernen Salesforce-Umgebungen, in denen Salesforce selten isoliert arbeitet und sich nahtlos in ein breiteres Ökosystem von Anwendungen und Datenplattformen integrieren muss. Dieser Leitfaden soll Architekten und Entwicklern helfen, diese Integrationen klar und sicher zu entwerfen. Statt sich auf Punkt-zu-Punkt-Implementierungen zu konzentrieren, werden bewährte Integrationsmuster vorgestellt, die sich auf wiederkehrende Unternehmensszenarien wie die Prozessorchestrierung, die Datensynchronisierung und den Echtzeit-Datenzugriff beziehen. Jedes Muster legt den Schwerpunkt auf architektonische Absichten, Kompromisse und Ausführungsmodelle, sodass Teams fundierte Designentscheidungen treffen können, die skaliert und dauerhaft sind. In diesem Dokument finden Sie Folgendes:

- Integrationsmuster, die allgemeine Unternehmens-„Archetypen“ in Prozess-, Daten- und virtuellen Zugriffsszenarien darstellen

- Ein Musterauswahl-Framework, das hilft, den richtigen Ansatz basierend auf Integrationsabsicht und Ausführungszeit zu identifizieren

- Praktische Anleitung zu Skalierbarkeit, Resilienz, Governance und Sicherheitsaspekten

- Bewährte Vorgehensweisen aus realen Salesforce- und Data 360-Implementierungen Das Ziel dieses Dokuments besteht darin, eine gemeinsame Architektursprache für die Integration bereitzustellen und Teams dabei zu unterstützen, Lösungen zu entwickeln, die Leistung, Flexibilität und Trust in Einklang mit Unternehmensdaten und Governance-Strategien bringen.

Dieses Dokument richtet sich an Designer und Architekten, die Daten aus anderen Anwendungen in ihrem Unternehmen in Salesforce Data 360 (ehemals Data Cloud) integrieren müssen. Dieser Inhalt ist eine Zusammenfassung vieler erfolgreicher Implementierungen von Salesforce-Architekten und -Partnern. Wenn Sie sich mit den Integrationsfunktionen und -optionen vertraut machen möchten, die für die umfassende Einführung von Data 360 verfügbar sind, lesen Sie die Abschnitte "Musterübersicht" und "Musterauswahlanleitung" weiter unten. Architekten und Entwickler sollten diese Musterdetails und bewährten Vorgehensweisen während der Entwurfs- und Implementierungsphase von Dateninteraktionsprojekten in Data 360 berücksichtigen. Wenn diese Muster ordnungsgemäß implementiert werden, können Sie so schnell wie möglich zur Produktion gelangen und über die stabilsten, skalierbarsten und wartungsfreien Anwendungen verfügen. Die eigenen beratenden Architekten von Salesforce verwenden diese Muster als Referenzpunkte bei Architekturüberprüfungen und pflegen und verbessern sie aktiv. Wie bei allen Mustern deckt dieser Inhalt die meisten Integrationsszenarien ab, jedoch nicht alle. Salesforce ermöglicht zwar beispielsweise die Integration von Mashups auf der Benutzeroberfläche (UI), diese Integration fällt jedoch nicht in den Geltungsbereich dieses Dokuments.

Jedes Integrationsmuster folgt einer konsistenten Struktur. Dies sorgt für Konsistenz bei den in den einzelnen Mustern bereitgestellten Informationen und erleichtert zudem den Vergleich von Mustern.

- Name: Der Musterkennzeichner, der auch den im Muster enthaltenen Integrationstyp angibt.

- Context: Das allgemeine Integrationsszenario, auf das sich das Muster bezieht. Kontext enthält Informationen darüber, was Benutzer erreichen möchten und wie sich die Anwendung verhält, um die Anforderungen zu erfüllen.

- Problem: Als Frage ausgedrückt, ist dies das Szenario, das das Muster lösen soll. Lesen Sie diesen Abschnitt, um nachzuvollziehen, ob das Muster für Ihr Integrationsszenario geeignet ist.

- Kräfte: Die Einschränkungen und Umstände, die die Lösung des angegebenen Szenarios erschweren.

- Lösung: Die empfohlene Lösung für das Integrationsszenario.

- Skizze: Ein UML-Sequenzdiagramm, das Ihnen zeigt, wie die Lösung das Szenario angeht.

- Ergebnisse: Erläutert, wie die Lösung auf Ihr Integrationsszenario angewendet wird und wie die mit diesem Szenario verbundenen Kräfte aufgelöst werden. Dieser Abschnitt enthält auch neue Herausforderungen, die durch die Anwendung des Musters auftreten können.

- Randleisten: Zusätzliche Abschnitte zum Muster, die wichtige technische Probleme, Variationen des Musters, musterspezifische Bedenken usw. enthalten.

- Beispiel: Ein reales Szenario, das beschreibt, wie das Designmuster in einem realen Salesforce-Szenario verwendet wird. Im Beispiel werden die Integrationsziele erläutert und erläutert, wie das Muster implementiert wird, um diese Ziele zu erreichen.

Verwenden Sie diese Tabelle als Inhaltsverzeichnis für die in diesem Dokument enthaltenen Integrationsmuster.

| Musterebene1 | Musterebene2 | Muster | Szenario |

|---|---|---|---|

| Datenaufnahmemuster – Eingehende Daten | Batch-Aufnahmemuster | Massendatenaufnahme aus Cloud-Speicher | Daten werden aus einer Enterprise Cloud-Speicherquelle wie Amazon S3, Azure Blob oder Google Cloud Storage in Data 360 in Form großer Batches mit Rohdaten (z. B. Transaktionen oder Produktprotokollen) aufgenommen. |

| Massendatenaufnahme aus Salesforce Clouds | Data 360 empfängt CRM-Daten per Massenvorgang aus mehreren Salesforce-Organisationen (z. B. Sales Cloud, Service Cloud), um zusammengeführte Kundenprofile zu erstellen. | ||

| Streaming und Echtzeit-Aufnahmemuster | Ereignisgesteuerte Aufnahme über die Aufnahme-API – Streaming | Data 360 abonniert Streaming-Aufnahmeendpunkte, die kontinuierliche Ereignisnutzlasten (z. B. Kaufereignisse, IoT-Telemetrie) von Unternehmenssystemen empfangen, um Profilaktualisierungen in Echtzeit vorzunehmen. | |

| Aufnahme von Web- und mobilem Verhalten in Echtzeit | Data 360 erfasst und verarbeitet Verhaltensdaten von Websites und mobilen Anwendungen in Echtzeit über SDKs, um Interaktionskennzahlen und Personalisierungsmodelle anzureichern. | ||

| CRM-Synchronisierung nahezu in Echtzeit über Streaming | Data 360 empfängt CRM-Datenaktualisierungen (z. B. Kontakt-, Kundenvorgangs- oder Opportunity-Änderungen) nahezu in Echtzeit über Ereignisströme, um eine kontinuierlich synchronisierte Customer 360 Ansicht aufrechtzuerhalten. | ||

| Ereignisstromaufnahme aus Cloud-Messaging-Plattformen – Kinesis und MSK | Data 360 verwendet Streaming-Daten direkt von Cloud-Ereignisplattformen wie AWS Kinesis oder Kafka (MSK), um hochfrequente betriebliche oder IoT-Ereignisse zu verarbeiten. | ||

| Null Kopiermuster – Eingehend und ausgehend | Eingehende Nullkopie – externe Plattformen für Data 360 | Data 360 fragt externe Datensets (z. B. Snowflake, BigQuery) bei Bedarf über die Aufnahme von Nullkopien ab, ohne Daten physisch in Salesforce zu verschieben. | |

| Ausgehende Nullkopie – Data 360 für externe Plattformen | Externe Systeme wie Databricks oder Tableau greifen über ausgehende Zero Copy-Verbindungen ohne Datenreplikation auf angereicherte Segmente und Statistiken in Data 360 zu. | ||

| Zusammengeführte Datenplattform für mehrere Organisationen mit Data Cloud One | Data Cloud One vereinheitlicht mehrere Salesforce-Organisationen und externe Datenquellen unter einem gemeinsamen Metadaten- und semantischen Modell und bietet so eine konsistente Customer 360 ohne Datenduplizierung. | ||

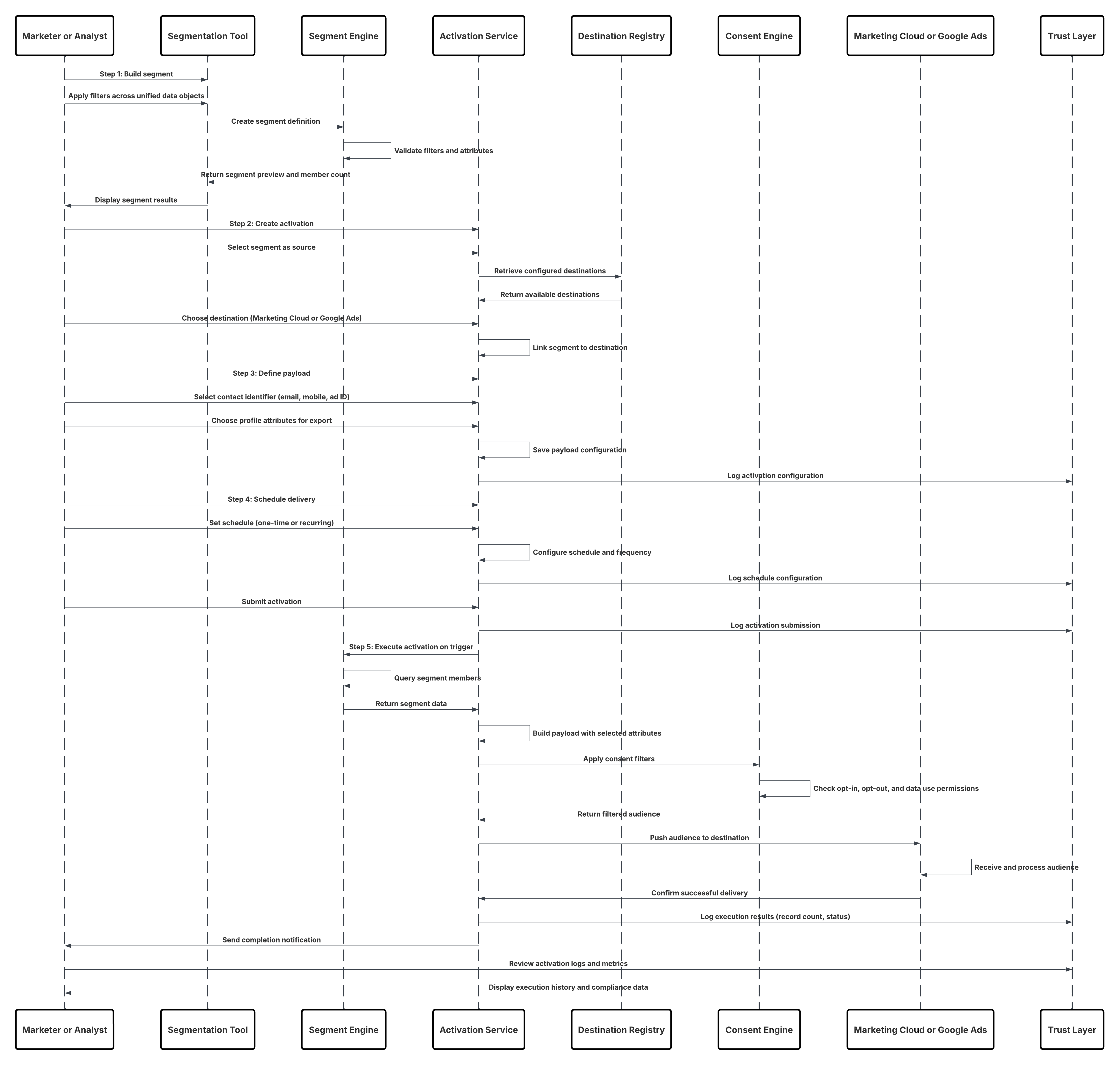

| Datenaktivierungsmuster – Ausgehende Daten | Batch-Aktivierungsmuster | Segmentaktivierung für Marketing- und Werbeplattformen | Data 360 aktiviert verwaltete Kundensegmente direkt in Marketing Cloud, Meta, Google Ads oder anderen Anzeigenplattformen für die Bereitstellung personalisierter Kampagnen |

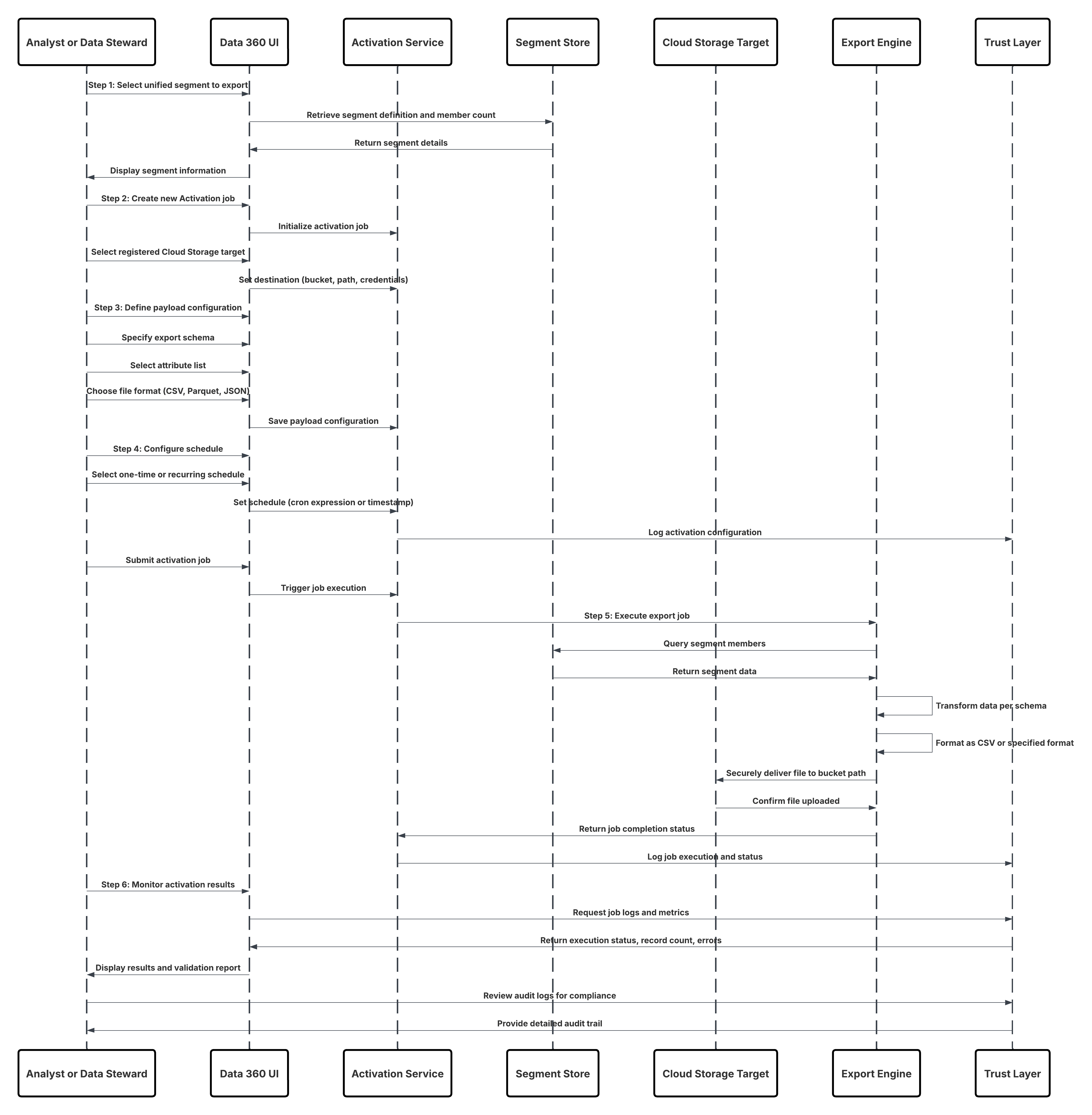

| Datenexport in Cloud-Speicher | Data 360 exportiert zusammengeführte oder gefilterte Datensets (z. B. Datensätze vom Typ "Zustimmung zu Kunden") als CSV- oder Parquet-Dateien in den Enterprise Cloud-Speicher für Analysen oder die Compliance-Archivierung. | ||

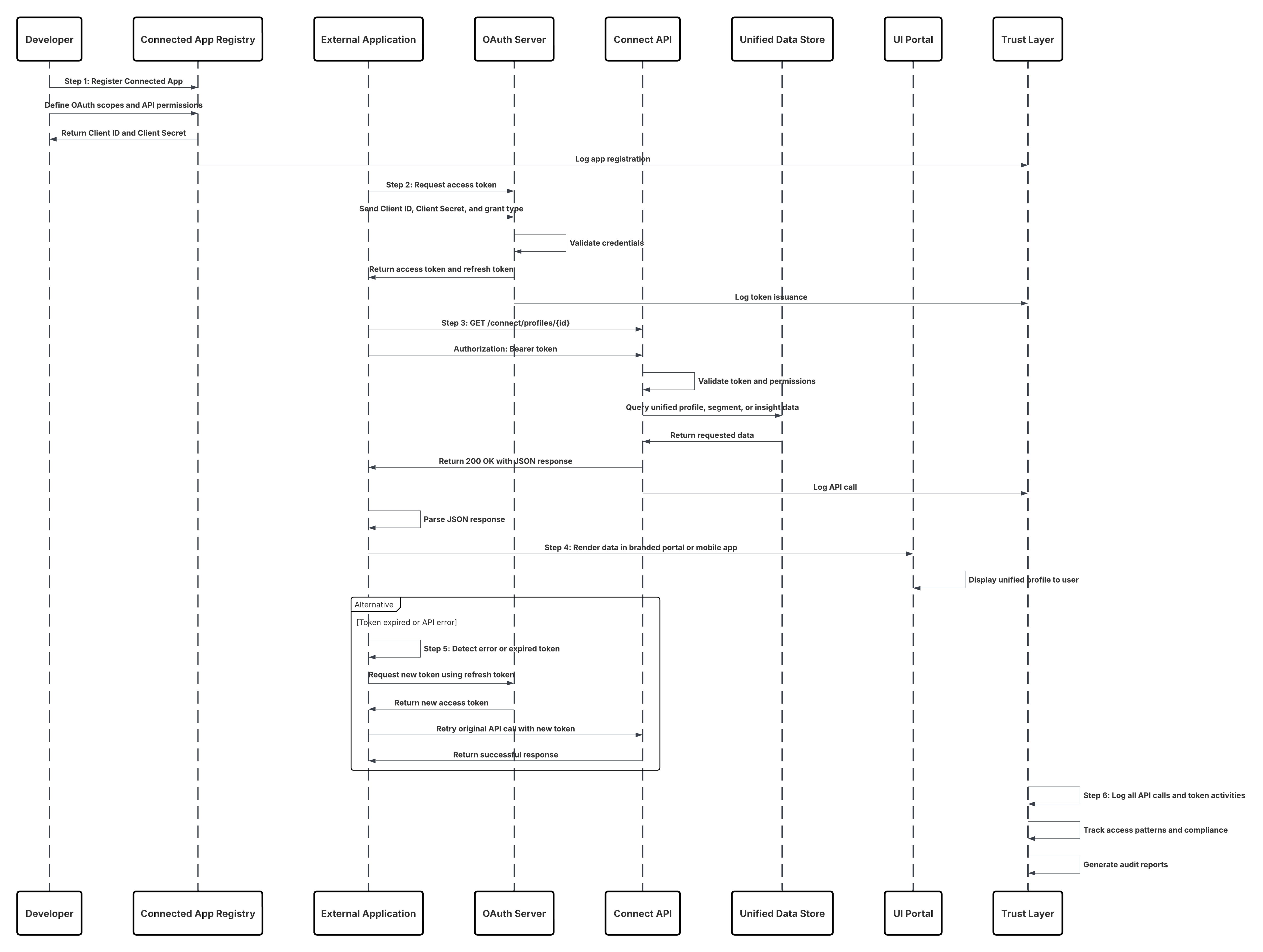

| API-basierte On-Demand-Aktivierung | Benutzerdefinierte Anwendungsintegration über die Connect-API | Externe Anwendungen rufen die Data 360 Connect-API in Echtzeit auf, um personalisierte Aktionen (z. B. Treuebilanzprüfung oder Generierung von AI-Angeboten) basierend auf aktuellen Kundendaten abzurufen oder auszulösen.Benutzerdefinierte Web- oder mobile Anwendungen rufen harmonisierte Data 360-Statistiken sicher über die Connect-REST-API ab, um sie auf der Benutzeroberfläche von Unternehmen oder Partnern anzuzeigen. | |

| Abschließen des Kundenprofilabrufs über die Datendiagramm-API | Ein System ruft das vereinheitlichte Profil eines Kunden mithilfe der Datendiagramm-API ab und gibt eine vorverknüpfte JSON-Darstellung in Echtzeit der vollständigen 360°-Ansicht zur Entscheidungsfindung oder Personalisierung zurück. | ||

| Echtzeit-Datenaktionen | Echtzeit-Datenaktion zum Umwandeln von Kundensignalen in sofortige Aktionen | Data 360 erkennt und verarbeitet ein Live-Ereignis (z. B. Einwilligungsaktualisierung, Kaufauslöser) und ruft sofort ein verbundenes System oder einen Salesforce-Flow für nachgelagerte Aktionen auf.Ein Kundenaktivitätssignal (z. B. erkanntes Abwanderungsrisiko) in Data 360 löst eine sofortige Echtzeitaktion aus, beispielsweise das Aktualisieren von CRM, das Aufrufen von Einstein-Bewertungen oder das Starten einer Aufbewahrungs-Journey. |

Die Integrationsmuster in diesem Dokument werden in drei Kategorien unterteilt: Daten-, Prozess- und visuelle Integrationen.

Datenintegrationsmuster in Data 360 zielen auf die Bewegung und Synchronisierung von Daten zwischen Systemen ab, um sicherzustellen, dass Data 360 und externe Plattformen konsistente, aktuelle und vertrauenswürdige Informationen enthalten. Diese Muster verarbeiten in der Regel große Datenflüsse mit hohem Volumen und basieren auf geregelten Pipelines, die Schemakonsistenz, Abstammungsverfolgung und Mastering-Regeln erzwingen.

- Batch-Aufnahmemuster stellen die grundlegende Ebene der Einarbeitung von Unternehmensdaten dar. Die Massendatenaufnahme aus Cloud-Speicherservices wie AWS S3, Azure Blob oder Google Cloud Storage ermöglicht es, große historische Datensets regelmäßig in Data 360 zu laden, um die Identität aufzulösen, zu segmentieren und zu analysieren. Ähnlich verhält es sich bei der Massenaufnahme aus Salesforce Clouds, beispielsweise Sales, Service oder Marketing Cloud, mit nativen Konnektoren und Datenströmen, um CRM-Daten in die vereinheitlichte Datenebene zu integrieren und so Harmonisierung und Kontinuität zwischen den Engagementsystemen zu gewährleisten.

- Streaming und Echtzeit-Aufnahmemuster erweitern dies durch die Erfassung von Ereignisdaten mit hoher Geschwindigkeit. Durch die ereignisgesteuerte Aufnahme über die Aufnahme-API können externe Systeme Kundenaktivitäten kontinuierlich in Data 360 streamen. Die Echtzeit-Aufnahme von Web- und mobilen Verhaltensweisen erfasst Clickstream- und Interaktionsdaten direkt von digitalen Kontaktpunkten, um die sofortige Personalisierung zu fördern. Die CRM-Synchronisierung nahezu in Echtzeit über Streaming-APIs stellt sicher, dass Kundenattribute und Einwilligungsaktualisierungen schnell systemübergreifend berücksichtigt werden. Die Aufnahme von Ereignisströmen aus Messaging-Plattformen wie Amazon Kinesis oder Confluent MSK unterstützt kontinuierliche Pipelines mit hohem Durchsatz, wodurch Data 360 an die Ereignisarchitekturen von Unternehmen angepasst wird.

- Die einheitliche Multi-Org Data Platform mit Data Cloud One veranschaulicht die Datenintegration weiter und bietet eine konsolidierte Umgebung, um Daten aus mehreren Salesforce-Organisationen und externen Quellen unter einer gemeinsamen Governance- und semantischen Ebene zu vereinheitlichen. Dadurch können Organisationen unternehmensweite Datenkonsistenz, freigegebene Datenmodelle und skalierbare Analysen erreichen.

- In der Aktivierungsphase folgen Batch-Aktivierungsmuster demselben Datenintegrationsprinzip. In Data 360 zusammengestellte Segmente werden in geplanten Aufträgen auf nachgelagerte Marketing- und Werbeplattformen wie Marketing Cloud, Meta Ads oder Google Ads exportiert und lösen dort die Kampagnenausführung aus. Ebenso können Datensets in Cloud-Speicherziele exportiert werden, um externe Analysen und Data Science-Pipelines voranzutreiben. In all diesen Anwendungsfällen fungiert Data 360 als Quelle der Wahrheit für synchronisierte und zusammengestellte Kundendaten.

Prozessintegrationsmuster in Data 360 beinhalten das Auslösen oder Orchestrieren von Geschäftsprozessen über mehrere Systeme hinweg in nahezu Echtzeit. Anhand dieser Muster kann Data 360 aktiv an Unternehmens-Workflows teilnehmen und so kontextbezogene Antworten und dynamische Datenaktivierung ermöglichen.

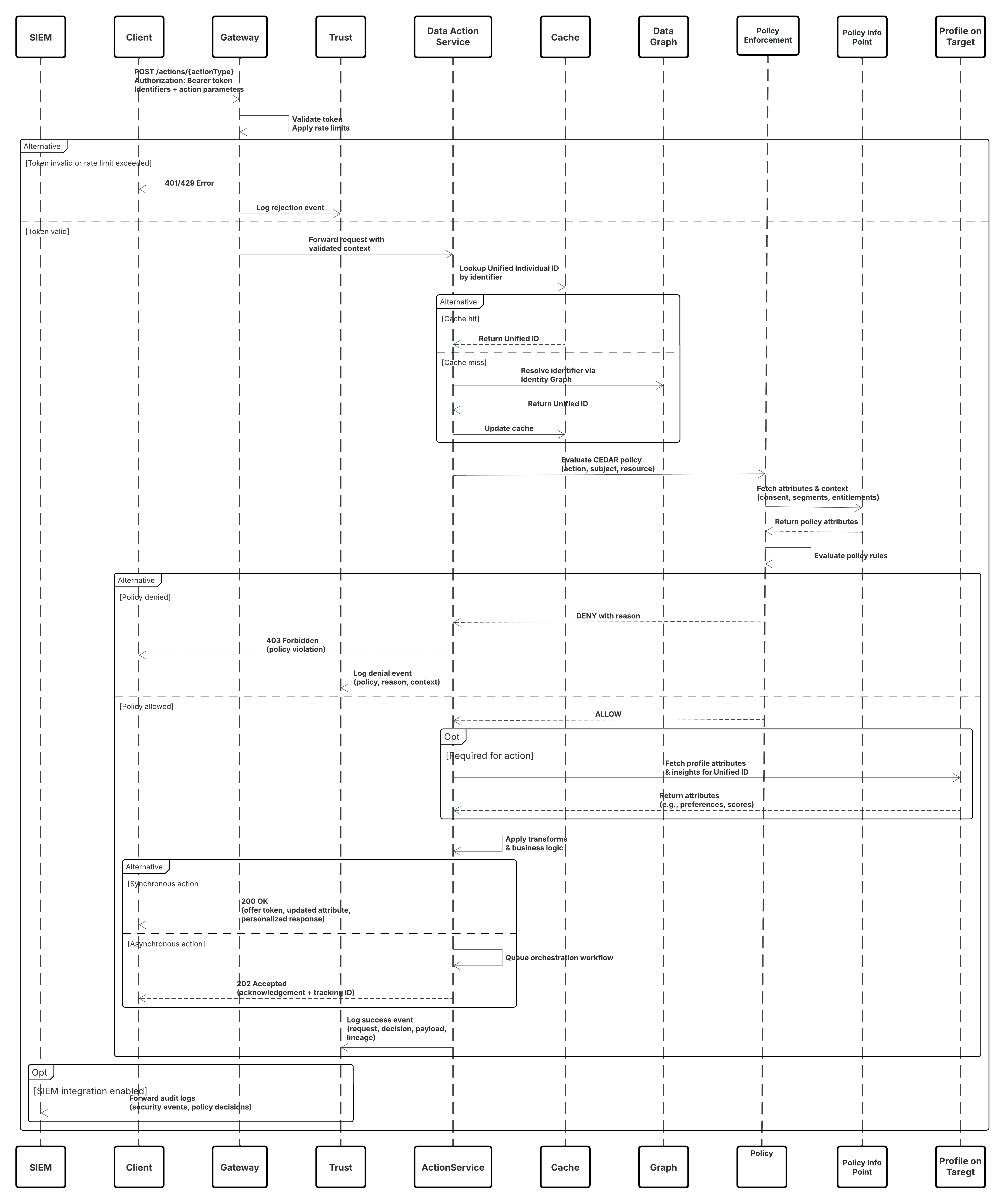

- Die API-basierte On-Demand-Aktivierung ermöglicht Engagementszenarien in Echtzeit. Über die Connect-API können benutzerdefinierte Anwendungen Kundenprofile direkt in Data 360 im Rahmen von betrieblichen Prozessen abfragen oder aktivieren, beispielsweise eine Agentenkonsole, die während einer Kundeninteraktion zusammengeführte Profilstatistiken abruft. Die Complete Customer Profile Retrieval via Data Graph API unterstützt zusammengesetzte Anwendungen und Microservices, die auf API-gesteuerten Zugriff auf das vollständige Einheitendiagramm eines Kunden angewiesen sind, was dynamische Erfahrungen ohne vordefinierte Segmente ermöglicht.

- Mit Echtzeit-Datenaktionen wird dieser Integrationsansatz weiter vorangetrieben, indem sofortige Reaktionsfähigkeit ermöglicht wird. Wenn ein Kundensignal erkannt wird, beispielsweise ein Kauf, eine Formularsendung oder ein Schwellenwertereignis, kann Data 360 Aktionen wie das Aktualisieren eines CRM-Datensatzes, das Aufrufen eines externen Webhooks oder das Starten eines personalisierten Angebots-Workflows auslösen. Diese Muster verkörpern eine echte Prozessorchestrierung, die Kundenintelligenz in Echtzeit mit automatisierter operativer Ausführung verbindet.

Virtuelle Integrationsmuster in Data 360 ermöglichen den Live-Zugriff auf externe oder Verbunddatenquellen, ohne Daten physisch kopieren oder duplizieren zu müssen. Diese sind wichtig für Unternehmen, die geregelte, aktuelle Informationen zur Abfragezeit benötigen und gleichzeitig die Datenbewegung minimieren.

- Inbound Zero Copy Data Federation(External Platforms-to-Data 360) ermöglicht externen Systemen wie Data Warehouses oder Data Lakes die Freigabe von Datensets für Data 360 über sichere, geregelte Verbindungen (z. B. Snowflake Secure Data Sharing). Dadurch wird sichergestellt, dass Data 360 virtuell auf externe Daten zugreifen und sie bearbeiten kann, wodurch die Aktualität gewahrt bleibt und unnötige Abgleiche vermieden werden.

- Mit der ausgehenden Zero Copy-Datenfreigabe (Data 360-zu-externen Plattformen) kann Data 360 zusammengestellte Datensets für den externen Verbrauch wie AI-Modellierung, Business Intelligence oder erweiterte Analysen über sichere Datenverbund- und Live-Abfragemechanismen bereitstellen. Die Auswahl der besten Integrationsstrategie für Ihr System ist nicht trivial. Es gibt viele Aspekte zu berücksichtigen und viele Tools, die verwendet werden können, wobei einige Tools für bestimmte Aufgaben besser geeignet sind als andere. Jedes Muster richtet sich an bestimmte kritische Bereiche, einschließlich der Funktionen der einzelnen Systeme, des Datenvolumens, der Fehlerverarbeitung und der Transaktionalität.

Beantworten Sie bei der Auswahl eines Integrationsmusters zunächst zwei grundlegende Fragen, die das Gesamtdesign und -verhalten der Integration beeinflussen. Was integrieren Sie? – Prozess-, Daten- oder virtueller Zugriff Diese Dimension definiert den primären Zweck der Integration.

- Prozessintegrationen konzentrieren sich auf die Orchestrierung von Geschäfts-Workflows und die systemübergreifende Koordinierung von Aktionen.

- Bei Datenintegrationen liegt der Fokus auf der Synchronisierung, Anreicherung oder Übertragung von Daten zwischen Systemen.

- Virtuelle Integrationen konzentrieren sich darauf, in Echtzeit auf externe Daten zuzugreifen, ohne sie in Salesforce oder Data 360 kopieren oder beibehalten zu müssen. Wenn Sie diesen Intent verstehen, können Sie die erforderliche Orchestrierung, Datenverschiebung und Kopplung zwischen Systemen bestimmen.

- Wie muss sie ausgeführt werden? – Die Methode Synchron oder Asynchron definiert das Ausführungsmodell der Integration.

- Synchrone Integrationen erfolgen in Echtzeit und blockieren, wobei der Anrufer eine sofortige Antwort erwartet – häufig verwendet für benutzergesteuerte oder Validierungsszenarien.

- Asynchrone Integrationen sind nicht blockierbar und entkoppelt und wurden für Skalierung, langfristige Prozesse, Wiederholungen und hohe Datenvolumen entwickelt. Zusammen bieten diese beiden Dimensionen – Intent und Ausführungszeitpunkt – einen klaren, konsistenten Rahmen für die Auswahl des richtigen Integrationsmusters, während Benutzererfahrung, Skalierbarkeit und betriebliche Widerstandsfähigkeit in Einklang gebracht werden. Hinweis: Für eine Integration kann eine externe Middleware oder Integrationslösung (z. B. Enterprise Service Bus) erforderlich sein, je nachdem, welche Aspekte auf Ihr Integrationsszenario zutreffen.

In dieser Tabelle sind die Muster und ihre wichtigsten Aspekte aufgeführt, damit Sie bestimmen können, welches Muster Ihren Anforderungen am besten entspricht, wenn Ihre Integration von Salesforce in ein anderes System erfolgt.

| Typ | Zeitpunkt | Überlegungen zu "Ausgehend" |

|---|---|---|

| Datenintegration | Asynchron | Segmentaktivierung für Marketing- und Werbeplattformen |

| Prozess-/Datenintegration | Synchronous | Benutzerdefinierte Anwendungsintegration über die Connect-API Abschließen des Kundenprofilabrufs über die Datendiagramm-API |

| Datenintegration | Synchronous | Echtzeit-Datenaktion zum Umwandeln von Kundensignalen in sofortige Aktionen |

| Virtuelle Integration (mit Zero Copy) | Asynchron | Ausgehende Nullkopie – Data 360 für externe Plattformen |

| Virtuelle Integration | Asynchron | Zusammengeführte Datenplattform für mehrere Organisationen mit Data Cloud One |

In dieser Tabelle sind die Muster und ihre wichtigsten Aspekte aufgeführt, damit Sie das Muster ermitteln können, das Ihren Anforderungen am besten entspricht, wenn Ihre Integration von einem anderen System in Salesforce erfolgt.

| Typ | Zeitpunkt | Eingehende Überlegungen |

|---|---|---|

| Datenintegration | Asynchron | Massendatenaufnahme aus Cloud-Speicher Massendatenaufnahme aus Salesforce Clouds |

| Datenintegration | Asynchron | Ereignisstromaufnahme aus Cloud-Messaging-Plattformen – Kinesis und MSK CRM-Synchronisierung nahezu in Echtzeit über Streaming |

| Prozessintegration | Synchronous | Ereignisgesteuerte Aufnahme über die Aufnahme-API – Streaming Aufnahme von Web- und mobilem Verhalten in Echtzeit |

| Virtuelle Integration | Asynchron | Eingehende Nullkopie – externe Plattformen für Data 360 |

In dieser Tabelle sind einige wichtige Begriffe in Bezug auf Middleware und ihre Definitionen in Bezug auf diese Muster aufgeführt.

| Term | Definition |

|---|---|

| Ereignisverarbeitung | Die Ereignisverarbeitung bezieht sich auf das Empfangen, Weiterleiten und Reagieren auf identifizierbare Vorkommnisse aus einem Quellsystem oder einer Anwendung. Die Middleware verarbeitet Ereignisse, indem sie den Zielendpunkt identifiziert, das Ereignis weiterleitet und die erforderliche Geschäftsaktion auslöst (z. B. Protokollierung, Wiederholungen oder Aktivierung nachgelagerter Services). In Data 360-Architekturen ist die Ereignisverarbeitung wichtig für die Echtzeit-Datenaufnahme, Aktivierungsauslöser und Veröffentlichungs-/Abonnementmuster. Ereignisse können von externen Systemen (Kafka, AWS Kinesis) oder Salesforce Platform-Ereignissen stammen und von Middleware oder dem Data 360-Ereignis-Bus zur sofortigen Verarbeitung weitergeleitet werden. |

| Protokollkonvertierung | Die Protokollkonvertierung ermöglicht die Kommunikation zwischen Systemen, die unterschiedliche Datentransportstandards verwenden. Middleware übersetzt proprietäre oder ältere Protokolle (wie AMQP, MQTT, FTP) in unterstützte Data 360-Protokolle (REST, gRPC oder HTTPS). Dadurch wird die Interoperabilität über heterogene Systeme hinweg gewährleistet. Da Data 360 die Protokollkonvertierung nicht nativ verarbeitet, stellt Middleware die Anpassungsebene bereit, um Nachrichten in ein Format zu kapseln oder umzuwandeln, das Data 360-APIs und -Konnektoren interpretieren können. |

| Übersetzung und Transformation | Die Übersetzung und Transformation gewährleisten die Interoperabilität, indem sie ein Datenformat oder Schema einem anderen zuordnen. Middleware führt diese Transformationen aus, um verschiedene Datennutzlasten (CSV, XML, JSON) an Data 360-Datenmodellobjekten (DMOs) und Objekten der einheitlichen Datenebene (Unified Data Layer Objects, UDLOs) auszurichten. Dies umfasst die Bereinigung, Anreicherung und Anwendung der semantischen oder ontologiebasierten Zuordnung vor der Aufnahme. Salesforce bietet Transformationstools wie Rezepte für die Datenvorbereitung. Komplexe Transformationen (insbesondere für die semantische Harmonisierung) lassen sich jedoch am besten in Middleware verarbeiten. |

| Warteschlange und Pufferung | Warteschlange und Pufferung basieren auf der asynchronen Nachrichtenweitergabe, um eine belastbare, entkoppelte Kommunikation zu gewährleisten. Middleware-Plattformen (z. B. MuleSoft, Kafka oder Azure Event Hub) stellen persistente Warteschlangen bereit, in denen Daten temporär gespeichert werden, wenn Data 360 oder nachgelagerte Systeme ausgelastet oder nicht erreichbar sind. Dadurch wird Datenverlust verhindert und die Aufnahme oder Aktivierung nahezu in Echtzeit unterstützt. Data 360 unterstützt die Streaming-Aufnahme und das Flow-basierte ausgehende Messaging. Die dauerhafte Warteschlange und die garantierte Zustellung werden jedoch in der Regel von Middleware verarbeitet. |

| Synchrone Transportprotokolle | Synchrone Transportprotokolle beinhalten Blockierungs-/Antwortvorgänge in Echtzeit. Der Absender wartet auf eine Antwort, bevor er fortfährt. In Data 360 werden sie für API-basierte On-Demand-Aktivierungen, Echtzeitanreicherungen oder Profilnachschlagevorgänge verwendet, bei denen Antworten sofort erforderlich sind. Middleware gewährleistet die Verbindungszuverlässigkeit und verwaltet Wiederholungen oder Ausweichvorgänge für synchrone Data 360-API-Aufrufe. |

| Asynchrone Transportprotokolle | Asynchrone Transportprotokolle unterstützen die nicht blockierende, entkoppelte Kommunikation, bei der der Absender die Verarbeitung fortsetzt, ohne auf eine Antwort zu warten. Middleware verarbeitet asynchrone Flows für Batch-Aktivierungen, die Streaming-Aufnahme und die ereignisgesteuerte Aktivierung. Dies ermöglicht einen hohen Durchsatz und Widerstandsfähigkeit – entscheidend für das Streaming von Ereignissen und die nahezu Echtzeit-Datenaufnahme in Data 360. |

| Vermittlungsweiterleitung | Die Vermittlungsweiterleitung definiert einen komplexen Nachrichtenfluss zwischen Systemen und stellt sicher, dass die richtigen Daten oder Ereignisse den richtigen Verbraucher erreichen. Middleware fungiert als Vermittler und verarbeitet Weiterleitungslogik basierend auf Regeln, Kopfzeilen, Inhalten oder Ereignistypen. In Data 360-Integrationen stellt die Mediation sicher, dass Ereignisse und Profilaktualisierungen aus mehreren Systemen ordnungsgemäß an Datenaufnahme-APIs, Aktivierungsendpunkte oder externe Verbraucher weitergeleitet werden. Dies vereinfacht die Orchestrierung und unterstützt die Datensynchronisierung mit mehreren Systemen. |

| Prozesschoreografie und Serviceorchestrierung | Prozesschoreografie und Orchestrierung koordinieren Prozesse mit mehreren Systemen. Die Choreografie unterstützt autonome, asynchrone ereignisgesteuerte Flows, bei denen Systeme auf der Grundlage gemeinsamer Regeln ohne zentrale Steuerung agieren. Die Orchestrierung ist ein zentral verwalteter Flow, der die Serviceausführung steuert. In Data 360-Architekturen verwaltet Middleware die Orchestrierung für die systemübergreifende Aufnahme und Aktivierung, während Salesforce-Workflows oder -Flows leichte Choreografien innerhalb der Plattform verarbeiten. Auf Middleware-Ebene wird eine komplexe Orchestrierung empfohlen, die eine Transaktionskoordination oder eine Verwaltung des Status erfordert. |

| Transaktionalität (Verschlüsselung, Signieren, zuverlässige Zustellung, Transaktionsverwaltung) | Die Transaktionalität gewährleistet systemübergreifend atomare, konsistente, isolierte und langlebige Vorgänge (ACID). Salesforce und Data 360 sind Transaktionen innerhalb ihrer Grenzen, unterstützen jedoch keine verteilten Transaktionen über externe Systeme hinweg. Middleware übernimmt die globale Transaktionssteuerung, einschließlich Verschlüsselung, Nachrichtensignatur, Rollback, Vergütung und zuverlässiger Zustellung. Bei geschäftskritischen Datenflüssen (z. B. Finanz- oder Einwilligungsaktualisierungen) gewährleistet Middleware die durchgängige Integrität und Wiederherstellung von Data 360 und externen Systemen. |

| Weiterleitung | Die Weiterleitung gibt den gesteuerten Fluss von Nachrichten oder Daten zwischen Komponenten an. Sie kann auf Kopfzeilen, Inhaltstypen, Prioritäten oder Regeln basieren. Middleware verarbeitet die Weiterleitungslogik für Ereignisse und Aktivierungen, die Data 360 betreffen, beispielsweise die Weiterleitung von Segmenten für angereicherte Zielgruppen an verschiedene nachgelagerte Systeme (Anzeigenplattformen, Lagerhäuser, CRM-Anwendungen). Obwohl die Weiterleitung in Salesforce (Apex, Flows) implementiert werden kann, wird die Middleware-Weiterleitung aus Gründen der Skalierbarkeit, Flexibilität und Governance bevorzugt. |

| Extrahieren, Umwandeln und Laden | Bei der ETL werden Daten aus Quellsystemen extrahiert, in ein konsistentes Schema umgewandelt und in ein Ziel (wie Data 360) geladen. Middleware- oder ETL-Tools verarbeiten diese Vorgänge vor der Datenaufnahme. Data 360 kann ETL-Ausgaben über APIs, Konnektoren oder Massenaufnahmepipelines empfangen und unterstützt zudem die Datenerfassung (CDC) für die Synchronisierung nahezu in Echtzeit. Middleware-ETL-Prozesse sind wichtig für die Integration veralteter Systeme und die Sicherstellung der Datenqualität vor der Vereinheitlichung in Data 360. |

| Lange Abstimmung | Long Polling (Comet-Programmierung) ist eine Methode zur Aufrechterhaltung einer offenen Kommunikation zwischen Systemen für Echtzeitaktualisierungen. Der Client sendet eine Anforderung und der Server hält sie so lange, bis ein Ereignis auftritt. Anschließend antwortet er und öffnet erneut eine Verbindung. Salesforce verwendet dies in den Streaming-API- und CometD/Bayeux-Protokollen für die ereignisgesteuerte Datensynchronisierung. Middleware kann diese Ereignisse abonnieren und sie an Data 360 weiterleiten, um Echtzeit-Aufnahme- oder Aktivierungsauslöser zu erhalten und so eine minimale Latenz zwischen Unternehmenssystemen zu gewährleisten. |

Die Datenaufnahme ist der erste und wichtigste Schritt im Datenlebenszyklus von Salesforce Data 360. Auf diese Weise gelangen Rohinformationen aus mehreren externen Systemen (CRM, ERP, Web, Mobile oder Drittanbieter-APIs) auf die Plattform und werden Teil einer einheitlichen Kundenansicht. Das richtige Aufnahmemuster hängt davon ab, was das Unternehmen benötigt:

- Datenvolumen: Wie viele Daten gleichzeitig verschoben werden

- Latenz: Wie aktuell müssen die Daten sein

- Quellsystemfunktionen – Art und Weise, wie das System Daten verbinden und bereitstellen kann Data 360 unterstützt mehrere Aufnahmemodi, um diese Anforderungen zu erfüllen: Batch für Ladevorgänge mit hohem Volumen, Streaming für Aktualisierungen nahezu in Echtzeit, ereignisbasierte Aufnahme für die Transaktionsunmittelbarkeit und Aufnahme ohne Kopieren für sofortigen Zugriff auf externe Daten, ohne sie physisch zu verschieben. Zusammen stellen diese Muster sicher, dass jedes Kundensignal – sei es ein Kaufereignis, ein Clickstream-Protokoll oder eine Treueaktualisierung – effizient, sicher und im richtigen Zeitrahmen in Data 360 einfließt, um vertrauenswürdige Analysen und AI-gestützte Erfahrungen zu ermöglichen.

Batch-Aufnahmemuster sind das Rückgrat der umfangreichen Dateneinarbeitung in Data 360. Sie sind für Szenarien optimiert, in denen Daten per Massenvorgang verarbeitet werden – in der Regel planmäßig oder regelmäßig – und nicht kontinuierlich. Diese Muster eignen sich am besten für:

- Historische Daten werden geladen, um die Plattform mit vorhandenen Unternehmensdatensätzen zu initialisieren

- Regelmäßige Synchronisierung mit Datensatzsystemen wie ERPs, Data Warehouses oder proprietären Datenbanken

- Anwendungsfälle, in denen die Echtzeitaktualisierung nicht entscheidend ist, Konsistenz, Vollständigkeit und Überprüfbarkeit jedoch Die Batch-Aufnahme bietet eine vorhersehbare Leistung und eine einfache Bedienung, was sie zu einer vertrauenswürdigen Wahl für Unternehmen macht, die Terabyte strukturierter oder halbstrukturierter Daten verwalten. Data 360 bietet eine Reihe allgemein verfügbarer Konnektoren für die Produktion, die die Batch-Aufnahme nativ unterstützen. Diese Konnektoren optimieren das Integrations-Setup, reduzieren die benutzerdefinierte ETL-Entwicklung und gewährleisten Datenqualität und Sicherheit bei jedem Import. In der folgenden Tabelle sind die gängigsten Konnektoren für die Batchaufnahme im Unternehmensmaßstab hervorgehoben.

Context

Dieses Muster wurde für Unternehmensszenarien entwickelt, bei denen große Mengen an strukturierten Daten wie CSV- oder Parquet-Dateien und unstrukturierte Datenbestände aus zentralisierten Data Lakes oder geplanten Dateiablagen aufgenommen werden. Zu den Datenquellen zählen in der Regel Cloud-Speicherplattformen wie Amazon S3, Google Cloud Storage (GCS) und Microsoft Azure Blob Storage, bei denen Dateien regelmäßig als Teil vorgelagerter Datenpipelines oder Batch-Exporte bereitgestellt werden.

Problem

Wie kann eine Organisation einen zuverlässigen, sicheren und durchsatzstarken Prozess einrichten, um massive, dateibasierte Datensets aus ihrer primären Cloud-Speicherplattform nach einem vorhersehbaren, wiederkehrenden Zeitplan in Data 360 aufzunehmen, ohne dabei die Governance, Skalierbarkeit oder Leistung zu beeinträchtigen?

Kräfte

Die Aufnahme massiver, dateibasierter Datensets in Data 360 ist keine einfache Datenübertragung, sondern eine architektonische Herausforderung, die von Skalierung, Governance und Plattformeinschränkungen geprägt ist.

Datenvolumen und Skalierung: Die Data 360-Aufnahmekonnektoren sind für Zuverlässigkeit und Governance optimiert, nicht für den willkürlichen Massendurchsatz. Beispielsweise unterstützt der Amazon S3-Konnektor bis zu 100 Millionen Zeilen oder 50 GB pro Objekt, je nachdem, welche Obergrenze zuerst erreicht wird. Für Unternehmen mit historischen Datensets, die Milliarden von Datensätzen aufweisen, wird diese Grenze zu einer wichtigen Designeinschränkung. Ein Single-File-Lift-and-Shift-Ansatz wird schnell undurchführbar, was intelligente Datenpartitionierungs-, Blockierungs- und Orchestrierungsstrategien erfordert, um eine Skalierung zu erreichen, ohne die Konnektorobergrenzen zu erreichen.

Schemadefinition und -wartung: Data 360 erfordert explizite Schemadefinitionen für jede Aufnahme-Pipeline, um die semantische und strukturelle Integrität sicherzustellen. Bei der S3-Aufnahme muss eine CSV-Datei Spaltenüberschriften und eine einzelne repräsentative Datenzeile definieren. Diese Datei fungiert als kanonischer Vertrag zwischen dem Quellsystem, d. h. dem Cloud-Speicher und Data 360. Fehlausrichtungen – in Feldnamen, Datentypen oder Codierungen – können zu Aufnahmefehlern oder stillen Datenbeschädigungen führen. Das Verwalten dieser Schemadatei in der Versionskontrolle und das Erzwingen der Validierung über CI/CD- oder Data Governance-Workflows wird zu einer bewährten Vorgehensweise für Produktionsumgebungen.

Konventionen für strenge Benennungen: Data 360 erzwingt strenge Objekt- und Feldbenennungsregeln, um die Konsistenz im Metadatendiagramm aufrechtzuerhalten.

- Objektnamen müssen mit einem Buchstaben beginnen und dürfen nur Buchstaben, Ziffern oder Unterstriche enthalten.

- Feldnamen müssen denselben Mustern folgen. Dateien, die gegen diese Konventionen verstoßen, beispielsweise Felder mit Leerzeichen, Sonderzeichen oder nicht unterstützten Symbolen, schlagen bei der Schemavalidierung während der Aufnahme fehl. Unternehmen müssen Datenhygieneprozesse vor der Aufnahme implementieren, um eingehende Dateistrukturen zu bereinigen und zu normalisieren.

Authentifizierung und Sicherheitsstatus: Jede Verbindung mit externem Speicher muss den Sicherheits- und Compliance-Standards auf Unternehmensebene entsprechen.

- Die Authentifizierung wird in der Regel über AWS Access/Secret Keys oder die Authentifizierung mit Verbundidentitätsanbieter (IdP) abgewickelt.

- IAM-Rollen müssen begrenzt sein, um die geringsten Berechtigungen zu erzwingen und nur Lesezugriff auf die angegebenen Speicherpfade zuzulassen.

- Für den sicheren Zugriff müssen ausgehende IP-Adressen direkt zur Zulassungsliste des Quellsystems hinzugefügt werden. Diese mehrschichtigen Steuerelemente stellen sicher, dass jede Dateiübertragung in einem überprüfbaren Null-Trust-Bereich ausgeführt wird, wodurch die Unternehmenskonformität mit der für die Aufnahme in großem Umfang erforderlichen Flexibilität abgewogen wird.

Lösung

Diese Tabelle enthält Lösungen für dieses Integrationsproblem.

| Lösung | Fit | Kommentare |

|---|---|---|

| Verwenden von nativen Cloud-Speicher-Konnektoren (Amazon S3, Google Cloud Storage, Azure Blob Storage) | Best | Dies ist das empfohlene und zuverlässigste Muster für die umfangreiche, wiederkehrende dateibasierte Aufnahme in Data 360\. Native Konnektoren bieten verwaltete Authentifizierung, Schemazuordnung und sichere Datenverschiebung direkt in Data Lake Objects (DLOs) von Data 360. Ideal für geplante Batch-Ladungen, bei denen die Latenz nicht kritisch ist (z. B. stündliche oder tägliche Planung). |

| Umgang mit großen Datensets (über Konnektorobergrenzen hinaus) | Am besten mit Vorverarbeitung | Jeder Konnektor erzwingt Aufnahmeobergrenzen (z. B. S3: 100 Millionen Zeilen oder 50 GB pro Objekt). Implementieren Sie bei größeren Datensets einen ETL-Vorverarbeitungsschritt, um Daten in kleinere Dateien/Ordner zu partitionieren, die unter diese Schwellenwerte fallen. Konfigurieren Sie dann mehrere Datenströme, um jede Partition parallel aufzunehmen, und verwenden Sie den Knoten append in einer Batch-Datentransformation) in Data 360, um die Partitionen erneut zu einem vereinheitlichten Datenset zu kombinieren. |

| Sicherheit und Governance | Best | Alle Konnektoren unterstützen die sichere Authentifizierung über Cloud-native Methoden (IAM-Rollen, Serviceaccounts oder Zugriffsschlüssel). Schränken Sie den Zugriff auf Data 360-IP-Bereiche über die Zulassungsliste des Cloud-Anbieters ein, um mehr Kontrolle zu erhalten. Die Datenübertragung erfolgt über verschlüsselte Kanäle, wobei die Dateien während der Aufnahme in einer temporären sicheren Staging-Ebene gespeichert werden. |

| Wann nicht verwenden | Suboptimal | Dieses Muster ist nicht optimal für:

|

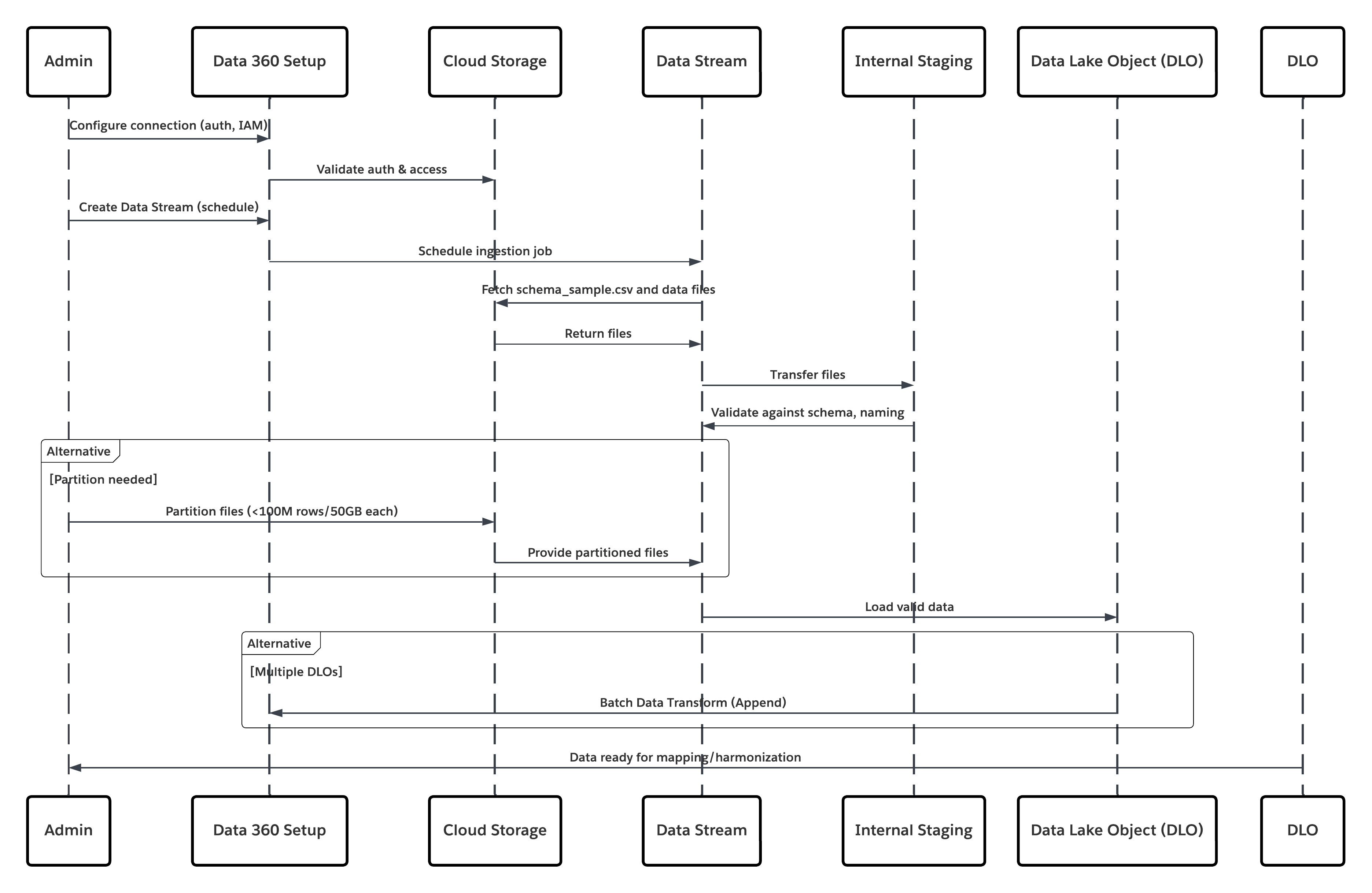

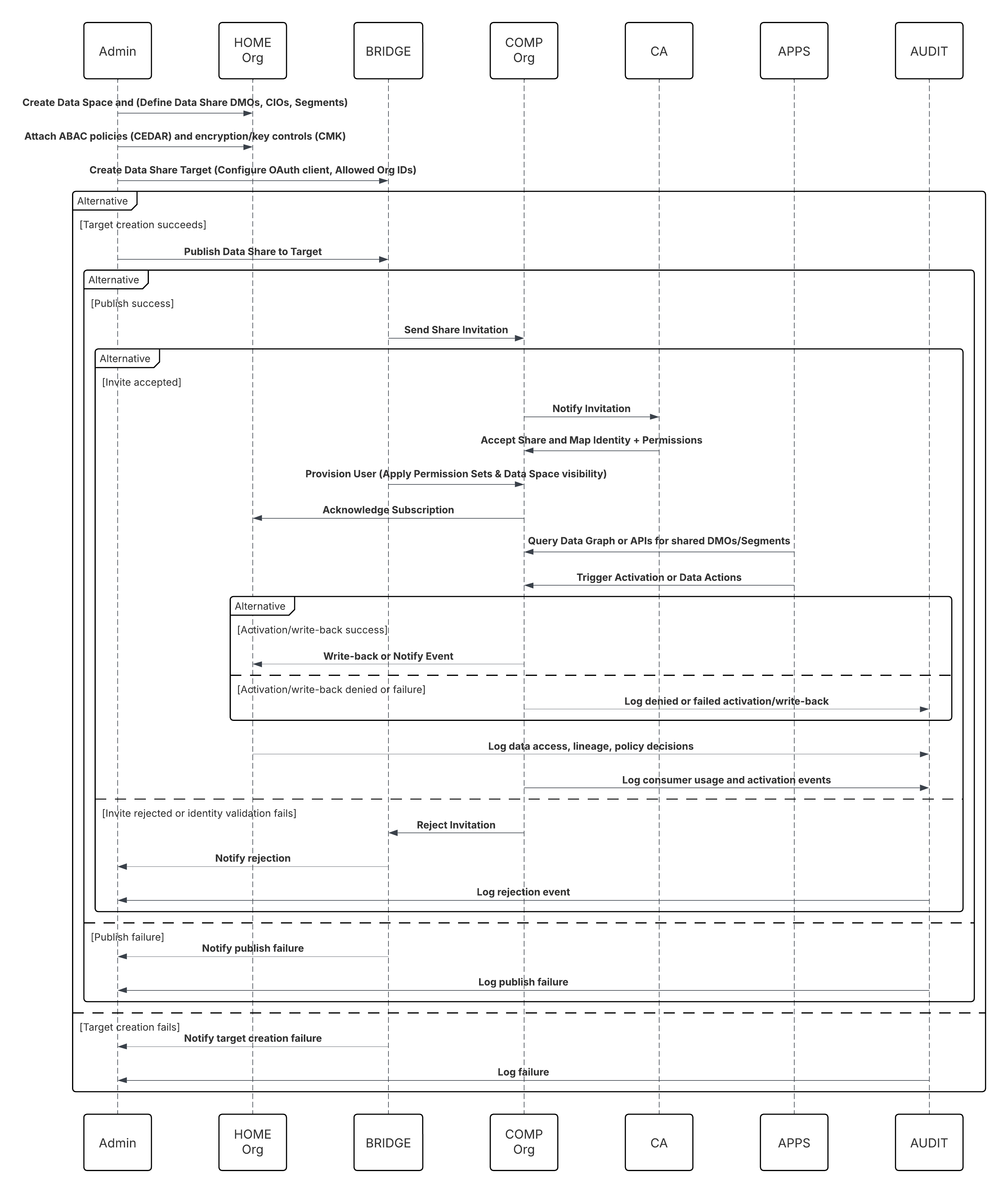

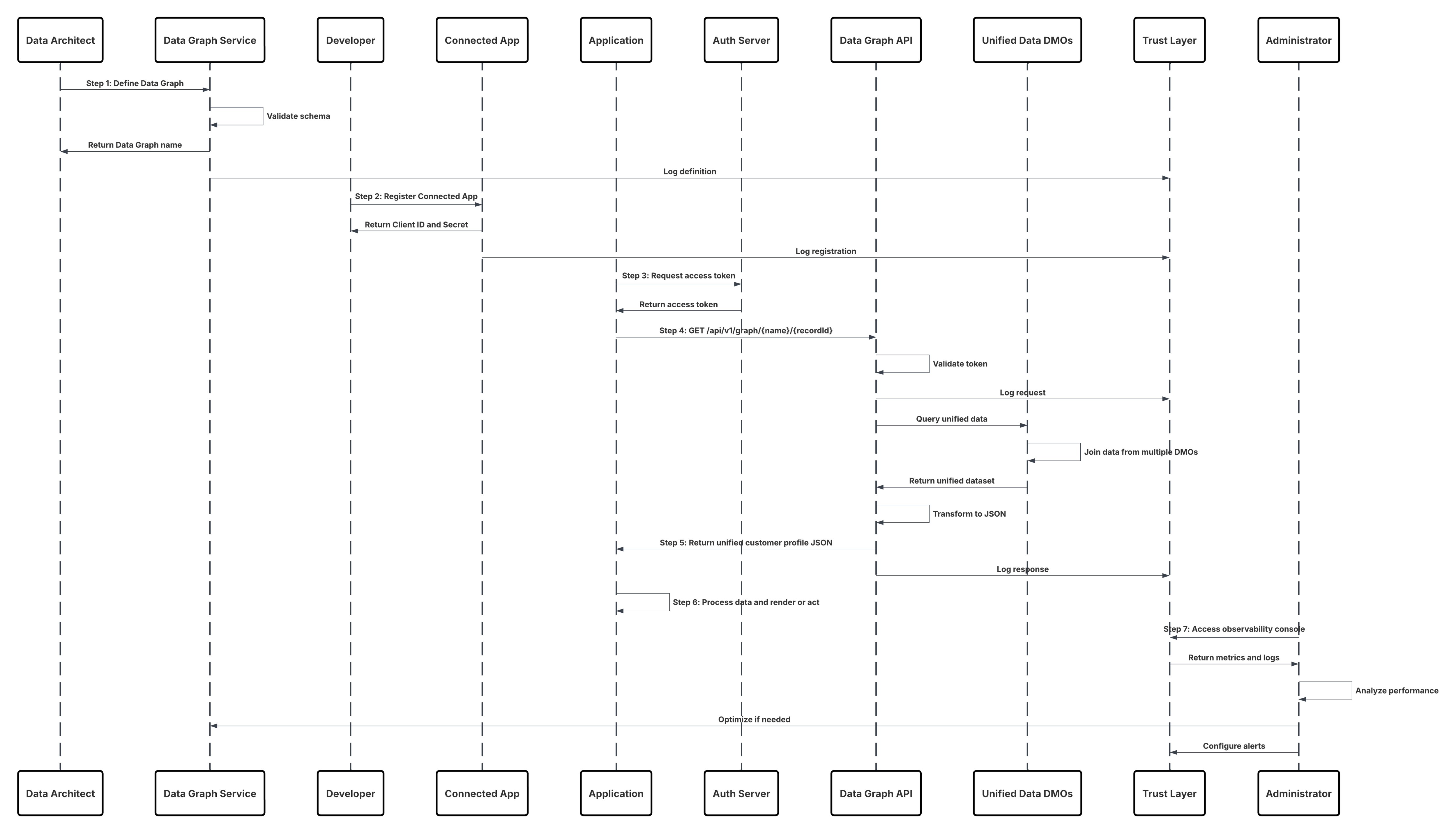

Skizze

In diesem Diagramm wird die Abfolge der Schritte zum Aufnehmen der Daten aus dem Cloud-Speicher in Data 360 veranschaulicht.

In diesem Szenario:

- Der Administrator konfiguriert eine Verbindung mit dem Cloud-Speicher über die Setup-Schnittstelle für Data 360 (mit Angabe der Authentifizierung, der Bucket-Details, der IAM-Rollen und der Positivliste).

- Die Data Cloud-Setup-Schnittstelle authentifiziert sich bei der Cloud-Speicherplattform und überprüft Anmeldeinformationen und Zugriff.

- Der Administrator erstellt einen Datenstrom in Data 360, verknüpft den Datenstrom mit dem Objekt/Ordner im Cloud-Speicher und definiert den Aufnahmeplan.

- Beim Planauslöser fordert der Datenstrom Quelldateien (z. B. CSV, Parquet) von der Cloud Storage Platform an.

- Die Cloud Storage Platform stellt Dateien bereit, einschließlich der erforderlichen gültigen Datei schema_sample.csv und anderer Datendateien, die mit Benennungskonventionen konform sind.

- Der Datenstrom überträgt Dateien an die interne Staging-Umgebung in Data 360.

- Data 360 Pipeline verarbeitet die Dateien: Verwendet die Schemadefinition aus schema_sample.csv Validiert Struktur, Feldnamen und dividiert die Last, wenn sie über den Aufnahmeschwellenwerten (100 Millionen Zeilen/50 GB pro Datei) liegt. Wenn große Dateien erkannt werden, wird ein Partitionierungsschritt vor der Verarbeitung (dem Administrator für die nächste Ausführung mitgeteilt) extern ausgeführt.

- Datensätze werden aus der Staging-Instanz in ein Data-Lake-Objekt (DLO) importiert.

- Verwenden Sie bei Bedarf den Knoten append in einer Batch-Datentransformation, um mehrere DLOs zu kombinieren.

- Data 360 protokolliert Erfolg/Fehler, aktualisiert den Status für die Überwachung und signalisiert, dass Daten für die Zuordnung, Harmonisierung und Vereinheitlichung bereit sind.

Ergebnisse

Die Anwendung dieses Musters ermöglicht die sichere, geplante und umfangreiche Aufnahme strukturierter oder unstrukturierter Dateien aus Enterprise Cloud-Speicherplattformen in Data 360. Der Prozess ist automatisiert, skalierbar und widerstandsfähig. Er stellt Rohdaten in Data-Lake-Objekten (DLOs) bereit, die als Grundlage für die Harmonisierung und Zuordnung zum Customer 360-Datenmodell dienen.

Aufnahmemechanismen

Der Aufnahmemechanismus hängt vom Konnektor und der in Data 360 definierten Planungsstrategie ab.

| Aufnahmemechanismus | Beschreibung |

|---|---|

| Native Cloud Storage Connector (Amazon S3, GCS, Azure) | Empfohlen für die direkte Aufnahme von Dateien im CSV- oder Parquet-Format aus dem Cloud-Data-Lake des Unternehmens. Diese Konnektoren unterstützen inkrementelle und vollständige Aktualisierungspläne. Beispielsweise kann eine Bank eine tägliche Synchronisierung von Kundentransaktionsdateien aus einem S3-Bucket in ein DLO konfigurieren. |

| Partitionierte Dateistrategie | Bei sehr großen Datensets (über 100 Millionen Zeilen oder 50 GB pro Objekt) werden die Daten in kleinere logische Sätze partitioniert (z. B. nach Monat oder Region). Jede Partition wird als separater Datenstrom verwaltet und später mithilfe einer Batch-Datentransformation mit einem Knoten vom Typ "Anhängen" neu kombiniert. |

| Automatisierte geplante Synchronisierung | Data 360 bietet eine deklarative Planung (Stunden-, Tages- oder benutzerdefinierter Rhythmus), die Aufnahmeaufträge automatisch auslöst und so die Aktualisierung der Daten ohne manuelle Eingriffe sicherstellt. |

Fehlerbehandlung und -behebung

Die Fehlerbehandlung und -behebung sind wichtig, um die Zuverlässigkeit bei der Aufnahme von Daten mit hohem Volumen zu gewährleisten.

- Fehlererkennung: Bei jeder Ausführung des Datenstroms werden Aufnahmefehler (z. B. Schemaabweichungen, Dateibeschädigungen oder Namensverstöße) in der Data 360-Überwachung protokolliert. Administratoren können fehlgeschlagene Batches überprüfen und erneut verarbeiten.

- Wiederherstellungsmechanismus: Data 360 führt die Überprüfung durch, um sicherzustellen, dass fehlgeschlagene Batches vorherige Aufnahmen nicht beschädigen. Wiederholungen können konfiguriert werden, nachdem Quellprobleme (z. B. falsch formatierte CSVs) behoben wurden.

- Schemavalidierung: Die Datei schema_sample.csv definiert Datentypen und Struktur. Alle Änderungen lösen eine Validierung aus, um eine stille Schemaabweichung zwischen Ausführungen zu vermeiden.

Überlegungen zum idempotenten Design

Die Aufnahme ist idempotent. Die erneute Verarbeitung derselben Datei führt nicht zu doppelten Datensätzen. Zu den wichtigsten Strategien zählen:

- Datei-Fingerabdruck: Data 360 berechnet Prüfsummen, um zuvor verarbeitete Dateien zu identifizieren und zu überspringen.

- Transaktionsaufnahme: Die Daten werden in eine Phase aufgenommen und erst nach erfolgreicher Verarbeitung aller Datensätze in das DLO übernommen.

- Anhängen vs. Ersetzen: Abhängig von der Geschäftslogik können Streams an das Ziel-DLO angehängt werden oder es vollständig ersetzen. Dadurch werden deterministische Ergebnisse sichergestellt und teilweise Datenüberschneidungen vermieden.

Sicherheitsüberlegungen

Sicherheit ist in der gesamten Aufnahme-Pipeline von entscheidender Bedeutung, von der Authentifizierung über die Verschlüsselung bis hin zur Zugriffskontrolle.

- Authentifizierung und Autorisierung: Konnektoren verwenden das sichere Integrations-Framework von Salesforce und nutzen Anmeldeinformationen mit Namen und externe Anmeldeinformationen für die Authentifizierung, ohne Geheimnisse preiszugeben.

- Verschlüsselung: Die Daten werden während der Übertragung (TLS 1.2+) und im Leerlauf (AES-256) verschlüsselt.

- Netzwerksteuerungen: Quellspeichersysteme (z. B. S3-Buckets) müssen Data 360-IPs auf die Zulassungsliste setzen.

- Compliance-Ausrichtung: Unterstützt Enterprise-Datenschutz-Frameworks wie die DSGVO, HIPAA und FFIEC-Richtlinien in Kombination mit Customer-Managed Keys (CMK).

- Überprüfbarkeit: Jeder Aufnahmeauftrag und jeder Zugriff auf Anmeldeinformationen wird für die Rückverfolgbarkeit und Compliance-Berichte protokolliert.

Randleisten

Aktualität

Die Aktualität hängt vom Aufnahmeplan und dem Datenvolumen ab.

- Für große Unternehmens-Datensets (100 Millionen Zeilen) muss möglicherweise eine Partitionierung vorgenommen werden, damit sie parallel aufgenommen werden können.

- Die typische Aufnahmelatenz liegt je nach Dateigröße und Transformationskomplexität zwischen Minuten und einigen Stunden.

- Bei der Aufnahme nahezu in Echtzeit können Data 360 Streaming- oder API-basierte Konnektoren das dateibasierte Modell ergänzen.

Datenvolumen

- Bestens geeignet für die regelmäßige Aufnahme von Batches mit hohem Volumen.

- Jedes über den S3-Konnektor verarbeitete Objekt unterstützt bis zu 100 Millionen Zeilen oder 50 GB pro Datei.

- Verwenden Sie für Systeme auf Petabyte-Skala die Datenpartitionierung und die Orchestrierung mehrerer Streams.

Unterstützung von Endpunktfunktionen und Standards

Die Funktionen und die Standardunterstützung für den Endpunkt hängen von der von Ihnen ausgewählten Lösung ab.

| Konnektortyp | Endpunktanforderungen |

|---|---|

| Amazon S3 Connector | S3-Bucket mit entsprechender IAM-Richtlinie und schema\_sample.csv-Datei, die das Schema definiert. |

| Google Cloud Storage Connector | Serviceaccount-Anmeldeinformationen und Bucket-Zugriff mit einheitlichen Benennungskonventionen. |

| Azurblauer Speicher-Konnektor | Greifen Sie auf die Schlüssel- oder SAS-Token-basierte Authentifizierung zu. Blob- oder Ordnerstrukturen müssen den Data 360-Konventionen entsprechen. |

Bundesstaatsverwaltung

Der Status wird über Datenströme und ihren letzten erfolgreichen Ausführungszeitstempel verfolgt.

- Data 360 behält automatisch Synchronisierungsstatus und Verschiebungen bei, wodurch sichergestellt wird, dass nur neue oder geänderte Dateien bei nachfolgenden Ausführungen verarbeitet werden.

- Bei der Integration mit externen ETL-Tools werden eindeutige Dateikennzeichner (z. B. UUIDs oder Zeitstempel) empfohlen, um Duplikate zu vermeiden.

Komplexe Integrationsszenarien

In erweiterten Unternehmensarchitekturen kann dieses Muster integriert werden in:

- ETL-Pipelines für Middleware (z. B. Informatica, MuleSoft): Orchestrieren der Vorverarbeitung, Validierung und Dateipartitionierung vor der Übergabe an Data 360.

- AI/ML-Workflows: Verarbeitete DLO-Daten können über das DMO veröffentlicht werden, um Trainingsumgebungen oder RAG-Indizes über Data 360-Aktivierungsziele zu modellieren.

- Transaktionale Systeme: Harmonisierte DMOs können über Datenaktionen oder Plattformereignisse nachgelagerte Aktualisierungen in Salesforce CRM oder externen Systemen auslösen.

Beispiel

Ein globales Finanzinstitut speichert Kunden- und Transaktionsdaten in einem AWS S3-Data-Lake, in dem partitionierte Parquet-Dateien nachts nach Region (z. B. USA, EU und APAC) generiert werden. Das Datenarchitekturteam konfiguriert mehrere Datenströme in Data 360, die jeweils mit einem regionalen Ordner verbunden sind, wobei eine freigegebene schema_sample.csv konsistente Kopfzeilen und Datentypen über alle Partitionen hinweg gewährleistet. Nächtliche Aufnahmepläne laden die Daten automatisch in DLOs. Anschließend hängen Batch-Datentransformationen alle regionalen Partitionen an ein vereinheitlichtes Customer_Transactions_DLO an. Dieses harmonisierte Datenset wird dann dem Customer 360-Datenmodell zugeordnet, wodurch nachgelagerte Analysen und AI-Aktivierungen ermöglicht werden. Der Ansatz bietet eine automatisierte und zuverlässige Aufnahme aus dem vorhandenen Data Lake, erzwingt eine starke Authentifizierung und Verschlüsselung in Übereinstimmung mit den IT-Richtlinien des Unternehmens und bietet eine skalierbare, modulare Grundlage, die zukünftige Erweiterungen und Schemaentwicklungen unterstützt.

Context

Ein primärer und wichtiger Anwendungsfall für Data 360 ist die Vereinheitlichung von Kundendaten im gesamten Salesforce-Ökosystem. Dieses Muster deckt nativ Daten aus Salesforce-Kernplattformen ab – Sales Cloud und Service Cloud (zusammen Salesforce CRM) und Marketing Cloud Engagement. Zu den Quellen gehören standardmäßige und benutzerdefinierte CRM-Objekte (z. B. Account, Kontakt, Kundenvorgang, Opportunity) und Marketing Cloud Engagement-Data Extensions, die Engagementereignisse, E-Mail-Sendungen und Verfolgungsdaten enthalten.

Problem

Wie kann eine Organisation standardmäßige und benutzerdefinierte CRM-Objekte und Marketing Cloud Engagement-Data Extensions effizient und zuverlässig in Data 360 aufnehmen, damit die Daten zum Erstellen von vereinheitlichten Kundenprofilen (Identitätsbestimmung, Customer 360) verwendet werden können, während gleichzeitig Leistung, Governance und minimale Unterbrechungen der Quellsysteme gewährleistet sind?

Kräfte

Native Konnektoren vereinfachen die Arbeit, es müssen jedoch mehrere betriebliche und architektonische Kräfte verwaltet werden:

- Umfassende Quellberechtigungen: Ein spezieller verbindender Benutzer (Integrationsaccount) muss über die entsprechenden Leseberechtigungen auf Objekt- und Feldebene verfügen. Die Nichtzuweisung der erforderlichen Berechtigungssätze (beispielsweise eines vorgefertigten Data 360-Konnektors) ist eine häufige Ursache für Aufnahmefehler.

- Datenaktualisierungsmodi und -kosten: Konnektoren unterstützen den vollständigen und den Delta-/inkrementellen Aktualisierungsmodus. Vollständige Aktualisierungen sind leistungs- und gutschriftsintensiver. Delta-Extraktionen reduzieren die Auslastung, sind jedoch auf eine zuverlässige Änderungsverfolgung im Quellsystem angewiesen.

- Benutzerdefiniertes Schema und Feldzuordnung: CRM-Instanzen enthalten oft benutzerdefinierte Objekte/Felder. Eine genaue Schemazuordnung und Verarbeitung benutzerdefinierter Felder (Namen, Typen) ist erforderlich, um Zuordnungsfehler oder semantische Abweichungen zu vermeiden.

- Starter-Datenpakete vs. Benutzerdefinierte Zuordnung: Starter-Datenpakete beschleunigen die Einarbeitung, indem typische Objekte/Felder vorab ausgewählt werden. Stark angepasste Organisationen benötigen jedoch maßgeschneiderte Stream-Definitionen.

- Obergrenzen für Durchsatz und API: API-Obergrenzen für Quellorganisationen und Marketing Cloud-Extraktionsraten schränken ein, wie aggressiv Sie Aktualisierungen planen können.

- Datenhygiene- und Benennungskonventionen: Quellfeldnamen, Nullverhalten und Datentypen müssen vor der Aufnahme normalisiert werden, um nachgelagerte Zuordnungsprobleme zu vermeiden.

- Sicherheit und geringste Berechtigung: Der Konnektor basiert auf der sicheren Authentifizierung und muss IAM-Muster mit den geringsten Berechtigungen, Überprüfbarkeit und Netzwerksteuerungen berücksichtigen.

Lösung

Diese Tabelle enthält Lösungen für dieses Integrationsproblem.

| Lösungsbereich | Fit | Kommentare / Implementierungsdetails |

|---|---|---|

| Lösungsanpassung | Best | Verwenden Sie den nativen Salesforce CRM-Konnektor und den Marketing Cloud Engagement-Konnektor in Data 360\. Beginnen Sie mit Starter-Datenpaketen für Standardanwendungsfälle und beschleunigen Sie die Einarbeitung. Verwenden Sie die manuelle Stream-Anpassung für maßgeschneiderte oder domänenspezifische Datenmodelle. |

| Umgang mit hochgradig angepassten CRM-Instanzen | Am besten mit Zuordnungsworkshop | Behandeln Sie Starter-Pakete als Grundlage und führen Sie einen Zuordnungsworkshop durch, um Folgendes zu ermitteln: Benutzerdefinierte Objekte und Beziehungen. Formel- oder berechnete Felder. Erweiterungen für verwaltete Pakete. Berechnen Sie bei schweren Formelfeldern Werte in einem vorgelagerten ETL oder in Data 360-Transformationen, um die API-Last in Quellorganisationen zu minimieren. |

| Wann nicht verwenden | Suboptimale Szenarien | Vermeiden Sie dieses Muster in folgenden Fällen: Sie benötigen die Aufnahme von Ereignissen mit hoher Häufigkeit oder in Echtzeit (verwenden Sie stattdessen Streaming-Konnektoren, Plattformereignisse oder Zero-Copy-Verbund). Die API-Kapazität der Quellorganisation ist begrenzt und geplante Extraktionen können nicht ohne Drosselung oder Warteschlangenverzögerungen unterstützt werden. |

| Sicherheit und Governance | Obligatorische Steuerelemente | Grundsatz der geringsten Berechtigung: Verwenden Sie einen dedizierten Integrationsbenutzer mit minimalem Lesezugriff. Verwenden Sie niemals organisationsweite Administratoren. Authentifizierung: Verwenden Sie OAuth 2.0 und verbundene Anwendungen, rotieren Sie Client-Geheimnisse regelmäßig und überwachen Sie die Verwendung von Aktualisierungstoken. Überprüfung und Rückverfolgbarkeit: Protokollieren Sie alle Aufnahmeausführungen, Schemaänderungen und Konnektorereignisse. Leiten Sie Protokolle zur Überprüfungsbereitschaft an SIEM- oder Compliance-Systeme weiter. Datenklassifizierung: Wenden Sie das PII/PHI-Tagging und die attributbasierte Zugriffssteuerung (ABAC) mit CEDAR-Richtlinien unmittelbar nach der Aufnahme an, um Maskierung, Einwilligung und Einhaltung nachgelagerter Vorschriften zu erzwingen. |

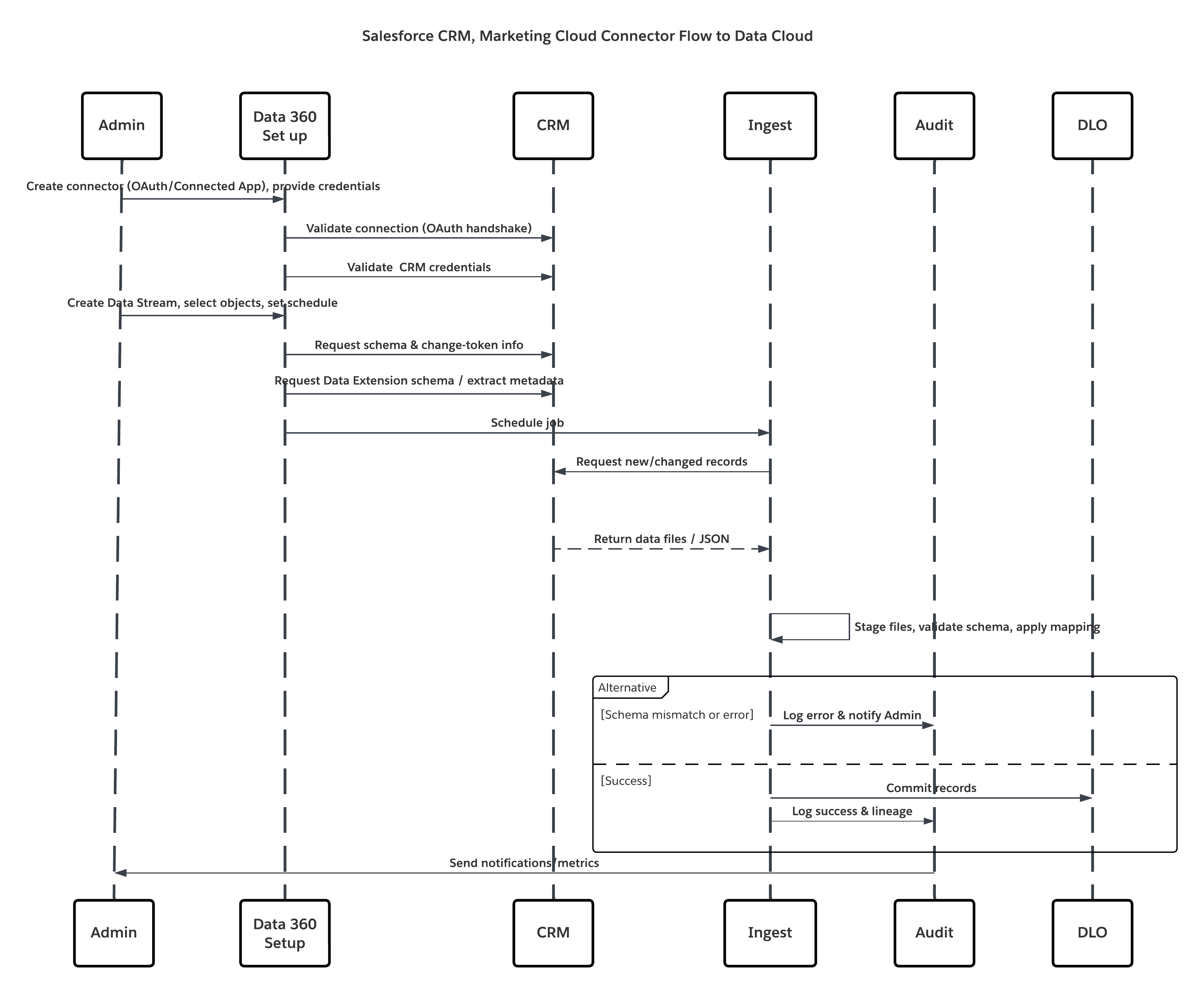

Skizze

In diesem Diagramm wird die Abfolge der Schritte zum Aufnehmen der Daten aus dem Cloud-Speicher in Data 360 veranschaulicht.

In diesem Szenario:

- Der Administrator stellt Integrationsbenutzer bereit und weist Konnektorberechtigungssätze in Quellorganisationen zu.

- Der Administrator konfiguriert Konnektoren im Setup von Data 360 (stellt über OAuth/verbundene Anwendung eine Verbindung mit Salesforce CRM und Marketing Cloud her).

- Der Administrator erstellt Datenströme, wählt Objekte und Data Extensions aus, wählt die vollständige Aktualisierung oder Delta-Aktualisierung aus und legt Zeitpläne fest.

- Bei geplanter Ausführung fordert Data 360 Schema- und Delta-Token von der/den Quelle(n) an.

- Quellsysteme geben Datensätze zurück (Delta oder vollständige Nutzlast). Marketing Cloud kann Auszüge bereitstellen. CRM kann JSON-/Abfrageergebnisse zurückgeben.

- Data 360 stellt Dateien im internen sicheren Staging-Bereich bereit und validiert sie anhand des zugeordneten Schemas.

- Wenn die Validierung fehlschlägt, wird ein Fehler bei der Aufnahme protokolliert, der Administrator wird benachrichtigt und der Commit wird angehalten. Wenn die Validierung erfolgreich ist, überträgt Data 360 Datensätze atomar an das Ziel-DLO.

- Die Überwachungs- und Prüfungsprotokolle werden mit Abstammung, Ausführungsdauer, Zeilenzahl und Anmeldeinformationen aktualisiert. Benachrichtigungen für Administratoren, wenn Schwellenwerte oder Fehler ausgelöst wurden.

Ergebnisse

Daten zu Kundenbeziehungen und Marketinginteraktionen werden als Data-Lake-Objekte (DLOs) in Data 360 aufgenommen. Daraus ergibt sich:

- Zusammengeführtes Datenset mit Profilen, Kundenvorgängen, Opportunities und Kennzahlen für E-Mail/Engagement.

- Grundlage für die Identitätsbestimmung und Erstellung von Profilen für zusammengeführte Einzelpersonen.

- Betriebsbereitschaft für die nachgelagerte Harmonisierung, Anreicherung, AI-Modellierung und Aktivierung unter Beibehaltung der Governance und Überprüfbarkeit.

Aufnahmemechanismen

Der Aufnahmemechanismus hängt vom Konnektor und der in Data 360 definierten Planungsstrategie ab.

| Mechanismus | Wann zu verwenden |

|---|---|

| Salesforce CRM-Konnektor (nativ) | Ideal für standardmäßige/benutzerdefinierte CRM-Objekte; unterstützt vollständige und Delta-Aktualisierungen. |

| Marketing Cloud Engagement-Konnektor (nativ) | Ideal für Data Extensions, Sends und Tracking-Extraktionen; unterstützt Full/Delta-Modi. |

| Starter-Datenpakete | Beschleunigen Sie die Einarbeitung für allgemeine Sales/Service/Marketing-Objekte. |

| Benutzerdefinierte Streams + Vorverarbeitung | Wird verwendet, wenn komplexe Transformationen oder eine schwere Schemanormalisierung erforderlich ist. |

Fehlerbehandlung und -behebung

Die Fehlerbehandlung und -behebung sind wichtig, um die Zuverlässigkeit bei der Aufnahme von Daten mit hohem Volumen zu gewährleisten.

- Pro Ausführung Protokolle: Jede Ausführung des Datenstroms enthält Details zu Erfolg/Fehler und Fehler auf Zeilenebene.

- Abrufe und Prüfpunkte: Fehlgeschlagene Ausführungen können wiederholt werden, nachdem Quell- oder Schemaprobleme behoben wurden. Data 360 verwendet Staging- und Atom-Commit-Semantik.

- Warnungen: Konfigurieren Sie Benachrichtigungen für Schemaabweichungen, wiederholte Fehler oder Delta-Sequenz-Lücken.

Überlegungen zum idempotenten Design

Die Aufnahme ist vom Design her idempotent. Die erneute Verarbeitung derselben führt nicht zu doppelten Datensätzen. Zu den wichtigsten Strategien zählen:

- Änderungserkennung: Delta-Extrakte basieren auf Quellsystemänderungsindikatoren (LastModifiedDate / Datenerfassung für Systemänderungen). Überprüfen Sie, ob die Quelle zuverlässige Zeitstempel/Kennzeichnungen bereitstellt.

- Duplizierung: Verwenden Sie eindeutige Geschäftsschlüssel (z. B. Contact.ExternalId), um ein Deduplizieren oder Einfügen in DLOs vorzunehmen.

- Transaktions-Commit: Datensätze werden in Phasen unterteilt und erst übernommen, wenn die Batchverarbeitung erfolgreich abgeschlossen wurde.

Sicherheitsüberlegungen

Sicherheit ist in der gesamten Aufnahme-Pipeline von entscheidender Bedeutung, von der Authentifizierung über die Verschlüsselung bis hin zur Zugriffskontrolle.

- Authentifizierung und Autorisierung: Konnektoren verwenden das sichere Integrations-Framework von Salesforce und nutzen Anmeldeinformationen mit Namen und externe Anmeldeinformationen für die Authentifizierung, ohne Geheimnisse preiszugeben.

- Verschlüsselung: Die Daten werden während der Übertragung (TLS 1.2+) und im Leerlauf (AES-256) verschlüsselt.

- Netzwerksteuerungen: Quellspeichersysteme (z. B. S3-Buckets) müssen Data 360-IPs auf die Zulassungsliste setzen.

- Compliance-Ausrichtung: Unterstützt Enterprise-Datenschutz-Frameworks wie die DSGVO, HIPAA und FFIEC-Richtlinien in Kombination mit Customer-Managed Keys (CMK).

- Überprüfbarkeit: Jeder Aufnahmeauftrag und jeder Zugriff auf Anmeldeinformationen wird für die Rückverfolgbarkeit und Compliance-Berichte protokolliert

Randleisten

Aktualität

Die Aktualität hängt vom Aufnahmeplan und dem Datenvolumen ab.

- Der ideale Rhythmus hängt von den Geschäftsanforderungen ab – stündlich für Marketingauslöser nahezu in Echtzeit, nächtliche für große Schlichtungen.

- Die Delta-Modi reduzieren Last und Kosten. Vollständige Aktualisierungen sind schwerer und werden für anfängliche Ladevorgänge oder größere Schemaänderungen verwendet.

Datenvolumen

- CRM-Konnektoren sind für transaktionale Datensets und Datensets mit mittlerem Volumen (Millionen von Datensätzen) optimiert.

- Ziehen Sie bei extrem großen historischen Volumen die Phasen-ETL in Betracht, um sie in Phasen zu partitionieren und zu laden.

Unterstützung von Endpunktfunktionen und Standards

Die Funktionen und die Standardunterstützung für den Endpunkt hängen von der von Ihnen ausgewählten Lösung ab.

| Konnektor | Endpunktanforderungen |

|---|---|

| Salesforce CRM-Konnektor | Die Quellorganisation muss eine verbundene Anwendung, OAuth-Token und einen dedizierten Integrationsbenutzer mit Leseberechtigungen zulassen. |

| Marketing Cloud-Konnektor | Marketing Cloud-API-Anmeldeinformationen oder installiertes Paket; Data Extensions müssen Daten über Extrakte/API bereitstellen. |

Bundesstaatsverwaltung

- Konnektorstatus: Datenströme behalten die letzten erfolgreichen Synchronisierungszeitstempel und Delta-Verschiebungen bei.

- Hauptschlüsselstrategie: Bevorzugen Sie konsistente Geschäftskennzeichner (externe IDs), damit die nachgelagerte Schlichtung und das Aktualisieren und Einfügen deterministisch sind.

Komplexe Integrationsszenarien

In erweiterten Unternehmensarchitekturen kann dieses Muster integriert werden in:

- Hybridtopologien: Kombinieren Sie die CRM-Aufnahme mit Streaming (Plattformereignisse), um Aktualisierungen nahezu in Echtzeit vorzunehmen.

- Middleware-Orchestrierung: Verwenden Sie MuleSoft- oder ETL-Tools, wenn eine komplexe Orchestrierung, Anreicherung oder Transformationsvoraberfassung erforderlich ist.

- Feedbackschleifen für Aktivierungen: Harmonisierte DMOs können nachgelagerte Aktualisierungen an Quellsystemen über Datenaktionen oder Plattform-APIs auslösen (vorsichtig bei SoD-Steuerelementen).

Beispiel

Ein multinationaler Händler konsolidiert Accounts, Kontakte, Kundenvorgänge, Opportunities und Marketing Cloud-Engagementkennzahlen in Data 360, um eine einheitliche Kundenansicht zu erstellen. Das Starter-Datenpaket initialisiert die zentralen Vertriebs- und Serviceobjekte, während das Team das Modell um benutzerdefinierte Felder wie "Loyalty_Membershipc" und "Customer_Tierc" erweitert, um den Treuekontext zu erfassen. CRM-Datenströme werden stündlich im Delta-Modus ausgeführt und Marketing Cloud Engagement wird täglich mithilfe von Delta-Extrakten für Engagementereignisse synchronisiert. Diese Datensets werden über DLOs und die Identitätsbestimmung verarbeitet, was zu einem vereinheitlichten Kundenprofil führt, das CRM- und Engagementsignale kombiniert, um die Personalisierung und nachgelagerte AI-Modelle voranzutreiben.

Diese Muster wurden für Szenarien entwickelt, in denen es auf Millisekunden ankommt – wenn Kundeninteraktionen, Transaktionen oder Signale sofortige Statistiken oder Aktionen auslösen müssen. Sie gehen über die herkömmliche geplante Batch-Aufnahme hinaus, um einen ereignisgesteuerten Datenfluss zu ermöglichen, bei dem Informationen sofort verarbeitet werden. Im Salesforce Data 360-Ökosystem ist "Echtzeit" kein einzelner Modus, sondern ein Kontinuum von Latenzmodellen. An einem Ende liegt die Synchronisierung nahezu in Echtzeit, bei der Aktualisierungen aus Datensatzsystemen (wie CRM oder ERP) innerhalb von Sekunden oder Minuten in Data 360 widergespiegelt werden. Auf der anderen Seite steht die echte Echtzeit-Ereigniserfassung, bei der clientseitige Verhaltenssignale wie Klicks, Käufe oder mobile Interaktionen in Millisekunden aufgenommen und aktiviert werden. Für Architekten ist die Unterscheidung mehr als semantisch. Sie definiert, wie Pipelines konzipiert werden, wie APIs aufgerufen werden und wie nachgelagerte Entscheidungen getroffen werden. Durch die Auswahl des richtigen Musters – ob Synchronisierung nahezu in Echtzeit oder Aufnahme von Ereignis-Streaming – wird sichergestellt, dass das System die Latenzziele des Unternehmens erreicht und gleichzeitig die Datenintegrität, Skalierbarkeit und Governance gewährleistet.

Context

Mit diesem Muster können externe Systeme, beispielsweise eine benutzerdefinierte Anwendung, eine Internet-of-Things (IoT), ein Point-of-Sale (POS)-System oder ein Drittanbieterservice, Ereignisdaten nahezu in Echtzeit programmgesteuert in Data 360 übertragen, wenn diskrete Ereignisse auftreten.

Problem

Wie kann ein Entwickler zuverlässig einzelne Datensätze oder kleine asynchrone Ereignisbatches aus einer externen Anwendung mit geringer Latenz an Data 360 senden, damit die Daten schnell verarbeitet, segmentiert und aktiviert werden können?

Kräfte

Dieses Muster bietet eine geringe Latenz und eine bessere Entwicklersteuerung, führt jedoch zu mehreren technischen Einschränkungen und betrieblichen Abhängigkeiten:

- Entwicklerabhängigkeit: Erfordert Entwickleraufwand, um authentifizierte REST-API-Clients und Fehler-/Wiederholungslogik zu implementieren – es handelt sich nicht um einen Zeigen-und-Klicken-Konnektor.

- Strenges Schema beim Schreiben: Die Aufnahme-API erzwingt die Erstellung von Schemas beim Schreiben. Es muss ein genaues Schema definiert und in die Konnektorkonfiguration hochgeladen werden. Alle Nutzlasten müssen genau übereinstimmen oder abgelehnt werden.

- Doppelte Interaktionsmodi: Derselbe Konnektor unterstützt Streaming (JSON) für Aktualisierungen mit geringer Latenz, Datensatz-für-Datensatz-Aktualisierungen und Massensynchronisierung (CSV) für größere regelmäßige Synchronisierungen. Architekten müssen pro Anwendungsfall auswählen.

- Authentifizierung und Sicherheit: Aufrufe müssen über eine verbundene Salesforce-Anwendung mit OAuth 2.0 authentifiziert werden (z. B. JWT-Bearer-Flow für Server-zu-Server). Die Umfänge "Tokenverwaltung", "Rotation" und "Least-Privileges" sind obligatorisch.

- Operative Sichtbarkeit: Entwickler und Plattformteams müssen die Überwachung auf Antwortcodes, Wiederholungen, Warteschlangen mit totem Brief und Schemaabweichungswarnungen implementieren.

- Anforderung an Echtzeitdiagramme: Für eine echte sofortige Aktivierung (sofortige Segmentierung, Echtzeit-DMO-Zuordnung) muss das Ziel-Datenmodellobjekt (DMO) Teil des Echtzeit-Datendiagramms sein. Andernfalls durchlaufen Ereignisse eine Pipeline mit etwas höherer Latenz.

Lösung

Diese Tabelle enthält Lösungen für dieses Integrationsproblem.

| Lösungsbereich | Fit | Kommentare / Implementierungsdetails |

|---|---|---|

| Lösungsanpassung | Am besten für die Ereigniserfassung mit geringer Latenz | Verwenden Sie die Data 360-Aufnahme-API (Streaming-JSON) zum Pushen einzelner Ereignisse oder Mikro-Batchs. Konfigurieren Sie den Aufnahme-API-Konnektor mit einem strengen OAS 3.0-Schema (.yaml). Verwenden Sie die Massen-CSV-Aufnahme für größere, weniger häufige Synchronisierungen. |

| Verarbeitung von Schemaänderungen | Streng / Verwaltet | Schemaänderungen sind fehlerhaft: Aktualisieren Sie OAS .yaml, versionieren Sie den Konnektor und führen Sie Vertragstests durch. Implementieren Sie die Migration rollierender Schemas, wenn Hersteller nicht gleichzeitig Änderungen vornehmen können. |

| Wann nicht verwenden | Suboptimal | Nicht ideal, wenn eine Vorverarbeitung erforderlich ist (z. B. Deduplizierung, garantierter Auftrag usw.) oder wenn extrem große Massenlasten auftreten (verwenden Sie native Massenkonnektoren oder Batch-ETL). Wenn die Quelle keine schemagültigen Nutzlasten erzeugen oder sich nicht sicher authentifizieren kann, verwenden Sie alternative Aufnahmemethoden. |

| Sicherheit und Unternehmensführung | Pflichtfeld | Verwenden Sie OAuth 2.0 mit den geringsten Berechtigungsbereichen, drehen Sie Schlüssel und protokollieren Sie die Tokennutzung. Erzwingen Sie TLS 1.2+, validieren Sie bei Bedarf Client-IPs und stellen Sie das PII-Tagging für Nutzlasten sicher. Alle Ereignisse müssen Provenienz-Metadaten enthalten (Quelle, Zeitstempel, Schemaversion, Identitätsschlüssel). |

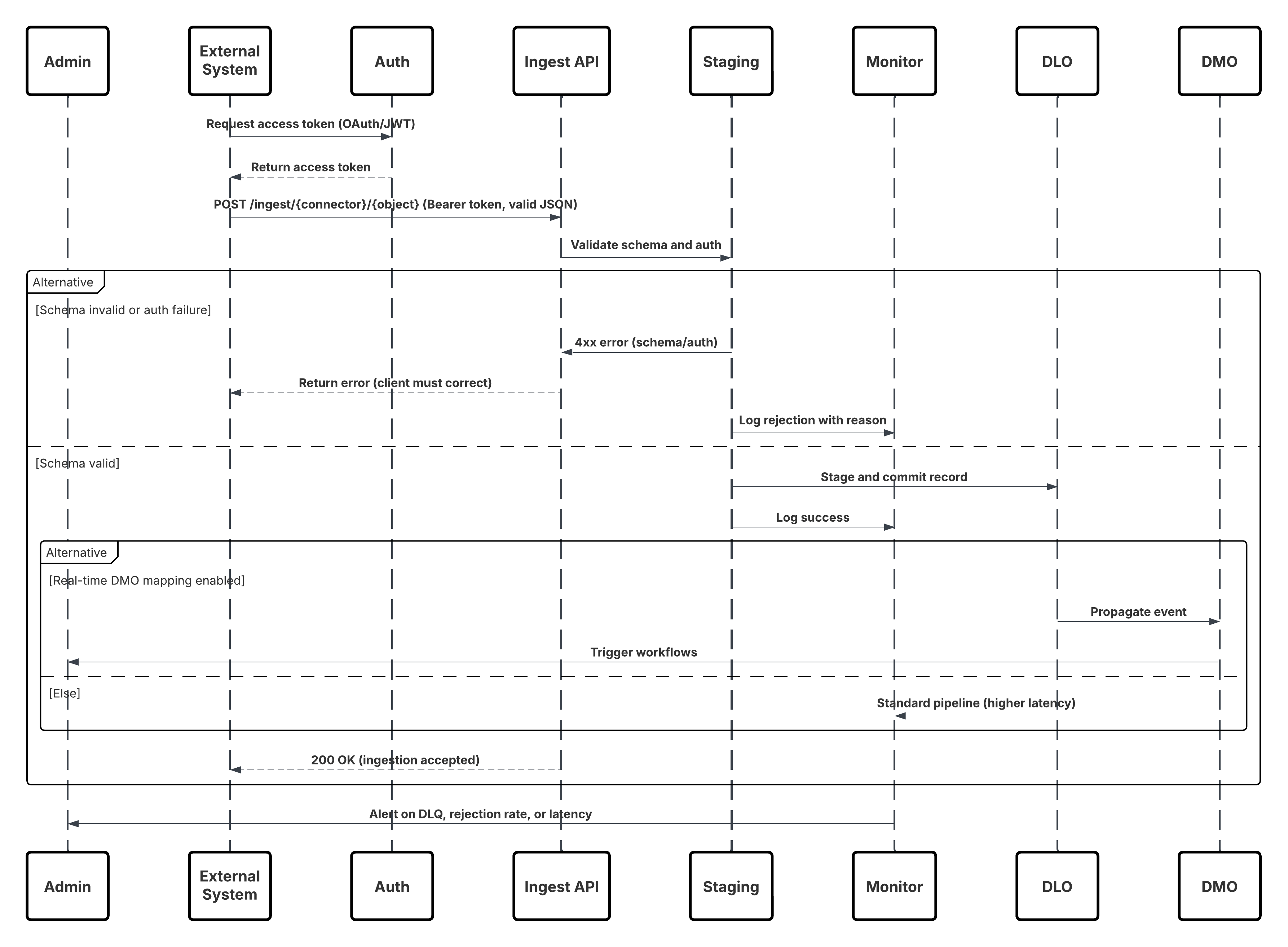

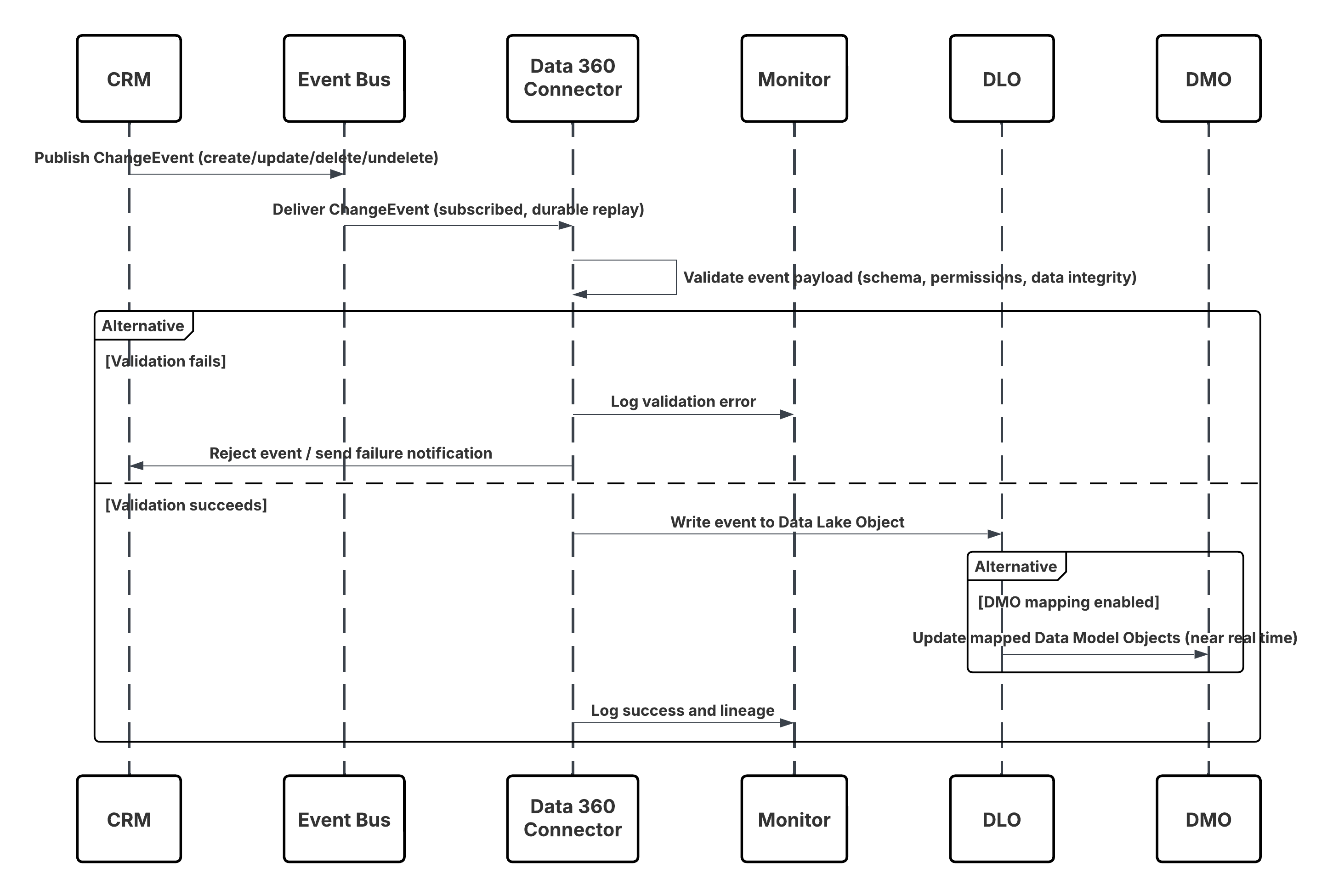

Skizze

In diesem Diagramm wird die Abfolge der Schritte zum Aufnehmen der Daten aus der Aufnahme-API in Data 360 veranschaulicht.

In diesem Szenario:

- Das externe System fordert die Authentifizierung über OAuth/JWT vom Auth Server an.

- Auth Server gibt Zugriffstoken an "Externes System" zurück.

- Das externe System sendet die POST-Anforderung zur Datenaufnahme mit Autorisierung und JSON-Nutzlast an die Data 360-Aufnahme-API.

- Die Aufnahme-API validiert Anforderungsschema und Authentifizierung über das Modul "Staging & Validation".

- Bei Schema-/Authentifizierungsfehlern:

- Fehler, der an "Externes System" zurückgegeben wurde.

- Ablehnung zur Überwachung und Warnung protokolliert.

- Bei erfolgreicher Validierung:

- Datensätze, die in Data Lake Object (DLO) inszeniert und übernommen wurden.

- Erfolgsprotokollierung zur Überwachung.

- Wenn diese Option aktiviert ist, werden die Daten in das Echtzeit-Datendiagramm (DMO) übernommen, wodurch nachgelagerte Workflows ausgelöst werden.

- Andernfalls werden Daten über die standardmäßige Batch-Pipeline oder die Pipeline mit höherer Latenz verarbeitet.

- Die Aufnahme-API bestätigt den Erfolg des externen Systems.

- Überwachungskomponenten benachrichtigen den Administrator bei Warteschlangen mit auslaufenden Briefen, Ablehnungsraten oder Latenzproblemen.

Ergebnisse

Externe Ereignisdaten werden mit geringer Latenz in Data 360-DLOs aufgenommen. Wenn das Ziel-DMO Teil des Echtzeitdiagramms ist, sind die Daten für die sofortige Segmentierung, Agenten-Workflows, AI-Modelle und die operative Aktivierung verfügbar. Dadurch können Sie schnell auf Ereignisse reagieren, die aus einem verbundenen System stammen.

Aufnahmemechanismen

Der Aufnahmemechanismus hängt vom Konnektor und der in Data 360 definierten Planungsstrategie ab.

| Mechanismus | Wann zu verwenden |

|---|---|

| Streaming-JSON (Aufnahme-API) | Einzelne Ereignisse, Micro-Batchs, Verhaltensereignisse, Clickstreams, IoT-Telemetrie – wenn eine geringe Latenz erforderlich ist. |

| Massen-CSV (Aufnahme-API-Massenmodus) | Größere, regelmäßige Uploads mit gelockerten Latenzanforderungen. |

| Edge / Middleware | Wird verwendet, wenn Sie Validierung, Transformation, Anreicherung oder Ratenbegrenzung benötigen, bevor Sie die Aufnahme-API übertragen. |

Fehlerbehandlung und -behebung

- Unmittelbare (Synchronisierungs-)Fehler: 4xx-Antworten für Schema-/Authentifizierungsfehler: Der Client muss die Nutzlast oder das Token beheben und es erneut versuchen.

- Vorübergehende (asynchrone) Fehler: 5xx Antworten: Client-Wiederholungsversuche mit exponentiellem Backoff und Jitter.

- Warteschlange mit Dead-Letter (DLQ): Persistente Fehler werden in DLQ zur manuellen Inspektion und erneuten Wiedergabe angezeigt.

- Monitoring: Verfolgen Sie Schemaablehnungsrate, Authentifizierungsfehler, Latenzperzentile und DLQ-Rückstand. Warnung bei Schwellenwerten.

Überlegungen zum idempotenten Design

- Idempotenzschlüssel: Jedes Ereignis sollte einen eindeutigen Identitätsschlüssel/Nachrichten-ID enthalten.

- Strategie zum Aktualisieren und Einfügen: Verwenden Sie Geschäftsschlüssel (ExternalId), um Duplikate bei Wiederholungen zu vermeiden.

- Dedup Window: Architekt sollte Deduplizierungsfenster und Aufbewahrung für die Identitätsverfolgung definieren.

Sicherheitsüberlegungen

Sicherheit ist in der gesamten Aufnahme-Pipeline von entscheidender Bedeutung, von der Authentifizierung über die Verschlüsselung bis hin zur Zugriffskontrolle.

- Authentifizierung: OAuth 2.0 (JWT-Bearer) wird für Server-zu-Server empfohlen. Beschränken Sie die Umfänge nur auf die Aufnahme.

- Verschlüsselung: TLS 1.2+ für den Transport; Data 360 erzwingt die Verschlüsselung im Leerlauf.

- Niedrigste Berechtigung: Anmeldeinformationen für verbundene Anwendungen verfügen über minimale Rechte. Drehen Sie Geheimnisse und Instrumentenzugriffsprotokolle.

- Nutzlast-Governance: Schließen Sie Einwilligungs-/Verbrauchskennzeichnungen in Ereignismetadaten ein. Wenden Sie ABAC-/CEDAR-Richtlinien unmittelbar nach der Aufnahme an.

- IP-Steuerelemente / Private Connect: Schränken Sie bei Bedarf den Zugriff über Zulassungslisten ein oder verwenden Sie Private Connect für private Netzwerke.

Randleisten

Aktualität

Die Aktualität hängt vom Aufnahmeplan und dem Datenvolumen ab. Die Streaming-JSON ergibt je nach Verarbeitung und Diagrammkonfiguration eine Latenz von einer Sekunde zur anderen. Die Massen-CSV beträgt Minuten bis Stunden. Wählen Sie diese Option anhand von Geschäfts-SLAs aus.

Datenvolumen

Einzelne Ereignisgrößen sollten klein sein (< wenige KB). Bei Herstellern mit hohem Durchsatz sollten Sie ggf. Batches beim Produzenten erstellen oder einen Streaming-Puffer (Kafka/Kinesis) verwenden, bevor Sie die API aufrufen.

Bundesstaatsverwaltung

- Schema Versioning: Verwalten Sie die Schemaversion in Ereignismetadaten und verwenden Sie die Konnektorversionierung beim Aktualisieren des OAS-Vertrags.

- Verschiebungen des Konnektors: Data 360-Handles übernehmen die Semantik. Produzenten sollten die Identitätsschlüssel und die letzte erfolgreiche Sequenz verfolgen, um die Wiedergabe sicher zu gestalten.

Komplexe Integrationsszenarien

In erweiterten Unternehmensarchitekturen kann dieses Muster integriert werden in:

- Kantenvalidierungsebene: Verwenden Sie Middleware, um heterogene Produzentenformate in den erforderlichen OAS-Vertrag zu übersetzen, Ratenbegrenzungen vorzunehmen und Anreicherungen vorauszusetzen.

- Hybridarchitekturen: Kombinieren Sie die Aufnahme-API für Ereignisse und Konnektoren für die Massenabstimmung.

- Agentenaktivierung: In Echtzeit-DMOs zugeordnete Ereignisse können Agentforce-Workflows und Einstein-Modelle für automatisierte Entscheidungen auslösen.

Beispiel

Eine Einzelhandelskette überträgt Point-of-Sale-Kaufereignisse in Data 360 in Echtzeit, um das sofortige Kundenengagement zu fördern. Jeder Shop führt eine kompakte Serverkomponente aus, die Transaktionen erfasst, sie mit Standort- und Gerätemetadaten anreichert und JSON-Ereignisse mithilfe von JWT Bearer OAuth mit Identitätsschlüsseln sicher postet, um Duplikate zu vermeiden. Ein Administrator definiert die Ereignisstruktur, indem er ein OAS-Schema für die Verkaufsstelle hochlädt und den Aufnahme-API-Konnektor konfiguriert. Eingehende Ereignisse werden in das DLO "pos_sale" aufgenommen, dem DMO "Sale" zugeordnet und dem Echtzeitdiagramm hinzugefügt. Dadurch werden Käufe mit hohem Wert sofort erkannt, was VIP-Workflows in Agentforce auslöst und die Kundensegmentierung aktualisiert, um die Echtzeitpersonalisierung zu fördern.

Context

Dieses Muster ermöglicht die Erfassung detaillierter Benutzerinteraktionsdaten mit hohem Volumen, beispielsweise Seitenaufrufen, Schaltflächenklicks, Produktimpressionen und Videowiedergaben, von Websites und mobilen Anwendungen in trueReal-Time. Sie ist die Grundlage für die sofortige Personalisierung, bei der jede digitale Interaktion die Benutzererfahrung dynamisch beeinflussen und das Engagement fördern kann.

Problem

Wie kann ein Unternehmen einen kontinuierlichen Strom von Verhaltensereignissen aus digitalen Eigenschaften erfassen und verarbeiten, der Millionen von Benutzerinteraktionen pro Minute umfasst, und diese Daten sofort in Data 360 zur Verfügung stellen, um die Segmentierung, Personalisierung und Aktivierung in Echtzeit zu unterstützen?

Kräfte

Dieser Anwendungsfall stellt verschiedene Designherausforderungen vor, die eine speziell entwickelte Aufnahmearchitektur mit geringer Latenz erfordern:

- Extremer Durchsatz: Websites mit hohem Datenverkehr oder mobile Anwendungen können Millionen von Ereignissen pro Minute aussenden. Die Aufnahmeebene muss horizontal skaliert werden, um dieses Volumen ohne Ereignisverlust oder Staudruck zu verarbeiten und eine konsistente Latenz unter Spitzenlasten zu gewährleisten.

- Clientseitige Instrumentierung: Im Gegensatz zu servergesteuerten Integrationen hängt dieses Muster von clientseitigen SDKs ab. Auf jeder Seite muss ein JavaScript-Beacon (Salesforce Interactions SDK) eingebettet sein oder ein natives SDK muss in mobile Anwendungen integriert sein. Dies erfordert eine zuverlässige Clientbereitstellung, Versionierung und Ereignisschema-Governance.

- Ereignisverarbeitung mit geringer Latenz: Benutzeraktionen wie "dem Einkaufswagen hinzufügen" oder "Videowiedergabe" müssen Data 360 innerhalb von Sekunden erreichen, um eine Echtzeitaktivierung und kontextbezogene Antworten (z. B. gezielte Angebote, personalisierte Empfehlungen) zu ermöglichen.

- Harmonisierung und Identitätsbestimmung von Daten: Erfasste Ereignisse enthalten oft anonyme Kennzeichner (Cookies, Geräte-IDs, Sitzungstoken). Damit Customer 360-Anwendungsfälle unterstützt werden, müssen diese über die Identitätsbestimmung von Data 360 bekannten Profilen zugeordnet und mit dem Customer 360-Datenmodell harmonisiert werden.

Lösung

Es wird empfohlen, den Salesforce Marketing Cloud Personalization-Konnektor zu verwenden, eine native, vollständig verwaltete Streaming-Pipeline, die für die Aufnahme von Verhaltensweisen mit hohem Durchsatz konzipiert ist.

| Lösungsbereich | Fit | Kommentare / Implementierungsdetails |

|---|---|---|

| SDK-basierte Ereigniserfassung | Best | Stellen Sie das Salesforce-SDK für Interaktionen (web) oder das native SDK (mobil) bereit. Diese kompakten Bibliotheken erfassen und serialisieren Benutzerinteraktionen in Echtzeit und hängen Metadaten (Sitzungs-ID, Zeitstempel, Kontext) an. |

| Streaming-Pipeline für Ereignisse | Best | Ereignisse werden über sicheres HTTPS an den Ereignis-Streaming-Service von Marketing Cloud Personalization gesendet. Diese Ebene ist horizontal skalierbar und für die Übertragung mit geringer Latenz (< 2s) optimiert. |

| Data 360-Integration | Best | Der Personalisierungs-Konnektor von Data 360 abonniert den Streaming-Feed und nimmt jedes Ereignis nahezu in Echtzeit in ein Data-Lake-Objekt (DLO) auf. |

| Datenmodellzuordnung | Bewährte Vorgehensweisen | Das aufgenommene DLO wird Customer 360 Data Model Objects (DMOs) zugeordnet. Dadurch können anonyme und bekannte Benutzer über die Identitätsbestimmung verknüpft werden. |

| Aktivierung von Echtzeitdiagrammen | Optional / Empfohlen | Fügen Sie zugeordnete DMOs in das Echtzeitdiagramm ein, um sie sofort zu segmentieren und so personalisierte Aktionen über Einstein oder Agentforce auszulösen. |

| Wann nicht verwenden | Suboptimal | Dieses Muster ist in folgenden Fällen nicht ideal: Die Quelldaten sind Webclient und Ereignisse (verwenden Sie stattdessen die Aufnahme-API). Der Organisation fehlt die Kontrolle über webbasierte/mobile Clients. Eine Echtzeit-Verhaltensverfolgung ist nicht erforderlich (Batch-Aufnahme verwenden). |

| Verarbeitung der Schemaänderungen | Verwaltete Evolution | Ereignisschemas entwickeln sich, wenn neue Interaktionen hinzugefügt werden. SDKs sollten Ereignisdefinitionen versionieren. Abwärtskompatible Änderungen (Hinzufügen von optionalen Feldern) sind sicher. Änderungen, die fehlerhaft sind, erfordern eine Neukonfiguration des Konnektors und Vertragstests. |

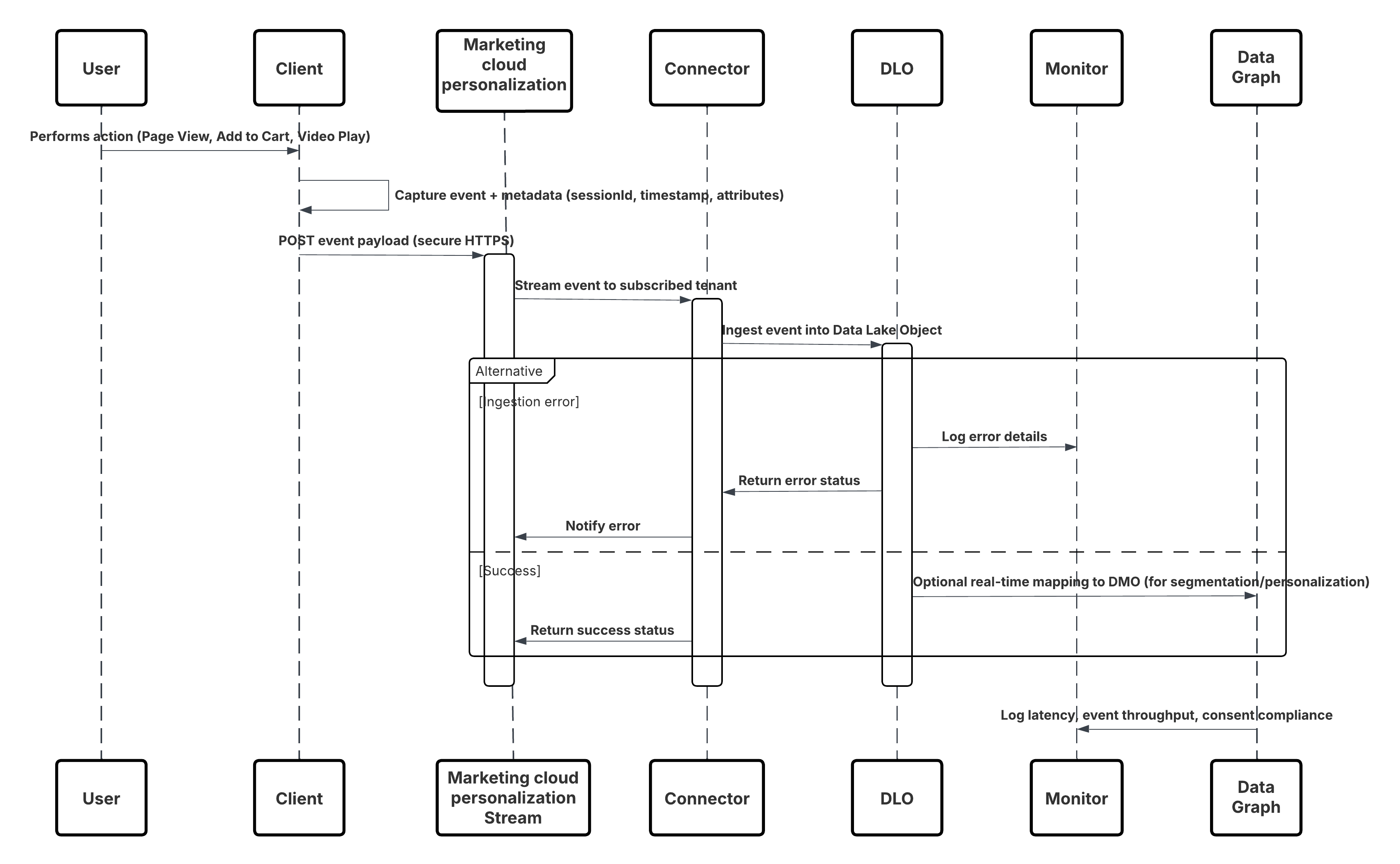

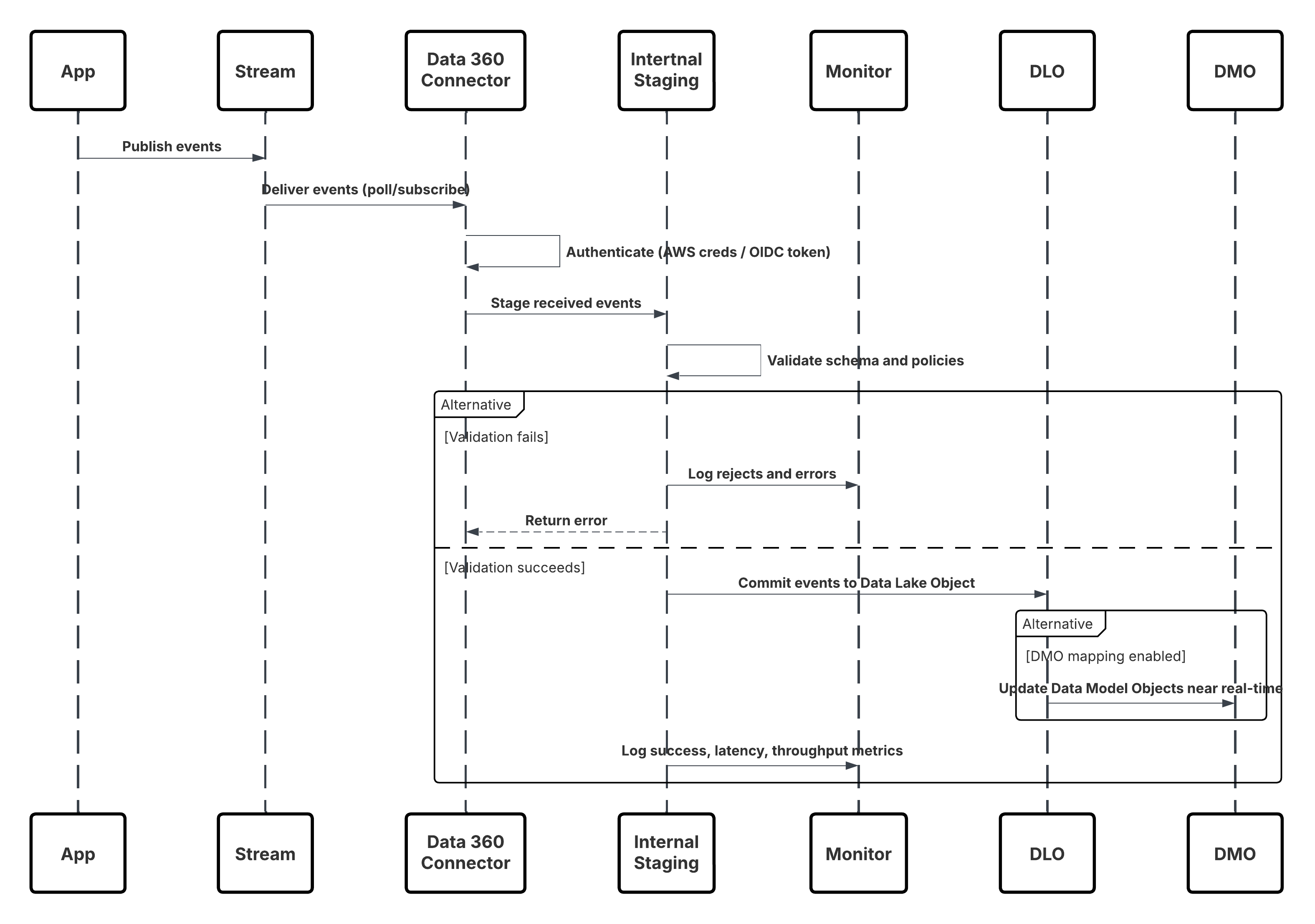

Skizze

In diesem Diagramm wird die Abfolge der Schritte zum Aufnehmen der Daten aus mobilen und Webkanälen in Data 360 veranschaulicht.

In diesem Szenario:

- Stellen Sie das SDK in Web- oder mobilen Kanälen bereit (Benutzerinteraktionserfassung).

- Konfigurieren Sie das SDK mit Steuerelementen für Mandanten-ID, Umgebung und Einwilligung.

- Streamen Sie erfasste JSON-Ereignisse (Metadaten + Attribute) an den Marketing Cloud-Streaming-Endpunkt.

- Erstellen und konfigurieren Sie im Setup von Data 360 den Personalisierungskonnektor für den Mandanten.

- Nehmen Sie Ereignisse in ein DLO auf und ordnen Sie das DLO → DMO in Data 360 zu.

- Aktivieren Sie das DMO im Echtzeitdiagramm für die sofortige Aktivierung.

- Überwachen Sie Latenz, Schemakonformität, Einwilligungskennzeichnungen, Durchsatz und Fehlerraten.

- Stellen Sie die Bereitstellung in der Produktion bereit und überwachen Sie sie kontinuierlich.

Ergebnisse

Ein kontinuierlicher Stream mit Verhaltensereignissen mit geringer Latenz fließt aus digitalen Kanälen in Data 360. Innerhalb von Sekunden ist jede Benutzeraktion für die Echtzeitsegmentierung, die Prognosemodellierung oder die ausgelöste Personalisierung verfügbar, was eine wirklich adaptive Kundenerfahrung ermöglicht.

Aufnahmemechanismen

Der Aufnahmemechanismus hängt vom Konnektor und der in Data 360 definierten Planungsstrategie ab.

| Mechanismus | Wann zu verwenden |

|---|---|

| SDK für Interaktionen (Web) | Echtzeiterfassung über Webbrowser und SPAs. |

| Mobile SDK | Echtzeiterfassung aus nativen mobilen Anwendungen. |

| Personalisierungs-Konnektor | Verwaltetes Abonnement zwischen Marketing Cloud und Data 360\. |

| Echtzeitdiagrammzuordnung | Aktiviert die sofortige Aktivierung in Segmentierung, Einstein und Journeys. |

Fehlerbehandlung und -behebung

- Schichtweise Fehlertoleranz: Implementieren Sie mehrstufige Validierungs- und Wiederholungsmechanismen: Client-SDKs verarbeiten vorübergehende Fehler mit exponentieller Absicherung, während die Aufnahmeebene dauerhafte Warteschlangen und wiedergebbare Pipelines verwendet, um Datenverluste zu verhindern.

- Schema & Data Governance: Versionieren und validieren Sie Ereignisschemas kontinuierlich. Ungültige oder sich entwickelnde Ereignisse werden an eine Schemaablehnungs- oder Dead-Letter-Warteschlange weitergeleitet, um eine sichere Triage und erneute Wiedergabe zu ermöglichen.

- Idempotenz und Duplizierung: Verwenden Sie stabile Ereigniskennzeichner und die Semantik zum Aktualisieren und Einfügen, um eine genaue Verarbeitung auch bei Wiederholungen oder Wiederholungen zu gewährleisten.