In diesem Dokument wird ein Standpunkt dargestellt, der die IT-Architektur beschreibt, die Unternehmen in den nächsten 3-5 Jahren benötigen werden, um den Wert einer Agentenbelegschaft vollständig zu erfassen. Es wird die IT-Transformation beschrieben, die erforderlich ist, um die Bereitstellung von AI-Agenten im großen Umfang zu unterstützen. Das Ziel ist es, einen strategischen Leitfaden und eine Referenzarchitektur bereitzustellen, die CIOs, CDOs und IT-Führungskräften bei der Planung ihres Wegs zum Agentenunternehmen helfen.

Leistungsfähige AI-Modelle ermöglichen die Schaffung einer Agentenbelegschaft, die in der Lage ist, die Umgebung zu erfassen, über Daten nachzudenken, autonome Entscheidungen zu treffen, Aufgaben auszuführen und effektiv mit menschlichen Mitarbeitern zusammenzuarbeiten. Diese neue Belegschaft verspricht einen entscheidenden Wandel in puncto Innovation, Produktivität und Agilität und schafft so Mehrwert für Aktionäre und Kunden. Um diese Vision zu verwirklichen, müssen Organisationen eine Geschäfts- und IT-Transformation durchlaufen, um zu Agentenunternehmen zu werden.

Heute sieht sich das traditionelle Unternehmen mit betrieblichen Ineffizienzen konfrontiert, die sich aus Informationssilos, Mitarbeitern, die in manueller Arbeit begraben sind, falsch ausgerichteten Anreizen in Organisationsstrukturen und uneinheitlichen Feedbackschleifen zwischen Strategien und Ergebnissen ergeben. Diese Probleme führen zu suboptimalen Kundenerfahrungen, ineffizienten Prozessen und verpassten Wachstumschancen.

Das Agentic Enterprise überwindet diese Einschränkungen, indem es eine digitale Belegschaft intelligenter AI-Agenten in menschliche Mitarbeiter integriert. Mit dieser neuen AI-gestützten Belegschaft kann eine Organisation Innovationen für Wachstum fördern, operative Spitzenleistungen steigern und die Widerstandsfähigkeit von Unternehmen mit verschiedenen Arten neuer Geschäftsfunktionen aufbauen.

Neue Geschäftsmöglichkeiten zur Innovationsförderung:

- Erhöhte menschliche Produktivität: Die Schnelligkeit, Skalierbarkeit und die ständige Verfügbarkeit von AI-Agenten ermöglichen es Unternehmen, sich wiederholende Arbeiten zu automatisieren, und ermöglichen es menschlichen Mitarbeitern, sich auf hochwertigere und kreativere Aufgaben zu konzentrieren.

- Verbesserung der Anpassungsfähigkeit: Da die Argumentation von AI-Agenten beobachtet werden kann, können sie dynamisch lernen und neue Fertigkeiten bereitstellen, wodurch das Unternehmen die Leistung kontinuierlich verbessern kann, um Geschäftsziele zu erreichen und sich schnell an neue Marktchancen anzupassen.

Beispiel in Aktion – Innovation der Kundenerfahrung in Finanzdienstleistungen: Eine Vermögensverwaltungsfirma kann einen AI-Agenten verwenden, um ihr Kundenengagementmodell neu zu erfinden. Der Agent überwacht Portfolios autonom, identifiziert wichtige Momente für eine Kundenüberprüfung und bereitet den Plan vor dem Anruf für den Berater vor, wobei er den Plan anpasst, sobald Nachrichten veröffentlicht werden. Dadurch kann der menschliche Berater eine proaktive, personalisierte Kundenerfahrung im richtigen Maßstab bereitstellen, Beziehungen stärken und neue Opportunities aufdecken.

Neue Geschäftsfunktionen zum Schutz und zur Gewährleistung der Widerstandsfähigkeit der Organisation:

- Elastische Belegschaftskapazität: Unternehmen können ihre Fähigkeit zur Bewältigung des Anstiegs der Arbeitslast aufgrund sich ändernder Geschäftsbedingungen schnell skalieren, ohne die Kosten und Verzögerungen durch die Steigerung einer vollständig menschlichen Belegschaft.

- Prognostizierte betriebliche Resilienz: AI-Agenten sind rund um die Uhr in der Lage, Betriebs-, Compliance- und Sicherheitsrisiken in Echtzeit autonom zu antizipieren, zu modellieren und zu minimieren. So wird sichergestellt, dass das Unternehmen das Trust seiner Kunden und Beteiligten aufrechterhält.

Beispiel in Aktion – Schützen von Kundendaten: Ein großes Unternehmen kann einen AI-Datenverwaltungsagenten bereitstellen, der die regulatorische Umgebung auf Änderungen der Datenschutzgesetze überprüft, sensible Informationen in Unternehmensdatensets erkennt und klassifiziert und dann die entsprechende Governance-Richtlinie anwendet. Der Agent kann Datenzugriffsanforderungen überprüfen und Ausnahmen zur Überprüfung an einen menschlichen Analysten weiterleiten, wodurch das Compliance-Risiko reduziert und gleichzeitig die vertrauenswürdige Verwendung von Daten ermöglicht wird.

Neue Geschäftsfunktionen zur Optimierung der Betriebsexzellenz:

- Autonome Prozessausführung: Eine digitale Belegschaft kann komplexe, aus mehreren Schritten bestehende Aufgaben rund um die Uhr in Maschinengeschwindigkeit ausführen (mit Menschen auf dem Laufenden), wodurch Kosten reduziert und Prozesse effizient skaliert werden.

- Grenzüberschreitende Orchestrierung: AI-Agenten können über die Informations- und Anreizsilos hinweg arbeiten, die normalerweise menschliche Mitarbeiter einschränken, und so die Agilität für funktionsübergreifende Prozesse fördern.

Beispiel in Aktion – Optimierung des Marketing-Trichters im Einzelhandel: Ein Einzelhandelsmarketingteam kann einen AI-Agenten einsetzen, um seinen Kampagnenprozess als Reaktion auf neue Verbrauchertrends zu beschleunigen. Der Agent kann Marketingpläne generieren, mit Marketing-, Produkt- und Vertriebsteams zur Überprüfung zusammenarbeiten und dann automatisch digitale Sicherheiten erstellen und über mehrere Kanäle hinweg ausführen, wobei die Kampagne basierend auf Echtzeit-Feedback dynamisch angepasst wird.

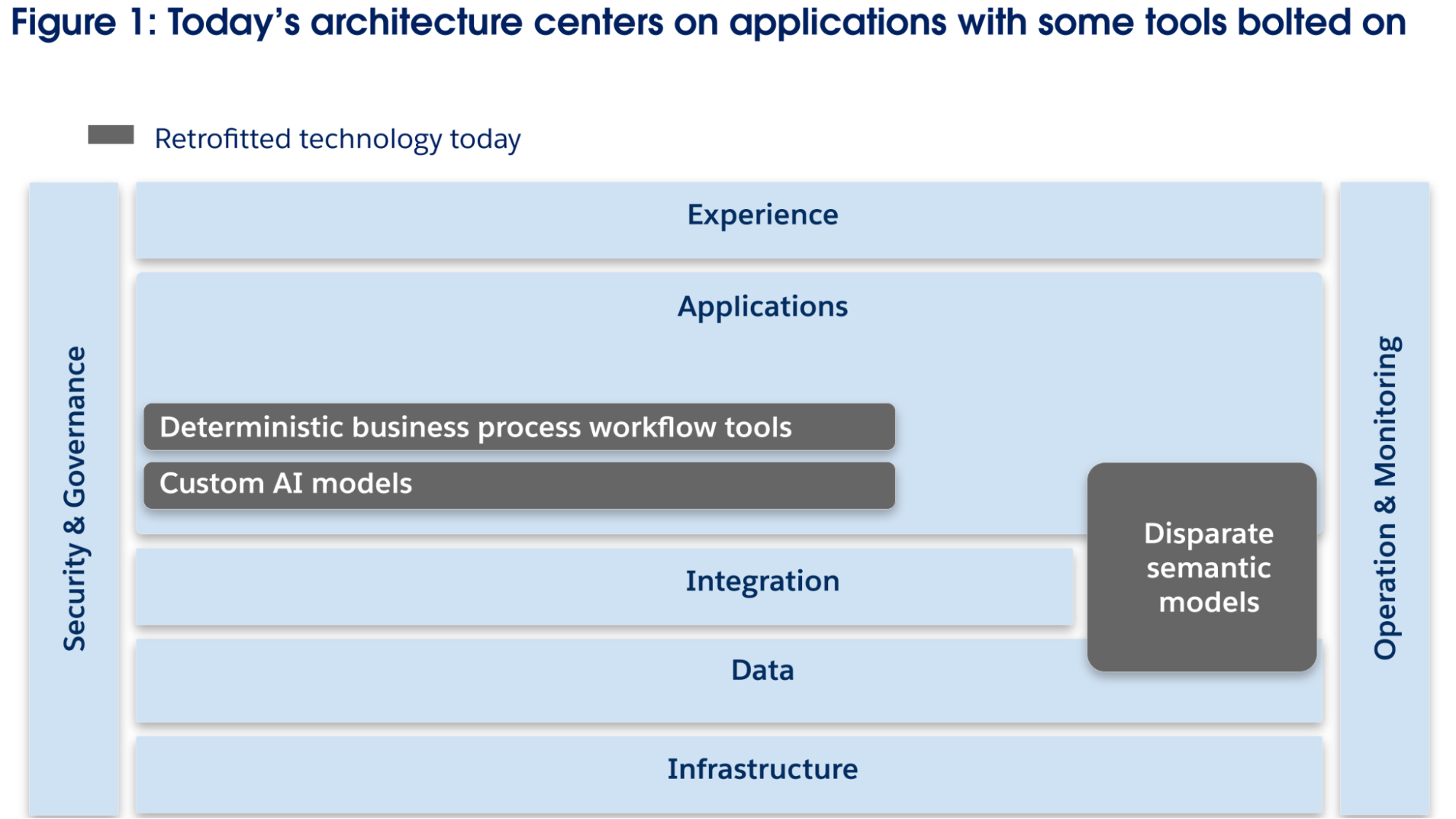

Die IT-Architektur des Unternehmens kann mithilfe eines Ebenenkonstrukts dargestellt werden. Die Schichten gruppieren zugehörige technische Funktionen logisch und erleichtern strukturiertes Denken, bedeuten jedoch nicht notwendigerweise spezifische Implementierungen oder den Grad, in dem eine Schicht monolithisch oder heterogener ausgestaltet sein sollte. In dieser Ebenenansicht (Abbildung 1) besteht die traditionelle IT-Architektur aus fünf Hauptebenen: Infrastruktur, Daten, Integration, Anwendung und Erfahrung. Zwei Ebenen – Sicherheit und IT-Vorgänge – erstrecken sich über diese Ebenen, um Governance, Überwachung und Schutz zu gewährleisten.

Die traditionelle IT-Architektur wurde für ein Paradigma entwickelt, bei dem die Intelligenz des Unternehmens auf menschlichen Mitarbeitern beruhte, die Aktionen in Anwendungen ergriffen, um auf Daten zuzugreifen, Geschäftslogik anzuwenden, die Zusammenarbeit zu erleichtern und Workflows auszuführen. Sie ist nicht für ein Paradigma konzipiert, bei dem AI-Agenten bestimmte Anwendungsfälle, die zuvor von Menschen durchgeführt wurden (oder gar nicht durchgeführt wurden), bedenken und ergreifen können, während Menschen die AI-Agenten überwachen und sich auf kreativere und mehrdeutige Aufgaben konzentrieren.

Obwohl die traditionelle Architektur heute Bereitstellungen von AI-Agenten in untergeordneten Dimensionen unterstützt, kann sie die oben beschriebenen Geschäftsfunktionen des Agentic Enterprise nicht vollständig bereitstellen. Für die Realisierung dieser Funktionen ist eine IT-Architektur erforderlich, die für die weit verbreitete Bereitstellung leistungsstarker AI-Agenten konzipiert ist, die breite Anwendungsfälle abdecken können, statt sich auf begrenzte Bereitstellungen für enge Anwendungsfälle zu beschränken.

AI-Agenten werden sich in den nächsten 5 Jahren weiter verbessern und die IT-Architektur muss sich weiterentwickeln, um den Wert leistungsfähigerer und intelligenter AI-Agenten zu realisieren und zukunftssicher zu werden. Erstens werden Agenten intelligenter, wenn sich die zugrunde liegenden AI-Modelle (wie multimodale LLMs) und die kognitiven Architekturen der Agenten weiterentwickeln (z. B. Planung in mehreren Schritten, Aufgabenaufteilung usw.). Zweitens verfügen AI-Agenten über verbesserte Lern- und Anpassungsfähigkeiten mit Gedächtnisverbesserungen, Selbstreflexionsfunktionen und der Möglichkeit, aus Feedback zu lernen. Drittens können AI-Agenten besser mit anderen Agenten, Tools und Daten interagieren, wie das sich schnell entwickelnde Ökosystem offener Technologiestandards (z. B. Model Context Protocol, Agent2Agent usw.) zeigt. Diese drei Technologietrends werden es AI-Agenten ermöglichen, bei abstrakteren und komplexeren Aufgaben leistungsfähiger zu sein, sie werden jedoch auch zahlreiche Herausforderungen für die heutige IT-Architektur mit sich bringen.

Erstens stützen sich AI-Agenten grundsätzlich auf AI-Modelle, die intern entwickelt und extern bezogen werden und sich schnell weiterentwickeln und eine komplexe, gemeinsame und standardisierte AI/ML-Modellverwaltung erfordern. Heute werden AI-Modelle für bestimmte Anwendungsfälle in einer Anwendung verwendet, nicht als freigegebene Funktionen für die Wiederverwendung mit gemeinsamen Tools für Schulungen, Bereitstellung, Governance und Risikomanagement. Künftig müssen Unternehmen unterschiedliche AI-Modelle für verschiedene Anwendungsfälle für Agenten verwenden können, die Tools erfordern, die es Agenten ermöglichen, die zugrunde liegenden Modelle (z. B. das Grundlagenmodell im Vergleich zu einem domänenspezifischen kleineren Modell) je nach Geschäftskontext auszutauschen. Dazu müssen intern entwickelte oder gehostete AI-Modelle mit einheitlichen Lebenszyklus-Tools verwaltet werden, um Konsistenz, Wiederverwendbarkeit, Skalierbarkeit und Effizienz zu gewährleisten. Ebenso erfordert der Zugriff auf extern gehostete AI-Modelle ein unternehmensweites Kontroll-Framework, um optimale Leistung, Sicherheit, Compliance, Verfügbarkeit und Zuverlässigkeit zu gewährleisten.

Zweitens verfügen AI-Agenten über unterschiedliche Skalierungsmuster und betriebliche Anforderungen wie Hosting, Entwicklung, Überlegungen, Lernen, Speicherverwaltung und Vorgänge, die eine separate und dedizierte architektonische Grenze für Agenten erfordern. Eine direkte Einbettung dieser Funktionalität in die heutige statische und deterministische Anwendungsarchitektur würde unnötige architektonische Komplexität und Risiken mit sich bringen. Darüber hinaus sollten AI-Agenten über standardisierte Schnittstellen oder Messaging-Systeme mit vorhandenen Anwendungen interagieren, um in Echtzeit interagieren zu können.

Drittens müssen AI-Agenten in der Lage sein, über unterschiedliche Datensets nachzudenken und miteinander zusammenzuarbeiten, oft über isolierte Anwendungsstapel hinweg. In der heutigen Architektur gibt es jedoch keine gemeinsame semantische Funktion, die es diesen Agenten ermöglicht, über unterschiedliche Datensets nachzudenken. Obwohl Einzweckagenten erfolgreich bereitgestellt werden können, bleibt es daher schwierig und riskant, sie so zu skalieren, dass sie in großer Anzahl bei komplexen, siloübergreifenden Aufgaben eingesetzt werden.

Schließlich fehlt es der aktuellen IT-Architektur für Unternehmen an einer effektiven Möglichkeit, durchgängige Geschäftsprozesse zu orchestrieren, zu optimieren und zu steuern, die dynamische Workflows enthalten, die von leistungsfähigeren Agenten ausgeführt werden, was die Rolle der menschlichen Mitarbeiter in diesem Prozess erweitern und in einigen Fällen ersetzen wird. Heute werden Automatisierungstools genutzt, um lineare, deterministische Workflows zu verwalten, die in der Regel einer vordefinierten Sequenz folgen, in prozessspezifischen Sprachen dokumentiert sind und auf statischer Logik basieren, die sich selten ändert. AI-Technologien können einige dieser linearen Prozesse verbessern (beispielsweise die Verwendung von ML-Modellen anstelle hartcodierter Geschäftsregeln zur Berechnung von Schwellenwerten für die Darlehensgenehmigung), die strategischen und Ausführungsaspekte der meisten wichtigen Geschäftsprozesse bleiben jedoch von Natur aus dynamisch und flexibel. Aufgaben wie das Entwickeln von Marketingstrategien, das Lösen komplexer Kundenprobleme oder potenzieller Kunden haben klare Ziele (Kundenzufriedenheit, Kundenvorgangslösungsgeschwindigkeit usw.), folgen jedoch nicht einer festen, vordefinierten Ausführungsreihenfolge.

Derzeit verlassen sich traditionelle Unternehmen in erster Linie auf den Menschen, um diese komplexen Geschäftsprozesse zu koordinieren und durchzuführen (z. B. die Festlegung einer Strategie und die Verwaltung komplexer Programme). Da sich AI-Agenten in den nächsten 3-5 Jahren ständig weiterentwickeln (größere Intelligenz, Lern- und Interaktionsfunktionen), wird sich ihre Fähigkeit, solche dynamischen Prozesse autonom auszuführen, erheblich erweitern, was Komplexitäten und Integrationsherausforderungen mit sich bringt, die weit über die Möglichkeiten der vorhandenen Integrations- und Automatisierungstools hinausgehen. Die anpassungsfähige und dynamische Natur von AI-Agenten schafft einen starken Bedarf an neuen Orchestrierungsfunktionen, um die Kontrolle auf Unternehmensebene, umfassende Transparenz und konsistente Ausrichtung an unternehmensweiten strategischen Zielen zu gewährleisten, insbesondere bei der Verwaltung komplexer, langwieriger und aus mehreren Schritten bestehender Workflows, die AI-Agenten, Menschen, Automatisierungstools und andere deterministische Systeme umfassen.

Die IT-Architektur des Agentic Enterprise schafft eine Plattform für intelligente Aktionen, indem sie menschliche Mitarbeiter, AI-Agenten und deterministische Systeme nahtlos integriert. Mit dieser Architektur können Mitarbeiter und AI-Agenten dynamisch auf vereinheitlichtes Enterprise Knowledge aus verschiedenen Datenquellen zugreifen und es nutzen, um komplexe Workflows und Prozesse effizient auszuführen, die auf strategische Geschäftsziele ausgerichtet sind. Die bestehende IT-Architektur einer Reihe isolierter Plattformen und Punktlösungen wird sich zu einer Reihe von zusammengesetzten Anwendungsservices, semantischen und Datentools und Netzwerken von AI-Agenten entwickeln, die von neuen intelligenten Tools zur Orchestrierung von Geschäftsprozessen überwacht und gesteuert werden.

Diese Architektur ermöglicht es Agenten, ihren jeweiligen Umfang zu erkennen, zu begründen und zu handeln, innerhalb und bereichsübergreifend zu arbeiten und kontinuierlich zu lernen, sich zu verbessern und anzupassen. Dies erfordert ein Design, das sich auf zuverlässige Mechanismen für den Zugriff auf Daten und Knowledge (semantisches Verständnis), flexible und standardisierte Kommunikationsprotokolle und -schnittstellen (z. B. Agent zu Agent, Agent zu deterministischen Systemen und Agent zu Mensch) konzentriert und Workflows und Prozesse über Agenten, Menschen und Automatisierungstools und deterministische Systeme hinweg orchestriert.

Zur Realisierung der architektonischen Vision einer Plattform für intelligente Aktionen werden die folgenden Designprinzipien als bewährte Vorgehensweisen empfohlen:

- Zusammensetzbarkeit und Modularität: Entwerfen Sie Architekturelemente als modulare Komponenten mit standardisierten Schnittstellen, um eine schnelle und dynamische Zusammenstellung von Agentenfunktionen, Workflows und menschlichen Oberflächen zu ermöglichen. Priorisieren Sie Verträge mit klarer Oberfläche und Abstraktion, um AI-Agenten die größtmögliche Flexibilität beim Erstellen von Workflows zu ermöglichen.

- Daten und semantische zuerst: Stellen Sie einen umfassenden, genauen, schnellen, sicheren und kosteneffizienten Zugriff auf Daten sicher, mit einem gemeinsamen semantischen Verständnis für Agenten, die effektiv über isolierte Systeme hinweg argumentieren können. Dazu müssen Daten (und Metadaten) wie ein Produkt behandelt werden, mit Tools, die Qualität, Herkunft, Governance und Zugriff sicherstellen, sowie einer Möglichkeit, semantisches Verständnis bereitzustellen, das zwischen Agenten und Menschen geteilt wird.

- Eingebettete IT- und Geschäftsbeobachtbarkeit: Betten Sie durchgängige Überwachungs-, Verfolgungs-, Bewertungs- und Erklärbarkeitsfunktionen in die gesamte Architektur ein, um Einblicke in die Überlegungen, Verhaltensweisen, Systeminteraktionen und Auswirkungen von Agenten auf Geschäfts-KPIs zu erhalten und die Leistung von Agenten kontinuierlich zu optimieren. Dazu zählen Kostenoptimierung (FinOps), Nachhaltigkeitskennzahlen und betriebliche Telemetrie bei gleichzeitiger Wahrung von Trust, Compliance und verantwortungsvollem Ressourcenverbrauch. Da AI-Agenten von Natur aus nicht deterministisch sind, ist die Beobachtbarkeit von entscheidender Bedeutung, um sicherzustellen, dass AI-Agenten vertrauenswürdig, konform und überprüfbar mit der menschlichen Aufsicht arbeiten können.

- Trust-out: Erzwingen Sie dynamische, detaillierte Berechtigungen, die auf dem Intent der Aufgaben des Agenten (Datenzugriff, Aktionen usw.) basieren, und implementieren Sie umfassende Sicherheitspraktiken, einschließlich roter Teams, automatisierter CVE-Scans, Schwachstellenerkennung und risikobasierter Validierungskontrollen. Angesichts des Risikos, dass Agenten aufgrund ihrer Fähigkeit, mit Maschinengeschwindigkeiten zu arbeiten, eskalierende Risiken verursachen, sind genauere und dynamischere Kontrollen erforderlich. Stellen Sie sicher, dass alle AI-generierten Ausgaben (von Agenten oder Modellen) vor der Verwendung oder Bereitstellung streng anhand definierter Richtlinien für Compliance, Sicherheit, Toxizität und Verzerrung validiert werden, was Protokollierungs- und Erklärbarkeitsmechanismen mit überprüfbaren Prüfprotokollen für AI-Entscheidungen, -Aktionen, -Inhalte und -Prognosen erfordert.

- Agent zuerst mit menschlicher Aufsicht: Legen Sie fest, dass AI-Agenten das Standardtool zum Lösen von Geschäftsanwendungsfällen sein können, wobei andere Überlegungen (z. B. Kosten, technische Anpassung) außer Acht gelassen werden, und entwerfen Sie IT-Systeme so, dass sie für Agenten-Workflows zugänglich sind. Dazu gehört auch die Möglichkeit für Menschen, jeden Schritt des Prozesses eines Agenten zu überwachen, in ihn einzugreifen und ihn zu überschreiben. Agenten benötigen selbstreflektierende Fähigkeiten, um proaktiv nach menschlicher Anleitung zu suchen, wenn ihr Vertrauen in die Entscheidungsfindung unter vorprogrammierte Schwellenwerte fällt.

- Reaktive und multimodale Interaktion: Aktivieren Sie die Architektur, um umfassende Agentenaufruf- und -antwortmechanismen für alle Interaktionstypen zu unterstützen, einschließlich Agent-zu-Agent-Protokollen, menschlichen multimodalen Eingaben (Sprache, Text, visuell), Geschäftsereignissen, Systemsignalen und Streaming-Daten. Aktivieren Sie sowohl ereignisgesteuerte als auch Echtzeitverarbeitungsfunktionen, um sicherzustellen, dass Agenten auf zeitnahe Signale aus jeder Quelle oder jedem Format reagieren können.

- AI-fähige Infrastruktur: Stellen Sie sicher, dass die Infrastruktur mit integrierter Redundanz elastisch skaliert werden kann, um schwankende AI-Arbeitslasten zu bewältigen, und integrieren Sie ML/LLM-Pipelines in die Daten- und Anwendungsarchitektur, während Sie die Anforderungen an die Datenresidenz erfüllen.

- Offenes Ökosystem: Priorisieren Sie die Interoperabilität und vermeiden Sie Technologiebindungen, indem Sie offene Standards, Protokolle und genau definierte Schnittstellen (APIs, Ereignisse) bevorzugen, um vom Technologieökosystem zu profitieren.

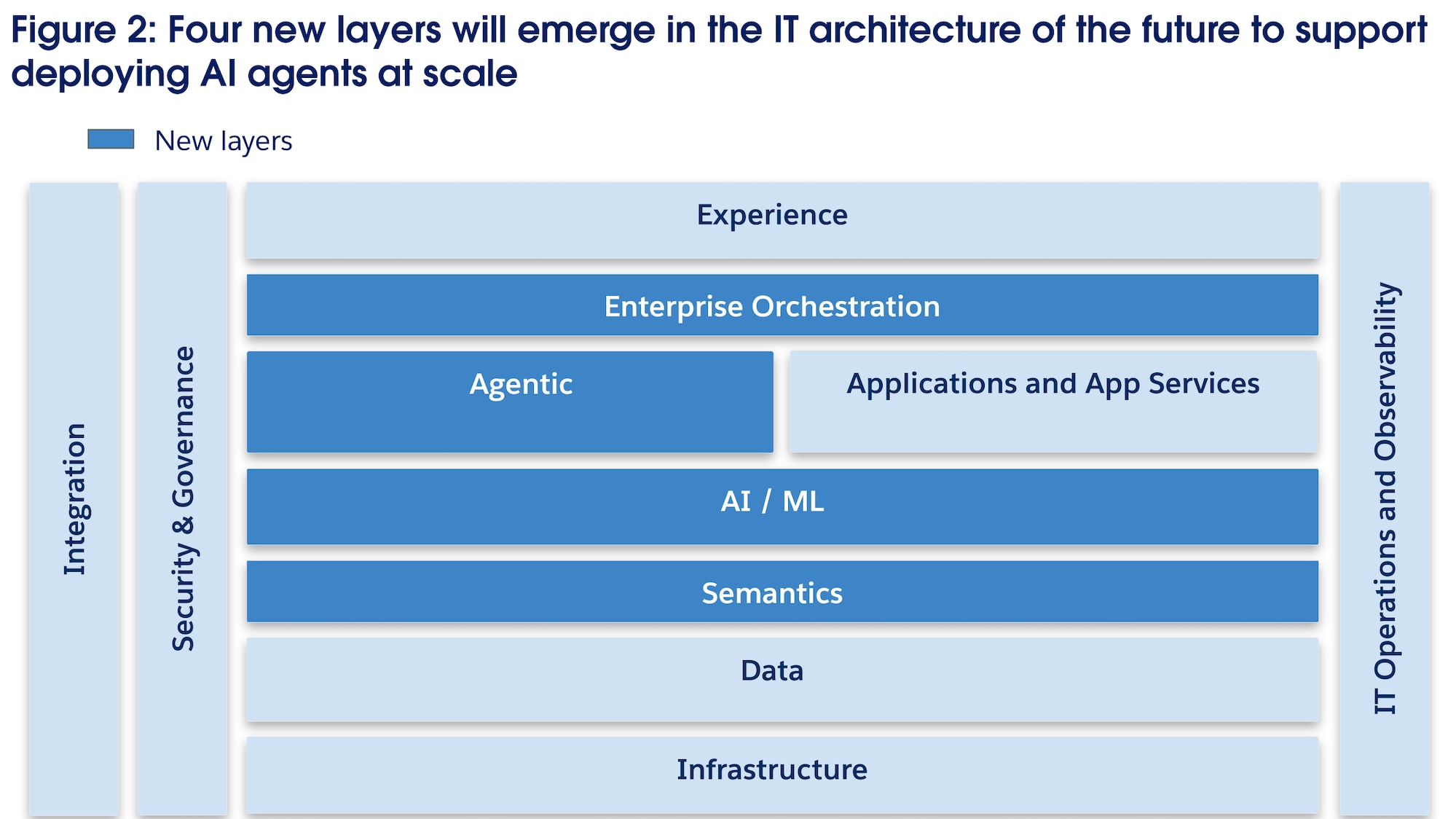

Um die Agententransformation erfolgreich zu aktivieren und zu skalieren, müssen Unternehmen über die bloße Verbesserung der aktuellen Ebenen hinausgehen. Sie müssen die Einführung von vier zusätzlichen Architekturebenen (Abbildung 2) in Erwägung ziehen, die speziell auf die Anforderungen von AI-Agenten zugeschnitten sind.

Die Agentic Layer ist der Entwicklung und Verwaltung von AI-Agenten gewidmet und umfasst kognitive Funktionen wie Planung, Überlegungen, Arbeitsspeicher, Werkzeugauslastung, Statusverwaltung und Lebenszykluskontrolle. Diese Schicht erfüllt die individuellen technischen und betrieblichen Anforderungen von AI-Agenten, gewährleistet die Interoperabilität zwischen Anwendungen und Datenspeichern durch standardisierte Protokolle und erleichtert die Zusammenarbeit zwischen Agenten. Die vorhandene Anwendungsebene wird zu Anwendungsservices weiterentwickelt, die dynamisch für Agenten-Workflows erstellt werden.

Die semantische Ebene wird eingeführt, um die Trennung zwischen Unternehmensrohdaten und dem semantischen Verständnis zu beheben, das AI-Agenten benötigen. Sie codiert und verwaltet explizit Geschäftseinheiten, Konzepte, Definitionen und Beziehungen zwischen Unternehmen. Dadurch wird eine Unternehmensontologie und die Darstellung von Business Knowledge erstellt, um ein gemeinsames semantisches Verständnis zu ermöglichen, das komplexere Workflows mit mehreren Agenten unterstützt, die Aufgaben auf höherer Ebene ausführen. Über einen Datenkatalog hinaus übersetzt die semantische Ebene eine Abfrage mit natürlicher Sprache in präzise Abfragen für bestimmte Datenspeicher, harmonisiert die Ergebnisse und gibt dem Agenten eine kontextbezogene und umfassendere Antwort zurück. Die vorhandene Datenebene wird unterdessen durch die Übernahme zentraler Lakehouses vereinheitlicht und der Datenzugriff über eine AI-fähige Datenstruktur erweitert, um die Prinzipien des Betriebsmodells für Datenmaschen zu unterstützen.

Die AI/ML-Ebene zentralisiert die Verwaltung der AI-Funktionen von Unternehmen, einschließlich großer Sprachmodelle, großer Aktionsmodelle und domänenspezifischer ML-Modelle. Dabei werden sowohl intern entwickelte AI-Modelle während ihres gesamten Lebenszyklus als auch der kontrollierte Zugriff auf externe AI-Services verarbeitet. Im Gegensatz zu herkömmlichen Architekturen, in denen AI-Modelle in Anwendungen eingebettet sind, etabliert diese Ebene AI-Modelle als erstklassige Komponenten und gemeinsam genutzte Services im Unternehmen. Sie konzentriert sich auf unternehmensgesteuerte AI-Funktionen (nicht auf AI-Funktionen, die von externen Anbietern bereitgestellt werden). Diese Schicht bietet standardisierte Mechanismen für Trust, Sicherheit, Compliance und Bereitstellung und bietet Informationen für verschiedene Agenten und andere AI-Arbeitslasten im Unternehmen.

Die Enterprise Orchestration Layer ist die funktionale Abstraktion zur Koordinierung, Steuerung und Optimierung komplexer, aus mehreren Schritten bestehender Workflows und Geschäftsprozesse, die sich auf AI-Agenten, Menschen, Automatisierungstools und deterministische Systeme erstrecken. Diese Ebene nutzt ein gemischtes Orchestrierungsmodell, das es einzelnen Agenten und Systemen ermöglicht, lokal choreographierte Aufgaben mithilfe offener Protokolle wie MCP und A2A autonom zu bearbeiten, während gleichzeitig eine zentrale durchgängige Überwachung und Koordination des gesamten Prozesses gewährleistet wird. Zum Implementieren des gemischten Orchestrierungsmodells stellt diese Ebene wichtige Geschäftsprozesse in semantisch umfangreichen, semantisch lesbaren Formaten dar, die sowohl die deterministischen Schritte (modelliert während der Entwurfszeit) als auch die dynamischen Schritte (entschieden von Agenten während der Laufzeit) eines Geschäftsprozesses definieren und so die Grundlage für das Prozessmodell für die Verwaltung und Optimierung bilden.

In der Regel sind erhebliche Teile der menschengesteuerten Geschäftsprozesse in maschinenlesbaren Formen undokumentiert oder unzugänglich. Die detaillierte Beobachtbarkeit der Aktivitäten von AI-Agenten, einschließlich umfangreicher Daten und Metadaten zu ihren Aufgaben und Aktionen, ermöglicht jedoch die Erfassung, Dokumentation und Integration dynamischer, zuvor unstrukturierter Arbeit in deterministische lineare Workflows, um umfassende Prozessmodelle zu erstellen. In der detaillierten Prozessdokumentation werden bisher unsichtbare Abhängigkeiten zwischen Aufgaben und Ausführungspfade erfasst. Dadurch kann das Unternehmen die betriebliche Effizienz kontinuierlich optimieren, Engpässe effektiv beheben und von Agenten identifizierte bewährte Vorgehensweisen systematisch in wiederverwendbare unternehmensweite Playbooks kodifiziert werden. Dies führt zu einem ganzheitlichen digitalen Zwilling einzelner Prozesse und bei der Skalierung zum gesamten Unternehmen.

Komplexe Prozesse wie die Ausführung umfassender Vertriebsstrategien oder die Einarbeitung neuer Mitarbeiter umfassen beispielsweise zahlreiche voneinander abhängige Schritte, bei denen die Orchestrierungsebene eine angemessene Beteiligung der Mitarbeiter (z. B. die Bearbeitung von Ausnahmen), begrenzte Autonomie für AI-Agenten und die Durchsetzung der Compliance sicherstellen kann. Bei diesen Prozessen sorgt die Orchestrierungsebene von oben nach unten für mehr Berechenbarkeit und Governance, verfolgt und wertet wichtige Leistungsindikatoren (KPIs) kontinuierlich aus, gewährleistet die transaktionale Integrität von Workflows und Rollback-Logik und behält die Transparenz in jeder Phase des Workflows bei, um die Ausrichtung auf übergreifende Geschäftsziele sicherzustellen. Zum Implementieren dieser Funktion verwendet diese Ebene Richtlinien, Regeln und Leitplanken aus der Sicherheits- und Governance-Ebene (per Code-Richtlinie) sowie Geschäftsziele und KPIs, die in der semantischen Ebene gespeichert sind. Angesichts der Autonomie und Schnelligkeit von AI-gestützten Interaktionen besteht die Gefahr strategischer Fehlausrichtungen oder Compliance-Verstöße, insbesondere bei langfristigen, mehrstufigen Workflows. Der Ansatz der gemischten Orchestrierung mindert diese Risiken, indem unternehmensweite Geschäftsregeln, Compliance-Prüfungen und Richtlinienerzwingung direkt in komplexe Workflows eingebettet werden und die menschliche Aufsicht an kritischen Stellen integriert wird.

Jede dieser 11 Ebenen bietet spezifische Funktionen für die Bereitstellung von AI-Agenten in großem Umfang auf sichere, vertrauenswürdige und effektive Weise, die das volle Potenzial der Agenten-AI nutzen, um die Art und Weise zu verändern, wie Arbeit in einem Unternehmen erledigt wird. Im folgenden Abschnitt werden die Funktion der Ebene, die neuen Änderungen aufgrund der Zunahme von AI-Agenten und ihre wichtigen Technologiefunktionen beschrieben.

Funktion: Die Erfahrungsebene fungiert als primäre Oberfläche für menschliche Benutzer und ermöglicht multimodale Interaktionen, indem Eingaben (Text, Sprache, visuell) erfasst und kontextbezogen relevante Antworten auf mehreren Geräten bereitgestellt werden. Sie übergibt Benutzerabsichten nahtlos zur Aktion an die Agentenebene und bietet gleichzeitig die dynamische Benutzeroberfläche und Visualisierungen, die menschliche Eskalationen und Genehmigungen in Agenten-Workflows erleichtern.

Was ist anders als heute: AI wird traditionelle GUI-basierte Oberflächen mit natürlicher Sprachverarbeitung, Kontextbewusstsein und proaktiver Entscheidungsunterstützung erweitern. AI-Agenten können proaktiv Interaktionen initiieren und personalisierte Echtzeitempfehlungen über alle Kanäle und Modalitäten hinweg bereitstellen.

Wichtige Technologiefunktionen:

- Unterhaltungs-AI und digitale Assistenten: Aktivieren Sie die Benutzeroberfläche standardmäßig, um AI-Unterstützung zur Unterstützung menschlicher Benutzer zu bieten.

- Benutzeroberfläche für Attribution und Transparenz: Geben Sie Antworten auf der Benutzeroberfläche erklärbar an, z. B. durch Anzeigen von Zitaten, Datei-/Systemquellen und des Ansatzes/Rationals für die Entscheidungen.

- Service für proaktive und Umgebungsbenachrichtigungen: Ermöglicht es Agenten, Statistiken oder Warnungen proaktiv auf dem am besten geeigneten Kanal und Formfaktor basierend auf dem aktuellen Kontext des Benutzers an Benutzer zu übertragen.

- Omnikanal-Erfahrungen: Bietet eine nahtlose, konsistente und einheitliche Erfahrung über alle Kanäle hinweg mit Journey-Kontinuität, bei der Unterhaltungen und Aufgaben der Person statt der Anwendung folgen.

- Multi-Modal-Funktionen: Ermöglicht es Menschen, mit Agenten und Anwendungen über Text, Sprache, Bild, Touch, Video und AR/VR zu interagieren, damit Agenten Informationen in der effizientesten Modalität verstehen und präsentieren können.

- Kontextbezogene Personalisierung und dynamische Benutzeroberfläche: Ermöglicht kontextbezogene Echtzeit-Benutzererfahrungen (Zeit, Standort, Benutzeraktionen), um die Personalisierung, einschließlich der direkten Generierung von Benutzeroberflächen, zu ermöglichen.

Funktion: Die Agentenebene fungiert als standardmäßige Laufzeitumgebung für die Arbeit im Unternehmen, in der AI-Agenten Aufgaben aus der Erfahrungsebene aufschlüsseln und ausführen, indem sie Workflows mithilfe von Tools aus der Anwendungsebene und der Datenebene dynamisch zusammenstellt. Der Konfigurationsstatus von AI-Agenten wird in dieser Ebene gespeichert und verwaltet. Agenten werden für bestimmte Aufgaben instanziiert und die spezifischen Agenteninstanzen anschließend außer Betrieb genommen. Durch diese Implementierung können Agenten immer vom aktuellen Konfigurationsstatus aus basierend auf Offline-Optimierungen aufgerufen werden (mit Funktionen aus AI/ML, Beobachtbarkeit und Orchestrierungsebenen). Diese Ebene ist für die umfassende Lebenszyklusverwaltung, Koordination und Governance der AI-Agenten verantwortlich.

Was ist anders als heute: Diese Ebene wird aus dem aktuellen ungleichen Satz an Pilotprogrammen und begrenzten Agentenbereitstellungen hervorgehen. Obwohl regelbasierte Bots vorhanden sind, werden nur wenige adaptive, nicht deterministische und zielgerichtete Softwareprogramme in großem Umfang bereitgestellt.

Wichtige Technologiefunktionen:

- Agent Runtime Environment (Agentenlaufzeitumgebung): Verwaltet den Lebenszyklus, die Ausführung und die Ressourcenzuteilung für AI-Agenten.

- Agent Lifecycle Management Suite: Enthält Entwicklungs-Frameworks, Entwicklungs- und Testtools sowie Verwaltungssysteme für Agentenaktivitäten und Versionskontrolle.

- Agent Reasoning Engine (Modul für Agentenüberlegungen): Ein kognitives Framework für Agenten, um Ziele aufzuschlüsseln, zu planen und zu entscheiden, welche Tools zur Lösung komplexer Probleme verwendet werden sollen.

- Agentenspeicher und Kontextspeicher: Ermöglicht Agenteninstanzen das Abrufen und Verwalten des Kontexts zu vorherigen Interaktionen, wodurch Konsistenz und Personalisierung gewährleistet werden.

- Agenteninteroperabilitätsprotokolle: Standardisierte Schnittstellen für die Kommunikation zwischen Agenten (A2A) und für Agenten zur Schnittstelle mit externen Systemen (z. B. über das Modellkontextprotokoll).

- Tool Registry (Tool-Registrierung): Ein zusammengestellter Satz interner und extern unterstützter Tools, die Agenten zum Erledigen einer bestimmten Aufgabe aufrufen können.

- Agentenregister: Ein zusammengestelltes Ökosystem aus vorgefertigten AI-Lösungen und Agenten, das die Erkennung und den Abgleich von Funktionen unterstützt.

- Erzwingung der Richtlinie für verteilte Agenten: Ermöglicht die unternehmensweite Unternehmensführung, indem Agenten die Einhaltung selbst überprüfen können, bevor sie Maßnahmen ergreifen.

- Framework für Agentenselbstreflexion und -anpassung: Stellt einen Mechanismus bereit, mit dem ein Agent seine eigene Leistung analysieren und mit menschlicher Genehmigung Verbesserungen auslösen oder Änderungen an sich selbst vorschlagen kann.

Funktion: Diese Ebene fungiert als zentralisiertes Intelligenzzentrum und bietet AI-Modelle als eine Reihe gemeinsamer Services, die von der Agentenebene (und Anwendungen) verwendet werden können, um ihre Argumentations- und Entscheidungsfindungsfunktionen mit integrierten Sicherheits-Frameworks und Überwachungsfunktionen zu unterstützen.

Was ist anders als heute: AI-Modelle wurden in der Regel in bestimmte Anwendungen eingebettet. In der IT-Architektur von Agentic Enterprise wird die AI/ML-Ebene ein erstklassiger zentraler Satz von Services sein, der viele Anwendungen und Agenten unterstützt und den gesamten Modelllebenszyklus von der Entwicklung bis zur Bereitstellung in Echtzeit unterstützt.

Wichtige Technologiefunktionen:

- Vorgefertigte Grundlagenmodelle: Große ML-Modelle, die auf einem breiten Spektrum von Daten trainiert wurden und eine Vielzahl allgemeiner Aufgaben ausführen können.

- Abrufvergrößerte Generierung (RAG): Eine AI-zentrierte Pipeline, die Grundlagenmodelle auf unternehmensspezifischen Daten basiert, um die Genauigkeit zu erhöhen und Halluzinationen zu reduzieren.

- AI Trust, Safety, & Governance Hub (AI Trust, Safety und Governance-Zentrum): Eine Suite von Tools, die in den Modelllebenszyklus integriert sind, um verantwortungsvolle AI-Prinzipien wie Verzerrungserkennung, Erklärbarkeit und Sicherheitsüberwachung durchzusetzen.

- Modell-Gateway: Ein Weiterleitungsmodul, das als zentraler Einstiegspunkt für alle Modellrückschlussanforderungen fungiert und Aufrufe an verschiedene interne und externe Modelle verwaltet, um Kosten, Leistung und Compliance zu optimieren.

- Modellentwicklungsworkbench: Eine integrierte Entwicklungsumgebung für Datenwissenschaftler mit Tools für die Datenvorverarbeitung, das Modelltraining und Experimente.

- MLOps und Lifecycle Automation Pipeline: Das CI/CD-Modul für maschinelles Lernen, das den durchgängigen Lebenszyklus von Modellen von der Schulung bis zur Bereitstellung und Einstellung automatisiert.

- Modellbereitstellungs- und Rückschlusslaufzeit: Eine skalierbare Umgebung mit geringer Latenz zum Bereitstellen trainierter Modelle als sichere API-Endpunkte für den Echtzeitverbrauch.

- Modell- und Vermögenswertregister: Ein zentralisiertes, versionsgesteuertes Repository für alle AI/ML-Datenbestände, einschließlich Modelle, Datensets und Quellcode, um die Reproduzierbarkeit und Überprüfbarkeit zu gewährleisten.

- Generierung und Verwaltung synthetischer Daten: Tool zum Generieren und Verwalten synthetischer Daten, das die statistischen Eigenschaften realer Daten beibehält, ohne sensible Informationen offenzulegen.

Funktion: Die Enterprise-Orchestrierungsebene ist die Steuerungsebene für die durchgängige Arbeit in einem Agentenunternehmen. Dadurch wird sichergestellt, dass die agentischen Workflows und Interaktionen den Unternehmenszielen und Governance-Richtlinien entsprechen. Sie nutzt die Telemetrie der Beobachtbarkeit aus anderen Ebenen, um umfassende Geschäftsprozessmodelle zu erstellen und die Optimierung anhand von KPIs zu ermöglichen, die aus der semantischen Ebene stammen. Diese Ebene stellt den freigegebenen Kontext und den Langzeitspeicher für jede neue Instanz eines AI-Agenten für wichtige Workflows bereit.

Was ist anders als heute: Diese Ebene bietet einen einheitlichen Einblick in Geschäftsprozesse, indem maschinenlesbare Modelle erstellt werden, die sowohl strukturierte, deterministische Schritte als auch die unstrukturierte, dynamische Arbeit von Menschen und Agenten erfassen. Sie geht über die heutigen Modelle für die humanzentrierte Zusammenarbeit und Unternehmensführung hinaus, indem Geschäftsziele und Compliance-Regeln als Einschränkungen programmgesteuert in Agenten-Workflows zur Steuerung der Agentenbelegschaft codiert werden.

Wichtige Technologiefunktionen:

- Hybrid Workflow Execution Engine: Die Kernlaufzeit, die das "gemischte Orchestrierungsmodell" ausführt, bietet eine zentrale Übersicht und ermöglicht gleichzeitig die Choreografie lokaler Agenten.

- Prozessführung und Einschränkungsmodul: Ein Echtzeit-Governance-Service, der deklarative Geschäftsregeln, Richtlinien und Einschränkungen für alle laufenden Prozesse verwendet und anwendet.

- Freigegebener Speicher und Kontextverwaltung: Eine freigegebene Speicherebene, auf die alle Akteure in einem Workflow zugreifen können, um Kontinuität und Kohärenz über mehrere Schritte hinweg zu gewährleisten.

- Prozessmodellierungs-Studio: Eine Design-Zeit-Umgebung zum Erstellen und Verwalten maschinenlesbarer, semantisch reichhaltiger Prozessmodelle, die sowohl deterministische als auch dynamische zielgerichtete Schritte definieren.

- Prozessoptimierung und -simulation: Eine Funktion, die digitale Simulationen von Geschäftsprozessen für erweiterte Analysen, Was-wäre-wenn-Simulationen und Prognoseoptimierungen erstellt.

- Prozesserkennung und Gesundheitsüberwachung: Erfasst Prozessmodelle und Echtzeitdaten, um Berichte zu Geschäftskennzahlen des Prozesszustands zu erstellen.

- Digitale Zwillingsprozessmodellierung: Ein Echtzeit-Spiegel von Live-Workflows zum Testen, Simulieren von Änderungen und Optimieren ohne Auswirkungen auf die Produktion.

Funktion: Auf dieser Ebene werden vorhandene Geschäftsanwendungsfunktionen als zusammengesetzte und modulare Tools und Services für Agenten zur Verfügung gestellt. Sie dient auch als Präsentationslaufzeit zum Einbetten von Agentenfunktionen in die Benutzererfahrung. Anwendungen sind weiterhin das System der Datensätze, werden jedoch so umgestaltet, dass sie für Agenten "headless"-Funktionen sind.

Was ist anders als heute: Anwendungen werden sich von monolithischen Benutzeroberflächen zu "Backend-Services" entwickeln, die Agenten dynamisch über APIs und Ereignisse aufrufen können. Diese Ebene wird nativ in AI-Agenten und -Modelle integriert und die Zunahme von LLMs zur Codegenerierung wird zu einer Erhöhung der Anzahl benutzerdefinierter, von Agenten erstellter Mikroanwendungen führen.

Wichtige Technologiefunktionen:

- Modulare Anwendungsservices: Zerlegte Geschäftslogik aus traditionellen Anwendungen, die als maschinenlesbare Aktionen veröffentlicht wurden, die Agenten aufrufen können.

- Agent Embedding SDKs: Toolkits und Bibliotheken, mit denen Entwickler Agenten sicher direkt in Anwendungsbenutzeroberflächen einbetten können.

- Services zur Generierung dynamischer Benutzeroberflächen: Services, mit denen ein AI-Agent Benutzeroberflächenkomponenten basierend auf dem Benutzerkontext in Echtzeit generieren oder ändern kann.

- Native AI-Benutzeroberflächen-Frameworks: Front-End-Frameworks mit integrierter Unterstützung für die Verarbeitung AI-gesteuerter Benutzeroberflächen, beispielsweise die Verwaltung probabilistischer Daten und das Streamen von Textantworten.

- Agentenbasierte Interaktionssysteme: Anwendungen für Produktivität und Zusammenarbeit in Unternehmen, die AI-Agentenfunktionen über visuelle Komponenten integrieren.

- AI-erweiterte Low-Code/No-Code-Anwendungsentwicklung: Tools, mit denen Benutzer und Agenten benutzerdefinierte Anwendungen und Services mit natürlicher Sprache und Aufforderungen erstellen können.

- Anwendungsleitplanken für die Agentennutzung: Anwendungsseitige Steuerelemente für die Agentennutzung, beispielsweise Ratenbegrenzung, Berechtigungen mit Umfang und Telemetrie.

Funktion: Die semantische Ebene bietet ein einheitliches Verständnis von Daten und Knowledge im gesamten Unternehmen und ermöglicht es Menschen und AI-Agenten, Informationen konsistent zu interpretieren und darauf zu reagieren. Knowledge Representation Tools wie Ontologien und Knowledge Diagramme werden verwendet, um Abfragen mit natürlicher Sprache in präzise Datenabfragen mit Kontextbewusstsein zu übersetzen.

Was ist anders als heute: Heutige Unternehmen verfügen zwar über unterschiedliche Metadatenspeicher, die IT-Architektur des Agentic Enterprise erfordert jedoch ein zentralisiertes Enterprise Knowledge Graph (EKG), das Daten domänenübergreifend mit explizit definierten semantischen Beziehungen verknüpft. Dies bietet den umfassenden Kontext, den AI-Agenten zum Ausführen komplexer Überlegungen durchlaufen können, wodurch Anforderungen für eine Reihe technischer Funktionen geschaffen werden, die Knowledge Diagramme unterstützen, die sich über mehrere Funktionsbereiche erstrecken.

Wichtige Technologiefunktionen:

- Metadatenservice: Stellt aussagekräftige Metadaten bereit, einschließlich Datenherkunft, Inhaberschaft und Klassifizierungen.

- Business Glossary & Taxonomy Management: Ein Tool, mit dem Geschäftsbenutzer Standardgeschäftsbedingungen definieren und vereinbaren können.

- Semantic Model Management: Eine Workbench für Knowledge Engineers zum Erstellen, Verwalten und Steuern semantischer Modelle und Ontologien.

- Enterprise Knowledge Graph (EKG): Eine Laufzeitinstanziierung der Unternehmensontologie, die die Beziehungen zwischen Geschäftseinheiten speichert und zuordnet.

- Modul für die Metadatenaufnahme und Harmonisierung: Eine automatisierte Pipeline, die das Enterprise Knowledge Graph aus verschiedenen Quellsystemen ausfüllt und verwaltet.

- Semantisches Abfragemodul: Interpretiert Abfragen mit natürlicher Sprache und erstellt strukturierte Abfragen anhand des EKG, um Daten aus verschiedenen Quellen abzurufen.

- Semantisches Argumentationsmodul: Analysiert implizites Knowledge und verborgene Beziehungen und leitet sie aus dem EKG ab.

Funktion: Die Datenebene ist die grundlegende Quelle der Wahrheit. Sie verwaltet und bietet sicheren, gesteuerten Zugriff auf alle Unternehmensdaten, die von der semantischen Ebene interpretiert werden können, die für Schulungen zu verwendende AI/ML-Ebene, für Transaktionen zu verwendende Anwendungen und Agenten für Argumente.

Was ist anders als heute: Die Datenebene entwickelt sich zu einer einheitlicheren, echtzeitorientierteren und Governance-orientierteren Ebene, die sich oft auf ein Data-Lakehouse im Cloud-Stil konzentriert. Sie muss ein größeres Volumen und eine größere Vielfalt an Daten verarbeiten und von der Batch-orientierten Verarbeitung zum Echtzeit-Streaming wechseln, um reaktive Agenten zu unterstützen. Datenverwaltung und Qualität gewinnen noch mehr an Bedeutung, um zu verhindern, dass schlechte Daten fehlerhafte AI-Ausgaben erzeugen.

Wichtige Technologiefunktionen:

- VectorDB: Eine spezialisierte Datenbank, die für das Speichern und Abfragen von hochdimensionalen Vektoreinbettungen optimiert ist, die für RAG wichtig sind.

- Intelligente Analysedatenpipelines: Ein automatisierter, metadatengesteuerter Service für die Datenaufnahme, -transformation und -ladung (ETL/ELT) in die Datenebene.

- Enterprise Data Lakehouse: Ein zentrales Repository für strukturierte, halbstrukturierte und unstrukturierte Daten, optimiert für Analysen und AI-Arbeitslasten.

- Zero-Copy Data Federation & Search (Zero-Copy-Datenverbund und -suche): Techniken zum Zugreifen auf, Abfragen und Durchsuchen von Daten in mehreren Shops ohne physische Datenbewegung.

- Natürliche Sprache zu SQL: Eine Technik zum Konvertieren von Abfragen mit natürlicher Sprache in SQL.

- Service für Unternehmensdatenkatalog und -erkennung: Ein zentralisiertes, durchsuchbares Inventar aller Datenbestände im gesamten Unternehmen.

- Master & Reference Data Management (MDM): Verwaltet den "goldenen Datensatz" für wichtige Geschäftseinheiten wie "Kunde" und "Produkt".

- Service für die adaptive Datenqualität: Ein kontinuierlicher Überwachungsservice, der mithilfe von KI Datenqualitätsprobleme automatisch in Echtzeit erkennt und behebt.

- Datenverträge: Maschinenlesbare Vereinbarungen zwischen Datenproduzenten und Verbrauchern, die das Schema, die Semantik und die SLAs des Datenaustauschs angeben.

- AI-spezifische Datenspeicher: Datenbanken, die für bestimmte AI-Anwendungsfälle entwickelt wurden, beispielsweise Zeitreihen- oder Diagrammdatenbanken.

- AI-fähiges Datengewebe: Eine logische Datenabstraktionsebene, die eine vereinheitlichte, virtualisierte Ansicht der Daten in verschiedenen physischen Systemen bietet.

- Echtzeit-Datenverarbeitung: Funktionen zum kontinuierlichen Verarbeiten und Analysieren multimodaler Datenströme mit Maschinengeschwindigkeiten.

Funktion: Die Infrastrukturebene bildet die Grundlage für alle anderen Ebenen und bietet die Rechen-, Speicher-, Netzwerk- und Cloud-Funktionen, die erforderlich sind, um AI- und Agentenarbeitslasten skalierbar und kosteneffizient auszuführen.

Was ist anders als heute: AI-Arbeitslasten erfordern eine höhere Skalierbarkeit und Elastizität, um die probabilistische Natur von Agentensystemen zu bewältigen. Die Infrastruktur muss eine schnelle Bereitstellung, spezielle Hardware wie GPUs und Netzwerkdatenverkehr mit geringer Latenz und hohem Durchsatz für die Kommunikation zwischen Agenten unterstützen.

Wichtige Technologiefunktionen:

- Infrastruktur als Code: Automatisierte Bereitstellung und Verwaltung der Infrastruktur mit CI/CD-Bereitstellungs-Pipelines.

- Hybrid- und Multi-Cloud-AI-Infrastruktur: Nutzen Sie die Elastizität der öffentlichen Cloud und die spezielle Infrastruktur für generative AI-Arbeitslasten.

- AI-optimierte Berechnung, Speicherung und Netzwerk: Ordnet Infrastrukturressourcen basierend auf der variablen Nachfrage aus AI-Arbeitslasten dynamisch zu und skaliert sie.

- Edge AI-Infrastruktur: Ermöglicht die Bereitstellung von AI-Modellen und Agenten am Rande des Netzwerks für Anwendungsfälle mit individuellen Latenz- oder Datenschutzanforderungen.

- Selbstheilungsinfrastruktur: Verwendet AI, um die Systemwiederherstellung ohne manuelle Eingabe zu verwalten und so eine hohe Verfügbarkeit zu gewährleisten.

- Nachhaltiges AI-Computing: Energieeffiziente Ansätze zur Verringerung der Umweltauswirkungen von AI-Arbeitslasten.

- Autoskalierung mit Kosten- und CO2-Aspekten: Verwendet FinOps- und Nachhaltigkeitssignale, um die Skalierung und Platzierung von Kapazitäten voranzutreiben.

Funktion: Die Integrationsebene dient als universelles Kommunikationsgewebe für alle (alten und neuen) Systeme über APIs, Ereignisse, Protokolle und Middleware, um sicherzustellen, dass Agenten Services, Daten und Tools nahtlos finden und mit ihnen interagieren können.

Was ist anders als heute: Die Integration muss sich weiterentwickeln, um die dynamischen n:n - Kommunikationsmuster von AI-Agenten zu unterstützen, statt nur vorbestimmte statische Interaktionen zwischen einigen bekannten Systemen zu verarbeiten. Sie erfordert eine Echtzeit-Datenverarbeitung und muss Ad-hoc-Erkenntnisse und die Zusammenarbeit zwischen Agenten ermöglichen.

Wichtige Technologiefunktionen:

- Pipeline für die Betriebsdatenkonnektivität: AI-gestützte Tools für die automatische Schemazuordnung, Datentransformation und Workflow-Generierung, einschließlich API-geführter, ereignisgesteuerter und umgekehrter ETL-Funktionen.

- Adaptive API Management and Service Mesh (Adaptive API-Verwaltung und Service-Mesh): API-Gateways und Service-Mesh-Technologie, die Services dynamisch registrieren, entdecken und steuern können, mit adaptiver Richtlinienerzwingung für Agenten.

- Semantic Knowledge Adapter: Eine Integrationskomponente, die ein gemeinsames Vokabular und Datenmodell für Agenten und Anwendungen bereitstellt, um eine konsistente Dateninterpretation zu ermöglichen.

- Ereignisgesteuertes Integrationsgewebe: Ein Messaging- und Streaming-Backbone mit hohem Durchsatz und geringer Latenz, das eine entkoppelte, asynchrone Kommunikation ermöglicht.

- Agent Protocol Gateway (Agentenprotokoll-Gateway): Ein Gateway für MCP-Services, mit dem Agenten Tools sicher entdecken und Aktionen auslösen können, um MCP mit internen APIs und Ereignissen zu verbinden.

- Composable Capability Catalog & Marketplace (Komponierbarer Funktionskatalog und Marktplatz): Ein zentralisierter, gesteuerter Katalog für alle Unternehmensfunktionen – APIs, Services, Agentenfertigkeiten, Modelle und Datensets – mit Anmerkungen zu semantischen Metadaten für die On-Demand-Zusammenstellung.

Funktion: Diese Ebene überwacht und verwaltet die Gesundheits- und Betriebsleistung von Agenten und des gesamten Systems (eingebettetes Prinzip der Beobachtbarkeit) und bietet Transparenz und Kontrolle, indem Statistiken generiert werden, die die Überprüfung, das Debugging, die Erklärbarkeit, die Kosten und die Ressourcenoptimierung der Agentenbelegschaft des Unternehmens ermöglichen.

Was ist anders als heute?: Diese Ebene wird noch wichtiger, da AI-Agenten Fehler in Maschinengeschwindigkeit verursachen können. Sie muss über die Infrastrukturüberwachung hinaus erweitert werden, um das unvorhersehbare Verhalten autonomer Agenten einzubeziehen, was neue Arten der Telemetrie und die Fähigkeit erfordert, die semantische Korrektheit zu verstehen, nicht nur die technische Leistung.

Wichtige Technologiefunktionen:

- Plattform für Echtzeitüberwachung und -beobachtung: Erfasst kontinuierlich Protokolle, Kennzahlen und Verfolgungen in der gesamten IT-Umgebung mit Erweiterungen für ML-Kennzahlen und das Agentenverhalten.

- FinOps & Cloud Cost Management: Verantwortlich für die Überwachung, Analyse und Optimierung der Infrastrukturkosten im Zusammenhang mit AI und Agentenarbeitslasten.

- Agenten- und ML-spezifische Überwachung: Protokolliert jeden Schritt der Ausführung eines Agenten in einem unveränderlichen Überwachungsprotokoll und profiliert kontinuierlich das Verhalten des Agenten, um Abweichungen von bestehenden Normen zu erkennen.

- AIOps, Vorfalls- und Änderungsverwaltung: Verwendet AI/ML, um potenzielle IT-Probleme zu prognostizieren, Ursachen zu identifizieren und Workflows zur Behebung zu erstellen.

- Geschlossene Feedbackschleife für Lerninhalte: Integriert die Beobachtbarkeitstelemetrie von Agenten wieder in MLOps-Pipelines und ermöglicht so eine automatisierte Modellneuschulung oder eine sofortige Anpassung.

- Semantic Observability Engine: Integriert die Beobachtbarkeit in die semantische Ebene zur Kontextualisierung, um die Erkennung semantischer Anomalien im Agentenverhalten zu ermöglichen.

Zweck: Diese Schicht integriert Trust und Sicherheit in der gesamten Architektur, indem sie die Vermögenswerte des Unternehmens vor Bedrohungen schützt, Risiken verwaltet und die Einhaltung gesetzlicher Anforderungen sicherstellt. Sie umfasst Identitätsverwaltung, Bedrohungserkennung, GRC und AI-spezifische Sicherheitsmaßnahmen.

Was ist anders als heute: Die Sicherheitsebene muss weiterentwickelt werden, um neue Angriffsflächen anzugehen, die von AI-Modellen und -Agenten dargestellt werden, beispielsweise die sofortige Injektion und die Modellvergiftung. Die Identitäts- und Zugriffsverwaltung muss von statischen, rollenbasierten Steuerelementen zu dynamischen, intent-basierten Berechtigungen wechseln, die just-in-time erteilt und sofort nach der Verwendung widerrufen werden.

Wichtige Technologiefunktionen:

- LLM Input/Output Security & Guardrails (LLM-Eingabe-/Ausgabesicherheit und -Leitplanken): Unternehmensleitplanken, die zur Aufforderungs- und Antwortzeit angewendet wurden, um unsichere Inhalte, personenbezogene Daten und Jailbreaks zu blockieren.

- Zero Trust-Architektur mit AI-Überprüfung: Kontinuierliche Authentifizierung durch AI-basierte Verhaltensanalysen mit detailliertem Just-in-Time-Zugriff für Agenten basierend auf ihrer spezifischen Aufgabe.

- Agentensicherheits-Framework: Detaillierte Berechtigungsmodelle, Überwachung auf schädliches Verhalten und Eindämmungsmechanismen zum sicheren Unterbrechen von Agentenaktivitäten.

- AI-Modellsicherheit: Eine detaillierte Verteidigungsstrategie mit Kontrollen in jeder Phase des Modelllebenszyklus zum Schutz vor Vergiftung, Extraktion und gegnerischen Angriffen.

- Datenschutz-KI: Techniken wie Verbundlernen und differenzieller Datenschutz zum Schutz vertraulicher Daten.

- AI-erweitertes GRC: Einsatz von AI-Agenten zur kontinuierlichen Überwachung der Einhaltung von Steuerelementen durch die IT-Architektur.

- Modul für Policen als Code: Eine zentrale Informationsquelle für die Definition von Geschäftsregeln und Compliance-Einschränkungen in einem deklarativen, maschinenlesbaren Format, um Leitfäden für das Verhalten von Agenten festzulegen.

- Kontinuierliches Red-Teaming: Automatisierte, fortlaufende kontradiktorische Tests von AI-Modellen und Agenten, um Schwachstellen zu identifizieren, bevor Angreifer sie ausnutzen.

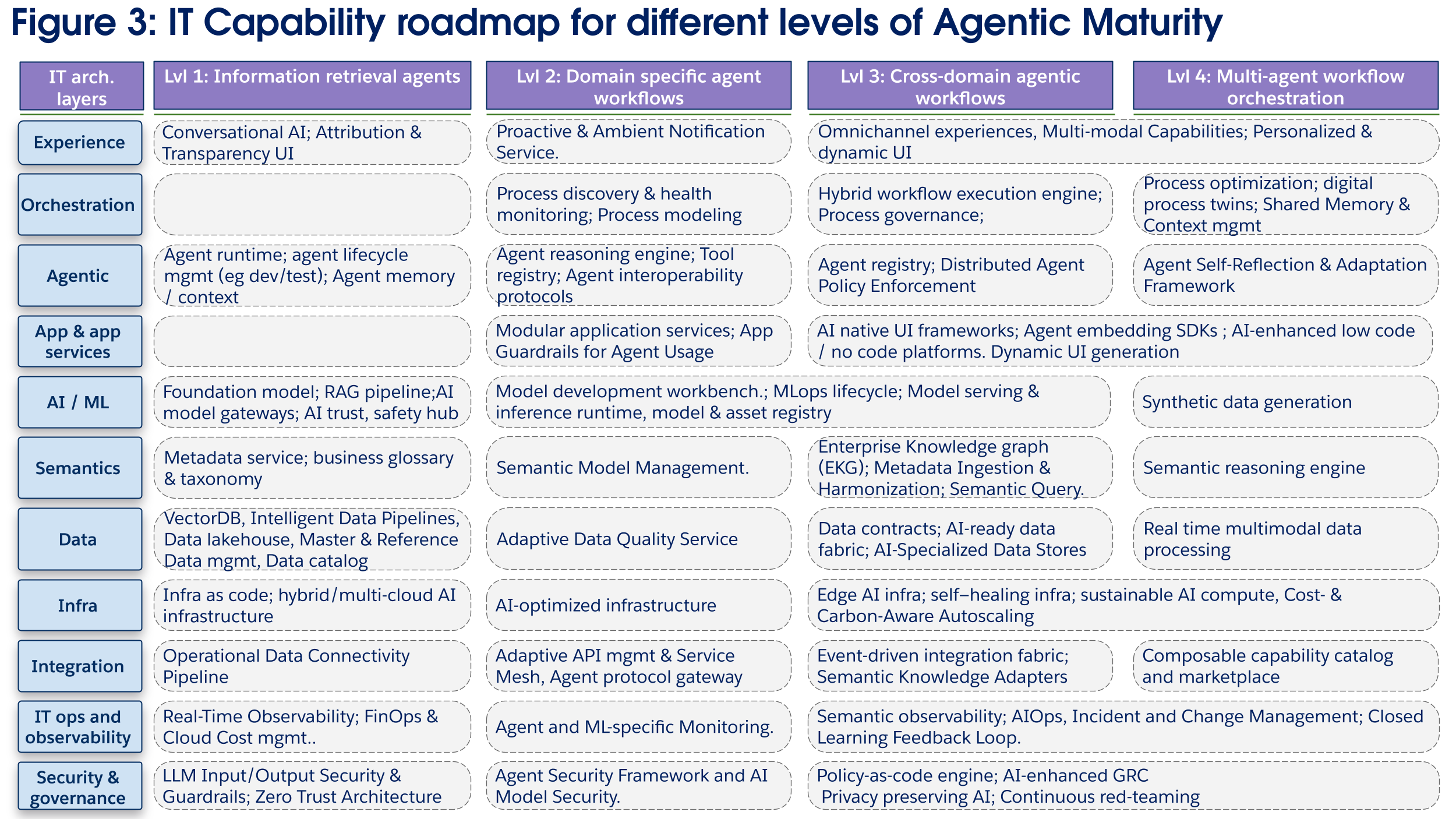

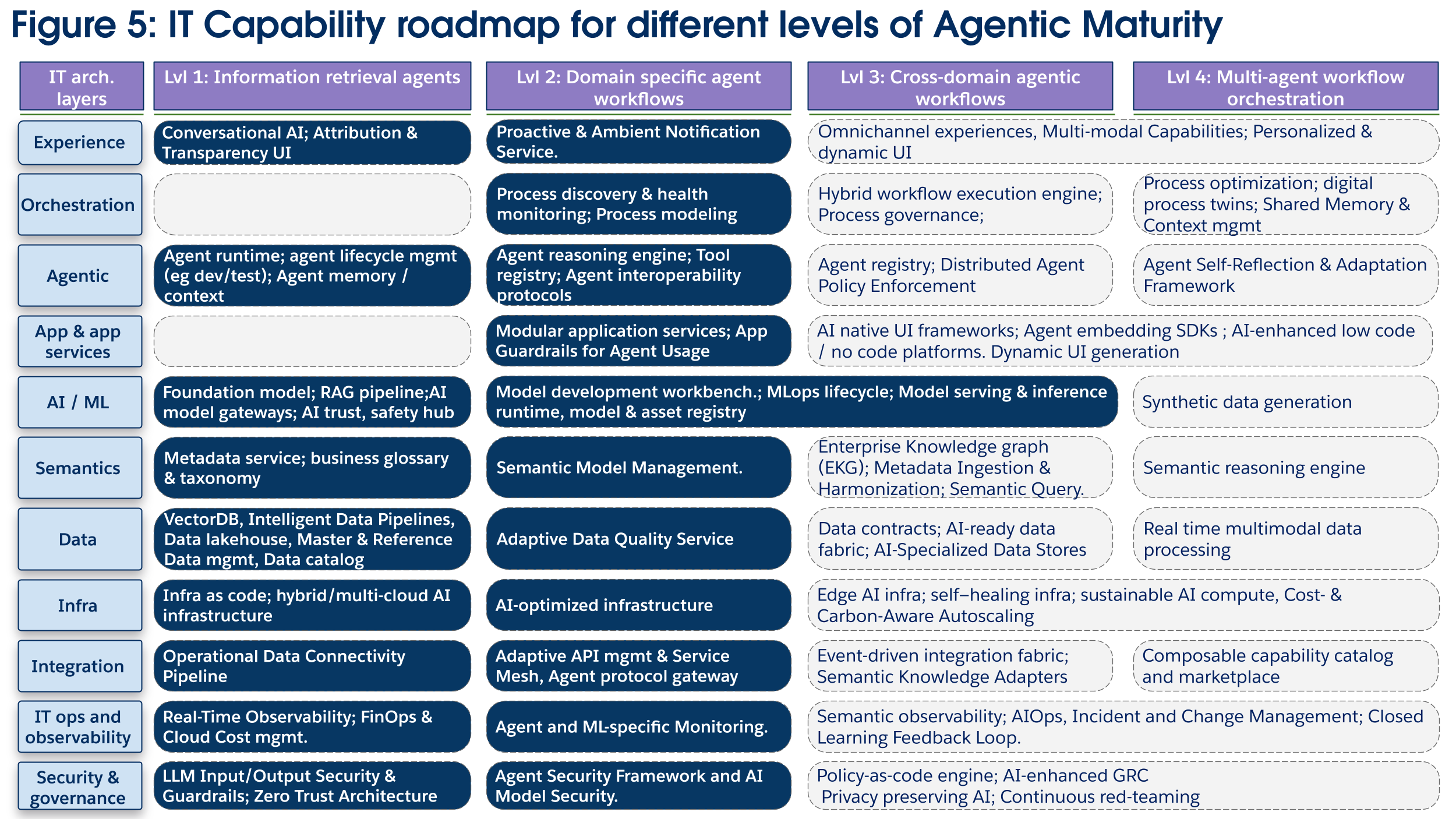

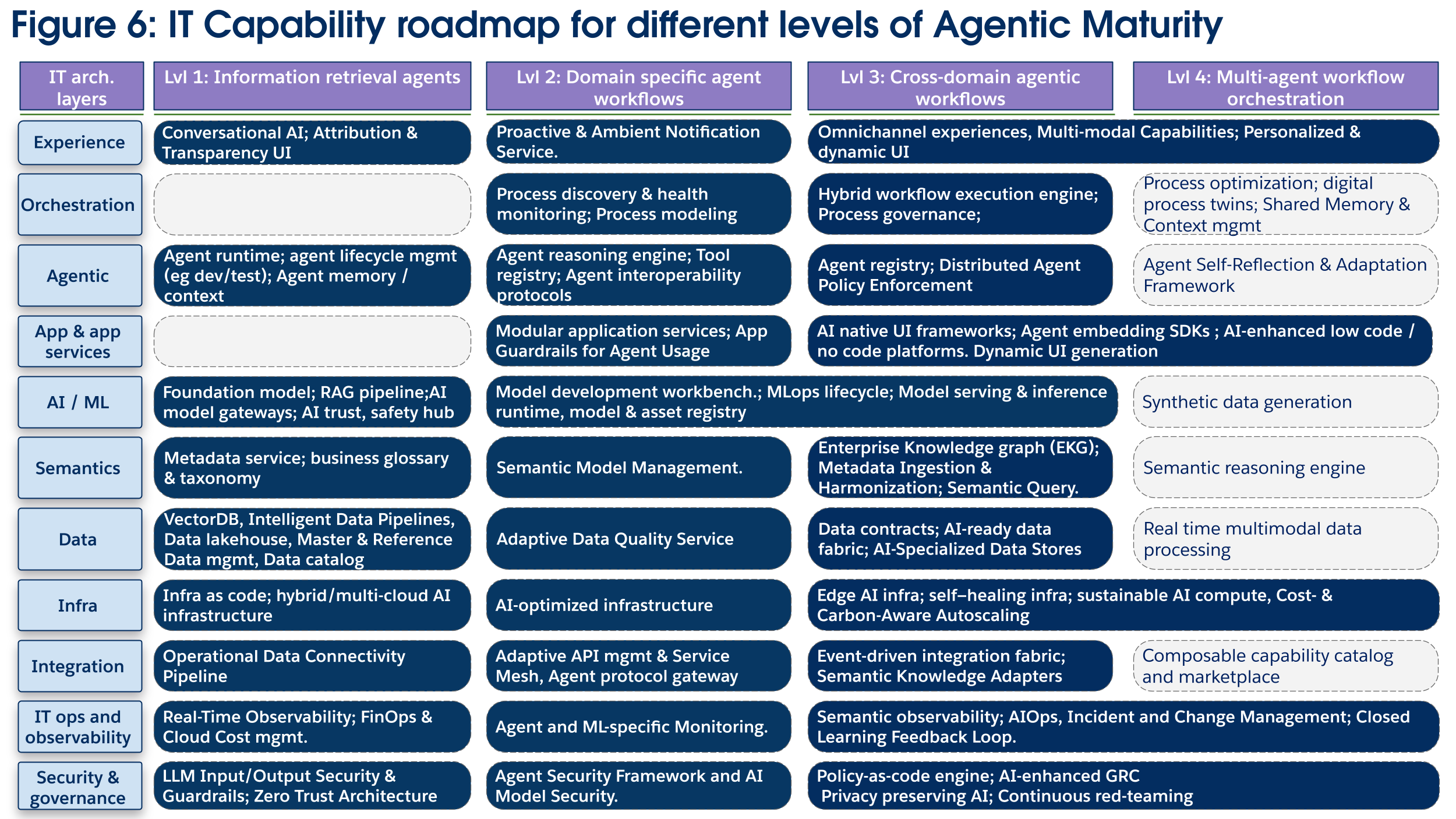

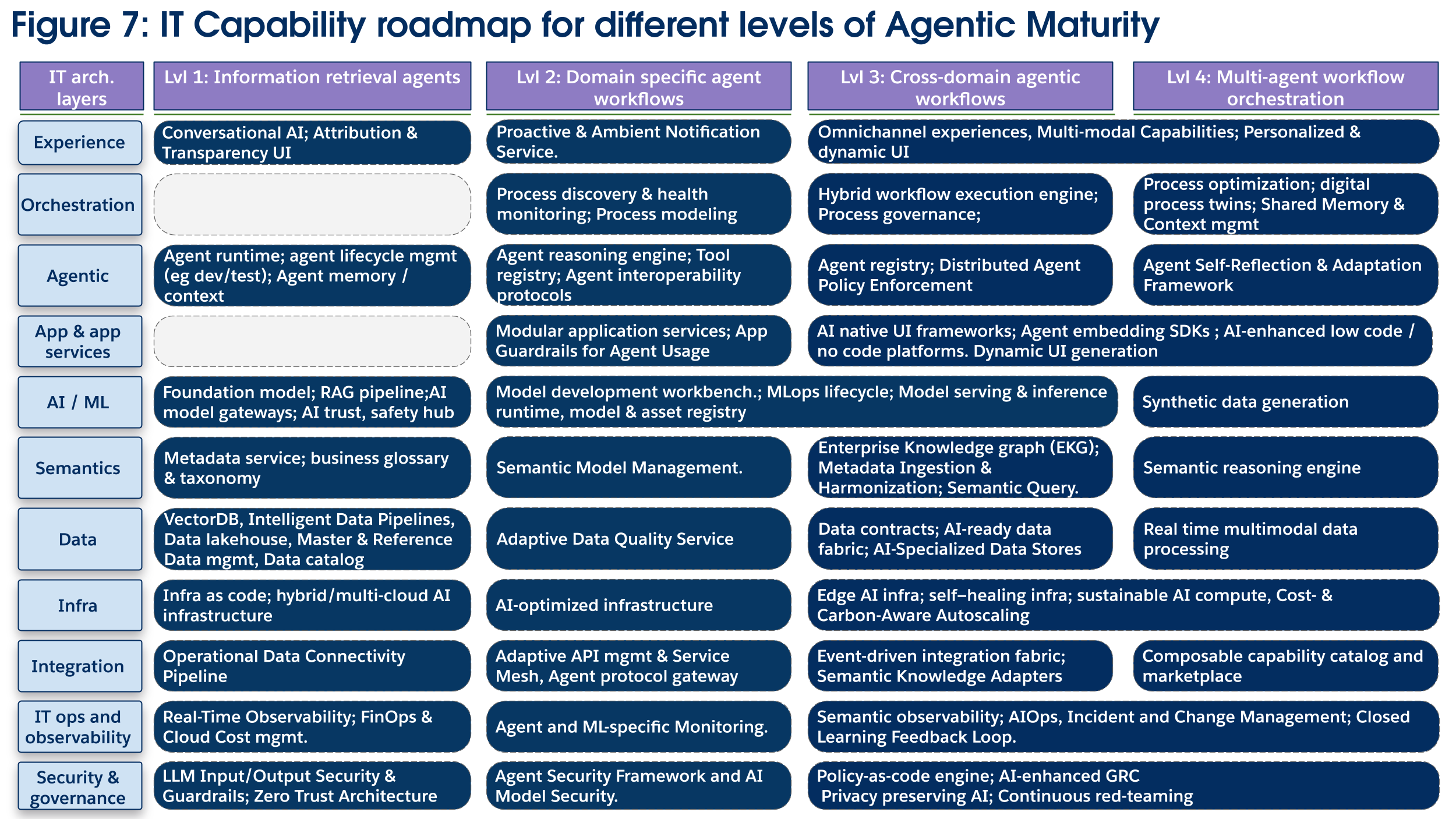

Die Umwandlung in Agentic Enterprise erfordert eine mehrstufige Journey, bei der die technologischen Grundlagen geschaffen und gleichzeitig ein spürbarer Geschäftswert geschaffen wird (siehe Abbildung 3). Während die genaue Roadmap von der Strategie, der Kultur, dem AI-Governance-Modell und dem Ausgangspunkt der IT-Architektur des Unternehmens abhängt, sollten die meisten Organisationen einen phasenweisen Ansatz verfolgen, da fortlaufende IT-Investitionen Agenten mit wachsendem Umfang, Komplexität und Wertschöpfung antreiben. Das Agentic Reifegradmodell von Salesforce bietet Unternehmen ein nützliches Framework für Reifegrade, um ihre Transformation zu strategisieren. Darin wird dargelegt, wie Agentenfunktionen vom grundlegenden Informationsabruf (Ebene 1) zur Orchestrierung komplexerer Workflows mit mehreren Domänen (Ebene 2 und 3) und mehreren Agenten (Ebene 4) wachsen können. Um diese Phasen erfolgreich zu durchlaufen, muss sich die IT-Architektur konzertiert weiterentwickeln, wobei in jeder Phase gezielt in verschiedene Ebenen der Architektur investiert werden muss, um die Anforderungen komplexerer und hochwertiger Bereitstellungen von AI-Agenten zu erfüllen. Für jeden Reifegrad werden die spezifischen Technologiefähigkeiten, die für die 11 Architekturebenen erforderlich sind, mit einer Begründung für Investitionen identifiziert.

Reifegrad 1: Agenten zum Abrufen von Informationen

Geschäftsziel und Wert: Steigern Sie die Produktivität menschlicher Mitarbeiter, indem Sie eine vertrauenswürdige Unterhaltungsoberfläche für die Abfrage von Enterprise Knowledge bereitstellen. Der primäre Wert besteht darin, die menschlichen Fähigkeiten zu erweitern und nicht zu ersetzen. Diese Agenten unterstützen Menschen, indem sie Informationen abrufen und Aktionen empfehlen.

Architekturfokus: Der Fokus liegt auf der Schaffung einer sicheren, zuverlässigen Datengrundlage und den grundlegenden AI-Komponenten, die für den Informationsabruf erforderlich sind. Governance und Beobachtbarkeit sind vom ersten Tag an wichtig, um User Trust aufzubauen und die Kosten zu kontrollieren.

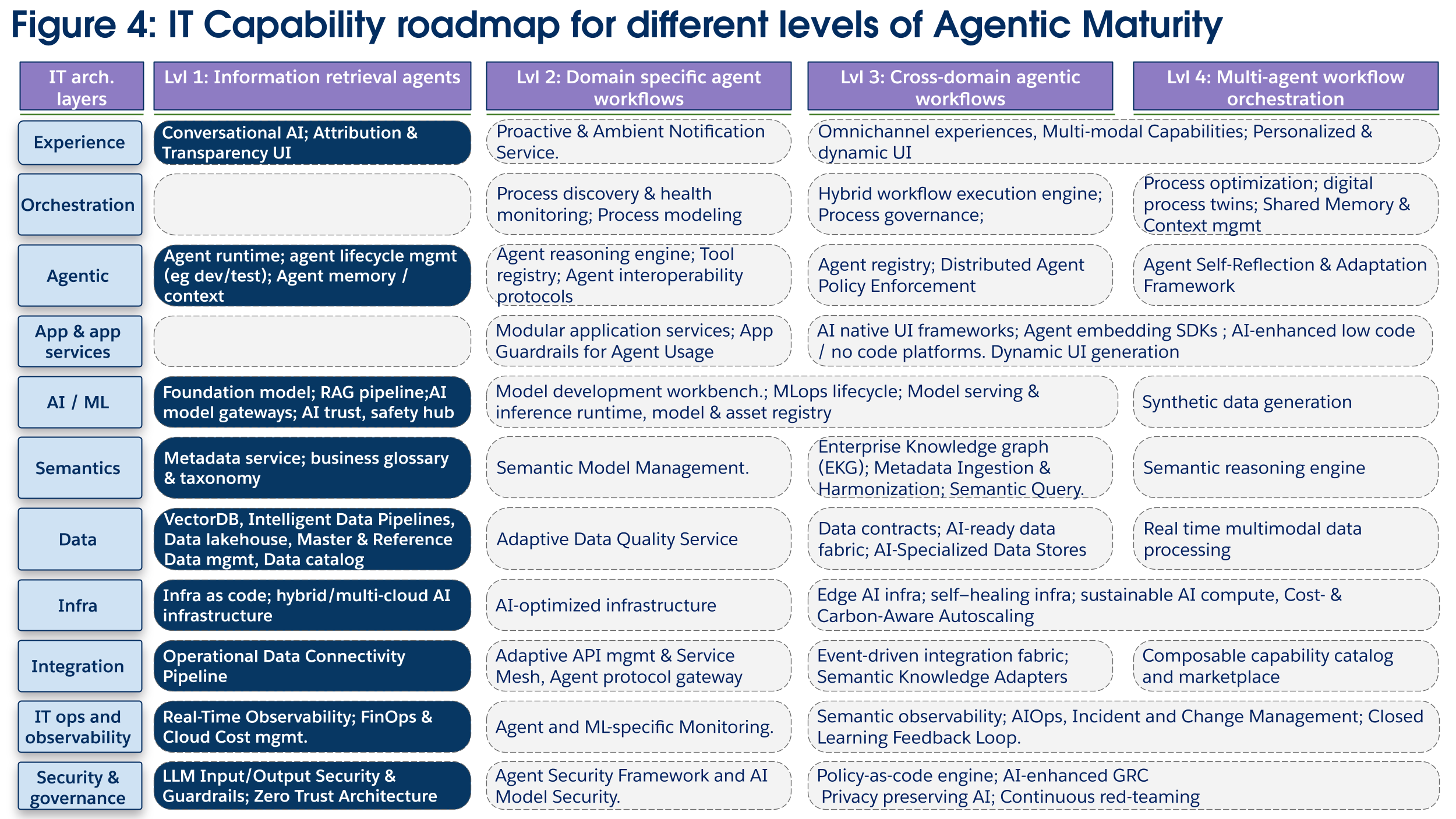

Wichtige Technologieinvestitionen (Abbildung 4):

In dieser Phase sollte sich die IT auf die Erstellung einer vertrauenswürdigen Pipeline für die Datenzuweisung zu Agenten und andere Grundlagenfunktionen konzentrieren. Technologien in der Datenebene wie eine VectorDB sind für die Aktivierung der RAG-Techniken (Retrieval Augmented Generation) wichtig, die Agenten zum Abrufen von Informationen unterstützen. Dies ist mit einer zentralisierten AI/ML-Ebene gekoppelt, die ein Modell-Gateway für sicheren, kostengesteuerten Zugriff auf Grundlagenmodelle und ein AI Trust, Safety & Governance Hub zur Überwachung unsicherer Ausgaben und zur Sicherstellung der Einhaltung von Vorschriften enthält. Die Stammdatenverwaltung und Geschäftsglossare in der semantischen Ebene sind die Grundlage für Agenten, um genaue Informationen abzurufen. Agentenlaufzeit und Lebenszyklusfunktionen sind erforderlich, um sicherzustellen, dass in dieser Phase erstellte Agenten geändert und für künftige Anwendungsfälle erweitert werden können. Die Erfahrungsebene muss eine Benutzeroberfläche für Attribution und Transparenz enthalten, die Agentenantworten durch die Anzeige von Zitaten und Quellen ihrer Informationen erklärbar macht, um einen Mehrwert zu bieten und das Vertrauen der Benutzer zu stärken. Grundlegende Investitionen in Beobachtbarkeit und Sicherheit (z. B. Null Trust) müssen mit der Umsetzung beginnen, um die Weichen für künftige Bereitstellungen von Agenten zu stellen.

Reifegrad 2: Einfache Orchestrierung, Einzeldomänenagenten

Geschäftsziel und Wert: Automatisieren Sie Routineaufgaben und orchestrieren Sie Workflows mit geringer Komplexität in einer einzigen Geschäftsdomäne. Dies verbessert die betriebliche Effizienz und reduziert die manuelle Arbeit, sodass sich die Mitarbeiter auf Tätigkeiten mit höherem Wert konzentrieren können.

Architekturfokus: Die wichtigste architektonische Verschiebung besteht darin, Daten schreibgeschützt abzurufen und Aktionen auszuführen. Dies erfordert den Beginn einer längeren Reise zur Modularisierung der Anwendungsfunktionen (oft als APIs verfügbar), auf die Agenten zugreifen können, die Implementierung zuverlässiger Sicherheit für Agentenaktionen und die Erstellung semantischer und AI-Entwicklungsfunktionen, um die Intelligenz von AI-Agenten zu verbessern.

Wichtige Technologieinvestitionen (Abbildung 5):

Die Investitionen konzentrieren sich thematisch darauf, AI-Agenten in die Lage zu versetzen, Maßnahmen mit ordnungsgemäßer Unternehmensführung zu ergreifen. Die Ebene "Anwendungen und Anwendungsservices" unterliegt einer wichtigen Änderung, da monolithische Geschäftslogik in modulare Anwendungsservices (APIs) zerlegt wird, die Agenten aufrufen können. Diese sind durch Anwendungsleitplanken geschützt, um zu verhindern, dass Agenten Systeme überfordern, und Integrationen in Tools zur Beobachtung möglich. Damit diese Agenten unterstützt werden, müssen Investitionen in Agentenüberlegungen, Toolprotokolle (wie MCP) und Registrierungen getätigt werden. Dies birgt neue Risiken, sodass ein spezielles Agentensicherheits-Framework und AI-Modell sowie Agentenüberwachungsfunktionen für die Verwaltung und Sicherheit unerlässlich sind. Schließlich können Unternehmen mit der Skalierung ihrer AI/ML-Funktionen für benutzerdefinierte Modelle beginnen, um diese Agenten bei domänenspezifischen Aufgaben zu unterstützen.

Reifegrad 3: Orchestrierungsagenten mit mehreren Domänen

Geschäftsziel und Wert: Automatisieren Sie komplexe durchgängige Geschäftsprozesse, die organisatorische und funktionale Grenzen umfassen (z. B. "Angebotserfassung", "Auftragsverwaltung"). Der Wert liegt darin, Silos abzubauen, Prozesszykluszeiten zu beschleunigen und ganze Wertschöpfungsketten innerhalb des Unternehmens zu optimieren. Höhere Änderungen bei der Produktivität menschlicher Mitarbeiter sind möglich, da organisatorische Barrieren abzubauen beginnen und sich die Menschen mehr auf die Beaufsichtigung von AI-Agenten konzentrieren.

Architekturfokus: Die Architektur muss nun übergreifende technische Probleme unterstützen. Ein gemeinsames semantisches Verständnis im gesamten Unternehmen, ein zentralisiertes Orchestrierungsmodul für die Unternehmensführung und ein entkoppeltes, ereignisgesteuertes Integrationsgefüge werden zu den entscheidenden Enablern.

Wichtige Technologieinvestitionen (Abbildung 6):

Technologieinvestitionen konzentrieren sich thematisch auf die Orchestrierung von Prozessen im Unternehmensmaßstab über Menschen, Agenten und deterministische Systeme hinweg. Die Unternehmensorchestrierungsebene rückt in den Fokus von Investitionen, da ein Hybrid-Workflowausführungsmodul zur Koordinierung von Aktivitäten und ein Prozessführungs- und Beschränkungsmodul zur Durchsetzung von Geschäftsregeln und Compliance-Richtlinien in laufenden Prozessen erforderlich sind, da Agenten domänenübergreifend arbeiten, oft mit unterschiedlichen Richtlinien und semantischen Definitionen. Diese domänenübergreifende Koordinierung ist nur mit einer ausgereiften Semantic Layer möglich, die ein Enterprise Knowledge Graph (EKG) aufweist, das ein gemeinsames Verständnis der domänenübergreifenden Beziehungen zwischen Unternehmenseinheiten schafft. Die Integrationsebene muss zu einer ereignisgesteuerten Integrations-Fabrik weiterentwickelt werden, die ein Streaming-Backbone verwendet, um Systeme zu entkoppeln und die für langfristige Unternehmensprozesse typische robuste, asynchrone Kommunikation zu ermöglichen. Angesichts des höheren Werts dieser Workflows und der damit verbundenen Risiken sind zusätzliche Investitionen in Sicherheit und Überwachung von entscheidender Bedeutung (z. B. AIOps, Policy-as-Code). Schließlich müssen weitere Investitionen in die Anwendungs- und Serviceebene (z. B. AI-fähige LCNC, dynamischere und multimodalere Benutzererfahrungen) getätigt werden, wenn menschliche Benutzer beginnen, leistungsfähigere AI-Agenten zu überwachen und mit ihnen zusammenzuarbeiten.

Reifegrad 4: Orchestrierung mit mehreren Agenten und mehreren Domänen

Geschäftsziel und Wert: Konzipieren und optimieren Sie Geschäftsvorgänge domänenübergreifend, um schrittweise Änderungen an Produktivität und Effizienz voranzutreiben. In dieser Phase wird eine ganzheitliche digitale Simulation (digitaler Zwilling) des Unternehmens für die kontinuierliche Verbesserung und strategische Planung über wichtige Geschäftsprozesse und Workflows hinweg erstellt.

Architekturfokus: In der letzten Phase steht die dynamische, neu entstehende Zusammenarbeit zwischen Agenten im Mittelpunkt. Dies erfordert erweiterte A2A-Kommunikationsprotokolle (Agent-zu-Agent), Funktionen zum Selbstlernen von Agenten, weitere Investitionen in die Ausreifung der Orchestrierungs-, Daten- und Semantikebenen sowie eine vollständig dynamische und selbstheilende Infrastruktur, um die wachsenden Anforderungen an dynamische AI-Arbeitslasten zu erfüllen, da Agenten im gesamten Unternehmen skaliert wurden.

Wichtige Technologieinvestitionen (Abbildung 7):

Thematische Investitionen konzentrieren sich auf die Schaffung eines sich selbst verbessernden, autonomen Systems. Auf der Agentenebene bietet ein Agenten-Selbstreflexions- und -anpassungs-Framework den Mechanismus, mit dem ein Agent seine eigenen Leistungsprotokolle analysieren und Verbesserungen auslösen kann. Dieses Lernen wird von der IT Operations and Observability Layer (Ebene für IT-Vorgänge und Beobachtungsfähigkeit) unterstützt, die eine geschlossene Lernfeedbackschleife implementiert, um automatisch Beobachtungsdaten in MLOps-Pipelines für die Modellneuschulung zurückzugeben, wodurch auch die Generierung synthetischer Daten genutzt werden kann, um die Modellleistung weiter zu optimieren. Da Agentennetzwerke abteilungsübergreifend bereitgestellt werden und die Modularisierung von Anwendungen kontinuierlich vorangetrieben wird, sind weitere Investitionen in die Sicherheit und vor allem ein komponierbarer Funktionskatalog erforderlich, damit Agenten Funktionen dynamisch zusammenstellen können, um abstraktere und hochwertigere Aufgaben zu lösen. Diese Prozesse werden alle über die neue Funktion "Digital Twin Process Modeling" (Digitale Zwillingsprozessmodellierung) orchestriert und optimiert, die Echtzeitdaten verwendet, um Simulationen für Was-wäre-wenn-Analysen und Prognoseoptimierungen zu erstellen, sodass Unternehmen neue Agentenbereitstellungen sicher testen und bereitstellen können.

Schlussfolgerung

Die Roadmap zu einem Agentic Enterprise durchläuft eine IT-Architekturentwicklung. Enterprise-Architekten werden die entscheidenden Treiber dieser Transformation sein und zusammen mit anderen Partnern im Geschäft und in der IT die wichtigen Investitionsentscheidungen treffen, die für die Organisation erforderlich sind, um den Wert der neuen Geschäftsfunktionen des Agentic Enterprise zu realisieren.